基于无人机数码影像的玉米育种材料株高和LAI监测

2018-03-10牛庆林冯海宽杨贵军李长春赵衍鑫

牛庆林,冯海宽,杨贵军※,李长春,杨 浩,徐 波,赵衍鑫

(1. 农业部农业遥感机理与定量遥感重点实验室,北京农业信息技术研究中心,北京 100097;2. 国家农业信息化工程技术研究中心,北京 100097;3. 北京市农业物联网工程技术研究中心,北京 100097;4. 河南理工大学测绘与国土信息工程学院,焦作 454000;5. 北京市农林科学院玉米研究中心,北京 100097)

0 引 言

基于无人机遥感平台搭载不同的微小型传感器构建超低空遥感数据获取系统可快速、无损和高通量地获取田间作物表型信息,因其机动灵活、操作简单且获得的遥感影像空间分辨率高等特点,成为田间作物表型信息监测技术研究的热点[1-2]。田间作物株高(height,H)和叶面积指数(leaf area index,LAI)是作物表型参数的重要组成部分[3],是评价作物长势和预测产量的重要依据[4-7]。因此,利用无人机遥感技术快速、无损和高通量地监测田间玉米育种材料的H和LAI表型参数,对其长势监测及产量预测具有重要的意义[8]。

无人机多光谱、高光谱和激光雷达(light detection and ranging,LIDAR)传感器因其价格昂贵,且后续的数据处理过程相对复杂,阻碍了无人机遥感技术在田间作物表型信息监测中的应用[9-15]。数码相机传感器具有空间分辨率高[16],微型化和智能化且价格低的特点,这使得无人机搭载高清数码相机传感器作为一种低成本的遥感数据获取系统得到快速发展。利用无人机搭载高清数码相机获取试验田的高清数码影像,构建多种类型的可见光植被指数,筛选出敏感的植被指数对大豆育种材料和冬小麦的 LAI具有较好的估算能力,R2分别达到 0.68和0.71[17-18];利用地面控制点(ground control point,GCP),结合获取的高清数码影像生成试验田的数字表面模型(digital surface model,DSM),通过DSM提取作物H,分别用H和可见光植被指数估测LAI,并将结果进行对比,表明基于DSM提取的H比可见光植被指数估测精度更高,R2达到0.9[19];Luo等[20]基于LIDAR提取的H,估测低矮湿地植被的 LAI,R2达到 0.79。H是作物长势监测的重要指标,与倒伏性状密切相关,是重要的作物表型参数之一[4,21]。基于无人机高清数码影像结合 GCP生成试验田多生育期的DSM,并提取H,进行了冬小麦的生长率变化监测[22];基于低成本的无人机高清数码影像,将得到的H和可见光植被指数进行信息融合,准确地估测了玉米的地上生物量,R2达到0.8左右[23]。基于多生育期的无人机高清数码影像,构建可见光植被指数,进行不同生育期水稻叶片叶绿素含量的估测(相关系数0.78),表明高清数码影像能够用于水稻叶片叶绿素含量的监测[24];基于可见光植被指数分别进行单生育期和多生育期的水稻产量估测,R2分别达到 0.71和 0.73[25]。

然而将无人机高清数码影像提取作物H的方法应用于玉米育种材料H的监测及将H和可见光植被指数进行融合后估测 LAI的研究还很少。该文以玉米育种材料为研究对象,利用无人机高清数码影像结合GCP生成试验田的DSM,提取玉米育种材料H;利用可见光植被指数和可见光植被指数与H融合后分别估测LAI,并对比分析LAI估测结果,以期将低成本的无人机高清数码影像应用于玉米育种材料H和LAI的监测,为综合评价玉米育种材料的长势及产量提供一种快速、无损和高通量的田间监测技术手段。

1 材料与方法

1.1 试验材料与设计

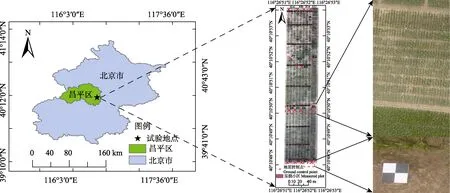

于2017年5—9月在北京市昌平区小汤山镇国家精准农业研究示范基地的玉米育种材料试验田进行田间试验,地处北纬 40°10′48″~40°10′54″N,东经 116°26′51″~116°26′53″E,海拔高度约30 m,土壤类型为潮土,一年只种植一季玉米育种材料。试验田属暖温带,半湿润大陆性季风气候,春季干旱多风,夏季炎热多雨,秋季凉爽,冬季寒冷干燥,四季分明,平均无霜期180至200 d。年平均气温约为10~12 ℃,年降雨量644 mm左右,其中降雨主要集中在夏季,降水可达全年的70%~80%,其他月份降雨相对较少。

试验田共种植800份玉米育种材料,播种时间为2017年5月15日,每份育种材料种植3行,株距0.25 m,行距0.6 m,行长2 m,共种植8排,每排之间的距离0.8 m,所选育种材料具有较好的代表性,南边设置4行保护行,北边设置2行保护行。为了精确地获取试验田的 DSM,本试验在试验田内均匀地布设了16个GCP,GCP由0.3 m×0.3 m的木板(其上粘贴一张有黑白标志的聚录乙烯成分的塑料软板,目的是准确地确定木板的几何中心位置)和埋于地下的木桩组成,并且用螺丝钉将其固定在一起,防止 GCP在获取不同生育期的无人机高清数码影像时发生空间位置的移动,其三维空间位置用差分 GPS进行测量。试验田栽培管理措施与一般大田管理措施相同,地面随机选取 72个实测玉米育种材料小区,如图 1所示。

图1 玉米育种材料试验田位置及试验设计Fig.1 Location and experiment design of maize breeding materials experimental plot

1.2 地面数据获取

分别于拔节期(2017年6月29日)、喇叭口期(2017年7月11日)和抽雄吐丝期(2017年7月28日)3个关键生育期采集田间玉米育种材料H和LAI数据。玉米育种材料H的观测方法为:在每个小区的每一行的中间位置处选取1株玉米,使用塔尺测量其H,每个小区有3行,得到3个H观测值,取其平均值作为测量小区的平均H。在拔节期和喇叭口期的H是以第一片完全展开叶的自然高度,作为植株的高度,在抽雄吐丝期是以雄穗顶端的高度,作为植株的高度。利用LAI-2200C型植物冠层分析仪(美国LI-COR, www.ecotek.com.cn)对选取的72个小区进行LAI的测量。LAI-2200C型植物冠层分析仪利用“鱼眼”光学传感器(垂直视野范围 148°,水平视野范围360°)测量作物冠层上、下5个角度的透射光线,利用植被冠层的辐射转移模型计算LAI冠层结构参数。LAI-2200C型植物冠层分析仪基于成熟的LAI-2000技术平台,并内置GPS模块,能够整合GPS信息,进行散射光校正,从而使 LAI-2200C型植物冠层分析仪适用于任何天空条件下的任何冠层测量。LAI测量时,尽量避免太阳光直射,在测量者面对太阳的方向上,旋转180°,即在背向太阳光一侧,先测一个天空光,再依次放在靠近玉米育种材料根部位置测量 4个目标值,在仪器进行测量时,保持镜头水平,最后获得小区平均LAI值。

1.3 无人机数据获取及预处理

分别于苗期(2017年6月8日)、拔节期(2017年6月29日)、喇叭口期(2017年7月11日)和抽雄吐丝期(2017年7月28日)4个关键生育期获取玉米育种材料试验田的无人机高清数码影像。利用八旋翼电动无人机(单臂长386 mm,机身净质量4.2 kg,载物质量6 kg,续航时间 15~20 min)搭载高清数码相机为无人机遥感数据获取平台,并配备位置与姿态系统(position and orientation system,POS)实时获取数据采集时刻传感器位置和姿态信息。高清数码相机型号为索尼 Cyber-shot DSC-QX100,其主要参数为:质量179 g;尺寸62.5 mm×62.5 mm×55.5 mm;2 090万像素CMOS传感器;焦距10 mm(定焦拍摄)。影像获取时,太阳光辐射强度稳定,天空晴朗无云,无人机飞行高度60 m,获得的影像空间分辨率为0.013 m。借助Agisoft PhotoScan Professional软件进行无人机高清数码影像的拼接处理,生成试验田的高清数字正射影像(digital orthophoto map,DOM)和DSM。从无人机POS系统中导出POS数据,每一个POS数据与无人机获取的高清数码影像是一一对应的,包含每张影像拍摄时刻的经度、纬度、高度、偏航角、俯仰角和旋转角共 6个元素,表征影像获取时刻的空间位置和姿态信息。无人机高清数码影像的拼接流程:基于POS数据和对应的无人机高清数码影像进行影像拍摄时刻空间姿态的还原,并生成飞行区域的稀疏点云;基于稀疏点云建立空间格网,并将GCP添加到空间格网中,导入GCP对应的三维空间坐标信息,并对影像的空间姿态进行进一步的优化,生成具有精确空间信息属性的稀疏点云;基于具有空间属性信息的稀疏点云进行飞行区域密集点云的构建,生成飞行区域表面的3D多边形格网,即飞行区域表面几何结构的生成,并构建其空间纹理信息,最终生成飞行区域玉米育种材料试验田的DOM和DSM,具体的处理流程如图2所示。

图2 基于GCPs的无人机高清数码影像生成高清数字正射影像(DOM)和数字表面模型(DSM)的处理流程Fig.2 Processing flow of digital orthophoto map (DOM) and digital surface model (DSM) generated by using high-resolution digital images of UAV combined with GCPs

1.4 数码影像变量选取

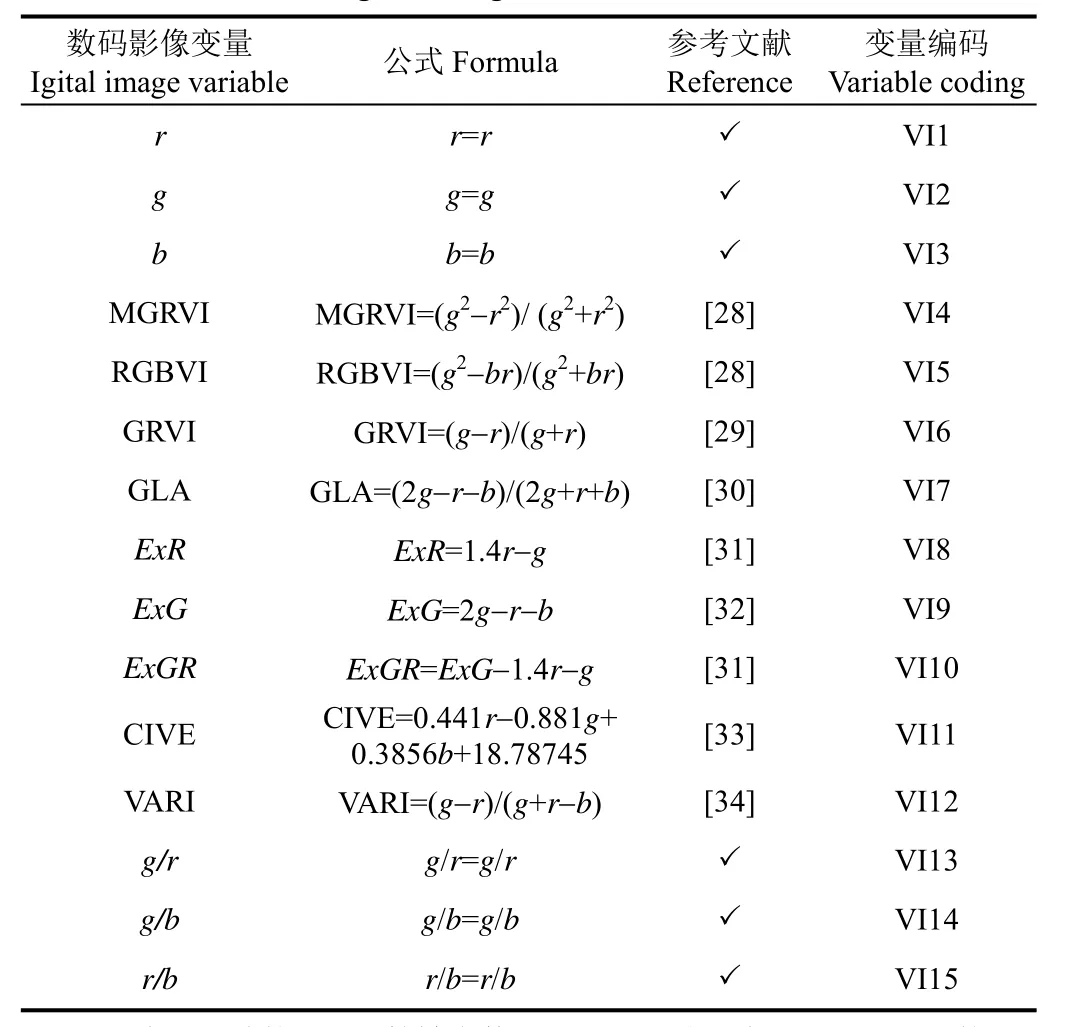

基于玉米育种材料试验田的 DOM 提取每个实测小区的冠层红、绿和蓝通道的平均DN(digital number,DN)值,进行归一化处理,即将红、绿和蓝通道的DN值分别定义为R、G和B,进行归一化后得到数码影像变量[24-27],分别定义为r、g和b。

依据已有研究成果及LAI和可见光植被指数之间的关系,选择12个可见光植被指数,共15个数码影像变量进行LAI的估测,如表1所示。

表1 与LAI相关的数码影像变量Table 1 Digital image variables related to LAI

1.5 数据分析方法

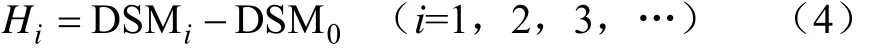

玉米育种材料H的提取,即在试验田内获取不同生育期的无人机高清数码影像,结合 GCP,利用 Agisoft PhotoScan Professional软件生成玉米育种材料试验田的DSM,通过不同生育期的DSM之间的作差运算,得到相应生育期玉米育种材料的 Hi,作为玉米育种材料长势信息监测的一种指标。如图3所示为基于DSM提取H的原理图,其中在 t0时,此时试验田为播种后至出苗前的裸土或植株较小近似裸土的苗期,获取试验田无人机高清数码影像,结合GCP,生成试验田的DSM,即DSM0,可以得到试验田高精度的高低起伏变化情况,作为后期H数据提取的地表基准面;在 t1、t2、t3、…、ti(ti代表玉米育种材料的关键生育期)时间,进行试验田无人机高清数码影像的获取,使用与t0时生成DSM0相同的GCP,生成试验田玉米育种材料的DSM,分别为DSM1、DSM2、DSM3、…、DSMi;通过将 DSMi(i=1,2,3,…)与DSM0进行作差,得到对应ti生育期玉米育种材料的Hi,即式(4)。

图3 基于DSM的株高提取原理Fig.3 Principle of height extraction based on DSM

玉米育种材料LAI的估测,首先,将选取的数码影像变量和实测H与LAI进行相关性分析,得到数码影像变量和H与LAI的相关关系;其次,基于逐步回归分析方法,随机选择 70%的样本数据作为估算数据集,构建LAI的估算模型,利用未参与估算的 30%样本数据作为验证数据集,进行 LAI估算模型预测能力的评价。逐步回归分析在进行估算模型的建立时,模型会一次添加或删除一个变量,在每一步中,变量都会被从新评价,对模型没有贡献的变量将会被删除,预测变量可能会被添加、删除好几次,直到得到最优模型为止。赤池信息量准则(akaike information criterion,AIC)考虑了模型的统计拟合度以及用来拟合的变量数目,AIC值较小的模型需优先选择,它表明模型用较少的变量获得了足够的拟合度。

1.6 统计分析

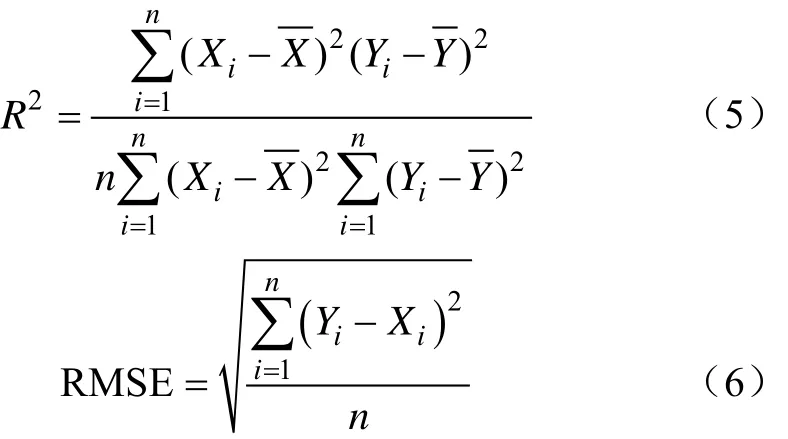

选取决定系数(R2)、均方根误差(RMSE)和归一化的均方根误差(nRMSE)作为评价估算模型与验证模型的指标。估测模型与验证模型的 R2越大,相对应的RMSE和nRMSE越小,则模型估算能力越好。其计算公式分别为

2 结果与分析

2.1 基于无人机数码影像的玉米育种材料株高监测

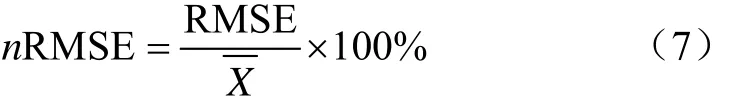

利用Agisoft PhotoScan Professional软件,将获得的苗期无人机高清数码影像及GCP进行数据拼接处理,分别生成苗期玉米育种材料的DSM0和DOM0,其结果如图4所示。

图4 玉米育种材料苗期的DSM0和DOM0Fig.4 DSM0 and DOM0 of maize breeding materials at seeding stage

从DSM0得到,玉米育种材料试验田的地势为南低北高的趋势,并且地势变化也不均匀,与通过具有代表性的离散地面高程点内插生成DSM相比[19],结合GCP生成的DSM0更符合客观的实际地形高低起伏分布情况;从DOM0得到,试验田的玉米育种材料苗较小,整体上呈现裸土的颜色。综合DSM0和DOM0所呈现的信息,将DSM0作为其他生育期提取玉米育种材料H的地表基准面。

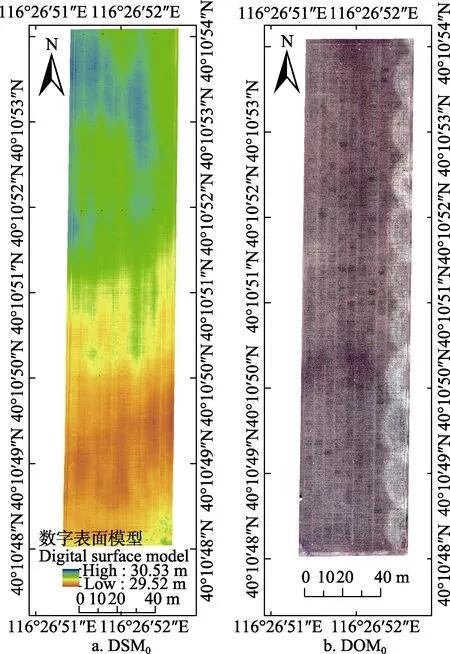

分别将拔节期、喇叭口期和抽雄吐丝期获取的无人机高清数码影像结合 GCP进行拼接处理生成对应的DSM 和 DOM,即 DSM1和 DOM1、DSM2和 DOM2、DSM3和 DOM3。基于 H 提取公式(4),将 DSM1、DSM2和DSM3分别于DSM0进行作差,得到拔节期、喇叭口期和抽雄吐丝期的H分别为H1、H2和H3,结果如图5所示。

将H图与相对应的DOM图进行综合分析,对提取的玉米育种材料H进行评价。其中H1的提取结果较差,H2的南半部分提取结果较好,北半部分提取结果较差,H3的提取结果较好,这主要与玉米育种材料的冠层空间结构有关,即行与行之间的封垄状况。拔节期的H1提取结果较差,是由于此时期南半部分玉米育种材料处于未完全封垄状态,而由于玉米育种材料自身特性的差异,北半部分玉米育种材料多数处于未封垄状态,有少数处于未完全封垄状态;在没有提取到H信息相对应的区域玉米育种材料长势较弱,行与行之间的空隙较大,而提取到H信息的部分,玉米育种材料长势较旺。喇叭口期的H2南半部分提取结果较好而北半部分提取结果相对较差,南半部分的玉米育种材料较多处于完全封垄状态,只有极个别的玉米育种材料小区处于未完全封垄状态,而北半部分玉米育种材料,长势相对较弱,处于未完全封垄状态,有极个别的玉米育种材料行与行之间的空隙较大,导致提取的H结果不理想。抽雄吐丝期的H3提取结果较好;此时期的玉米育种材料基本上全处于封垄状态,长势较为旺盛,除极个别玉米育种材料自身长势较弱外,整体上株高的提取结果较好。

图5 基于DSM提取的玉米育种材料的株高和DOMFig.5 Height extracted from DSM and DOM of maize breeding materials

结合玉米育种材料的封垄状态,提取DSM上完全封垄或未完全封垄但长势旺盛小区的 H,共得到 145个,和对应的实测H数据进行对比,其结果如图6所示,基于DSM提取的H和实测的H高度拟合 R2、RMSE和nRMSE分别为0.93, 28.69 cm和17.90%。

图6 基于DSM提取玉米育种材料的株高和对应实测株高的对比Fig.6 Comparison of height extracted from DSM and corresponding measured height of maize breeding materials

2.2 进行玉米育种材料LAI的估测

2.2.1 数码影像变量及株高与LAI的相关性分析

基于高清DOM,查看相应实测小区中行与行之间的间隙,筛选出未封垄的实测小区,将未完全封垄但长势旺盛或完全封垄的实测小区作为估算LAI模型的小区,共有176个,从高清的DOM上提取这些实测小区的R、G和B通道的平均DN值,并构建数码影像变量,和相对应的实测H数据,组成LAI模型构建的样本数据集。随机选择70%的样本数据组成估算数据集(124个样本),与对应的LAI进行相关性分析,其结果如图7所示。

图7 数码影像变量及H与LAI的Pearson相关系数分析结果Fig.7 Results of Pearson correlation coefficient analysis between digital image variables, H and LAI

参考相关系数检验临界值表进行变量的显著性检验,当自由度为124时,相关系数的绝对值大于0.23时,达到0.01显著性水平。从图7中可以得知,H、r、MGRVI、GRVI、ExR、ExGR、VARI和g/r与LAI之间的相关系数的绝对值均大于0.7,远大于0.23,达到0.01显著水平。

2.2.2 玉米育种材料LAI估测模型构建

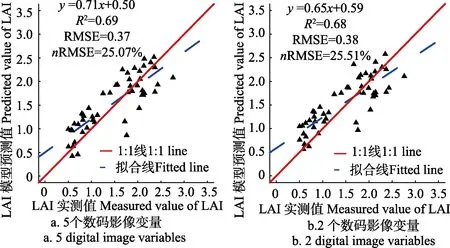

将选取的15个数码影像变量与玉米育种材料LAI进行逐步回归分析,构建LAI估算模型,并计算模型的AIC值、R2、RMSE和nRMSE,结果如表2所示。综合考虑逐步回归分析模型的评价指标,得到综合精度较好的两个逐步回归分析模型,分别包含5个(r、g、GRVI、g/b和r/b)和2个(r、r/b)数码影像变量,分别利用30%的验证数据集(52个样本),对估算模型进行验证,其散点图如图8所示。5个和2个数码影像变量估算模型的AIC值、R2、RMSE和 nRMSE分别为 131.21、0.66、0.39、25.40%和135.50、0.63、0.40、26.47%,5个数码影像变量估算模型比2个数码影像变量估算模型的AIC小4.29,R2大0.03,RMSE小0.01,nRMSE小0.77%。利用30%的验证数据集分别对这两个模型进行评价,5个和2个数码影像变量验证模型的R2、RMSE和nRMSE分别为0.69、0.37、25.07%和 0.68、0.38、25.51%,R2、RMSE和 nRMSE分别相差0.01,0.01和0.44%,表明2个模型的预测能力相当。

表2 数码影像变量与LAI的逐步回归分析结果Table 2 Results of stepwise regression analysis between digital image variables and LAI

将选取的 15个数码影像变量和相对应的实测 H共16个变量与玉米育种材料LAI进行逐步回归分析,构建LAI的估算模型,并计算模型的AIC值、R2、RMSE和nRMSE,结果如表3所示。综合考虑逐步回归分析模型的评价指标,选择了包含3个变量(H、g、g/b)的逐步回归模型进行玉米育种材料LAI的估测,估算模型的AIC值、R2、RMSE和nRMSE分别为116.59、0.69、0.37和24.34%,利用 30%的验证数据集对估算模型进行验证,其散点图如图9所示,其评价指标R2、RMSE和nRMSE分别为0.73、0.35和23.49%,表明模型具有较高的精度和稳定性。

图8 玉米育种材料LAI逐步回归模型预测值与实测值的关系Fig.8 Relationship between model estimated values of LAI of stepwise regression model including digital image variables and measured of LAI for maize breeding materials

表3 数码影像变量和株高与LAI的逐步回归分析结果Table 3 Results of stepwise regression analysis between digital image variables, H and LAI

图9 数码影像变量和株高的LAI逐步回归模型预测值与实测值的关系Fig.9 Relationship between model estimated values of LAI of stepwise regression model including digital image variables and H and measured of LAI for maize breeding materials

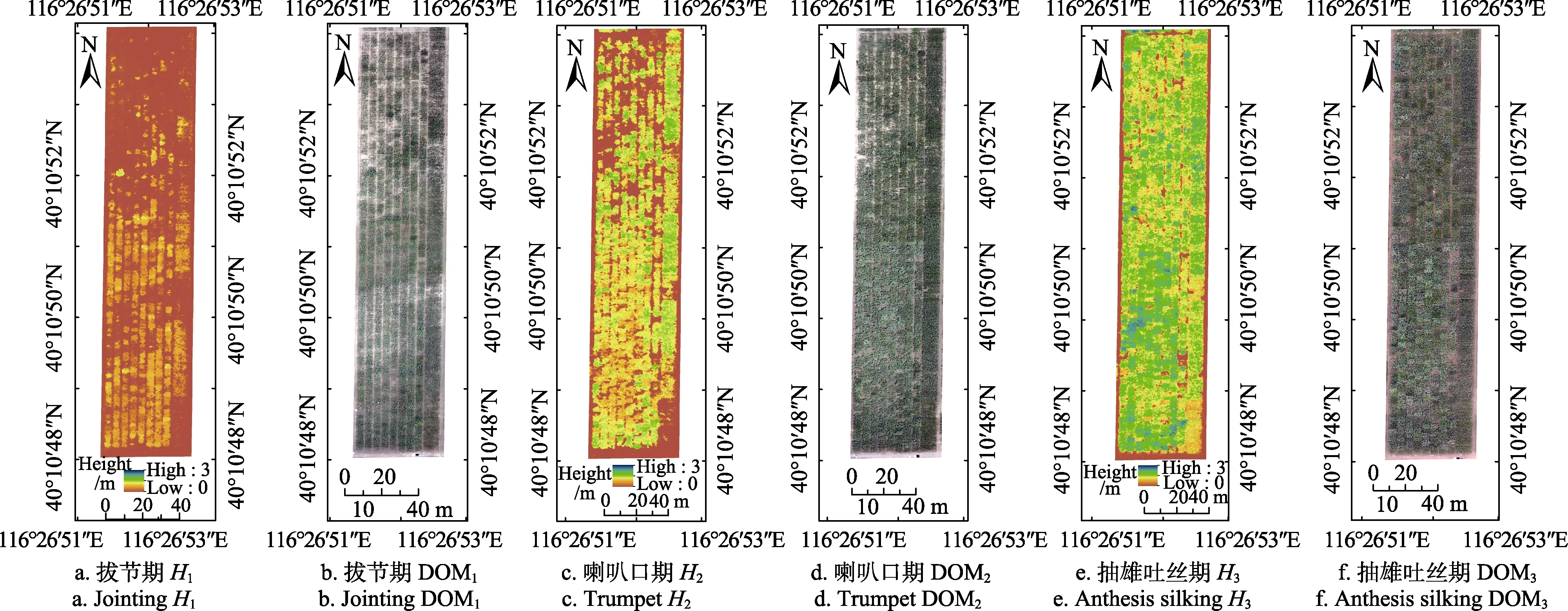

通过仅用数码影像变量构建玉米育种材料LAI估测模型的分析,综合考虑估算模型和验证模型的评价指标及模型的简单易用性,选择包含2个数码影像变量(r、r/b)的逐步回归模型为LAI的估算模型,并制作试验田玉米育种材料LAI的空间分布图,结果如图10a、10b和10c所示。通过H和数码影像变量进行融合构建玉米育种材料LAI估测模型的分析,选择了3个变量(H、g、g/b)的逐步回归模型为LAI的估算模型,在制作LAI空间分布图时需考虑H提取的结果精度。由于拔节期和喇叭口期的部分玉米育种材料长势较差,行与行之间的空隙较大,即冠层封垄状况较差,导致基于DSM提取的H结果较差,而抽雄吐丝期的玉米育种材料基本上处于完全封垄状态,提取的H数据结果较好。因此,基于抽雄吐丝期DSM提取的H数据结果,和相对应的DOM,将H和数码影像变量相融合的方法制作试验田玉米育种材料LAI的空间分布图,结果如图10d所示。

从图10得到,拔节期的玉米育种材料还处于生长期,整体的 LAI值相对较小,且不同的玉米育种材料之间的差异较小,只有极个别的玉米育种材料长势较为旺盛,其对应的LAI值也相对较大;喇叭口期的玉米育种材料处于快速生长的阶段,其长势旺盛,不同的玉米育种材料的品种差异在LAI的空间分布上得到呈现,部分材料的LAI较大,部分材料的LAI相对较小,在整个试验田内呈现出不均匀的分布情况;仅用数码影像变量估算抽雄吐丝期的LAI,与喇叭口期相比,LAI整体上继续增大,且不同的玉米育种材料的LAI空间差异明显,且与喇叭口期的 LAI空间差异不太一致,这可能与玉米育种材料自身的生长特性有关;将H和数码影像变量进行融合估算抽雄吐丝期的LAI,与仅用数码影像变量估算抽雄吐丝期的LAI相比,LAI值整体上偏小,但不同的玉米育种材料的 LAI差异较为明显,且与仅用数码影像变量估测LAI结果的空间分布趋势相一致,在监测不同的玉米育种材料的长势差异时,结果更好。

图10 玉米育种材料LAI估测的空间分布图Fig.10 Spatial distribution maps of estimated LAI of maize breeding materials

3 讨 论

3.1 玉米育种材料株高监测

基于作物的DSM提取其H对于精准农业田间生产管理具有重要的应用价值[19,35-38]。但已有的研究多集中于大田作物的栽培管理方面,且作物的品种相对较少。该文基于无人机高清数码影像结合GCP生成了试验田800份玉米育种材料DSM,提取了玉米育种材料的H,并将其中145个实测H与DSM提取H进行对比,其R2达到0.93,表明基于DSM提取玉米育种材料H具有较高的精度,这与已有的基于无人机RGB数码影像提取作物H的研究结果基本一致[19,35],为作物育种中 H的监测,提供了一种低成本、快速和高通量的监测技术手段。然而该文基于DSM提取的H整体偏低于实测H,这主要是由高清数码影像构建玉米育种材料冠层结构三维点云的摄影测量算法所决定的,因为田间实测H的最高点为玉米育种材料在自然生长状态下叶子或雄穗最高点的高度,而最高点对应的空间结构较小,在进行冠层空间三维点云重建时,可能会被算法误认为噪声而去除,从而导致植株叶子或雄穗等较小的空间结构信息的损失,与实测H相比,基于DSM提取的H偏低;另外,当玉米育种材料H高于测量者的身高时,利用塔尺测量H时是仰视读数,这也导致实测H值偏大。因此,进一步提高冠层结构三维点云重建算法对冠层空间较小结构信息的重建精度,提高DSM提取H的精度将是接下来的研究方向。

3.2 玉米育种材料LAI估测

基于作物冠层的光谱信息估测作物LAI对于作物的长势监测及产量预测意义重大。但在作物生长发育的后期,存在一定的光谱信息饱和现象,该文仅用数码影像变量估算玉米育种材料的LAI,与已有的仅用数码影像变量估算大豆育种材料、冬小麦和水稻LAI的研究结果基本一致[17,18,25]。然而该文利用数码影像变量估算玉米育种材料的LAI时,融入H信息后,生成的估算模型与仅用数码影像变量估算LAI相比,R2提高了0.06,LAI验证模型的R2提高了0.05,表明将数码影像变量和H信息进行融合估算LAI,模型精度明显提高,这与 Yue等[13]和Li等[21]将H融合到光谱信息后估算冬小麦和玉米的地上生物量,精度明显提高,具有一致的结论。表明将H和光谱信息进行融合后估算玉米育种材料的LAI,模型估算精度明显提高,进一步减弱光谱信息饱和问题。但该文仅限于一年一个试验点的无人机高清数码影像数据,需要进一步分析不同年份不同地点的数据,以期构建一个普适性更好的估算模型。

4 结 论

1)基于无人机高清数码影像结合地面控制点(ground control point, GCP)生成试验田玉米育种材料的数字表面模型(digital surface model, DSM),基于DSM提取玉米育种材料株高,DSM提取的株高与实测株高具有高度的一致性(R2=0.93,RMSE=28.69 cm,nRMSE= 17.90%),表明将DSM提取的株高应用于玉米育种材料田间株高表型的监测具有较高的精度,克服传统田间株高监测的不足,可为大面积的田间株高测量提供一种新的技术手段。

2)基于无人机高清数码影像构建玉米育种材料冠层的数码影像变量,即将数码影像的红、绿和蓝通道的DN(digital number)值分别定义为R、G和B,进行归一化后得到数码影像变量,分别定义为r、g和b,进行其LAI的估算,得到r和r/b的二元线性回归模型,其估算模型和验证模型的R2、RMSE和nRMSE分别为0.63、0.40、26.47%和0.68、0.38、25.51%;将H和数码影像变量进行融合估算LAI,得到H、g和g/b的三元线性回归模型,其估算模型和验证模型的 R2、RMSE和 nRMSE分别为0.69、0.37、24.34%和0.73、0.35、23.49%。有H信息的LAI估算模型和验证模型的精度都明显提高。表明将 H信息与数码影像变量进行融合估算玉米育种材料的 LAI精度更高,可为玉米育种材料田间表型信息的监测提供一种快速、无损和高通量的表型监测技术手段。

[1] Colomina I, Molina P. Unmanned aerial systems for photogrammetry and remote sensing: A review[J]. Isprs Journal of Photogrammetry & Remote Sensing, 2014, 92(2):79-97.

[2] Yang G, Liu J, Zhao C, et al. Unmanned aerial vehicle remote sensing for field-based crop phenotyping: current status and perspectives[J]. Frontiers in Plant Science, 2017, 8:1111.

[3] 徐云碧. 作物科学中的环境型鉴定(Envirotyping)及其应用[J]. 中国农业科学, 2015, 48(17): 3354-3371.Xu Yunbi. Environmental identification (Envirotyping) and its application in crop science[J]. Chinese Agriculture Science, 2015, 48(17): 3354-3371. (in Chinese with English abstract)

[4] Watanabe K, Guo W, Arai K, et al. High-throughput phenotyping of sorghum plant height using an unmanned aerial vehicle and its application to genomic prediction modeling[J]. Frontiers in Plant Science, 2017, 8.

[5] Singh S K, Iii J H H, Maw M J W, et al. Assessment of growth, leaf N concentration and chlorophyll content of sweet sorghum using canopy reflectance[J]. Field Crops Research, 2017, 209: 47-57.

[6] 阎广建, 胡容海, 罗京辉, 等. 叶面积指数间接测量方法[J]. 遥感学报, 2016, 20(5): 958-978.Yan Guangjian, Hu Ronghai, Luo Jinghui, et al. Review of indirect methods for leaf area index measurement[J]. Journal of Remote Sensing, 2016, 20(5): 958-978. (in Chinese with English abstract)

[7] 陈仲新, 任建强, 唐华俊, 等. 农业遥感研究应用进展与展望[J]. 遥感学报, 2016, 20(5): 748-767.Chen Zhongxin, Ren Jianqiang, Tang Huajun, et al. Progress and perspectives on agricultural remote sensing research and application in china[J]. Journal of Remote Sensing, 2016,20(5): 748-767. (in Chinese with English abstract)

[8] Araus J L, Cairns J E. Field high-throughput phenotyping:the new crop breeding frontier[J]. Trends in Plant Science,2014, 19(1): 52-61.

[9] Candiago S, Remondino F, De Giglio M, et al. Evaluating multispectral images and vegetation indices for precision farming applications from uav images[J]. Remote Sensing,2015, 7(4): 4026-4047.

[10] Potgieter A B, George-Jaeggli B, Chapman S C, et al. Multispectral imaging from an unmanned aerial vehicle enables the assessment of seasonal leaf area dynamics of sorghum breeding lines[J]. Frontiers in Plant Science, 2017, 8: 1532.

[11] Yang G, Li C, Wang Y, et al. The dom generation and precise radiometric calibration of a uav-mounted miniature snapshot hyperspectral imager[J]. Remote Sensing, 2017,9(7): 642.

[12] Yuan H, Yang G, Li C, et al. Retrieving soybean leaf area index from unmanned aerial vehicle hyperspectral remote sensing: Analysis of RF, ANN, and SVM regression models[J]. Remote Sensing, 2017, 9(4): 309.

[13] Yue J, Yang G, Li C, et al. Estimation of winter wheat above-ground biomass using unmanned aerial vehicle-based snapshot hyperspectral sensor and crop height improved models[J]. Remote Sensing, 2017, 9(7): 708.

[14] Nie S, Wang C, Dong P, et al. Estimating leaf area index of maize using airborne discrete-return LiDAR data[J]. IEEE Journal of Selected Topics in Applied Earth Observations &Remote Sensing, 2016, 9(7): 3259-3266.

[15] Guo Q, Su Y, Hu T, et al. An integrated UAV-borne lidar system for 3D habitat mapping in three forest ecosystems across China[J]. International Journal of Remote Sensing,2017, 38(8/10): 2954-2972.

[16] Jin X, Liu S, Baret F, et al. Estimates of plant density of wheat crops at emergence from very low altitude UAV imagery[J]. Remote Sensing of Environment, 2017, 198.

[17] 李长春, 牛庆林, 杨贵军, 等. 基于无人机数码影像的大豆育种材料叶面积指数估测[J]. 农业机械学报, 2017,48(8): 147-158.Li Changchun, Niu Qinglin, Yang Guijun, et al. Estimation of leaf area index of soybean breeding materials based on UAV digital images[J]. Transactions of the Chinese Society for Agricultural Machinery, 2017, 48(8): 147-158. (in Chinese with English abstract)

[18] 高林, 杨贵军, 李红军, 等. 基于无人机数码影像的冬小麦叶面积指数探测研究[J]. 中国生态农业学报, 2016,24(9): 1254-1264.Gao Lin, Yang Guijun, Li Hongjun, et al. Winter wheat LAI estimation based on unmanned aerial vehicle RGB-imaing[J].Journal of Chinese Eco-Agriculture, 24(9): 1254-1264. (in Chinese with English abstract)

[19] 杨琦, 叶豪, 黄凯, 等. 利用无人机影像构建作物表面模型估测甘蔗LAI[J]. 农业工程学报, 2017, 33(8): 104-111:104-111.Yang Qi, Ye Hao, Huang Kai, et al. Estimation of leaf area index of sugarcane using crop surface model based on UAV image[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2017, 33(8): 104-111: 104-111. (in Chinese with English abstract)

[20] Luo S, Wang C, Pan F, et al. Estimation of wetland vegetation height and leaf area index using airborne laser scanning data[J]. Ecological Indicators, 2015, 48: 550-559.

[21] Li W, Niu Z, Huang N, et al. Airborne LiDAR technique for estimating biomass components of maize: A case study in Zhangye City, Northwest China[J]. Ecological Indicators,2015, 57(2): 486-496.

[22] Holman F, Riche A, Michalski A, et al. High throughput field phenotyping of wheat plant height and growth rate in field plot trials using UAV based remote sensing[J]. Remote Sensing, 2016, 8(12): 1031.

[23] Li W, Niu Z, Chen H, et al. Remote estimation of canopy height and aboveground biomass of maize using highresolution stereo images from a low-cost unmanned aerial vehicle system[J]. Ecological Indicators, 2016, 67: 637-648.

[24] Saberioon M M, Amin M S M, Anuar A R, et al. Assessment of rice leaf chlorophyll content using visible bands at different growth stages at both the leaf and canopy scale[J].International Journal of Applied Earth Observations &Geoinformation, 2014, 32(10): 35-45.

[25] Zhou X, Zheng H B, Xu X Q, et al. Predicting grain yield in rice using multi-temporal vegetation indices from UAV-based multispectral and digital imagery[J]. Isprs Journal of Photogrammetry & Remote Sensing, 2017, 130: 246-255.

[26] Cheng H D, Jiang X H, Sun Y, et al. Color image segmentation: advances and prospects[J]. Pattern Recognition,2001, 34(12): 2259-2281.

[27] Torres-Sánchez J, López-Granados F, Peña J M. An automatic object-based method for optimal thresholding in UAV images: Application for vegetation detection in herbaceous crops[J]. Computers & Electronics in Agriculture,2015, 114(C): 43-52.

[28] Bendig J, Yu K, Aasen H, et al. Combining UAV-based plant height from crop surface models, visible, and near infrared vegetation indices for biomass monitoring in barley[J].International Journal of Applied Earth Observation &Geoinformation, 2015, 39: 79-87.

[29] Tucker C J. Red and photographic infrared linear combinations for monitoring vegetation[J]. Remote Sensing of Environment, 1979, 8(2): 127-150.

[30] Mounir Louhaichi, Michael M, Borman, Douglas E. Johnson.Spatially located platform and aerial photography for documentation of grazing impacts on wheat[J]. Geocarto International, 2001, 16(1): 65-70.

[31] Georgee M, Joãocamargo N. Verification of color vegetation indices for automated crop imaging applications[J]. Computers & Electronics in Agriculture, 2008, 63(2): 282-293.

[32] Vol N. Color Indices for weed identification under various soil, residue, and lighting conditions[J]. Transactions of the Asae, 1995, 38(1): 259-269.

[33] Kataoka T, Kaneko T, Okamoto H, et al. Crop growth estimation system using machine vision[C]// Ieee/asme International Conference on Advanced Intelligent Mechatronics, 2003. Aim 2003. Proceedings. IEEE, 2003:1079- b1083.

[34] Gitelson A A, Kaufman Y J, Stark R, et al. Novel algorithms for remote estimation of vegetation fraction[J]. Remote Sensing of Environment, 2002, 80(1): 76-87.

[35] Bendig J, Bolten A, Bennertz S, et al. Estimating biomass of barley using crop surface models (CSMs) derived from UAV-Based RGB imaging[J]. Remote Sensing, 2014, 6(11):10395-10412.

[36] Bendig J, Bolten A, Bareth G. UAV-based imaging for multi-temporal, very high resolution crop surface models to monitor crop growth variability [J]. Photogrammetrie Fernerkundung Geoinformation, 2013, 2013(6): 551-562.

[37] Tilly A N, Hoffmeister D, Cao Q, et al. Multitemporal crop surface models:accurate plant height measurement and biomass estimation with terrestrial laser scanning in paddy rice[J]. Journal of Applied Remote Sensing, 2014, 8(1):083671-083671.

[38] Scotford I M, Miller P C H. Combination of spectral reflectance and ultrasonic sensing to monitor the growth of winter wheat[J]. Biosystems Engineering, 2004, 87(1): 27-38.