融合HOG和颜色特征的人体姿态估计新算法

2017-11-28沈建冬

沈建冬,陈 恒

西京学院 控制工程学院,西安 710123

融合HOG和颜色特征的人体姿态估计新算法

沈建冬,陈 恒

西京学院 控制工程学院,西安 710123

为解决现有人体姿态估计算法在处理光照条件很差或颜色对比度很低的待处理图像时估计准确度较低的问题,利用梯度方向直方图(HOG)和颜色特征建立了一种的基于可能性C(PCM)聚类算法部位外观模型,提出了一种新的融合HOG特征和颜色特征的人体姿态估计算法。算法根据待处理图像自动选择部位外观模型,若图像的光照条件和颜色对比度都较好则选择现有的基于HOG和颜色特征融合的部位外观模型,否则选择基于PCM聚类算法的部位外观模型。仿真实验表明所建立的部位外观模型能更准确地描述光照条件很差或颜色对比度很低的图像中下真实人体部位的外观,提出的人体姿态估计算法对各种类型的待处理图像均能得到准确度更高的估计结果。

人体姿态估计;部位外观模型;梯度方向直方图;颜色;可能性C聚类算法

1 引言

人体姿态估计是人体动作与行为的识别与分析的一个基础问题[1],是一个利用边缘和颜色等图像特征来估计各个人体部位在图像中的具体定位位置的过程[2]。迄今为止,已经提出了多种人体姿态估计算法[3]。现有的人体姿态估计算法可分为基于整体的方法和基于模型的方法两大类[4],其中基于模型的方法更被研究者所关注。基于模型的人体姿态估计的基本思路是首先建立数学模型来描述人体不同部位间的外观特征和空间位置的关联情况,然后设法度量人体部位可能定位区域与真实人体部位外观的相似程度,最后设计推理算法,在所有可能的部位定位区域中进行搜索,最终确定相似度较高且符合人体模型约束的各部位定位区域。

由于真实人体部位的外观特征实际上并不存在准确的描述,人体姿态估计中往往都是用外观模型来代替真实人体部位外观特征。部位外观模型的建立主要包含两方面:(1)采用什么样的图像特征;(2)如何度量与人体部位可能定位区域的相似度。现有的部位外观模型中有些是仅利用单个图像特征建立的[5-10],有些是通过融合颜色、HOG和形状等多个图像特征而建立的[11-14]。Johnson和Everingham[11]基于线性SVM算法分别利用HOG与形状特征建立了两种部位外观模型,利用人体部位可能定位区域与这两种外观模型相似度的乘积来计算相似度;Sapp等[12]将HOG、颜色和形状特征放在一起构成一个特征向量,对所有训练图像标注部位区域的对应特性向量利用线性SVM算法构造分界面,根据人体部位可能定位区域的特征向量与基于分界面的距离来计算相似度;Singh等[13]将人体部位可能定位区域与分别基于边缘密度、形状和HOG特征建立的部位外观模型的相似度按照大小进行排序并构成向量,并将其用于基于多个部位检测器的图结构模型,从而建立了部位外观模型;韩贵金等[14]利用SVDD算法建立基于HOG特征的部位外观模型,根据部位定位概率建立了基于颜色特征的部位外观模型,将人体部位可能定位区域与两种外观模型的相似度按不同的权值进行累加,用累加和来计算相似度。

虽然现有通过融合多个图像特征而建立的部位外观模型用于人体姿态估计时已经取得了较好的效果,但它们普遍都没有考虑到待处理图像的光照及对比度等实际情况的不同,而是采用相同的部位外观模型,导致对不同待处理图像的估计准确度有较大的差距。为此,本文建立了一种新的融合HOG特征和颜色特征的人体姿态估计算法,对不同待处理图像采用不同的部位外观模型,对光照条件较好和颜色对比度较高的待处理图像采用文献[14]的基于HOG和颜色特征融合的部位外观模型,对于光照条件很差或颜色对比度很低的情况,采用本文建立的基于PCM聚类的部位外观模型。

2 基于PCM聚类算法的部位外观模型

韩贵金等[14]对人体部位可能定位区域与分别基于HOG和颜色特征的两种外观模型的相似度按照不同的权值进行累加,建立了基于HOG和颜色特征融合的部位外观模型。模型并没有考虑不同待处理图像的光照和颜色对比度等实际情况的不同,而是对所有的待处理图像均采用相同的外观模型。若待处理图像的光照条件较好且图像颜色对比度较高,不同部位可能定位区域的HOG和颜色特征的区分度较高,两种部位外观模型对应的权值能比较恰当地反映两种图像特征在识别人体部位时所起的作用,人体姿态估计效果良好;但如果待处理图像的光照条件很差或图像颜色对比度很低,不同部位可能定位区域的颜色特征的区分度较低,所有可能定位区域与基于颜色特征的部位外观模型均具有较高的相似度,导致基于颜色特征的部位外观模型的权值大于基于HOG的部位外观模型,颜色特征将起到主要作用,这与此种情况下人体识别部位时主要依靠HOG特征的特性相违背。为此,本文建立了一种基于PCM聚类算法的部位外观模型来解决这个问题。

2.1 可能性C聚类算法

模糊C均值聚类算法是一种非常经典的模糊聚类算法,样本以某种程度隶属于某一类,并规定单个样本对所有类的隶属度之和为1。但实际上单个样本对所有类的隶属度之和并不一定为1,特别是对于数据集中的噪声或野值样本,隶属度之和为1的约束将会导致其对各类的隶属度基本相等,这与噪声或野值样本隶属于各类的概率或可能性都很小的实际情况并不符合[15],从而导致模糊C均值聚类算法对噪声和野值不鲁棒。针对这个问题,Krishnapuram等提出了可能性C聚类算法(PCM)[15],算法放宽了样本对所有类的隶属度之和为1的约束,使得样本的隶属度能真正代表隶属于某类的可能性,提高了对噪声和野值的鲁棒性。

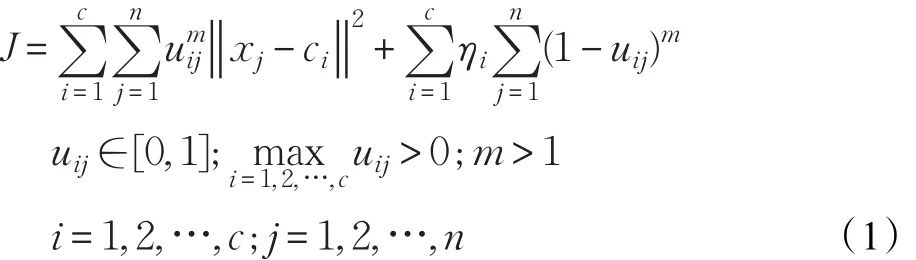

对于样本集X={x1,x2,…,xn},若给定模式类个数为c,PCM聚类算法的目标函数定义如下:

其中,ci为第i个模式类的聚类中心,uij表示xj属于第i个模式类的可能性,m∈[1,∞)是模糊指数,ηi为惩罚参数,可利用下式来计算:

K值通常取1,此时ηi即为类内距离平方的加权平均。ηi—般利用模糊C均值聚类算法的训练结果获取,而且在PCM算法的迭代过程中保持不变,若参与迭代计算会导致算法不稳定[15]。

利用梯度法对式(1)进行求解,可得:

2.2 基于PCM聚类算法的部位外观模型

利用聚类算法建立部位外观模型时,需要用所有部位可能定位区域对应图像特征构造样本集,但由于图像内容的多变性,样本集中不可避免地会出现野值样本。为提高对野值样本的鲁棒性并使样本的隶属度能真正代表其隶属于模式类的可能性,本文利用PCM聚类算法来建立部位外观模型,将收敛后部位类的聚类中心视为部位外观模型,样本属于部位类的可能性即为可能定位区域与部位外观模型的相似度。建立过程可分为如下几个步骤:

(1)算法参数初始化

给定模糊指数m、结束阈值ε或最大迭代次数T,模糊指数m一般情况下取2,此时聚类效果最佳[16]。

(2)构造样本集并初始化隶属度

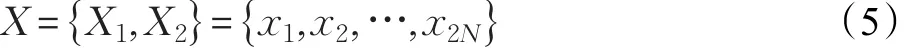

为减小算法复杂度,首先减小部位可能定位区域的总个数[17],然后构造样本集X

其中,N为减小后部位可能定位区域的总个数,X1={x1,x2,…,xN}为利用所有减小后所有可能定位区域构造的样本集,X2={xN+1,xN+2,…,x2N}为从减小后的所有可能定位区域之外的图像中任选出N个同样大小的图像区域而构造的样本集,一个样本是由HOG和颜色直方图特征而构成:

其中,m为部位可能定位区域的HOG块数,hi为图像区域的HSI颜色空间中的色调直方图特征。

样本集X={X1,X2}中任一样本属于两个模式类的可能性利用其与基于HOG和颜色特征融合的部位外观模型[14]的相似度来初始化:

(3)建立部位外观模型

利用PCM聚类算法进行迭代运算,算法收敛后的聚类中心即为部位外观模型,样本属于部位类的可能性即为可能定位区域与部位外观模型的相似度。

3 融合HOG和颜色特征的人体姿态估计

由前面的分析已知,韩贵金等建立的部位外观模型[14]对光照条件很差或图像颜色对比度的待处理图像的人体姿态估计效果较差。此种情况下不同部位可能定位区域的颜色特征区别不大,基于PCM聚类算法的部位外观模型在建立过程中聚类中心以及样本对人体部位的隶属度的变化主要是由样本的HOG特征在起作用,HOG特征将起到主要作用。但由于在建立过程中,样本集中的一半样本是随机选择的,基于PCM聚类算法的部位外观模型对光照条件较好且人图像颜色对比度较高的待处理图像的识别效果并不稳定。

为了提高对不同待处理图像的人体姿态估计效果,本文提出了一种新的融合HOG和颜色特征的人体姿态估计算法。首先将待处理图像从RGB颜色空间转换到HSI颜色空间,HSI空间中亮度分量表征成像亮度,图像亮度的均值可有效表征图像的光照情况,色调分量通常用来从宏观上区分某一种颜色,利用图像区域内所有像素点色调的均方差即可表征图像颜色的对比度,颜色对比度越大,图像不同区域的颜色区别越明显,图像色调的均方差也越大。人体模型和推理算法与文献[14]相同,部位外观模型的选择准则是:若亮度均值大于等于亮度阈值且减小后部位的定位区域[17]的色调的均方差大于等于均方差阈值,选择基于HOG和颜色特征融合的部位外观模型,如果亮度均值小于亮度阈值或色调的均方差小于均方差阈值则选择基于PCM聚类算法的部位外观模型。

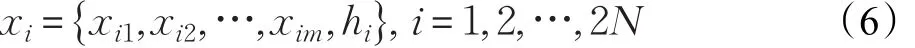

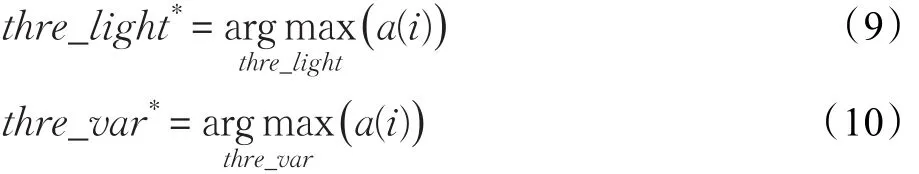

亮度阈值和均方差阈值可通过训练图像集中所有图像人体姿态估计准确度的极大化来确定:

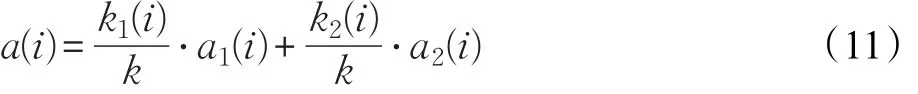

其中,thre_light={0.01,0.02,…,0.98}为亮度阈值的取值集合,thre_var为所有训练图像中减小后部位的定位区域的均方差集合,a(i)表示当将亮度阈值取thre_light(i)或均分差阈值取thre_var(i)时训练图像集中所有图像的人体姿态估计准确度,准确度计算公式如下:

其中,k为训练图像的个数,k1(i)和a1(i)分别为训练图像集中亮度均值大于等于threshold(i)或均方差大于等于thre_var(i)的图像个数和采用基于HOG和颜色特征融合的部位外观模型时的人体姿态估计准确度,k2(i)和a2(i)分别为训练图像集中亮度均值小于threshold(i)或均方差小于thre_var(i)的图像个数采用基于PCM聚类算法的部位外观模型时的人体姿态估计准确度。

4 仿真实验及分析

为便于比较,本文选择与文献[14]相同的训练图像集,文献[14]中的测试图像集作为本文的第一个测试图像集。为了测试基于PCM聚类算法的部位外观模型的有效性,本文从第一个测试图像集中挑选出了55张光照条件很差或图像颜色对比度很差的图像,并与从他处挑选了能够检测到人体上半身的45张光照条件很差或图像颜色对比度很差的图像共同组成了第二个测试图像集。

与文献[14]相同,本文同样采用所有测试图像标注的部位区域与部位外观模型的相似度来衡量部位外观模型的有效性。表1给出了文献[14]建立的基于HOG和颜色特征融合的部位外观模型和本文所建立的基于PCM聚类算法的部位外观模型分别与两个测试图像集中所有图像标注的部位区域的相似度的比较结果,括号内外数据分别为标准差和均值。

表1 相似度比较

从表1可以看出,对于光照条件和图像颜色对比度大多较好的第一个测试图像集,基于HOG和颜色特征融合的部位外观模型要比基于PCM聚类算法的部位外观模型能更准确地描述真实人体部位的外观特征,但对于光照条件很差或图像颜色对比度很差的第二个测试图像集,基于PCM聚类算法的部位外观模型效果更好。

表2给出了几种基于树形图结构模型而建立的人体姿态估计算法对不同测试图像集的姿态估计准确度的比较结果,其中“PCM”表示仅利用基于PCM聚类算法的部位外观模型的人体姿态估计算法,“HOG+color”表示本文所提出的人体姿态估计算法。

表2 人体姿态估计准确度比较

从表2可以看出,对于光照条件和图像颜色对比度大多较好的第一个测试图像集,“PCM”的估计准确度比文献[12]和[14]的准确度要低。但对于光照条件很差或图像颜色对比度很差的第二个测试图像集,“PCM”的估计准确度要高于文献[12]和[14],证明了本文所建立的基于PCM聚类算法的部位外观模型更加适用于光照条件很差或图像颜色对比度很差的情况。与文献[12]和[14]相比,本文提出的融合HOG特征和颜色特征的人体姿态估计算法不论是第一个测试图像集,还是第二个测试图像集均取得了更高的估计准确度。

图1给出了本文提出的人体姿态估计算法对第一个测试图像集中的几幅测试图像的人体姿态估计结果。从图1可以看出,对于光照条件、人体尺寸和姿态都有区别的不同测试图像,本文所提算法都能获得较为理想的估计结果。

图1 人体姿态估计示例

为测试本文所提出的人体姿态估计算法对光照条件很差或图像颜色对比度很差的图像的估计效果,图2给出了文献[12]和本文所提人体姿态估计算法对第二个测试图像集中几幅图像的人体姿态估计结果。从图2可以看出,对于光照条件很差或图像颜色对比度很差的几幅测试图像,文献[12]算法的估计结果并不好,但本文算法都取得了更为理想的估计结果,表明了本文算法对光照条件很差或图像颜色对比度很差的图像的有效性。

图2 人体姿态估计结果比较

5 结束语

本文对如何恰当利用HOG特征和颜色特征进行人体姿态估计进行了研究,提出了一种新的融合HOG特征和颜色特征的人体姿态估计算法。算法中仍然采用传统的树形图结构模型作为人体模型,但部位外观模型则根据待处理图像的光照条件和颜色对比度在基于HOG和颜色特征融合的部位外观模型和基于PCM聚类算法的部位外观模型中自动选择。仿真实验证明了本文所提出的人体姿态估计算法的有效性。如何更好地融合两种图像特征以及其他图像特征将是下一步的主要工作。

[1]Yang W L,Wang Y,Mori G.Recognizing human actions from still images with latent poses[C]//Proceedings of the CVPR 2010,San Francisco,CA,USA,2010:2030-2037.

[2]Felzenszwalb P,Huttenlocher D.Pictorial structures for object recognition[J].International Journal of Computer Vision,2005,61(1):55-79.

[3]Thomas B M,Hilton A,Krüger V,et al.Visual analysis of humans[M].Berlin:Springer,2011:131-138.

[4]Samuel A J.Articulated human pose estimation in natural images[D].Leeds:University of Leeds,2012:11-18.

[5]Wang Yang,Duan T,Liao Zicheng.Learning hierarchical poselets for human parsing[C]//Proceedings of the CVPR 2011,Providence,RI,USA,2011.

[6]Sapp B,Taskar B.MODEC:multimodal decompo-sable models for human pose estimation[C]//Proceedings of the CVPR,Portland,OR,USA,2013:3674-3681.

[7]Yang Y,Ramanan D.Articulated human detection with flexible mixtures of parts[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2013,35(12):2878-2890.[8]Wang Fang,LiYi.Beyond physicalconnections:Tree models in human pose estimation[C]//Proceedings of the CVPR 2013,Portland,OR,USA,2013:596-603.

[9]Ferrari V,Mar´ın-Jim´enez M,Zisserman A.Progressive search space reduction for human pose estimation[C]//Proceedings of the CVPR 2008,Anchorage,AK,USA,2008:1-8.

[10]Eichner M,Ferrari V.Better appearance models for pictorial structures[C]//Proceedings of the 20th British Machine Vision Conference,London,UK,2009,3:1-11

[11]Johnson S,Everingham M.Combining discriminative appearance and segmentation cues for articulated human pose estimation[C]//Proceedings of the 12th International Conference on Computer Vision Workshops.Piscataway,N J:IEEE Press,2009:405-412.

[12]Sapp B,Alexander T,Taskar B.Cascaded models for articulated pose estimation[C]//Proceedings of the 11th European Conferenceon ComputerVision.Berlin:Springer,2010:406-420.

[13]Singh V K,Nevatia R,Huang Chang.Efficient inference with multiple heterogeneous part detectors for human pose estimation[C]//Proceedings of the 11th European Conference on Computer Vision.Berlin:Springer,2010:314-317.

[14]韩贵金,朱虹.基于HOG和颜色特征融合的人体姿态估计[J].模式识别与人工智能,2014,27(9):769-777.

[15]Krishnapuram R,Keller J.A possibilistic approach to clustering[J].IEEE Transactions on Fuzzy Systems,1993,1(2):98-110.

[16]Miguel E.Fuzzy clustering of ecological data[J].Journal of Ecology,1990,78:561-567.

[17]Han Guijin,Zhu Hong,Ge Jianrong.Effective search space reduction for human pose estimation with Viterbi recurrence algorithm[J].International Journal of Modelling,Identification and Control,2013,18(4):341-348.

SHEN Jiandong,CHEN Heng

College of Control Engineering,Xijing University,Xi’an 710123,China

New human pose estimation algorithm based on HOG and color features.Computer Engineering and Applications,2017,53(21):190-194.

The existing human pose estimation algorithm always get the lower accuracy for those images with very poor light conditions and low color contrast.For solving the problem,a more suitable part appearance model based on the Possibilistic C-Means(PCM)clustering algorithm is built by using Histogram of Oriented Gradient(HOG)and color features,and a new human pose estimation algorithm based on the fusion of HOG and color features is proposed.The part appearance model is selected automatically according to the image to be processed,the existing part appearance model based on the fusion of HOG and color features is selected if both the light conditions and color contrast are good,and otherwise the part appearance model based on PCM clustering algorithm is chosen.Simulation results show that the established part appearance model can represent the appearance of real human part,which is from images with very poor light conditions and low color contrast,more accurately,the proposed human posture estimation algorithm can get more accurate estimation results for various types of images to be processed.

human pose estimation;part appearance model;histogram of oriented gradient;color;possibilistic C-means clustering algorithm

A

TP391.4

10.3778/j.issn.1002-8331.1606-0319

陕西省教育厅自然科学资助项目(No.2013jk1068)。

沈建冬(1976—),男,副教授,主要研究领域为模式识别,E-mail:sjd761107@126.com;陈恒(1965—),男,博士,副教授,硕士生导师,主要研究领域为机器人与智能控制。

2016-06-23

2016-07-25

1002-8331(2017)21-0190-05

CNKI网络优先出版:2016-12-02,http://www.cnki.net/kcms/detail/11.2127.TP.20161202.1503.018.html