基于双目立体视觉的成熟棉花识别定位

2017-10-27沈晓晨李霞王维新

沈晓晨 李霞 王维新

摘要:针对采棉机械手棉花识别定位难的问题,提出一种基于机器视觉的棉花识别与定位方法,搭建出双目立体视觉系统,在此基础上通过相机标定、图像采集、图像处理、特征提取等过程,计算得出棉株的深度信息以及其成熟棉花的三维信息,其深度平均误差值为255 mm,单位坐标误差均值为(28 mm,-14 mm,-135 mm)。结果表明,基于双目立体视觉对棉株上的成熟棉花进行三维空间上的识别定位是可行的。

关键词:棉花采摘机器人;双目立体视觉;成熟棉花;图像分割;识别定位;深度信息;三维信息

中图分类号: S22591文献标志码:

文章编号:1002-1302(2017)16-0185-04

收稿日期:2016-03-31

基金项目:国家自然科学基金(编号:51405312)。

作者简介:沈晓晨(1991—),男,湖北襄阳人,硕士研究生,主要从事图像处理。E-mail:510134974@qqcom。

通信作者:李霞,博士,副教授,主要從事机械设计及其自动化研究。E-mail:lixia0415@163com。

棉花是我国重要的工业基础及战略物资,也是广大棉农脱贫致富的重要作物,在农业生产中占有重要的经济地位。新疆由于具备独特的光热资源,已成为全国最大的商品棉生产基地[1-3]。新疆棉花总产量、国内销售量以及出口量连续多年位居全国之首,已经成为当地的支柱产业[4]。新疆与国外的棉花种植模式差别较大,棉花品种不同,且国产采棉机的采摘效率不太理想,而由于进口采棉机价格成本太高、零配件价格高、维修费用高、服务不及时等因素的影响,农民接受不了,难以推广[5],因此棉花采收一直是制约新疆棉花发展和经济效益提高的重要因素之一。根据目前情况,亟需研究出机械化、智能化的棉花采摘机器人,新疆的棉花种植区域比较集中,具有农业机械化、智能化的发展优势,因此充分利用先进技术和装备并结合人工采摘和机械化采摘的优点,开发一种新型的棉花收获智能机已成为当前的紧迫任务。其中视觉系统主要解决的是棉花自动识别与定位,也是机械化、智能化棉花采摘机器人的关键难题。

目前,在果蔬收获机器人工作方面已有多国展开了研究,美国学者Schertz和Brown于1968年首次提出使用机器人来完成一些采摘作业的思想,Takahashi等依据苹果在双目立体视觉系统中左右图像对中的视差,利用三维空间分割将2幅图像合成1幅中心图像[7-9]。Kondo等用4个光源以及3个摄像机组成了草莓采摘机器人[10],虽然国内在农业采摘机器人领域开展研究比较晚,但发展速度快,目前已获得很多研究成果。刘兆祥等根据苹果树的反射光谱特性,利用激光的反射差异和三角测量原理实现苹果的识别与定位[11]。刘坤等为准确识别自然环境中被遮挡的棉花,提出了使用随机Hough变换来识别棉花的方法[12]。赵杰文等选取HIS色彩空间的H通道对田间的番茄采用阈值分割的方法进行识别。徐惠荣等利用颜色信息差来进行识别柑橘,同时在顺光、逆光的情况下进行了柑橘的识别研究[14]。在棉花图像分割方面,王勇等分析了棉田环境中不同对象在几种常用色彩空间下的颜色特征,提出了一种采用R-B色差模型的分割策略[15]。韦皆顶等选取HSV色彩空间中的S通道对棉花进行阈值分割[16]。

本研究基于机械视觉对成熟棉花进行识别定位,以期为实现成熟棉花的机械手采摘提供参考。

1材料与方法

11设备与材料

采用1对维视图像的MV-VS 078FM/FC高速工业CCD摄像机作为实时计算机视觉系统的图像采集设备,该摄像头采用高速USB 20接口,焦距≥20 mm,视野角度≥50°,图像输出格式为RGB24(24位真彩色),动态捕获存储格式为AVI;计算机采用惠普台式液晶电脑,其基本配置为220 GHz主频,400 GB的内存,1 024 MB的显卡,640 G硬盘,CPU为Intel(R)Core(TM)2DuoCPU T6670,电脑的操作系统为Window XP专业版32位SP3(DirectX90c);数据处理采用Excel 2007,图像处理软件为Matlab 2015b。试验所用的棉花棉株均来自于石河子大学惠远种业试验田,所有棉株均含有不少于3个成熟棉花,且具有普遍性。成熟棉株图像采集于2013年10月。

12方法

在实验室环境下,将采集的成熟棉花棉株置于栽盆中,在32 W荧光灯照射下,以栽盆为基准中心,间隔不同距离多次采集,由于采棉机械手最优采棉距离在550~650 mm之间,所以在此范围内随机从6个距离点采集成熟棉花图像。每个距离点采集3组,共36幅图像,并对采集的棉花图像利用Matlab软件编写好的GUI进行图像处理。

2双目立体视觉

21双目视觉原理

双目立体视觉指的是仿照人类双眼感知距离的方法,以实现机械视觉对三维信息的感知,通常基于三角测量的方法,利用2个或多个摄像头对同一景物从不同位置形成图像,从而通过视差恢复距离信息。双目立体视觉模型一般可分为汇聚式立体视觉模型和平行式立体视觉模型。由于平行式立体视觉模型需要相机与其光轴绝对平行,而这在实验室条件下很难实现,所以一般多采用汇聚式立体视觉模型进行立体视觉的运用。在该模型下空间内的任意一点P(X,Y,Z)过C1、C2摄像头拍摄图像的投影点像素坐标分别为P1(u1,v1)、P2(u2,v2),假设P1、P2的坐标点已知,则可以利用摄像头的内部参数和外部参数反求出P点的世界坐标,即为P=M1-1P1和P=M2-1P2。M1、M2的计算公式分别为:

[JZ(]M1=[JB([]ax1γ1uo100ay1vo100010[HL)]];[JZ)][JY](1)

[JZ(]M2=[JB([][HL(4]ax2γ2uo200ay2vo200010[HL)]] [JB([]RT01]。[JZ)][JY](2)

式中:ax1、ay1、ax2、ay2分别为摄像头C1、C2在x轴和y轴上的焦距;γ1、γ2分别为摄像头C1、C2的不垂直因子;(uo1,vo1)、(uo2,vo2)分别为摄像头C1、C2光轴像素坐标;R、T分别为旋转矩阵和平移矩阵。

22相机标定

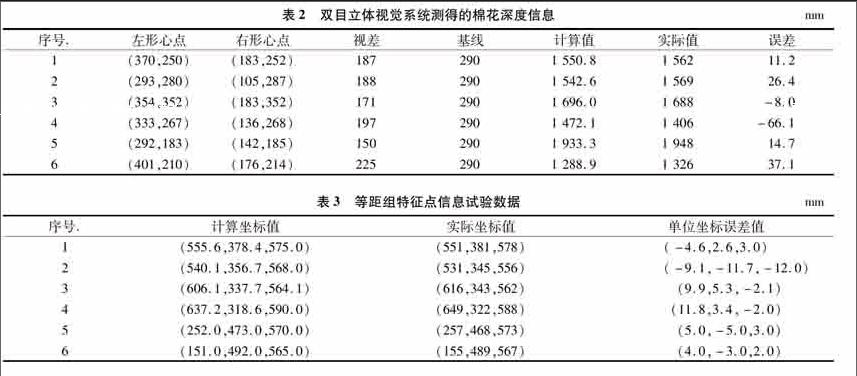

相机标定在于获取精确的相机内部参数(焦距、失真系数、不垂直因子)以及外部参数(旋转矩阵、平移矩阵)。本次标定试验采用Jean-Yves Bouguet的 Camera Calibration Toolbox-Standard Version和 Stereo CameraCalibration Toolbox摄像机标定工具箱进行双目摄像头标定,先用左右2个CCD摄像机从不同位置采集10对标定板图像;然后利用Camera Calibration Toolbox-Standard工具箱分别读入左右CCD摄像机采集的标定板图像(图1);最后采用交互式的角点区域提取方法,利用Matlab软件对标定板图像进行自动角点检测,得到左/右摄像头内部参数,并通过Camera Calibration Toolbox-Standard工具箱得到校正后的左/右摄像头外部参数(表1)。

注:平移向量与旋转向量皆为右摄像头相对于左摄像头的位置关系。

3图像分割与特征点匹配

31棉花图像分割

棉花的图像分割作为识别定位的预先处理,其质量直接决定后序的识别定位效果,图像分割是把图像分成各具特性的区域并提取出所需目标的技术和过程,以便棉花采摘机器人的视觉识别系统根据对图像的理解进行作业。图像分割是图像识别和分析的首要问题,因此图像分割技术一直受到研究者们的高度重视,现已提出了上千种分割算法,目前分割方法主要有阈值分割方法、聚类分割法[17]、区域增长法[18]、基于边缘检测的图像分割方法[19]和基于神经网络的图像分割方法[20]等。由于计算机的智能程度和速度还远没有达到人的水平,到现在为止图像分割问题还不存在一个通用的方法,也不存在一个判断分割是否成功的客观标准。图像分割的任务是把图像中感兴趣的目标区域提取出来,本研究中的图像分割是把成熟棉花从其自然背景中提取并标记出来。利用成熟棉花果实与周围环境颜色特征的差异性,主要采用基于Eckhorn的猫视觉皮层模型的图像分割方法——基于脉冲耦合神经网络(pulse coupled neural net),并显示了其优越性。最初的分割数学方程描述如公式(3)所示:

3)式中:Fij表示第(i,j)个神经元的第n次输入;β为连接系数;Sij表示外部输入激励信号,即点(i,j)对应像素的灰度值;M为连接矩阵的元素;Lij(n)为连接输入;VL为连接幅度常数;Uij(n)为内部活动项;αθ为迭代衰减时间常数;θij(n)为动态阔值;Vθ为连接权放大系数;Yij(n)为神经元的输出。但由于基于脉冲耦合神经网络(PNCC)的图像分割,图像的层次性被极大地削弱了,且对图像后续的处理造成了麻烦。因此,本研究通过其高β值对传统的PNCC进行改进,改进后的脉冲耦合神经网络(PNCC)的图像分割数学方程描述如公式(4)所示:

式中:U(n)为内部活动项;θ(n)为动态阔值;D(n)表示第n次脉冲反馈输入矩阵;L为线性连接通道输出矩阵;Cij(n)表示非线性输出矩阵;Yij为神经元的脉冲输出矩阵。

基于PNCC[21]的多值分割法对R-B灰度图进行分割试验,图像分割结果如图2所示。通过大量的试验可以看出,采用基于PNCC的多值分割法,图像分割的分割率≥9168%,并且有效保留了图像的层次性。

32成熟棉花目标的特征点匹配

立体匹配即在左图像和右图像中分别找出真实世界中的某一点在2个摄像机成像平面上的匹配投影点。主要方法是依据目标物体的颜色、几何形状等特征,从立体视觉系统左、右摄像机同时拍摄的一组图像中通过某个特征从一副图像的某点搜素另一幅图像的匹配点。为了使匹配的过程达到一定的抗噪能力[22-23],同时减少歧义性,提出了特征匹配。由于不受灰度的影响,所以抗干扰性较强,同时计算量小、速度快,满足了相同的实时性。特征点的选取和匹配,是利用双目立体视觉技术获得目标物体三维信息的关键。成熟棉花在摄像机成像的投影近似一个标准的圆形,所以其在二维图像的形心基本是在摄像机平面上投影所形成的标准圆形的圆心,因此左右图像上的圆心是一对最佳的匹配点,同时也是棉花采摘过程中理想的采摘点,因此可以直接提取并用于三维信息的计算。利用左、右摄像机采集图像中成熟棉花投影圆心的提取结果如图3所示。

4成熟棉花定位

41棉株深度信息

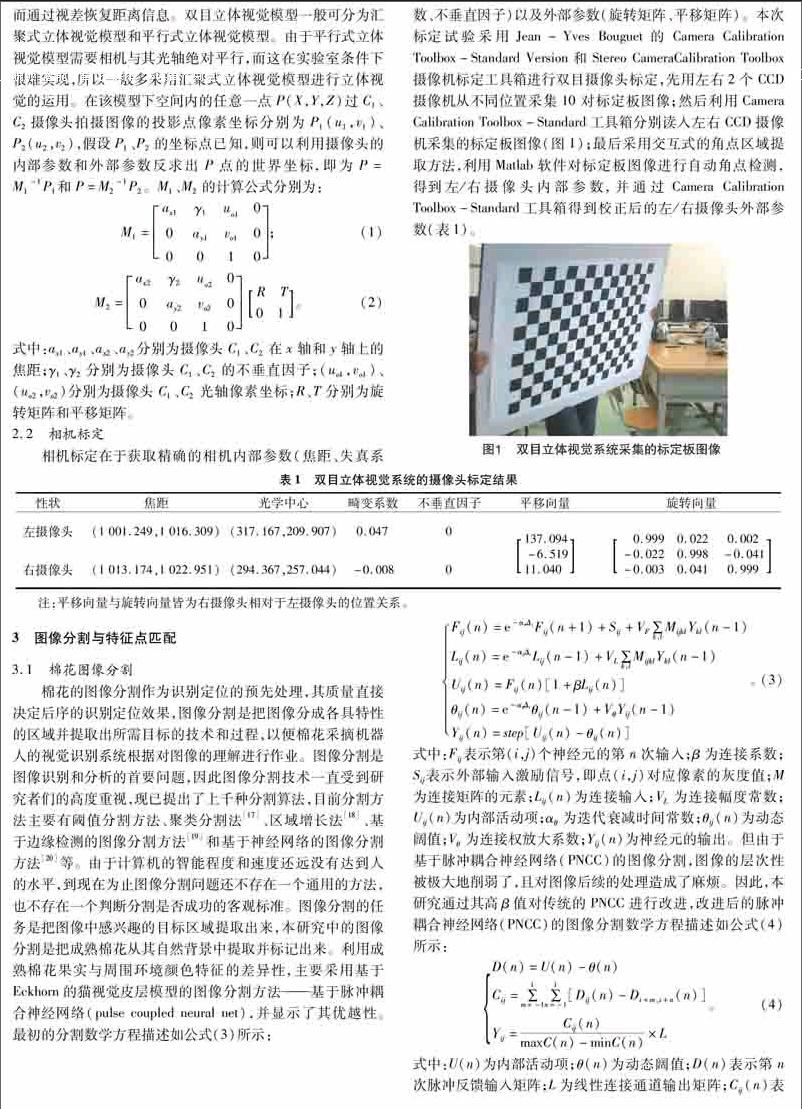

对分割好的图像进行进行特征点匹配,等距的3组6幅圖像的特征点坐标取均值,以减小偶然误差,处理完成得到6组不同距离的成熟棉花特征点数据。现取每个特征点的1对左右匹配点P1、P2数据,利用相机标定得到的投影矩阵M1、M2,反求出特征点的世界坐标(X,Y,Z),Z即为棉株的深度信息。试验数据见表2,计算出来的深度误差值平均为 255 mm,可以满足采棉机械手对不同棉株深度精确的要求。

42同一棉株不同位置成熟棉花的定位识别

由于棉株上存在多个棉桃,因而采棉机械手须要知晓棉株上对应成熟棉花的多个特征点的坐标,其精准度直接由机械视觉机构给定的匹配点空间坐标的误差值决定。本研究对同一棉株不同位置的成熟棉花定位识别,任取一个等距的组,其特征点的计算坐标与实际坐标如表3所示,得到其平均坐标误差值为(28 mm,-14 mm,-135 mm),表明满足同一棉株不同位置的棉花识别定位的精确度要求。

5结论

在分析研究成熟棉花视觉系统设计要求的基础上,建立了适合本研究所使用的双目立体视觉系统,搭建了试验平台,

并对双目相机摄像头进行了标定,用标定好的相机对棉花图像进行采集,提出了一种基于PNCC的多值分割法。在相机标定及目标识别的基础上,利用基于形心特征匹配方法来实现果实目标的匹配,并利用双目立体视觉原理对基于空间点三维信息的计算进行研究,对棉花特征点进行深度恢复,实现棉株空间的初步定位,并进一步对棉株上的成熟棉花进行坐标定位。结果表明,该定位方法具有很高的精确度,能够满足采棉机械手的定位要求。

因此,基于机器视觉对棉株上的成熟棉花进行三维空间上的识别定位是可行的,在后期的研究过程中,将采取更规范的试验操作以减小其识别定位的偶然误差、提高成熟棉花的识别定位精度,使得采棉机械手采棉作业的识别定位更加精准。

参考文献:

新疆年鉴社 新疆年鉴2011[M] 北京:中国统计出版社,2011

新疆统计局 新疆统计年鉴2011[M] 新疆:新疆生产建设新疆年鉴社,2011

[3]李生军 棉花收获机械化[M] 新疆:新疆科学技术出版社,2008

[4]中华人民共和国农业部采棉机作业质量:NY/T 1133—2006[S] 2006

[5]耿端阳,张铁中,罗辉,等 我国农业机械发展趋势分析[J] 农业机械学报,2004,35(4):208-210

[6]Kondo N,Nishitsuji Y,Ling P P,et al Visual feedback guided robotic cherry tomato harvesting[J] Transactions of the Asae,1996,39(6):2331-2338

[7]Takahashi T,Zhang S,Sun M,et al New method of image processing for distance measurement by a passive stereo vision[C] An ASAE Meeting Presentation,1998

[8]Takahashi T,Zhang S H,Fukuchi H,et al Binocular stereo vision system for measuring distance of apples in orchard(Part 1)—Method due to composition of left and rightimages[J] Journal of the Japanese Society of Agricultural Machinery,2000,62(1):89-99

[9]Takahashi T,Zhang S,Fukuchi H,et al Binocular stereo vision system for measuring distance of apples in orchard(Part 2)—Analysis of and solution to the correspondence problem[J] Journal of the Japanese Society of Agricultural Machinery,2000,62(3):94-102

[10]Kondo N,Ninomiya K,Hayashi S,et al A new challenge of robot for harvesting strawberry grown on table top culture[C] ASAE Annual International Meeting,2005

[11]劉兆祥,刘刚,乔军 苹果采摘机器人三维视觉传感器设计[J] 农业机械学报,2010,41(2):171-175

[12]刘坤,费树岷,汪木兰,等 基于改进随机Hough变换的棉桃识别技术[J] 农业机械学报,2010,41(8):160-165

[13]赵杰文,刘木华,杨国彬 基于HIS颜色特征的田间成熟番茄识别技术[J] 农业机械学报,2004,35(5):122-124,135

[14]徐惠荣,叶尊忠,应义斌 基于彩色信息的树上柑橘识别研究[J] 农业工程学报,2005,21(5):98-101

[15]王勇,沈明霞,姬长英 采摘期成熟棉花不同部位颜色识别分析[J] 农业工程学报,2007,23(4):183-185

[16]韦皆顶,费树岷,汪木兰,等 基于HSV彩色模型的自然场景下棉花图像分割策略研究[J] 棉花学报,2008,20(1):34-38

[17]徐德,谭民,李原 机器人视觉测量与控制[M] 北京:国防工业出版社,2011:35-36

[18]宋村夫 基于双目立体视觉的催泪弹智能化发射系统设计[D] 长沙:国防科学技术大学,2011

[19]王星,刘金义 基于HSI的彩色图像二值化技术研究[J] 科学技术与工程,2011,11(19):4609-4611

[20]杨转 基于HSI颜色模型的杂草与 土壤背景分割方法研究[J] 河北农业大学学报,2011,34(4):124-127

[21]赵小川 现代数字图像处理技术提高及应用案例详解[M] 北京:北京航空航天大学出版社,2012

[22]邓姿 基于立体视觉的三维粒子图像处理[D] 大连:大连理工大学,2006

[23]胡新宇 基于机器视觉的家蚕微粒子图像识别方法的研究[D] 武汉:武汉理工大学,2011