基于点云密度的结构化道路边界增强检测方法*

2017-08-09苏致远徐友春彭永胜王任栋

苏致远,徐友春,彭永胜,王任栋

(1.军事交通学院研究生管理大队,天津 300161; 2.军事交通学院军用车辆系,天津 300161)

基于点云密度的结构化道路边界增强检测方法*

苏致远1,徐友春2,彭永胜2,王任栋1

(1.军事交通学院研究生管理大队,天津 300161; 2.军事交通学院军用车辆系,天津 300161)

为快速鲁棒地检测结构化道路边界,提出一种基于HDL-64E激光雷达点云密度的道路边界增强检测方法。通过建立虚拟雷达模型,利用点云密度特征,实现前景与背景分离,并利用随机采样一致性算法得到20m内的道路边界。为解决20~100m内道路边界点云稀疏、检测准确性下降的问题,提出利用光线切割模型对道路边界进行增强检测。在校园道路和城市快速路进行实验,道路边界检测率达到95%以上,有效检测距离可达70m以上,检测周期小于32ms。

道路边界检测;虚拟扫描模型;点云密度;光线切割模型

前言

在智能车的环境感知中,道路边界检测用于确定行驶区域,缩小注意力分布范围,为智能车的路径规划、定位和导航提供约束条件和信息。在复杂的城市道路和高速公路环境中,确定道路边界显得尤为重要。

当前,结构化道路边界检测主要有两种方法:一种是基于道路几何特征的方法,另一种是基于图像分割的方法[1]。基于图像分割的方法可获取丰富的环境信息,并利用颜色、纹理等特征进行区域的生长和分割,但该方法对环境敏感,受光照等因素影响大。基于道路几何特征的方法能够克服外界环境的大部分干扰,检测精度高,是高级别智能驾驶应用中的主要检测方法。因此,本文中利用三维激光雷达的点云数据,依据道路几何特征检测道路边界。

文献[1]中根据多帧连续二维雷达数据建立数字高程图(digital elevation map),根据车辆运行方向提取道路边界候选点,然后利用霍夫变换(Hough transform)和多模型随机采样一致性(RANSAC)算法求解道路边界。文献[2]中在三维点云中分别提取每条扫描线的特征点,通过霍夫变换和距离约束选择道路边界候选点,最后通过迭代的高斯过程回归将候选点作为种子点表示道路边界,检测距离达50m。文献[3]中通过将雷达扫描线分段,构建马尔科夫随机场,通过图割算法求最优解来分割路面。文献[4]中使用局部凹凸性分割不同物体。文献[5]中采用Mesh方式构造图,通过计算梯度分离地面。以上方法中,基于图的方法计算量大,实时性差,而基于栅格的方法,检测效果受栅格尺度影响大,对阈值选取的要求较高。此外,很多方法要用到雷达或车辆坐标系下的高度或高度差信息,并以此作为区分道路和道路边界的条件,但在车辆行进过程中,尤其是车辆发生较大俯仰、侧倾时,鲁棒性降低。

为解决以上问题,本文中基于HDL-64E三维激光雷达数据,提出一种新的道路边界增强检测方法。首先建立了虚拟雷达模型,根据虚拟扫描线上点云的分布特征实现前景与背景分离,该过程去除了路面,同时保留了障碍物和部分道路边界,然后建立光线切割模型,结合前景近景分离结果对道路边界进行远距离扩展。本文中方法具有以下特点:一是基本不受路面倾斜和起伏影响;二是对较低的道路边界或较高的护栏同时有效;三是在部分遮挡的动态环境下,依然可以得到稳定的检测结果。

1 数据预处理

本文中研究采用HDL-64E三维激光雷达,其垂向扫描范围(VFOV)为-24.8°~2°,其间按照一定的规律分布着64个激光发射器,雷达通过旋转扫描得到360°范围内的环境信息。在600r/min的转速下,每帧采集约13万个点。针对大量点云的分割通常采用非模型投影方法,按投影方向可分为基于地面投影和基于虚拟像平面投影两大类[6]。

1.1 点云投影

本文中提出了一种基于地面的全景投影方法(见图1),与全景深度图(panoramic range image)[4]相比,该方法基于地面投影,投影结果为三维点云而不是深度图像。由于所用雷达在不同距离有相同的扫描点数,所以可将其按照雷达旋转方向依次展开成一个三维场景,x轴为旋转角度(-π/2~3π/2),y轴为扫描点到雷达旋转轴的距离(0~120m),z轴为扫描点的高度。在路面区域,同一条扫描线的点近似在一条水平直线上,在同一个扫描角度上障碍物导致点云密度差异。

图1 全景投影图

1.2 点云校正

HDL-64E三维激光雷达通过旋转获取环境数据,数据本身具有一定的组织结构。但由于激光雷达的安装、标定等原因,同一扫描角度上的点在地面的投影并不严格地落在一条通过旋转中心的直线上。本文中基于极坐标栅格下的虚拟扫描(virtual scan)模型[7],或叫虚拟雷达模型,建立基于原始点云的虚拟雷达模型,雷达每个角度的虚拟扫描线在x-y平面的投影都是一条延伸线通过雷达旋转中心,由扫描距离最近的点指向扫描距离最远点的线段,每个线段都包含64个子节点(子节点可能为空)。如图1所示,每条虚拟扫描线在x-y平面的投影都是与y轴平行的线段。

由以上模型,每帧的扫描数据可表示成三维矩阵Iv,满足:

(1)

其中P(b,j)=[xyzi]

(2)

式中:Iv的每一列表示某个旋转角度的64组数据,对应64个激光发射角度,每一行表示旋转360°单个激光采集到的所有数据;n为每帧的采样次数;b为光线编号,根据俯视角度由负到正从0至63取值;j为从起始位置开始的采集次数;P(b,j)为点的属性,包含点的坐标及强度信息;i为点的强度。

1.3 点云分割

根据HDL-64E的检测特性,即在平坦区域点云密度低,有障碍物处点云密度高,可将障碍物从环境中分离出来。通常的做法是划分栅格,并统计各个栅格的点云密度,由于密度的阈值难以确定,本文中将虚拟雷达模型中同一虚拟扫描线上相邻扫描点的距离差作为判断点云密度的依据。在理想水平面上,雷达每个扫描点至雷达旋转轴的距离是确定的,若遇到凸障碍,激光无法穿过障碍物,导致扫描点到雷达旋转轴的距离小于其理论距离;若遇到凹障碍,实际扫描距离将大于理论距离。

根据激光的发射角度,第j线激光的扫描距离yj小于第j+1线的扫描距离yj+1(此处仅考虑射向地面的光束,所以取0≤j<54),如遇障碍物且有两条扫描线同时扫描到该障碍物,则有

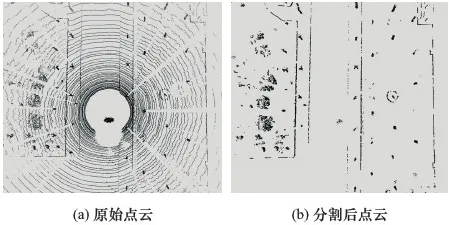

yj+1-yj (3) 设扫描线在平面上的理论扫描距离为Yj(0≤j<54),扫描距离超过一定范围及扫描角度为正(即水平面以上)的线束不包含在内,则相邻两线的理论扫描间隔为 Dj=Yj+1-Yj (4) 将dj取值为Dj的某一比例,即令 dj=ηjDj=ηj(Yj+1-Yj) (5) 由以上推导编写算法,对原始点云进行分割,结果如图2所示。图中表示路面和平坦地面的点都被分离出来,仅保留了地面上的障碍物和部分道路边界。 图2 原始点云和分割后点云对比 为比较点云分割效果,将最大最小高度图[8](maximum and minimum height map)与本文方法作比较,结果如图3所示,图3(a)为最大最小高度图保留下来的原始点(栅格大小为20cm×20cm,高度差为10cm),图3(b)为本文方法保留的原始点(ηi=1/3)。对比发现:(1)最大最小高度图中保留下来的特征无关点数量比本文方法多,这与栅格本身特点有关,栅格过大导致与特征无关的点增多,栅格过小某些特征点可能会消失;(2)道路边界(矩形框内)的连续性不如本文方法,最大最小高度图的分割结果取决于栅格大小,相邻栅格的属性不能同时满足阈值要求,造成特征丢失,而本文方法能很好解决这种问题。 图3 两种分割方法对比 根据道路形态,通常建立中间为平面或曲线、两侧有一定高度突变的道路模型[9-10],这种模型能表现道路边界的突变特征,但不能很好地表现道路形态。本文方法无须研究路面的具体形状,只须假设道路边界存在。 2.1 光线切割模型 HDL-64E激光雷达随扫描距离增加点云密度降低,导致路面滤除时远距离的道路边界特征不明显。为增加道路边界检测距离,本文中提出一种光线切割模型。 假设三维激光雷达安装在竖直平面内,各条扫描线的扫描覆盖范围就构成顶角不同的圆锥体,如果有垂直平面切割圆锥,理论上就会形成双曲线的一支。由于道路边界高度相对于雷达安装高度很小,所以通常还需要一次水平切割,见图4。图4(a)中雷达旋转轴与垂直切割平面的距离为BO,雷达此时的旋转角度为θ,角度分辨率为Δθ。 图4 光线切割模型 首先研究角度对道路边界检测的影响,如图4(b)(图4(b)为图4(a)的俯视图)所示,设旋转中心B与道路边界CO距离为L,前后扫描获得的点分别为C点和A点,扫描距离为LBC和LBA。由几何关系可知: LBC=LBO/cosθ (6) LBA=LBO/cos(θ+Δθ) (7) LBA-LBC=LBO/cos(θ+Δθ)-LBO/cosθ (8) 当雷达转速为600r/min时,Δθ≈0.17°,若已知雷达旋转中心到道路边界的距离LBO=L,则道路边界上前后两次扫描点的距离差仅与扫描角度相关。图5为当L=300cm和L=1000cm时,相邻两个扫描点的距离差与扫描角度的关系。 图5 相邻扫描点距离差与扫描角度的关系 由图5可见:扫描角度一定时,若雷达旋转轴到道路边界的距离增加,相邻两个扫描点的距离差增加;旋转轴到道路边界的距离一定时,随扫描角度的增加,相邻扫描点的距离差近似呈指数增加。依照此规律即可根据扫描角度计算该角度上相邻两点间的理论距离差,再以理论值为依据从原始数据筛选出符合条件的点,即为道路边界候选点。 2.2 道路边界检测与增强 地面滤除后,车辆两侧的道路边界信息被很好地保留下来。为得到雷达旋转中心距道路边界的距离,本文中使用一种条件采样的方法,将车辆两侧满足道路边界约束的点确定为道路边界候选点,对其滤波后拟合直线,根据拟合结果计算雷达旋转轴到道路边界的距离,以此为依据搜索地面滤除过程丢失的道路边界,同时根据搜索结果验证采样的正确性,并对下一帧的检测提供参考。 在筛选道路边界候选点时不可避免会掺杂一些错误点,本文中采用RANSAC算法拟合道路边界,可有效减小错误点的干扰,拟合出正确的道路边界。 算法的流程图如图6所示。 图6 算法流程图 为检验本文算法,分别在校园道路和城市快速路进行实验。实验平台配置为intel酷睿i5双核2.5GHz处理器,4G内存。图7为两种典型的测试场景,图7(a)为校园道路,车辆正处于丁字路口,图7(b)为城市快速路,空白处是因为车辆遮挡没有数据。校园道路宽度窄,道路边界清晰,但道路节点多,拓扑结构复杂,同时车流较少,交通环境简单;城市快速路宽阔,道路节点少,拓扑结构简单,但车流量大,交通环境复杂,道路边界遮挡严重。 图7 校园和城市快速路实验场景 本文中使用检测成功率、单侧道路边界提取点数、道路边界候选点正确率和运行时间等指标来评价算法。检测成功率指本算法求解出道路边界的帧数与测试帧数的比值。单侧道路边界提取点数是从原始数据筛选出的单侧道路边界候选点数量。候选点正确率为候选点中真实道路边界点数量与候选点总数的比值,由于采用RANSAC算法拟合道路边界,故对迭代1次与10次的结果进行比较说明候选点的正确率,结果见表1。 表1 实验结果 由表1可见:在城市快速路的检测成功率稍高,原因是快速路虽然车辆较多,但道路节点少,拓扑结构简单;校园道路节点多,道路零散,拓扑结构复杂,导致单侧平均点数较少。RANSAC算法通过随机选择原始数据拟合目标方程,可反映原始数据的质量,在误差范围内迭代1次得到的拟合方程包含了95%的候选点,且将迭代次数增至10次后结果仅有2%以内的提升,表明原始数据的质量,即道路边界候选点的正确率很高,平均正确率在95%以上。 图8为两种场景下的实验结果,分别显示在校园和城市快速路环境下的边界采样点数和检测成功率,以及在城市快速路上的最远检测距离。 图8 实验结果 由图8可见:校园道路边界的候选点数量变化较大,主要受校园道路零散的因素影响;检测成功率在实验次数较少时由于比例计算会呈现急速下滑的趋势,随实验次数增加趋于稳定,表明算法效果稳定。 在城市快速路环境下,本文方法提取道路边界候选点的最远距离达到了100m以上。根据HDL-64E雷达的技术指标,距离越远扫描点越稀疏,超过60m后两条扫描线间的理论间隔达到10m以上,但算法提取的点仍可有效地判断道路趋势。在采样点数为0或者最远距离为0的场景下,算法没有找到道路边界,可能的原因是多车遮挡等原因导致道路边界消失。 在实时性上,基于高度图的霍夫变换算法平均运行时间[2]约为27.8ms,本文算法的平均运行时间约为24ms,可以满足智能车实时性要求。 本文中提出一种道路边界增强检测算法,首先建立虚拟雷达模型对雷达数据进行预处理,基于点云密度分离前景和背景,然后通过两次筛选得到道路边界候选点,最后通过随机采样一致性算法对道路边界进行拟合。实验结果表明:该算法道路边界检测率达到95%以上,运行时间满足智能车实时性要求,检测距离优于其他算法。此外,本文方法不依赖于路面形态,对低矮的道路边界和较高的护栏都有效,在部分遮挡的情况下依然可以得到稳定的结果。 [1] LIU Z, WANG J L, LIU D X. A new curb detection method for unmanned ground vehicles using 2D sequential laser data[J]. Sensors,2013,13(1):1102-1120. [2] CHEN T T, DAI B, LIU D X, et, al. Velodyne-based curb detection up to 50 meters[C]. Intelligent Vehicles Symposium(IV). Seoul, Korea: IEEE,2015:241-248. [3] 朱株,刘济林.基于马尔科夫随机场的三维激光雷达路面实时分割[J].浙江大学学报(工学版),2015,49(3):464-469. [4] MOOSMANN F, PINK O, STILLER C. Segmentation of 3D lidar data in non-flat urban environment using a local convexity criterion[C]. Intelligent Vehicles Symposium(IV). Xi’an: IEEE,2009:215-220. [5] DOUILLARD B, UNDERWOOD J, KUNTZ N, et, al. On the segmentation of 3D LIDAR point clouds[C]. International Conference on Robotics and Automation(ICRA). Shanghai: IEEE,2011:2798-2805. [6] 王肖,王建强,李克强,等.智能车辆3-D点云快速分割方法[J].清华大学学报(自然科学版),2014,54(11):1440-1446. [7] PETROVSKAYA A, THRUN S. Model based vehicle detection and tracking for autonomous urban driving[J]. Autonomous Robots,2009,26:123-139. [8] 辛煜,梁华为,梅涛,等.基于激光传感器的无人驾驶汽车动态障碍物检测及表示方法[J].机器人,2014,36(6):654-661. [9] 俞先国,刘大学,戴斌.基于非闭合Snakes和单线激光雷达的路边检测与滤波[J].机器人,2013,35(4):425-431. [10] HAN J, KIM D, LEE M, et, al. Road boundary detection and tracking for structured and unstructured roads using a 2D lidar sensor[J]. International Journal of Automotive Technology,2014,15(4):611-623. Enhanced Detection Method for Structured RoadEdge Based on Point Clouds Density Su Zhiyuan1, Xu Youchun2, Peng Yongsheng2& Wang Rendong1 1.PostgraduateTrainingBrigade,MilitaryTransportationUniversity,Tianjin300161;2.DepartmentofMilitaryVehicle,MilitaryTransportationUniversity,Tianjin300161 For the fast and robust detection of structured road edge, an enhanced road edge detection method is proposed based on the density of point clouds from HDL-64E lidar. By setting up virtual scan model and utiliazing the density features of point clouds, foreground is separated from background, and 20 meters of road edge is obtained by using random sample consensus algorithm. To solve the problem of poor detection accuracy of road edge within a distance of 20 and 100 meters due to sparse point clouds, a sheme is proposed to use ray cut model to conduct an enhanced detection on road edge. The results of experiments on both campus road and city express show that the effective detection rate of road edge reaches over 95% with a detectable distance longer than 70m within a duration less than 32ms. road edge detection; virtual scan model; point clouds density; ray cut model 10.19562/j.chinasae.qcgc.2017.07.017 *国家自然科学基金(91220301)和国家重点基础研发计划项目(2016YFB0100903)资助。 苏致远,博士研究生,E-mail:13672089813@163.com。 原稿收到日期为2016年6月3日,修改稿收到日期为2016年9月2日。

2 道路边界检测与增强

3 实验结果

4 结论