结构不规则工件定位与抓取研究

2017-03-29秦小健漆思杰顾自明

王 丹,钱 炜,秦小健,漆思杰,顾自明

(1.上海理工大学 机械工程学院,上海 200093;2.丰汉电子(上海)有限公司,上海 201611)

结构不规则工件定位与抓取研究

王 丹1,钱 炜1,秦小健2,漆思杰1,顾自明1

(1.上海理工大学 机械工程学院,上海 200093;2.丰汉电子(上海)有限公司,上海 201611)

为解决结构不对称、质量分布不均匀的工件定位抓取问题,提出了利用工件表面特征的位置信息进行定位的方法。识别和提取工件上表面定位孔的图像坐标,联合机器人手眼标定参数获取工件的位姿信息。文中以散热器壳为例搭建了一种单目视觉系统,对机器人定位抓取系统中工件存在判定、图像分割、工件提取以及工件定位进行了研究,并通过实验进行验证,实验结果表明,该方法定位成功率高达0.92,具有较强的实用性。

单目视觉;工件定位;存在判定;图像分割

在工业自动化生产中,涉及到各种的零件识别及元件装配和搬运,例如电子行业元件自动定位、IC卡上的字符识别以及铸造业的机器人搬运等,机器人视觉在工件识别上的应用越来越广泛[1-3]。目前单目视觉定位的研究对象主要采用平面定位,试验工件为圆形、矩形或者对称开槽的对称型工件,其特点是质量分布均匀,重心和形心位置重合,通过计算质心和惯性矩的方法来计算抓取中心的位置[4-5];而在铸造业中质量分布不均匀、形状结构复杂的压铸件不适用该法。根据上述缺陷,本文采用定位工件表面特征孔的方法实现了复杂工件的定位和抓取。

不同的工件特点有不同的图像处理方法。孙琦[6]等人采用HSV颜色空间H分量的方法进行分割,该法对于工件与背景颜色不同的图像来说准确性较高,但会丢失工件的表面细节信息;朱代先、夏群峰等人基于灰度特征模板匹配法[7-9],采用相似性度量准则进行搜索,然后通过边缘检测提取工件的轮廓特征后进行质心法进行定位。模板匹配的方法受模板的种类影响,定位目标仅限于库中存在的对象,且只有轮廓比较简洁的圆柱体型或者矩形的工件才能提取清晰的工件轮廓。本文以外形复杂的散热器壳为例搭建了一套单目视觉定位抓取系统,采用OTSU算法选取合适的阈值对图像进行分割,能够保留工件表面大部分的空间特征;结合利用工件表面特征进行工件定位的思想,识别散热器壳上两个定位孔的图像坐标,联合机器人手眼标定参数,获取工件的位姿信息。

1 视觉系统工作原理

为减小环境光对图像质量的影响,根据工作现场环境情况添加光源。利用固定在支架上的工业相机拍摄某工位工件的图片,通过采集卡将数字图像传输给计算机,由计算机完成图像分割、工件存在判定、工件提取以及工件定位等步骤,得出工件位置参数并传递到机器人控制器,由机器人控制器控制夹爪抓取工件,工作流程如图1所示。

图1 工件定位流程图

2 图像处理

图像处理部分主要包括图像分割以及判定数字图像中是否存在工件,通过直方图归一化的方法降低噪声的影响并将目标工件提取出来,便于后续工件位姿信息的获取。目标图像如图2所示,背景图像如图3所示。

图2 目标图像

图3 背景图像

2.1 图像分割

图像分割是机器人视觉和图像识别领域重要的预处理方法。本文采用灰度图像自适应阈值分割法[10-11],用OTSU算法(最大类间方差法)确定图像分割的最佳阈值,计算简单且不受图像亮度和对比度的影响。

按图像的灰度特性将图像分成背景和前景两部分,背景和前景之间的类间方差越大,说明构成图像的两部分差别越大。当部分前景错分为背景或部分背景错分为前景都会导致两部分差别变小。因此,使类间方差最大的分割意味着错分概率最小。OTSU算法以最佳门限将图像灰度直方图分割成两部分,使两部分类间方差取最大值,即分离性最大。

OTSU算法实现原理:

图4 均衡化前后的灰度图及直方图

(2)计算图像灰度均值μ。

(1)

其中,μ0为分开后前景像素点的平均灰度;w0为分开后前景像素点数量占图像的比例;μ1为分开后背景像素点的平均灰度;w1为分开后背景像素点数占图像的比例;

(3)计算直方图的零阶w[i]和一级距u[i]。设灰度门限值为k,则图像像素按灰度级被分为两类

C0={1,2,…k}

(2)

C1={k+1,…,M}

(3)

(4)

w1=1-w[k]

(5)

对一级矩作以下处理

μ0=μ[k]/w[k]

(6)

μ1[μ-μ[k]]/[1-w[k]]

(7)

(4)计算并找到最大的类间方差,对应此最大方差时的灰度值即为要找的阈值t。

(8)

其中, 是分割阈值为t时的类间方差。当 为全局最大时所对应的t称为最佳阈值;

(5)用找到的阈值二值化图像。

图5 两种方法分割图像结果

如图所示,图5(a)为HSV颜色空间H分量图像分割结果,图5(b)为最大类间方差法分割结果。从图像可以看出,本文所述的OTSU算法分割效果更好。

2.2 工件存在判定

首先采集没有工件时该工位的图像作为背景图像,如图6所示。进行工件识别时在同样的光照条件下捕获目标图像,并用上文所述方法分别对背景图像和目标图像完成图像分割,然后对二值图像进行工件存在判定,工件存在判定公式如下

|fm(u,v)-fb(u,v)|=Δf

(9)

图6 目标图像与模板图像差异点数量分布规律

本算法中图像的二值化阈值受光照条件以及噪声的影响,工件尺寸以及工业相机拍摄的图像大小决定了门限值的大小:在相同背景环境、光照以及图像采集设备的条件下,工件在视野中占图幅比例越大,门限值越大;反之,则门限值越小。门限值的大小需要根据实际情况通过多次实验得出。本系统中存在工件的目标图像与模板图像差异点总数分布规律如图6所示,∑Δf在1.52×106~1.59×106之间浮动,以最低值作为界限,对于小于界限值的图像判定为工件不存在,此时门限值k为0.76。

2.3 目标工件的提取

要对工件进行定位首先要将工件从背景中分离出来。对于存在工件的目标图像,先创建一张空白图像fk(u,v),大小与目标图像大小一致。然后遍历目标图像与背景图像的每一个像素点,比对每一个对应点的像素值,并对空白图像进行填充。填充规则如下

(10)

其中,fk(u,v)为空白图像(u,v)点的像素值。

当目标图像(u,v)点与背景图像(u,v)点像素值相同时,空白图像(u,v)点的值为1(置白),当目标图像与背景图像在该点的像素值不同时,空白图像在该点的值取目标图像该点的值,填充后的图像即为提取出来的工件结果,如图7所示。

通过背景删除法提取工件,不受图像背景颜色以及结构特征等的干扰,直接去除背景提取工件的二值图,该方法能够有效保留工件表面的特征信息,方便后续工件的定位。

图7 工件提取结果

3 工件位姿识别方法

基于两点的2D视觉工件定位抓取系统分为EYE-IN-HAND和EYE-TO-HAND两种手眼模式,为计算简便采用第2种手眼模式。本文所述的工件定位抓取方法在目标工件实际位置与理想抓取位置相差不大的前提下实现。为防止机械手在运动过程中遮挡相机视场,视觉系统在机械手回归到零位后开始采集图片。

(11)

(12)

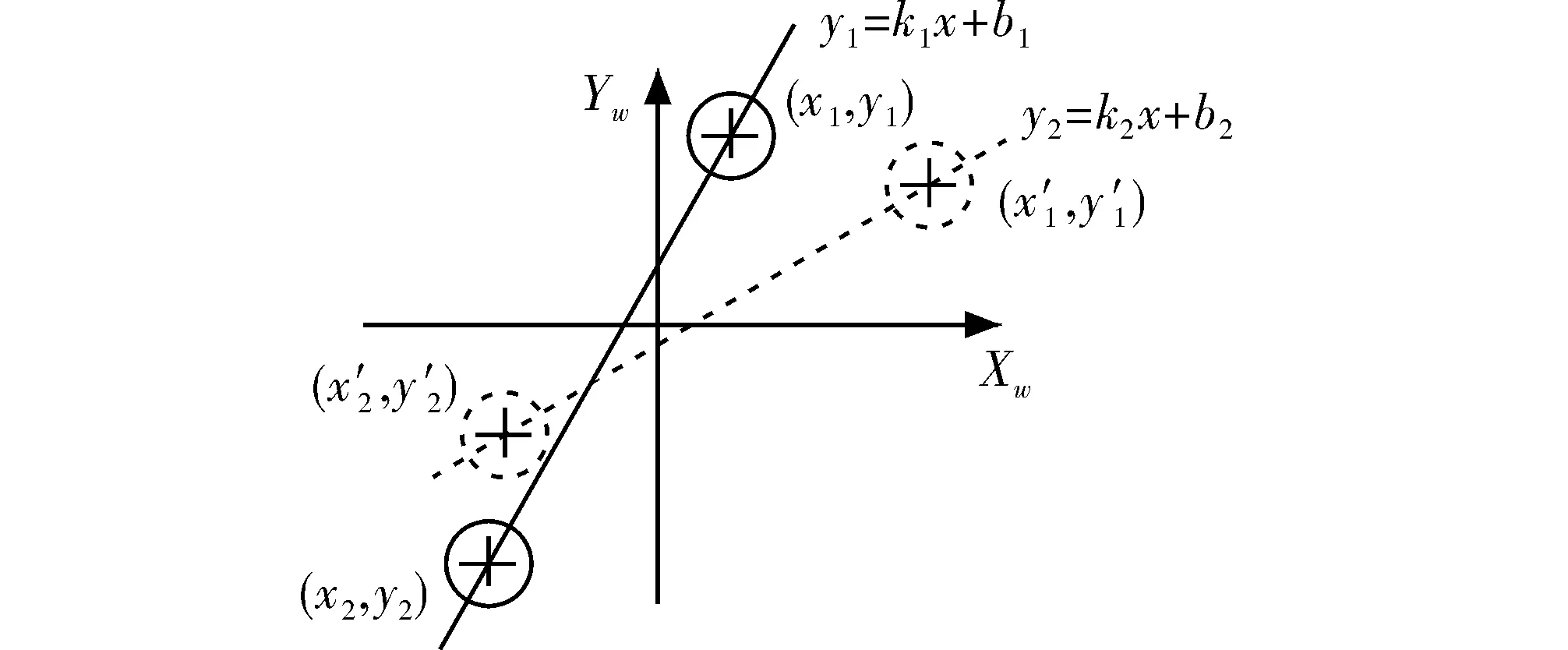

建立零位时两定位销中心点在机器人世界坐标系中XY平面所构成的直线方程Y1=k1x+b1,目标图像中定位孔中心点在世界坐标系中XY面上的直线方程Y2=k2x+b2,如图8和图9所示。

图8 夹爪坐标空间示意图

图9 定位孔与定位销相对位置关系示意图

利用4点坐标求两条直线的角度差Δα,并计算其中一对坐标点X和Y方向的位移差Δx和Δy

(13)

(14)

其中, 为机械手应该偏转的角度; 和 为定位销 应该发生的位移。机械手发生确定角度的偏转和位移变化之后下降一定高度完成抓取工作。

4 机器人抓取实验

系统由FANUC公司M-20iA机器人、机器人控制器、Kenyence公司的CV-H500M型CCD、CA-LIHR35镜头、CV-X170A型控制器、CA-DRW24W型照明光源、实验台及实验工件组成,摄像机安装在实验台上端的支架上。

表1 实验结果举例

5 结束语

本文阐述了工业机器人定位工件的基本步骤,通过目标图像与背景图像相似度的比较实现了工件的存在判定,运用作差法提取目标工件,通过定位孔中心点及其构成的直线确定了工件的位姿信息完成工件定位。

本研究应用Matlab与VC++混合编程,将工件位置信息输入到M-20iA机器人控制器,完成了机器人对工件的抓取任务。实验表明,在合适的补充光源条件下,本研究采用的工件定位方法能够准确的定位工件并成功抓取,对其应用到工业生产中形状结构不规则的工件的定位抓取工作有指导意义。

[1] 李树杰.中国机器视觉的发展趋势[J].赤峰学院学报,2010,26(1):161-162.

[2] 刘金桥,吴金强.机器视觉系统发展及其应用[J].机械工程与自动化,2010,158(1) :215-216.

[3] 郭静,罗华,张涛.机器视觉与应用[J].电子科技,2014, 27(7) :185-187.

[4] 孙琦.基于Adept机器人的平面工件视觉定位与控制[D].杭州:杭州电子科技大学, 2009.

[5] 王红涛.基于视觉的工业机器人目标识别定位方法的研究[D].西安:西安理工大学,2007.

[6] 孙琦,罗志增.Eye- to- Hand机器人系统的平面工件识别研究[J].杭州电子科技大学报,2009(3):46-49.

[7] 朱代先.基于双目视觉的工件定位与抓取研究[J].计算机测量与控制,2011,19(1):92-94.

[8] 夏群峰,彭永刚.基于视觉的机器人抓取系统应用研究综述[J].机电工程,2014,31(6):697-701.

[9] 王召利,杨廷梧,刘上乾,等.特殊靶标图像的Otsu自适应双阈值分割法[J].电子科技,2010,23(6):46-48.

[10] 阳树洪.灰度图像阈值分割的自适应和快速算法研究[D].重庆:重庆大学,2014.

[11] Tian Jing,Yu Weiyu,Xie Shengli.An ant colony optimization algorithm for image edge deteetion [C].CA,USA:IEEE Congress on Image,2009.

[12] Zhang Zhengyou.Flexible camera calibretion by viewing a plane from unknown orientations[C].Korea:ICCCV,1999.

[13] 陈泽宁,张学习,彭泽荣,等.基于机器视觉的工件定位和识别[J].电子科技,2016,29(4) :99-103.

[14] 陈立松.工业机器人视觉引导关键技术的研究[D].合肥:合肥工业大学,2013.

[15] 卜鹏辉,赵宏,谷飞飞,等.一种基于平面靶标的全自动标定方法[J].光电学报.2014,34(10):41-45.

The Research on Orientation and Scraping of Workpiece with Asymmetry Structure

WANG Dan1,QIAN Wei1,QIN Xiaojian2,QI Sijie1,GU Ziming1

(1.School of Mechanical Engineering,University of Shanghai for Science and Technology, Shanghai 200093,China;2.Yutaka Electronics (SH)CO.,LTD, Shanghai 201611,China)

To solving the problem of location and grasping workpiece that with nonuniform mass distribution and asymmetry structure, a new method of orientation based on object surface features is proposed. Recognition and extraction the image coordinate of locating holes in the surface of workpiece, then combined image coordinate with robot EYE-TO-HAND system calibrate parameters to obtain pose information. The paper experiment on radiator case and built a whole monocular computer vision system, and did some research into robot orientation and scraping system about judgment on existence of workpiece, division of image, workpiece feature extraction and positioning. The results show that the success rate is 0.92 and the positioning method have a strong practical value.

monocular computer vision; workpiece locating; judgment on existence; picture division

2016- 05- 26

国家科技支撑计划基金资助项目(2015BAK16B04)

王丹(1991-),女,硕士研究生。研究方向:数字图像处理。

10.16180/j.cnki.issn1007-7820.2017.01.038

TP391.41

A

1007-7820(2017)01-139-05