自适应中心对称局部三值模式的人脸识别

2016-11-09陈伟栋

闫 河 王 朴 刘 婕 陈伟栋

(重庆理工大学计算机学院 重庆 400054)

自适应中心对称局部三值模式的人脸识别

闫河王朴刘婕陈伟栋

(重庆理工大学计算机学院重庆 400054)

针对局部三值模式描述人脸图像纹理特征时直方图维数过高以及阈值不能自适应选取的缺陷,提出一种自适应中心对称局部三值模式方法。首先,用具有降低维数的中心对称局部三值模式算子对人脸图像编码,把邻域像素均值引入编码中以增强抗噪性能;其次,嵌入统计邻域均值与邻域像素的标准差作为阈值以自适应提取人脸特征,并统计特征直方图;最后用卡方距离度量训练样本特征直方图和测试样本特征直方图的相似度,采用最近邻分类器分类识别。所提算法在YALE、Extended Yale B人脸图像库上的最高正确识别率分别达到99.67%,99.33%;识别一张人脸的速度分别达到0.1984和0.3988 s。实验结果表明,所提算法对光照变化和噪声更加鲁棒,有效提高了人脸识别的精度和速度。

人脸识别中心对称局部三值模式自适应阈值

0 引 言

近年来,受公共安全、国家安全、人机交互、金融安全等领域大量潜在的需求所驱动,人脸识别技术已经成为模式识别领域的研究热点[1],其关键问题是如何找出有效描述人脸特征的算子。在实际应用中,人脸易受光照、噪声等变化的影响,通常使得人脸图像呈现较强的不稳定性,甚至会造成同一个人的差异比不同人之间的差异还大[2],因此,增加了人脸识别的难度。局部二值模式LBP(Local Binary Pattern)[3]用于人脸识别[4-11]中是一种有效局部纹理特征描述算子,该方法简单,对微弱光照变化具有一定的鲁棒性,但在编码时会产生256个不同的二进制,导致形成的直方图特征维数较高以致不利于分类与识别;其次,当光照剧烈变化时,LBP算子无法描述该变化的剧烈程度,使得LBP特征表征能力和分类能力下降。针对LBP的不足,HeiKKiloi等[12]把中心对称的思想用到LBP算子上,提出了中心对称二值局部模式CS-LBP(Center Symmetric LBP),其思想是不再依次比较邻域周边像素与中心像素的灰度值,而是比较中心像素对称的两个周边像素灰度值,该模式降低了LBP特征维数,计算复杂度低、且具有抗噪性。Tan等[13]在LBP基础上提出了局部三值模式LTP(Local Ternary Patterns),LTP算子采用0、1、-1三个值进行编码,并且允许用户自定义一个阈值,在一定程度上均衡了剧烈光照引起的灰度值变化,解决了光照剧烈变化下的识别问题。LTP特征已在人脸识别领域[14-17]取得了较好的应用效果。然而,由于LTP算子采用0、1、-1三个值进行编码,使得LTP特征维数更高,其次,LTP算子是事先自定义一个阈值,需要进行大量实验来寻找最佳阈值,且阈值不能自适应地兼顾不同样本间的差异,因此LTP还存在普适性问题。

针对上述问题,本文提出了自适应中心对称局部三值模式方法CS-LTPAT(Center Symmetric LTP with Adaptive Threshold)。该方法首先把文献[12]的思想应用到LTP算子上,提出了中心对称局部三值模式(CS-LTP)以降低LTP维数;为了增强所提算子的抗噪性,把邻域均值加入到算子的编码中;其次,为了提高算法的普适性,通过统计邻域均值与邻域像素的对比度值,将其对比度的标准差作为阈值自适应提取人脸特征。实验表明,所提算法对光照变化和噪声更加鲁棒,有效提高了人脸识别的精度和速度。

1 LTP算子

LTP算子是在LBP算子基础上进行扩展,采用三值编码模式,LTP继承了LBP对光照不敏感的优点,并且算子本身自定义的一个阈值t在一定程度上能减少剧烈光照的影响。LTP算子量化阶段增加了-1码,通过计算邻域像素gi与中心像素的gc差值,差值在[-t,t]范围内则被量化为0,差值大于t则被量化为1,差值小于-t则被量化为-1。LTP的具体计算公式定义如下:

(1)

其中t为用户自定义的阈值,利用LTP算子进行编码,权值的编码方式与LBP算子类似,编码方式的计算公式如下:

(2)

从LTP算子的编码过程得出,LTP是一种图像微量特征、局部形状以及局部纹理的描述算子,并通过用户自定义阈值t和增加一位编码,在一定程度上均衡了剧烈光照变化下的像素值,有效提高了LTP特征的表征能力和分类能力。但LTP直方图特征维数会随着半径R和邻域像素点P的增大而显著增大,这将大大增加了计算的复杂度。另外,LTP阈值始终是固定值,不能根据样本图像的自身情况自适应选取。因此需要一种自适应样本阈值,以进一步优化LTP。

2 基于自适应中心对称局部三值模式的人脸特征描述与识别

2.1CS-LTP算子

使用LBP算子描述图像纹理时,产生的直方图特征维数较高,为了降低维数,文献[12]重新定义像素值之间的比较关系,提出了中心对称局部二值模式(CS-LBP)。CS-LBP只比较邻域内基于中心像素中心对称的像素值对,因此CS-LBP相比LBP统计直方图的维数更低。考虑LTP的维数问题,本文把中心对称的思想应用到局部三值模式中,提出了中心对称局部三值模式(CS-LTP)。CS-LTP的定义如下:

(3)

其中S是权值系数:

(4)

当中心对称对的灰度差大于某个阈值t时,S为1,否则为0。

从CS-LTP计算公式可以看出,CS-LTP直方图维数比LTP直方图维数更低,计算量小很多,能够适应实时计算的需求。为了降低噪声的影响,本文把邻域均值编码考虑到CS-LTP算子中,则CS-LTP的计算公式如下:

(5)

2.2自适应阈值的选取

针对LTP阈值不能自适应问题,本文提出一种能根据图像自身情况自适应选取阈值的方法。选取的方式为计算邻域对比度的标准差,将该标准差设为当前邻域的阈值。在(P,R)邻域内,通过计算邻域均值与邻域像素的对比度得到该邻域的标准差δ,δ值较小表明对比度值较为分散,反之,则表明分布较为集中。标准差δ可以直观地观察样本的变化程度。δ具体计算如下:

(6)

(7)

(8)

(4) 根据对比度值及其均值,计算标准差δ

(9)

从标准差δ的计算过程看,δ值会随着每个邻域的变化而变化,这说明了标准差对样本具有自适应性。同时样本类内的标准差在一般情况变化也不大,说明邻域均值与邻域周边像素对比度的标准差能描述样本间变化关系。因此把标准差作为阈值不仅能有效解决自定义阈值的局限,同时兼顾不同样本之间的差异,使得LTP算子能够提取更有鲁棒性的纹理特征。

2.3改进人脸识别算法

将自适应中心对称局部三值模式应用于人脸识别。首先将人脸图像进行预处理,再把人脸图像分成不同子块,用CS-LTPAT算子提取每个子块纹理特征,并统计每个子块的直方图。然后,按一定的次序联接各个子块直方图生成人脸图像的特征向量。其具体步骤如下:

步骤1对人脸图像进行直方图均衡化等一系列的预处理。

步骤2将预处理后图像按8×8分块,并用自适应中心对称局部三值模式(CS-LTPAT)提取人脸图像直方图特征。

步骤3用卡方距离度量训练集图像和测试集图像直方图特征的相似度。卡方距离的计算公式具体如下:

(10)

式中H1,H2分别为算法提取的特征向量。该值的距离越小,表明两个人越相似。

步骤4通过最近邻分类器进行分类识别。

3 实验结果及分析

通过实验对几种性能最好的基于纹理特征人脸描述算子进行性能评估,包括文献[4]局部二值模式(LBP)、文献[12]中心对称局部二值模式(CS_LBP)以及局部三值模式(LTP)[13]和本文提出的自适应中心对称局部三值模式(CS-LTPAT)。为了公平起见,各类算法均采用了分块做法,分块大小8×8,邻域(P,R)取(8,2),并使用卡方距离作为特征向量相似度度量,最后通过最近邻分类器进行分类识别。本实验分为三部分。第一部分验证算法提取的特征维低和算法的实时性;第二部分验证所提算法对光照的鲁棒性;第三部分验证算法的抗噪性。

3.1人脸数据库

YALE人脸数据库是由耶鲁大学所采集。该人脸库中包含15个人,每人11幅,总共165幅不同光照条件下的正面头像。经处理,图像大小统一为100×100。图1(a)给出了一个人经过预处理后的11张人脸图像,其中第4幅和第7幅图像的光照条件较差。 Extended Yale B人脸数据库来自38个人的不同光照下采集的 64 幅正面图像,经处理,图像尺寸统一为 192 ×168。 根据光照强弱变化,该图像库分成 set1 至 set5 五个子集,各子集分别含有 70 幅、120幅、120 幅、140 幅和 190 幅人脸图像。set1-set5子集的光照条件逐步变差,set 1 光照条件最好,set 5 光照条件最差。图1(b)给出了其中一个人的8张图片。

(a) YALE人脸库部分图像

(b) Extended Yale B人脸库部分图像图1 YALE和Extended Yale B人脸库部分图像

3.2特征维数与时效性实验

为了验证所提算法提取的特征不仅维数低且实时性好,表1给出了所提算法在YALE、Extended Yale B人脸图像库上识别一张图像所需要的维数与时间。

表1 识别一张人脸需要的特征维数和时间(s)

由表1可见,虽然CS-LTPAT特征维数比CS-LBP特征维数略高,识别时间也比略长;但是相对LBP和LTP来说,特征维数还是比较低,也能达到实时性要求。下面实验也将验证CS-LTPAT特征比CS-LBP特征具有更好的抗光照性和抗噪性。

3.3光照实验

为验证本文算法对光照的鲁棒性,分别在上述两个人脸库数据中进行四组实验。第一组实验依次选取YALE人脸库上每人1幅图像作为训练集,其余图像作为测试集。实验结果如图2所示。第二组实验采用Extended Yale B人脸数据库中子集set 1 作为训练集,其余子集作为测试集;第三组实验把光源较差的子集 set 4作为训练样本,其余子集作为测试样本;第四组实验选用每个人的一幅光照条件最好的图片作为训练样本,其余图片作为测试样本。第二、三、四组实验结果分别见图3、图4、图5所示。

图2 YALE人脸库上不同方法的识别率(%)

从图2可以看出,CS-LTPAT算子识别率优于LBP、CS-LBP和LTP算子。当测试集光源变化时,LBP,CS-LBP和LTP方法识别性能有较大幅度的波动,而CS-LTPAT波动幅度较小。尤其在4号样本和7号样本光照条件较差时,CS-LTPAT仍保持较高的识别率。说明了CS-LTPAT算子对差光源具有较好的鲁棒性。图3-图5进一步说明了CS-LTPAT算法识别率高于LBP、CS-LBP和LTP算法。当训练集光照条件较好时,各算法均有较好的识别效果且CS-LTPAT方法识别率最高。当训练集光照条件较差或者训练样本单一时,LBP,CS-LBP和LTP算法出现大幅度下降,而CS-LTPAT算法的识别率保持稳定,体现了CS-LTPAT算法对光照变化的自适应性。

综合图2-图5可以得出,在光照较差时,LBP算法的识别率最低,而CS-LTPAT算法的识别率最高。LBP算法之所以最低的识别率是由于LBP无法描述光照变化所引起的人脸间差异,因而人脸识别效果差。CS-LBP算法的识别率比LBP高,主要原因在于CS-LBP算法通过中心对称思想增强了对局部纹理描述的能力。LTP方法的识别率也高于LBP是由于LTP算子采用-1、0、1三个值编码,并且算子本身自定义的一个阈值在一定程度上能够均衡光照变化的影响。而本文算法的识别率优于其他方法,说明本文算法对光照变化有较强的自适应性。产生这种结果的原因在于CS-LTPAT算子考虑了邻域间的光照差异,把样本邻域像素均值与邻域像素对比度的标准差作为阈值,使得算法动态生成适应于样本的阈值,有效解决了因剧烈光照和不同样本造成人脸差异的问题。

图3 Extended Yale B 人脸库上子集set1作为训练集(%)

图4 Extended Yale B 人脸库上子集set4作为训练集(%)

图5 Extended Yale B 人脸库上单样本图像作为训练集(%)

3.4噪声实验

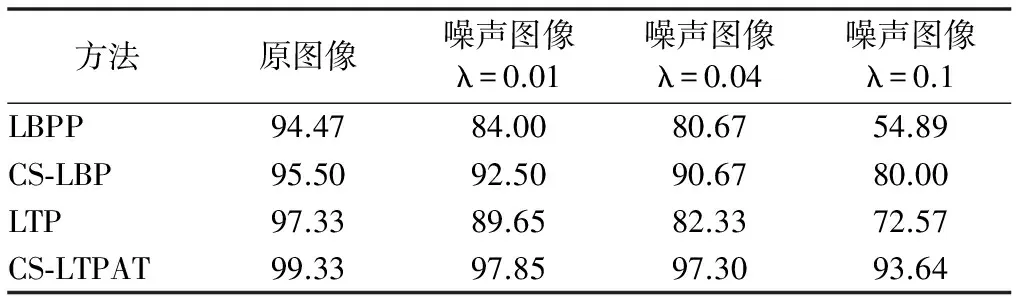

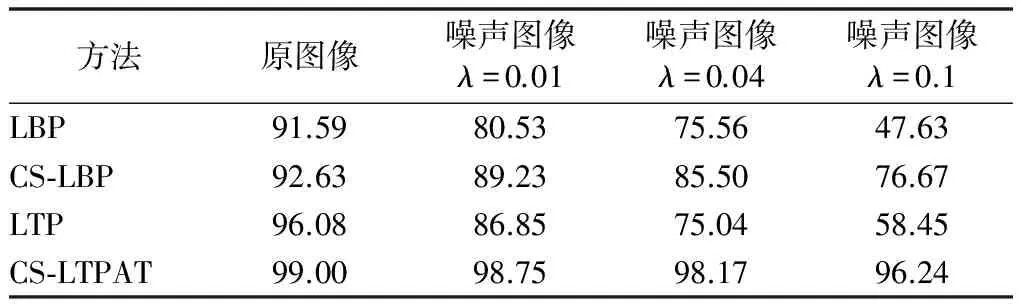

为了验证本文所提算法具有较强的抗噪性,本实验分别在YALE、Extended Yale B两个标准人脸数据库上进行对比实验。由于,现实中噪声的来源非常复杂,并且每张图像受噪声污染的程度也是千差万别。因此,实验中的噪声图像是通过模拟噪声完成。噪声的模型选择高斯白噪声,其均值为0,归一化标准差为λ,分别取0.01、0.04、0.1。实验分为原始图像和噪声图像这两种情况。 在YALE人脸数据库上,随机选取每人一幅图像组成训练集,剩余图像为测试集。实验结果如表2所示。在Extended YALE B中随机选取每个子集里每人五张图像组成训练样本,其他的图像做测试样本,实验结果如表3所示。

表2 YALE人脸库上的实验结果(%)

表3 Extend YALE B人脸库上的实验结果(%)

由表2至表3的实验结果可见,本算法的抗噪声能力明显要优于LBP、CS-LBP和LTP方法。CS-LBP的抗噪性要好于LTP,LBP,而LTP要胜于LBP。LBP算法的抗噪性差主要由于LBP算子采用邻域像素与中心像素的对比度确定二值关系,二值模式易受噪声的影响。LTP算法的抗噪性要优于LBP算法是因为LTP算子本身定义一个阈值,减小了LTP模式受噪声干扰的程度。而CS-LBP算法的抗噪性好于LTP是由于CS-LBP算子不再考虑邻域像素与中心像素的对比度,只比较基于中心像素对称的像素间对比度,大大地增强算子的抗噪能力。而本文算法的抗噪能力最强原因在于算法不仅应用中心对称的思想,且引入邻域均值和动态阈值,极大地增强算法的抗噪性。

综合上述实验来看,CS-LTPAT 算子提取的特征不仅维数低,具有良好实效性,而且对光照变化和噪声变化不敏感。

4 结 语

本文在局部三值模式(LTP)的基础上,提出了自适应中心对称局部三值模式(CS-LTPAT)纹理特征提取算法。本文的工作主要包含3个方面:(1)提出了中心对称局部三值模式,该模式计算复杂度低,能适应实时计算的需求;(2)引入邻域均值增强算子的抗噪性能;(3)通过统计邻域均值与邻域周边像素对比度的标准差,并将标准差作为动态阈值,提高LTP算法的普适性。在YALE和Extended Yale B两个标准人脸数据库上的实验结果表明,在光照变化不大时,CS-LTPAT特征描述算法的识别精度比经典LBP特征描述算法、CS-LBP特征描述至少高出3.5%,比LTP高出2.1%;在光照剧烈变化时,CS-LTPAT的识别精度比LBP、CS-LBP至少高出10%,比LTP至少高出5%。当人脸图像存在噪声时;CS-LTPAT的识别精度比LBP、CS-LBP、LTP分别至少提高了13.85%,5.35%,8.30%。CS-LTPAT识别一张人脸的速度也分别达到了0.1984和0.3988 s。结果充分说明了自适应中心对称局部三值模式算法描述的人脸特征维数低、鉴别能力强,对光照变化及噪声干扰具有更强的鲁棒性,有效提高了人脸识别的精度与速度。

[1] Zhao W,Chellappa R,Phillips P J,et al.Face recognition:a literature survey[J].Acm Computing Surveys,2003,35(4):399-459.

[2] Adani Y,Ullman S.Face recognition:the problem of compensating for the illumination direction[C]//Proceedings of European Conference on Computer Vision,1994:286- 296.

[3] Ojala T,Pietikainen M,Maenpaa T.Multi-resolution grayscale and rotation invarian texture classification with local binary patterns[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2002,24(7):971-987.

[4] Ahonen T,Hadid A,Pietikainen M.Face descirption with local binary pattenrs:application to face recognition[J].IEEE Trans Of Pattenr Analysis and Machine Intelligence,2006,28(12):2037-2041.

[5] 王玮,黄菲菲,李见为,等.使用多尺度LBP特征描述与识别人脸[J].光学精密工程,2008,16(4):696-705.

[6] Guo Zhenhua,Zhang Lei,David Zhang.A completed modeling of local binary pattern operator for texture classification[J].IEEE Trans.on Image Processing,2010,19(6):1657-1663.[7] Zhang W C,Shan S G,Gao W,et al.Local Gabor Binary Pattern Histogran Sequence(LGBPHS):A Novel Non-statistical Model for Face Representation and Recognition[C]//Proc of the 8th Eurropean Conference on Computer Vision.Prague,Gzech Republic,2004:469-481.

[8] 袁宝华,王欢,任明武.基于完整LBP特征的人脸识别[J].计算机应用研究,2012,29(4):1557-1559.

[9] 高涛,马祥,白璘.采用自适应加权扩展LBP的单样本人脸识别[J],光电子·激光,2012,23(4):782-790

[10] Jabid T,Kabir M H,Chae O.Local directional patern(LDP)-a robust image descriptor for Obeject Recognition[C]//Proc of 7th IEEE International Conference on Advanced Video and Signal Based Surveillance,2010:482-487.

[11] Z hang B,Gao Y,Zhao S,et a1.Local derivative pattern versus local binary pattem:face recognition with high-order local pattern descriptor[J].IEEE Transactions on Image Processing,2010,19 (2):533-544.

[12] Heikkila M,Pietikainen,Schmid C .Description of interest regions with local binary patterns[J].Pattern Recognition,2009,42(3):425-436.

[13] Tan Xiaoyang,Triggs B.Enhanced local texture feature sets for face recognition under difficult lighting conditions[J]. IEEE Trans.on Image Processing,2010,19(6):1635-1650.

[14] 霍天霖,王莹.基于LTP子模式的人脸识别研究[J].吉林工程技术师范学院学报,2012,28(5):77-80.

[15] 李伟生,王立逗,周丽芳.一种基于LTP自适应阈值的人脸识别方法[J].小型微型计算机系统,2014,35(9):2099-2103.

[16] 张军,张奇志,周亚丽,等.基于局部Gabor三值模式的人脸识别[J].北京信息科技大学学报,2013,28(2):71-75.

[17] 徐楠楠,李岚,师飞龙.基于汉明约束和CLTP的人脸识别[J].信息通信,2014(4):45-47.

FACE RECOGNITION BASED ON CENTROSYMMETRIC LOCAL TERNARY PATTERN WITH ADAPTIVE THRESHOLD

Yan HeWang PuLiu JieChen Weidong

(College of Computer Science,Chongqing University of Technology,Chongqing 400054,China)

In this paper we propose a new method called centrosymmetric local ternary pattern with adaptive threshold (CS-LTPAT) to address the shortcomings of local ternary pattern in too high the histogram dimension and not being able to adaptively select threshold when describing the texture features of face image.First,the method encodes the face image with the dimension-lowered centrosymmetric local ternary pattern (CS-LTP) operator,and introduces the neighbourhood pixel mean value to encoding for enhancing the anti-noise performance; Secondly,it embeds the standard deviation of statistical neighbourhood average and neighbourhood surrounding pixel as the threshold to extract the facial feature adaptively,and counts the features histograms.Finally,it uses chi-square to measure the similarity of training sample features histogram and test sample features histogram,and employs the nearest neighbour classifier in recognition.The proposed approach is applied to YALE and Extended Yale B standard face database,result shows that the highest correct recognition rates reach 99.67% and 99.33% respectively,and the speed of identifying a face reach 0.1984s and 0.3988 s respectively.Experimental result demonstrates that the proposed method effectively improves the accuracy and speed of the face recognition,and is more robust on the illumination variation and noise.

Face recognitionCentrosymmetryLocal ternary patternAdaptive threshold

2015-03-24。国家自然科学基金面上项目(61173184);重庆理工大学研究生创新基金项目(YCX2013219)。闫河,教授,主研领域:图像多尺度几何分析,目标跟踪,模式识别等。王朴,硕士生。刘婕,硕士生。陈伟栋,硕士生。

TP391

A

10.3969/j.issn.1000-386x.2016.09.034