基于空间分布特征的图像显著性检测*

2016-03-15李二水张建伟

李二水 张建伟

(1.四川大学计算机学院 成都 610065)

(2.四川大学视觉合成图形图像技术国防重点学科实验室 成都 610065)

基于空间分布特征的图像显著性检测*

李二水1,2张建伟1,2

(1.四川大学计算机学院成都610065)

(2.四川大学视觉合成图形图像技术国防重点学科实验室成都610065)

摘要论文提出了一种基于图像显著性区域的空间分布统计特征的全分辨率显著性检测方法。该方法根据图像尺寸按比例提取出图像四周的像素,组成一个新的背景图像,通过对背景图像进行分析处理,得出背景图像块的颜色空间特征,将其运用于获得整幅图像的全分辨率显著性。此外,通过简单的阈值分割方法得到图像中的显著目标。实验结果表明,论文提出的方法容易实现,能够快速、清晰而准确地提取出图像中的显著性目标。

关键词空间分布特征; 显著性检测; 背景图像; 全分辨率

Image Saliency Detection Based on Spatial Distribution Feature

LI Ershui1,2ZHANG Jianwei1,2

(1. College of Computer, Sichuan University, Chengdu610065)

(2. National Key Laboratory of Fundamental Science on Synthetic Vision, Sichuan University, Chengdu610065)

AbstractA method of salient region detection that outputs full resolution saliency maps is proposed which is based on spatial distribution feature of image salient region. Firstly, according to the image size, some peripheral pixels of the image are copied to build a new image named background image, then the background image is analyzed and its features of color space are gotten, lastly, its features are used to produce a full resolution saliency map of the entry image. Moreover, the salient region is obtain by apply a sample method of threshold segmentation on the saliency map. The experiment results show that our model is simple to implement, can extract salient objects in images fast and exactly.

Key Wordsspatial distribution feature, saliency detection, background image, full resolution

Class NumberTP391

1引言

实验心里学家赤瑞特拉通过大量的实验得出人类获取的外界信息83%都是通过视觉完成的,然后对于海量的信息,视觉系统并不是同时地完全进行接收和处理,它具有某种特殊的机制进行选择性的处理和忽略,就是视觉的选择注意机制。把这种机制引用于图像和视频的处理之中,发展出了显著性检测研究。

长久以来,包括计算机视觉、心理学、生物学和神经学等多个领域的学者和专家一致致力于视觉注意机制的基础研究和实际应用工作。举例来说,在计算机视觉领域,显著区域的检测有着广泛的应用,如基于内容的图像检测[1]、图像自动裁剪[3]、图像视频压缩[4]以及在小的显示设备上调节图像的大小[5]等。最近的研究[16,18,20]表明视觉注意机制同样有助于目标的检测、识别和追踪。

图像显著性是指,图像中的像素点或区域能够区别于其他点或区域吸引视觉注意的能力。显著区域检测的本质是一种视觉注意模型(Visual Attention Model,VAM)。VAM是依据视觉注意机制而建立的模型,它利用视觉注意机制得到图像中最容易引起视觉注意的显著部分,并用一幅灰度图像表示其显著度[7]。Treisman和Gelade[21],Koch和Ullman[9]的早期工作,以及Itti,Wolfe[8,11]等人的视觉注意理论提议将视觉注意机制分为两个阶段:纯数据驱动、快速的、自底向上的、潜意识的显著性提取;以及任务驱动、慢速的、自顶向下的、有意识的显著性提取。

图1 输入图像(上),视觉显著图(下)

2相关工作

本文主要关注自底向上的显著性检测相关的文献。这类方法或是基于生物学原理的,或是纯计算的,或两者兼顾。这些方法利用亮度、颜色、边缘等底层特征属性来决定图像某个区域和它周围的对比度。我们可以宽泛地把这些算法分成局部的和全局的两大类。

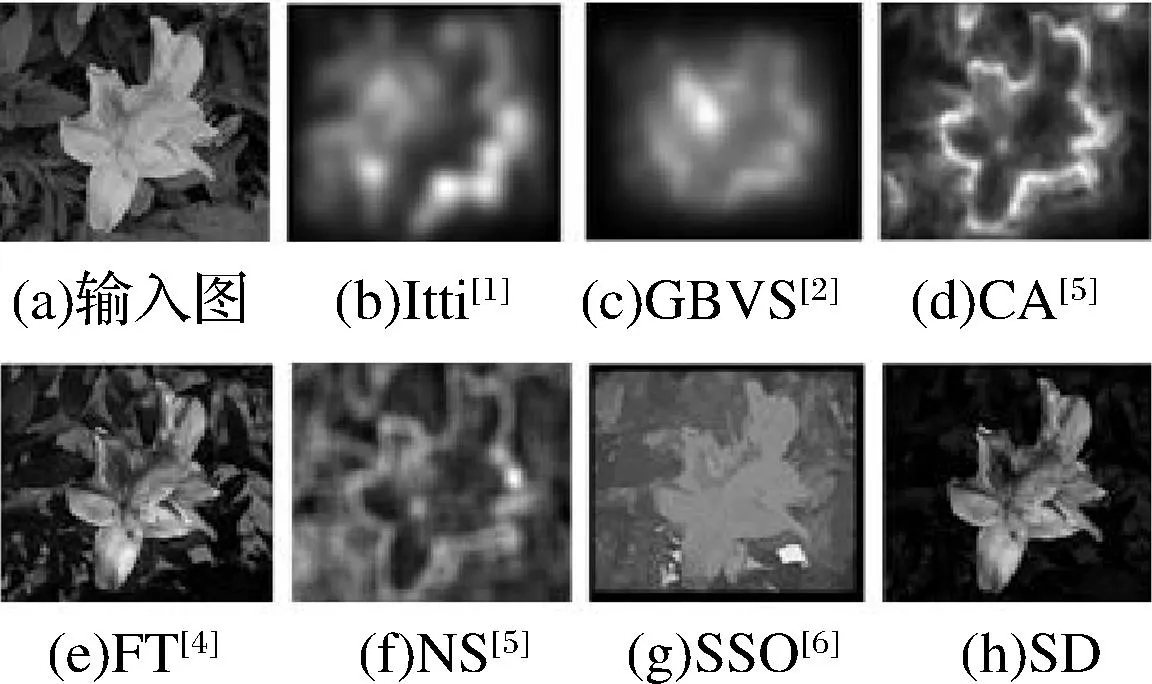

图2 各主流方法及SD方法得到的视觉显著性图

基于局部对比度的方法利用图像区域相对于局部领域的对比度。在Koch和Ullman[19]提出的非常有影响力的生物启发模型基础上,Itti等人[7]定义了图像的显著性。此定义利用了多尺度图像的中心-周围的差异特征来得到多幅显著图并最终融合成整体显著性图像。Ma和Zhang[17]提出了另一种基于局部对比度分析的方法来产生显著性图像,并用模糊增长模型对其进行扩展。Harel等人[14]通过将Itti等人的特征图归一化来突出显著部分,并且可以和其他显著图像结合。Liu等人[20]通过将高斯图像金字塔的对比度线型结合,提出了多尺度对比度。最近,Goferman等人[12]同时对局部底层线索、全局考虑、视觉组织规则以及表层特征进行建模来突出显著性物体。这些利用局部对比度的方法倾向于在边缘部分产生高显著性值,而不是均匀地突出整个物体。

基于全局对比度的显著性区域计算方法用一个区域和整个图像的对比度来计算显著性值。Zhai和Shah[13]定义了基于某个像素和其余像素点对比度的像素级显著性。Achanta等人[2]提出了频率调谐方法,此方法用某个像素和整个图像的平均色的色差来直接定义显著值。但该方法用的是整个图像的平均色,在本质上就弱化了显著区域的显著程度。

3显著区域空间分布特征

3.1原理

所有现在已存的显著性检测算法,包括基于全局对比度的方法和基于局部对比度的方法,它们得出视觉显著性的方法都是由图像的像素值之间进行对比从而同时产生出相对显著性区域和相对非显著性区域。如果能有某种方法先确定某些像素属于非显著性区域,那么图像的显著性检测就变得非常容易了。

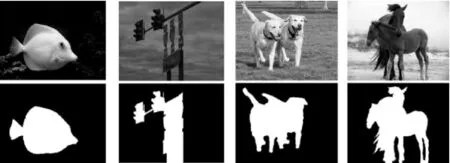

图3 原始图片和它们的人工标注的显著区域图

通过对国际上现有的、业界接受度高的、多个用于图像目标检测、分割和显著性检测等图像处理算法比较的公开测试数据集进行观察和分析,我们发现图像处理算法感兴趣的区域绝大部分是处于整个图像空间的中间位置。对于图像的显著性检测而言,这种显著性区域处于图像中间位置的像素空间分布特征更加的明显。其实,只要我们大概地回想一下我们真实日常生活中拍摄照片时的场景,我们就会明白,对于我们感兴趣的目标,我们当然会把它置于取景框的中央,并聚焦于它们。这样就表明了一个非常重要的事实:我们感兴趣的区域或者目标较大概率处于一幅图像的中间位置,这个像素空间分布特征不仅是我们为测试图像算法而收集的图像数据集的图片有,所有人工拍摄的自然图片都具有这个像素空间分布特征。

3.2实现

在所有我们已知的公开测试集中,Achanta等人提供的测试集[2]是此类数据最大的测试集,并且由人工精确标注了显著性区域。图1展示了其中的一些图片和对应的精确标注显著图。观察之后不难发现,显著图并不是处于图像的绝对中央位置,而是有一定的随机性。而且,有少量图像,它们的部分显著图处于整个图像的边缘。

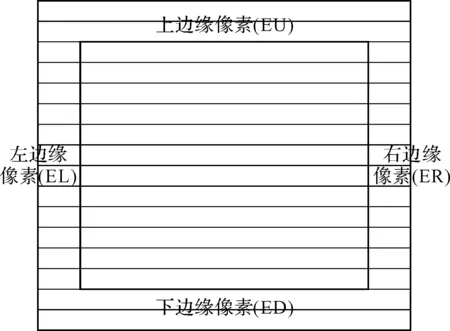

图4 边缘区域图

我们定义边缘比例ER为边缘像素个数占整幅图像像素个数的比例。针对输入图像I,它的宽为W个像素,高为H个像素。ER计算公式为:

(1)

为了使我们的算法针对不同的图像检测显著性具有较好的泛化能力,而不是仅针对某一个数据集去达到最好的ROC曲线,我们并没有统计任何一个测试数据集的边缘比例。本文中所有实验结果的边缘比例ER采用经验值ER=10%,而且EU=ED,EL=ER。当然,这些值也可以根据实际输入图像的特点来确定。把收集的边缘像素重新组合成一个背景图。

4获得显著性图像

4.1选择颜色模型

Lab颜色模型基于人对颜色的感觉,Lab中的数值描述正常视力的人能够看到的所有颜色。因为Lab描述的是颜色的显示方式,而不是设备生成颜色所需的特定色料的数量,所以Lab被视为与设备无关的颜色模型。Lab色彩模型由亮度L和有关色彩的a,b三个元素组成。L表示亮度,a表示从洋红色到绿色的范围,b表示从黄色到蓝色的范围。L的值域由0~100,a和b的值域都是由-128~+127。所有的颜色就以这三个值交互变化所组成。

Lab色彩模型除了不依赖于设备外,它还具有其他的特点和优势:色域宽阔,它不仅包含了RGB,CMYK的所有色域,还能表现出它们不能表现的色彩;人的肉眼能感知的色彩,都能通过Lab模型表现出来;Lab色彩模型弥补了RGB色彩模型色彩分布不均的不足,因为RGB模型在蓝色到绿色之间的过渡色彩过多,而在绿色到红色之间又缺少黄色和其他色彩。为了在获取图像显著性的处理中保留尽量宽阔的色域和丰富的色彩,同时效果较好,我们把原始图像变换到Lab色彩模型。

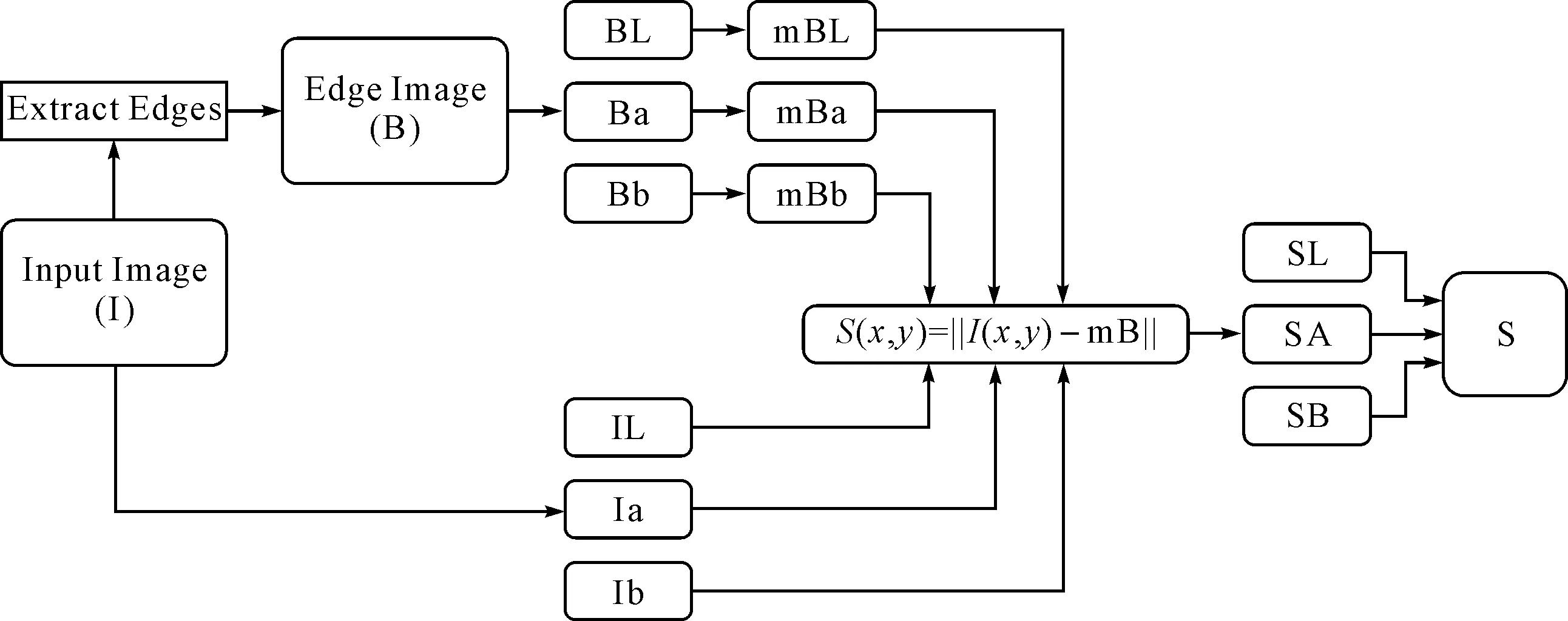

图5 显著性算法流程图

4.2变换颜色空间

针对输入图像I,它的宽为W个像素,高为H个像素。按照边缘比例ER=10%提取I的四周边缘像素组成边缘图像B,它的宽为Wb=0.1*W个像素,高为Hb=0.1*H个像素。运用相同的颜色空间变换参数把输入图像I和它的对应边缘图像B变换到Lab色彩空间,分别对应为ILab和BLab。然后再分别分离出三个通道:ILab分离得到IL、Ia和Ib;BLab分离得到BL、Ba和Bb。

对于获得的Blab的单通道图像BL、Ba和Bb,分别计算得到对应的平均值mBL、mBa和mBb。

利用一阶距离获得单通道图的显著性。

针对原图在Lab空间分解通道得到的三个单通道图像IL、Ia和Ib,使用式(2)可以分别计算一阶距离得到三幅显著性图,分别为SL、SA和SB。

S(x,y)=‖I(x,y)-mB‖

(2)

4.3获得最终显著图

在已经获得SL、SA和SB三幅显著图的情况下,如何融合最终的显著图。显然可以给它们分配不同的比例线型合成最后的显著图S。本文实验结果采用如式(3)所示的最简单的平均法,每幅显著图SL、SA和SB在合成最后的显著图S的比重是一样的。

(3)

5实验结果与分析

为了评价本文提出的显著性检测方法,这里比较了六种主流的显著性检测模型:Itti模型[7],GBVS模型[14],CA模型[12],FT模型[2],NS模型[17],SSO模型[19]与本文模型在图像数据库[6]中的表现,Achanta[15]从该数据库中选出1000幅图像组成一个显著性检测的标准图像库,图像库中每幅图像均有被大部分人接受的单一显著物理存在。六种主流模型的MatLab程序可以从相关网站上下载得到。

一些具有代表性的测试图像及实验结果见图2(a)~2(h)。从图2中可以看到本文方法产生的显著图能够明显且客观地反映出图像中整个显著物体的轮廓,特别是图像的边缘信息比较完整和清晰,显著物体与背景图像的对比也很强烈,显著物体的整体性也比较完整,结果与人的主观感觉比较一致。Itti模型、CA模型和NS模型的显著图都是显示一些边缘亮点,显著区域内部被镂空,GBVS模型和SSO模型的显著图边缘模糊,在处理复杂背景的图像时不能有效地抑制背景噪声的特点更加明显;在FT模型的显著图中能够检测到显著物体的边缘和较好的完整性,但是显著物体与背景区域的对比不如本文模型得到显著图明显,因为本文模型充分利用了显著物体像素的空间分布特性,在本质上消除了背景区域像素对显著性检测的干扰,能够有效弥补上述方法的缺陷。

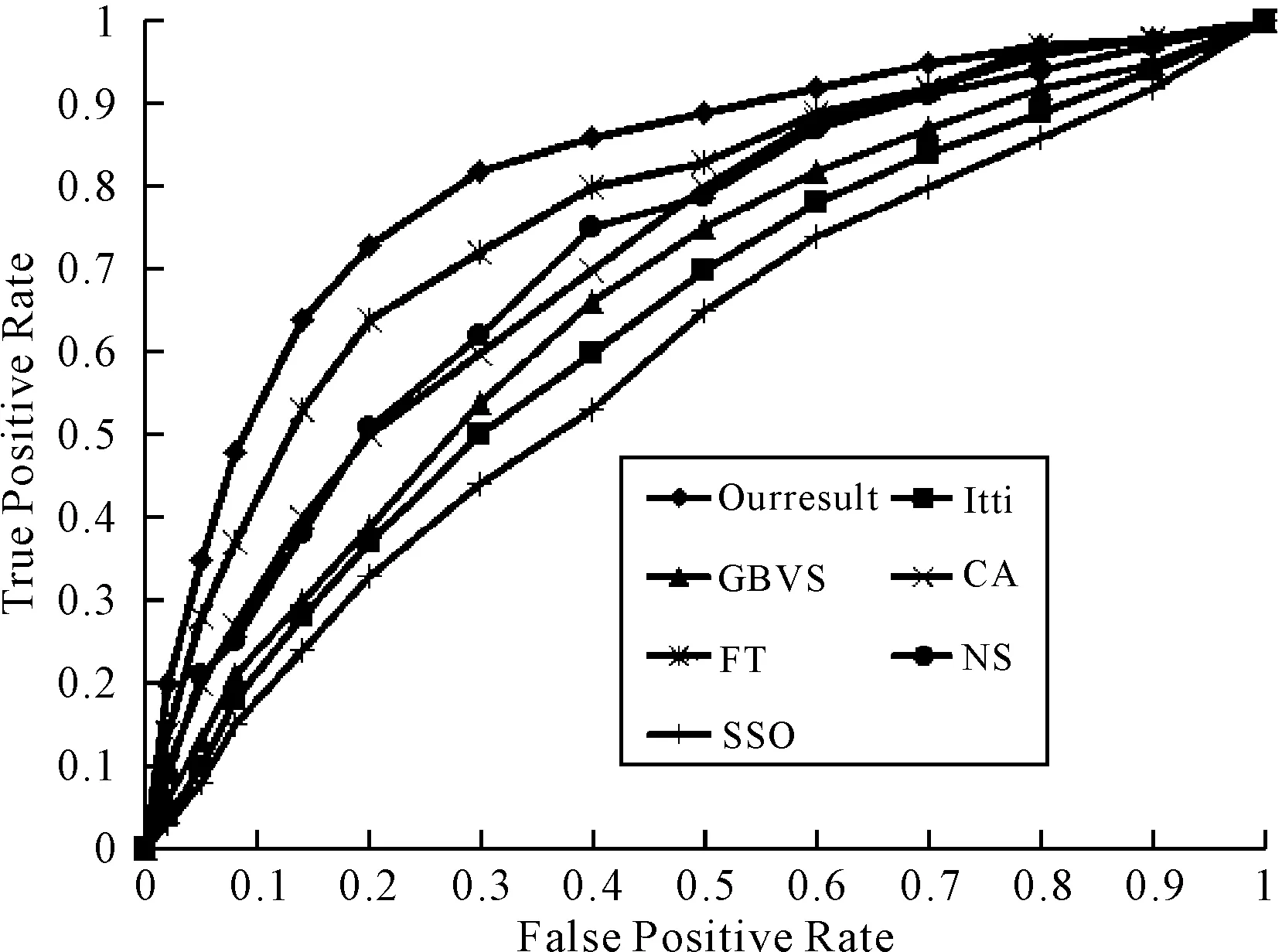

除了上述的主观评价外,本文还计算了几种不同显著性检测方法的ROC(Receiver Operating Characteristic)曲线。ROC曲线是一种分析判断和决策性能的定量方法,可以动态地、客观地评价一种分类方法的优劣。客观评价显著性结果的本质是一个二分问题,即算法计算的结果是否与统一接受的主观认定相一致。一个二分问题会出现四类情况:实际是正类并且被预测为正类,即真正类(True Positive,TP);实际是负类而被预测为真类,即假正类(False Positive,FP);实际是负类并且被预测为负类,即真负类(True Negative,TP);实际是正类而被预测成负类,即假负类(False Negative,FN)。定义真正类率(True Positive Rate,TPR)和假正类率(False Positive Rate,FPR)分别为

(4)

ROC曲线的横坐标为FPR,代表错误的命中率;纵坐标为TPR,代表正确的命中率。我们先将处理原图而得到的显著性图归一化到灰度图空间,然后简单地取灰度图的直方图谷值为阈值,对显著性图进行二分阈值分割。显著图的TPR和FPR是正相关的,我们期望的结果是:较小的FPR对应较大的TPR。

本文中绘制ROC曲线的数据库图像由文献[2]提供,该数据库共包含1000幅自然场景的图像,图像中显著物体的大小占整幅图像的大小各不相同,显著物体在整幅图像中的空间分布也千差万别,而且图像背景也比较复杂。图6中的ROC曲线表明本文提出的方法在较小的FPR时,有较大的RPR,其结果优于文献[1~5]中提出的方法。

图6 ROC曲线

本算法运行的软件环境为Matlab R2013a,系统环境为Windows 7旗舰版,内存为4GB,CPU主频为2.5GHz,运行计算一副图像显著性的平均耗时为4.736秒,与本文中提及的其他主流算法相比,处于中等偏上水平,结合显著性检测的效果,本文提出的方法的表现是优秀的。

6结语

我们提出了基于空间分布特征的图像显著性计算方法,该方法实现简单,时间复杂度较低,再结合Lab色彩模型可以准确地刻画出整幅图像中的完整显著区域。

我们通过对业界比较认可的几个公开的图像显著性计算测试集仔细观察,得出了显著区域像素在整幅图像中的空间分布特征,利用该特征可以获得背景区域像素,并且大大地减少了计算量。利用已获得的先验知识,把显著区域和背景区域提前分离,使得背景区域像素不会作为噪声干扰我们计算图像像素的显著性,这样使得我们的显著性区域与背景区域的对比更加明显,同时,显著性区域也保持了很好的完整性。

本文提出的显著性检测方法主要是在Lab色彩空间中基于各单通道颜色对比来获取图像的显著特性的。接下来的工作将把图像的纹理特征加入进来,作为像素显著性强度的一个影响因素,以便使显著性检测方法更加完善。

参 考 文 献

[1] Jian M W, Dong J Y, Ma J. Image retrieval using wavelet-based salient regions[J]. The Imaging Science Journal,2011,59(4):219-231.

[2] R. Achanta, S. Hemami, F. Estrada, et al. Frequency-tuned salient region detection. In CVPR, pages 1597-1694,2009:409-414.

[3] 华顺刚,陈国鹏,时树胜.基于相似性判据的图像尺寸调整算法[J].计算机工程,2012,38(4):191-193.

HUA Shungang, CHEN Guopeng, SHI Shusheng. Image resizing algorithm based on similarity criterion[J]. Computer Engineering,2012,38(4):191-193.

[4] Gupta R, Chaudury S. A scheme for attentional video compression[J]. Pattern Recognition and Machine Intelligence,2011,6744:458-465.

[5] Kim W, Kim C. A novel image importance model for content-aware image resizing[C]//Proceedings of the 18thIEEE International Conference on Image. Brussels, Belgium: IEEE,2011:2469-2472.

[6] 沈兰荪,张菁,李晓光.图像检索与压缩域处理技术的研究[M].北京:人民邮电出版社,2008:102-103.

SHEN Lansun, ZHANG Jing, LI Xiaoguang. Image Retrieval and Compressed Domain Processing[M]. Beijing: Posts and Telecom Press,2008:102-103.

[7] Itti L, Koch C, Niebur E. A model of saliency-based visual attention for rapid scene analysis[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence,1998,20(11):1254-1259.

[8] Zhang X L, Li Z P, Zhou T G, et al. Neural activities in V1 create a bottom-up saliency map[J]. Neuron,2012,73(1):183-192.

[9] C. Koch, S. Ullman. Shifts in selective visual attention: towards the underlying neural circuitry. Human Neurbiology, 4:219-227,1985:409-410.

[10] Hansen L K, Karadogan S, Marchegiani L. What to measure next to improve decision making? On top-down task driven feature saliency[C]//2011 IEEE Symposium on Computational Intelligence, Cognitive Algorithms, Mind, and Brain. Paris, France: IEEE,2011:86-87.

[11] Baluch F, Itti L. Mechanisms of top-down attention[J]. Trends in Neurosciences,2011,34(4):210-224.

[12] S. Goferman, L. Zelnik-Manor, A. Tal. Context-aware saliency detection. In CVPR,2010:410-414.

[13] Itti L, Koch C. A saliency-based search mechanism for overt and covert shifts of visual attention. Vision Research,2000,40(6):1489-1506.

[14] J. Harel, C. Koch, P. Perona. Graph-based visual saliency. In NIPS, pages 545-552,2006:410-414.

[15] Achanta R, Estrada F, Wils P, et al. Salient region detection and segmentation[C]//Proceedings of the 6thInternational Conference on Computer Vision Systems,2008,5008:66-75.

[16] Jiao W, Peng Q M, Lv W X, et al. Multiscale detection of salient regions[C]//Proceedings of the 4thIEEE Conference on Industrial Electronics and Applications. Xi’an, China: IEEE,2009:2408-2411.

[17] Zhang Ling-Yun, Matthew H. Tong, TimK. Marks, et al. Cottrell (2008). SUN: A Bayesian framework for saliency using natural statistics[J]. Journal of Vision,8(7):32,1-20.

[18] Zhang J, Sun J D, Liu J, et al. Visual attention model based on multi-scale local contrast of low-level features[C]//Proceedings of the 10thIEEE International Conference on Signal Processing(ICSP). Beijing, China,2010:902-905.

[19] Esa Rahtu, Juho Kannala, Mikko Salo, et al. Segmenting salient objects from images and videos[C]//Proceedings of the 11thEuropean conference on Computer vision: Part V pages 366-379.

[20] 张巧荣,顾国昌,刘海波,等.利用多尺度频域分析的图像显著区域检测[J].哈尔滨工程大学学报,2010,31(3):361-365.

ZHANG Qiaorong, GU Guochang, LIU Haibo, et al. Salient region detection using multi-scale analysis in the frequency domain[J]. Journal of Harbin Engineering University,2010,31(3):361-365.

[21] A. M. Triesman, G. Gelade. A feature-integration theory of attention[J]. Cognitive Psychology,1980,12(1):97-136.

中图分类号TP391

DOI:10.3969/j.issn.1672-9722.2016.02.032

作者简介:李二水,男,硕士研究生,研究方向:图形图像处理、计算机视觉。张建伟,男,博士,研究员,博士生导师,研究方向:数字图像处理与计算机图形学、空管自动化。

基金项目:面向大尺度场景的高融合度增强现实技术(编号:2013AA013802);民航科技项目(编号:20150228)资助。

*收稿日期:2015年8月17日,修回日期:2015年9月21日