迁移学习模糊识别方法和智能建模

2015-12-02王士同钟富礼蒋亦樟邓赵红钱鹏江

王士同, 钟富礼, 蒋亦樟, 邓赵红, 钱鹏江

(1.江南大学数字媒体学院,江苏无锡214122;2.香港理工大学计算机系,香港)

传统机器学习方法发展至今已取得了许多重 大研究成果[1-4],其学习模式通常包含无监督学习和有监督学习两种。无监督学习中,聚类分析[5-7]是一类代表方法;而对于有监督学习,分类和回归[8-12]应用更为普遍。就上述的两种传统机器学习模式而言,无论是无监督学习还是有监督学习,其在学习过程中必须基于对大量数据的分析和学习方可构建较好的模型,从而进行进一步的数据分析或预测。然而,在实际应用中,大量可用及有用的数据由于时间、采集设备等因素而不易获取。如在处理某一新兴领域的建模问题时,模型构建初期,数据量往往较少不足以构建一个满意的模型。这时通常需要借助大量且有效的历史数据为模型得以充分训练起到支撑作用,但是历史数据通常与当前数据不同源或是虽然同源但由于生产环境与条件的不同,致使这些数据存在某种程度上的差异性。若继续使用传统的机器学习方法进行建模,所得模型在新数据并不充分或数据自身采集时就存在信息缺失问题,所建的系统必定变得不可靠,故难以用于实际的生产活动中。此外,对于无监督的学习方法,如聚类分析其同样在面对数据量缺乏的聚类任务时,由于数据缺乏导致聚类信息不明确,进而造成最终所能获取的聚类结果不佳。以上缺陷均因传统的机器学习模式所导致,如何更智能的学习则是当前的研究重点。

针对传统机器学习方法所存在的问题,一种全新的学习模式——迁移学习方法已提出[13-17]。该方法在学习目标任务的过程中,通常借鉴历史相关领域(源域)的数据或知识以辅助当前领域(目标域)的学习,其学习过程与人类的认知过程一致,是一种类人学习方式。目前,迁移学习方法已成功应用于分类、聚类以及回归等方面,其中又以分类领域的成果最为丰富[18-22]。但是,迁移学习方法的应用主要集中于基于概率论的机器学习方法,而作为机器学习领域另一大研究分支基于模糊论的机器学习方法,其在应用迁移学习技术解决算法在面对数据量少或数据信息缺失等场景下性能下降等问题的研究尚且不多。近年来,本课题组基于模糊识别方法[7,23-25]和智能建模[26-29]的研究,针对如何将迁移学习技术引入经典的模糊机器学习方法中进行了一系列研究[30-36]。

文中在简述迁移学习基础理论的基础上,重点介绍了本课题组近年来如何将迁移学习理论应用于模糊识别方法和智能建模方法。并就目前迁移学习在模糊识别和智能建模尚存在的问题和未来发展的趋势进行总结和展望。

1 迁移学习理论

经过对人类学习过程的分析,发现人类在认知新事物过程中,必定会借鉴以往知识进行类比迁移学习。例如当人在认知“梨”的过程中,必定会借鉴其认知“苹果”的知识,这就是迁移学习在人类学习过程中的具体体现。迁移学习定义为:不同的领域或任务之间相互借鉴、学习、迁移转化的能力[17]。

1.1 迁移学习的发展历程

在传统的数据挖掘和机器学习算法中,经常采用带标签或未带标签的训练数据通过传统的训练模型得到标准的应用于未来数据的预测模型[1-4]。在半监督分类过程中,带标签的数据通常并非大量存在。因此,要建立一个良好的分类系统,必须同时借助大量无标签的数据与少量有标签的数据。然而,以往大部分的研究成果都是建立在有标签的数据与无标签的数据分布一致的情况下。而迁移学习理论则恰恰相反,它允许用于训练和测试的数据源于不同的领域或具有不同的数据分布特征。1995年在NIPS有关机器学习的会议上,首次提出了迁移学习的相关理论。

自迁移学习理论提出以来,已得到人们越来越多的关注,对于它的表述不同的研究人员有着不同的见解。其中,具有代表性的论述有:学习引导学习,终身学习,知识迁移,归纳迁移,多任务学习,巩固知识,上下文敏感学习,以知识为基础的归纳学习,元学习,增量 /累积学习等[37]。其中,与迁移学习密切相关的一个技术是基于多任务的学习框架[38],该框架试图同时对多个不同任务进行学习。这种学习方式的传统做法是通过对多任务中(包括源任务和目标任务)共同部分的学习,进而引导每个独立单体各自学习。

2005年,美国国防部高级研究计划局关于信息处理技术的有关公告中,又给迁移学习下了新的定义:一个系统在进行新任务时应该借鉴以往任务积累下的经验与知识。在该定义中,迁移学习被用来从一个或多个源任务学习中强调对源和目标任务的同时学习,而迁移学习理论则更多地把精力用于目标任务中提取历史知识并将这些知识应用于新的目标任务中去。这一手段与多任务学习不同,在任务的学习方面,它使得源任务与目标任务在迁移学习时所占的比重不再对等。

今天,迁移学习理论已在人工智能领域内的多个方向得到了发展,尤其是数据挖掘(ACM KDD,IEEE ICDM and PKDD,etc)与机器学习(ICML,NIPS,etc)方面。这也进一步的促使了该领域内的研究人员将更多的目光转移到迁移学习理论的应用与研究方面。同时也为文中的研究工作提供了理论的依据。

1.2 迁移学习的基本概念

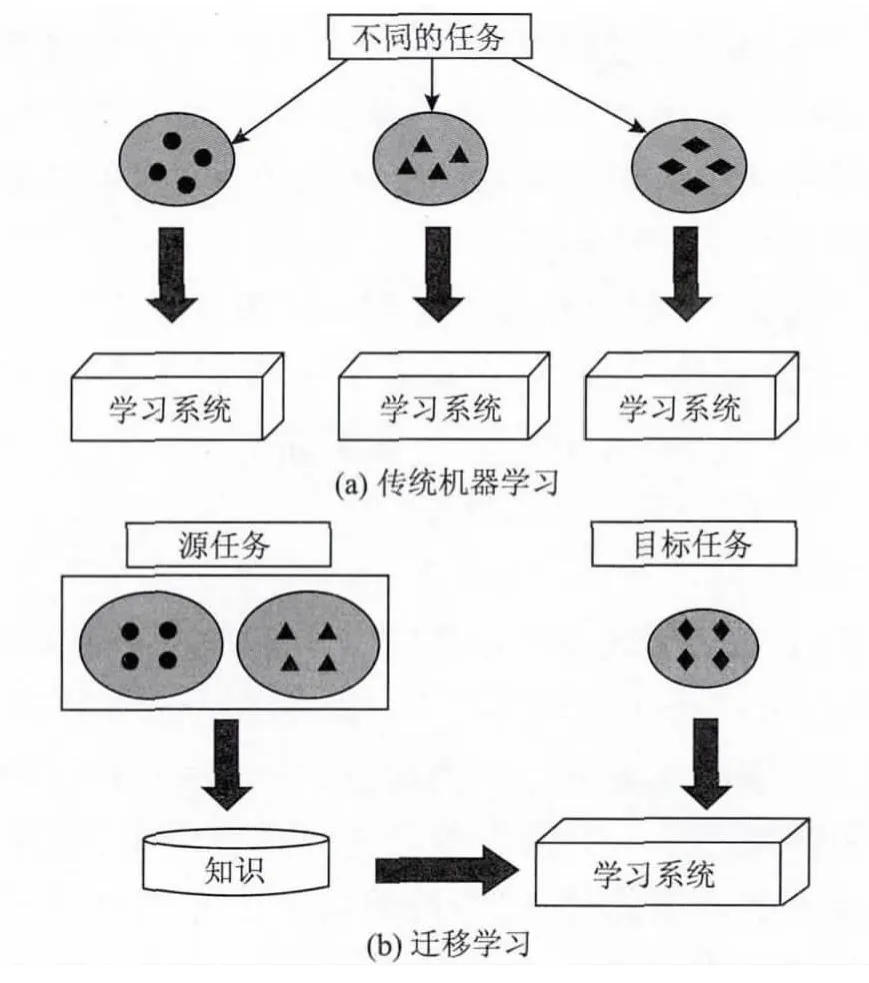

根据迁移学习的理论[17],分析传统机器学习技术与迁移学习机器学习技术之间的联系与差异,具体如图1所示。

图1 不同的学习过程Fig.1 Different learning processes between the traditional machine learning and the transfer learning

由图1(a)可以发现,在传统的机器学习过程,对于处理不同的任务,其通过自有的学习方法,构建出与之对应的不同的学习系统。这样的构建方法,在遇到数据分布状况发生变化时,其必须重新进行模型训练,因此,浪费了当初所建模型的时间与精力。

为使机器学习理论更加智能化,并使其具备与人类学习过程类似的能力,人们在传统的机器学习方法的基础上引入迁移学习机制,具体的学习过程如图1(b)所示。因迁移学习理论强调借鉴历史知识,通过利用这些历史知识指导系统对新任务或新数据域的学习掌握能力。当然,这样的建模设计也更加符合人类的认知行为习惯,同时为机器学习领域实现增量式学习打下了坚实的基础。

1.3 迁移学习的基本分类

迁移学习方法通常可分为3大类:①基于实例的迁移学习方法[39-41],该方法的主要原理是通过对源域数据的改造以满足目标域数据分布,从而增大目标域的数据量实现样本的迁移;②基于特征表征的迁移学习方法[42-44],该方法通过为目标域学习得到一个有效的特征表征空间,在对目标域学习时借鉴所获取的特征表征空间,进而提高目标域的学习性能;③基于关联知识的迁移学习方法[45-46],该方法基于一个假设,即源域和目标域的数据近似,通过迁移数据之间的关联性以提高目标域的学习性能;④ 基于模型参数的迁移学习方法[30-36,47-49],该方法通过对源域数据总结得到一系列的模型参数称作源域模型知识,然后在目标域学习过程中利用这些知识进行辅助学习,从而得到性能更佳的目标域模型。

1.4 迁移学习的研究进展

迁移学习技术自被提出以来,由于其独特的学习认知能力与人类的认知过程基本一致,使得该理论在人工智能领域成为研究热点[18-22]。目前,迁移学习理论已经在分类、聚类以及回归等方面得到了广泛关注。2007年Raina等[18]将迁移学习的理论应用到了未标记数据的分类问题上;Yang等[19-20]提出了基于迁移学习理论的TPLSA算法,并将其应用于文本分类方向,并在此后提出了一种半监督的域适应迁移成分分析方法(TCA),该算法同样被广泛应用到分类领域中;Glorot等[21]进一步将域适应的迁移学习方法成功应用到了大规模情感数据的分类问题上;Duan等[22]成功地将迁移学习理论与多核学习融合并应用于分类领域;Dai等[50]将其应用于聚类的迁移学习,提出了一种自学习的聚类算法。

近年来,迁移学习技术的研究工作主要集中于基于概率论基础的机器学习方法,而基于模糊论的机器学习方法中利用迁移学习技术的相关报道还较少。本课题组对于如何将迁移学习技术引入经典模糊机器学习方法,从而使得模糊机器学习过程变得更为智能进行一系列的研究工作。主要在模糊识别方法即模糊聚类技术和模糊智能建模方法即模糊系统建模技术两个方面开展了相关工作。

2 迁移学习模糊识别方法

在模糊识别领域,模糊聚类得到了广泛的应用,如图像分割[51]和目标检测[52]等。经典的基于模糊理论的聚类分析方法有FCM算法及其相关变形算法[5-7]。但无论是经典的FCM算法还是具备前沿性的FCM算法的变形算法,其良好的聚类性能一般需依靠大量包含丰富信息的聚类样本。在实际生产中所采集到的数据常存在以下的几种情况:①由于生产的保密性或该产业本身就是一新兴产业,以往并无数据积累,这就极易造成所能获取的数据样本非常有限同时所包含的聚类信息亦较少,最终得到聚类性能不佳;②由于数据本身在传输过程中受种种因素的干扰,造成了数据丢失或数据失真的状况,这也会间接造成传统的聚类算法失效。为此,经研究发现迁移学习可作为一种有效策略以解决传统聚类方法在样本缺乏或失真情况下聚类性能不佳的问题。

2.1 经典模糊聚类技术

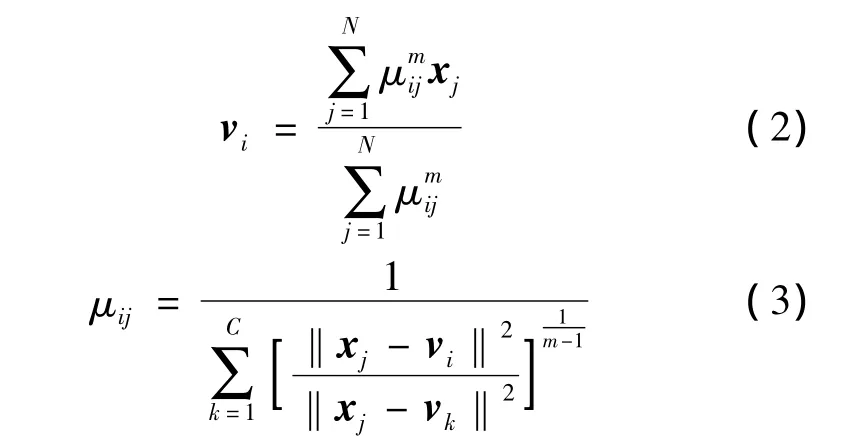

在经典聚类算法中,一类重要的聚类策略是由不断迭代更新的类中心驱动空间的划分,其中尤以FCM算法最为著名[6],其目标函数如下:

其中:C为聚类数;vi=(vi1,…,vik)为第i类的中心点;μij为第j个样本属于i类的隶属度;模糊指数m必须满足m >1;xj为第j个样本点。为了得到最优的聚类中心V以及隶属度U,利用拉格朗日条件极值的优化理论可以得到如下的迭代表达式:

根据式(2)和式(3),迭代优化终止后所获取的隶属度矩阵U在去模糊化之后得到空间划分矩阵,根据该矩阵可最终获取每一个样本xj所对应的类标签。

虽然上述经典模糊聚类算法在面对各具特色的数据集时均被证实具有良好的聚类性能,但是由机器学习理论可知,此类传统聚类算法的优越性一般均是建立在大量待分析数据或数据所含信息非常充分的基础上。这便造成了当上述算法遇到待分析数据不足或是待分析数据所含信息缺失时,算法的有效性将面临严重的考验,甚至得不到能够满足生产或生活需要的聚类结果[34]。

2.2 基于迁移学习的模糊聚类技术

为解决经典模糊聚类算法在待分析数据不足或数据信息缺失情况下性能下降的问题。研究发现[34,36],通过解决下述两大问题即可实现具备迁移学习能力的模糊聚类算法,进而提高算法的适应性。

问题1:采用何种方法进行迁移学习?

在通过对FCM算法的长期研究,发现类似FCM算法这类基于划分的聚类方法,参数迁移是一种有效地迁移学习策略。通过对源域数据进行聚类获取对应的模型参数(如类中心v和隶属度U),这两个重要参数内包含了数据与类别之间的关联关系,是一类可用的理想知识。只需利用上述两参数构造出合理的目标函数,使得目标域在聚类的过程中有效地借鉴从源域中所获取的上述知识,即可实现源域到目标域的迁移学习。

问题2:如何在聚类过程中实现迁移?

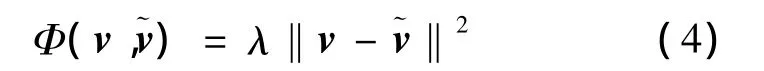

为在聚类的过程中实现参数迁移亦即知识迁移,设计出了以下两个迁移聚类准则:

1)中心知识迁移准则

2)隶属度知识迁移准则

上述两种迁移准则不仅利用了类中心知识还利用了隶属度知识,因此其迁移学习的能力是有保障的,通过调节迁移平衡参数λ和η可最终控制迁移的质量。此外,由于类中心本身具有高度的数据抽象能力,因此使用类中心作为迁移知识并不会暴露源域数据,对源域数据的隐私起到了保护的作用。

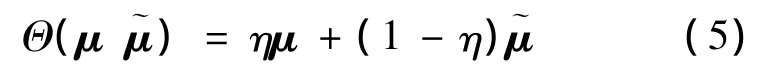

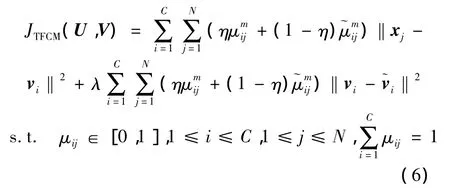

根据上述迁移思想,最终可构造如下的融入上述两种知识迁移的模糊聚类算法,即TFCM算法。其具体目标函数如下:

其中,λ和η为迁移平衡参数,且λ∈[0,+∞)及η∈[0,1]。值得注意的是,当迁移平衡参数λ =0且η=1时,文中算法实际上退化为经典的FCM算法,这一性质保证了TFCM算法式(5)的性能不会劣于经典FCM算法,有效地避免了负迁移的影响。

为了得到最优的目标域聚类中心V以及隶属度U,利用拉格朗日条件极值的优化理论可以得到如下的迭代表达式:

具体的迁移FCM算法(TFCM)实现过程如下:

1)输入:聚类中心数C,隶属度模糊控制参数γ,最大迭代次数f,源域数据集XSource,目标域数据集XTarget,迁移平衡参数λ和η,迭代终止条件ε;

2)输出:目标域类中心点V和隶属度U。

3 迁移学习模糊智能建模

模糊系统作为智能建模领域内一个重要的研究分支,其依靠自身独特的可解释性以及强大的学习能力,被广泛应用于各个领域内,如智能控制、信号处理、模式识别等方面[53]。针对模糊系统的研究主要集中在系统的参数学习方面,经典的学习方法主要包含以下两个方面[54]:①利用专家经验直接赋值;②通过大量的数据进行训练学习。而在实际建模过程中后一种方法应用的更为广泛。但是,经典的模糊系统建模方法同样面临着训练和测试分布不一致,或是数据缺乏导致所构建的系统泛化性能达不到现实生产过程的期望。针对这种情况,有效地利用历史相关领域(源域)积累的知识对当前领域(目标域)建模而言将是一种有益的补充。同样,在利用源域数据进行建模时与聚类一样同样存在以下两个问题:

1)采用何种方法进行迁移学习,是实例迁移?特征迁移?关联知识迁移?还是参数迁移?

2)如何在建模过程中实现迁移?

3.1 经典模糊系统建模技术

经典模糊系统模型可分为以下几类,具体如表1所示。

表1 经典模糊系统对应之模糊规则Tab.1 Classical fuzzy models and their definition of the fuzzy rules

由于TSK模型较为简洁并具有一定的研究价值和可扩展性,如大样本拓展等[26]。文中将重点介绍如何基于TSK模糊系统进行迁移学习,具体给出具有迁移学习能力的TSK模糊系统的建模方法。

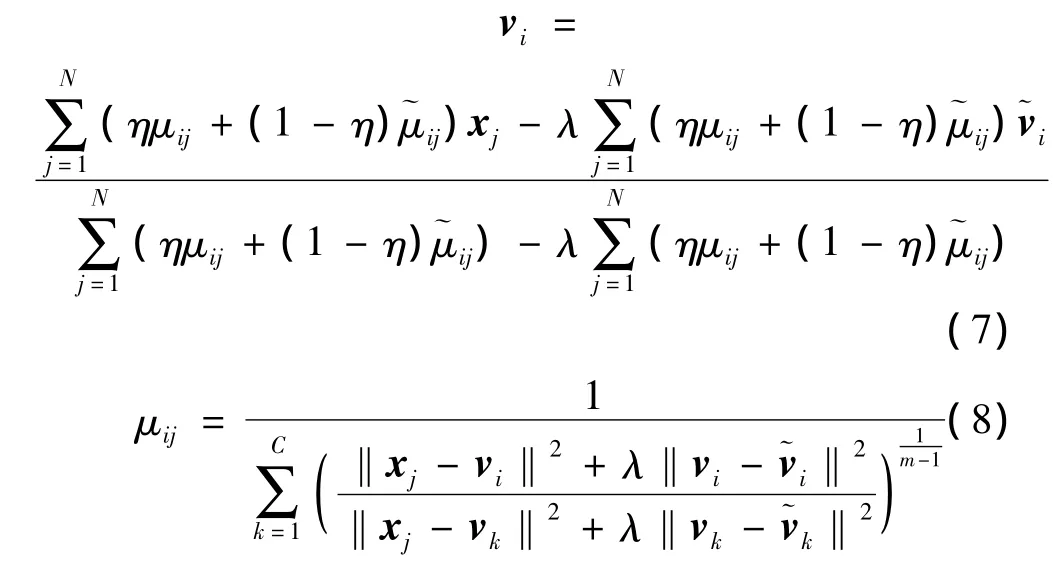

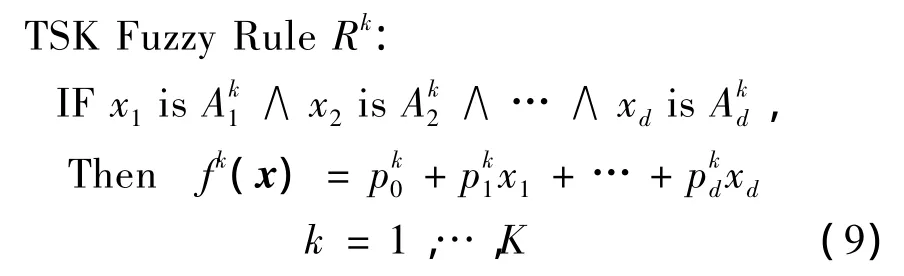

TSK型模糊系统的模糊推理规则表达如下:

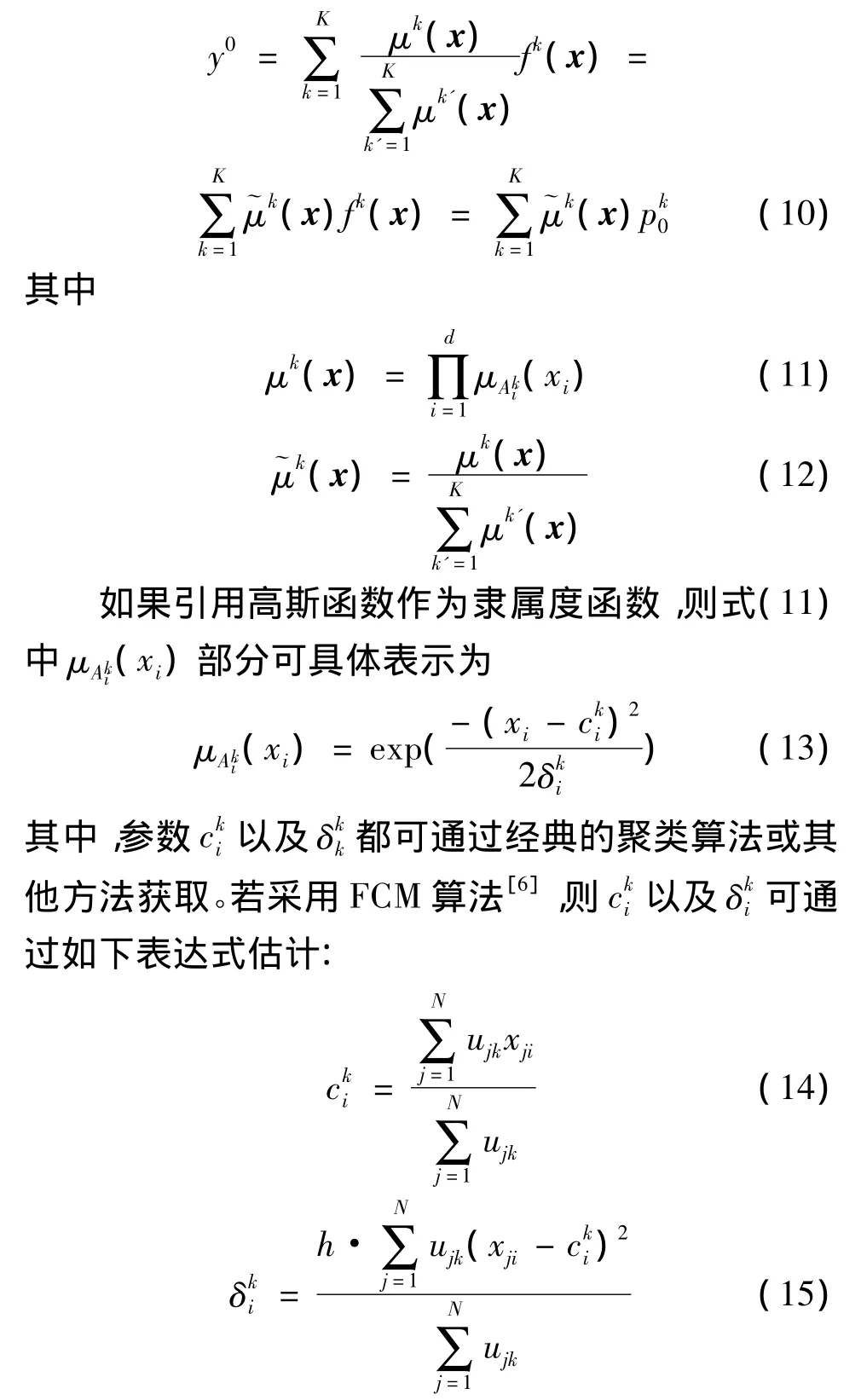

式中:ujk为输入向量 xj= [xj1,xj2,…,xjd]T隶属于第k类的隶属度;h为人工可调的尺度参数。

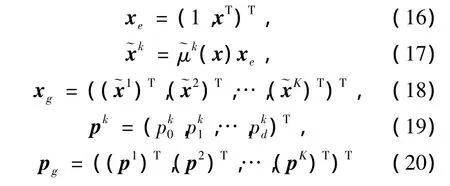

根据文献[26]的策略,令

此时,可将式(10)改写为

通过上述描述,可知TSK型模糊系统的参数学习问题最终可转化为线性回归问题[26]。这也使得利用TSK模型进行系统建模时,可借鉴线性回归模型加以探讨。

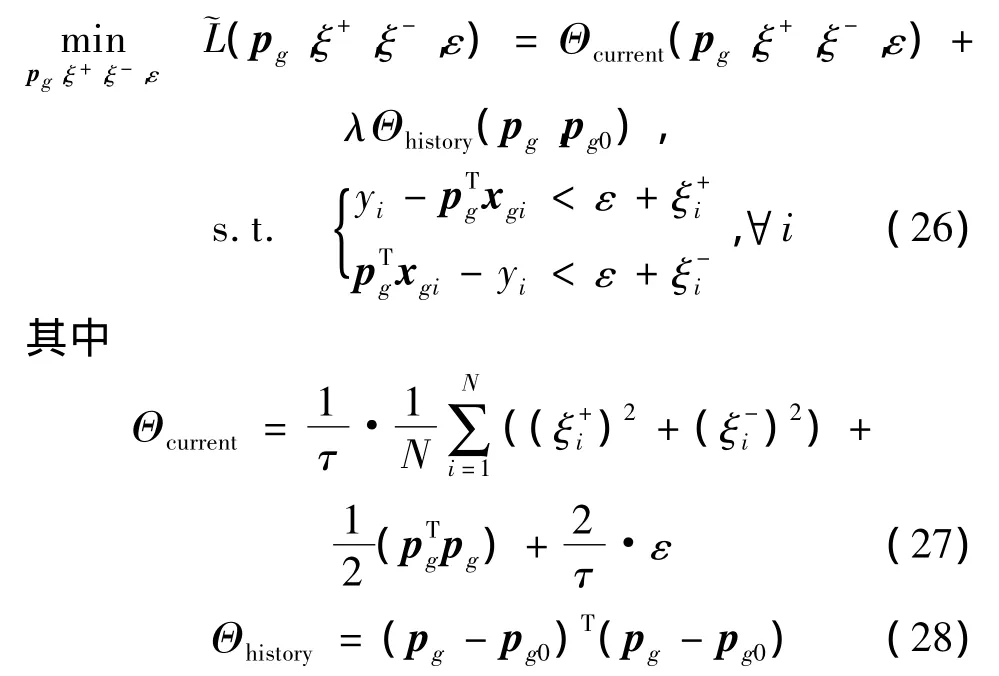

为对TSK模糊系统模型后件参数进行优化,基于ε-不敏感损失函数构造TSK模型的优化目标函数[26],具体表示如下:

由于式(24)引入了结构风险项,故其继承了统计学习理论学习算法的一些优点,如对小样本集具有一定的鲁棒性。

尽管上述TSK模糊系统建模方法在面对传统数据建模任务时,表现出了一定的优越性能,但在面对数据缺乏的建模任务时,其性能受限于传统的机器学习模式往往得不到令人满意的建模效果。

3.2 基于迁移学习的模糊系统建模技术

在通过对TSK模糊系统的研究,发现有效利用历史相关领域(源域)积累的知识对当前领域(源域)建模则是一种有益的补充。针对TSK模糊系统,其中一类有用的知识可以描述为该系统对应的参数pg。因而对于某历史场景受训得到的TSK模糊系统,可把其对应的pg作为已有的可用历史知识进行参数迁移。

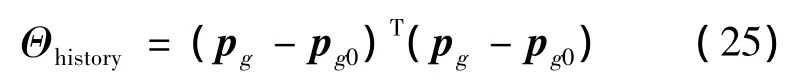

为在建模过程中实现参数迁移也即知识迁移,设计出针对TSK模糊系统的模糊后件参数知识迁移准则:

式中:pg0为从源域模糊系统中获取的后件参数作为迁移知识;pg为当前目标域有待训练优化的模糊系统后件参数。

由于上述迁移准则仅利用了高度抽象的后件参数,其在迁移过程中并不暴露源域数据,因此能够对源域数据的隐私起到保护作用。

根据上述迁移思想,在传统TSK模糊系统建模技术(即式(24))的基础上融入迁移学习准则式(25)可得到具备迁移学习能力的TSK模糊系统建模方法,称之为T-TSK-FS算法。其具体目标函数如下:

其中,Θcurrent为利用目标域数据对模型训练学习;Θhistory为利用源域知识进行迁移学习,该项可有效利用源域知识尽可能地对目标域数据的缺乏或信息缺失进行信息补偿。两项的功能分别为使得学习得到的模型逼近目标域采样数据对应的模型和源域已构建的模型。参数λ使得最终学习得到的模型在两者之间达到一个平衡。λ可人工设定,也可通过机器学习中常用的交叉验证策略[56]选择一个合适的值。

具体的算法实现过程如下:

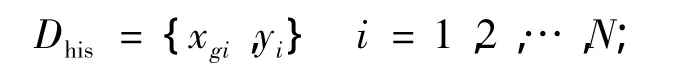

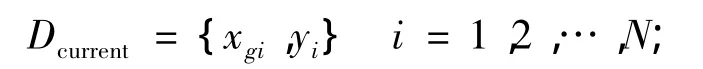

1)历史总结阶段:①设置模糊规则数Khis,正则参数τhis;②利用FCM算法得到源域的模糊系统前件参数,进而得到对应于回归模型的数据集

③利用式(24)优化得到源域的模糊系统后件参数phis;

2)迁移学习阶段:①设置模糊规则数K=Khis,正则参数τ及平衡参数λ,pg0=phis;②继承源域模糊系统模型的前件参数,并利用源域系统的前件参数和式(16)-式(17)得到对应于目标域系统的回归数据集:

③利用式(26)优化得到目标域后件参数pg;④根据学习得到的后件参数和继承的前件参数生成迁移学习TSK模糊系统。

4 结语

着重介绍了两种具有代表性的模糊迁移学习方法,即迁移FCM算法和迁移TSK模糊系统,分别引入模糊迁移识别领域和模糊迁移智能建模领域。但就目前的研究而言,无论是模糊迁移识别领域还是模糊迁移智能建模领域均存在着各种技术问题丞待进一步解决:

1)针对迁移模糊聚类方法,其迁移性能的优越往往偏重于迁移学习参数(如式(6)中的λ以及η)的取值,而由于聚类为无监督学习方法,其参数无法像有监督学习方法一样通过交叉验证获取,因此如何获取合理的迁移学习参数依旧是值得深入研究的问题。

2)针对迁移模糊系统建模方法,特别是迁移TSK模糊系统建模方法。目前文中仅对模糊系统的后件参数(如式(24)中的pg)进行了迁移,如何对前件参数进行迁移?采用何种方式进行迁移是一件具备挑战的工作。此外,如何在其他类型的模糊系统上进行知识迁移,同样也需要进一步展开相关的研究工作。

3)无论是迁移模糊聚类方法,还是迁移模糊系统建模方法。目前均只采用了参数迁移这一种特殊的迁移学习策略。如何在上述两大领域内开展其他诸如实例迁移,特征迁移及关联知识迁移将是今后研究了重点,亦是一项有意义的工作。

[1]WANG J,Malakooti B.Characterization of training errors in supervised learning using gradient-based rules[J].Neural Networks,1993,6(8):1073-1087.

[2]Clapper J P,Bower G H.Learning and applying category knowledge in unsupervised domains[J].Psychology of Learning and Motivation,1991,27:65-108.

[3]周志华,王珏.机器学习及其应用[M].北京:清华大学出版社,2007.

[4]ZHONG S.Semi-supervised model-based document clustering:a comparative study[J].Machine Learning,2006,65(1):3-29.

[5]Hall L O,Goldgof D B.Convergence of the single-pass and online fuzzy C-means algorithms[J].IEEE Transactions on Fuzzy Systems,2011,19(4):792-794.

[6]Bezdek J C.Pattern Recognition with Fuzzy Objective Function Algorithms[M].New York:Plenum Press,1981.

[7]ZHU L,Chung F L,WANG S T.Generalized fuzzy C-means clustering algorithm with improved fuzzy partitions[J].IEEE Transactions on Systems Man and Cybernetics:Part-B,2009,39(3):578-591.

[8]Mjolsness E,DeCoste D.Machine learning for science:state of the art and future[J].Science,2001,293:2051-2055.

[9]Kuncheva L I,Rodrlguez J J.Classifier ensembles with a random linear oracle[J].IEEE Transaction on Knowledge and Data Engineering,2007,19(4):500-508.

[10]Baralis E,Chiusano S,Garza P.A lazy approach to associative classification[J].IEEE Transaction on Knowledge and Data Engineering,2008,20(2):156-171.

[11]DENG Z H,JIANG Y Z,Chung F L,et al.Knowledge-leverage based fuzzy system and its modeling[J].IEEE Trans Fuzzy Systems,2013,21(4):597-609.

[12]DENG Z H,JIANG Y Z,Choi K S,et al.Knowledge-leverage-based TSK fuzzy system modeling[J].IEEE Trans Neural Networks and Learning Systems,2013,24(8):1200-1212.

[13]Thrun S.Is learning the n-th thing any easier than learning the first?[C]//Advances in Neural Information Processing System.Denver:MIT,1996:640-646.

[14]Ben-David B,Schuller R.Exploiting task relatedness for multiple task learning[C]//Proceedings of the 16th Annual Conference on Learning Theory.Washington:Springer,2003:825-830.

[15]Ando R K,Zhang T.A framework for learning predictive structures from multiple tasks and unlabeled data[J].Journal of Machine Learning Research,2005,6:1817.

[16]Cavallanti G,Cesa-Bianchi N,Gentile C.Linear algorithms for online multitask classification[J].Journal of Machine Learing Research,2010,11:2901 -2934.

[17]PAN S,YANG Q.A survey on transfer learning[J].IEEE Transactions on Knowledge and Data Engineering,2009,22(10):1345-1359.

[18]Raina R,Battle A,Lee H,et al.Self-taught learning:transfer learning from unlabeled data[C]//Proceedings of 24th International Conference on Machine Learning.New York:ACM,2007:759-766.

[19]XUE G R,DAI W Y,YANG Q,et al.Topic-bridged PLSA for cross-domain text classification[C]//Proceedings of 31th International ACM SIGIR Conference on Research and Development in Information Retrieval.New York:ACM,2008:627-634.

[20]PAN S,Tsang I W,T Kwok J,et al.Domain adaptation via transfer component analysis[C]//Proceedings of 21th International jont Conference on Machine Learning.San Francisco,CA:ACM,2009:1187-1192.

[21]Glorot X,Bordes A,Bengio Y.Domain adaptation for large-scale sentiment classification:a deep learning approach[C]//Proceedings of 28th International Conference on Machine Learning.Bellevue,Washington:ACM,2011:513-520.

[22]DUAN L X,Tsang I W,XU D.Domain transfer multiple kernel learning[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2012,34(3):465-479.

[23]WANG S T,Chung F L,SHEN H B,et al.Note on the relationship between probabilistic and fuzzy clustering[J].Soft Computing,2004,8(5):366-369.

[24]WANG S T,Chung F L,DENT Z H,et al.Robust fuzzy clustering neural network based on epsilon-insensitive loss function[J].Applied Soft Computing,2007,7(2):577-584.

[25]DENT Z H,Choi K S,Chung F L,et al.Enhanced soft subspace clustering integrating within-cluster and between-cluster information[J].Pattern Recognition,2010,43(3):767-781.

[26]DENT Z H,Choi K S,Chung F L,et al.Scalable TSK fuzzy modeling for very large datasets using minimal-enclosing-ball approximation[J].IEEE Trans Fuzzy Systems,2011,19(2):210-226.

[27]DENG Z H,Choi K S,CAO L B,et al.T2FELA:type-2 fuzzy extreme learning algorithm for fast training of interval type-2 TSK fuzzy logic system[J].IEEE Trans Neural Netw Learning Syst,2014,25(4):664-676.

[28]JIANG Y Z,Chung F L,Ishibuchi H,et al.Multitask TSK fuzzy system modeling by mining intertask common hidden structure[J].IEEE Trans Cybernetics,2015,45(3):548-561.

[29]JIANG Y Z,DENG Z H,Chung F L,et al.Multi-task TSK fuzzy system modeling using inter-task correlation information[J].Information Science,2015,298:512-533.

[30]DENG Z H,JIANG Y Z,Chung F L,et al.Knowledge-leverage-based fuzzy system and its modeling[J].IEEE Trans Fuzzy Systems,2013,21(4):597-609.

[31]DENG Z H,JIANG Y Z,Choi K S,et al.Knowledge-leverage-based TSK fuzzy system modeling[J].IEEE Trans Neural Netw Learning Syst,2013,24(8):1200-1212.

[32]DENG Z H,JIANG Y Z,Cao L B,et al.Knowledge-leverage based TSK fuzzy system with improved knowledge transfer[C]//FUZZ-IEEE.Beijing:IEEE,2014:178-185.

[33]DENG Z H,Choi K S,JIANG Y Z,et al.Generalized hidden-mapping ridge pegression,knowledge-leveraged inductive transfer learning for neural networks,fuzzy systems and kernel methods[J].IEEE Trans Cybernetics,2014,44(12):2585-2599.

[34]蒋亦樟,邓赵红,王骏,等.基于知识利用的迁移学习一般化增强模糊划分聚类算法[J].模式识别与人工智能,2013,26(10):975-984.JIANG Yizhang,DENG Zhaohong,WANG Jun,et al.Transfer generalized fuzzy c-means clustering algorithm with improved fuzzy partition by leveraging knowledge[J].PR and AI,2013,26(10):975-984.(in Chinese)

[35]蒋亦樟,邓赵红,王士同.0阶L2型 TSK迁移学习模糊系统[J].电子学报,2013,41(5):897-904.JIANG Yizhang,DENG Zhaohong,WANG Shitong.0-order-L2-norm-Takagi-Sugeno-Kang type transfer learning fuzzy system[J].Acta Electronica Sinica,2013,41(5):897-904.(in Chinese)

[36]QIAN P J,JIANG Y Z,DENG Z H,et al.Cluster prototypes and fuzzy memberships jointly leveraged cross-domain maximum entropy clustering[J].IEEE Transactions on Cybernetics,2015(99):1.

[37]Thrun S,Pratt L.Learning to Learn[M].New York:Springer,1998.

[38]Caruana R.Multitask learning[J].Machine Learning,1997,28(1):41-75.

[39]ZHENG W,SONG Y Q,ZHANG C S.Transferred dimensionality reduction[C]//Machine Learning and Knowledge Discovery in Databases.Antwerp:Springer,2008:550-565.

[40]DAI W Y.Boosting for transfer learning[C]//Proceedings of the 24th International Conference on Machine Learning.Corvallis:ACM,2007:193-200.

[41]LIAO X J,XUE Y,Carin L.Logistic regression with an auxiliary data source[C]//Proceedings of the 22nd International Conference on Machine Learning.Bonn:ACM,2005:505-512.

[42]Raina R,Battel A,Lee H,et al.Self-taught learning:transfer learning from unlabeled data[C]//Proceedings of the 24th International Conference on Machine Learning.Corvallis:ACM,2007:759-766.

[43]DAI W Y,XUE G R,YANG Q,et al.Co-clustering based classification for out-of-domain documents[C]//Proceedings of the 13th ACM SIGKDD International Conference on Knowledge Discovery and Data Mining.New York:ACM,2007:210-219.

[44]Argyriou A,Pontil M,YING Y,et al.A spectral regularization framework for multi-task structure learning[C]//Advances in Neural Information Processing Systems.Whistler:MIT,2007:25-32.

[45]Mihalkova L,Mooney R J.Transfer learning by mapping with minimal target data[C]//Proceedings of the AAAI-08 Workshop on Transfer Learning for Complex Tasks.Chicago:AAAI,2008:31-36.

[46]Davis J,Domingos P.Deep transfer via second-order markov logic[C]//Proceedings of the 26th Annual International Conference on Machine Learning.Montreal:ACM,2009:217-224.

[47]Lawrence N D,Platt J C.Learning to learn with the informative vector machine[C]//Proceedings of the Twenty-First International Conference on Machine Learning.New York:ACM,2004:65.

[48]Schwaighofer A,Tresp V,YU K.Learning gaussian process kernels via hierarchical bayes[C]//Advances in Neural Information Processing Systems.Vancouver:MIT,2004:1209-1216.

[49]Evgeniou T,Pontil M.Regularized multi-task learning[C]//Proceedings of the Tenth ACM SIGKDD International Conference on Knowledge Discovery and Data Mining.Seattle:ACM,2004:109-117.

[50]DAI W Y,YANG Q,XUE G R,et al.Self-taught clustering[C]//Proceedings of 25th International Conference on Machine Learning.New York:ACM,2008:200-207.

[51]LI K,GUO Z.Image segmentation with fuzzy clustering based on generalized entropy[J].J Comput,2014,9(7):1678-1683.

[52]LI L,JI H,GAO X.Maximum entropy fuzzy clustering with application to real-time target tracking[J].Signal Process,2006,86(11):3432-3447.

[53]AstrAom K J,McAvoy T J.Intelligent control[J].Journal of Process Control,1993,2(3):115-127.

[54]蒋亦樟,邓赵红,王士同.ML型迁移学习模糊系统[J].自动化学报,2012,38(9):1393-1409.JIANG Yizhang,DENG Zhaohong,WANG Shitong,Mamdani-larsen type transfer learning fuzzy system[J].Acta Automation Sinica,2012,38(9):1393-1409.(in Chinese)

[55]Azeem M F,Hanmandlu M,Ahmad N.Generalization of adaptive neuro-fuzzy inference systems[J].IEEE Transactions on Neural Networks,2000,11(6):1332-1346.

[56]Ito K,Nakano R.Optimizing support vector regression hyper parameters based on cross-validation[C]//Proceedings of the International Joint Conference on Neural Networks.Japan:IEEE,2003:2077-2082.