动态场景下的基于SIFT和CBWH的目标跟踪

2015-12-02

(杭州电子科技大学通信工程学院,浙江 杭州310018)

0 引 言

运动目标跟踪是计算机视觉的重要研究方向,其中对先验未知的物体进行跟踪越来越引起人们的关注。在视频中对先验未知的物体进行跟踪,通常称为无模型(model-free)跟踪[1-2]。这种跟踪方式得到的唯一信息就是图像序列第一帧的初始区域,跟踪器给出感兴趣目标在随后帧的位置。在对目标进行跟踪的时候,特征的选择至关重要。文献[3]提出了haar-like 特征以及积分图之后,很多学者利用haar-like 特征进行跟踪[1,4]。多示例学习(Multiple Instance Learning,MIL)以包的形式得到训练样本,利用正负样本包训练得到分类器[1]。加权多示例学习(Weighted MIL,WMIL)在正样本包中引入了权值[5],压缩跟踪(Compressive Tracking,CT)则是利用最简单的朴素贝叶斯分类器对降维后的特征进行分类[4]。对于视频中目标可能被遮挡或消失而导致跟踪失败的情况,这些算法会累积误差。本文提出了一种基于SIFT[6]特征和修正的背景加权直方图(Corrected Background-Weighted Histogram,CBWH)[7]的卡尔曼跟踪算法。实验表明,本文算法在动态背景下能够准确跟踪目标,对目标遮挡、变形、面外旋转及角度变化鲁棒性较好。

1 基于SIFT 特征点和CBWH的目标跟踪

1.1 卡尔曼滤波器

卡尔曼滤波器用于跟踪主要分成预测和修正2个阶段。利用预测阶段得到物体下一帧的大概位置,缩小目标的搜索范围,从而减小运算量,再利用修正阶段确定最终位置。卡尔曼滤波器包含信号模型(s[n]=As[n-1]+u[n],n >1)和观测模型(X[n]=Hs[n-1]+w[n])2个模型。其中状态向量s[n]=[x[n]y[n]vx[n]vy[n]]T中的x[n]、y[n]分别为目标中心在水平、垂直方向上的位置分量,vx[n]、vy[n]分别为目标在水平、垂直方向上的速度。观测向量X[n]=[xc[n]yc[n]]T,其中xc[n]和yc[n]分别是目标中心在水平、垂直方向上的观测值。A为已知的4×4 维的状态转移矩阵,H为2×4维的观测矩阵。驱动噪声u[n]服从高斯分布Ν(0,Q),观测噪声w[n]服从高斯分布Ν(0,R)。

1.2 目标模型

目标在跟踪时用特征来描述目标,本文利用SIFT 特征点和CBWH。

本文跟踪算法基于动态场景,因此不采用静态场景的减背景法来确定目标的位置。为了对目标进行精确定位,采用SIFT点匹配方法。SIFT是一种检测局部特征的算法,具有尺度不变性,改变旋转角度、图像亮度或拍摄视角都能得到很好的检测效果。

物体快速运动或摄像头曝光时间过长,导致视频中的运动物体模糊,不利于获取目标的SIFT 特征,但颜色直方图特征并不会受到运动模糊的影响。为了减小背景颜色特征对目标定位造成的影响,利用CBWH 进行跟踪。

1.3 估计目标最优位置并确定尺度

得到当前帧目标的状态之后对正模型2 进行更新。首先,将当前帧目标区域向周围扩大srh_step个像素,计算扩大区域上的SIFT 特征点。将目标框外面的特征点均判为是背景点。考虑到遮挡情况,需要判定目标框内的特征点为目标点或遮挡物上的点,先与前帧目标点匹配,匹配成功的点判为目标特征点,对未能匹配的点进行SVM 分类。随着目标的运动,目标特征点和背景特征点会发生变化,为了减少SVM 分类器的分类误差,要对SVM 分类器进行更新。由于相邻帧的特征差异不大,因此不需要每帧都更新,每svmUp帧训练一次。

采用SPSS 21.0统计学软件对数据进行处理,计数资料以百分数(%)表示,采用x2检验,以P<0.05为差异有统计学意义。

将相似度归一化的值作为权值,位置加权得到的结果X[n]=[xc[n]yc[n]]T作为卡尔曼滤波器的观测值送入修正过程。修正步骤得到的结果即为当前帧目标的中心位置。

3.3 年龄增高增加经产妇中各类高危妊娠的发生率 已有的国内外研究均发现,高龄初产妇发生前置胎盘、妊娠高血压疾病、慢性高血压合并妊娠、妊娠期糖尿病比例显著高于非高龄组 [3-6]。

给定图像序列Ⅰt(t=1,…,T)以及在第一帧中的初始化区域b1,采用检测与跟踪相结合的方式,计算感兴趣目标所在区域bt(t=2,…,T)。利用SIFT 匹配的方式检测,利用CBWH 跟踪。检测时SIFT 匹配进行2次,第一次是将当前帧搜索区的SIFT点与第一帧目标的SIFT 特征点进行匹配,第二次是与前一帧判定为目标的特征点进行匹配,得到当前帧的每个匹配点的坐标及其对目标中心点的位移。为描述方便,称第一帧目标的SIFT 特征点为正模型1,前一帧目标的SIFT 特征点集为正模型2。与前一帧匹配时,将当前帧SIFT 特征与正模型2 匹配,对匹配成功的点进行投票,得到目标的中心位置p2。对正模型1 进行同样的处理,得到p1。

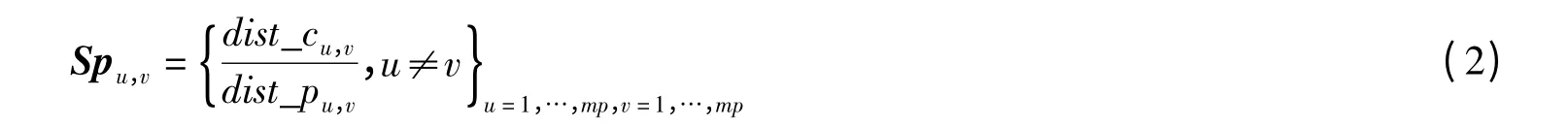

对Sp 中所有的值进行排序,中值作为目标相对前一帧的尺度变化。同样根据第一帧与当前帧的特征点匹配情况,得到Sc的中值作为目标相对第一帧的尺度变化。利用尺度变化来得到当前帧目标的长宽。

由前一帧与当前帧的特征点匹配情况,分别计算前一帧和当前帧各自特征点之间的欧式距离,由相应点对的欧式距离之比得到尺度变化。前一帧特征点位置为loc_pi,当前帧匹配点位置为loc_ci(i=1,…,mp),dist_pu,v和dist_cu,v,u≠v,(u=1,…,mp,v=1,…,mp)分别前一帧与当前帧所有点对间的欧式距离,则所有可能的尺度变化为:

使用LIBSVM[9]进行SVM 分类器的训练和分类。SVM类型为C-SVC,核函数为RBF 函数,损失函数-c为1.2,gamma-g为2.8。此外SIFT 匹配中最近邻次近邻之比为0.75,srh_step=30,svmUp=10,th1 =10,n0=10,实验中算法的实际处理效率为0.31 0.46 s/帧,不如TLD、CT、WMIL。若对整张图提取SIFT 特征,如240×320 像素的图就需要0.38 s,因此本文利用卡尔曼滤波器估计出目标在当前帧的可能位置,缩小搜索范围,减少提取SIFT 特征的时间。卡尔曼滤波器的预测位置有助于CBWH 快速确定位置,平均只需0.02 s。此外仅对未能成功匹配的点进行SVM 分类,且SVM 分类器是每隔svmUp帧更新一次,因此不会对实时性造成影响。

SIFT 具有很好的稳健性和辨别性,但计算较费时,为减小计算量,在预测区域的扩大区域即搜索区上提取SIFT 特征点,分别与第一帧和前一帧目标SIFT 特征点进行匹配。首先考虑当前帧和前一帧进行SIFT 特征匹配的情况。视频中连续两帧目标的外形变化不大,考虑无尺度变化和面内旋转的情况,当前帧匹配成功的SIFT 特征点rm(m=1,…,M)得到各自的投票h(m)=rm-am,其中rm为特征点在当前帧的坐标位置,am为模型中对应特征点对目标中心点的距离向量。假设目标中心不会离开可视范围,保证无投票结果为负的情况。计算目标中心位置前先去除离群点。计算M个点与其余点的距离,取num(num≤M)个距离小于th1的点。对应的对这num个点加权平均,权值与am长度的指数成反比,即加权平均得到的位置p2 就是这次匹配得到的候选目标中心位置。同样根据当前帧与第一帧SIFT 匹配的情况,得到位置p1。

以卡尔曼预测位置为起始位置,CBWH 作为特征,进行均值漂移,得到估计中心位置p3。对得到的3个中心位置p1,p2,p3 进行融合,作为当前帧目标的观测位置。分别取出以p1,p2,p3为中心点所在的区域patch1,patch2,patch3,分别与第一帧中的初始化目标块patch 求相似性,patchi和patch 之间的相似性计算为:

2 实验结果

为了验证本算法的效果,在不同场景对不同物体进行跟踪,与TLD、CT、WMIL 方法进行比较,参数均为作者给出代码的默认值。由于篇幅所限,本文只列出一组实验对比图。

根据文献[8]提供的视频,在Matlab 上进行仿真。根据实验效果调整参数,参数设置A =

在幻方中,如果我们称一行中的所有数的积为行积,一列中所有数的积为列积.则(5)式可概括为:3阶幻方中,第一行的行积、第三行的行积、第一列的列积以及第三列的列积之和等于第二行的行积与第二列的列积之和的两倍.

暴雨工况下,沿基岩层面不会产生滑动,基覆分界面亦不会整体滑动,满足边坡稳定性的规范要求,暴雨工况下覆盖层内部圆弧滑动所得安全系数更小,使边坡局部破坏进一步加剧。且边坡上个变形开裂部位控制工况均为暴雨工况,这与汛期边坡变形加剧情况相吻合。

因为针对动态背景获得的视频,前n0帧基本都不会存在有遮挡或严重的形变,将SIFT与正模型2匹配的结果作为目标的观测位置。保存目标SIFT 特征点的特征和背景SIFT 特征点的特征,分别作为SVM 分类器的正负样本。

对行人进行跟踪,如图1所示。该图像序列有252帧,存在的干扰因素有:遮挡、变形、面外旋转、背景杂波。图1(a)为TLD算法跟踪结果,图1(b)为CT算法跟踪结果,图1(c)为WMIL算法跟踪结果,图1(d)为本文算法跟踪结果。每一行的图从左到右分别代表图像序列中的第90帧、第127帧、第152帧、第233帧。第90帧目标离开遮挡时,TLD算法和WMIL算法跟踪错误,CT算法跟踪区域与实际目标区域存在偏差,本文算法跟踪目标正确。第127帧目标发生面外旋转,TLD算法、CT算法、WMIL算法跟踪目标错误,本文算法跟踪区域与实际目标区域存在偏差。第152帧视频视角变化,本文算法准确跟踪目标,另3种算法跟踪目标错误。第233帧视频视角发生变化,TLD算法和CT算法跟踪目标失败,WMIL算法和本文算法跟踪目标成功。

本文依据具体问题具体分析的原理,遵循问题产生发展的特定环境进行思考分析,结合高中《文化生活》课堂中出现的问题,紧密联系高中政治课教学,深入挖掘分析现有教学环境和条件下所出现的问题及其背后的原因,紧紧抓住教师和学校的作用,提出相应具体可行的措施,以期更好地落实政治学科核心素养并完善教学方法,从而能够在日后对高中阶段《文化生活》的教学产生积极影响。

图1 各类算法跟踪效果比较

3 结束语

本文针对动态场景下的目标跟踪,提出了基于SIFT 特征点和CBWH的卡尔曼跟踪目标方法。先利用卡尔曼滤波器进行预测得到目标可能出现的区域,再在该区域内提取出SIFT 特征点,分别将当前帧的特征点与第一帧和前一帧SIFT 特征点进行匹配投票得到候选中心位置,利用CBWH 特征得到候选中心位置,最后将所得位置加权值对卡尔曼滤波器预测值进行修正,得到当前帧目标的位置。实验表明在目标存在遮挡、视角变化和目标角度变化的情况下,本文算法跟踪准确度和精度都较高。

[1]Babenko B,Yang M,Belongie S.Robust object tracking with online multiple instance learning[J].Pattern Analysis and Machine Intelligence,IEEE Transactions on,2011,33(8):1619-1632.

[2]Nebehay G,Pflugfelder R.Consensus-based Matching and Tracking of Keypoints for Object Tracking[C]//Applications of Computer Vision (WACV),2014 IEEE Winter Conference on.Steamboat Springs,CO:IEEE,2014:862-869.

[3]Viola P,Jones M.Rapid object detection using a boosted cascade of simple features[C]//Computer Vision and Pattern Recognition,2001.CVPR 2001.Proceedings of the 2001 IEEE Computer Society Conference on.IEEE,2001:511-518.

[4]Zhang K,Zhang L,Yang M.Real-time compressive tracking[M]//Computer Vision-ECCV 2012.Berlin:Springer Berlin Heidelberg,2012:864-877.

[5]Zhang K,Song H.Real-time visual tracking via online weighted multiple instance learning[J].Pattern Recognition,2013,46(1):397-411.

[6]Lowe D G.Distinctive image features from scale-invariant keypoints[J].International journal of computer vision,2004,60(2):91-110.

[7]Ning J,Zhang L,Zhang D,et al.Robust mean-shift tracking with corrected background-weighted histogram[J].Computer Vision,IET,2012,6(1):62-69.

[8]Wu Y,Lim J,Yang M.Online object tracking:A benchmark[C]//Computer vision and pattern recognition(CVPR),2013 IEEE Conference on.Portland,OR:IEEE,2013:2411-2418.

[9]Chang C C,Lin C J.LIBSVM:a library for support vector machines[J].ACM Transactions on Intelligent Systems and Technology (TIST),2011,2(3):27.