基于多特征索引和局部约束的服饰检索方法

2015-11-30臧雪柏

王 丹,臧雪柏

(1.北华大学信息技术与传媒学院,吉林吉林132011;2.吉林大学计算机科学与技术学院,长春130012)

基于多特征索引和局部约束的服饰检索方法

王 丹1,2,臧雪柏2

(1.北华大学信息技术与传媒学院,吉林吉林132011;2.吉林大学计算机科学与技术学院,长春130012)

为弥补传统BoW(Bag ofWords)模型缺失的颜色信息和空间信息,提出了基于多特征索引和局部约束的服饰检索方法。基于BoW模型分别建立关于颜色特征和SIFT特征的两种倒排文件索引结构,检索相似服饰图像,并提出了局部约束的后验证方法。实验结果表明,该方法在不同环境采集的服饰数据库的测试中,得到了理想的检索性能。

服饰检索;BoW模型;多特征索引;后验证;局部约束

0 引 言

随着电子商务的发展,网上购买服装的模式倍受消费者的青睐[1]。基于内容的服饰检索方法将大大提高消费者的购买效率,因此迫切需要高性能的服饰检索技术。当查询一幅心仪的服饰时,基于内容的图像检索系统将呈现给用户一组与查询图像相似的服饰图像。由于网上所有的服饰图像都源自现实生活,在图像检索系统中,不同环境采集的服饰图像将给高性能的检索系统带来巨大的挑战。

然而,在检索服饰图像时,常用的图像特征[2,3]并不具备适当的辨别能力。观察可知,多样化背景下的服饰图像,其局部区域的变化不大。因此,笔者将局部视觉特征作为描述服饰图像的主要特征。此外,SIFT特征[4]可以很好地表示服饰图像的局部视觉特征,它对图像旋转、尺度缩放、亮度变化保持不变性。Sivic等[5]提出BoW(Bag ofWords)模型实现图像检索系统,该模型将数据库所有图像的局部视觉特征(SIFT特征)量化为视觉单词,然后建立直方图进行比较。然而,在服饰检索应用中,服饰的颜色信息至关重要。而BoW模型只依赖于SIFT特征生成视觉单词,该模型通常忽略了图像的其他信息(比如颜色信息)。特征量化时,重要信息的缺失会产生错误的匹配结果并影响检索的精确度。Zheng等[6]根据BoW模型在特征量化时颜色信息丢失的缺陷,提出了c-MI(Coupled Multi-Index)框架,将SIFT特征和颜色特征组合为一个多维度的特征,提高了特征的辨别能力。同时,由于量化后的视觉单词缺少了特征间的空间关系,降低了局部特征的辨别能力,仍会产生错误的匹配结果并影响检索性能。因此,目前很多研究在得到匹配特征后,通过几何约束的方式在后序验证步骤中过滤错误的匹配特征对[7-11]。

综上,基于BoW模型的服饰检索系统存在两大缺陷:1)依赖于SIFT特征的量化过程忽略了图像的颜色信息;2)量化后的视觉单词缺少了特征间的空间关系,降低了局部特征的辨别能力。根据以上两种缺陷,笔者基于多特征索引和后序验证两种方案提出了一种新的服饰检索方法。首先,根据颜色信息在服饰图像中的重要性,使用近似c-MI框架的方法[6],引入颜色特征提高视觉特征的辨别能力,并分别建立关于颜色特征和SIFT特征的两种倒排文件检索相似服饰图像。进而,根据普遍服饰图像局部区域的变化不大以及几何形变均为尺度缩放与旋转变化等特点,提出了基于局部约束的后验证方法。通过局部邻域内匹配特征对的数量,定义局部邻域约束值,进而判断是否满足局部邻域的约束条件。若满足约束条件,最后计算局部邻域内的所有共同匹配特征是否满足一致的几何变换,并以此建立后验证准测,验证错误的匹配特征。

1 多特征索引方法

Zheng等[6]提出了c-MI框架,将SIFT特征和颜色特征组合为一个多维度的视觉特征,提高了检索结果的辨别能力。受此启发,笔者使用了与文献[5]相同的颜色特征描述符CN(Color Names)。图像中每个像素点的CN描述符都是一个11维的特征向量,表示11种颜色(黑色,白色,蓝色,棕色,灰色,绿色,橙色,粉色,紫色,红色和黄色)在该像素点出现的概率。计算检测点的CN描述符时,首先以检测点的尺度大小确定该点的局部邻域,再计算该邻域所有像素点CN描述符的平均值,并作为该检测点的CN描述符。

特征量化阶段,采用分层k-means聚类方法[12-15]分别训练SIFT特征和CN特征。最后使用SIFT特征和CN特征分别构成两种倒排文件检索服饰图像。

2 基于局部约束的后验证方法

2.1 局部邻域约束

根据普遍服饰图像局部区域的变化不大以及几何形变均为尺度缩放与旋转变化等特点,提出了基于局部约束的后验证方法。通过定义匹配特征的局部邻域范围,过滤不相关的匹配特征对,提高后验证阶段的计算效率。

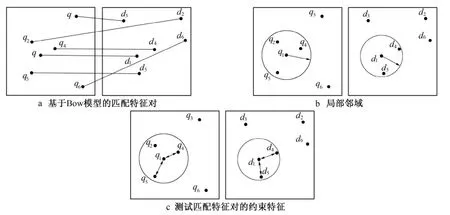

局部邻域约束的处理流程如图1所示,其中图1a表示基于BoW模型得到初始的匹配特征对,选择一个匹配特征对作为测试匹配特征对,并根据其尺度参数得到局部邻域,图1b中单向箭头表示特征点尺度参数。图1c指出根据局部邻域内共同匹配特征的数量约束测试匹配特征对,红色双箭头所指的红色圆点表示测试匹配特征对局部邻域内的匹配特征。

首先,得到查询图像与候选图像的匹配特征集M(Q,D)。选择其中的一个匹配特征对作为测试匹配特征对(qi,di),并验证其是否正确。计算测试匹配特征的局部邻域,邻域范围计算如下

其中Sscli与Sscl'i分别表示测试匹配特征对(qi,di)的尺度参数。σ控制局部邻域范围,笔者定义为120。

其次,精选局部邻域中的共同匹配特征,并对测试匹配特征进行约束。共同匹配特征定义如下

其中dist(,)表示两特征描述符的欧氏距离。最后该邻域内共同匹配特征对的数量便是局部邻域约束值。

图1 局部邻域约束方法流程图Fig.1 The flowchart of local constraintmethod

CComMatch(qi,di)是查询图像与候选图像共同匹配特征对的数量。若约束值大于阈值δ1,进而计算其局部邻域内共同匹配特征对是否满足一致的几何关系;否则,判断为错误匹配特征对。笔者根据局部约束值与匹配特征数量的比例定义阈值,表示查询图像与候选图像匹配特征对的数量。

2.2 空间验证

根据测试匹配特征对局部邻域内共同匹配特征的空间编码是否一致,验证测试匹配特征是否正确。

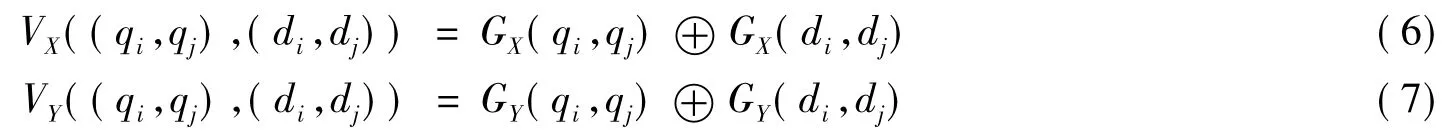

首先,定义了GX和GY两种类型的编码,分别描述测试匹配特征对与其邻域内共同匹配特征对在横向与纵向的位置关系,编码定义如下

其中(xi,yi)和(xj,yj)分别表示查询图像中,测试中心匹配特征与其邻域内共同匹配特征在原图像中的位置信息。按照相同的方法,计算候选图像中的编码信息GX(di,dj)和GY(di,dj)。

根据得到的编码信息进行验证,如下

其中⊕表示异或计算,如果所有匹配特征都正确匹配,则这些匹配特征的编码信息一致,同时VX和VY的值都为0。

基于邻域内共同匹配特征编码信息一致的数量,计算测试匹配特征的几何得分,如下

通过检查测试匹配特征的几何得分验证其是否正确,定义如下

根据所有匹配特征的几何得分与局部邻域内共同匹配特征数量的比例,定义阈值δ2=CComMatch(qi,di),如果所有匹配特征都正确匹配,C值为0。最后,根据图像间正确匹配特征保留的个数对候选图像重新排列。

3 实验设计与分析

笔者通过检索精确度与计算时间验证笔者算法的检索性能,并与多种检索方法作比较。实验中,在多种环境下拍摄了10组服饰类图像集,如图2左侧表示,其中每组有50幅图像。同时在网上下载9 500幅服饰类图像(fuzhuang.taobao.com),数据库的图像总数为10 000幅。后验证阶段计算初始检索结果前1 000幅图像的几何得分并重排序。在CPU为Core i5,3.30 GHz、8 GRAM、64位的WIN7操作系统、Matlab R2012a中进行测试。

图2 不同方法在10组服饰集合中的mAP性能Fig.2 ThemAP performance of the differentmethods from the 10 clothing collections

3.1 实验准备

笔者在传统的BoW模型基础上,提取SIFT特征和CN特征;同时记录特征点的位置信息和尺度,作为后序验证的计算条件。提取特征前,将尺寸过大的图像按比例缩小至小于500×500像素。分别采用分层k-means方法[9]量化SIFT特征,生成1 M个视觉单词;量化CN特征,生成1 000个视觉单词。同时建立两种倒排文件结构,索引图像。如图3所示,两种视觉词都与多个索引特征相连,其中每个索引特征包含图像的ID,特征位置,尺度参数。

利用两种倒排文件结构索引图像时,首先分别量化查询图像特征点的SIFT描述符和CN描述符,得到两种视觉单词;若基于上述倒排文件结构可查找到相同的索引特征,即定义为匹配特征。最后,根据查询图像与数据库图像匹配特征的数量定义图像间的相似性。

图3 两种倒排文件结构Fig.3 Two kinds of inverted file structure

3.2 与其他检索方法的性能对比

笔者从10组服饰类的图像集共选出100幅作为查询图像,其中每组随机选取10幅。并以平均正确率均值(mAP:mean Average Precision)[16]作为检索精确度的度量方式,mAP反映系统在全部相关图像上性能的单值指标。系统检索出来的相关图像越靠前(rank越高),mAP就可能越高。如果系统没有返回相关图像,则平均正确率均值默认为0。对比其他检索方法:1)基于SIFT特征量化的传统BoW模型(BoW);2)基于SIFT特征和CN特征量化的多特征索引方法(M-FI);3)基于SIFT特征量化的传统BoW模型,并使用局部约束的后验证方法(BoW+LC)。

其中n表示一幅查询图像在数据库中相似图像的总数量,表示第i个相似图像在检索结果中的排列序号。

通过对各种方法检索精确度的分析可以看出,传统的BoW模型忽略了特征间的几何关系,影响检索精确度。因此局部约束的后验证方法(BoW+LC)增加特征间的几何关系,提高检索性能。同时,仅依赖于SIFT特征量化的BoW模型忽略了服饰图像的其他重要信息(颜色信息),限制了检索性能。所以,基于SIFT特征和CN特征量化的多特征索引方法(M-FI)弥补了颜色信息丢失的缺点,改善检索性能。根据服饰图像颜色信息的重要性和其局部区域变化不大的两大特点,笔者提出了基于多特征索引和局部约束的服饰检索方法(Ourmethod),在增加特征颜色信息的同时,拟补了特征量化后空间关系丢失的缺点。极大程度地的提高了检索的精确度,并达到最佳的检索性能。

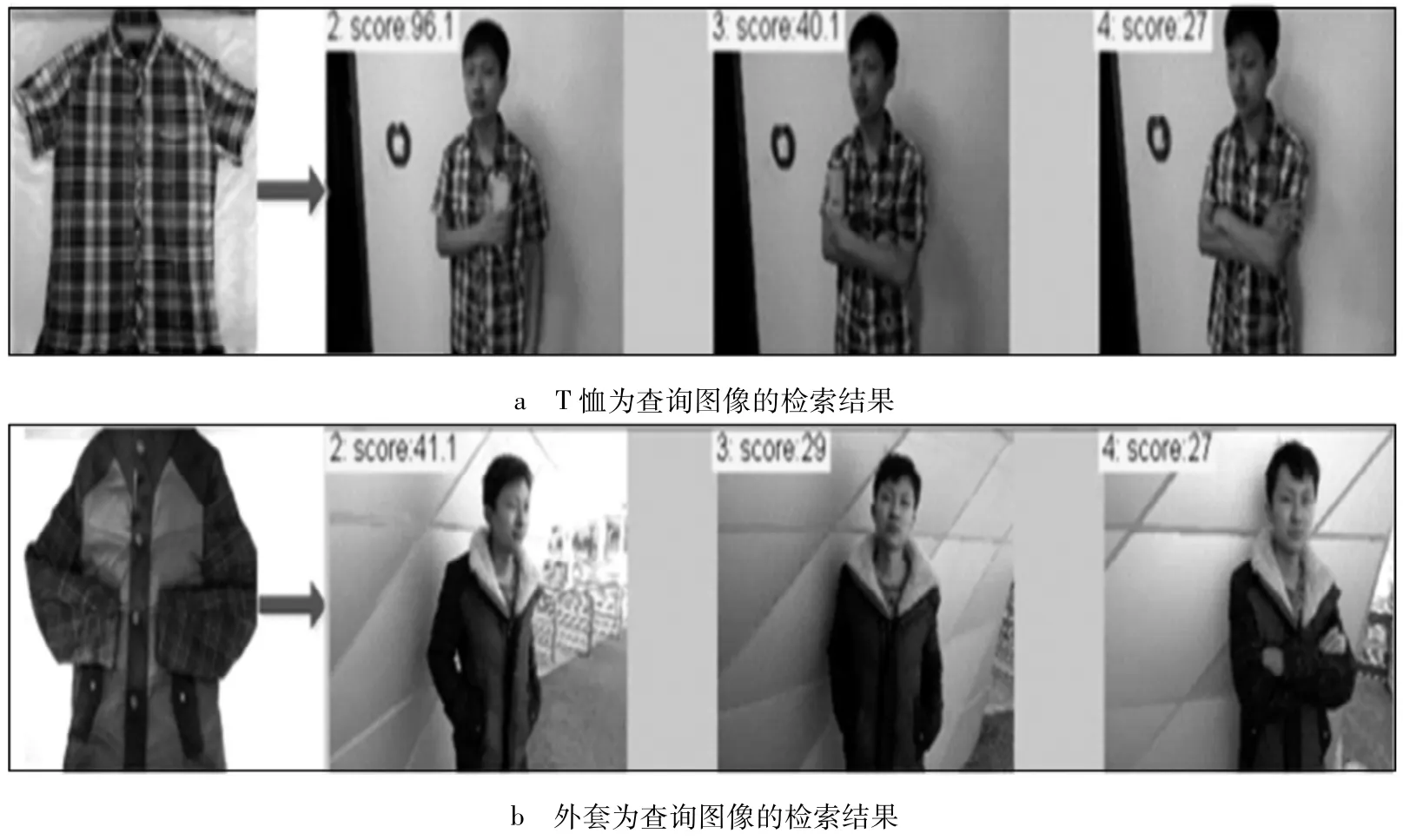

3.3 检索实例

图4显示了笔者方法的检索结果,箭头左侧为查询图像中服饰实例,右侧即检索结果。这些结果的光照、遮挡、尺度等变化证明了笔者方法在服饰图像复杂变换中的有效性。

图4 笔者方法的检索结果Fig.4 Example results of ourmethod

4 结 语

基于内容的服饰检索应用中,由于传统的BoW模型的服饰检索系统量化过程忽略了图像的颜色信息并量化后缺少了特征间的空间关系。笔者提出了基于多特征索引和局部约束的服饰检索方法,该方法首先引入颜色特征提高特征的辨别能力,并分别建立关于颜色特征和SIFT特征的两种倒排文件检索相似服饰图像。然后,提出了基于局部约束的后验证方法。通过定义匹配特征的局部邻域范围,计算局部邻域内所有匹配特征是否满足一致的几何变换。

实验中,通过与其他检索方法的比较,证明了该方法在复杂背景下可以准确检索相似的服饰图像,极大地改善了检索性能。

在未来的工作中,将利用人脸快速检测方法定位服饰区域,并通过训练服饰区域特征的高层语义信息检索相似图像,力图实现鲁棒性更好的服饰检索方法。

[1]CHEN Q,LIJ,LU G,et al.Clothing Retrieval Based on Image Bundled Features[C]∥Cloud Computing and IntelligentSystems(CCIS),2012 IEEE 2nd International Conference on.Hangzhou:IEEE,2012,2:980-984.

[2]YAMAGUCHIK,KIAPOUR M H,ORTIZ L E,et al.Parsing Clothing in Fashion Photographs[C]∥IEEE Conference on Computer Vision and Pattern Recognition.Providence,RI:[s.n.],2012:3570-3577.

[3]DATTA R,JOSHID,LI J,et al.Image Retrieval:Ideas,Influences,and Trends of the New Age[J].ACM Computing Surveys,2008,40(2):5-8.

[4]LOWE D G.Distinctive Image Features from Scale-Invariant Keypoints[J].International Journal of Computer Vision,2004,60(2):91-110.

[5]SIVIC J,ZISSERMAN A.Video Google:A Text Retrieval Approach to Object Matching in Videos[C]∥Proceedings of 9th IEEE International Conference on Computer Vision.Nice,France:[s.n.],2003:1470-1477.

[6]ZHENG L,WANG S,LIU Z,et al.Packing and Padding:Coupled Multi-Index for Accurate Image Retrieval[C]∥IEEE Conference on Computer Vision and Pattern Recognition.Colubums,OH:[s.n.],2014:1947-1954.

[7]ZHAO H,LIQ,LIU P.Hierarchical Geometry Verification via Maximum Entropy Saliency in Image Retrieval[J].Entropy,2014,16(7):3848-3865.

[8]ZHOUW,LIH,LU Y,et al.Sift Match Verification by Geometric Coding for Large-Scale Partial-Duplicate Web Image Search[J].ACM Transactions on Multimedia Computing,Communications,and Applications,2013,9(1):1-18.

[9]CHEN Yanzhi,LIXi,ANTHONY DICK,et al.Ranking Consistency for Image Matching and Object Retrieval[J].Pattern Recognition,2014,47(3):1349-1360.

[10]ZHANG Lining,WANG Lipo,LIN Weisi,et al.Geometric Optimum Experimental Design for Collaborative Image Retrieval[J].IEEE Transactions on Circuits and Systems for Video Technology,2014,24(2):346-359.

[11]赵宏伟,李清亮,刘萍萍.基于分级显著信息的空间编码方法[J].电子学报,2014,42(9):1863-1867. ZHAO Hongwei,LI Qingliang,LIU Pingping.Spatial Encoding Based on Hierarchical Salient Information[J]. Acta Electronica Sinica,2014,42(9):1863-1867.

[12]NISTER D,STEWENIUSH.Scalable Recognition with a Vocabulary Tree[C]∥IEEE Conference on Computer Vision and Pattern Recognition.New York,NY,USA:[s.n.],2006:2161-2168.

[13]王建功,林国余.基于多特征融合的多摄像机人体跟踪方法 [J].吉林大学学报:信息科学版,2014,32(6):675-683. WANG Jiangong,LIN Guoyu.Human Tracking Method Based on Multiple Features Fusion across Multiple Cameras[J]. Journal of Jilin University:Information Science Edition,2014,32(6):675-683.

[14]刘元琳,段锦,祝勇,等.基于概率密度分割的特征约束角点匹配方法[J].吉林大学学报:信息科学版,2014,32(4):435-440. LIU Yuanlin,DUAN Jin,ZHU Yong,etal.Characteristics Constrained Corner Matching Method Based on Probability Density Segmentation[J].Journal of Jilin University:Information Science Edition,2014,32(4):435-440.

[15]王亮,刘贵,段红岩.Dynamic and Combined Gestures Recognition Based on Multi-feature Fusion in a Complex Environment[J].中国邮电高校学报(英文版),2015,22(2):81-88. WANG Liang,LIU Gui,DUAN Hongyan.Dynamic and Combined Gestures Recognition Based on Multi-Feature Fusion in a Complex Environment[J].The Journal of China Universities of Posts and Telecommunications:English Edition,2015,22(2):81-88.

(责任编辑:刘东亮)

Clothing Retrieval Based on Multi-Feature Index and Local Constraint

WANG Dan1,2,ZANG Xuebai2

(1.College of Information Technology and Media,Beihua University,Jilin 132011,China; 2.College of Computer Science and Technology,Jilin University,Changchun 130012,China)

According to the two characteristics of clothing(the importance of color information and the little variation in local areas)in content-based clothing retrieval application,the paper proposed a clothing retrieval method based on multi-feature index and local constraint.We construct two inverted file index structure with color feature and SIFT feature based on Bag of Words model respectively.Experimental results based on the clothing image database with the various situations demonstrate that ourmethod could work well.

clothing retrieval;bag of words(BoW)model;multi-feature index;geometric verification; local constraint

TP393

A

1671-5896(2015)06-0728-06

2015-07-08

吉林省科技发展计划基金项目资助(20140101184JC)

王丹(1980— ),女,吉林梅河口人,北华大学讲师,吉林大学博士研究生,主要从事智能信息系统与嵌入式技术研究,(Tel)86-13304400025(E-mail)wangdanjl_jl@163.com;臧雪柏(1963— ),女,长春人,吉林大学研究员,博士,主要从事网格计算与智能系统研究,(Tel)86-13596081669(E-mail)xbzang@yahoo.com.cn。