机器人上战场,靠谱吗

2015-07-06肖婷婷

肖婷婷

美国《陆军》杂志2014年11月号刊载威廉·马修斯的一篇文章,文中描绘了这样的场景——

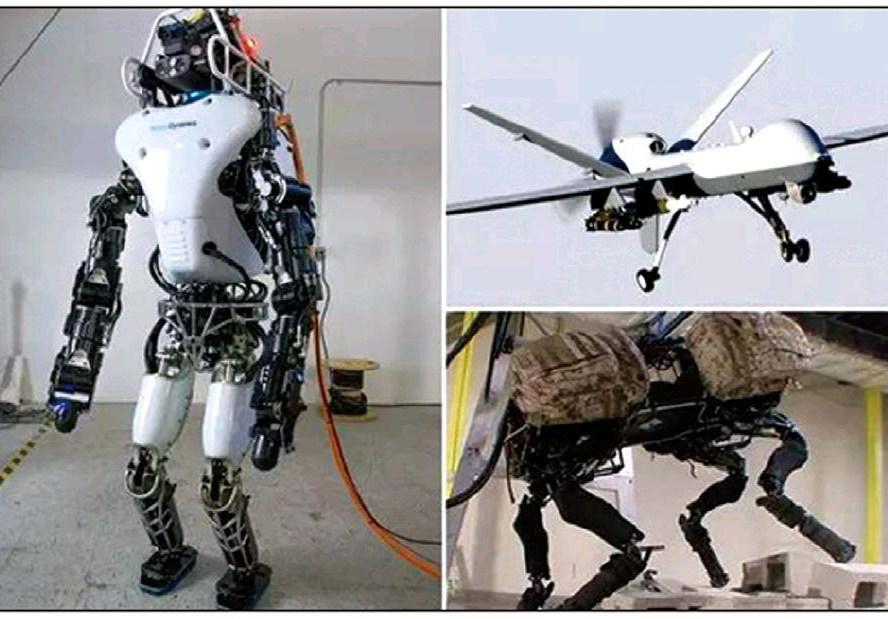

美国陆军一支20吨军用卡车车队沿着佐治亚州一条乡村公路以每小时40英里的速度高速行驶,虽然驾驶座上没有任何人,但是这些卡车还是遵守交通规则,可以转弯避开障碍物,当小孩突然蹿到街上时会紧急停下来。

两架无人驾驶飞机在一座小镇上空盘旋,在下方的街道上寻找自己的目标。当它们发现目标时,用无线电将目标的GPS坐标发送给一辆行驶着将要拦截目标的无人驾驶越野车。

一队士兵蜷缩在他们即将要攻击的建筑物不远处的防护墙后面。他们从包裹中取出通用轻型自主机器人套件,掏出一个装有监控摄像头手掌大小的四旋翼直升机和一个滚动前进,可以爬楼梯的坦克状机器人。这些微型机器人将会先行一步,向士兵们显示下个转角处是什么以及隔壁房間里有什么。士兵们将留下一个小型固定传感器来监视其进出路线。

那么,问题来了,机器人取代人类上战场,这靠谱吗?

美军开发“超人类战士”

7月24日,美国《外交学者》网站发表了弗朗茨·斯特凡·盖迪的题为《超人类和机器人杀手:美国陆军如何设想2050年战争》的报道,编译如下:根据一份总结美国陆军赞助的研讨会成果的新报告,新型超人类和自主战斗机器人将成为2050年战场上的两个主要角色。

2015年3月,在马里兰州举行的总结美国陆军赞助的研讨会,汇聚了不同群体的专家一起设想2050年战术地面战场。他们的结论是:届时,人类将属于现代战场上的少数。2050年的战场将“过度拥挤”,充斥着数量大大超过人类战士的机器人。

与会者进一步预言,也许对2015年的决策者和高级军官们来说,最令人不安的将是,2050年的战斗节奏将会更快,令军人们不堪重负,其结果是机器人将不得不在人类很少监督的情况下自主做出决定。

人类将不再能够处于“决策圈内”,反而会在“圈上”行动。两者的不同之处在于,在前者的情况下,人类决定是一个过程所需的步骤,因此,人类正在行使主动控制;而在后者情况下,人类只能观察正在发生的行为(以及在某些情况下,观察已经作出的决定及其原因),但他们只能在事后或者在等待预期行为时采取行动。

根据这一报告,虽然2050年战场上的机器人跟今天存在的系统相似,如武装无人机和“射后不管”导弹等,但比起如今的这些系统,这些机器人将“拥有更大的机器推理能力和智能自主权”。

在2050年的作战空间里,机器人通常会团队作战,跟今天的军团一样。根据已确立的参与条例和优先级别,这些自组织或者协作性机器人集合将拥有不同程度的行动自由(从受到主动管理到完全自主行动)。机器人群和团队(以及个别机器人)将被分配各种任务。

当然,依靠高度自治的杀手机器人力量以及其他新的作战技术,会制造敌人可以利用的新的攻击向量。比如说,如果敌方黑客设法通过电子欺骗控制美国的陆军机器人,会发生什么?在一个像是影片《终结者》的场景里,他们会把枪口对准携带武器的战友吗?

在2050年的战场上,人类有望与机器人将并肩作战,那人类和机器人的分工如何?对此,专家们认为:2050年主要的陆军部队将是人类-机器人混合团队。为了使人类能够有效地与机器人结成伙伴,必须以各种方式来增强人类小组成员的力量。这些超级人类将有外骨骼,具备多种植入物,并且可以无缝访问传感器,认知能力得以增强。

最令人感到震撼的是,研讨会与会者还预计,“转基因士兵”将与“能力未得以增强的人类”一起作战:他们(转基因超级人类)将拥有得以增强的物理能力、感官和认知能力。在2050年这个时间框架里,超人类出现在战场上是极有可能的,这是因为需要启用这一发展的各个组成部分已经存在了,并且正在经历迅速演变。

但是,在任何一点成为现实之前,将必须克服各种障碍。首先是,将需要开发新的指挥和控制概念,以成功管理、整合和带领人类、超人类和机器人战士。这意味着,创建一个成功地将人工与人类智能合并在一处的新型混合认知指挥架构。

霍金呼吁禁用杀人机器人

美国《时代》周刊网站7月28日报道称,伟大的理论物理学家斯蒂芬·霍金和特斯拉汽车公司首席执行官埃隆·马斯克,与数十名人工智能和机器人专家在27日发表的公开信中,一道呼吁禁止使用“攻击性自动武器”。

“人工智能技术目前的发展已经使其在几年内、而不是几十年内成为可行——即使法律上不可行事实上也是可以实现的,这样的情况危险极大,”这封公开信说。《卫报》报道说这封信将在布宜诺斯艾利斯举办的人工智能国际联合大会上宣读。“自动武器被称为继火药、核武器之后的第三次战争革命。”

这封公开信把无需人类命令便能够选择并攻击目标的人工智能武器,与无人机和巡航导弹等人类选择打击目标的武器有所区别。这封信中还说,虽然对军队官兵来说,人工智能技术可以令战区更加安全,但这种不受人类控制的武器会引发“全球性人工智能军备竞赛”。

“它们流入黑市或落入恐怖分子和独裁者之手不过是时间问题,”这封信的署名者们警告道。“人工智能可以通过多种方式使战场对人类、尤其是平民来说更加安全,而不必通过创造杀戮新工具这种方式。”

英国《金融时报》网站7月27日发表题为《科学家提醒,要警惕杀人机器人军备竞赛》的报道称,科技界的一些大人物呼吁全球禁止“杀人机器人”。他们提醒说,越过这一界限,将开启新一轮全球军备竞赛。

人工智能领域的1000多位专家在一封公开信中表明了干预态度。在这封信上署名的包括斯蒂芬·霍金教授、特斯拉公司首席执行官埃隆·马斯克,以及苹果公司合伙创始人史蒂夫·沃兹尼亚克。

尽管“机器人士兵”仍处于“纸上谈兵”阶段,可是计算能力和人工智能的迅速进步,增加了军方在20年内把机器人士兵派上战场的可能性。

这封请愿书于7月28日在布宜诺斯艾利斯举行的国际人工智能联合大会上递交。该信警告说,继火药与核武器的发明之后,可以独立确定和袭击目标且不需人类进行任何干预的武器系统的开发,将会带来“第三次战争革命”。

它描绘了未来冲突的可怕情形,类似于系列电影《终结者》中的场景。

该信说:“对于执行暗杀、破坏国家稳定、征服民众或选择性杀死特定民族等任务,自主式武器是理想选择。”

“因此,我们认为,人工智能军备竞赛对人类而言是无益的。人工智能可以让战场变得对人类——尤其平民——而言更安全的方式有许多种,不用创造新的杀人工具。”

联合国也担心“致命性自主式武器”的开发,以至于它去年召开了有史以来第一次此类会议,讨论新科技带来的风险。

加利福尼亚大学伯克利分校的人工智能领域专家、该信的署名者之一斯图尔特·拉塞尔之前曾警告说,机器人武器系统可能使得人类“毫无防御能力”。

该信是今年第二封猛烈抨击将人工智能引入到战场上的信。不过,在呼吁禁止这些武器系统方面,这封最新的请愿书强硬有力得多。该信是由生命未来研究所协调写成的。该所是由包括Skype公司合伙创始人扬·塔林在内的众多志愿者于2014年创建的。马斯克和霍金均是该研究所科学顾问委员会的成员。

自主式杀人机器人的想法对许多军方人士而言具有吸引力,因为它们提供了重要的对敌优势,其部署不会令本国部队的任何人处于危险中,而且长期来看,比起必须支持和保护人员的先进武器,如战斗机,它们的成本应该更加低廉。

五角大楼是机器人研究的最大支持者之一。2013年,其智库之一海军研究处发给塔夫茨大学、布朗大学、伦斯勒理工学院、乔治敦大学和耶鲁大学等多所大学的研究人员一笔研究经费,高达750万美元,让其研究如何能教会自主式机器人分辨对错。

西方军事规划者担心,如果他们没能致力于研究这一技术,那么他们可能会将新一轮军备竞赛的领导权让给潜在对手,比如中国。

资料来源:搜狐网、参考消息网、凤凰网