基于半逆法的一种快速单幅图像去雾算法

2015-03-15张红英吴亚东王小元刘小婷

刘 言, 张红英, 吴亚东, 王小元, 刘小婷

(1. 西南科技大学信息工程学院,四川 绵阳 621010;

2. 西南科技大学特殊环境机器人技术四川省重点实验室,四川 绵阳 621010;3. 西南科技大学计算机与技术学院,四川 绵阳 621010)

基于半逆法的一种快速单幅图像去雾算法

刘 言1,2, 张红英1,2, 吴亚东3, 王小元1,2, 刘小婷3

(1. 西南科技大学信息工程学院,四川 绵阳 621010;

2. 西南科技大学特殊环境机器人技术四川省重点实验室,四川 绵阳 621010;3. 西南科技大学计算机与技术学院,四川 绵阳 621010)

针对目前去雾算法实时性较差,对天空等区域的处理不理想以及去雾后的图像视觉效果较差等问题,提出一种新的基于半逆法的快速单幅图像去雾算法。首先从大气散射模型出发,利用改进的半逆算法得到大气整体光照值;其次,基于大气散射光特性,以图像边缘信息为合成条件融合图像的边缘信息和场景深度信息,准确估测大气光幂;然后,根据大气散射模型得到初步复原无雾图像;最后,经过色调调整和细节增强处理,得到一幅真实感强烈的无雾图像。对于深度发生突变或者远景像素点,消除了光晕效应。与其他算法相比,本算法能很好保持色彩和细节信息,具有较好的实时性和鲁棒性。

图像去雾;半逆;边缘维持;大气散射模型

Keywords:image defogging; semi-inverse; edge preserving; atmospheric stcattering model

图像去雾问题在数学分析中被归纳为图像处理中的欠约束问题,这种问题往往未知参数较多且没有客观评价标准。在早期的图像去雾算法研究中一般采用图像增强的方法,如直方图增强,伽马修正,对比度拉伸等来实现图像在视觉效果上恢复,这种方法被定义为非物理模型方法去雾。但是该方法没有考虑图像的内在信息因素和降质过程,导致图像过饱和或颜色严重失真。随着去雾理论的发展,图像降质问题得到了更多地关注,如大气散射模型等的提出让图像去雾技术有了较大地进步,基于降质模型的方法被定义为物理模型方法。近几年,基于单幅图像去雾算法主要是围绕物理模型展开的。Narasimhan和Nayar[1]利用相同场景、不同季节光照的多幅图像做线性融合运算,从而估测到深度图像,进而复原无雾图像。此方法比较依靠深度和不同图像的光照信息,条件较为苛刻,不太适合实时图像处理。Fattal[2]通过假设透射率和表面投影的局部不相关,估算景物的反射率,进而推断景物的透射率来复原无雾图像,该方法在雾浓度比较大的区域或者假设不成立时失效。Tarel和 Hautiere[3]通过计算大气光幂,来复原无雾图像,但是采用的中值滤波器不能很好地维持边缘细节信息,在深度发生突变或远景区域容易产生光晕效应。相比之下,He等[4]提出的暗原色先验算法让图像去雾技术再向前推进一大步,受到研究人员的高度关注。在优化透射率时所用的抠图方法(soft matting),其技术具有很高的空间和时间复杂度,耗时较长。为了解决这个问题,He等[5]又采用了导向滤波(guided-image filter)来修正透射图(transmission map),却导致图像质量的降低,使得透射图没有抠图方法得到的结果精细。同时,Wang和Feng[6]采用多尺度透射图融合方法也获得了很好的效果,但该技术计算复杂度较高。Sun[7]采用的双边滤波器也能得到很好透射图,由于采用梯度权重计算方法,容易导致梯度逆反效应。近期国内外基于暗原色先验知识改进的快速算法成为了热点。

由Land[8]提出的Retinex算法以及其相关改进算法在色彩增强算法中得到成功应用,该算法名字来源与视网膜(retina)和大脑皮层(cortex)两个词的合成,将到达成像设备的光分为照度分量和反射分量,从图像中去除场景的照度分量,获得反射分量。人眼视觉模型近几年也受到极大的关注。例如,黄黎红[9]提出了基于单尺度Retinex(SSR)的雾天图像增强算法,刘茜等[10]提出的多尺度Retinex(MSR)的自适应图像增强方法。另外,美国国家航空航天局(NASA)Langley研究中心(LRC)将基于邻域(surround-based)的Retinex算法成功嵌入DSP系统,对分辨率为256×256的灰度图像,该算法的处理速度可达30帧/秒,实时性较强,但此算法容易引入光晕效应。

本文从大气散射模型出发,提出了一种基于半逆法的改进去雾算法,首先利用改进的Ancuti等[11]提出的半逆去雾检测算法求到整体大气光照值,再基于暗原色先验知识,求取最小值图;其次,利用平滑的深度信息图和最小值图中提取的边缘信息图作为合成条件进而获得准确的大气光幂;然后利用大气散射模型复原无雾图像;最后,对处理后的图像进行色调修正和局部优化,得到一幅真实感强烈的无雾图像。本算法的空间、时间复杂度较低,还能很好地保持图像的边缘细节信息而且不会引入光晕效应。

1 大气散射模型

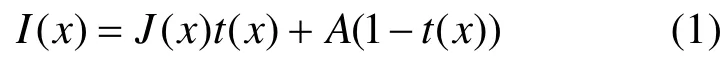

Narasimhan和Nayar[1]研究了不同天气条件下的大气粒子特性,分析了各种大气粒子散射特性,提出了雾霾天气和水下环境下的大气散射模型。与文献[1]模型类似,对雾天图像的物理模型也可以使用 He等[4]所提到单幅图像的大气散射模型(图1)。该模型表述为:

其中, I( x)为降质图像, J( x)为原始图像,t( x)为透射率,A为整体大气光照值。该模型认为两种环境光造成了图像的降质。一种是景物反射光线的衰减项,另一种则是大气粒子对照射光的散射项。所以 J( x) t( x)描述的景物反射光线穿过大气后的衰减项,而 A( 1 - t( x))表示大气散射光,它导致场景的模糊和色偏。当大气同质时,透射率t( x)可以表示为:

其中:β是大气散射系数,d是场景深度。图像去雾的目的是通过 ()t x、A值复原无雾图像 ()J x。

图1 大气退化物理模型示意图

根据物理模型属性,Tarel和Hautiere[3]提出的大气光幂 ()V x需满足两个约束条件:

(1) 大气光幂的灰度为正值;

(2) 大气光幂的灰度值不大于该像素点的RGB通道中的最小灰度值并推导出大气光幂 ()V x的计算公式为:

本文以大气光幂 ()V x满足两个约束条件为依据,采用了一种新的估测大气光幂的方案。

2 本文的算法

2.1 算法流程设计

大多数基于物理模型图像去雾算法一般将最不透明的亮度最高的像素作为整体大气光值,但是图像中最亮像素可能是一辆白色汽车或者强烈光照,会影响到整体大气光值A的估测。若采用Ancuti 等[11]的半逆去雾检测算法求得整体大气光照值,估测到的整体大气光比简单利用图像最亮点更具有鲁棒性,但其后续的基于层的去雾算法效果不太理想。因为其算法在对不同图层加权求和的过程中,图层权重比例不方便设置,同时无雾区域的对比度没得到较好地改善。因此,为了克服其采用的基于不同光照图层的融合算法的不足,本文采用改进的半逆算法求整体大气光照值,再利用图像边缘信息和平滑区域融合的方法来估测大气光幂,从而复原无雾图像。

算法流程:

(1) 用改进的半逆检测算法求整体大气光照值A;

(2) 白平衡处理降质图像 I( x);

(3) 求 RGB 三颜色通道的最小值图像Imin(x);

(4) 利用本算法的高斯平滑滤波核处理Imin(x),得到边缘合成条件 ΔB ;

(5) 分别利用7×7的高斯滤波和9×9的均值滤波窗口处理Imin(x),得到平滑图像 Ismooth(x);

(6) 利用合成公式合成大气光幂 V( x, y);

(7) 以 Imin(x)为引导图像,对 V( x, y)进行导向滤波;

(8) 根据公式:

V( x, y) =max(min(K ×V( x, y), Imin(x )),0),得到优化后的 V( x, y);

(10) 对 J( x, y)做色调映射和细节增强。

2.1.1 改进的半逆法求整体大气光照值A

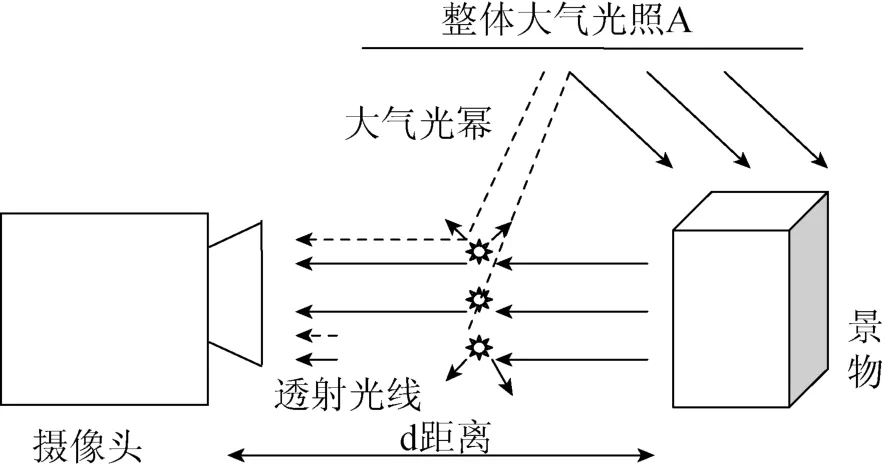

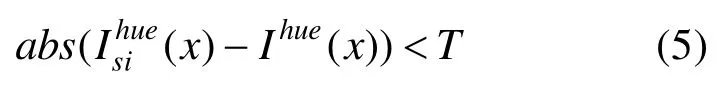

根据Narasimhan和Nayar[1]的观察,整体大气光最佳估计值出现在雾最浓的像素点,He等[4]选择图像暗原色通道中值最大的1%的像素点作为整体大气光值,这种选择思路基于图像中包含天空区域和没有纯白色的饱和点。与暗原色先验知识类似,Ancuti等[11]提出在雾区除了深度不连续的区域,亮度值变化非常小,基于这个假设,将降质图像 I( x)与其半逆图像 Isi( x)转换到 HSI或者CIE色彩空间比较色调差异,并设定一色差阈值,以这个阈值为判据将降质图像分为雾区和非雾区,检测出雾区,进一步在邻近天空区域的雾区中选择最亮像素点作为整体大气光值。产生的半逆图像表示为在RGB三通道中分别用原像素点和逆像素点的最大值代替原像素点。半逆图像公式可描述为:

其中, Ir(x), Ig(x)和 Ib(x)表示 RGB三个通道的像素灰度值。通过研究计算:

其中,T是预先设定的阈值,按照视觉特性取T=10°, Ihue(x)表示降质图像的色度,表示其半逆图像的色度。将原始降质图像 I( x)和其半逆图像 Isi( x)转换到HIS或者CIE色彩空间后比较色度差异,并把所有小于阈值T的那些图像像素作为雾气区域,然后选择雾气区域的最亮像素点作为整体大气光照值A。但是这样的方法也不能很好地解决白色物体对整体大气光值估计的干扰,所以本文采用了改进的半逆检测算法来确定整体大气光照值。首先,取雾气区域亮度分量上方1/10的像素区域做四叉树分割,将这些区域分为四个小块区域,分别比较四个小块区域灰度均值与灰度方差之差,选择差值最小的区域,继续做四叉树分割,一直到选出的矩形区域达到固定边宽(经过实验验证取边宽为8个像素点较好),停止分割,取这个矩形区域中最大灰度值做为整体大气光照值A。该方法不仅排除了非雾区的影响还减小了算法的计算量,较好地消除雾区中白色物体的干扰,求得较准确的整体大气光照值A,如图2所示。

图2 改进半逆法示意图

2.1.2 白平衡

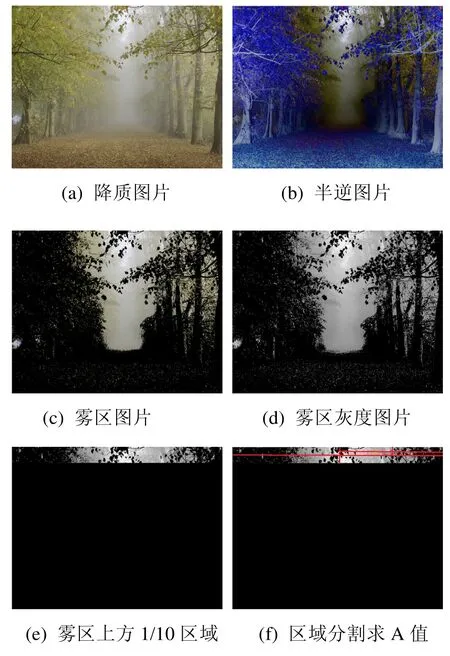

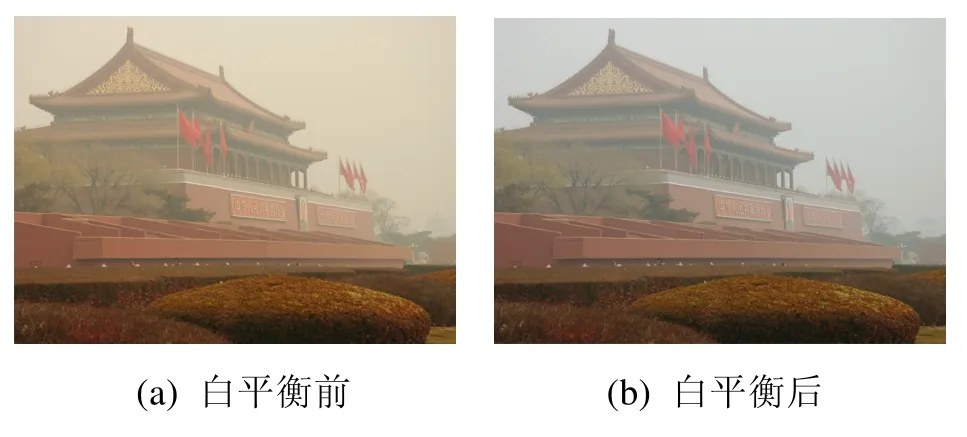

根据对人眼视觉系统(human visual system, HVS)的研究发展,人眼对物体的识别机制使得人对物体色彩的判断能适应环境光的变化,即当入射光在一定程度上变化时,人们的视觉系统能判断出哪些变化是由环境光的改变产生的,而对物体表面的颜色认为是恒定不变的。基于这个原理,偏于高色调的光源通常会使视觉系统感受到场景偏于蓝色,而低色调的光源通常会使人们感受到场景偏于红色。相机拍摄到的照片如果没有进行曝光或者白平衡处理,则会出现色偏效应。所以对于一些色调偏高或者偏低的图片应该先做白平衡处理。白平衡的步骤:①将相机拍摄到的图像做归一化处理;②将整体大气光照值A校正为纯白色。本文采用白点(white point)算法可表示为:

由图3可看出,经过白平衡处理后的图像看上去更自然,A值更接近于白色。

图3 白平衡处理前、后的图像

2.2 大气光幂(atmospheric veil)估计

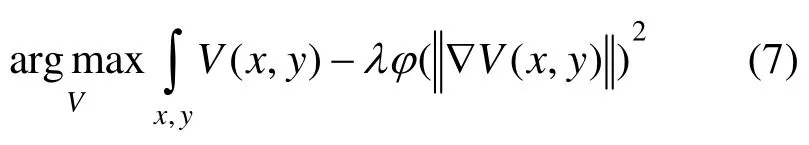

Tarel和 Hautiere[3]提出大气光幂优化问题可以表示为:

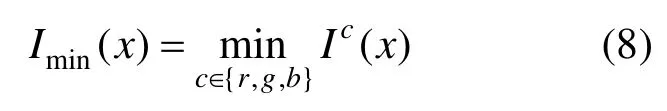

图像的景物深度信息和图像边缘细节信息可从RGB图像的三个通道中的最小值图像中提取,最小值图像可以表示为:

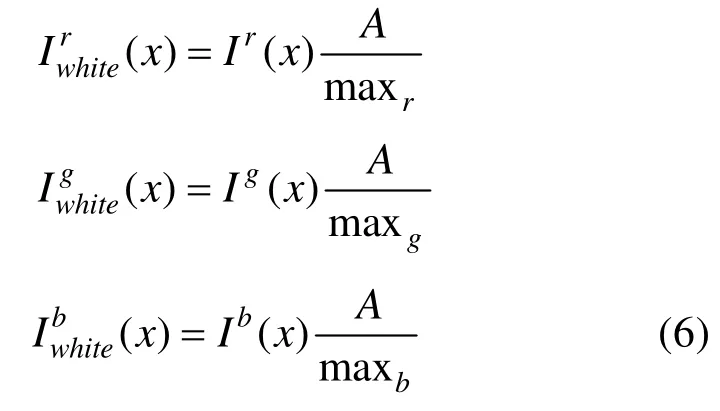

假设大气光幂可以从最小值图像中提取出来,而且认为除了在那些深度发生跳变的地方,大气光幂在大部分区域都是平滑的。本文提出一种新的大气光幂的快速合成方法,该方法基于一个边缘先验知识:最小值图像的边缘就是亮度变化剧烈的地方。对图像进行平滑时,如果中心像素为非边缘点,则它的亮度会受到邻域内其他同区域像素的影响;反之,如果中心像素点是边缘点,则邻域中的非边缘点的亮度对中心点没有影响。所以需先对最小值图像非边缘点内部进行高斯平滑滤波局部去噪和均值滤波得到包含景深信息的模糊图像 Ismooth(x),在边缘处则直接提取最小值图像像素 Imin(x),最后将两张图像进行融合处理,这样既能保证视觉上的边缘锐化,又能获得含有深度信息的模糊背景,其效果如图 4所示。

图4 合成效果图

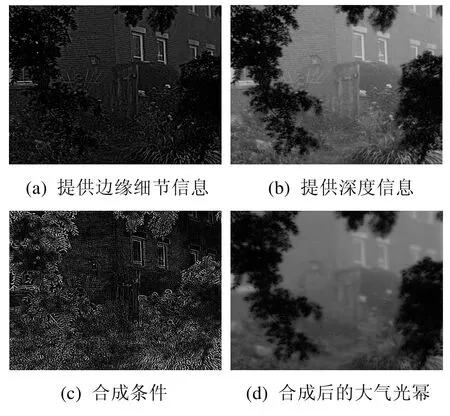

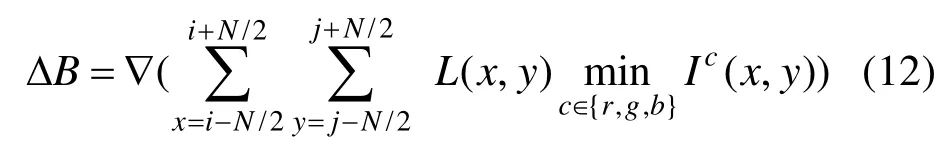

根据最小值图像的边缘就是亮度变化剧烈的地方的先验知识,利用邻域像素和中心像素点的亮度梯度关系即合成条件 BΔ 确定图像的边缘,从而计算大气光幂。大气光幂 (,)V x y的合成公式可以定义为:

其中,Δ B 表示合成条件,f ( x, y)表示最小值图像,G( x, y)表示低通高斯核函数, H( x, y)表示均值核函数, H( x, y) G( x, y)的平滑效果取决于模板窗口大小。再以 f( x, y)为引导图像,对 V( x, y)进行导向滤波,最后合成得到:

V( x, y ) =max(min(K ×V( x, y), Imin(x )),0)(10)

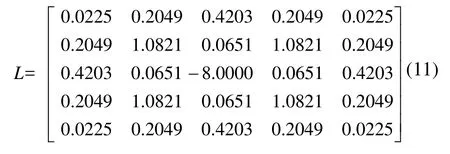

式(9)中的合成条件 ΔB ,可以直接由改进的高斯拉普拉斯模板对最小值图像 Imin(x)滤波得到。黄剑玲和邹辉[12]提出的改进的高斯 Laplace模板可以很好地提取边缘信息,同时去噪,改进的高斯Laplace模板表示为如下形式:

该高斯Laplace模板的系数为1,其最大特点体现在16个方向上设置了不同的权重向量,不同类型方向上设置的权重不等,相同类型方向上设置等权重,并且整个模板无零值点,保证了16个方向都被检测到,克服了原有边缘检测算子的不足。 ΔB 的公式表示如下:

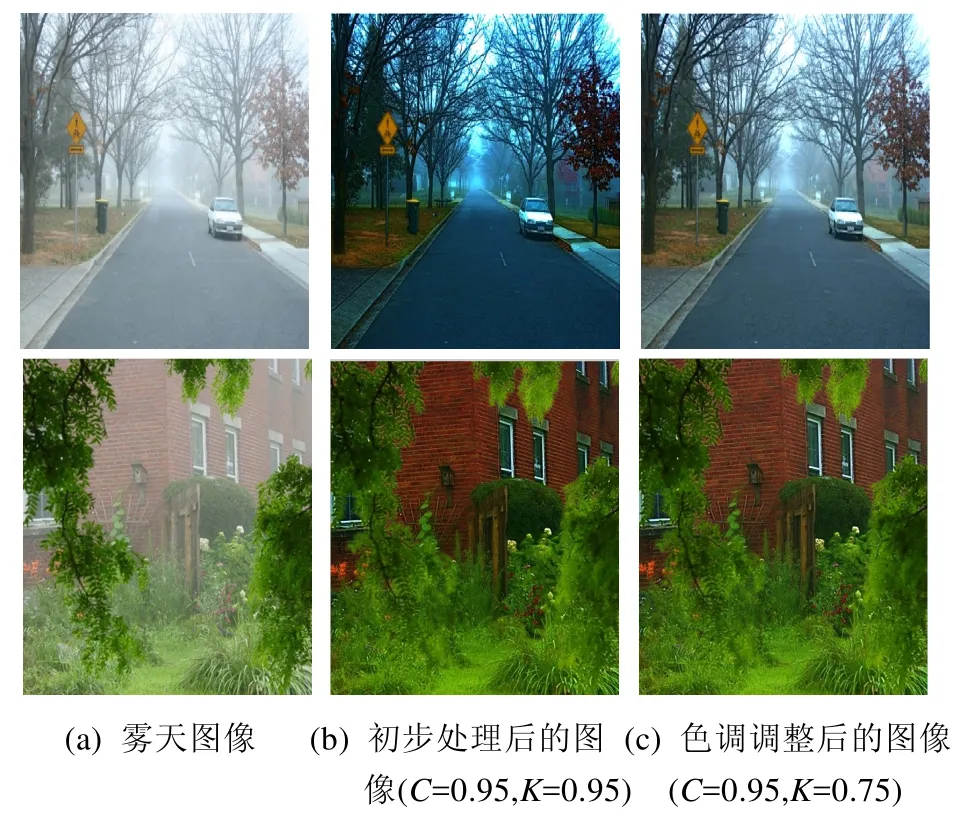

式(9)和式(10)引入因子C和K,根据大量实验验证,取值C=0.95,K=0.75可得到较好的图像复原效果。C和K是本文算法设定两个系数,用来控制大气光幂的对比度。

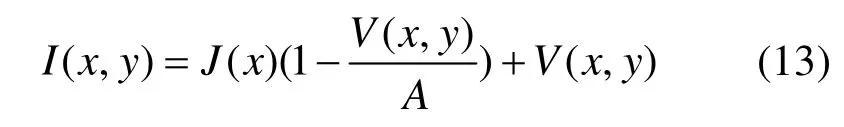

2.3 降质图像复原

根据Tarel和Hautiere[3]的研究,利用大气光幂 V( x, y)、整体大气光值A,及利用式(1)和式(3)可以把大气散射模型改写成:

将式(10)变形为:

其中,J( x, y)为复原后的图像,I( x, y)为降质图像。利用改进的半逆检测算法估算到A,再用合成算法得到大气光幂 V( x, y)的估计图,最后根据式(14)就得到复原图像 (,)J x y。

3 色调调整和细节增强

3.1 色调调整

由式(14)得到的复原图像通常偏暗,而降质图像整体偏灰白如图 5所示。可对初步处理过的复原图像做增强处理,提高复原图像的可视性和真实性。

图5 色调调整图

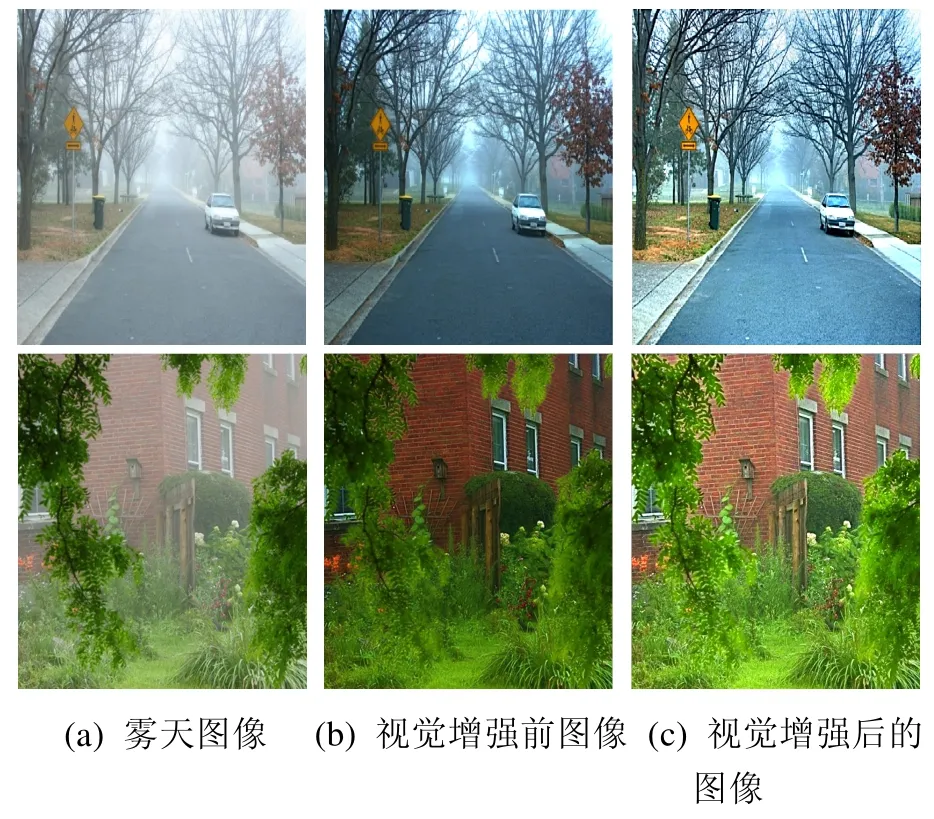

一般算法采用gamma函数来提高初步处理后的图像的对比度,本文算法只需要调整C和K,就可以提高复原图像的对比度。参数C取值越大,雾区雾越淡,就越暗;取值越小,雾区的雾就越浓。而系数 K越大整体对比度就越高,越低越白从而对比度就越低。由图5可见,改变C和K来进行色调调整,初步处理后的图像对比度明显改善。为了进一步提高复原图像的对比度,通过实验分析,可采用自适应低照度视觉增强算法来做处理可得较好效果。自适应低照度视觉增强算法流程:

(1) 求复原图像 RGB通道的最大值图像Imax(x, y)和最小值图像 Imin(x, y)。

(2) 以 15×15的窗口,对 Imax(x, y)做最大值滤波,得到对 I (x, y)进行最小值滤

min波,得到

(3) 以 Imax(x, y)为引导图像,对进行导向滤波,得到 F 1(x, y)。以 Imin(x, y)为引导图像,对进行导向滤波,得到 F( x, y)。

(4)由公式:得到视觉增强后的图像Ic∈r,g,b(x, y)。

由图6可见采用自适应低照度视觉增强后,图像对比度得到明显提高。

图6 视觉增强图

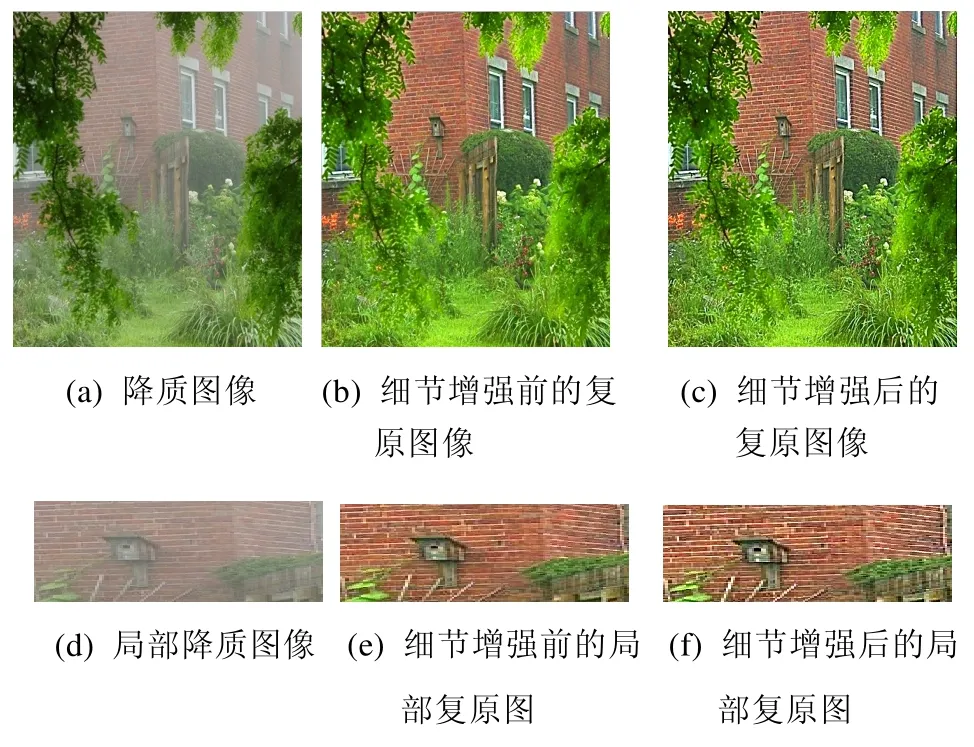

3.2 细节增强

色调调整过程不可避免造成图像边缘模糊,使处理后的图像产生失真。所以需要对图像进行细节增强处理(图7)。本文加入了边缘补偿公式:

图7 细节增强示意图

4 实验结果分析和客观评价

在配置为Pentium (R) D,3 . 30 GHz CPU,8 GB内存的计算机上采用matlab 7.0软件环境对本文算法进行了验证,文献[4]、文献[3]和文献[2]Fattel去雾算法是图像复原中比较经典的算法,而带颜色恢复的多尺度 Retinex (multi-scale retinex with color restoretin, MSRCR)去雾文献[13]算法是目前效果较好的图像增强算法。本文算法分别与上述算法进行对比并给出实验结果和分析。为了进一步说明本文半逆法的特点,还对本算法进行了局限性分析,且与文献[11]的半逆法进行了对比分析,并给出了实验结果。

4.1 主观视觉

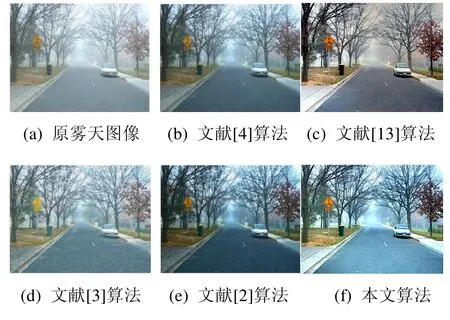

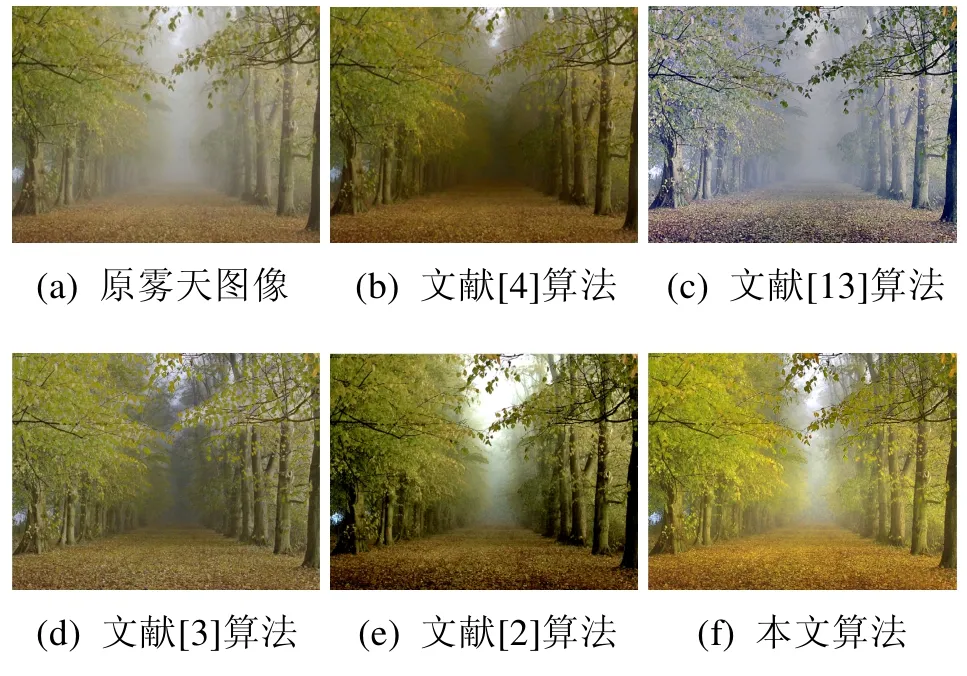

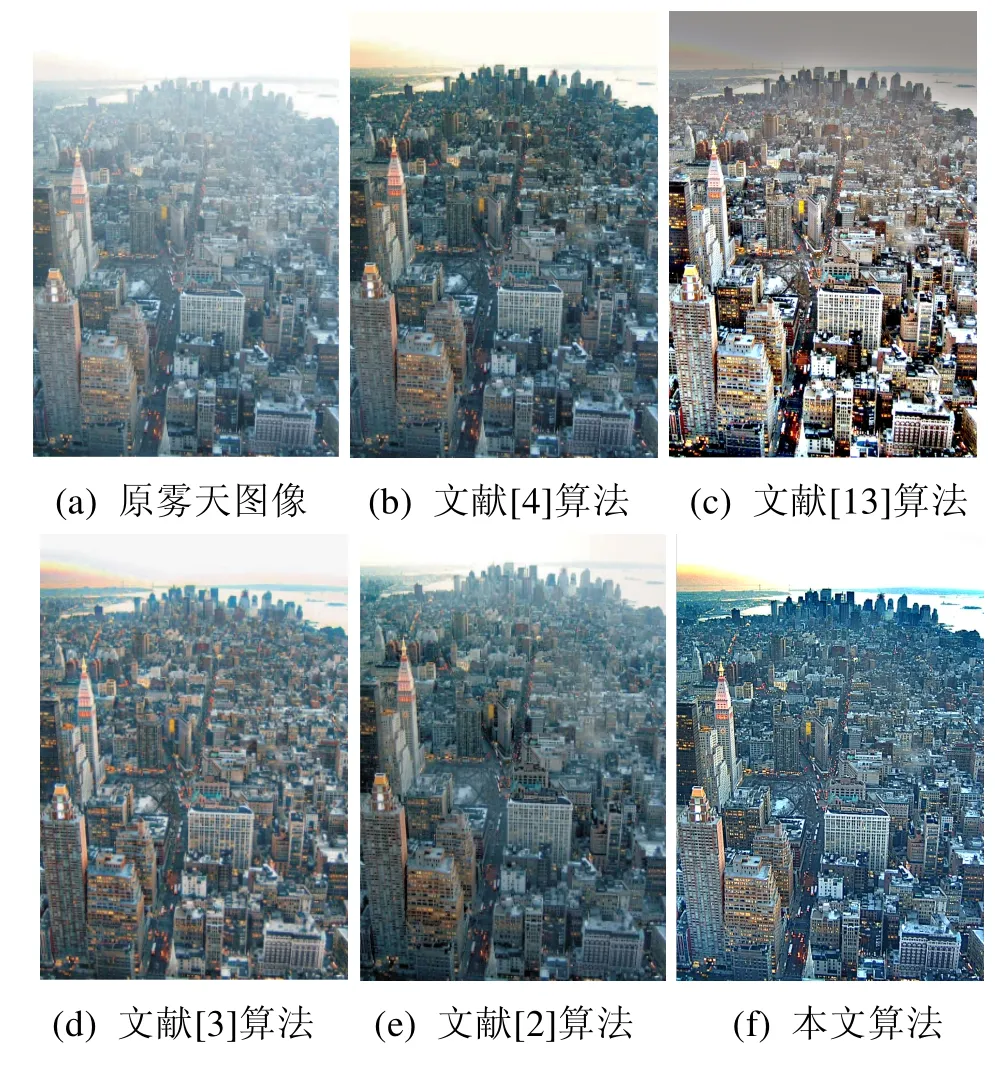

图8~11给出了不同算法的去雾结果,图8~11场景依次为:公路(尺寸为 600×400)、森林(尺寸为377×253)、城市(尺寸为260×147)、山地(尺寸为670×502)。其中(a)图为原雾天图像,(b)、(c)、(d)、(e)、(f)图分别为He结果、MSRCR结果、Tarel结果、Fattel结果和本文结果。

图8 本文算法和其他四种算法的复原图像

图9 本文算法和其他四种算法的复原图像

图10 本文算法和其他四种算法的复原图像

图11 本文算法和其他四种算法的复原图像

分析图8~11,文献[4]算法结果相对偏暗,文献[3]算法的结果边缘细节不够清晰,而且在边缘处出现了光晕现象。文献[2]算法结果的局部区域出现了明显的失真,文献[13]算法较好地提高了雾天图像的对比度,但是增强后常常导致颜色偏移。本文算法的复原图像前景颜色比较鲜艳,而背景保留了少部分雾使图像更加真实,光照调整比较适中,突出了细节。

4.2 客观评价

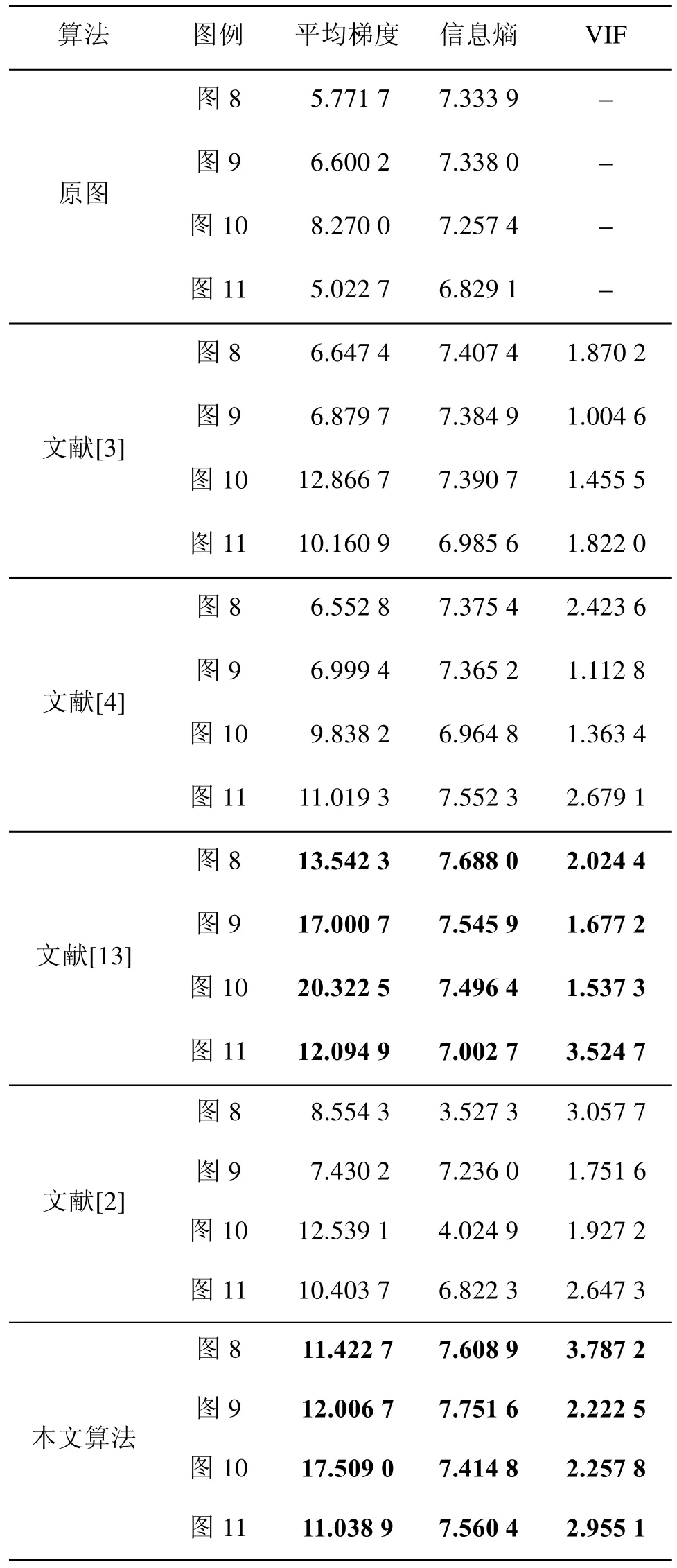

对去雾后的图像质量客观评价,使用了平均梯度、信息熵、视觉信息保真度(visual information fidelity, VIF)三个指标。其中,平均梯度越大,图像层次越多,细节就越清晰。信息熵是图像质量评价的常用指标,反映的是图像信息丰富程度。信息熵越大,信息量就越丰富,图像质量越好。VIF是 Sheikh和 Alan[14]结合了自然图像统计模型、图像失真模型、人眼视觉系统模型提出的图像质量评价指标,与峰值信噪比(peak signal to noise ratio, PSNR)和结构相似性(structual similarity index metric, SSIM)相比在主观视觉上具有更高的一致性。各指标统计见表1。

表1 几种算法去雾结果客观评价

从表1中图8~11平均梯度和信息熵两个指标来看,本文算法及文献[13]算法去雾后的数值明显高于其他三种算法,说明较好地改善了雾天图像的对比度。文献[13]算法虽然有较高的平均梯度和信息熵,但其 VIF值很低,说明其视觉保真性较差,这种算法容易导致色彩偏移。本文算法的平均梯度、信息熵整体较好,VIF均高于对比算法,说明在提高图像细节清晰度和对比度的同时也有较好地视觉效果。

4.3 运行时间比较

去雾算法在实际应用中必须考虑到实时性,测试时,文献[3]算法采用复杂度为O(N)的中值滤波方法。文献[13]使用了3个尺度的高斯核,并采用快速傅里叶变换在频域中进行卷积运算以提高速度。文献[4]算法采用了软抠图的方法,耗时较多。文献[2]采用了ICA方法来优化。比较了五种算法的时间,本文算法在处理速度上具有优越性。对于 600×400的图片文献[4]算法所用平均时间为20.23 s、文献[2]算法为 33.40 s、文献[3]算法为2.00 s、文献[13]为1.60 s、本文算法只需4.13 s。若对本算法图像下采样加速优化,可达到实时处理雾天视频的目的。

4.4 局限性分析

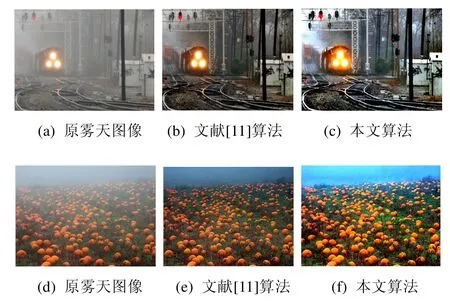

为了区别本文半逆算法与文献[11]的差异,将两种半逆法进行了对比分析。两种算法均采用半逆检测算法求取A值,但实现方法不同,本文算法采用的是基于大气光幂的物理模型复原雾天图像,而文献[11]算法采用图层加权融合的图像增强方法提高对比度,从而达到复原雾天图像的目的,这种去雾算法效果不太理想。因为其算法在对不同图层加权求和的过程中,权重比例不方便设置,若权重比例选择不合适,容易导致融合后的图像出现不连续和伪影效应,同时无雾区域的对比度也未得到较好地改善。本文半逆算法从图像降质过程为出发点,估测大气光幂。这种方法参数设置简单,复原图像的有雾和无雾区域的对比度都得到了较好地改善。两种算法对比效果如图12所示。经实验证明,本文算法也存在一定的局限性,从1 000张雾天图中随机抽取250张,用本文算法处理后,统计测试结果得出,对于前景薄雾,背景浓雾的图片或大面积天空图片,如果去雾程度太大,背景容易出现不太明显的颜色失真和梯度效应;去雾程度太小,其效果不明显。其原因是由雾分布不均匀导致的,即大气光幂不是渐变而是突变的情况。大气光幂的系数 K的选择决定去雾的程度,K值越大去雾程度越大,K值越小去雾程度越小。本文算法实验中选取的 K=0.75,取得了较好的实验结果。若将本算法用于视频去雾系统,需进一步提高系数K的自适应性。

图12 本文算法和文献[11]算法的复原图像

5 结 论

本文提出了一种基于半逆法和图层信息融合的大气光幂估计方案。该方法能够较好地保持大气光幂的边缘和平滑非边缘区,无需附加任何场景的信息,通过雾天图像自动的恢复大气光幂,从而复原降质图像。本文算法的时间复杂度仅与图像像素成线性关系,本文算法的优点首先在于利用改进的半逆检测算法排除了雾区中白色物体的干扰,获得准确的整体大气光照值。其次利用边缘信息为合成条件融合了大气光幂的深度突变区和平滑区域,进一步获得了准确的大气光幂。尽管本算法取得了一定效果,但是由于雾天状况的随机性和复杂性,还有相机和视频设备的质量等众多因素在去雾工作中需研究。因此,未来的工作将继续完善该算法,并将其用于视频去雾系统。

[1]Narasimhan S G, Nayar S K. Vision and the atmosphere [J]. International Journal of Computer Vision, 2002, 48(3): 233-254.

[2]Fattal R. Single image dehazing [J]. ACM Transactions on Graphics, 2008, 27(3): 72-79.

[3]Tarel J P, Hautiere N. Fast visibility restoration from a single color or gray level image [C]//Proceedings of the 12th IEEE International Conference on Computer Vision. Kyoto, Japan, 2009: 2201-2208.

[4]He Kaiming, Sun Jian, Tang Xiaoou. Single image haze removal using dark channel prior [C]//Proc of the IEEE Computer Society Conference on Computer Vision and Pattern Recognition (CVPR), 2009: 1956-1963.

[5]He Kaiming, Sun Jian, Tang Xiaoou. Guided image filtering [J]. IEEE, 2013, 35(6): 1397-1409.

[6]Wang Z, Feng Y. Fast single haze enhancement [J]. Computers and Electrical Engineering, 2014, 40(3): 785-795.

[7]Sun Wei. A new single-image fog removal algorithm based on physical model [J]. International Journal for Light and Electron Optics, 2013, 124(21): 4770-4775.

[8]Land E H. The Rexinex theory of color vision [J]. American Scientist, 1977, 237(6): 108-128.

[9]黄黎红. 一种基于单尺度Retinex的雾天降质图像增强新算法[J]. 应用光学, 2010, 31(5): 728-733.

[10]刘 茜, 卢心红, 李象霖. 基于多尺度Retinex的自适应图像增强法[J]. 计算机应用, 2009, 29(8): 2077-2079.

[11]Ancuti C O, Ancuti C, Hermans C, et al. A fast semi-inverse approach to detect and remove the haze from a single image [C]//2010 - 10th Asian Conference on Computer Vision. Queenstown (ACCV), New Zealand, 2010: 501-514.

[12]黄剑玲, 邹 辉. 基于高斯Laplace算子图像边缘检测的改进[J]. 微电子学与计算机, 2007, 24(9): 155-161.

[13]Rahman Z, Jobson D, Woodell G. Retinex processing for automatic image enhancement [J]. Journal of Electronic Imaging, 2004, 13(1): 100-110.

[14]Sheikh H R, Alan C. Image information and visual quality [J]. IEEE Transactions on Image Processing, 2006, 15(2): 430-444.

A Fast Single Image Dehazing Using the Improved Semi-Inverse Approach

Liu Yan1,2, Zhang Hongying1,2, Wu Yadong3, Wang Xiaoyuan1,2, Liu Xiaoting3

(1. School of Information and Engineering, Southwest University of Science and Technology, Mianyang Sichuan 621010, China; 2. Robot Technology Used for Special Environment Key Laboratory, Southwest University of Science and Technology, Mianyang Sichuan 621010, China; 3. School of Computer and Technology, Southwest University of Science and Technology, Mianyang Sichuan 621010, China)

In order to overcome the defects of the existing algorithms, such as the poor real-time performance, bad effect in sky area and poor visual effects to dehaze image. A new algorithm for fast single image dehazing is presented based on the semi-inverse method from the point of view of atmospheric scattering model. The improved semi-inverse algorithm is firstly used to obtain the global atmospheric illumination value. Secondly, based on the characteristics of atmospheric scattering light, the atmospheric veil is accurately estimated fusing the image edge information and scene depth information. Then, the restore image eliminates the halo effect for depth uncontinuous pixels or distant pixels according to the atmospheric scattering model. Finally, the obtained restore image has a strong sense of reality by using of the hue adjustment and detail enhancement. Compared with the other algorithms, our algorithm can maintain color and detail information and ensure the real-time performance.

TP 391.41

A

2095-302X(2015)01-0068-09

2014-08-11;定稿日期:2014-08-20

四川省科技厅青年基金资助项目(2011JQ0041);中国科学院西部之光人才培养计划资助项目(科发人教字(2012)179号);特殊环境机器人技术四川省重点实验室开放基金资助项目(13zxtk05);国家自然科学基金资助项目(61303127)

刘 言(1987–),男,四川广安人,硕士研究生。主要研究方向为图像处理、模式识别。E-mail:56200552@qq.com

张红英(1976–),女,四川德阳人,教授,博士。主要研究方向为图像处理、动目标检测与跟踪、生物特征识别。E-mail:zhy0838@163.com