基于视频的弹丸终点参数获取研究*

2015-03-15曹丽静刘玉文

曹丽静 刘玉文

(陆军军官学院 合肥 230031)

基于视频的弹丸终点参数获取研究*

曹丽静 刘玉文

(陆军军官学院 合肥 230031)

针对目前弹丸动爆实验组织难,系统复杂等问题,论文提出了一种基于视频图像计算弹丸终点参数的新方法,简化了动爆实验所需的复杂测量系统平台,通过视频图像中弹丸位置姿态的提取计算弹丸终点参数。论文采用了改进的减背景法进行目标定位与跟踪,根据弹丸边界确定弹丸姿态,再由投影变换和立体视觉原理求得目标实际位置和姿态,并运用VC2010和OpenCV2.2软件平台设计了仿真系统。系统仿真结果表明论文方法实用可行,运算速度快,精度较高。

弹丸终点参数; 减背景法; 投影变换; 系统仿真

Class Number TP391.9

1 引言

弹丸的落角和落速等终点参数直接影响弹丸作用效果、终点效应等[1],是分析弹药毁伤效果的必要参数。弹丸在空中的飞行运动是一个非常复杂的运动过程[2],很难准确测量弹丸飞行过程中的速度和飞行姿态。为了研究弹丸终点效应,就必须获得弹丸的落速和落角,为了获得这两个重要参数,很多科学工作者都进行了大量研究工作,比如有数值模拟计算、近似公式、天幕靶测量和雷达法[3~6]等多种方法都可以测量或模拟出弹丸的终点速度。这些方法虽然有的发展较为成熟,但要么系统庞大、价格昂贵、技术复杂、维护难度大、且测量的绝对精度较低,适合于超视距大型环境中的目标跟踪和测量,要么进行了条件假设,计算复杂且不能得到实际速度。而基于视频的弹目交汇分析是采用图像和光学投影变换[7]的方法,可以充分利用光学投影变换的基本原理和方法,具有系统简单、易于操作、目标定位精度高、系统响应速度快等优点。

本文提出从高速摄像仪摄录的弹目交汇视频中,采用特征提取技术识别弹丸和目标,根据立体视觉测量原理计算落速、落角和炸目距离等弹丸终点效应参数,具有系统构成简单,操作方便,费效比高等特点。

2 目标识别与跟踪

本文获取高速弹目交汇视频的方法是,将高速摄像机固定在距离目标100m~150m的位置上,用以拍摄弹目交汇瞬间的视频,因此弹丸运动的背景基本上是固定不变的,本文采用改进的减背景法识别跟踪弹丸。

减背景法[8]通过当前图像与背景图像之间的差分,也就是当前图像与背景图像相减来检测运动区域,是目前运动检测中最常用的一种方法。其优点是提取目标位置准确,速度快,只需获取一幅当前图像,运算量低,可以做到实时检测与分割,不足之处是受其他环境因素影响较大,比如光线变化,风的吹动等,因此在非受控环境下,需要进行背景更新,减背景法也只能应用在摄像机静止情况下的运动目标检测[9]。

本文所采取的方法是高速摄像机固定好后,先拍摄一张没有弹丸的背景图像,然后利用减背景法检测运动目标,即前景图像与背景图像相减,像素相差较大的区域为目标区域,为了精确定位目标轮廓,还要进行边缘检测,提取目标轮廓。然后进行背景更新,具体方法是将背景图像中目标区域以外的像素更新为前景图像,目标区域的像素用原背景对应区域的像素填充,得到完整的新背景。将该新背景用于下一帧的目标检测,同时,每一帧的目标检测都可以确定目标在图像中的位置,因而也就实现了视频中运动目标的跟踪过程。

这种更新背景的方法弥补了减背景法对环境变化敏感的不足,增强了原来减背景法对环境的适应性。

3 弹丸终点参数提取

3.1 弹丸落角的求取

图1 弹丸终点形态示意

根据立体视觉[10]原理,可以求得弹丸在空间中的姿态,弹丸姿态平面图如图1所示。A、B分别为过弹丸中轴线且与水平面垂直的平面与弹丸边界相角的两个顶点,这两点空间坐标由立体视觉方法确定。设其坐标为A(xA,yA,zA)、B(xB,yB,zB),C点为A、B两点的中点,其坐标由A、B点坐标中值计算得到C(xC,yC,zC),O为弹丸近似形心,设其坐标由立体视觉方法确定,并将其设为弹体坐标系的原点。因此OC连线与弹体坐标系平面XOZ的夹角满足:

(1)

因此有

(2)

式(2)中θ为弹丸中线与水平面的夹角,即落角。

3.2 弹丸落速的求取

弹丸落速是指弹丸与靶接触瞬间的速度或者弹丸爆炸前的瞬时速度。弹丸落速的求取可通过相邻两帧图像中弹丸形心移动距离除以帧间时间获得。

(3)

其中,ΔD为相邻两帧图像间弹丸形心的移动距离,ΔT为相邻两帧图像的间隔时间。

为了获取弹丸的实际落速,需要将图上距离转换为实际距离,由于视频中所获取的每一帧图像都对应着实际物理空间的一个四边形区域,可以通过光学投影变换和图像配准,形成视频图像与物理空间之间的投影变换矩阵M,进而可以得出弹丸投影模型[7]:

(4)

其中,(x,y,z)为物理空间上的坐标,(u,v,1)为视频图像上弹丸像素点的位置坐标。

图2 光学投影变换模型

弹丸投影变换模型如图2所示。

要计算视频图像中弹丸在物理空间上的对应位置,需知道视频图像坐标系到物理空间地理坐标系之间的投影变换矩阵,即式(4)中的M。矩阵M的具体表示为

(5)

投影变换矩阵中m1~m9的确定方法是,通过在视频图像和物理空间上分别选定一对参考点,可确定投影变换矩阵中的参数,通过选取多个参考点,可以将全部参数确定。之后即可用式(4)计算出视频图像中任意像素点在物理空间上的匹配点坐标。

3.3 炸目距离求取

炸目距离是指弹丸爆炸时距目标的距离。当弹丸爆炸时会产生强光和大量烟雾,因此弹丸爆炸时视频图像在爆炸位置相对于背景图像有较高的亮度,从而确定了弹丸爆炸时所在的视频帧,根据前一帧弹丸的形心位置和弹丸速度推算爆炸时刻弹丸在图像中的位置,再利用投影变换原理,计算出弹丸实际位置,从而得到炸目距离为

(6)

其中,(xD,yD,zD)为弹丸坐标,(xM,yM,zM)为目标坐标,目标坐标为已知。

4 系统仿真

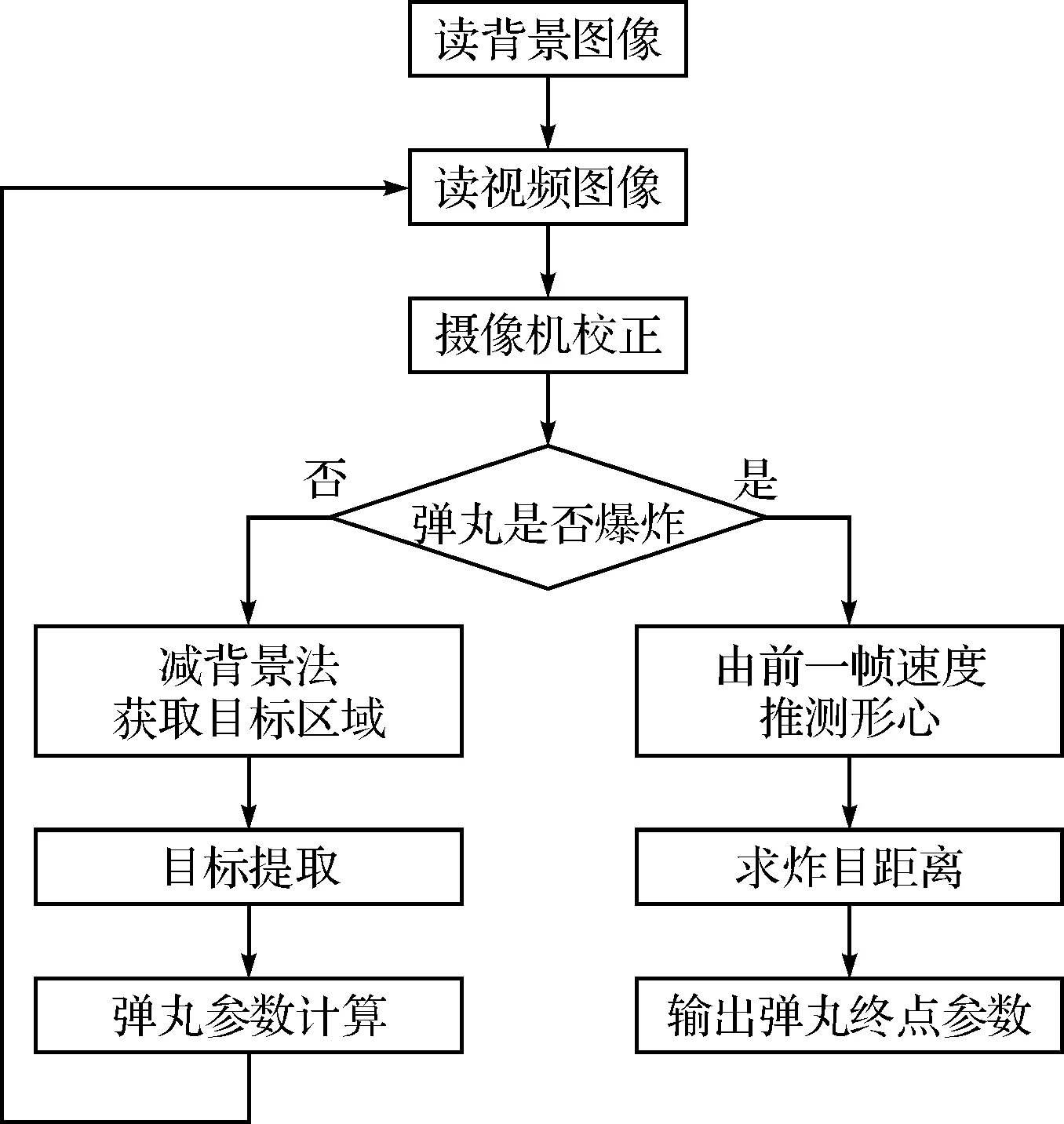

本文采用VC2010和OpenCV2.2为软件开发平台,设计了求取弹丸终点参数的系统仿真。系统设计流程如图3所示。

图3 弹丸终点参数获取流程图

运用该仿真系统对视频中弹丸飞行参数进行了计算,计算结果如图4所示。

图4 仿真界面

由于保密要求,无法获得火炮弹丸动爆实验视频,因此本文采用网上下载的高速摄影视频来验证方法的正确性。所用视频为子弹击中目标的过程,本系统实时计算子弹的姿态、速度、弹目距离等参数,当判断出子弹与目标相接触或爆炸时,记录此时弹丸各项参数,即为弹丸终点参数。

图4为子弹接触目标前一时刻的图像,由于子弹接触目标时弹头微向上,根据定义落角为负值,即θ=-14.62°,子弹飞行速度为vc=895.63m/s,弹目距离为DDM=0.01m。而该视频子弹实际飞行速度为900m/s,由此可见,本文算法切实可行,且精度较高。

5 结语

本文方法利用了减背景法提取目标位置准确、速度快、运算量低的优点提取目标区域,改进了背景更新模式,提高了其对环境的适应性,并利用弹丸外形特点和光学投影变换模型给出了弹丸终点参数的计算方法。本文直接通过弹目交汇视频提取弹丸终点参数,比弹道解算获取的终点参数准确度高,系统简便,运算速度快,为靶场测量弹丸终点参数提供了一种新途径。

另外,本文的研究成果为基于高速摄影的弹药动态毁伤试验技术提供关键技术支撑,还可以应用于各种弹药飞行姿态的测量及炮口初速、姿态等初始状态的测量问题。

[1] 武频,赵润祥,谭俊杰,等.滑翔增程弹气动特性分析[J].弹道学报,2001(4):38-41.

[2] 韩子鹏,等.弹箭外弹道学[M].北京:北京理工大学出版社,2008:1-256.

[3] 慈明森,柯言.理想爆炸成形弹丸终点弹道的数值模拟和实验模拟[J].弹箭技术,1994(2):43-48.

[4] 安长星,郝博.弹丸速度与弹道倾角之间的近似公式[J].沈阳工业学院学报,2003,22(2):73-75.

[5] 冯志远.天幕靶测量速度矢量[C]//长春,2008:107-108.

[6] 王沛.落速测量雷达技术研究[D].南京:南京理工大学,2008:8-16.

[7] 罗丽莉,秦晅.基于视频图像序列的动目标跟踪定位技术研究[J].指挥信息系统与技术,2010,1(3):70-73.

[8] 方帅,薛方正,徐心和.基于背景建模的动态目标检测算法的研究与仿真[J].系统仿真学报,2005,17(1):159-165.

[9] 苏礼坤,黄继红.基于帧间差分的彩色视频背景提取[J].成都信息工程学院学报,2010,25(2):167-171.

[10] 庞羽佳,王向军.利用立体视觉交汇测量方法进行靶场弹落点探测的误差分析[J].计量技术,2004(5):13-15.

Projectile Terminal Parameter Estimation Based on Video

CAO Lijing LIU Yuwen

(Army Officer Academy, Hefei 230031)

Aiming at the problems of projectile explosion experiment difficult organization and system complexity, a new method for computing projectile terminal parameters based on video is advanced in this paper. The method simplifies the complicated measuring system platform for projectile explosion experiment, instead that, the projectile terminal parameters are extracted from its position and attitude in the video image. An improved background subtraction is used to locate and track target in the paper, and the projectile attitude can be ascertained by its verge, then the real position and attitude of the target are figured out according to projection transformation theory. Lastly, a simulation system is designed by using VC2010 and OpenCV2.2. Result shows that the method practices well, runs fast, computes accuracy, etc.

projectile terminal parameter, background subtraction, projection transformation, system simulation

2014年10月1日,

2014年11月20日

曹丽静,女,硕士,讲师,研究方向:图像拼接、运动目标识别。刘玉文,男,博士,教授,硕士生导师,研究方向:弹道、气象等。

TP391.9

10.3969/j.issn1672-9730.2015.04.035