一种改进的两阶段目标跟踪方法

2015-02-20杨大为

王 静,王 琰,杨大为

(沈阳理工大学 信息科学与工程学院,辽宁 沈阳 110159)

一种改进的两阶段目标跟踪方法

王 静,王 琰,杨大为

(沈阳理工大学 信息科学与工程学院,辽宁 沈阳 110159)

针对动态场景中使用固定模板进行跟踪容易丢失目标的问题以及利用动态模型估计目标位置时产生的漂移问题,提出一种改进的基于偏最小二乘法的两阶段目标跟踪方法。该方法利用偏最小二乘分析法对在高维特征空间中搜集的正负样本降维,获得特征子空间构建目标表观模型集。跟踪在贝叶斯推理框架下进行:在初始跟踪阶段,利用粒子滤波原理及似然函数估计目标的初步位置;在校正阶段,采用一种适应性的基准模型确定最终的目标位置。对一些视频序列的实验结果证明了所提出方法的有效性。

目标跟踪;偏最小二乘法;粒子滤波;动态模型集;基准模型

目标跟踪在图像理解、人-机交互、智能监控、机器人学等方面有广泛的应用[1]。近年来,虽然人们已提出了大量的跟踪算法,但在跟踪过程中,由于受光照变化、遮挡、姿势改变及复杂背景等因素的影响,要设计一种鲁棒的跟踪算法仍是一项极具挑战的任务。目前已提出的算法根据其表观模型大体上分为两类:生成式模型跟踪算法和判别式模型跟踪算法。

生成式模型的跟踪方法首先学习一个外观模型来表示目标,然后搜索具有最大相似度的图像区域作为跟踪结果。Ross等[2]提出了一种增量视觉跟踪方法(IVT),该方法用一个低维的PCA子空间表示目标并假设误差项是高斯分布,用最小二乘法求解目标函数。尽管IVT方法对由光照变化和姿势改变引起的外观变化有效,但对一些具有挑战性因素(如部分遮挡和背景扰动)仍不能很好地跟踪。Adam等[3]用多碎片设计一个外观模型,该模型对于部分遮挡是强健的。最近,稀疏表示被引进到跟踪任务中[4],并且对部分遮挡、光照变化以及姿势改变显示了良好的效果。然而,生成式的方法丢弃了围绕目标区域的有用信息,而这些信息能够将目标更好地从背景中区分出来。

判别式模型的跟踪方法视跟踪为一个二进制分类问题,通过局部搜索在目标图像块和背景中估计决定边界。这些方法也称为基于检测的跟踪方法,即视跟踪为一项检测工作[5]。Grabner等[6]提出了在线Boosting特征选择方法。但是,此方法只使用一个正样本和多个负样本来更新分类器。如果当前分类器检测的目标位置不准确,抽取的正样本也将不准确,导致一个次优更新的分类器。这种累积的误差将严重地降低分类器的性能,最终导致跟踪失败(漂移)。多实例学习(MIL)跟踪器[7]将正负样本分别放入正负包,利用包相似函数在线训练分类器。该方法已被证明能很好地处理漂移问题。但是,该方法中使用的噪声或模型没有考虑正样本的重要性,因此,该跟踪器可能会选择一些效果较小的正样本。

为处理判别式的方法在跟踪阶段由于估计不准确导致目标漂移问题,本文加入校正,提出一种基于新的基准模型的两阶段跟踪方法。首先在运动目标所占据的区域和其周围的环境区域中,采用扰动由状态参数表示的图像的方法获得满足数量要求的正、负样本;再采用偏最小二乘回归方法进行降维,获得特征子空间用于构建基准模型和动态模型集;最后在两阶段的粒子滤波下进行跟踪:在初始跟踪阶段,采用一般的粒子滤波方法获得目标的估计位置;在校正阶段,将新的具有适应性的基准模型应用于该阶段,从而确定目标位置。通过对数个视频序列的实验以及与已有的两阶段粒子滤波方法[8-9]的比较验证了本文提出的方法具有良好的跟踪效果。

1 两阶段跟踪方法

1.1 偏最小二乘法降维

为了建立由各因素构成的数据矩阵X与由各目标构成的数据矩阵Y之间的关系,偏最小二乘方法(Partial Least Squares,PLS)[8]同时将X与Y作双线性分解,即

X=TPT+E

Y=UQT+F

(1)

式中:T∈RN×p,U∈RN×p是因素(得分、成分)矩阵;P∈Rm×p,Q∈Rn×p是载荷矩阵;E∈RN×m,F∈RN×n是误差项。通过求解优化问题:

(2)

式中

(3)

由于目标的外观在跟踪过程中很有可能是非线性且复杂的,因此一个线性的外观模型不能满足跟踪需要。同时,目标的外观模型又在时间上相关且有可能重复,因此,用多个外观模型表示目标。图1表明目标的观察在跟踪过程中可以分为多个集。

图1 目标外观在跟踪过程中的变化

1.2 粒子滤波采样

本文将目标跟踪当作一个动态的贝叶斯推理任务[12]进行,给定目标观察组x1:t={x1,x2,…,xt},目的是利用最大化后验估计来估计目标状态st,

(4)

(5)

式中,p(st|st-1)是描述连续帧间状态转移的运动模型,p(xt|st)是估计一个观察图像块属于目标类的观察模型。本文采用仿射运动模型,状态转移由随机漫步形成,例如p(st|st-1)=N(st;st-1,Σ),Σ表示仿射参数方差的对角协方差矩阵。动态似然函数由

p(xt|st)∝exp(-dt)

(6)

式中dt为样本xt到习得的模型A间的距离,

(7)

1.3 适应性的基准模板

在动态场景中,使用固定模板进行目标跟踪容易丢失目标,因为它没有考虑光照及姿势变化等因素引起的外观改变。然而,如果过于频繁地用新观察更新模板,错误有可能累积并且跟踪器将远离目标发生漂移。因此,为了更好地处理漂移问题,采用两阶段粒子滤波方法,在校正阶段不是以第一帧作为基准模板而是采用新的基准模板。

(8)

式中:A0在第一帧初始化;Ai为在线获取的动态模型,n根据动态模型集中模型的个数改变。从而采用两阶段进行跟踪:在第一阶段,利用粒子滤波原理在前一帧的目标位置周围随机产生600个粒子并利用公式(7)分别计算其到习得的动态模型集的距离,选出距离最小的作为当前帧的初步估计目标位置,至此获得的位置可能有点不准确但接近准确的目标位置;在校正阶段,再次利用粒子滤波原理在第一步获得的初步估计目标位置周围随机产生600个粒子,利用公式(6)和(7)计算其到定义的适应性基准模型A0′的距离,选出似然函数值最大的即为当前帧的最终目标位置[13]。

使用该基准模型,不仅与第一帧作了比较,也与在线获取的动态模型比较,使校正阶段的基准模板具有适应性从而提高了跟踪的准确性,进一步减轻了目标漂移问题。

1.4 跟踪算法

(1) 输入:图像帧F1,…,FN.

(2) 当t=1时手动标定目标区域,搜集正负样本并计算外观模型A0;当t≠1时,阶段1:利用粒子滤波原理在前一帧的跟踪结果st-1周围随机产生粒子,选出距离最小的作为初始估计的目标位置st;阶段2:再次使用粒子滤波原理及初步估计的跟踪结果st与基准模型,选出似然函数值最大的作为最终的跟踪结果st。

(3) 使用当前获得的跟踪结果更新动态的外观模型。

(4) 输出:第t帧的跟踪结果st并用矩形框显示目标。

2 实验结果及分析

图2 操作界面示意图

图3 David-indoor视频序列的跟踪结果

图4 CocaCola视频序列的跟踪结果

图5 Trellis视频序列的跟踪结果

图6 Boy视频序列的跟踪结果

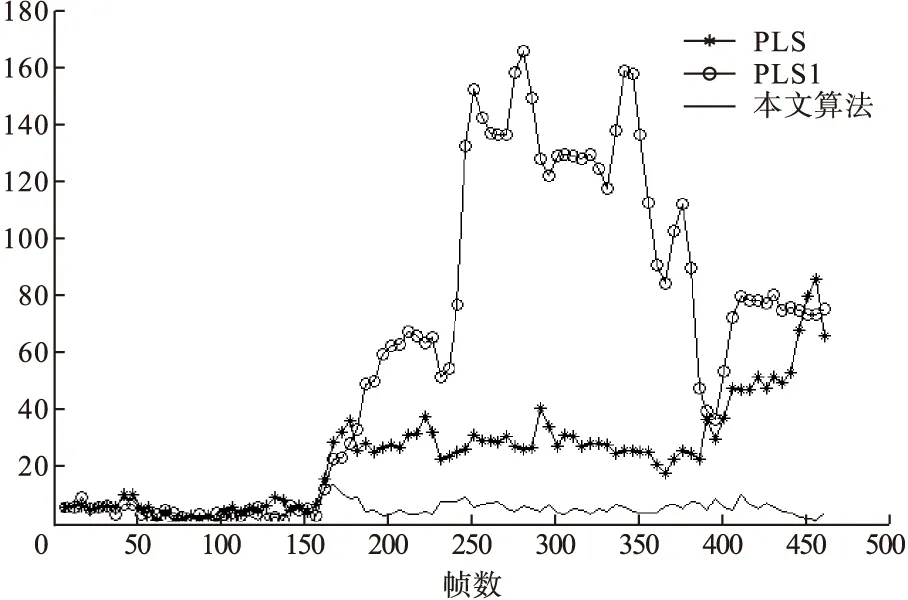

图7 David-indoor序列的中心位置差曲线图

图8 CocaCola序列的中心位置差曲线图

图9 Trellis序列的中心位置差曲线图

图10 Boy序列的中心位置差曲线图

表1 平均中心误差(像素)

光照及姿势变化:在David-indoor及Trellis中,见图3、图5,对视频序列中的人进行跟踪,并且目标均有很大的光照及姿势变化。PLS方法虽然在David-indoor视频序列中出现了目标跟丢的情况,但整体跟踪效果较好。但在Trellis视频跟踪中,其误差曲线图9在100帧以后将目标丢失了。如图5中,Trellis的第151帧出现了偏差,在第200、280、380、515中丢失跟踪目标。分析原因,是由于目标受光照,尺度及姿势发生巨大变化时,仅仅用第一帧作为基准模型远远不能满足跟踪需要,因此出现了目标丢失情形。

旋转及突然运动:PLS1是单阶段的跟踪算法,通过观察图7、8、9和10,表明两阶段的跟踪算法比单阶段的跟踪效果更好,更稳定。因为单阶段的只在线学习一个外观模型从而更容易跟丢目标,特别是对于如图4的CocaCola序列,对该序列中的物进行跟踪时目标发生旋转以及如图6的Boy序列,对该序列中的人进行跟踪时目标突然运动的情况,很容易产生不理想的外观模型,从而导致错误累积。从图7、8、9、10可以看出,PLS1的跟踪误差常常出现较大波动。

本算法采用适应性的基准模型,使跟踪更具在线学习性。即使目标受光照、尺度及姿势发生巨大变化时,仍能稳定地跟踪目标。在David-indoor视频序列中本算法仍能很好地跟踪,即作为基准的模板既利用了第一帧的静态模型,又利用了动态模型集从而使新的基准模板更具有适应性。表1表明在校正阶段采用适应性的基准模板的跟踪方法具有更好的跟踪效果。

表2 目标位置的部分坐标

注:与原始位置最接近的用粗体表示.

3 结论

提出了一种改进的两阶段跟踪方法。在校正阶段,提出了适应性的基准模型,将第一帧的模型和选入动态模型集中的模型的均值作为新的基准模型,使基准模板具有适应性,从而更好地对跟踪阶段的初步跟踪结果进行校正。对不同视频序列的目标跟踪结果表明,本文算法进一步解决了目标漂移问题,比PLS的跟踪稳定性有所提高。

[1]A.Yilmaz,O.Javed,M.Shah.Object tracking:A survey [J].ACM Computing Surveys (CSUR),2006,38(4):13.

[2]D.Ross,J.Lim,R.Lin,et al.Incremental learning for robust visual tracking [J].International Journal of Computer Vision,2008,77(1-3):125-141.

[3]A.Adam,E.Rivlin,I.Shimshoni.Robust fragments-based tracking using the integral histogram[C].CVPR,2006 IEEE Computer Society Conference on.IEEE,2006:798-805.

[4]X.Mei,H.Ling.Robust visual tracking using l1 minimization[C].Computer Vision,2009 IEEE 12th International Conference on.IEEE,2009:1436-1443.

[5]张谢华,路梅,田敏.基于支持向量机的目标跟踪研究[J].计算机工程与设计,2011,32(12):4210-4212.

[6]H.Grabner,M.Grabner,H.Bischof.Real-time tracking via on-line boosting[C].BMVC,2006:6.

[7]B.Babenko,M.Yang,S.Belongie.Robust object tracking with online multiple instance learning [J].Pattern Analysis and Machine Intelligence,IEEE Transactions on,2011,33(8):1619-1632.

[8]Qing Wang,Feng Chen,Wenli Xu,et al.Object Tracking via Partial Least Squares Analysis [J].Image Processing,IEEE Transactions on,2012,21(10):4454-4465.

[9]Qing Wang,Feng Chen,Wenli Xu,et al.Online Discriminative Object Tracking with Local Sparse Representation[C].Applications of Computer Vision(WACV),2012 IEEE Workshop on.IEEE,2012:425-432.

[10]X.Li,W.Hu,Z.Zhang,et al.Robust visual tracking based on incremental tensor subspace learning[C].Computer Vision,2007.ICCV 2007.IEEE 11th International Conference on.IEEE,2007:1-8.

[11]R.S.Lin,D.A.Ross,J.Lim,et al.Adaptive discriminative generative model and its applications[C].Advances in neural information processing systems,2004:801-808.

[12]Dong Wang,Huchuan Lu,Ming-Hsuan Yang.Least Soft-thresold Squares Tracking [C].CVPR,2013 IEEE Conference on.IEEE,2013:2373-2375.

[13]Kaihua Zhang,Lei Zhang,Ming-Hsuan Yang.Fast compressive tracking [J].Pattern Analysis and Machine Intelligence,IEEE Transactions on,2014,36(10):2002-2015.

[14]冈萨雷斯.数字图像处理(MATLAB版)[M].北京:电子工业出版社,2009.

(责任编辑:马金发)

An Improved Two-phase Object Tracking Method

WANG Jing,WANG Yan,YANG Dawei

(Shenyang Ligong University,Shenyang 110159,China)

To solve the problem that tracking with fixed templates is prone to fail in dynamic scenes and alleviate the visual drift problem caused by using dynamic models to estimate the target position in object tracking,an improved two-phase object tracking is proposed by partial least squares method.A low-dimensional feature subspace is studied with a few positive and negative samples in the high-dimensional feature space via partial least squares(PLS) analysis,which constructs an appearance model.Object tracking is carried out within the Bayesian inference framework:in the initial tracking phase,the preliminary estimation of object location is achieved by particle filter principle;in calibrating phase,the adaptive benchmark model is adopted to determine the final target location.Experimental results on some video sequences show the proposed method effectiveness.

object tracking;partial least squares(PLS);particle filter;dynamic model;benchmark model

2014-07-08

沈阳市科技创新专项基金资助项目(F13-316-1-73)

王静(1989—),女,硕士研究生;通讯作者:王琰(1962—),女,教授,博士,研究方向:计算机图形学,虚拟现实技术,图像处理技术.

1003-1251(2015)02-0016-07

TP391.41

A