基于肤色和器官定位的实时人脸检测*

2014-09-14黄禹馨张洪斌

黄禹馨,黄 山,,张洪斌

(1.四川大学电气信息学院,四川 成都 610065;2.四川大学计算机学院,四川 成都 610065)

基于肤色和器官定位的实时人脸检测*

黄禹馨1,黄 山1,2,张洪斌2

(1.四川大学电气信息学院,四川 成都 610065;2.四川大学计算机学院,四川 成都 610065)

基于肤色和器官的人脸检测是视觉监控领域中广泛应用的经典方法,但是辨别每个肤色像素和提取候选区域非常耗时且对噪声敏感,很多时候不能满足实时人脸检测的需要。通过引入肤色单元的概念,提高了该方法的快速性和鲁棒性,最终将其应用于实时视频序列中。首先,采用单元化的方法进行肤色分割,提取出人的肤色部分;接着,根据人脸长宽比例的范围,确定出候选人脸;然后,再对候选人脸区域分别进行眼睛和嘴巴的定位;对眼睛和嘴巴定位之后,我们可以利用眼睛和嘴巴呈倒三角关系的几何特征反过来进行人脸的精确定位。实验结果表明,该方法的识别率较高,并能满足实时视频人脸检测的快速性要求。

人脸检测;肤色分割;器官定位;几何特征

1 引言

人脸检测作为计算机视觉领域的一个热点研究问题,是人脸识别的前期工作,直接影响整个系统的性能和效率。近年来,随着安全监控、自动跟踪等领域的快速发展,人们不再满足于对单幅图片的人脸检测和识别,而转向了对实时视频中的人脸检测和识别,由此对系统的实时性提出了更高的要求。

目前人脸检测的主要方法有:基于AdaBoost的方法、基于神经网络的方法、基于色彩信息的方法和基于器官特征的方法等。然而前两种方法均需要通过冗长而复杂的训练过程才能达到人脸检测的目的,而基于色彩信息和器官特征这两种方法相对来说更简单易行,能更好地满足实际应用中的实时性要求。Hsu R等人[1]对基于肤色的人脸检测方面已经做了大量的研究。本文主要是在文献[1]的基础上引入肤色单元的概念,提高了该方法的快速性和鲁棒性,并结合了文献[2,3]中的器官定位方法来保证人脸检测精度,从而使之可以运用于实时视频的检测。

2 实时视频中快速人脸检测方法

2.1 人脸的颜色空间

经过对不同民族、不同种族的肤色研究发现,人的肤色在颜色空间上有聚类性,通过这种聚类性可以将人的肤色和其他物体区别出来。目前文献中常用的人脸颜色空间主要有:RGB(Red-Green-Blue)颜色空间、YIQ颜色空间[4]、HSV(Hue-Saturation-Value)颜色空间、HSI(Hue-Saturation-Intensity)颜色模型和YUV(YCbCr)颜色模型等。本文选取RGB颜色模型进行肤色检测。RGB颜色模型基于多媒体和摄像机中应用最广泛的RGB颜色空间。RGB颜色空间的红绿蓝三个变量之间是相互独立的,其混合叠加后能共同表示现实中的几乎任何颜色,通过线性变化,RGB颜色空间可以直接转化为灰度图。灰度图转换表达式如式(1)所示:

Gray=0.299×R+0.587×G+0.114×B

(1)

然而,在RGB颜色模型中,物体如果受到不同的光照,那么这个点表现出的三色值将受到较大影响,但其表达式的颜色不变。为了解决这个问题,我们引入了RGB颜色模型。RGB颜色模型又叫归一化的RGB颜色模型。RGB颜色模型三分量是RGB颜色模型中各个分量(R、G、B分量)占它们三者之和(R+G+B)的比例,其转换公式为:

(2)

由上式可以看出,经过转换,r+g+b=1总是成立,如果我们只考虑r和g的值不考虑b的值,这就相当于将三维的RGB空间转换成了二维的r-g空间。由于RGB模型是各个颜色分量的比例,和亮度信息没有关系,所以该模型可以克服亮度对肤色的影响。McKenna等人曾在(r,g)空间中对40个人(这40个人来自不同的民族)的肤色分布进行分析;Soriano等人对白种人和黄种人的肤色分布情况进行研究得出的结论是:不同人种的人脸肤色在不同光照的条件下在(r,g)空间的分布具有一致性。所以,本文采用了Soriano等人提出的肤色描述方法[5]进行肤色空间描述,即:

G+=amr2+bmr+cm,

(3)

其中,r应当满足一定的范围来进行条件约束;并且,当r和g都等于0.33时会出现白色像素点,需要剔除,即:

(4)

在满足式(3)和式(4)的前提下,如果满足下式条件,则判断此像素点为肤色点:

(5)

对于肤色像素,我们将其标记为1,非肤色像素我们将其标记为0。肤色图像掩膜的数学表达式如下:

(6)

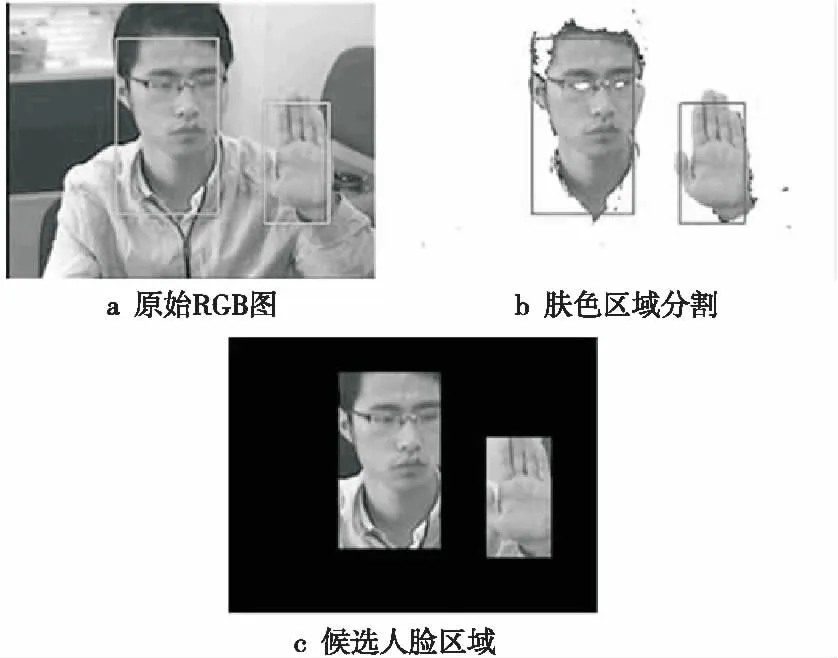

图1为实际的肤色像素分类图。其中,图1a为原始RGB图,图1b为经过归一化的RGB肤色检测后的效果图。

Figure 1 Color space pixel calibration图1 颜色空间像素标定

2.2 肤色区域分割

2.2.1 肤色单元

在RGB颜色空间中进行肤色分类得到的肤色区域是以像素点为单位的。在接下来的连通域检测[6]中,为了节省时间,并提高其鲁棒性,我们引入了肤色单元概念进行处理。

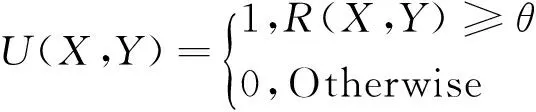

假设,一幅图像I(x,y)的大小为M*N,我们可以将这幅图像均等地分为P*Q个大小为m*n的基本单元U(X,Y)。P=M/m,Q=N/n。根据基本单元U(X,Y)内肤色像素点和基本单元内总像素点的比例,将基本单元分为肤色单元和非肤色单元。

(7)

其中,R(X,Y)为第(X,Y)个基本单元内肤色像素点和总像素点的比例,如果这个值大于某个阈值θ,我们就将U(X,Y)标记为肤色单元;否则为非肤色单元,表达式如下:

(8)

原始图像的大小为320*240,我们将其分割成40*30(1 200)个大小为8*8的基本单元。也就是将传统算法中的76 800个像素点的连通域检测变成了对1 200个肤色单元的连通域检测。大大缩小了计算时间。

由图2我们可以看出,传统肤色提取方法对噪声非常敏感。而引入了肤色单元后,其鲁棒性得到了显著的改善。

Figure 2 Comparison of robustness between traditional algorithm and the unitized color extraction algorithm 图2 传统算法与单元化肤色提取算法鲁棒性的对比

单元化的肤色提取方法不仅改善了原来算法的鲁棒性,在快速性方面也有很大的提升。我们使用了100幅图像对传统算法和改进后的算法分别进行测试,结果如表1所示。表格中只抽取了这100幅图像中的前4组数据进行比较,经过改进后的算法的搜索时间大大缩短,平均搜索时间比未改进前快了210.15倍。

2.2.2 候选人脸

在对人脸进行肤色单元标定之后,我们就可以使用连通域方法[6]从肤色区域中提取出候选人脸

Table 1 Comparison of search time between

区域。人脸的形状接近于矩形和椭圆形,但是,使用椭圆比外接矩形耗时,而且在确定真正的人脸之前就使用椭圆进行人脸提取没有实际的意义。因此,我们选用外接矩形去逼近人脸进行人脸的提取。我们知道,人脸的长宽是有一定的比例范围的,本文选取外接矩形的长宽比为:

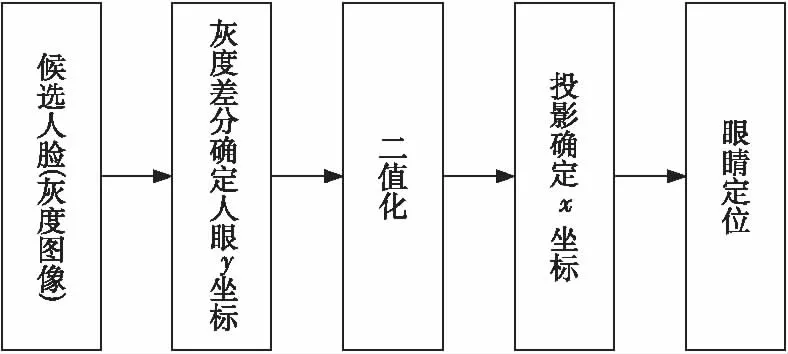

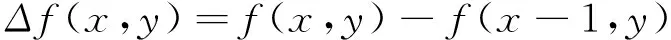

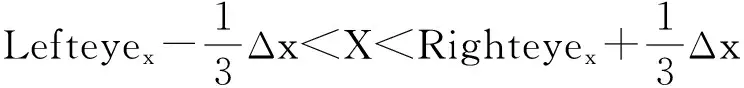

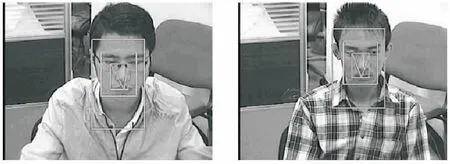

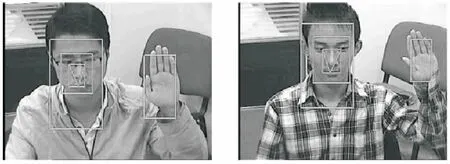

0.5 (9) 经过连通域方法对肤色区域进行提取,然后利用人脸的长宽比例对连通域方法提取的矩形进行初步判断。初步选定的候选人脸图如图3所示。 Figure 3 Candidates face图3 候选人脸 文献[7]中对候选人脸的选取采用投影法,即将图3c图分别进行横轴和纵轴的投影,然后确定联通域。显然本文采用的方法比文献[7]采用的方法要简单、快速、省时。 2.3 器官定位 检测出候选人脸之后,可以利用面部器官的位置、比例关系反过来进行人脸的精确定位。本文利用人脸面部的眼睛和嘴巴呈倒三角关系的几何特征来进行人脸的精确定位,同时滤除非人脸区域。 2.3.1 眼睛定位 在人的面部器官中,人的眼睛是主要器官之一,也是非常重要的面部特征。因此,实现眼睛的精确定位对人脸面部器官特征的提取和人脸的精确检测有着非常重要的意义。目前常用的人眼定位方法主要有以下几种:模板匹配的方法、基于广义对称变换的方法、边缘检测方法、基于灰度投影的方法等。 上述方法中,前三种方法计算复杂、运算量大、对计算机性能要求较高且不利于实时视频的处理。第四种方法计算简单,但是该种方法容易受到服饰和周围环境的影响。因此,我们对该种方法进行了一些改进。改进算法的具体流程如图4所示。 Figure 4 Flow chart of eyes position 图4 眼睛定位流程图 (1)y坐标的确定。 由于人眼周围颜色和明暗变化丰富,而面部其他部分则不具有这个特征,所以我们可以对灰度的变化进行微分,在眼睛部分必然产生一个绝对值较大的值,然后将这些值累加,结果最大的那一行便为眼睛的y坐标。在数字图像处理中,我们用差分代替微分,运算如下: (10) (11) 通过D(x,y)的最大值确定y坐标,继而确定候选眼睛区域。 由于候选人脸的定位是采用外接矩形进行描述的,因此会存在脖子部分有衣服等其他非肤色干扰因素的存在。这些非肤色区域也可能存在较丰富的灰度变化,这给眼睛y坐标的定位带来了一定的干扰。针对这一问题,我们进行了一定的改进:根据人脸的比例,我们将微分操作限制在图像的上半部分,即在图像的1/2~2/3以上部分;同时,将图片分成左右两部分分别进行y坐标的确定。这样就避免了其他非肤色区域的干扰。获得y坐标后,分别将y+a和y-a部分作为眼睛的候选区域。 (2)x坐标定位。 人的眼睛构成部分有白色和黑色,根据这一点可以进行眼睛x坐标的判断。在获取了眼睛y坐标之后,我们将候选眼睛区域进行二值化,获取二值化的眼睛图像;然后将二值化的图像向x轴做投影,这样便可以获取两个波峰。这两个波峰分别为左、右两个眼睛的x坐标。 Figure 5 Results of eyes position图5 眼睛定位结果 2.3.2 嘴巴定位 在人脸中,嘴巴是除了眼睛之外的另外一个重要器官和重要面部特征。利用嘴巴和眼睛的三角关系以及人脸的比例结构可以进行人脸的精确定位。嘴巴的颜色相对于肤色而言颜色较深且偏红,其他器官的颜色没有这一特性,因此可以利用RGB颜色空间进行嘴巴的定位。 根据人脸的比例关系和前面已经确定的左、右眼位置,我们可以大致确定嘴巴X和Y坐标的搜索范围: AEyey-2.3×Δx Δx=Righteyex-Lefteyex, AEyey=(Lefteyey+Righteyey)/2 (12) YangJie等人[7]根据RGB三分量提出了唇色模型: (13) 若θ<0.2,则认为此点为嘴巴。利用这一唇色模型,加上我们规定的搜索范围,可以在彩色图上进行嘴唇位置的判断。获得了左、右眼和嘴巴的位置,就可以根据三角关系进行人脸的精确定位。左、右眼和嘴巴的三角关系图如图6所示。 Figure 6 Eyes and mouth position图6 眼睛和嘴巴定位 在图6b中,经过上一小节候选人脸的判断后,将手掌部分判定为候选人脸,在候选人脸部分进行眼睛和嘴巴等器官的定位后系统确定手掌区域内部没有眼睛、嘴巴等器官,也不存在眼睛嘴巴的三角关系,因此判断出手掌区域不是人脸区域。在系统中,定位到人脸面部器官后,用直线将左眼、右眼以及嘴巴部分连接起来。 本文实验中使用的计算机的配置为:Intel Pentium(R)E5300 2.6 GHz CPU;Kingston DDR 2 GB内存。操作系统为Windows XP,实验平台为VS2010。摄像机采用SHEPER彩色摄像机,以PAL制信号输出。视频采集卡采用天敏公司的SDK2500监控卡,获取到的图片为320*240的24 Bit的真彩色RGB图,采集帧率为25帧/s。 3.1 人脸检测结果 单人人脸检测效果如图7所示,经过多次实验,本文的方法能实时地进行单个人脸的检测,且检测率较高。 Figure 7 Results of face detection 图7 人脸检测结果 3.2 干扰检测 由图8可见,本文的算法排除了与人脸同样具有大面积肤色连通域且长宽比相近的手掌的干扰,成功地检测出了人脸的位置。并且本次实验中有一位图片提供者一直佩戴眼镜参与实验,所以本文的检测方法对佩戴简单饰物者仍然适用。 Figure 8 Palm interference experiments图8 手掌干扰实验 3.3 实验数据分析 用本文方法对200幅实时正面人脸进行检测,得出本文方法的检测平均帧率为21,正确检测数为191,错误检测数为9,正确率为95.5%。 本文提出了一种实时视频中的快速人脸检测方法,采用肤色分割和器官检测来确定人脸的位置。通过引入肤色单元的概念来提高人脸定位的快速性和鲁棒性。实验结果表明了该方法的效果。如何进行多人脸的同时有效定位和对不同人种肤色人脸的检测将是下一步研究的主要方向。 [1] Hus R L,Abdel-Mottalab M,Jain A K.Face detection in color images[J]. PAMI, 2002,24(5):696-706. [2] Sheng Xian, Huang Shan,Zhou He. Application and simulation of eye location based on improved projection algorithm[J]. Computer Simulation, 2011,28(11):311-314.(in Chinese) [3] Yang Jie,Alex W.A real-time face tracker[C]∥Proc of WACV’ 96, 1996:142-147. [4] Hu Xiao-yan. The study of algorithms about face detection based on complexion[D]. Chengdu:Sichuan University, 2004.(in Chinese) [5] Soriano M, Martinkauppi B, Huovinen S, et al. Using the skin locus to cope with changing illumination conditions in color-based face tracking[C]∥Proc of IEEE Nordic Signal Processing Symposium,2000:383-386. [6] Yang Shu-ying. VC++ image processing program design [M]. 2nd edition. Beijing:Tsinghua University Press, 2003. (in Chinese) [7] Du Ping, Zhang Yan-kun, Liu Chong-qing. Institute of image processing and pattern recognition[J]. Computer Simulation, 2003,20(2):117-119. (in Chinese) 附中文参考文献: [2] 盛贤,黄山,周何. 改进的投影算法在人眼定位中的应用与仿真[J]. 计算机仿真,2011,28(11):311-314. [4] 胡小燕. 基于肤色的人脸检测算法的研究[D]. 成都:四川大学, 2004. [6] 杨淑莹.VC++图像处理程序设计(第二版)[M].北京:清华大学出版社,2003. [7] 杜平,张燕昆,刘重庆. 基于广义对称变换的人脸检测和面部特征提取[J]. 计算机仿真, 2003,20(2):117-119. HUANGYu-xin,born in 1989,MS candidate,his research interest includes image recognition and processing. Real-timefacedetectionbasedoncomplexionandorganslocation HUANG Yu-xin1,HUANG Shan1,2,ZHANG Hong-bin2 (1.School of Electrical Engineering and Information,Sichuan University,Chengdu 610065;2.School of Computer Science,Sichuan University,Chengdu 610065,China) Face detection based on complexion and organs location is one of the classical methods widely used in the field of visual monitoring,but discriminating each complexion pixel and extracting candidate areas are very time consuming and noise sensitive, which often cannot meet the requirements of real-time face detection. The concept of skin cells is introduced to improve the speed and robustness of the processing and applied to real-time video sequence. Firstly, complexion-like regions are extracted by classifying color skin units. Secondly,candidate face region are filtered with aspect ratio of the regions. Finally,real face regions are well located by utilizing the geometrical features of eyes and mouth and their inverted triangle relation.The experimental results show that this method has high detection accuracy and satisfies the requirements of real-time face detection. face detection;complexion segmentation;organ location;geometrical feature 1007-130X(2014)05-0936-05 2012-10-12; :2013-02-25 TP317. 4 :A 10.3969/j.issn.1007-130X.2014.05.025 黄禹馨(1989-),男,江苏苏州人,硕士生,研究方向为图像识别与处理。E-mail:772448597@qq.com 通信地址:610065 四川省成都市四川大学望江校区基础教学楼B217 Address:Room B217,Basic Teaching Building,Wangjiang Campus,Sichuan University,Chengdu 610065,Sichuan,P.R.China

3 实验结果与分析

4 结束语