基于稀疏自编码深度神经网络的林火图像分类

2014-08-05赵俭辉章登义

王 勇,赵俭辉,2,章登义,2,叶 威

1.武汉大学 计算机学院,武汉 430072

2.武汉大学苏州研究院,江苏 苏州 215123

基于稀疏自编码深度神经网络的林火图像分类

王 勇1,赵俭辉1,2,章登义1,2,叶 威1

1.武汉大学 计算机学院,武汉 430072

2.武汉大学苏州研究院,江苏 苏州 215123

1 引言

森林火灾对人类森林资源构成严重危害。目前,现存的火灾检测系统大部分是用光感或温感等传感器来检测森林火灾,但利用视频图像处理技术来识别真实林火场景中火焰方面的研究与应用也越来越常见。林区烟火的视觉特征主要包括颜色特征、形状特征、纹理特征、空间关系特征等[1-2]。上述类别特征的提取常需借助一定的数学工具如拉普拉斯算子、傅里叶变换、灰度共生矩阵、隐马尔科夫模型、LBP算子、离散小波分析等[3-4]。靳琪琳和段锁林[5]基于神经网络,采用逐级判断和分析,提出一种多特征融合算法来识别室内火焰。马宗方等[6]提取了火灾图像的面积重叠率、圆形度以及火焰尖角数目三个特征量,选择SVM进行分类器训练,最终利用训练好的分类器实现了火焰及干扰物体的分类识别问题。Ko等[7]提出一种基于亮度地图和SVM从视频序列中获得可靠火灾检测结果算法。贾洁等[8]针对SVM在数据量很大时求解时间过长的问题,提出一种基于最小二乘支持向量机的视频火灾烟雾识别算法。Khashei等[9]提出一种结合人工神经网络模型和多元线性回归模型的新分类模型。Yuan[10]训练神经网络分类器用来区分烟和非烟目标。黄儒乐等[11]探索了支持向量机(SVM)方法解决由脉冲耦合神经网络(PCNN)提取的林火烟雾图像特征后的计算机视觉模式识别问题。但是,上述火焰识别算法一方面训练过程均是采用有监督的特征学习,对数据集的泛化能力不是很好;另一反面,与火焰颜色、形状、纹理等视觉特征均相近的物体对林火识别干扰较大,导致识别率较低。近年来,机器学习领域中深度学习技术已逐步应用到图像处理中,深度学习可通过学习一种深层非线性网络结构,实现复杂函数逼近,表征输入数据分布式表示,并展现了强大的从少数样本集中学习数据集本质特征的能力[12]。胡昭华等[13]提出一种用连续自编码神经网络来实现非线性降维的方法。Le等[14]从无标签数据中利用稀疏自编码算法建立高层次的人脸特征检测器。Coates等[15]通过实验表明深度神经网络模型中隐藏层神经元数量可能比特征学习算法(如稀疏自编码、稀疏受限波兹曼机等)以及模型深度更加重要。因此,本文采用无监督特征学习算法稀疏自编码来构建深度神经网络,并采用ZCA白化技术来做数据预处理和显示学习到的特征,用softmax回归训练多分类的分类器。

2 本文算法

针对林火图像及与火焰特征相近的其他图像的分类应用,本文算法大致可分为以下4个步骤(2.1节~2.5节)。首先,在2.1节介绍与展示用于本文算法的数据集;然后,2.2节介绍用于特征学习的稀疏自编码详细算法过程;紧接着,2.3节介绍用于数据预处理和可视化学习到特征的ZCA白化技术;接下来,2.4节详细介绍了用2.2节生成的稀疏自编码深度神经网络从有标签训练集图像中提取特征,并卷积和池化上述特征得到池化后特征,最后,2.5节介绍用池化后特征训练softmax多分类器。从而得到最终的softmax分类器。

2.1 数据集

为了区分出林火和与火焰特征相近物体,本文选取红旗和红叶作为与火焰特征相近的代表性物体类别。从Internet上选取火焰图片371张,红旗图片171张,红叶图片190张,部分图片如图1所示。将上述三种类别图片共732张分为三个子数据集,如表1所示。

图1 三个类别部分图片集

表1 三个数据集

其中,无标签图片集用于无监督的特征学习,学习三个类别图片数据间相关性,建立稀疏自编码深度神经网络;有标签训练集用于接下来的softmax分类器的训练;有标签测试集用于测试该深度神经网络的图像分类准确率。

2.2 特征学习算法

自编码神经网络是一种无监督的学习算法,它让样本的输出值等于输入值。如果神经网络的隐藏层神经元个数远小于输入层和输出层,这样就迫使自编码神经网络去学习输入数据的压缩表示,假设神经网络输入数据是完全随机的数据,那么,要学习这些随机数据的压缩表示是十分困难的;但是如果输入数据间隐含有某些有联系的特定结构,如某些输入特征间是彼此相关的,那么,自编码算法就能发现这些有联系数据间的相关性,并在输出层重构出输入数据。相反,如果神经网络的隐藏层神经元个数较多或与输入输出层相当时,还可以对隐藏层神经元加上稀疏性限制,这样自编码神经网络仍然能发掘出输入数据间的相关性。如一幅大小100×100灰度图像,自编码神经网络的输入向量 x∈R10000为图像中10 000个像素点的灰度值,采用稀疏自编码神经网络处理后,能够发掘出图像中像素灰度值数据间的相关性。

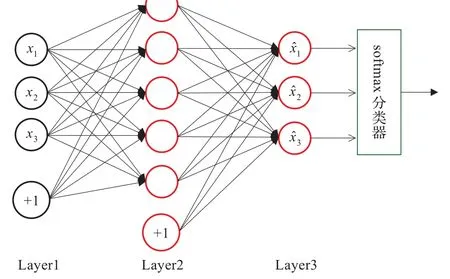

假设神经元的激活函数为sigmoid函数,当神经元的输出接近1时认为该神经元处于激活状态;反之,当神经元的输出接近0时认为该神经元处于抑制状态。因此,对神经网络稀疏性限制是指限制神经元绝大多数时间处于抑制状态。如图2所示,这是一种典型的自编码神经网络,包括输入层layer1(3个神经元,即x1、x2、x3),隐藏层layer2(5个神经元)和输出层layer3(3个神经元,即)。其中,+1为偏置项(截距项)系数。

图2 自编码神经网络与softmax分类器

其中,Sl是第l层的神经元总数。

在自编码神经网络中,仍然采用BP算法并让无标签输入样本与输出结果目标相等,即 yi=xi,则无标签的样本集表示为{x1,x2,…,xi,…,xm},1≤i≤m(m为无标签样本数量)。用a(j2)(xi)表示第i组样本输入xi情况下隐藏层第 j个神经元的输出值,则隐藏层(l=2)中第j个神经元的平均激活值为:

其中,nl为自编码神经网络层数;λ是规则化系数;hw,b(xi)是第i组样本神经网络输出层的输出值;β是控制稀疏性限制惩罚项的系数。公式(3)中由三部分的和组成,其中,第一部分是均方差项,第二部分是规则化项,最后一部分是惩罚项,该项是惩罚那些和ρ显著不同的情况以实现对该神经网络的稀疏性限制。 KL()是与 ρ间的相对熵,相对熵是一种常用的测量两个分布间差异的方法。相对熵为凸函数,在设定 ρ=ρ0情况下,存在唯一的极小值且在=ρ0处取得。KL计算公式如下:

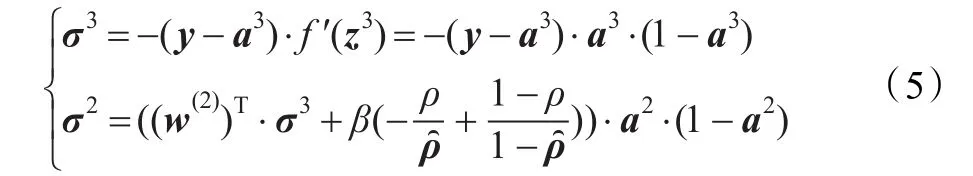

公式(3)中的代价目标函数的前两部分为非凸函数,对它的求解通常使用的是迭代法,如批量梯度下降法、牛顿法和LBFGS等。根据BP算法,该自编码神经网络(激活函数采用sigmoid函数)各层残差向量形式计算如下:

当采用线性解码时,输出层的输出值不必经过sigmoid函数处理,即 a3=z3,a3·(1-a3)=1,则 σ3=-(y-a3)。该深度神经网络权重向量和偏置项向量的梯度下降方向为:

图3 稀疏自编码学习到的特征

其中,l=1,2。这样就确定w和b的迭代规则,待迭代算法收敛或达到最大迭代次数,隐藏单元就获得了学习好的特征,即训练好了稀疏自编码深度神经网络的权值向量w和偏置向量b。如图3所示,是400个隐藏神经元训练后对应的特征在可视化后的结果,分为20行20列显示,每个特征表示所对应的隐藏单元学会了在图像的不同位置和方向进行边缘检测。

2.3 ZCA白化

与主成分分析(Priciple Components Analysis,PCA)类似,ZCA也是一种有利于提高无监督特征学习算法速度的数据降维技术。白化(Whitening)是为了降低输入图像像素间相关联度,是很多算法进行预处理的步骤。ZCA白化在本文中主要有两个应用:对无标记样本数据进行预处理和可视化学习到的特征。对数据的预处理中,首先,对样本数据的特征维(本文中的特征维数具体指输入层神经元个数)进行零均值化,用样本数据每一维减去该维平均值得到 xi,并归一化样本数据到[0,1]范围内。Σ实际上是训练样本的协方差矩阵,然后,对Σ作奇异值分解得到特征向量U和特征值对角矩阵S,其中,U= [u1u2… un],u1是协方差矩阵 Σ的主特征向量,u2是协方差矩阵Σ的次特征向量,依次类推,un是最次特征向量,这些特征向量构成了新的维度坐标下的一组向量基。则维度转换后的新的样本数据为xrot=UT·x,显然xrot中各维间相互独立,若将xrot除以标准差得到各维方差为1,从而满足白化的均值接近于0、方差相等两个必要条件,最终的ZCA白化数学公式如下:

其中,ε是ZCA白化参数,通常取0.01~0.1之间。最后可视化学习到的特征,看是否学习到好的特征,若不是则需调节ε,从而改变数据的预处理,直到得到较好的特征为止。较好的特征图像中含有丰富的边缘信息等。

2.4 卷积与池化

2.2节介绍了稀疏自编码神经网络,它的输入层和隐藏层神经元间是全连接的。它适用于低分辨率的图像,如MNIST手写体数据集(分辨率28×28)。但对于分辨率较高图像,如图像大小100×100,若要从中提取出100个特征,则该稀疏自编码神经网络有106个参数需要学习,这样网络训练时间会大大延长。对于一幅自然图像,图像局部范围内的统计特征与其他部分的相似,因此没必要让输入层和隐藏层神经元间全连接,为了减少由于高分辨率图像带来的神经网络模型参数过多的问题,卷积操作被应用进来,从而实现局部连接网络,局部连接网络的基本思想是基于人大脑视觉皮层神经元仅响应某些局部区域的刺激,局部连接神经网络只允许隐含层神经元与部分输入层神经元连接。具体地,可以先从大图像(Dimage×Dimage)中用一个大小为Dpatch×Dpatch的小块学习特征,这可以用稀疏自编码神经网络训练完成,然后对训练图像用前面学习到的特征参数依次进行卷积运算提取训练集图像的各个特征,设卷积运算的步长为1,则卷积特征图像大小为(Dimage-Dpatch+1)× (Dimage-Dpatch+1)。最终,用学习到的特征参数对2.1节中有标签训练集和测试集图像卷积得到卷积后特征图像。

虽然卷积操作可以减小神经网络需要训练的参数个数,大大简化特征提取过程,但是,正是由于卷积操作,会随之带来卷积后输出向量维数过大的问题,假设隐藏层神经元数量为HiddenSize,那么,卷积特征图像的维数为 (Dimage-Dpatch+1)×(Dimage-Dpatch+1)×HiddenSize,这样会大大增加后续softmax分类器设计的困难。因此,池化技术引入到了对卷积后特征的处理中。

池化分为最大值池化和均值池化。池化是利用自然图像中局部区域统计特征来实现特征降维效果,而且能防止出现过拟合。如用池化小方块Dpooling×Dpooling对其范围内图像像素值取平均值(最大值)得到一个像素值,称为均值(最大值)池化。池化具有平移不变性,本文中池化操作与卷积操作的一个重要区别是图像池化是作用于不重复的区域内,即池化步长为Dpooling。

2.5 Softmax回归

与logistic回归解决的是二分类问题相对应,softmax回归解决的是多分类问题,softmax回归是logistic回归的一种扩展。假设有标签样本集为(x′1,y′1),(x′2,y′2),…,(x′i,y′i),…,(x′m,y′m),1≤i≤m,logistic回归的类标签 y′i∈{0,1},softmax回归的类标签属于 y′i∈{0,1,…,k},这里的k指分类类别数量,本文实验中取k=3,即林火、红旗和红叶3个类别。用于训练softmax回归模型的样本集是指用2.1节有标签训练集池化后的特征。通过向softmax回归模型代价函数中加入规则化权重衰减项后,新的代价函数为凸函数,存在唯一的极小值。因此,可用2.1节求解稀疏自编码特征学习算法代价函数最小值时用到的一些迭代算法,如批量梯度下降、牛顿法、LBFGS等得到全局最优解。最后,待迭代算法完成后便得到了训练好的softmax多分类器。最后,测量softmax分类器图像分类的准确度,对于2.1节有标签测试集,先用2.4节提取卷积特征并池化得到池化后特征,输入训练好的softmax多分类器中得到分类标签,若softmax分类器输出标签与测试样本一致,表明分类结果正确,反之,则分类结果错误;统计整个有标签测试集中分类正确样本数量除以样本总数,得到针对该有标签测试集图像分类的正确率。

3 实验结果与分析

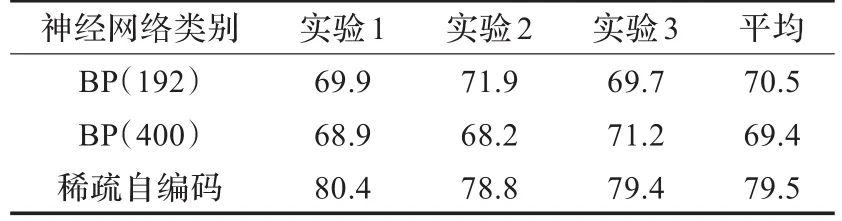

本文用于提取特征的图像小块的大小Dpatch=8,从无标签样本集每张图片中随机提取1 000个小块,100张图片共提取10万个小块;有标签训练集和测试集图片均统一图片大小到Dimage=64;池化小方块大小为Dpooling= 19。首先,采用Matlab工具箱中自带neural network toolbox构建传统BP神经网络(分别采用192个隐藏神经元和400个隐藏神经元),训练集和数据集仍采用2.1节中的有标签训练集和测试集。传统BP神经网络实验结果和本文算法实验结果及对比如表2所示。其中,本文稀疏自编码深度神经网络输入层和输出层神经元数量InputSize为192,隐藏层神经元数量HiddenSize为400。

表2 传统BP神经网络和稀疏自编码神经网络对比 (%)

从表2可看出,不论传统的BP神经网络各层神经元数量等于稀疏自编码输入层神经元数量(192)还是隐藏层神经元数量(400),稀疏自编码深度神经网络对林火图像及与林火特征相似图像的分类准确率均高于传统的BP神经网络。而且BP神经网络隐藏层神经元数量越多,其分类准确率不一定越高,可能会导致过拟合。实验结果表明,本文提出的基于稀疏自编码算法深度神经网络应用到林火图像分类中,能够进一步提高分类准确率。

4 结论

本文提出的稀疏自编码神经网络采用无监督的特征学习算法,不需要提取颜色、纹理、形状等特征,而是对图像块像素直接操作提取出图像数据的特征;能够有效地提高林火及类似特征物体的分类准确率。实验结果表明,该算法应用到林火、红旗、红叶图像分类中,较传统的BP神经网络,图像分类更准确。但图像分类的准确率仍不是很高,可能是数据集较小,还不能充分体现无监督特征学习强大的泛化能力。接下来,仍可从以下几个方面进一步提高本文算法准确率:

(1)增大样本数据集到几万甚至几十万张图片,相应地调整本文算法相关参数;

(2)增加神经网络的层数;

(3)数据集增大后,为提高处理速度,可采用并行处理。

[1]Subakan Ö N,Vemuri B C.A quaternion framework for color image smoothing and segmentation[J].International Journal of Computer Vision,2011,91(3):233-250.

[2]Liu M,Vemuri B C,Amari S I,et al.Shape retrieval using hierarchical total bregman soft clustering[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2012,34(12):2407-2419.

[3]Siang T K,Mat I N A.Color image segmentation using histogram thresholding-fuzzy C-means hybrid approach[J]. Pattern Recognition,2011,44(1):1-15.

[4]Gunay O,Toreyin B U,Kose K,et al.Entropy-functional-based online adaptive decision fusion framework with application to wildfire detection in video[J].IEEE Transactions on Image Processing,2012,21(5):2853-2865.

[5]靳琪琳,段锁林.基于神经网络与加权融合的火灾火焰识别研究[J].计算机工程与应用,2013,49(13):156-159.

[6]马宗方,程咏梅,潘泉,等.基于快速支持向量机的图像型火灾探测算法[J].计算机应用研究,2010,27(10):3985-3987.

[7]Ko B C,Cheong K H,Nam J Y.Fire detection based on vision sensor and support vector machines[J].Fire Safety Journal,2009,44(3):322-329.

[8]贾洁,王慧琴,胡燕,等.基于最小二乘支持向量机的火灾烟雾识别算法[J].计算机工程,2012,38(2):272-275.

[9]Khashei M,Zeinal H A,Bijari M.A novel hybrid classification model of artificial neural networks and multiple linear regression models[J].Expert Systems with Applications,2012,39(3):2606-2620.

[10]Yuan F.Video-based smoke detection with histogram sequence of LBP and LBPV pyramids[J].Fire Safety Journal,2011,46(3):132-139.

[11]黄儒乐,吴江,韩宁.林火烟雾图像自动识别中的模式分类器选择[J].北京林业大学学报,2012,34(1):92-95.

[12]孙志军,薛磊,许阳明,等.深度学习研究综述[J].计算机应用研究,2012,29(8):2806-2810.

[13]胡昭华,宋耀良.基于一种连续自编码网络的图像降维和重构[J].数据采集与处理,2010,25(3):318-323.

[14]Le Q V.Building high-level features using large scale unsupervised learning[C]//2013 IEEE International Conference on Acoustics,Speech and Signal Processing(ICASSP),2013:8595-8598.

[15]Coates A,Ng A Y,Lee H.An analysis of single-layer networks in unsupervised feature learning[C]//International Conference on Artificial Intelligence and Statistics,2011:215-223.

WANG Yong1,ZHAO Jianhui1,2,ZHANG Dengyi1,2,YE Wei1

1.Computer School,Wuhan University,Wuhan 430072,China

2.Suzhou Institute of Wuhan University,Suzhou,Jiangsu 215123,China

With the problem that forest fire and its similar objects are difficult to distinguish,this paper presents a new forest fire image classification approach based on deep neural network of sparse autoencoder.Using an unsupervised learning algorithm sparse autoencoder to learn features of large number of small patches from some unlabeled images has completed the training for deep neural network,and then with the learned features,the features can be extracted from large scale images and be convolved and pooled.It uses pooled features to train the softmax classifier by softmax regression.Experimental results show that this new image classification approach can more effectively distinguish forest fire and its similar objects, red flag,red leaves,etc.than traditional neural network does.

sparse autoencoder;unsupervised learning;convolve and pooling;softmax regression

针对林火与相似目标很难区分的问题,提出一种基于稀疏自编码深度神经网络的林火图像分类新方法。采用无监督的特征学习算法稀疏自编码从无标签图像小块中学习特征参数,完成深度神经网络的训练;利用学习到的特征从原始大小分类图像中提取特征并卷积和均值池化特征;对卷积和池化后的特征采用softmax回归来训练最终softmax分类器。实验结果表明,跟传统的BP神经网络相比,新方法能够更有效区分林火与红旗、红叶等类似物体。

稀疏自编码;无监督学习;卷积与池化;softmax回归

A

TP391.4

10.3778/j.issn.1002-8331.1401-0392

WANG Yong,ZHAO Jianhui,ZHANG Dengyi,et al.Forest fire image classification based on deep neural network of sparse autoencoder.Computer Engineering and Applications,2014,50(24):173-177.

苏州市国际科技合作计划项目(No.SH201115);湖北省自然科学基金(No.2009-514)。

王勇(1988—),男,硕士研究生;赵俭辉(1975—),通讯作者,男,副教授,研究领域为图像处理、模式识别、计算机仿真。E-mail:jianhuizhao@whu.edu.cn

2014-01-23

2014-05-04

1002-8331(2014)24-0173-05

CNKI网络优先出版:2014-07-11,http∶//www.cnki.net/kcms/doi/10.3778/j.issn.1002-8331.1401-0392.html