基于场景知识的移动目标检测

2013-04-03史东承

史东承,闫 李

(长春工业大学计算机科学与工程学院,长春130012)

随着计算机视觉领域的发展,视频监控对智能化的要求也越来越高,而作为视频监控核心技术之一的移动目标检测所面临的问题也越来越复杂。目前应用最多的目标检测算法是背景差法:背景差法的实质就是区分图像中目标的类别,即区分目标是前景还是背景,其关键在于对背景的建模和实时更新。已有许多文章对背景差法进行了改进,并取得较好的效果[1-3],但是这些算法仍不能从根本上解决由光照变化、阴影等外部环境因素和场景目标的移动、相互遮挡、形变、与背景颜色相似等场景内部因素所带来的干扰,从而影响算法的检测效果。

笔者算法依据背景建模的思想,从提取场景知识的角度出发,建立场景知识库,提出一种基于场景知识的移动目标检测算法。算法在提取特征时,选取对光照、形变等不敏感的颜色和纹理等目标特征建立场景知识库,从而在一定程度上削弱了这些噪声对目标检测效果的影响。

1 场景分割

区域是有效地表示场景内容的基本单位[4],所以首先要把场景分割成独立的目标区域。笔者选用mean shift算法对场景进行初始分割。mean shift算法是一种鲁棒性较强的特征空间聚类方法,且在场景中景物的边缘因为光照或遮挡的原因变得比较模糊时也能够得到高质量的目标边缘。

分割算法分两部分:1)使用改进的mean shift算法对场景进行初始分割;2)对得到的初始分割区域进行合并,并加入自动停止合并准则,完成分割。

1.1 改进的mean shift算法

mean shift算法通过寻求核函数概率密度估计▽f(x)的梯度为0的点,即f(x)的局部极大值,得到数据集的模值点。

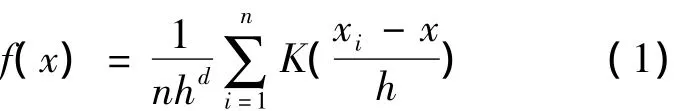

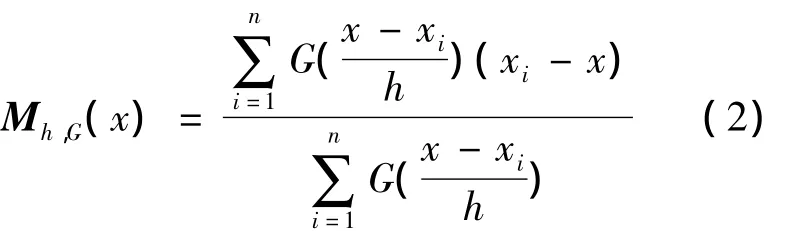

对于图像中的n个像素点{xi,i=1,2,…,n},x点的概率密度的核函数估计为

其中K(x)是一个核函数。x点处的mean shift向量为

其中K(x)=k(‖x‖2),g(x)=-k(x),G(x)= g(‖x‖2)。h为对核函数进行密度估计时所使用的窗口宽度,h的选择对最终的分割结果起着决定性的作用。

在Comaniciu等[5]所提出的基于 mean shift彩色图像分割方法的基础上进行了改进。mean shift实际上是一种特征空间聚类方法,所以颜色空间的选择必然会影响分割结果。在RGB颜色空间中,由于3个颜色分量存在着较强的关联性,故选取均匀的颜色空间CIE L*,u*,v*。从视觉角度来说,该空间更符合人眼视觉特性。图像中两个像素点i,j在该空间中的色彩差异可用欧氏距离表示:

用C替换式(2)中的项,即

依次遍历图像中的每一个像素点,通过反复迭代,概率密度函数达到收敛,同时局部区域像素点都漂移该收敛点,即函数的局部极大值点。把收敛点的色彩值赋给当前像素点,就使得图像中空间相邻、色彩一致的像素点都归为一类,完成图像的初始分割。

1.2 区域合并

在区域合并时,两个进行区域合并的区域必须满足:颜色相近、空间相邻,区域邻接出无明显边缘。故给出区域间的颜色距离和边缘距离的定义。

在区域合并过程中,何时停止合并直接决定着图像分割的效果。使用叶齐祥等[6]提出的自动停止合并的准则,当合并后剩余区域数目和区域颜色散度之和达到最小值时,停止合并,可得到较好的分割效果。

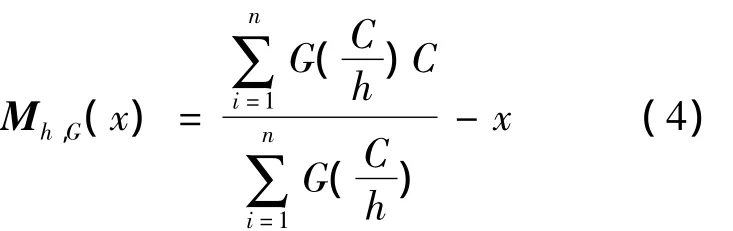

图1比较了笔者分割算法和传统均值移动算法的分割效果。图1(b)使用传统均值移动算法得到的分割区域为10个,分割区域过多过细,造成过分割,干扰笔者算法后续的目标征提取并且加大了算法计算量。图1(c)是笔者算法分割后区域数目仅为5个,能够避免过分割,且可以满足后续算法对场景各目标区域的区分,效果较好。

图1 分割效果比较Fig.1 Com parison of the segmentation results

2 场景知识提取及移动目标检测

2.1 特征提取

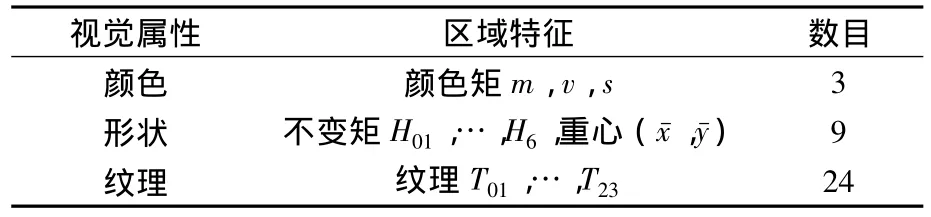

分割完成后,对每个场景目标区域进行标记编号。选取了场景区域的统计特征表达场景知识。特征选取的好坏直接影响着整个算法的性能,且由于场景景物的变化性较大,故笔者算法采用符合视觉属性且鲁棒性较强的统计特征进行区域知识表达。

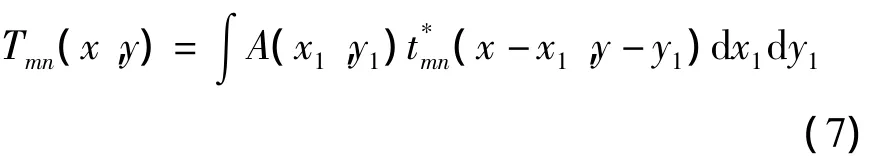

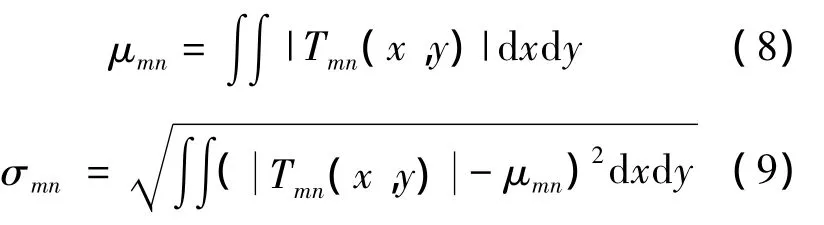

相对于其他的颜色特征来说,颜色矩简洁有效,故区域的颜色特征使用Stricker等[7]提出的颜色矩表示。纹理是一种不依赖颜色、亮度的视觉特征,且对场景的光照等变化具有较强的鲁棒性。用Gabor滤波器提取各区域的纹理特征[8]。给定一副图像A(x,y),它其Gabor小波变换定义如下

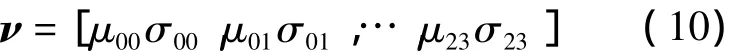

其中*表示复共轭,函数t(x,y)为Gabor小波函数。以Gabor小波变换系数的均值μmn和标准差σmn作为区域的纹理特征

使用μmn和σmn构建纹理特征向量,采用3级尺度,4个方向的Gabor滤波器,得到了24维的纹理特征向量:

区域的形状特征选取Hu[9]提出的7个不变矩和区域重心来描述。不变矩对于图像平移、旋转和尺度变换均保持不变,受目标形变遮挡的影响相对较小,故用不变矩可有效地表达目标的形状特征;使用区域重心描述目标的位置信息。

对提取的数据进行归一化处理,为每个区域构建一个36维的特征向量(如表1所示),并把所有目标的特征向量构建为一个特征向量集,即可得到场景知识库。

表1 区域特征向量Table 1 Feature vector of the region

2.2 相似性匹配和移动目标检测

对待检测的帧图像进行分割和特征提取后,根据相似性度量准则,用该帧图像中目标的特征向量和原场景知识库中各目标区域的特征向量进行相似性匹配。

若待检测目标与知识库中某目标的颜色、纹理、不变矩特征均满足给出的度量准则,而区域重心不满足相似性准则,则判定该移动目标为场景内原有目标;除上述情况外,若待检测目标的颜色、纹理、不变矩特征至少有一个不满足准则,则可判定该目标为新进入场景的移动目标。

根据分割区域标记和区域重心可以得到移动目标的移动信息和位置信息,完成移动目标检测。

各个特征进行相似性匹配的度量准则如下:

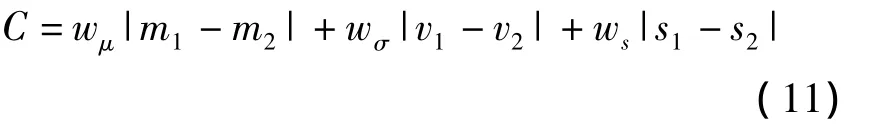

1)颜色矩的相似性度量准则

其中wμ、wσ、ws分别表示各颜色矩的权值。

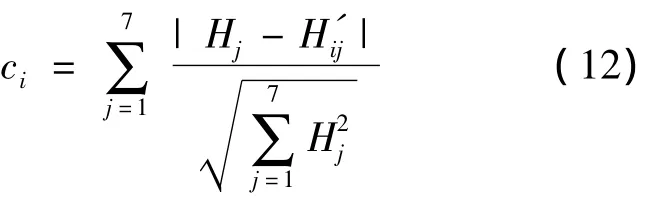

2)不变矩的相似性度量准则

3)区域重心的相似性度量

其中τ1和τ2可设定为图像长和宽的1/20~1/ 10,当式(3)和式(4)同时成立时,两个目标满足相似性匹配准则。

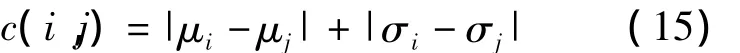

4)纹理特征的相似性度量

μ和σ分别为Gabor小波变换系数的均值和标准差。

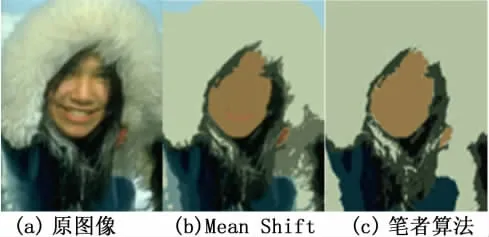

3 仿真结果及分析

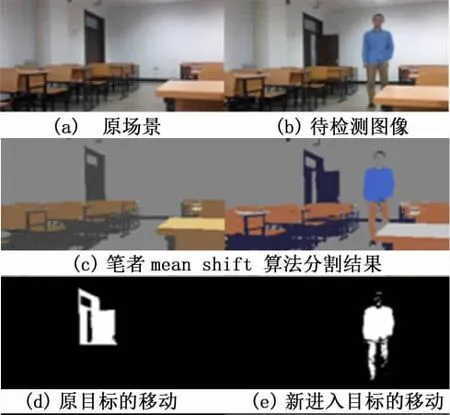

实验拍摄了简单的教室场景和街道交通场景图片,在Matlab平台上进行仿真,并对笔者算法和基于混合高斯建模的背景差法的检测结果进行比较。

图2 室内场景检测Fig.2 Detection of an indoor scene

图2为教室场景的移动目标检测:图2(a)为无移动目标的场景原图像;图2(b)为待检测图像,其中移动目标为教室后门(场景原有目标)和人(新进入场景目标);图2(c)为使用笔者分割算法进行分割得到的结果图,算法基本上单独分割出场景内各目标区域,且各区域轮廓清晰,区分度较好;图2(d)、(e)为检测结果图,打开的教室后门和新进入场景中的人都被成功的检测出来,且检测出的目标独立,粘连较少,得到了较好的检测效果。

图3为室外交通场景的移动目标检测:图3 (a)为待检测图像,移动目标为车辆;图3(b)为使用基于混合高斯建模的背景差法得到的检测结果。虽然该方法检测出了移动目标,但是检测结果受到了车辆阴影的影响,导致检测到的目标形状失真,直接影响下一步的识别、跟踪;并且阴影也可能会被判定为新的移动目标,从而影响检测的准确性。而用笔者算法在对场景进行区域分割后,选取对光照阴影有较强鲁棒性的颜色纹理特征进行目标表达,得到的检测结果并没有受到阴影的干扰,而且得到的车辆轮廓也较为完整,见图3(c)。

图3 算法比较Fig.3 Com parison of the two algorithm s

4 结论

从场景知识的角度出发,选取对外部环境变化和内部干扰鲁邦性都较强的颜色、形状、纹理特征组成目标特征向量,建立起场景知识库。用特征向量来代替各个目标区域不仅可减少系统的存储成本,而且可通过所选取特征对阴影形变等噪声的鲁棒性,提升整个算法的检测性能。最后,在用待检测目标的特征向量与场景知识库中特征向量进行相似性匹配时,可通过匹配准则的调整得到较好的检测效果。

由于算法中知识特征的抽取和匹配所需要的计算量较大,故算法的实时性需要进一步改进;笔者中所选取的实验场景都较为简单,故为了适应较复杂的监控场景,算法中加入场景知识库的实时更新就成为我们下一步工作的重点。

[1]Stauffer C,GrimsonW.Adaptive backgroundmixturemodels for real-time tracking[J].Proceeding of IEEEComputer Society Conference on Computer Vision and Pattern Recognition,1999,2(6):248-252.

[2]Elgammal A,Harwood D,Davis L.Non-parametricmodel for background subtraction[C]//Proceedings of International Conference on Computer Vision.1999:751-767.

[3]Rittscher J,Kato J,Joga S.A probabilistic background model for tracking[C]//Proceedings of European Conference on Computer Vision.2000:336-350.

[4]Luo Jie-bo,Guo Chen-gen.Perceptual grouping of segmented regions in color images[J].Pattern Recognition,2003,36(12):2781-2792.

[5]Comaniciu D,Meer P.Mean shift:A robust approach toward feature space analysis[J].IEEE Trans on Pattern Analysis and Machine Intelligence,2002,24(5):603-619.

[6]叶齐祥,高文,王伟强.一种融合颜色和空间信息的彩色图像分割算法[J].软件学报,2004,15(4):522-530.

Ye Qi-xiang,Gao Wen,Wang Wei-qiang.A fusion of color and spatial information for color image segmentation algorithm[J].Journal of Software,2004,15(4): 522-530.

[7]Sticker M,Orengo M.Similarity of color image[C]// Proceedings of SPIE Storage and Retrieval for Image and Video Database.1995:381-392.

[8]Manjunath B S,Ma W Y.Texture features for browsing and retrieval of image data[J].IEEE Transactions on Pattern Analysis Machine Intelligence,1996,18(8): 837-842.

[9]Hu M K.Visual pattern recognition bymoment invariant[J].IEEE Transactions on Information Theory,1962,8 (2):179-187.