基于异质局部特征的图像稀疏表示

2013-02-13徐望明方康玲

徐望明,方康玲

(武汉科技大学 信息科学与工程学院,湖北 武汉430081)

责任编辑:任健男

图像特征被广泛应用于图像处理与分析中作为图像的有效表达方式,其典型应用之一就是基于内容的图像检索(Content-Based Image Retrieval,CBIR)。给定查询图像,CBIR直接从图像库中查找与之视觉特征相似的图像,这种“图找图”式的依据视觉特征相似度给出图像检索结果的方法克服了传统的基于关键字的图像检索技术“字找图”式的不足,成为当前智能信息检索领域的研究热点[1]。

近年来,图像局部特征因其良好的可重复性、可分辨性和鲁棒性得了广泛重视和飞速发展,很多图像局部特征被相继提出(如SIFT[2],HOG[3]等),并用于CBIR等视觉任务中,弥补了图像全局统计特征(如颜色、形状、纹理等)的不足。然而,图像上所提取的局部特征因其数量较多、维数较高也给大规模图像检索任务带来了新挑战。这种“高维局部特征集”表示图像的方式,由于进行相似性度量的时间和空间复杂度高而难以适应大规模数据库环境下的图像检索任务,而图像的全局表示形式(Holistic Representation)用一个向量表示一幅图像,在这方面则有其天然优势,因为任何两幅图像的相似性直接可用向量之间的距离函数来度量。

为了使图像的表示形式既能像局部特征一样有描述图像细节信息的能力,又能像全局特征一样简洁明了,本文提出利用“稀疏学习”的思想,从训练图像的特征数据中建立超完备视觉词典,采用局部稀疏编码(Local Sparse Coding)和最大值合并(Max Pooling)将图像“高维局部特征集”转化为更高维的稀疏特征向量[4],然后通过直接计算向量相似性得到图像相似性,并应用于CBIR系统中。另外,本文不是使用单一局部特征,而是选取了信息互补的不同局部特征构成异质局部特征,从而能从多角度描述图像的内容,在CBIR系统中能得到比单一局部特征更好地检索结果。

1 相关工作

如何从原始“像素级”表示的图像中提取有更强表示能力的图像特征一直是图像分析任务首先要解决的问题,也一直是计算机视觉和模式识别领域的研究热点。

为了适应大规模图像数据库环境下的应用,可借助学习机制将提取的图像底层局部特征的集合通过“多对一”映射(编码)成为一种全局表达方式,即用一个向量来表示一幅图像,以便在图像检索任务中使用通用的相似性度量方法来比较图像的相似性,迅速返回检索结果。不同于通常所说的颜色、形状、纹理等全局统计特征,这是一种构造在局部特征基础上的全局特征,它仍能保留接近于图像底层的细节信息,可看作是较高一层的特征表示,这就向着“语义层”特征表示又前进了一步。目前这类特征中比较典型的例子是BoVW(Bag of Visual Words)[5],S.Lazebnik等人则使用SPM(Spatial Pyramids Matching)[6]方法对其进行了改进,在一定程度上加入了局部特征的空间分布信息。

另外,压缩传感和稀疏表达理论近年来在信号处理、模式识别和计算机视觉领域中掀起新一轮热潮,在人脸识别、场景分类等诸多应用中都取得了较好效果。其中一个核心的概念就是稀疏编码,最早源自Barlow等人对生物视觉系统研究而提出的有效编码假设[7]。Olshausen和Field则进一步提出了著名的稀疏编码模型[8],该模型通过基向量(或基函数)线性相加表示输入图像,在最小均方差意义下使重构图像尽可能地与原图像相似,同时要求表示系数尽量稀疏化。在此基础上,很多研究者在稀疏编码模型的理论和应用方面做了大量的工作,取得了丰硕成果,也提出了许多改进的稀疏编码模型。

对于图像数据,这些稀疏编码模型大多是从自然图像中“随机”选取若干图像块(按像素灰度值排列成多维向量)构成一个训练集合,加以训练学习后得到基向量和对应图像的稀疏表示(编码)。随机采样的子图像块作为样本会给学习过程带来不稳定性(比如引入背景或非目标区域噪声、对图像尺度、方向、视觉、亮度变化敏感等),从而学习到的基向量不一定具有代表性,并可能存在大量噪声信息冗余。针对以上这些问题,考虑到目前流行的图像局部特征(如SIFT等)本身就是对图像中感兴趣区域(图像块)的一种优于“像素级”的多维向量表示形式,因此,直接以图像局部特征作为训练样本,并采用稀疏编码模型学习基向量和图像的稀疏表示,是特征学习方法研究的新趋势。研究者们最近几年来在这方面做了一些尝试,并在图像重构、图像分类等应用中取得了较好效果[9-11]。

但其训练数据(局部特征)大多是在图像上密集采样的结果,一般都只使用单一的视觉特征。密集采样得到的特征数比基于兴趣点检测得到的特征数要多得多,而且极易引入背景和非目标区域噪声,另外单一视觉局部特征一般是精心设计的,是对图像块某一属性的描述,如果还能联合其他信息互补的局部特征,如基于兴趣点检测的特征加上基于局部纹理或形状描述的特征,则描述能力会更强。

本文正是以此为突破点,运用稀疏学习的思想,将SIFT(Scale Invariant Feature Transform)[2]、LBP(Local Binary Patterns)[12]和HOG(Histograms of Oriented Gradients)[3]等3种信息互补的图像局部特征视为异质局部特征进行融合,最终以一个高维稀疏向量的全局表示形式描述图像多角度的视觉内容,并将其应用于CBIR任务中。

2 图像异质局部特征的稀疏学习

2.1 局部特征的稀疏学习

图像的局部特征可以看作是对图像某一采样区域特性的向量描述。例如,SIFT特征是基于“团点”检测的,对图像缩放、旋转、光照变化甚至遮挡和裁剪等均保持着较好的不变性;LBP特征反映了图像上像素点与其近邻像素点灰度值的大小关系,描述了图像的局部纹理特性;HOG特征则描述了图像内容的局部形状或边缘特性。

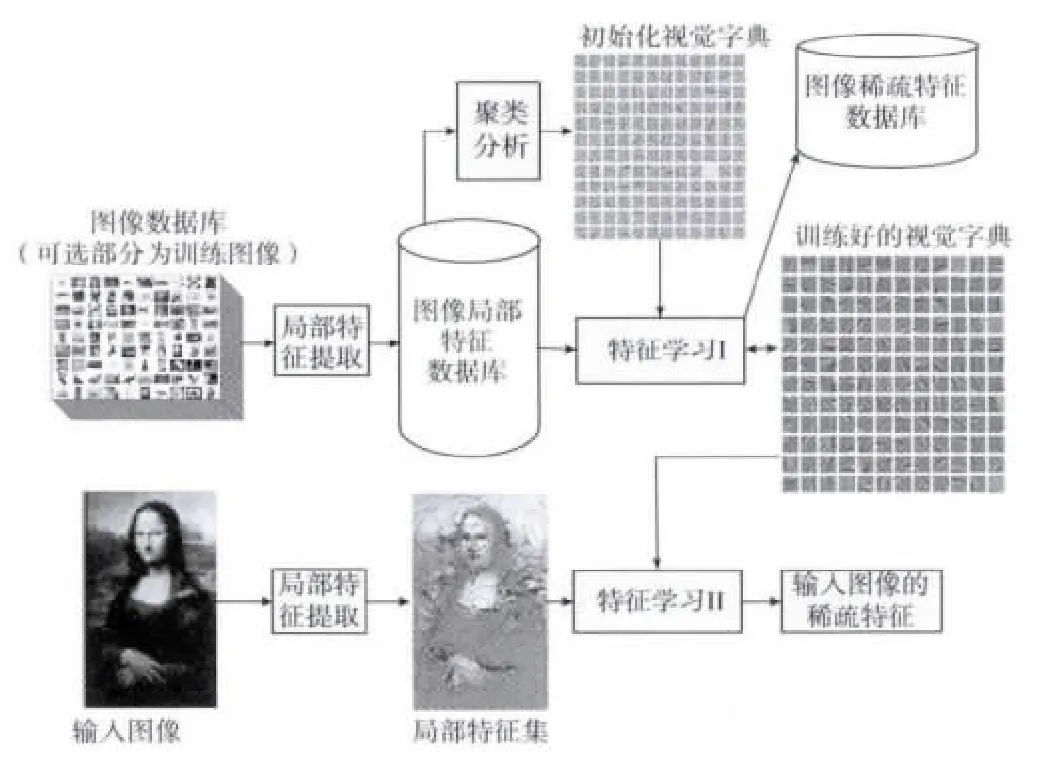

图像局部特征稀疏学习的目的,是利用学习机制将图像底层局部特征的集合通过“多对一”映射(编码)成为图像的全局稀疏表示形式,以便在图像检索任务中使用通用的相似性度量方法来比较图像的相似性。图像局部特征的稀疏学习过程如图1所示。

图1 图像局部特征的稀疏学习

一方面,选取图像库中的部分图像作为训练图像,提取底层局部特征,通过聚类方法得到初始的超完备视觉词典,然后利用初始化的视觉词典和训练图像的局部特征,交替使用词典学习方法和稀疏分解算法,通过不断的训练学习得到优化的超完备视觉词典和图像库中图像的稀疏特征(即全局稀疏表示);另一方面,应用系统的输入图像(如CBIR系统的查询图像)的局部特征被提取,并利用训练好的词典对其进行稀疏学习,得到输入图像的稀疏特征。随后,这些稀疏特征可被用于各种具体计算机视觉应用中。

记X=[x1,x2,…,xn](x1∈Ra×1)为输入矩阵(每列是一个输入向量),表示在d维空间中的一组包含n个局部特征向量的集合,B=[b1,b2,…,bk](b1∈Ra×1)为基矩阵(每列是一个基向量),表示由K个基向量构成的视觉词典,S=[s1,s2,…,sn](s1∈RK×1)为系数矩阵(每列是一个系数向量),表示利用视觉词典进行稀疏分解(局部稀疏编码)得到输入矩阵X的稀疏编码矩阵,则以上稀疏学习的过程可以表示成下面的优化问题

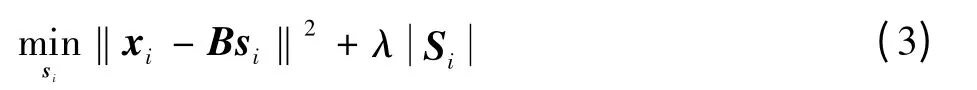

式中:‖x1-Bsi‖2表示重构误差;是稀疏性的惩罚函数;λ为规则化参数,用于权衡重构误差和稀疏约束。该优化问题在S保持不变时是关于B的凸优化问题,在B保持不变时是关于S的凸优化问题。一般通过交替固定B和S之一的同时优化另一个的方法来优化上述目标函数。

对于学习基矩阵B(即学习视觉词典),此时固定S,该优化问题等价于平方约束最小二乘问题)

对于学习系数矩阵S(即局部稀疏编码,学习局部特征的稀疏编码矩阵),此时固定B,该优化问题等价于L1规则化最小二乘问题

为了将图像用一个向量表示,对学习到的局部特征的稀疏编码矩阵,还要进行一个合并操作,一般采用最大值合并(Max Pooling)方法[9]

式中:scj是sc(最终的高维稀疏向量)的第j行元素;Sj是S的第j行第i列的矩阵元素;n是局部特征向量的数目。最大值合并相当于在对应基向量位置的最强响应,许多图像分类任务已证实该方法行之有效[4],故本文也采用最大值合并方法来合并各个稀疏编码,从而得到整幅图像的稀疏表示。

2.2 异质局部特征的稀疏学习

不同的局部特征,其设计思路不同,对图像底层细节信息描述的角度也就不同。这种信息互补的特征组合可视为异质局部特征(Heterogeneous Local Features)。本文从众多的图像局部特征中,选择了如前所述的SIFT(128维)、LBP(采用P=8,R=1统一模式LBP,58维)和HOG(36维)来构成异质局部特征加以研究。

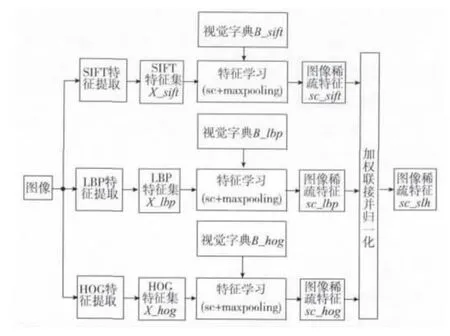

为了融合图像的异质局部特征,采用如图2所示的稀疏学习方法。

图2 图像异质局部特征的稀疏学习

从图像数据库中选择一部分图像作为训练图像,分别提取SIFT,LBP,HOG特征组成3个训练特征集,分别得到3个超完备视觉词典B_sift,B_lbp,B_hog。对于训练好的每一个视觉词典,利用其对图像的局部特征矩阵进行局部稀疏编码和最大值合并,分别得到稀疏特征sc_sift,sc_lbp,sc_hog,最后按照一定的权重进行首尾相连并进行归一化就能得到一个信息融合后的稀疏特征——单位向量sc_slh,即为该图像的最终全局稀疏表示形式。

这样,每幅图像仅用一个包含图像多角度局部信息的高维稀疏向量描述。图像相似性可直接用向量相似性来衡量。用这个稀疏特征向量来描述图像的特征,相比单一特征对图像进行了更全面的描述,又具备全局特征的形式,因而这样的特征既具备了较强的图像局部信息描述能力,又能够适应大规模数据库检索的需求。

3 应用实例:CBIR

将按以上稀疏学习方法得到的图像稀疏表示应用于基于内容的图像检索(CBIR)任务中。

3.1 图像库

采用标准图像库ZuBud[13]。该库包含201栋建筑物的1 005幅图像,每个建筑物各有5幅图像,原始分辨率为640×480(本文实验中将其缩小到320×240以减少数据量),是在不同季节和天气条件下从不同视角由两个不同相机拍摄的,还特别拍摄一些被树木遮挡的图像。采用该库来做图像检索实验能够方便地评估图像特征的性能,如尺度不变性、方向(旋转)不变性、视角不变性、光照不变性以及抗干扰能力等。

3.2 视觉词典学习

为减少计算量,对每建筑物各取1幅图作为训练图像集,对这201幅图像提取SIFT,LBP,HOG特征分别组成训练特征集,通过K-Means聚类得初始化视觉词典,并按式(2)进行词典学习,分别得到3个具有K(K=1 000)个基向量的超完备视觉词典。

3.3 图像的稀疏表示

对于学习好的每个视觉词典,利用其对全部1 005幅图像的局部特征矩阵按式(3)和式(4)进行局部稀疏编码和最大值合并,先将每幅图像用一个K维的稀疏向量进行表示;然后,通过加权联接的方式融合3个稀疏向量,并进行归一化,从而形成图像的最终全局稀疏表示,即3K维的稀疏单位向量。

3.4 图像检索过程和性能评价

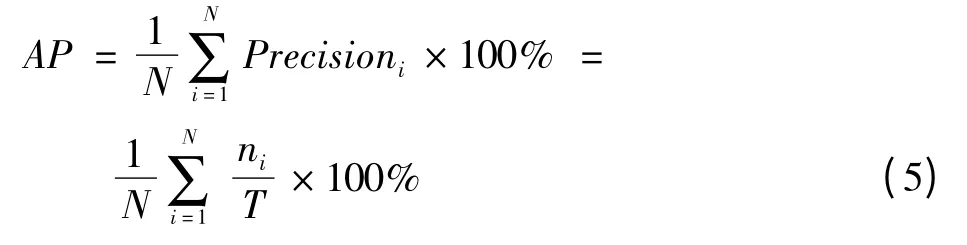

为了便于统计结果和评价检索性能,本文取每幅库图像作为查询图像,这样图像检索过程简化为,用两个稀疏单位向量的内积(夹角余弦)的来衡量两幅图像的相似度(内积越大越相似),并按相似度从大到小返回指定数量的图像作为检索结果。根据ZuBud库特点,指定返回结果图像数T=5,即等于实际相关图像数,故本文实验中单次检索的查准率与查全率相同。这里采用平均查准率(Average Precision,AP)作为性能评价标准,即

式中:ni是第幅查询图像检索出的相关图像数目,N=1 005。

3.5 实验结果及分析

表1为按6种不同的加权系数进行稀疏特征融合时图像检索实验的平均查准率。

表1 ZuBud图像库上6组图像检索实验的平均查准率

图3和图4分别是实验中某幅查询图像利用单一SIFT稀疏特征及按0.5∶0.3∶0.2的权值进行异质特征融合后的5-近邻(5-NN)检索结果。

由此可见,在本文设定的实验条件下,相比单一局部特征,综合利用异质局部特征进行图像检索,能够得到更高的查准率,异质局部特征对图像局部信息具有更全面的描述与区分能力。另外,每幅图像均由一个高维的稀疏向量来表示,因而只需要存储该向量中非零系数的值和索引,且图像间的相似性直接用稀疏向量的距离函数来度量,明显降低了直接用“局部特征集”表示图像时度量图像相似性的时空复杂度。

4 结论

本文提出了一种将图像的异质局部特征通过稀疏学习映射为图像全局稀疏表示形式的方法,并将之应用于基于内容的图像检索任务中。文中选取了SIFT,LBP,HOG这3种典型的图像局部特征形成图像异质局部特征,它们分别描述了图像的兴趣点特性、局部纹理特性和局部形状特性,加权融合后对图像视觉内容形成了多角度、更全面的描述。

在ZuBud数据库上进行的图像检索实验验证了该方法的有效性和高效性。实验结果表明:利用图像异质局部特征,相比于单一局部特征,能够从多角度更全面地描述图像的视觉内容;对提取的异质局部特征进行稀疏学习,能得到表征图像本质内容的全局稀疏表示,即高维稀疏向量,同时具备了局部特征和全局特征的优势,在表征图像细节信息的同时,避免了“局部特征集”相似性匹配的计算瓶颈,大大减少了时空复杂度,从而便于适应大规模图像检索的需求。

[1]周明全,耿国华,韦娜.基于内容图像检索技术[M].北京:清华大学出版社,2007.

[2]LOWE D G.Distinctive image features from scale invariant keypoints[J].International Journal of Computer Vision,2004,60(2):91-110.

[3]DALAL N,TRIGGS B.Histograms of oriented gradients for human detection[C]//Proc.CVPR 2005.San Diego,CA,USA:[s.n.],2005:886-893.

[4]YANG Jianchao,YU Kai,GONG Yihong,et al.Linear spatial pyramid matching using sparse coding for image classification[C]//Proc.CVPR,2009.Miami,FL,USA:[s.n.],2009:1794-1801.

[5]SIVIC J,ZISSERMAN A.Video Google:a text retrieval approach to object matching in videos[C]//Proc.ICCV,2003.Nice,France:[s.n.],2003:1470-1477.

[6]LAZEBNIK S,SCHMID C,PONCE J.Beyond bags of features:spatial pyramid matching for recognizing natural scene categories[EB/OL].[2013-01-05].http://ieeexplore.ieee.org/xpl/articleDetails.jsp?tp=&arnumber=1641019&queryText%3DBeyond+bags+of+features%3A+Spatial+pyramid+matching+for+recognizing+natural+scene+categories.

[7]BARLOW H.Possible principles underlying the transformation of sensory messages[EB/OL].[2013-01-05].http://wenku.baidu.com/view/676f2351f01dc281e53af0b2.html.

[8]OLSHAUSEN B A,FIELD D J.Sparse coding with an overcomplete basis set:a strategy employed by V1[J].Vision Research,1997,37(23):3311-3325.

[9]LEE H,BATTLE A,RAINA R,et al.Efficient sparse coding algorithms[C]//Proc.Advances in Neural Information Processing Systems.[S.l.]:MIT Press,2007:801-808.

[10]WANG Jinjun,YANG Jianchao,YU Kai,et al.Locality-constrained linear coding for image classification[C]//Proc.CVPR,2010.San Diego,CA,USA:[s.n.],2010:3360-3367.

[11]ZHANG C,LIU J,TIAN Q.Image classification by non-negative sparse coding,low rank and sparse decomposition[C]//Proc.CVPR,2011.Providence,RI:[s.n.],2011:1673-1680.

[12]OJALA D T,PIETIKINEN M,MAENPAA T.Multi-resolution gray scale and rotation invariant texture classification with local binary patterns[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2002,24(7):971-987.

[13]Zurich Building Image Database[EB/OL].[2013-01-20].http://www.vision.ee.ethz.ch/showroom/zubud/.