雾天环境下的指针式仪表检测与读数识别

2025-01-31吴攀超杨鹏孙电洋杨明昊

摘 要 针对雾天油田巡检机器人对指针式仪表漏检及读数识别准确率低的问题,提出一种结合FFA Net去雾算法和Yolov5检测网络的方法。首先,对于雾天图像,改进了FFA Net算法,通过多尺度结构、特征融合残差块和优化模块,有效地提升了算法在去雾任务中的性能表现。其次,对于仪表检测与读数识别,采用较小的检测头来提升Yolov5对小目标的检测能力,并引入空间转换模块将检测到的表盘图像转换为更符合人眼观感的正视图像。最后,创建了一个端到端的框架,紧密耦合仪表成分检索和仪表读数识别,提高了仪表读数的准确性。实验结果表明,所提方法在油田雾天环境下展现出了良好的鲁棒性,提升了雾天环境下指针式仪表检测与读数识别的准确性。

关键词 图像去雾 Yolov5 仪表检测 仪表识别

中图分类号 TP391"" 文献标志码 A"" 文章编号 1000 3932(2025)01 0101 10

近年来,随着人工智能在各个领域的快速发展,油田逐渐引入巡检机器人来进行巡检工作,以此提高识别准确率,减少设备漏检和误检所带来的经济损失[1]。一些机器人通过拍摄室外的指针式仪表图像,再利用图像处理技术来进行读数识别。然而,在雾霾天气环境下,会导致采集到的指针式仪表图像质量降低,出现无法识别仪表、指针读数,识别准确率低等问题。

目前,研究人员对指针式仪表的检测与读数识别进行了大量研究。LIU Y等首先采用Faster R CNN技术准确定位仪表位置,随后利用特征对应算法和透视变换获取高质量图像,最终通过Hough变换确定指针位置并读取读数[2]。WU X等提出一种基于二值掩模和改进Mask RCNN的仪表图像偏斜校正算法,实现了高精度椭圆拟合[3]。LIU Z等利用高斯尺度空间增强ORB算法的尺度不变性,并利用RANSAC对匹配点进行滤波,以提高特征指针匹配的精度,最后,通过霍夫变换拟合指针,获得读数[4]。WANG L等采用Faster R CNN目标检测方法定位仪表区域,并利用泊松融合方法和K fold验证算法扩展数据集,优化数据集质量[5]。

虽然以上方法都取得了不错的识别结果,但是在雾霾天气下,地面附近的空气中含有大量微粒会导致图像质量降低,出现色彩暗淡、对比度降低等问题,无法精确定位指针式仪表并且降低读数识别的准确率。针对此问题,笔者利用图像增强和深度学习方法来去除雾霾对表盘的干扰,并结合改进的Yolov5目标检测算法,对去雾后的指针式仪表图像进行检测与读数识别。

1 仪表检测与读数识别模型

针对雾天环境下对指针式仪表定位不准与读数识别准确率低的问题,笔者提出了基于特征融合注意力网络(FFA Net)和Yolov5的雾天环境下指针式仪表检测与读数识别方法。首先判断采集到的图像是否为雾天图像,采用基于FFA Net的图像去雾算法降低雾霾对仪表图像的干扰,然后对去雾后的仪表图像采用目标检测技术进行定位,排除图像中其他物体的干扰,识别正确的目标区域。根据目标区域的位置信息提取仪表表盘区域,缩小图像范围。对于倾斜、畸变的表盘图像,使用空间转换方法进行校正,从而得到高质量的表盘正视图像。笔者创建了一个读数识别模块,包括基于语义分割的仪表组件检索分支和基于文本识别器的仪表读数识别分支。通过仪表组件检索分支得到指针图和关键刻度图,通过仪表读数识别分支得到最终的识别结果。整体流程如图1所示。

2 基于FFA Net的图像去雾算法

QIN X等提出了FFA Net,该网络结合了像素注意力、通道注意力以及局部残差模块来进行去雾,取得了显著的效果[6]。但由于FFA Net的特征提取部分相对简单,去雾效果受到了限制,在雾浓度大的情况下经过处理的图片不仅出现了严重的色彩偏差,而且有大量的雾气残留,不利于后续的仪表识别。

2.1 改进的FFA Net图像去雾网络模型

针对上述问题,笔者在FFA Net的基础上,使用多尺度结构,改善了特征注意力模块,让网络能够更好地学习到所需的特征,提高了网络的泛化能力,并加入一个优化模块,进一步恢复图像的细节信息,提升网络的去雾效果。

改进的FFA Net整体结构如图2所示。首先将有雾图像输入到网络中,经过两次卷积来提取浅层特征,然后将提取到的浅层特征输入到由特征融合残差块组成的多流残差结构中来提取不同尺度的特征,最后通过优化模块保证生成图像的细节信息,从而输出无雾图像。

2.2 多流残差结构

FFA Net的特征提取部分仅通过单一的卷积神经网络来提取特征,这种情况只能捕获局部信息,忽略了全局和上下文信息,导致网络的处理能力受到限制。改进的FFA Net去雾网络建立在图像去雾任务中广泛采用的编码器-解码器架构之上,编码器可以有效地提取输入图像中的特征信息,解码器则可以将这些特征信息映射回原始图像空间,并帮助恢复清晰的图像。由编码器-解码器网络引发的大感受野能够获取更广泛的上下文信息,但随着网络层的逐渐加深,浅层特征信息往往难以保留。为了识别和融合不同层次的特征,笔者使用多流残差网络来提取不同尺度的特征,将浅层和深层信息集成在一起,得到更全面、更准确的图像表示。

多流残差结构如图3所示,首先将提取到的浅层特征送入不同尺度的编码器中,编码器对输入特征图进行下采样操作,编码器中的每一层都由卷积和特征融合残差块组成,在逐步降低分辨率的同时,不断地提取图像特征,并扩展特征图的维度。然后再经过解码器来重构图像,对经过编码器的特征图做上采样操作逐步恢复到输入图像的尺寸。在编码器和解码器的对应层之间使用跳跃连接将特征图在通道维度上进行拼接,有利于实现浅层特征和深层特征之间的直接传递,使得不同层次的特征可以更好地相互融合,降低网络训练的难度。该结构可以描述为:

M(x)=[F3×3(x),F5×5(x),F7×7(x)]""" (1)

其中,M(x)表示多流残差结构,F(·)表示内核大小为i的特征提取模块,[·]表示级联操作。

2.3 特征融合残差块

以往的深度学习去雾模型通常对通道特征和像素特征的处理是一视同仁的,忽略了实际有雾图像中雾霾分布的不均匀性,导致去雾效果不佳且限制了网络的表示能力。

FFA Net特征注意力模块通过结合通道注意力和像素注意力,能够不平等地处理不同像素区域的特征。但随着模型复杂度的提升,特征注意力模块的计算量也随之增加,且通道注意力中的降维操作会对通道注意力的预测产生负面影响。

WANG Q等通过研究表明避免降维对学习通道注意力非常重要,提出一种高效通道注意力模块(ECA),可在只增加少量参数的情况下显著提升其性能[7]。因此引入ECA模块来避免降维操作并有效促进跨通道交互,降低模型复杂度并增强泛化能力。此外,将残差块和特征注意力模块相结合,在减少网络深度的同时实现特征的融合,从而加快网络的收敛,进一步增强了网络的学习能力。

所提的特征融合残差块结构如图4所示,它可以让网络更加关注有用的通道信息和像素信息,给予不同浓度的区域不同的权重,让网络更加关注高频信息且不会忽略低频信息,从而达到更好的去雾效果。其整体结构如下:

F(x)=FA(ReLU(GN(Conv(Res(x)))))" (2)

其中,x为输入特征图,Res(·)为残差块,GN为组归一化,Conv为卷积模块,ReLU为激活函数,FA为改进后的特征注意力模块,F(x)为特征融合残差块。

2.4 优化模块

多流残差结构会导致生成的图像缺乏细节信息,优化模块的主要目的就是对聚在一起的特征映射进行精细调整。

优化模块的结构如图5所示,首先将输入特征图经过两个3×3的卷积和全局平均池化后,对特征图分别采用4、8、16、32的系数进行下采样来构造特征金字塔,接着对于不同尺寸的特征图,采用逐点卷积(卷积核大小为1×1)来降维,再接着采用最近邻插值对不同尺度的特征图进行上采样操作,将其恢复到原始尺寸。将输出的4个特征图在通道方向上做拼接后送入由5个残差块组成的残差结构中去,最后再经过3个3×3的卷积得到最终输出。其结构如下:

R(x)=3Conv(Res(D(GAP(2Conv(x)))))" (3)

D(x)=[(Conv(x↓))↑,(Conv(x↓))↑,

(Conv(x↓))↑,(Conv(x↓))↑,x]"" (4)

其中,iConv(·)表示经过i次卷积,Res(·)表示由5个残差块组成的残差结构,D(·)表示特征金字塔结构,↓代表下采样i倍,↑代表上采样i倍,GAP表示全局平均池化,R(x)表示优化模块。

残差块的网络结构如图6所示,其主要包括特征映射和恒等映射。在特征映射路径中,将输入特征图一次经过一个由卷积和组归一化构成的序列。而在恒等映射路径中,输入与输出通过一个跳跃连接直接相连。最后,将特征映射和恒等映射融合后经过SeLU激活函数得到输出。

2.5 损失函数

根据文献[8]的研究,广泛使用的L2损失函数在处理图像时由于平方惩罚可能会导致局部斑点伪影的产生。而LSSIM和L1损失函数在去雾任务中对保留图像结构和边缘信息具有良好的效果。因此,采用以下损失函数来优化网络模型:

L=L(Y,Y)+[1-L(Y,Y)]""""""""""""""" (5)

L(y,)=|y-|"""""" """"" (6)

L(x,y)=""" (7)

其中,L为总损失,L为平均绝对误差损失,y为样本i的真实标签,为模型对于样本i的预测标签,N为样本总数,L为结构相似性损失,μ和μ分别为x和y的方差,σ和σ分别为x和y的标准差,σ为x和y的协方差,c和c是用来维持稳定的常数,Y为去雾图像,Y为真实无雾图像。

3 指针式仪表检测与读数识别

针对现有的指针式仪表检测算法不能精准识别小目标,以及读数识别模块效率不高且准确率低的问题,笔者对目标检测算法Yolov5进行改进,用较小的检测头替代原始检测头,提高检测小目标的能力。并引入一个空间转换模块,将检测到的仪表图像校准到人类视觉范围内正常的图片。此外,创建了一个统一的框架,将仪表成分检索和仪表读数识别结合在一起,模拟端到端的文本检测器。

3.1 仪表检测模型

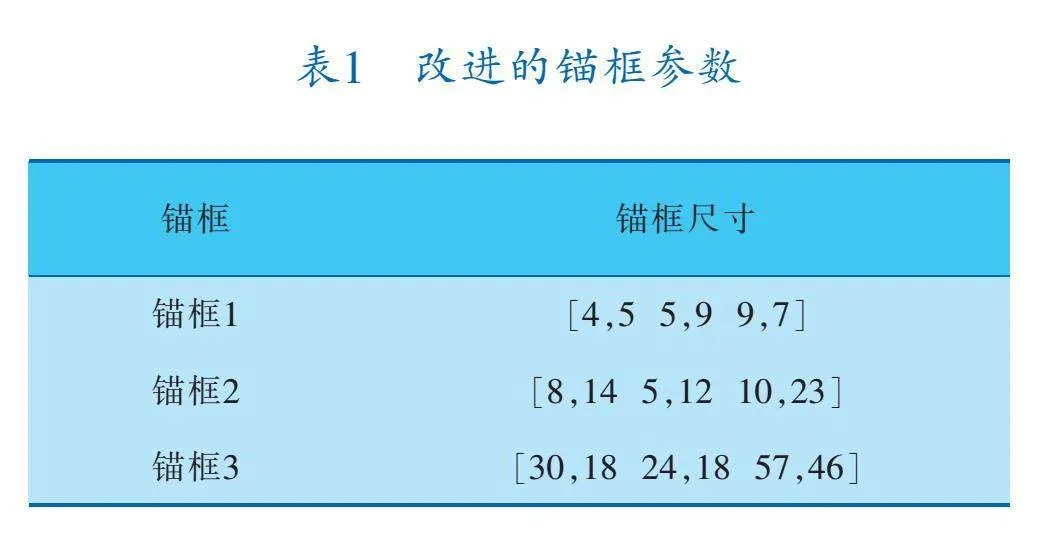

在应用Yolov5算法进行指针式仪表检测时,可能会面临从巡检机器人视角检测小目标的挑战,例如漏检或检测性能不佳的问题。尽管Yolov5的默认检测头能够胜任多尺度目标检测任务,但在小目标检测方面可能表现不佳。直接添加专门用于小目标检测的检测头可能会增加模型参数数量、降低推理速度,并且可能对整体检测性能造成负面影响。因此,通过改变Yolov5中的3个检测头大小,并设置相应的先验框尺寸,以解决上述问题。

为了匹配检测头大小的更改,先验框的锚框尺寸必须进行调整,以提高对小目标的检测性能。先验框的锚框尺寸设置见表1。经过修改的小目标检测头能够更好地聚焦于特征图中的小目标特征,并对小目标更敏感。改进后的Yolov5网络结构如图7所示。

3.2 空间转换模块

因为受到定位模块的限制以及拍摄视角的影响,将检测到的仪表图像直接传递给读数识别模块进行读数识别通常效果不佳。传统的方法是采用透视变换来校准相机角度,以获取正视图图像。然而,这种方法的计算时间较长且不够稳健。为了克服此问题,笔者引入了一个更高效、更强大的空间转换模块[9],它可以更高效地对齐仪表,将裁剪的仪表图像转为更符合人类视觉的正视图图像。

3.3 读数识别

先前的读取仪表的方法通常是读取仪表的指针、刻度和数字,但这些方法往往会创建独立的模块来处理不同的组件和数字,导致读数识别效果不佳。为此,笔者创建了一个数值获取模块,它由一个仪表组件检索分支和一个仪表数字识别分支组成,以探索它们之间的深层关系,整体结构如图8所示。

受Mask R CNN[10]的启发,笔者使用语义分割方法来检索仪表指针和关键刻度。该分支通过对主干特征执行两个不同的1×1卷积操作,生成1通道的指针图和关键刻度图,如图9所示。指针图用于指示仪表指针的位置,而关键刻度图则指示仪表指针的角度。

3.4 损失函数

总体损失函数可以计算如下:

L=L+L+L"""" (8)

其中,L表示仪表组件检索分支损失,L表示关键字检测损失,L表示关键字识别损失。

仪表组件检索分支主要生成指针图和关键刻度图,这两个分割图均通过最小化Dice损失来进行训练,具体如下:

L=1-"" (9)

L=1- (10)

其中,下标PointerMap表示指针图,下标KeyScaleMap表示关键刻度图,P(i)表示预测结果中第i个像素的值,G(i)表示真实标签区域中第i个像素的值。

仪表组件检索分支的最终损失是指针图和关键刻度图的权重组合,由(0,1)范围内的λ进行平衡:

L=λL+(1-λ)L(11)

将λ设置为0.4。因为在训练过程中,关键刻度图空间占用较小,相对较难学习,因此将更多的重要性分配给关键刻度图。

仪表数字识别分支的损失包括关键字检测损失和关键字识别损失。其中,关键字检测损失可以表述为:

L=(-pln p-(1-p)ln(1-p)) (12)

其中,‖·‖表示集合中的元素数量,p是预测像素,p是实际标签,Ω为正样本数量。

关键字识别损失可以表示为:

L=-ln p(y|x)""" (13)

其中,N′是输入图像中数字区域的数量,y是识别标签,p(y|x)是条件概率。

4 实验验证

4.1 实验设置

本研究的实验环境为Python 3.8、PyTorch 1.11和CUDA 11.3。所有网络在NVIDIA GeForce RTX4090 GPU上训练,周期设置为300。在训练之前,对所有图片进行尺寸调整,使其大小统一为640×480。使用Adam优化器,并将动量设置为0.9,批次大小设为16。初始学习率设置为10-4,在训练过程中将学习率逐步降低到10-6。

4.2 图像去雾实验

使用峰值信噪比(PSNR)和结构相似性指数(SSIM)来评估去雾网络的性能。这两个指标通常用于量化去雾图像恢复的质量。PSNR值越高,代表重建性能越好;SSIM值越大,代表失真越少。

在指针式仪表图像中添加不同浓度的雾霾,对笔者提出的基于FFA Net的图像去雾算法与DCP[11]、AOD Net[12]、FFA Net、SGID PFF[13]进行比较。表2为不同去雾算法在雾天合成数据集上的定量比较结果,图10展示了不同算法的去雾结果。从图中可以看出,经DCP和AOD Net去雾后的图片出现了严重的色彩失真。FFA Net和SGID PFF在雾浓度越来越高的情况下,依然有大量雾残留。相比之下,笔者提出的去雾算法在不降低图像亮度的情况下能够有效地将雾去除,去雾效果最好,与真实图像最为接近。

4.3 指针式仪表检测与读数识别实验

采用了一些目标检测中常用的性能指标来评价改进后的模型性能,这些指标包括精确度P、召回率R、平均精度mAP和每秒帧数FPS。不同目标检测网络进行仪表检测的定量结果见表3。

由表3可知,与原始几种Yolov5相比,笔者提出的目标检测网络获得了更好的检测精度。例如,与Yolov5 M相比,笔者所提网络的mAP提高了4.3%,R提升了2.4%。图11展示了Yolov5 S与笔者所提的检测网络的定性比较结果,其中边界框表示指针式仪表。可以看出,Yolov5 S对于小目标的检测不尽如人意,如图11a第2行右图,Yolov5 S未能将小的指针式仪表检测出来。相比之下,笔者提出的网络能够检测出不同形状和大小的仪表。

如图12所示,无论相机角度如何,空间转换模块都能够轻松自动地将图像转换为正视图图像。但是,在一些极大相机角度下,将仪表图像转换为正视图图像仍然存在挑战。

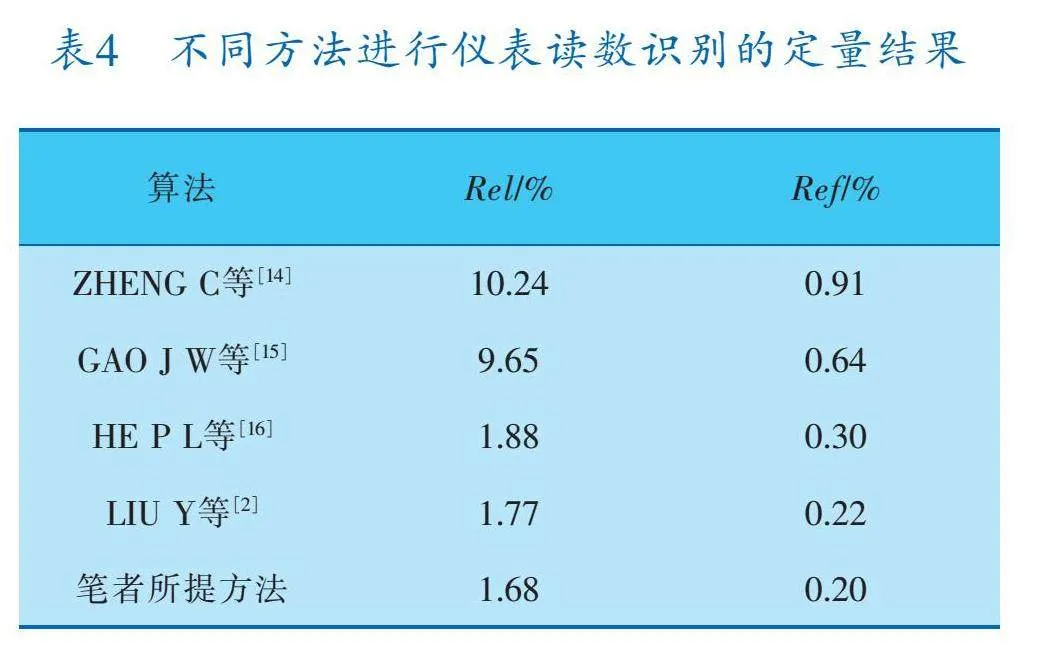

在指针式仪表读数识别中,选择了平均相对误差Rel和平均参考误差Ref作为评估指标[2],其值越小代表效果越好。不同方法进行仪表读数识别的定量结果见表4,可以看出笔者所提方法要优于其他方法。图13展示了笔者所提方法的可视化结果。

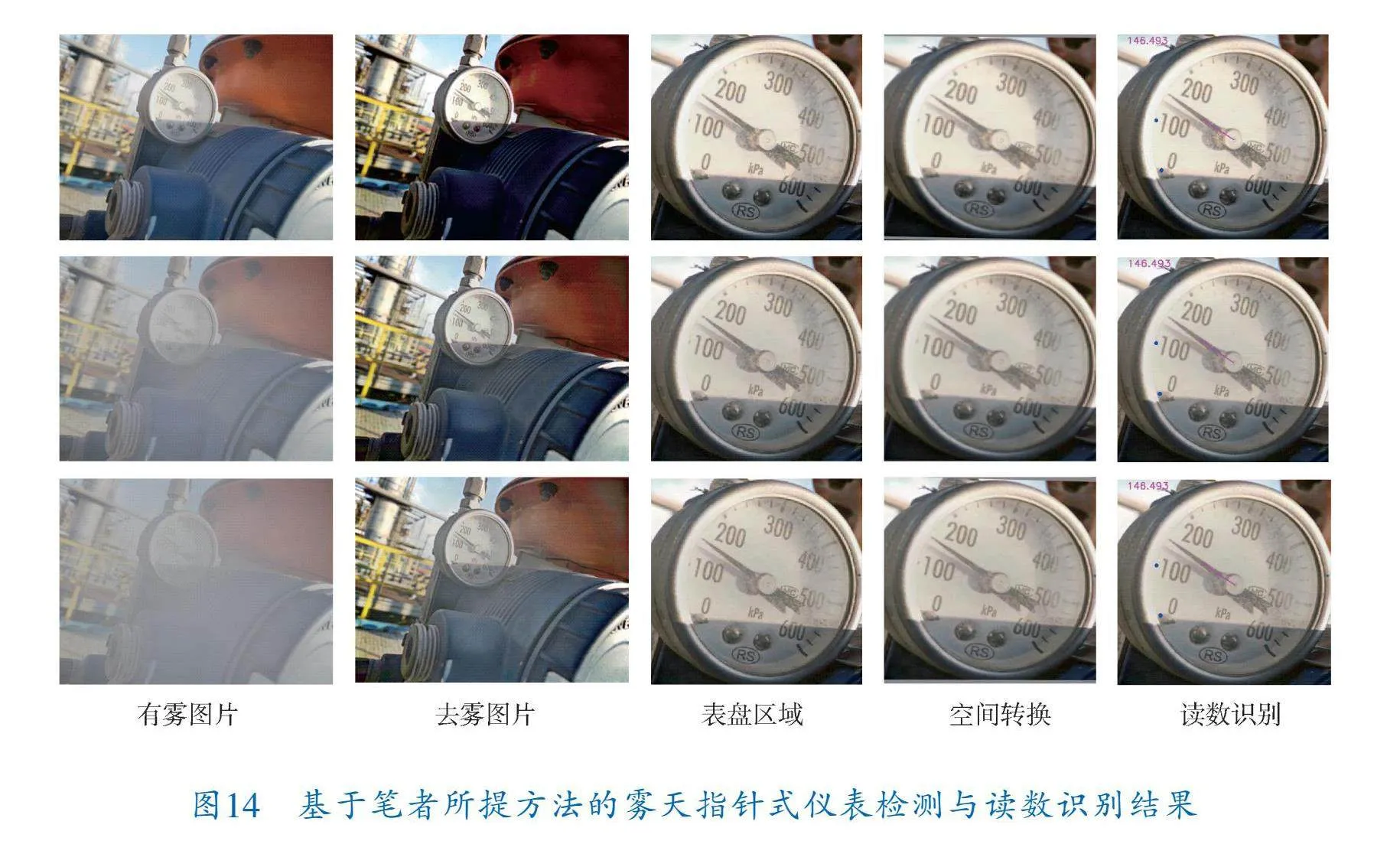

4.4 雾天指针式仪表检测与读数识别实验

表5为经过不同去雾算法去雾后对雾天环境下捕获的指针式仪表进行检测与读数识别的结果,可以看出,经笔者提出的去雾算法去雾后读数识别准确率最高,表明所提的去雾算法对提升雾天环境下的指针式仪表检测与读数识别的准确率有显著的效果。图14展示了经过笔者所提方法进行检测与读数识别的结果。

5 结束语

笔者所提方法有效地解决了油田现场巡检机器人在雾天环境下对指针式仪表的漏检和读数识别准确率低的问题。然而,除了雾天环境外,雨雪、低光照等复杂环境也会对仪表检测与读数识别的准确率造成影响。未来的研究方向将着重优化指针式仪表在雨雪、低光照等复杂环境下的检测与读数识别算法,以提升算法在复杂环境下的泛化能力。

参 考 文 献

[1] 朱斌滨.雨雾环境下变电站指针式仪表识别方法[D].长沙:长沙理工大学,2021.

[2] LIU Y,LIU J,KE Y C.A detection and recognition system of pointer meters in substations based on computer vision[J].Measurement,2020,152:107333.

[3] WU X,SHI X B,JIANG Y C,et al.A High Precision A "utomatic Pointer Meter Reading System in Low Light Environment[J].Sensors,2021,21(14):4891.

[4] LIU Z,HUANG H,WANG N,et al.A pointer meter re "ading recognition method based on improved ORB algorithm for substation inspection robot[J].Journal of Physics:Conference Series,2022,2189(1).DOI:10.1088/1742 6596/2189/1/012027.

[5] WANG L,WANG P,WU L H,et al.Computer Vision B "ased Automatic Recognition of Pointer Instruments:Data Set Optimization and Reading[J].Entropy,2021,23(3):272.

[6] QIN X,WANG Z L,BAI Y C,et al.FFA Net:Feature Fusion Attention Network for Single Image Dehazing[J].Proceedings of the AAAI Conference on Artificial Intelligence,2020,34(7):11908-11915.

[7] WANG Q,WU B,ZHU P,et al.ECA Net:Efficient cha "nnel attention for deep convolutional neural networks[C]//Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition.Piscataway,NJ:IEEE,2020:11534-11542.

[8] ZHAO H,GALLO O,FROSIO I,et al.Loss Functions for Image Restoration with Neural Networks[J].IEEE Transactions on Computational Imaging,2017,3(1):47-57.

[9] SHU Y,LIU S,XU H,et al.Read Pointer Meters Based on a Human Like Alignment and Recognition Algorithm[C]//CCF National Conference of Computer Applications.Singapore:Springer Nature Singapore,2023.

[10] HE K,GKIOXARI G,DOLLR P,et al.Mask R CNN[C]//Proceedings of the IEEE International Conference on Computer Vision.Piscataway,NJ:IEEE,2017:2961-2969.

[11] HE K M,SUN J,TANG X O.Single Image Haze Removal Using Dark Channel Prior[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2011,33(12):2341-2353.

[12] LI B Y,PENG X L,WANG Z Y,et al.Aod net:All in one dehazing network[C]//Proceedings of the IEEE International Conference on Computer Vision.Piscataway,NJ:IEEE,2017:4770-4778.

[13] BAI H R,PAN J S,XIANG X G,et al.Self Guided Image Dehazing Using Progressive Feature Fusion[J].IEEE Transactions on Image Processing:A Publication of the IEEE Signal Processing Society,2022,31:1217-1229.

[14] ZHENG C,WANG S R,ZHANG Y H,et al.A robust a nd automatic recognition system of analog instruments in power system by using computer vision[J].Measurement,2016,92:413-420.

[15] GAO J W,XIE H T,ZUO L,et al.A robust pointer m eter reading recognition method for substation inspection robot[C]//2017 International Conference on Robotics and Automation Sciences(ICRAS).Piscataway,NJ:IEEE,2017:43-47.

[16] HE P L,ZUO L,ZHANG C H,et al.A value recognit "ion algorithm for pointer meter based on improved Mask RCNN[C]//2019 9th International Conference on Information Science and Technology(ICIST).Piscataway,NJ:IEEE,2019:108-113.

(收稿日期:2024-05-15,修回日期:2024-10-25)

The Method for Pointer Instrument Detection and Reading Recognition in Foggy Conditions

WU Pan chao, YANG Peng, SUN Dian yang, YANG Ming hao

(School of Electrical and Information Engineering,Northeast Petroleum University)

Abstract"" Aiming at the oilfield inspection robots’ missed detection and low recognition accuracy of the pointer instrument in foggy weather, a method which combining FFA Net dehazing network and Yolov5 detection algorithm was proposed. Firstly, it has a FFA Net algorithm improved for the foggy images and has the multi scale structure and the feature fusion residual block and optimization module based to effectively enhance the algorithm′s performance in dehazing operation; and then, as for the instrument detection and reading recognition, it has a smaller detector head adopted to improve Yolov5’s ability in detecting small targets, and has a spatial transformation module introduced to convert the dial’s images detected into a front elevation in line with human perception; finally, it has an end to end framework created to tightly couple the meter component retrieval and meter reading recognition so as to improve the accuracy of meter readings. The experimental results show that, the proposed method boasts good robustness in the oilfield foggy environment, and it improves both accuracy of detection and reading recognition of the pointer meter in foggy environment.

Key words"" image dehazing, Yolov5, instrument detection, instrument recognition