基于改进PSPNet的森林火烧迹地检测

2024-10-31张艺马永军王广来黄建平

摘 要:为提高对森林火烧迹地的检测精度,文章利用火灾后Sentinel-2卫星影像,提出一种基于改进PSPNet的森林火烧迹地检测模型。该模型以带空洞卷积的ResNet34作为主干网络,并在主干网络内部融合RFB(Receptive Field Block)模块和ULSAM(Ultra Lightweight Subspace Attention Module)模块来增强其特征提取能力;最后利用跳跃连接使模型的解码器部分充分利用主干网络输出的四个层级特征图。实验结果表明改进PSPNet模型的平均交并比和总体准确率分别为91.86%和96.89%,相比PSPNet,分别提高1.52%和0.67%。与其他语义分割模型相比,改进模型得到的分割结果细节更加丰富,且具有较好的泛化性能。

关键词:森林火灾;火烧迹地;多光谱卫星影像;深度学习;语义分割

中图分类号:TP391.4;S762.3;P237 文献标识码:A 文章编号:2096-4706(2024)17-0043-07

0 引 言

森林作为陆地生态系统的主体,在碳循环和气候调节方面发挥着重要作用。林火对森林生态系统造成严重破环,并带来极大的经济损失。森林火烧迹地指的是森林经过火灾烧毁后尚未恢复到原始森林状态的土地,它提供了火灾发生的位置、面积等信息[1]。森林火烧迹地的准确绘制对于燃烧生物量估计和灾后植被恢复研究具有重要意义[2-3]。传统的火烧迹地信息主要来源于统计数据,存在收集困难,难以覆盖较大区域的缺点,遥感技术具有监测范围广、时效性强等优势,成为检测火烧迹地的重要手段[4]。

火灾发生前后的植被光谱特征会发生显著变化,这些特征是遥感提取火烧迹地的基础[5]。研究人员利用多光谱卫星影像,通过计算植被指数再设定阈值的方式提取火烧迹地[6]。常用的植被指数有过火区识别指数(Burned Area Index)、增强型植被指数(Normalized Difference Vegetation Index)、归一化植被指数(Normalized Difference Vegetation Index)、全球环境监测指数(Global Environment Monitoring Index)等。但是在实际研究中,植被指数阈值的设定会对火烧迹地的提取精度产生一定的影响[7]。因此,研究人员进一步使用机器学习算法如随机森林、支持向量机来提高对火烧迹地的识别精度,但是机器学习算法的性能受限于输入特征的选取[8]。

近年来,研究人员利用多光谱卫星影像,逐渐将深度学习方法应用到火烧迹地检测任务中。深度学习方法可以自动从输入的影像中提取特征,避免手动设计特征,提高了火烧迹地检测的准确性。Maskouni等[9]利用火灾前后双时相Sentinel-2影像,提出一种利用多尺度卷积的火烧迹地检测模型,其利用1×1、3×3、5×5多尺度卷积提取图像特征,提高了模型的鲁棒性,实验结果优于随机森林和支持向量机方法。Seydi等[10]利用火灾后的Sentinel-2影像,提出一种基于二次形态学算子和标准卷积层的Burnt-Net网络,它将形态学可学习尺度空间算子与多尺度残差块相结合,以增强模型的特征提取能力。Knopp等[11]利用火灾后Sentinel-2影像,利用U-Net检测火烧迹地,取得了较好的效果,但仍然存在背景像素(如海岸、农田和火山岩等)与火烧迹地像素间的错误分类问题。

利用深度学习方法提高对火烧迹地的检测精度是当前研究的重要问题。因此,本文以加拿大不列颠哥伦比亚省(British Columbia, BC)Bulkley-Nechako地区的森林火烧迹地为研究对象,利用火灾后Sentinel-2影像,提出一种改进PSPNet的森林火烧迹地检测模型。改进的模型以带空洞卷积的ResNet34作为主干网络,同时在主干网络内部融合了感受野模块(Receptive Field Block, RFB)和超轻量级子空间注意力模块(Ultra-Lightweight Subspace Attention Module, ULSAM),并使用跳跃连接使模型解码端充分利用主干网络的4个层级特征图。

1 实验数据与方法

1.1 实验数据

1.1.1 研究区域概况

BC省位于加拿大西部,南与美国华盛顿州、爱达荷州及蒙大拿州接壤,北邻育空地区、西北地区及美国阿拉斯加州。BC省的森林资源十分丰富,林业是该省的支柱产业。2018年,BC省发生了严重的森林火灾。本文以2018年BC省Bulkley-Nechako地区的森林火烧迹地为研究对象,其地理位置介于124°35′~126°55′W,52°23′~54°39′N之间。

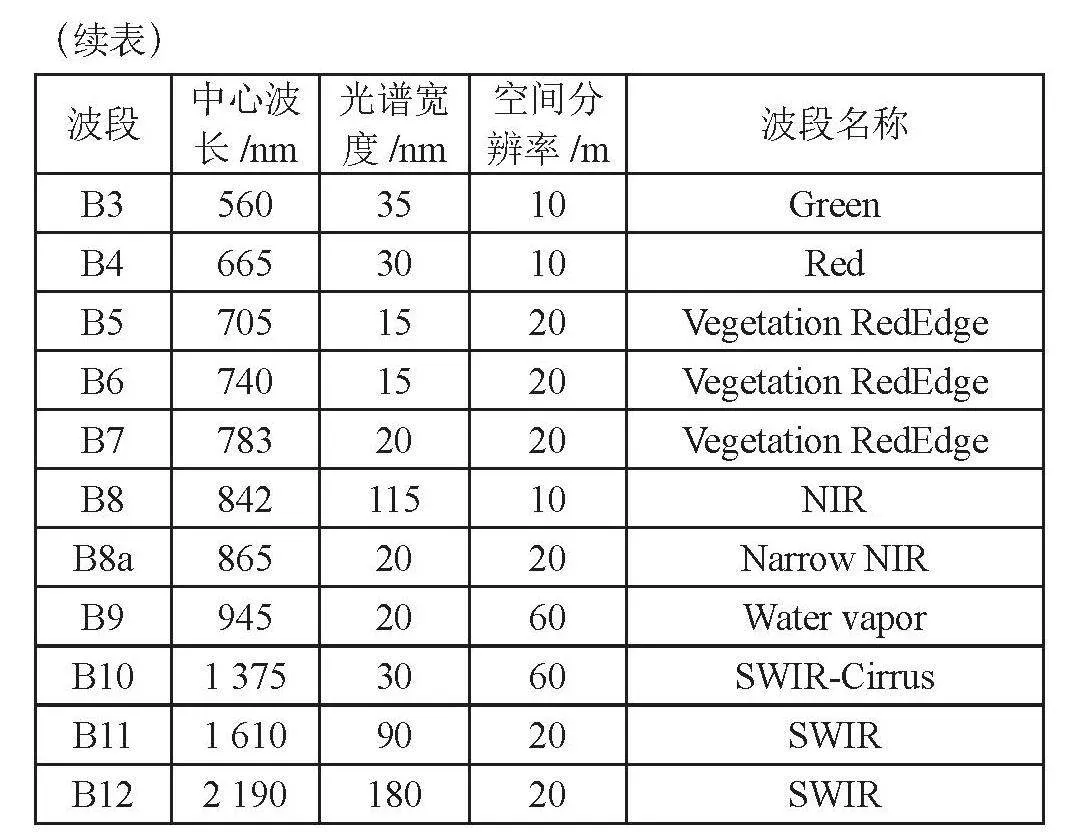

1.1.2 Sentinel-2影像介绍

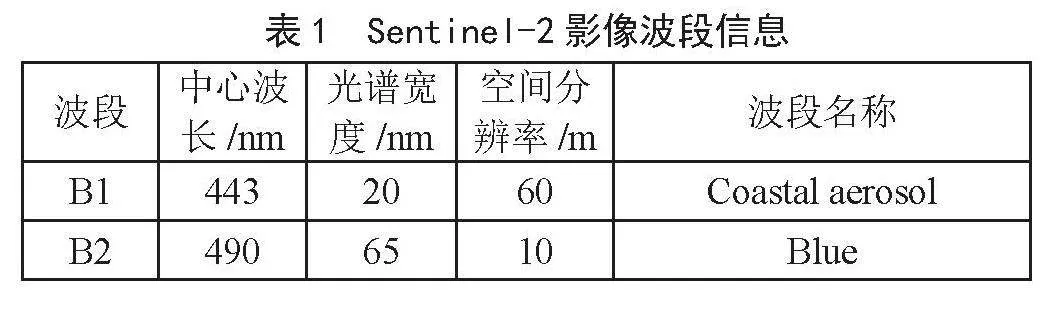

Sentinel-2是欧洲空间局哥白尼计划中的一项地球观测任务,可以拍摄地球表面的中分辨率影像,可用于森林监测、土地覆盖变化侦测等领域。Sentinel-2影像覆盖13个光谱波段,光谱范围涵盖可见光、近红外与短波红外,幅宽达290 km;具有不同的空间分辨率,分别为10 m、20 m和60 m;其分为2A和2B两颗卫星,一颗卫星的重访周期为10天,两颗互补,重访周期为5天。Sentinel-2影像各波段信息如表1所示。Sentinel-2影像可通过欧空局官网下载。

1.1.3 森林火烧迹地矢量标注介绍

林火是加拿大的主要自然干扰之一,对森林生态系统造成了重要影响。因此加拿大测绘和地球观测中心以及加拿大自然资源部林务局联合开发了加拿大国家烧毁面积综合数据(National Burned Area Composite, NBAC),用于计算自1986年以来每年在加拿大全国范围内的燃烧的森林面积。NBAC数据是一个火灾周界地图,准确地给出了每一场森林火灾发生的地理位置和实际烧毁区域,并提供了火灾开始时间、结束时间等信息,其以Shapefile矢量文件发布[12]。

1.1.4 语义分割数据集制作

本文利用Sentinel-2影像和火烧迹地矢量标注数据来制作深度学习语义分割数据集,具体步骤如下:

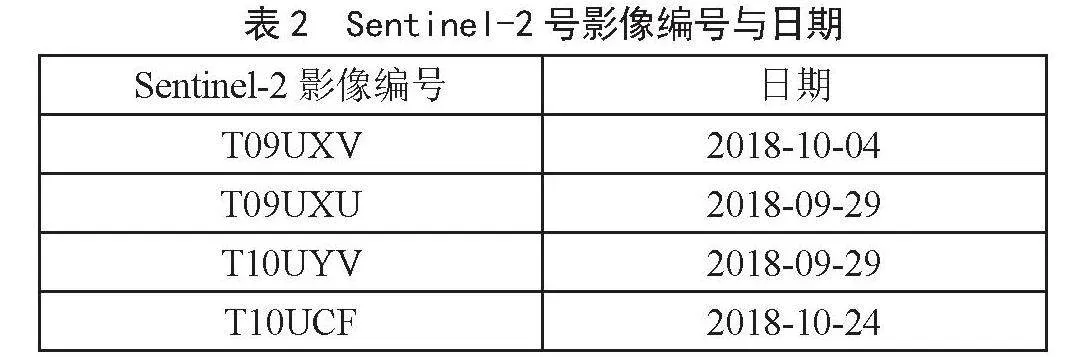

1)首先下载接近火灾结束时间且云量少的Sentinel-2影像,本实验所使用的四景Sentinel-2影像编号与日期如表2所示。下载的Sentinel-2影像是经过几何精校正的L1C产品,尚未经过大气校正,故使用Sec2Cor软件对L1C产品大气校正得到L2A产品。

2)经过大气校正后,影像的B1和B10波段被自动剔除,最后得到包含11波段的卫星影像。由于Sentinel-2影像的各波段的分辨率存在差异,故使用SNAP软件将各波段重采样至10 m分辨率。

3)利用Arcmap软件将Sentinel-2影像与火烧迹地标注数据统一到同一坐标系,使得影像与标注的空间位置一一对应。

4)原始火烧迹地标注为矢量数据,不能直接作为深度学习语义分割模型的标签。故利用Arcmap软件定义矢量标注中的火烧迹地的类别为l,除火烧迹地外的背景类别为0,再通过Arcmap的面转栅格功能,得到栅格标签。栅格标签中的0值代表背景,1值代表火烧迹地。并根据火烧迹地的范围进一步确定实际所用的影像大小。

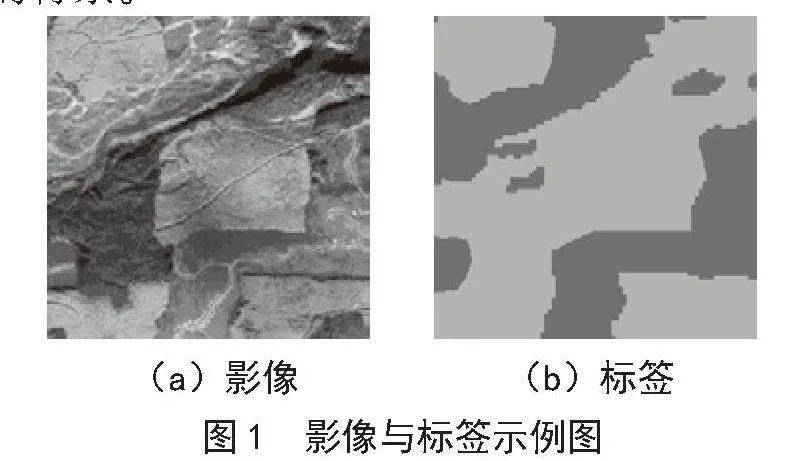

5)将卫星影像和标签均裁剪为256×256像素大小的图像,总计2 142张图片,其中影像的波段数为11。然后将所有图片按照6:2:2比例划分为训练集、验证集和测试集。256×256像素大小的图像(B12、B8、B2波段合成的伪彩色图像)及其标签如图1所示,在标签中黑色代表森林火烧迹地,灰色代表除火烧迹地外的背景。

1.2 改进PSPNet模型

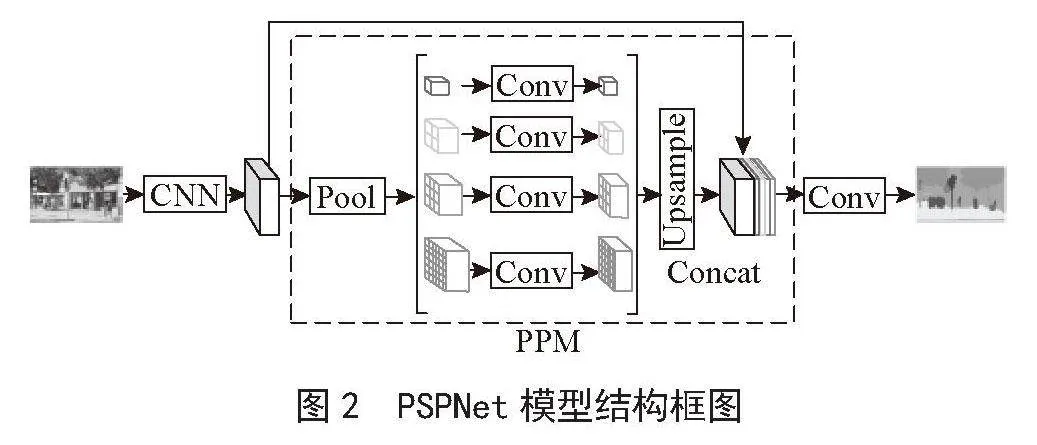

PSPNet是一种深度学习语义分割模型,它最主要的特点是采用金字塔池化模块(Pyramid Pooling Module, PPM)。利用该模块实现不同尺度信息的有效融合,从而更加有效的捕获全局信息。PSPNet的整体结构如图2所示。

PSPNet利用带空洞卷积的ResNet来提取图像特征,然后将提取到的特征送入金字塔池化模块。金字塔池化模块使用4个不同尺度的池化操作将输入特征图分别池化为1×1、2×2、3×3和6×6大小的特征图,然后利用1×1卷积分别对4组特征图进行降维。利用双线性插值将4组特征图上采样为输入特征图大小,并将其与ResNet输出的特征图进行拼接。最后经过卷积运算及上采样操作得到最终的预测结果。

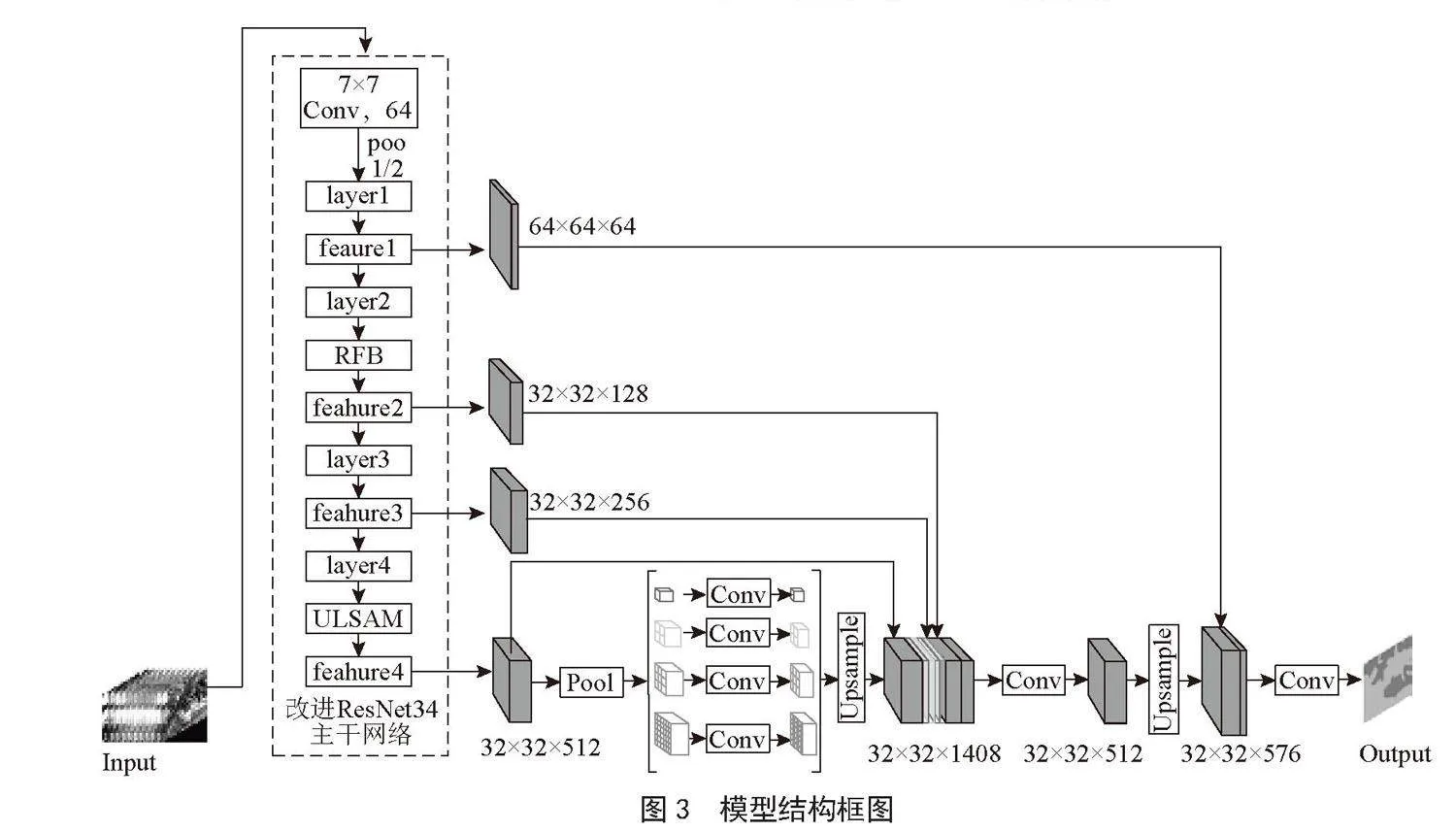

本文首先选取带空洞卷积的ResNet34作为PSPNet的主干网络,在其基础上进行改进,改进模型的整体结构如图3所示。模型输入数据为256×256像素大小,波段数为11的多光谱图像,图像中包含丰富的光谱信息;模型的输出结果为256×256像素大小的0-1二值图像。

本文改进模型的特点如下:

1)为了加强主干网络对于图像特征的提取,改进模型在原主干网络的layer2后引入RFB模块。RFB模块利用不同尺寸的卷积核以及不同空洞率的卷积核,增大了模型的感受野,实现了基于不同尺寸的特征提取。

2)考虑到卫星影像中包含的地物信息复杂,如森林、水体、阴影和火烧迹地等,故在原主干网络的layer4后嵌入ULSAM模块,来突出有效特征,减小复杂背景特征的干扰,从而更加有效的区分前景与背景。同时ULSAM模块有着较低的计算量,避免了过多的运算开销。

3)输入图像经过改进主干网络运算后,分别输出四个层级的特征图,采用feature1、feature2、feature3和feature4表示,其大小分别为64×64×64、32×32×128、32×32×256和32×32×512,与原主干网络输出的四个层级特征图大小保持一致。

PSPNet在模型解码端仅利用了原主干网络的feature4,feature4作为深层特征图,其包含着较多的语义信息,但是缺乏细节信息。feature1、feature2等浅层特征图包含着较多的细粒度信息,如颜色、纹理和边缘等特征,故本文采用跳跃连接使模型解码器部分充分利用改进主干网络的深层特征图与浅层特征图。首先将feature2、feature3与金字塔池化模块输出的特征图进行拼接,之后利用3×3卷积降维,并将输出的特征图再上采样为高宽为64×64的特征图。接着将上采样得到的特征图与feature1进行拼接,再利用3×3卷积对拼接后的特征图进行降维,最后通过双线性插值上采样获得森林火烧迹地的分割结果。

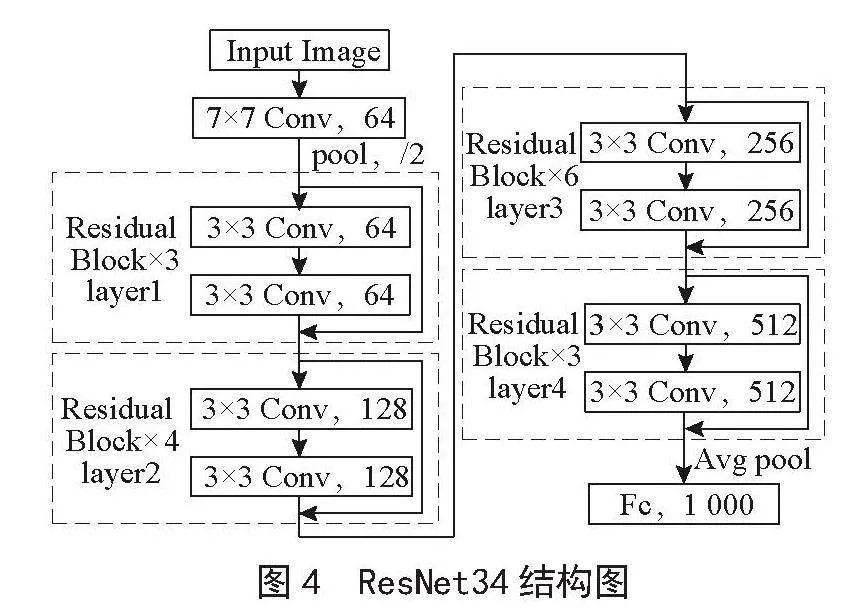

1.2.1 ResNet网络

ResNet通过残差模块中的跳跃连接将前面的特征直接传递到后面的层中,避免了神经网络训练过程中因网络层数过深而产生的梯度消失问题,提高了模型的表达能力和性能。ResNet34是一种较浅的ResNet网络,其具有较少的参数量和计算量,在许多视觉任务上表现出了良好的性能。ResNet34的结构示意图如图4所示。ResNet34通过残差块来提取图像特征,然后对提取到的特征进行全局平均池化,最后通过全连接层得到每一个类别输出的概率。

在语义分割模型设计中,研究人员使用去除全连接层的ResNet作为主干网络来提取图像特征。当输入图像的高宽为256×256时,经过ResNet的layer1、layer2、layer3和layer4运算后,特征图尺寸不断减小,分别输出高宽为64×64、32×32、16×16和8×8的特征图。最终输出的特征图尺寸为输入图像尺寸的1/32,使得图像特征信息丢失。为避免该问题,研究人员将空洞卷积结合到ResNet中。当输入图像的高宽为256×256时,带空洞卷积的ResNet输出的四个层级特征图的高宽分别为64×64、32×32、32×32和32×32。最终输出的特征图尺寸为输入图像尺寸的1/8,该方式有效提高了主干网络输出特征图的分辨率。

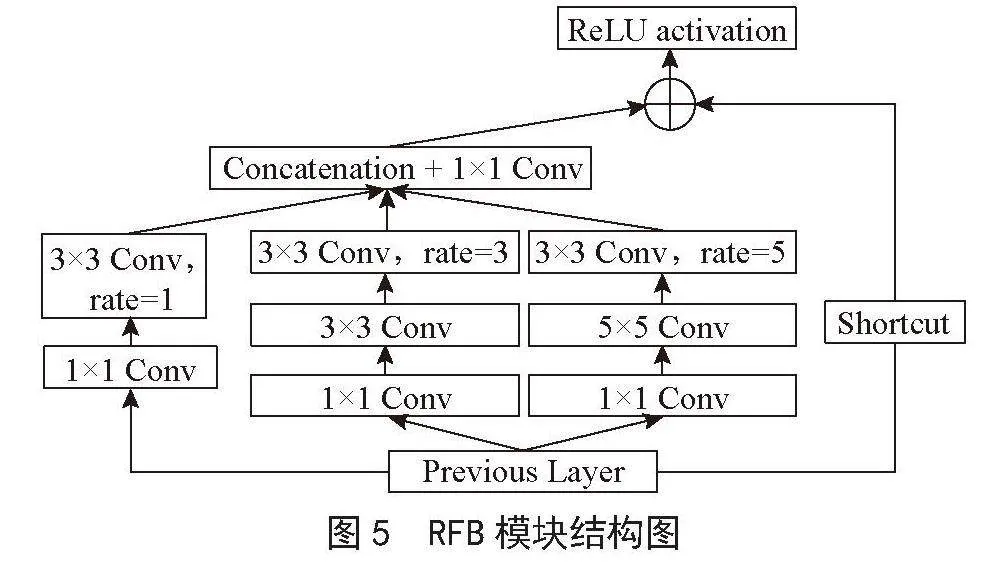

1.2.2 RFB模块

RFB[13]模块利用不同尺寸的卷积核组成多分支结构,模块结构如图5所示。在该模块中分别使用了1×1、3×3和5×5大小的卷积核,其特征提取能力优于使用相同尺寸的卷积核的网络结构。同时在该模块中分别使用了空洞率为1、3、5的3×3空洞卷积。空洞卷积在参数不变的情况下,增大了卷积核的感受野,使得每个卷积核的输出包含较大的范围,并且保证输出的特征图大小保持不变。另外RFB模块引入Shortcut结构,用来减轻深层网络的训练负担。

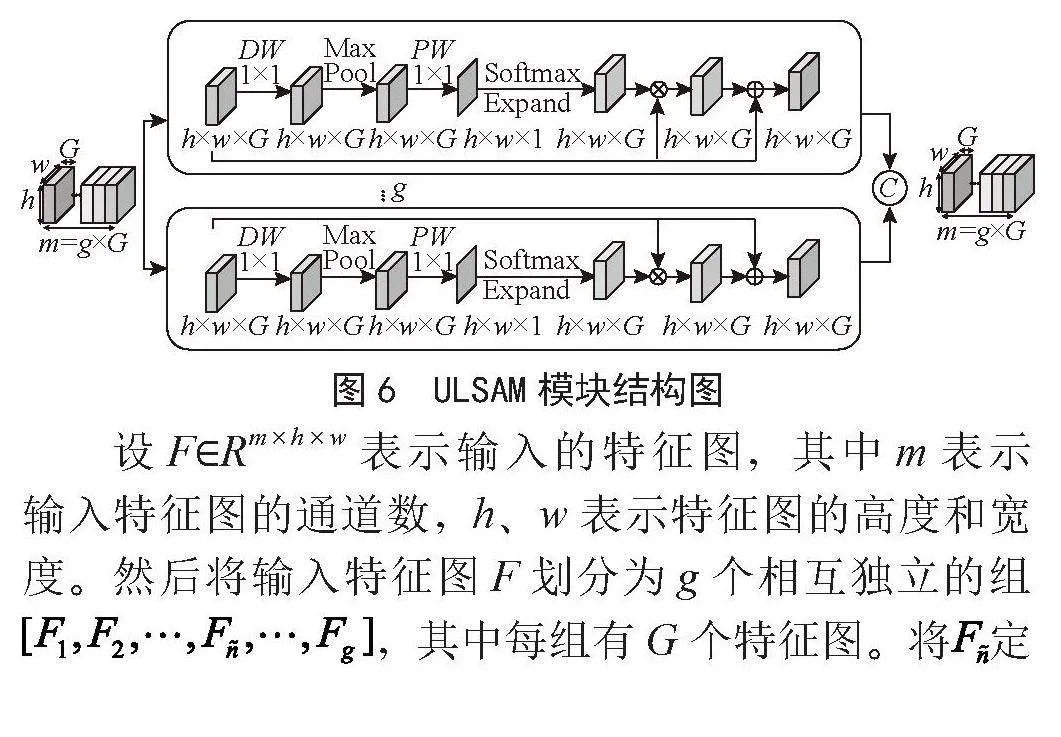

1.2.3 ULSAM模块

ULSAM[14]模块是一个空间注意力模块,它能够自适应地学习特征图之间的依赖关系,使模型更加关注图像中的有效特征。ULSAM模块为每个特征图子空间推断不同的注意力图,从而实现多尺度与多频率的特征表示。ULSAM模块结构示意图如图6所示。

设F∈Rm×h×w表示输入的特征图,其中m表示输入特征图的通道数,h、w表示特征图的高度和宽度。然后将输入特征图F划分为g个相互独立的组,其中每组有G个特征图。将定义为一组特征图,注意力图计算式如式(1)所示。式中,DW1×1表示1×1深度卷积;MaxPool3×3,1表示池化核尺寸为3×3,填充为1的最大池化操作;PW1×1表示1×1逐点卷积;Softmax为Softmax激活函数。每组特征图经过特征重分配后得到精细化的特征图,如式(2)所示。然后对不同组的输出特征图在通道维度上进行拼接得到最终的输出结果,如式(3)所示。在本文中,设置分组数g=4。

(1)

(2)

(3)

2 实验与结果分析

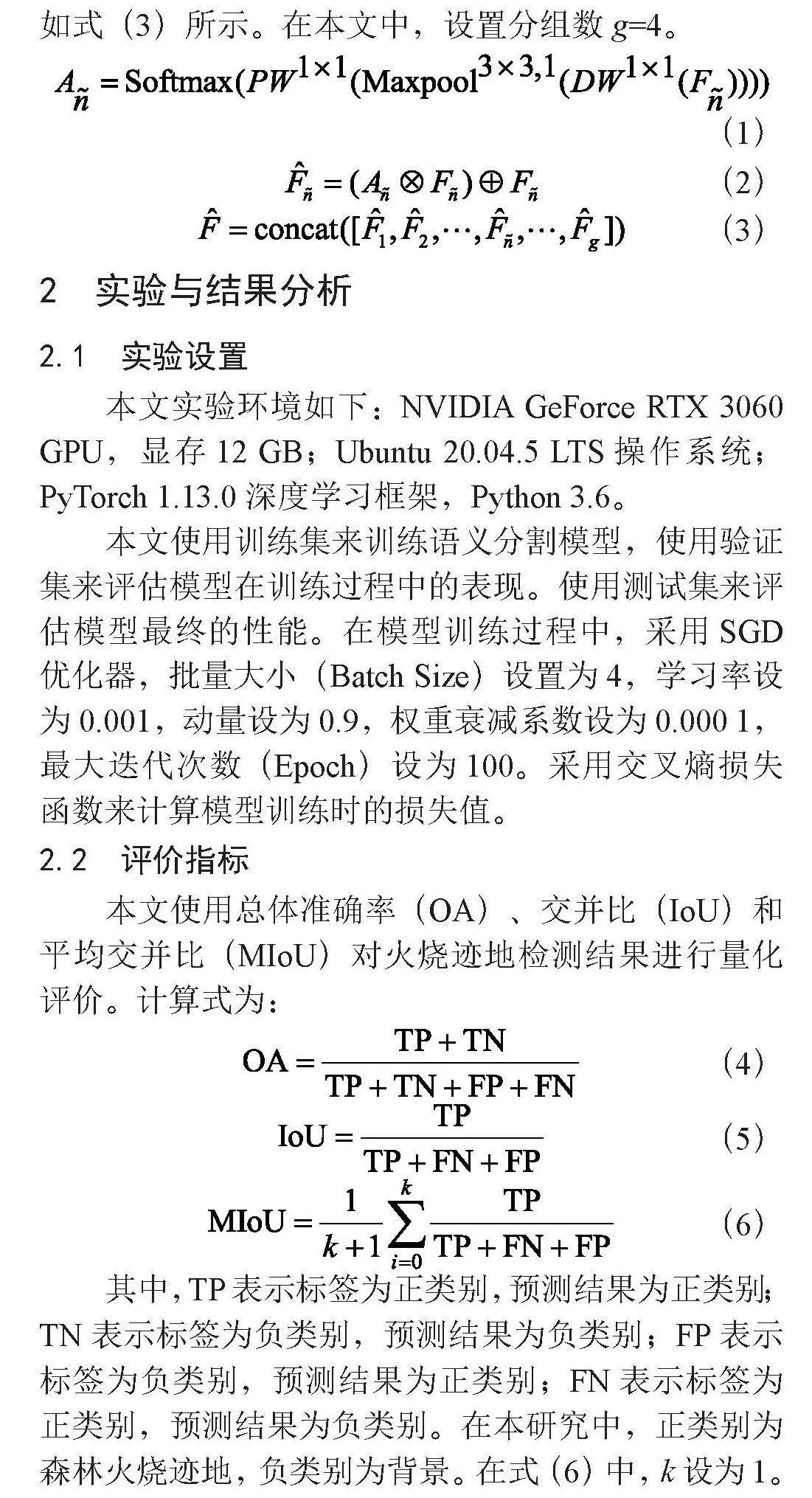

2.1 实验设置

本文实验环境如下:NVIDIA GeForce RTX 3060 GPU,显存12 GB;Ubuntu 20.04.5 LTS操作系统;PyTorch 1.13.0深度学习框架,Python 3.6。

本文使用训练集来训练语义分割模型,使用验证集来评估模型在训练过程中的表现。使用测试集来评估模型最终的性能。在模型训练过程中,采用SGD优化器,批量大小(Batch Size)设置为4,学习率设为0.001,动量设为0.9,权重衰减系数设为0.000 1,最大迭代次数(Epoch)设为100。采用交叉熵损失函数来计算模型训练时的损失值。

2.2 评价指标

本文使用总体准确率(OA)、交并比(IoU)和平均交并比(MIoU)对火烧迹地检测结果进行量化评价。计算式为:

(4)

(5)

(6)

其中,TP表示标签为正类别,预测结果为正类别;TN表示标签为负类别,预测结果为负类别;FP表示标签为负类别,预测结果为正类别;FN表示标签为正类别,预测结果为负类别。在本研究中,正类别为森林火烧迹地,负类别为背景。在式(6)中,k设为1。

2.3 实验结果

2.3.1 不同模型对比

本文改进模型与其他语义分割模型(PSPNet[15]、SegFormer-B0[16]、U-Net[17])在测试集上的实验结果如表3所示。从表中可以看出,本文改进模型的IoU、MIoU和OA指标均优于PSPNet、SegFormer-B0和U-Net;与PSPNet相比,改进模型的IoU、MIoU和OA分别提高了2.11%、1.52%和0.67%。

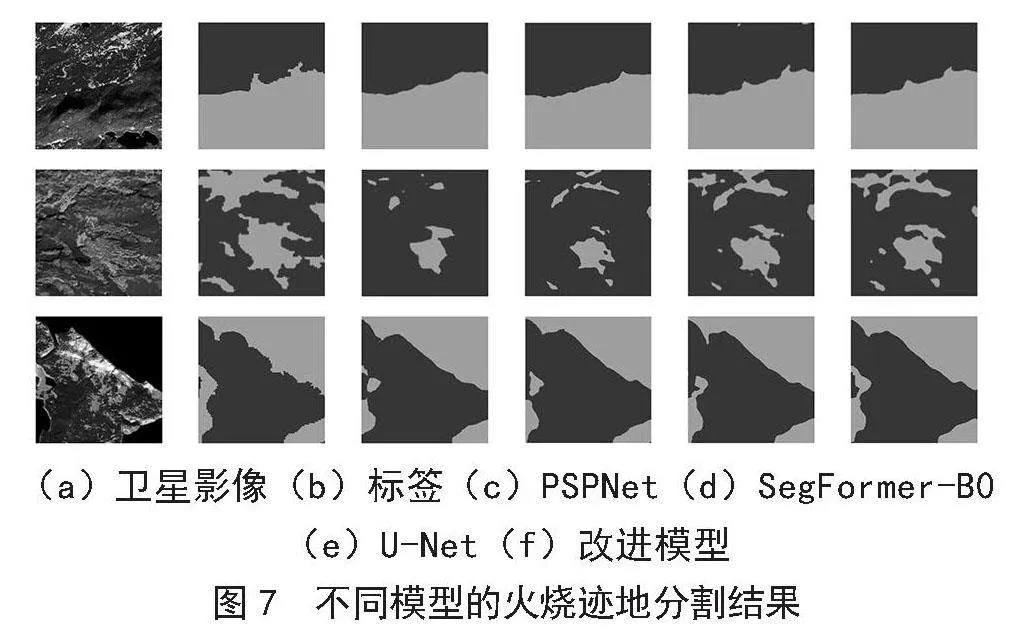

不同语义分割模型的检测结果对比图如图7所示。从第一行可以看出,PSPNet和SegFormer B0检测得到的火烧迹地边缘细节较差,U-Net和改进模型则表现较好。从第二行可以看出,四种模型均出现不同程度的错误分类,PSPNet的检测效果最差,改进模型的检测效果最好。从第三行可以看出,改进模型检测得到的火烧迹地边缘更加准确清晰,优于其他3个模型。整体而言,本文改进模型减少了火烧迹地像素与背景像素的错误分类,具有较好的检测能力。

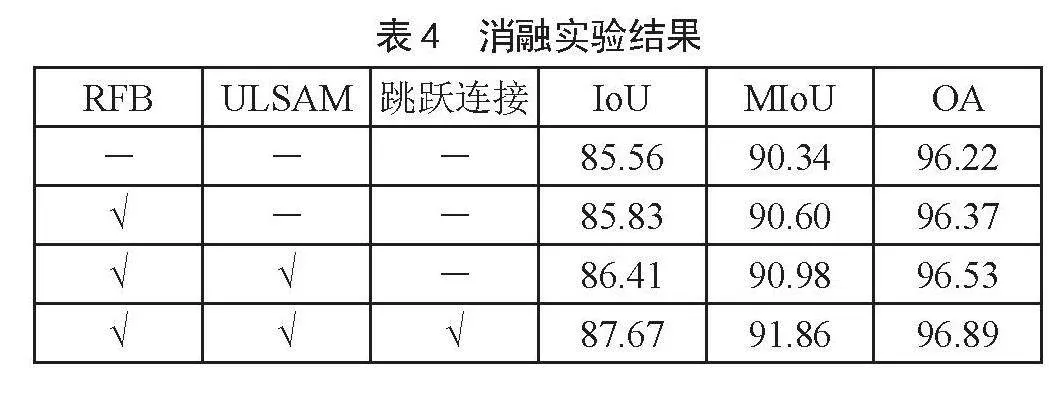

为了验证RFB模块、ULSAM模块和利用跳跃连接融合主干网络浅层特征图对模型的有效性,本文进行消融实验,结果如表4所示。从表中可以看出,加入RFB模块后,模型的IoU、MIoU和OA分别提高了0.27%,0.26%和0.15%,再加入ULSAM模块后,模型的IoU、MIoU和OA分别提高0.58%,0.38%和0.16%。这说明扩大感受野和通过空间注意力机制突出有效特征有助于模型对火烧迹地的检测。利用跳跃连接融合主干网络输出的浅层特征图对模型的IoU、MIoU和OA提升较大,分别提高了1.26%、0.88%和0.36%,说明浅层的细节特征信息对模型检测火烧迹地有着重要的作用。

2.3.2 不同模型泛化性能对比

为了验证本文改进模型与其他模型的泛化能力,本文以2018年BC省Kitimat-Stikine地区的森林火烧迹地作为研究对象。根据火灾的结束时间,选取了一景Sentinel-2影像,影像编号为T09VUE,日期为2018年9月18日。按照上述方法对卫星影像进行预处理,并对影像进行裁剪,得到一幅7 180×5 201像素大小、波段数为11的卫星影像。

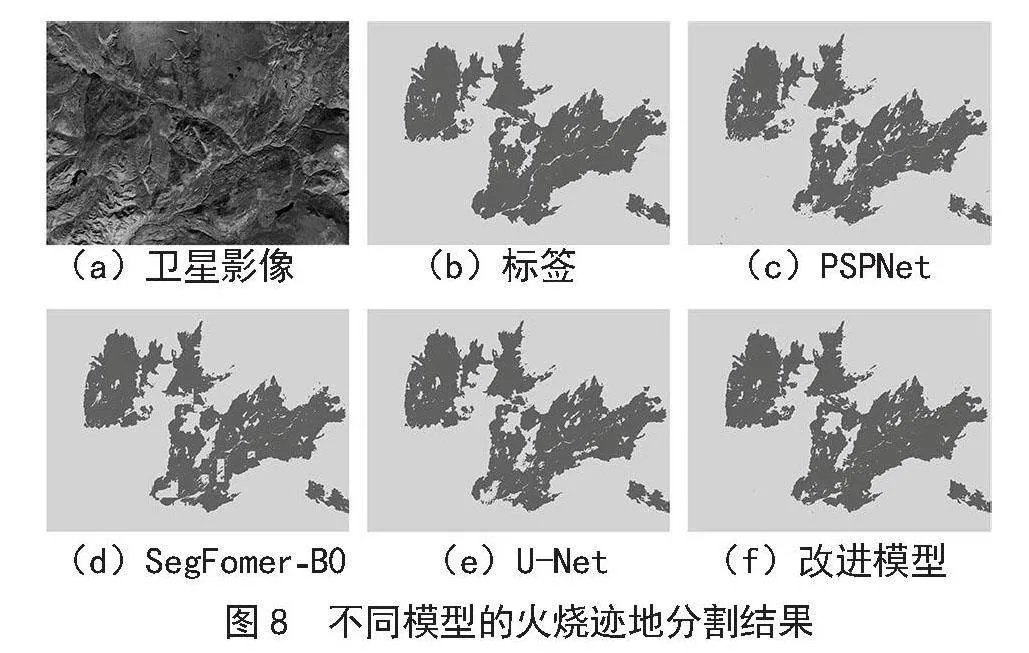

将该影像利用滑窗裁剪为256×256像素大小图像,分别输入到PSPNet、SegFormer-B0、U-Net和改进模型进行预测。然后将得到的预测结果依次进行拼接,得到一幅完整的预测图,预测结果示意如图8所示。从图中可以看出,PSPNet、SegFormer-B0和U-Net模型均出现了不同程度的欠分割问题,而改进模型的分割细节更加丰富。

同时计算不同模型对该影像分割结果的OA、IoU和MIoU,实验结果如表5所示,从表中可以看出,改进模型检测结果优于其他3个模型,其具有较好的泛化性能。

3 结 论

为了提高对森林火烧迹地的检测精度,本文提出一种改进PSPNet的森林火烧迹地检测模型,并采用10 m分辨率的Sentinel-2多光谱影像进行了实验。本文以带空洞卷积的ResNet34作为模型主干网络,并在主干网络内部结合RFB和ULSAM模块,最后在模型的解码器部分利用跳跃连接充分融合主干网络输出的四个层级特征图。实验结果表明,RFB、ULSAM模块和融合浅层特征有效增强了模型对火烧迹地的检测能力。与其他语义分割模型相比,改进模型对森林火烧迹地的检测精度更高,且具有较好的泛化性能,且具有较好的泛化性能。

参考文献:

[1] 吴立叶,沈润平,李鑫慧,等.不同遥感指数提取林火迹地研究 [J].遥感技术与应用,2014,29(4):567-574.

[2] 苗庆林,田晓瑞,赵凤君.大兴安岭不同植被火后NDVI恢复过程 [J].林业科学,2015,51(2):90-98.

[3] SHIRAISHI T,HIRATA R. Estimation of Carbon Dioxide Emissions from the Megafires of Australia in 2019–2020 [J/OL].Scientific Reports,2021,11(1):8267[2024-2-10].https://doi.org/10.1038/s41598-021-87721-x.

[4] 郝帅,王星,张秋良,等.大兴安岭火烧迹地遥感提取研究 [J].林业资源管理,2022(2):75-81.

[5] 杨伟,姜晓丽.森林火灾火烧迹地遥感信息提取及应用 [J].林业科学,2018,54(5):135-142.

[6] 廖瑶,李雪,刘芸,等.基于植被指数的高分一号遥感影像火烧迹地提取评价[J].自然灾害学报,2021,30(5):199-206.

[7] 韩丽,戴必辉,王秋华,等.影像选择及阈值对dNBR提取火烧迹地的影响 [J].遥感信息,2023,38(1):47-55.

[8] 牛方天,孙林,于会泳,等.地表反射率遥感数据支持的火烧迹地面积提取 [J].地球信息科学学报,2023,25(9):1855-1868.

[9] MASKOUNI F H,SEYDI S T. Forest Burned Area Mapping Using Bi-Temporal Sentinel-2 Imagery Based on a Convolutional Neural Network: Case Study in Golestan Forest [J/OL].Engineering Proceedings,2021,10(1):6[2024-02-06].https://www.mdpi.com/2673-4591/10/1/6.

[10] SEYDI S T,HASANLOU M,CHANUSSOT J. Burnt-Net: Wildfire Burned Area Mapping with Single Post-Fire Sentinel-2 Data and Deep Learning Morphological Neural Network [J/OL].Ecological Indicators,2022,140:108999[2024-01-20]. https://doi.org/10.1016/j.ecolind.2022.108999.

[11] KNOPP L,WIELAND M,RÄTTICH M,et al. A Deep Learning Approach for Burned Area Segmentation with Sentinel-2 Data [J/OL].Remote Sensing,2020,12(15):2422[2024-01-20].https://www.mdpi.com/2072-4292/12/15/2422.

[12] HALL R J,SKAKUN R S,METSARANTA J M,et al. Generating Annual Estimates of Forest Fire Disturbance in Canada: the National Burned Area Composite [J].International journal of wildland fire,2020,29(10):878-891.

[13] LIU S T,HUANG D,WANG Y H. Receptive Field Block Net for Accurate and Fast Object Detection [C]//Proceedings of the European conference on computer vision (ECCV).Munich:Springer,2018:404-419.

[14] SAINI R,JHA N K,DAS B,et al. Ulsam: Ultra-Lightweight Subspace Attention Module for Compact Convolutional Neural Networks [C]//2020 IEEE Winter Conference on Applications of Computer Vision (WACV).Snowmass:IEEE,2020:1616-1625.

[15] ZHAO H S,SHI J P,QI X J,et al. Pyramid Scene Parsing Network [C]//2017 IEEE conference on computer vision and pattern recognition.Honolulu:IEEE,2017:6230-6239.

[16] XIE E,WANG W H,YU Z D,et al. SegFormer: Simple and Efficient Design for Semantic Segmentation with Transformers [J].Advances in neural information processing systems,2021,34:12077-12090.

[17] RONNEBERGER O,FISCHER P,BROX T. U-Net: Convolutional Networks for Biomedical Image Segmentation [C]//International Conference on Medical Image Computing and Computer-Assisted Intervention.Munich:Springer,2015:234-241.

作者简介:张艺(1997—),男,汉族,山西晋中人,硕士研究生,主要研究方向:深度学习、图像分割;通信作者:黄建平(1982—),男,汉族,福建武夷山人,副教授,博士,主要研究方向:从事视觉检测、图像处理研究。

DOI:10.19850/j.cnki.2096-4706.2024.17.009

收稿日期:2024-03-13

基金项目:中央高校基本科研业务费专项资助基金(2572019CP19)

Forest Burned Area Detection Based on Improved PSPNet

ZHANG Yi, MA Yongjun, WANG Guanglai, HUANG Jianping

(College of Computer and Control Engineering, Northeast Forestry University, Harbin 150040, China)

Abstract: In order to improve the detection accuracy of forest burned area, this paper uses Sentinel-2 satellite images after the fire to propose a forest burned area detection model based on improved PSPNet. This model employs ResNet34 with dilated convolution as the backbone network and fuses the RFB module and ULSAM module inside the backbone network to enhance its feature extraction capability. Finally, skip connection is used to make the decoder part of the model make full use of the four-level feature maps output by the backbone network. The experimental results show that the MIoU and overall accuracy of the improved PSPNet model is 91.86% and 96.89%, respectively, which is 1.52% and 0.67% higher than PSPNet. Compared with other semantic segmentation models, segmentation outcomes achieved by the improved model exhibit richer details and have better generalization performance.

Keywords: forest fire; burned area; multispectral satellite image; Deep Learning; semantic segmentation