基于传感器的人体活动识别与应用

2024-09-30何玲杨一刘丹章杰

文章编号1000-5269(2024)05-0049-09 DOI:10.15958/j.cnki.gdxbzrb.2024.05.07

收稿日期:2023-11-20

摘要:近年来,人体活动识别技术得到了迅速发展,并在安全防御、医疗健康、智能交互、体育运动等领域得到广泛应用。本文结合国内外的相关文献,围绕人体活动识别,对知识图谱、人体活动数据集及人体活动识别方法及应用进行综述。首先,指出了不同数据采集方式的人体活动识别数据集的特点。其次,梳理了各种不断提高模型的准确度和性能的人体活动识别具体方法。再次,指出了知识图谱在人体识别活动中发挥的揭示实体间的关系,为人体活动解析提供隐含知识等重要作用。最后,面对人体活动识别的实际应用,对当前研究存在的问题和发展趋势进行了总结和展望。本研究为人体活动识别研究的技术发展和实际应用提供了方向指导和技术建议。

关键词:知识图谱;人体活动数据集;人体活动识别 中图分类号:TP18 文献标志码:A

人体活动识别技术通过采集人体活动数据,分析其动态信息,从而识别人体的各种活动,在安全防御、医疗健康、智能交互、体育运动等领域具有重要研究意义[1]。目前,人体活动识别在物联网、智能家居、移动设备、健康管理、娱乐游戏等方向有广泛的应用[2]。人体的骨骼、肌肉等组织构成了一个高度冗余的运动系统,各关节具有极大的灵活性,并且人体动作具有多样性、复杂性。因此,需要大量的数据支持才能确保人体活动识别的准确性和可靠性。而知识图谱是以语义网络为特征的知识库,通过建立实体间的互联关系、以结构化的方式组织和表示知识。知识图谱作为一种揭示实体间关系的语义网络知识库,已经成为人工智能研究的热点之一[3]。由于知识图谱可以建立实体间的关联关系,以结构化的方式组织和表示知识,可以为人体活动识别的研究提供重要的数据范围和研究基础。通过构建人体活动的知识图谱,可以将人体活动的各个要素抽象成实体,并分析它们之间的关系,从而实现人体活动的识别、生成、预测,以及姿态估计、运动优化等功能[4]。

随着传感器技术和智能算法的不断进步,人体活动识别将在更多领域得到应用,如医学、农业、纺织业、制造业[5]等。同时,与其他相关技术的结合也将进一步推动人体活动识别技术的发展。

1人体活动数据集

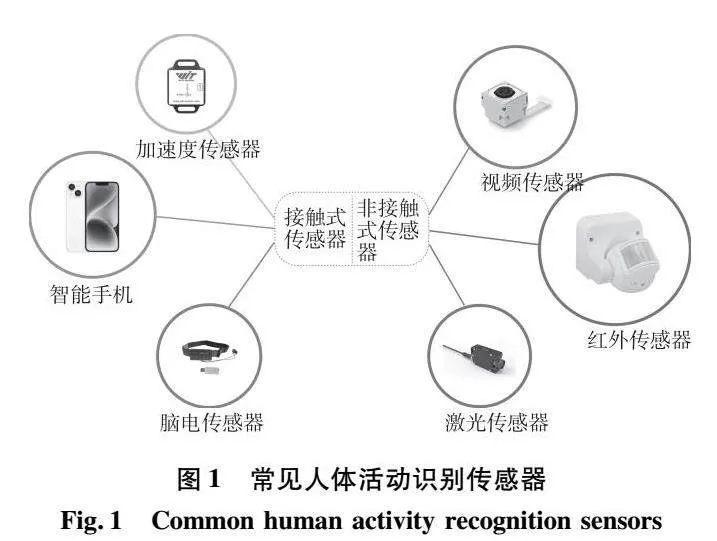

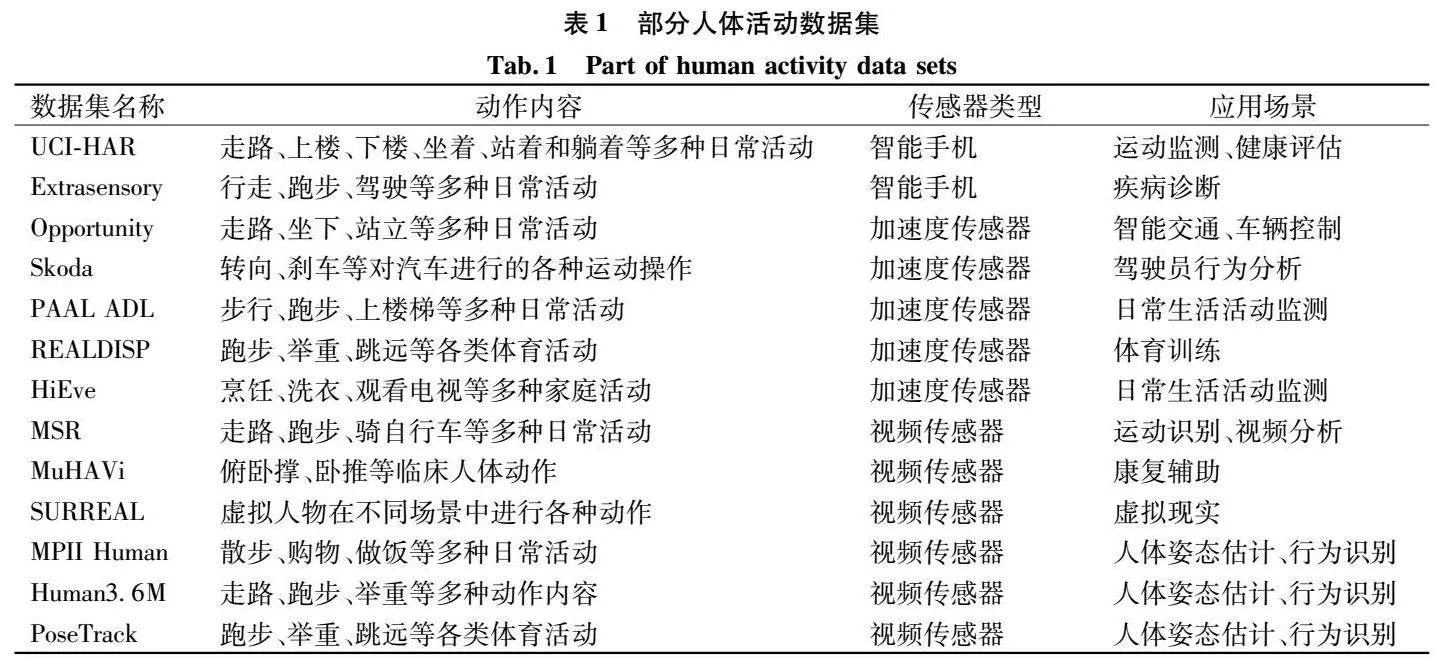

人体活动识别是一项复杂而关键的技术,需要大量的数据支持才能确保准确性和可靠性。为了满足这一需求,研究人员和学者们创建了许多人体活动识别数据集。这些数据集包含了各种不同的人体活动样本以及相应的标注信息,为研究者们提供了宝贵的资源。由于人体是一个多自由度冗余系统,人体活动具有复杂性和多样性,为准确识别人体活动,需要大量的活动数据支持,因此,以人体活动识别为目的的数据集超过万种。根据当前主要的人体活动识别方法中使用到的数据采集传感器类型,人体活动识别数据采集主要分为基于接触方式采集数据和基于非接触方式采集数据。基于接触方式的数据集主要通过加速度计、陀螺仪、磁力计以及智能手机、手表等传感器来采集数据,用于监测人体生理信号。基于非接触方式的数据集可以采用视频传感器或直接使用图像、视频信息识别人体活动。表1总结了文献中常见的人体活动识别数据集。图1列举了目前常用的一些人体活动识别传感器。

数据集名称动作内容传感器类型应用场景UCI-HAR走路、上楼、下楼、坐着、站着和躺着等多种日常活动智能手机运动监测、健康评估 Extrasensory行走、跑步、驾驶等多种日常活动智能手机疾病诊断Opportunity走路、坐下、站立等多种日常活动加速度传感器智能交通、车辆控制Skoda转向、刹车等对汽车进行的各种运动操作加速度传感器驾驶员行为分析PAAL ADL步行、跑步、上楼梯等多种日常活动加速度传感器日常生活活动监测REALDISP跑步、举重、跳远等各类体育活动加速度传感器体育训练HiEve烹饪、洗衣、观看电视等多种家庭活动加速度传感器日常生活活动监测MSR走路、跑步、骑自行车等多种日常活动视频传感器运动识别、视频分析MuHAVi俯卧撑、卧推等临床人体动作视频传感器康复辅助SURREAL虚拟人物在不同场景中进行各种动作视频传感器虚拟现实MPII Human 散步、购物、做饭等多种日常活动视频传感器人体姿态估计、行为识别Human3.6M走路、跑步、举重等多种动作内容视频传感器人体姿态估计、行为识别PoseTrack跑步、举重、跳远等各类体育活动视频传感器人体姿态估计、行为识别

表1中,前7个数据集为接触式传感器数据集,UCI-HAR[6]与Extrasensory[7]数据集分别通过让30个和200个志愿者携带智能手机,使用智能手机上的多个传感器来捕捉人类的行为和情感数据。研究人员可以利用其数据来探索行为模式和情感变化、人类活动与环境之间的关系,从而为智能设备和应用程序提供更智能化和个性化的交互体验。其中,UCI-HAR[6]数据集是一个大规模的行人动作识别数据集,包含了多种不同的场景和视角,对于研究人员的实验和算法评估具有很高的实用价值,但规模和多样性相对有限,更适用于一些较为简单的实际应用场景。而Extrasensory[7]数据集是一个多模态情感识别数据集,包含多种模态的数据,对于研究多模态情感识别算法具有很高的实用价值。此外,其规模相对较小,需要注意避免模型在训练过程中出现过拟合的情况。Opportunity、Skoda、PAAL ADL、REALDISP、HiEve数据集均采用加速度传感器。基于加速度传感器的数据集提供了实时的加速度数据,用于监测和分析物体或人体的运动状态,并且能够以高精度测量物体的加速度变化,可以提供准确的运动信息。此外,加速度传感器数据集的数据采集和处理相对简单,可快速应用于各种应用领域,如运动追踪、健康监测、智能手表等。大部分加速度传感器采集的是物体在某一方向上的加速度,因此,需要合理结合其他维度去获取物体的全方位运动信息。并且数据的测量范围有限,比较适用于速度和运动幅度较小的数据。最后,由于数据会受到噪声和漂移的影响,在处理数据前还需要进行滤波和校准处理,以提高数据质量。

后6个数据集为非接触式传感器数据集,皆采用了视频数据。MSR数据集包含了多种不同的活动和动作,涵盖了人类日常生活中常见的动作和姿势,数据规模较大,包含了大量的视频片段和动作序列,适用于训练和评估深度学习模型,同时需要注意部分视频片段的质量可能不高的问题,包括模糊、噪声等,需要进行滤波和降噪处理,提高模型的训练能力和性能评估。MPII Human数据集包含了多种类的人体姿势和活动数据,涵盖了多种不同的场景和动作,不过数据集中的各种类的视频数量相对较少,适用于对模型的泛化能力要求较小的场景。SURREAL数据集是通过合成技术生成了逼真的人体姿势和动作序列,可以用于研究姿势估计和人体活动识别等任务。MuHAVi数据集是一个多模态的人体活动识别数据集,包含了视频、深度图像和传感器数据,有助于研究多模态融合的活动识别算法。Human3.6M数据集提供了人体姿势的高精度标注,而PoseTrack数据集提供了带有人体姿势标注的视频序列。上述3个数据集的规模相对较小,适用于一些复杂度较低的活动场景。总而言之,基于视频传感器的人体活动识别数据集拥有丰富的多维信息,包括物体的形状、颜色、运动轨迹等,有助于识别不同的身体动作,其数据集通常是在实际场景中采集的,具有较高的现实意义和应用价值。不过视频数据的处理和分析需要较高的计算资源,会对计算设备产生较大的负担,需要对应的优化算法来减少负担,而且相较于其他类型的数据集,视频数据集通常较大,在数据的存储和传输方面可以进一步优化。

目前,用于人体活动识别的数据集普遍具有多样性、多模态、大规模的特点,总的来说,这些数据集在人体活动识别领域具有很高的价值,但在使用过程中也需要注意其局限性和潜在问题,在选择和使用数据集时,需要根据具体任务和需求进行评估和权衡。因为人类活动的复杂性和多样性,对于人体活动识别技术的研究和应用而言,数据的丰富性是至关重要的。现有的人体活动识别数据集虽然涵盖了许多活动类型,但仍然存在许多特定领域和场景下的人体活动需要被纳入数据库中。为了更好地理解和识别人类活动,我们需要不断丰富数据库,包括不同的活动类型、各种运动姿势、不同人群的数据等。通过构建更全面、更多样的数据库,可以提高人体活动识别的准确性和适应性,使其在更广泛的应用领域中发挥作用。此外,现有的数据集种类繁多,标注方式和数据格式也各不相同,这给数据的协同分析带来了困难。为了解决这个问题,未来的发展趋势是使用通用性数据分析人类活动。这意味着建立一个统一的数据平台,将来自不同数据集的人体活动数据进行整合和标准化处理,以便更有效地进行数据分析和模型训练。通过建立通用性数据分析人类活动的平台,研究人员和开发者可以更方便地访问和利用各种数据,进行深入的数据分析和交叉验证。这样做不仅可以提高人体活动识别的精度和鲁棒性,还可以促进不同研究团队之间的合作和知识共享,推动整个领域的进步。

综上所述,因为人类活动的复杂性和多样性,不断丰富和完善数据库是人体活动识别技术发展的必然趋势。同时,通过建立通用性数据分析人类活动的平台,可以更好地协同分析各种数据,推动人体活动识别领域的进一步发展。这将为我们在更深入的人类活动理解和更智能的应用场景研究上提供更广阔的前景。

2人体活动识别方法

2.1基于接触方式采集数据的人体活动识别方法分析

根据人体活动数据采集的方式不同,人体活动识别主要采用接触式传感器、非接触式的视觉和无线信号[8]。接触式传感器是一类能够通过接触物体表面来检测物体的物理特性或运动的传感器,由于与目标物体直接接触,使得其能够提供更直接、更准确的测量结果[9]。并且,由于接触式传感器能够直接接触目标物体并测量其特定参数,因此通常具有较高的测量精度,这使得其在需要高精度检测的应用中效果显著[10]。此外,接触式传感器直接与目标物体接触并实时测量参数,能够提供几乎即时的反馈和数据输出。但是,接触式传感器在测量过程中需要与目标物体接触,这可能对目标物体产生一定的影响。同时,由于接触式传感器需要与目标物体直接接触,因此在长时间使用过程中需要考虑传感器受到磨损和损坏,物体的表面质地、硬度和形状等因素也可能对传感器产生影响[11]。

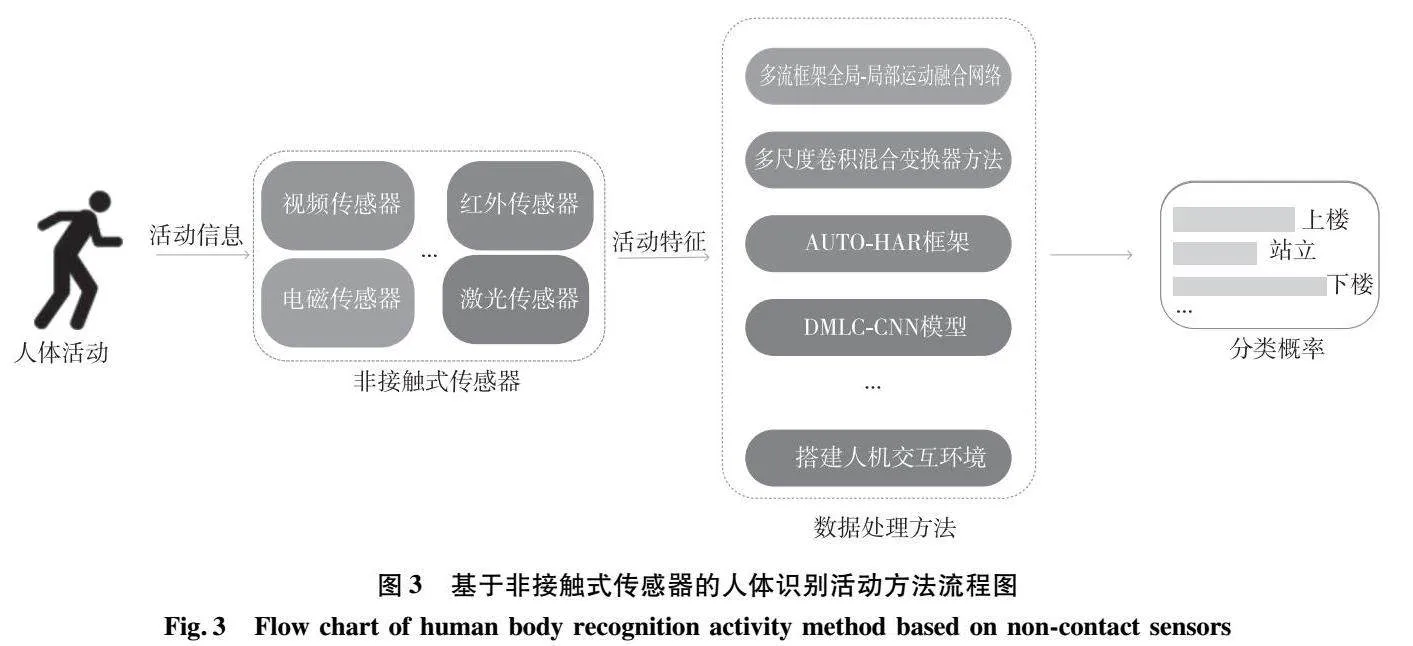

在人体活动识别中,接触式传感器直接与人体接触,能够提供较为准确的数据,并且能够实时地获取人体活动的数据,对于瞬时变化的人体活动有较好的响应能力,同时还可以测量多种参数,如压力、力度、角度等,适用于多种人体活动的识别。但是由于与人体直接接触,可能会给人带来不舒适的感觉,影响用户的体验,因此需要把传感器放置在合适的位置,减少对人体的自由运动的限制[12]。图2为基于接触方式采集数据的人体活动识别大体流程。

以下总结文献中常见的基于接触式传感器人体活动识别数据分析方法。宋欣瑞等[13]运用智能手机与手表采集的人体活动数据,采用CNN和GRU融合的方法构建多任务深度学习模型,自动从每个传感器原始数据中进行特征提取,人体活动识别的准确率可达到93%以上。邓诗卓等[14]运用接触式惯性和加速度传感器采集的测试者在厨房环境内日常动作及汽车工人工作场景运动数据,提出了基于共享参数 TS-2DCNN 和 MS-2DCNN 的

网络结构,在保证识别准确率的同时,减少了卷积层训练参数数量。ASUROGLU[15]基于加速度传感器采集的人体活动数据,运用局部加权随机森林算法,评估老年受测者的健康状况。MARDANPOUR等[16]运用惯性传感器模块采集的活动数据,采用知识提取范式解决计算成本过高的问题,利用参数更少的学生模型可以得到92.9%的准确度。WIJEKOON等[17]利用惯性传感器模块采集的活动数据,建立了一种个性化的开放式HAR算法——MNZ,它通过用户上下文感知的匹配网络架构,对整个HAR数据源进行了评估,与最常见的“知识密集型”开放式HAR算法相比,个性化性能提高了48.9%。王刚等[18]利用加速度传感器获取人体活动数据,提出一种基于多传感器与脉冲神经网络的人体活动识别方法,分类准确率达到 97.8%,运用脉冲神经网络专用芯片低功耗特性,以数毫瓦的功耗实现人体活动识别任务。李新科等[19]构建了基于加速度计惯导信息和卷积神经网络 的人体活动识别模型,模型的分类正确率达到了 92.73%。KUNCAN等[20]采用陀螺仪、加速度计和磁力计组成的接触式传感器组采集了人体活动19种信号,运用MP+LSTM方法识别人体活动。这些研究运用接触式传感器进行人体活动数据采集,通过深度学习、共享参数、知识提取等技术手段,实现了人体活动识别较高的准确率和个性化性能,在特征提取、多模态数据融合、可解释性、计算与存储成本、实时性和适应性等方面还有一定的发展空间,可以进一步研究和改进。

2.2基于非接触方式采集数据的人体活动识别方法分析

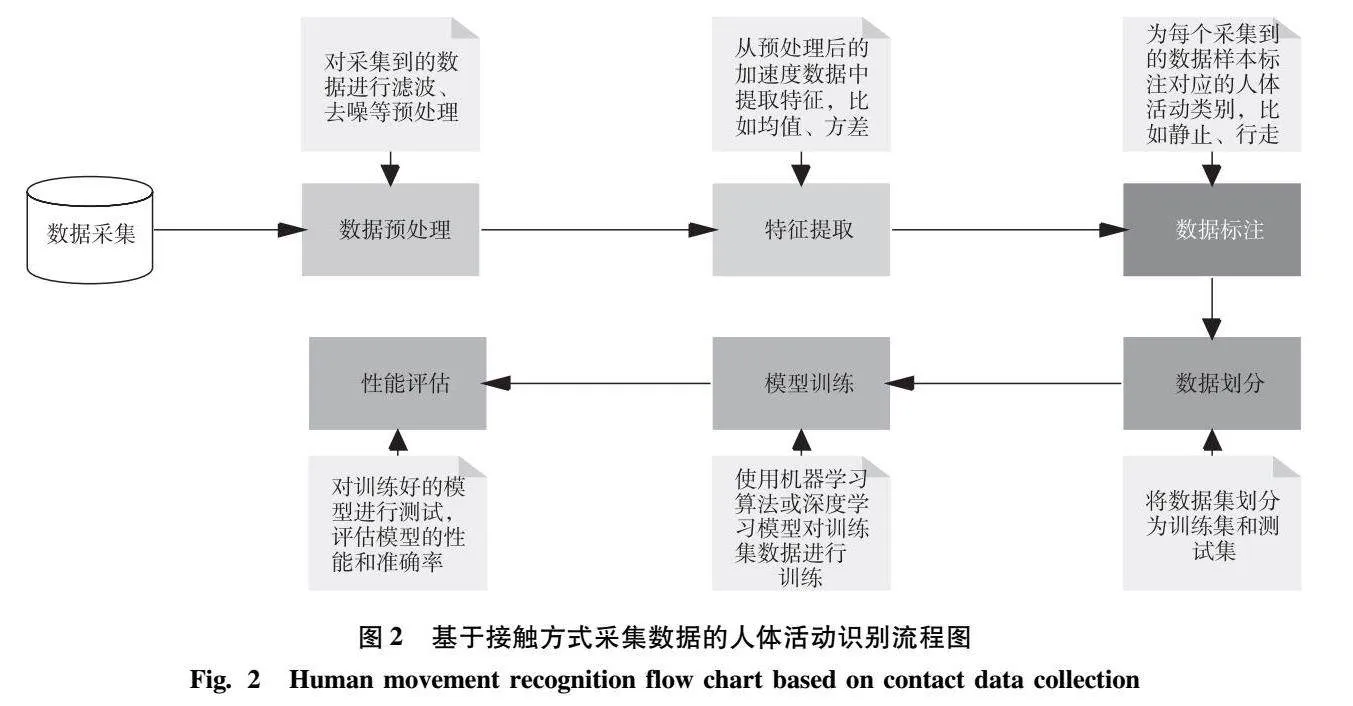

基于非接触方式采集数据的人体活动识别主要通过视频传感器或者视频数据来进行,基于机器视觉的识别是以图像处理技术为核心,按帧对视频序列中人体行为进行描述和识别[14-15]。非接触式传感器无需与人体直接接触,使用起来更加方便,具有较大的灵活性和适应性。但是非接触式传感器受到环境因素的影响较大,可能存在一定的误差,并且在数据采集和处理方面可能存在一定的延迟,不适用于对瞬时变化较敏感的活动识别。此外,由于视频数据量十分大,非接触式传感器采集的数据需要经过复杂的算法处理,才可以提取到有用的信息[21]。在人体活动识别过程中,非接触式传感器通过摄像头捕捉图像和视频,无需与人体直接接触。这种非接触式感知方式可以提高使用者的舒适度和便利性,避免因传感器与人体接触而产生的不适。并且非接触式传感器不仅可以捕捉人体的运动轨迹、姿态和动作,还可以捕捉到人体的面部表情、眼神等丰富信息,这为人体活动识别提供了更全面的数据支持。图3介绍了基于非接触式传感器的人体识别活动方法大体流程。

下面总结文献中常见的基于非接触式传感器人体活动识别数据分析方法。DEGARDIN等[22]运用Ntu-RGB的动作视频数据,提出一种原子运动表示方法,用于自监督人体动作的识别,可以在减少骨骼标记点的同时进行更细粒度的人体动作识别。QI等[23]利用NTU-RGB数据集,提出了一种

多流框架全局-局部运动融合网络,集成了时空维度的全局和局部运动信息,用分组图卷积模块增强聚合局部空间运动信息的能力。ZHOU等[24]将残差模块和双向长短期记忆模块与提出的注意机制相结合,进一步估计手臂运动轨迹。ISMAIL等[25]利用UCI视频数据集,建立了AUTO-HAR框架,用于人体活动识别任务的CNN架构。LIU等[26]利用Stanford Actions图片数据集,建立身体部位关系推理模块,实现人体活动识别。ASIF等[27]从视频中提取人体骨架数据,结合身体和手的运动特征,形成了DeepActs数据表示方法识别人体动作。SINHA等[28]提出一种基于无人机视频的卷积神经网络模型,对人体轮廓进行分割,从而识别人体动作。HUSSAIN等[29]提出一种基于边缘计算和云计算、用于不确定低光环境下HAR的云辅助物联网计算框架。ISLAM等[30]利用UP-Fall视觉数据集,使用具有卷积块注意力模块的多头卷积神经网络来处理视觉数据,用于多模式人类活动识别的多层次特征融合。基于非接触式传感器的人体活动的数据处理通常需要设计有效的特征提取和表示学习方法,以从原始数据中提取有用的特征表示,在算法方面需要进一步优化特征提取和表示学习、多模态融合、空间和时间建模等方面,以提高活动识别的性能。同时,可以考虑引入知识图谱等辅助方法来增强活动识别的准确性和可解释性。使用测试集数据对训练好的模型进行测试,评估模型的性能和准确率。

2.3知识图谱在人体活动识别中的应用

近年来,人工智能信息技术的迅猛发展,带来了行业的新需求,推动着智能系统的发展,驱动着认知模式的创新。数据和知识是新一代信息技术融合的基础,是实现人工智能的保障。谷歌副总裁AMIT[31]2012年提出,知识图谱是揭示实体间关系的语义网络知识库,本质上是以语义网络为特征的知识库。知识图谱建立实体间的互联关系,以结构化的方式组织和表示知识,是人工智能的重要基础,已成为当前研究的热点。

知识图谱在基于加速度和惯性传感器的人体活动识别中具有重要的应用。首先,知识图谱可以整合和组织与人体活动识别相关的领域知识,如运动学、生理学、医学等。LI等[32]由膝骨关节炎患者的电子病历文本中提取信息构建医学知识图谱,以支持知识检索和决策支持等智能医疗应用。并且通过将这些知识与非接触式传感器数据进行关联,捕捉人体活动识别中的上下文信息。通过将传感器数据与知识图谱中的上下文知识进行关联,可以更好地理解人体活动的环境背景,提高活动识别的准确性。ZHANG等 [33]为解决本体辅助多源数据集成和日常事务数据的动态更新问题,构建了自上而下模式的知识图谱,适应了运行时间段内服务的动态组成。其次,知识图谱还可以帮助理解和解释人体活动的语义含义,通过将传感器数据与知识图谱中的语义信息进行关联,可以对人体活动进行更深入的理解和解释,提高活动识别的可解释性。最后,知识图谱可以帮助整合和共享人体活动识别的数据集。通过将不同数据集中的活动标签、特征和元数据整合到知识图谱中,可以提供更全面和一致的数据集,促进研究者之间的合作和数据共享。综上所述,知识图谱在基于接触式传感器的人体活动识别中具有多种应用,包括领域知识整合、上下文感知、知识推理和推荐、活动语义理解以及数据集整合和共享等。这些应用有助于提高人体活动识别的准确性、可解释性和应用价值。

此外,知识图谱在基于视频数据的人体活动识别中也具有广泛的应用。首先,知识图谱可以帮助提取视频传感器数据中的特征,并学习表示人体活动的语义信息,通过将视频数据与知识图谱中的语义关系进行关联,可以提取更有意义和判别性的特征,提高人体活动识别的准确性。其次,知识图谱可以用于多模态数据的融合和表达。在基于视频传感器的人体活动识别中,除了视频数据,还可以结合其他传感器数据(如声音、惯性传感器等)进行综合分析。WANG等[34]构建人体运动图像的自动空间规划模型, 采用自适应边缘特征检测方法重构人体运动空间轮廓结构,提取运动图像的知识图谱,运用多尺度信息增强方法识别人体运动图像,解决人体运动图像空间分布不均和图像可靠性增强峰值信噪比低的问题。通过将不同传感器数据与知识图谱中的关系进行融合,可以提供更全面和准确的人体活动识别结果。再次,知识图谱还可以帮助整合和共享基于视频传感器的人体活动识别数据集。SHEN等[35]提出了考虑拓扑关系的空间场景知识图谱,探讨了空间场景知识图谱的定义、拓扑关系知识的获取和存储以及空间场景知识图形的可视化,可用于空间查询、空间分析和空间数据建模,通过将不同数据集中的活动标签、特征和元数据整合到知识图谱中,可以提供更全面和一致的数据集,还可以促进研究者之间的合作和数据共享,CHEN等[36]构建一个来自多模式视图(如文本、视觉和听觉视图)的多模态知识图谱,可为自然语言处理和计算机视觉的研究提供数据范围和研究基础,促进跨领域融合研究。最后,知识图谱可以提供对人体活动识别结果的解释和理解。通过将视频数据与知识图谱中的语义信息进行关联,可以获得更可解释和可理解的人体活动识别结果,增强对识别结果的解释能力。综上所述,知识图谱在基于非接触式传感器的人体活动识别中具有广泛的应用,包括特征提取和表示学习、上下文建模和关系推理、多模态融合、数据集整合和共享,以及可解释性和结果解释等方面。这些应用有助于提高人体活动识别的准确性、可解释性和应用价值。

3人体活动识别的应用

3.1基于接触方式采集数据的人体活动识别应用

接触式传感器提供的数据因其广泛使用、易于安装和非侵入性,也在逐渐变得受欢迎。包括手表和智能手机在内的许多智能产品都集成了加速度计等惯性传感器以及可以连续记录各种人类活动数据的陀螺仪[37],来进行人体运动识别,从而对人体健康进行检测。随着人体可穿戴传感技术的发展,人体活动识别可以运用在服装行业。近年来,基于纺织品的传感器已被用于活动识别。利用最新的电子纺织技术,传感器可以被整合到服装中,让用户可以舒适地穿着并享受长期的人体动作记录,最近电子纺织品的发展使得将传感器集成到服装中成为可能[38]。这具有显著的优势,例如能够捕捉自然行为,并通过不显眼的传感确保穿着者的舒适度,并且传感器可以附着在衣服上的任何位置。基于接触式传感器的人体活动识别也可用于监测运动员的姿势、动作和力度,以提供个性化的健身指导和反馈。例如,通过测量压力传感器的数据,可以识别重量训练中的姿势正确性,提醒用户调整姿势[39]。此外,基于接触式传感器的人体活动识别还可用于监测康复患者的运动范围、姿势和活动水平,以帮助评估康复进展和指导治疗计划。例如,通过测量关节传感器的数据,可以监测关节的活动范围,帮助康复训练的监控和调整[40]。

总体而言,基于接触式传感器的人体活动识别应用有着广阔的前景,将在健康、康复、智能产品等领域发挥重要的作用。随着技术和算法的不断进步,我们可以期待更精确、智能化和个性化的人体活动识别应用的发展。

3.2基于非接触方式采集数据的人体活动识别应用

人体动作识别由于其在现实世界中的应用,在计算机视觉领域引起了极大的关注。基于视觉的系统具有坚实的理论基础,在识别人类活动方面表现良好。计算机视觉中的动作识别一般分为视频中的动作识别和静止图像中的动作识别。静止图像中的动作识别旨在在没有任何时间信息的静态图像中识别人类活动。由于跑步和吸烟等人类活动可以通过单个输入图像进行识别,无需额外的运动线索[41],因此基于非接触式传感器的动作识别十分受重视。此前,由于COVID-19大流行的出现,导致人们避免与设备亲密接触,因此对准确、高效的基于视觉的通信的需求显著增加[34]。与传统的无线鼠标和键盘不同,基于视觉的交互除了能提供有效的远程控制外,还可以在不接触电子设备任何部分的情况下控制电子设备。随着近年来电子健康在智能家居各种应用领域的普及,人类运动识别技术还越来越多地应用于康复系统、慢性疾病管理和老年人个人健康监测。例如,通过监测老年人的日常行为,助手服务可以跟踪他的日常行为是如何完整和一致地执行的,并在此基础上确定是否以及何时需要干预或协助[42],比如,该人是否在浴室摔倒等。还可以围绕非结构化智能空间家庭养老监护机器人活动感知技术开展研究,进行监护机器人原型系统的集成开发和应用验证,为老年人活动意图发掘、医疗诊断、行为干预和机器人的主动服务等提供依据,为基于机器人的智能养老产品的研发奠定理论与技术基础。此外,自动驾驶的发展也带来了对智能、安全和稳定性的要求。因此,人类动作识别技术在这方面也有重要的应用,在动态、复杂和不确定的环境中,需要在行人和车辆之间建立有效的互动认知形式,车辆在做出适当的决策之前,需要通过视频传感器检测行人,识别他们的肢体动作,理解他们的动作含义[43]。

未来,随着深度学习和计算机视觉技术的不断发展,人体运动识别将在更多的领域,例如医学、农业[44]、纺织业、制造业[45]等中得到应用。

4结束语

近年来,随着人体活动识别技术的发展以及知识图谱在不同领域不断发挥作用,本文从人体活动识别数据采集角度出发,对现有的人体活动识别方法进行了归纳总结,并与知识图谱相连接,总结了知识图谱在各类人体活动识别方式中发挥的作用,并且进一步探索了人体活动识别的实际应用与发展前景。使用接触方式采集数据进行人体活动识别时,传感器的活动检测方法[13]不易受到环境影响,检测数据精度较高,信息量丰富,需要注意避免边界信息模糊,以及设计合理的装置佩戴方案来降低对用户体验的影响。在使用接触方式采集数据进行人体活动识别时,主要采用视频数据。基于图像的人体动作识别不会对用户的生活造成干扰,具有较大的灵活性和适应性。识别过程中需要考虑背景、视角、光线等因素干扰,降低数据采集和处理方面存在的延迟,它适用于对瞬时变化较慢的活动识别。此外,由于视频数据量大,非接触式传感器采集的数据需要经过一定的算法处理,才可以提取到有用的信息[21]。针对目前的人体活动识别具体技术,可以利用动作视频数据和骨架数据,进行精细化的人体动作识别,甚至可以通过自监督学习,减少标记点的数量。另外,运用注意机制、残差模块、双向长短期记忆模块等技术,可以进一步提高人体活动识别和运动轨迹估计的准确性。利用RFID信号、无人机视频等不同类型的数据进行人体活动识别,可以实现多尺度、多模式的识别和特征融合。知识图谱在人体活动识别中也发挥着重要作用。通过对知识图谱的应用,可以整合领域知识和数据,提供准确、可解释的活动识别结果。随着深度学习和知识图谱技术的不断发展,人体活动识别将在更多的领域得到应用。总体上而言,基于传感器的人体活动识别从技术方法到现实应用上都取得了一定的进展,但是在多模态融合、知识表达和推理、实时性和效率上仍然值得进一步研究。

参考文献:

[1]WALID G,A M K.A perspective on human activity recognition from inertial motion data[J].Neural Computing and Applications,2023,35(28):20463-20568.

[2] MOHAMMED M H,ZIA U,AMR M,et al.A robust human activity recognition system using smartphone sensors and deep learning[J].Future Generation Computer Systems,2018,81:307-313.

[3] JIA Q. A review on the application of knowledge graph technology in the medical field[J]. Scientific Programming, 2022, 2022:3212370.1-3212370.12.

[4] GUO K Y, WANG P S, SHI P P, et al. A new partitioned spatial-temporal graph attention convolution network for human motion recognition[J]. Applied Sciences, 2023, 13(3): 1647.1-1647.15.

[5] HUSZAR V D, ADHIKARLA V K. Live spoofing detection for automatic human activity recognition applications[J]. Sensors, 2021, 21(21): 7339.1-7339.20.

[6] RONAO C A,CHO S B. Human activity recognition with smartphone sensors using deep learning neural networks[J]. Expert Systems with Applications,2016,59:235-244.

[7] TRIANTAFYLLIDIS A K, VELARDO C, SALVI D, et al. A survey of mobile phone sensing, self-reporting, and social sharing for pervasive healthcare[J]. IEEE Journal of Biomedical and Health Informatics, 2015, 21(1): 218-227.

[8] ZHANG S B, LI Y X, ZHANG S, et al. Deep learning in human activity recognition with wearable sensors: a review on advances[J]. Sensors, 2022, 22(4): 1476.1-1476.43.

[9]ZYER T, AK D S, ALHAJJ R. Human action recognition approaches with video datasets:a survey[J]. Knowledge-Based Systems, 2021, 222: 106995.1-106995.21.

[10]MUNOZ-ORGANERO M, LOTFI A. Human movement recognition based on the stochastic characterisation of acceleration data[J]. Sensors, 2016, 16(9): 1464.1-1464.16.

[11]TASNIM N, BAEK J H. Dynamic edge convolutional neural network for skeleton-based human action recognition[J]. Sensors, 2023, 23(2): 778.1-778.17.

[12]YU X Q, PARK S, XIONG S P. Trunk range of motion: a wearable sensor-based test protocol and indicator of fall risk in older people[J]. Applied ergonomics, 2023, 108: 103963.1-103963.12.

[13]宋欣瑞,张宪琦,张展,等.多传感器数据融合的复杂人体活动识别[J].清华大学学报(自然科学版),2020,60(10):814-821.

[14]邓诗卓,王波涛,杨传贵,等.CNN多位置穿戴式传感器人体活动识别[J].软件学报,2019,30(3):718-737.

[15]AUROGLU T. Complex human activity recognition using a local weighted approach[J]. IEEE Access, 2022, 10: 101207-101219.

[16]MARDANPOUR M, SEPAHVAND M, ABDALI-MOHAMMADI F, et al. Human activity recognition based on multiple inertial sensors through feature-based knowledge distillation paradigm[J]. Information Sciences, 2023, 640: 119073.1-119073.13.

[17]WIJEKOON A, WIRATUNGA N, SANI S, et al. A knowledge-light approach to personalised and open-ended human activity recognition[J]. Knowledge-Based Systems, 2020, 192: 105651.1-105651.43.

[18]王刚,莫凌飞.基于多传感器融合的低功耗人体活动识别方法[J].传感器与微系统,2023,42(3):132-135.

[19]李新科,刘欣雨,李勇明,等.基于惯导信息和卷积神经网络的人体活动识别[J].生物医学工程学杂志,2020,37(4):596-601.

[20]KUNCAN F, KAYA Y, YINER Z, et al. A new approach for physical human activity recognition from sensor signals based on motif patterns and long-short term memory[J]. Biomedical Signal Processing and Control, 2022, 78: 103963.1-103963.23.

[21]BESHARATIAN B, DAS A, AWAWDEH A, et al. Benchmarking dynamic properties of structures using non-contact sensing[J]. Earthquake Engineering and Engineering Vibration, 2023, 22(2): 387-405.

[22]DEGARDIN B, LOPES V, PROENA H. ATOM: self-supervised human action recognition using atomic motion representation learning[J]. Image and Vision Computing, 2023, 137: 104750.1-104750.9.

[23]QI Y P, PANG C, LIU Y L, et al. Multi-stream global-local motion fusion network for skeleton-based action recognition[J]. Applied Soft Computing Journal, 2023,145: 110536.1-110536.13.

[24]ZHOU H Y, YANG G, WANG B C, et al. An attention-based deep learning approach for inertial motion recognition and estimation in human-robot collaboration[J]. Journal of Manufacturing Systems, 2023, 67: 97-110.

[25]ISMAIL W N, ALSALAMAH H A, HASSAN M M, et al. AUTO-HAR: an adaptive human activity recognition framework using an automated CNN architecture design[J]. Heliyon, 2023,9(2):e13636.

[26]LIU Q L, CHE X J, ZHAO M X. Body part relation reasoning network for human activity understanding[J]. Information Sciences, 2023, 619: 526-539.

[27]ASIF U, MEHTA D, VON CAVALLAR S, et al. DeepActsNet: a deep ensemble framework combining features from face, hands, and body for action recognition[J]. Pattern Recognition, 2023, 139: 109484.1-109484.12.

[28]SINHA K P, KUMAR P. Human activity recognition from UAV videos using a novel DMLC-CNN model[J]. Image and Vision Computing, 2023, 134: 104674.1-104674.11.

[29]HUSSAIN A, KHAN S U, KHAN N, et al. Low-light aware framework for human activity recognition via optimized dual stream parallel network[J]. Alexandria Engineering Journal, 2023, 74: 569-583.

[30]ISLAM M M, NOORUDDIN S, KARRAY F, et al. Multi-level feature fusion for multimodal human activity recognition in Internet of Healthcare Things[J]. Information Fusion, 2023, 94: 17-31.

[31]AMIT S. Introducing the knowledge graph: things, not strings[EB/OL].(2012-05-16)[2022-05-02].https://www.blog.google/products/search/introducing-knowledge-graph-things-not/.

[32]LI X, LIU H Y, ZHAO X, et al. Automatic approach for constructing a knowledge graph of knee osteoarthritis in Chinese[J]. Health Information Science and Systems, 2020, 8(1):12.

[33]ZHANG W Y, LIU Y G, JIANG L H, et al. The construction of a domain knowledge graph and its application in supply chain risk analysis[C]//Advances in E-Business Engineering for Ubiquitous Computing: Proceedings of the 16th International Conference on E-Business Engineering (ICEBE 2019). Cham: Springer International Publishing, 2020: 464-478.

[34]WANG Y W, FENG F. Reliability enhancement algorithm of human motion recognition based on knowledge graph[J]. International Journal of Distributed Systems and Technologies (IJDST), 2021, 12(1): 1-15.

[35]SHEN J W, SHI K F, MA M G. Exploring the construction and application of spatial scene knowledge graphs considering topological relations[J]. Transactions in GIS, 2022, 26(3): 1531-1547.

[36]CHEN Y, GE X K, YANG S L, et al. A survey onmultimodal knowledge graphs: construction, completion and applications[J]. Mathematics, 2023, 11(8): 1815.1-1815.27.

[37]ESSA E, ABDELMAKSOUD I R. Temporal-channel convolution with self-attention network for human activity recognition using wearable sensors[J]. Knowledge-Based Systems, 2023, 278: 110867.1-110867.14.

[38]SHEN T C, DI GIULIO I, HOWARD M. A probabilistic model of human activity recognition with loose clothing[J]. Sensors, 2023, 23(10): 4669.1-4669.18.

[39]PARK J, LEE H J, PARK J S, et al. Development of a gait feature-based model for classifying cognitive disorders using a single wearable inertial sensor[J]. Neurology, 2023, 101(1): e12-e19.

[40]CHEN Z, WANG Y Q, QIU P, et al. Pulmonary rehabilitation exercise based on wearable device pedometer improved lung cancer patients with impaired pulmonary function[J]. Alternative Therapies in Health and Medicine, 2024,30(1):78-82.

[41]DEHKORDI H A, NEZHAD A S, KASHIANI H, et al. Multi-expert human action recognition with hierarchical super-class learning[J]. Knowledge-Based Systems, 2022, 250: 109091.1-109091.47.

[42]YAO L N, SHENG Q Z, BENATALLAH B, et al. WITS: an IoT-endowed computational framework for activity recognition in personalized smart homes[J]. Computing, 2018, 100: 369-385.

[43]CHEN L, MA N, WANG P, et al. Survey of pedestrian action recognition techniques for autonomous driving[J]. Tsinghua Science and Technology, 2020, 25(4): 458-470.

[44]ANAGNOSTIS A, BENOS L, TSAOPOULOS D, et al. Human activity recognition through recurrent neural networks for human-robot interaction in agriculture[J]. Applied Sciences, 2021, 11(5): 2188.1-2188.20.

[45]GNTHER L C, KRCHER S, BAUERNHANSL T. Activity recognition in manual manufacturing: detecting screwing processes from sensor data[J]. Procedia CIRP, 2019, 81: 1177-1182.

(责任编辑:曾晶)

Abstract:

In recent years, the technology for recognizing human activity has progressed rapidly and has found widespread applications in the fields of security, healthcare, human-computer interaction, and sports.Based on the relevant literature at home and abroad, this paper reviews the knowledge graph, human activity data sets and human activity recognition methods and applications.It begins by identifying the distinguishing features of human activity recognition datasets collected using various methods. Subsequently, it examines specific techniques aimed at enhancing the accuracy and performance of human activity recognition models. Furthermore, it underscores the crucial role of knowledge graphs in unveiling the relationships befjU0fM6ChRkCFI7rMrEVXlnr6fT0GLCaGWIsTW9yrFE=tween entities in human activity recognition and in providing implicit knowledge for the analysis of human activity. Finally, in light of the practical implementation of human activity recognition, it summarizes existing research challenges and anticipates future development trends. This study provides direction and technical suggestions for the technology development and practical application of human activity recognition research.

Key words:

knowledge graph; human activity data sets; human activity recognition

基金项目:贵州省科技支撑计划项目(黔科合支撑【2021】一般439,黔科合支撑【2023】一般124)

作者简介:何玲(1975—),女,副教授,博士,研究方向:智能机器人系统、智能康养装备、新能源汽车智能控制,E-mail:529252287@qq.com.

*通讯作者:何玲,E-mail:529252287@qq.com.