基于自监督学习的多数据增广时间序列分类算法

2024-09-13刘辉

摘要:时间序列分类算法广泛应用于医疗诊断、金融预测等领域。然而,在解决时间序列分类问题时,深度学习模型通常面临数据标注困难等挑战。为了克服这些困难,本文提出了一种基于自监督学习的时间序列分类算法。该算法通过对时间序列片段进行数据增广,并设计区分数据增广形式的自监督辅助任务来挖掘时间序列的局部信息,以提高分类性能。实验结果表明,该算法在五个基准时间序列数据集上展现出优异的分类性能,并超过了现有方法。

关键词:时间序列分类;自监督学习;数据增广;局部特征;迁移学习

中图分类号:TP181 文献标识码:A

文章编号:1009-3044(2024)22-0004-03

开放科学(资源服务)标识码(OSID)

0 引言

时间序列数据广泛存在于现实世界,如交通分析、医疗诊断、金融预测和工业检测等领域[1-3]。挖掘时间序列数据的信息有助于分析现实情况,进行科学决策。例如,研究人员通过分析心电图、脑电图等医学数据来判断病人的身体状况,根据当前股票价格、汇率等金融数据预测股市未来发展趋势等。因此,研究时间序列分类算法是具有现实意义的。

近年来,已有大量学者将深度学习模型应用于时间序列分类任务中[4-7]。XIAO等人[8]分别使用时间特征网络提取数据局部特征和注意力网络提取数据内在关系,然后结合两种特征进行时间序列分类。DEMPSTER等人[9]提出一种利用随机大小和权重的卷积核来提取时域信息的方法,该方法可以提取多种数据特征从而提高时间序列分类效果。自监督学习作为一种新的学习范式[10],其能够利用辅助任务从大量无标签数据中挖掘出有效的数据信息。SHI等人[11]设计了自动去噪和时间序列数据相似性判别的自监督任务,该方法提高时间序列分类效果。LIU等人[12]根据心电信号数据的实际特点在数据上面叠加任意频率和幅度的正弦波以及叠加随机噪声进行数据增广,从而提高分类效果。但是监督学习需要大量标签数据进行训练,而对数据标注则需要耗费大量的时间和人力成本。自监督学习可以缓解时间序列分类领域标记困难的问题。

目前,自监督学习在时间序列分类领域已经得到了大量的研究[13]。FAN等人[14]通过学习时间序列数据之间和内部的关系来学习未标记数据的潜在特征。该方法设置锚样本和其他样本进行组合,然后让模型学习区分每种组合。YEHUDA等人[15]基于Koopman定理[16],通过自动编码器学习时间序列数据的特征表示,在ECG等数据集上取得优异效果。ISMAIL-FAWAZ等人[17]将时间序列分成三段,利用自动编码器进行特征表示,然后使用三重损失函数更新模型参数。然而,上述的自监督时间序列分类算法的辅助任务大多是简单任务,缺乏对数据信息的深度挖掘,且没有充分利用无标签数据。

因此,本文提出一个基于自监督学习的多数据增广时间序列分类算法,通过设置特定的多数据增广分类任务来挖掘数据的局部特征,既缓解了数据标注的困难,又提高了下游时间序列分类效果。本文的主要贡献包括:

1)本文提出了一种基于自监督的时间序列分类算法,通过设置区分数据增广形式的分类辅助任务来挖掘时间序列数据的局部信息,从而提高分类性能。

2)在五个基准时间序列数据集上进行实验验证,结果表明该算法具有优异的分类性能。

1 基于自监督学习的时间序列分类算法

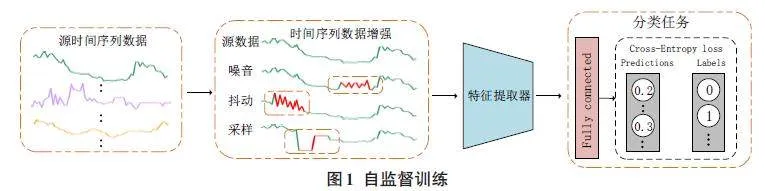

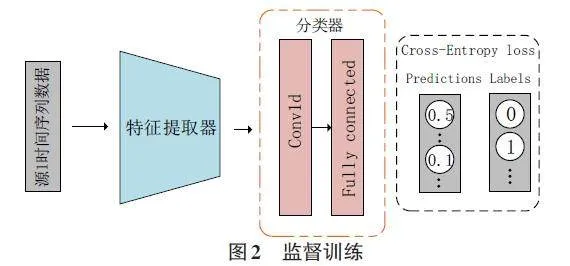

本文详细介绍了基于自监督学习的时间序列分类算法的具体步骤。该算法主要分为两个阶段:自监督预训练阶段和监督微调阶段。自监督预训练阶段如图1所示,利用无标签数据进行训练。监督微调阶段如图2所示,利用有标签数据对预训练模型进行微调。算法的特征提取器部分使用一维ResNet网络[18]。

令训练集为[Dtrain=x1,y1,x2,y2,...,xN,yN],其中[xi=v1,v2,...,vd]表示长度为[d]的时间序列,子序列记为[xi,j],其中[yi∈1,2,...,C]是时间序列[xi]对应的标签,[C]表示类标签个数。令[ƒ⋅;θ]表示一维ResNet特征提取器,其中[θ]是网络参数;[g⋅;ϕ]表示全连接分类器,其中[ϕ]是网络参数;[h⋅;φ]表示带一层CNN的全连接分类器,其中[φ]表示网络参数。

1.1 自监督训练

为了挖掘时间序列数据的局部特征,本文对时间子序列进行了数据增广和混合增广操作,并设置区分数据增广形式的分类辅助任务。数据增广方式包括随机噪声、数据抖动、上下采样以及混合增广(包含任意两种基础增广方法)。

对给定时间序列数据[x=v1,v2,...,vd],进行数据增广操作。

1) 随机噪声:随机生成高斯分布噪声[G=g1,g2,...,gd]对子序列[xi,j]添加噪声,如公式(1)所示:

[vi=vi+gi] (1)

2) 数据抖动:随机生成两个参数[α],[β],其中[α>1],[β<1],对子序列[xi,j]进行抖动,如公式(2)所示:

[v=vi⋅αif i mod 2=0 vi⋅βotherwise] (2)

3) 上下采样:令[k=i+j2],对子序列[xi,j]进行上下采样,如公式(3)所示:

[v=-1if i <=k 1otherwise] (3)

对时间序列数据[x=v1,v2,...,vd]进行数据增广操作后得到[x=v1,...,vi,...,vj,...,vd],并为增广数据[x]添加相应的伪标签[y],为了增加样本数量和扩大特征提取范围,随机选择两个基础增广方法进行组合,形成新的增广数据,最后得到新的自监督训练集[Daug=x1,y1,x2,y2,...,xn,yn]。令时间序列数据经过特征提取器后得到高级特征[zi=ƒ(xi,θ)],[zi]经过分类器后的类别概率为[pi=g(zi,ϕ)]。损失函数使用交叉熵损失函数[Lcls],其中[Daug]表示[Daug]数据集的类别数,如公式(4)所示:

[Lcls=-1Daugi=1Daugyilogpi] (4)

最后,利用特征提取器提取高级特征[zi],并使用分类器[h⋅;φ]区分源数据经过了何种数据增广,然后利用梯度下降算法更新特征提取器网络参数,完成自监督预训练。

1.2 监督训练时间序列分类

在完成自监督预训练后,将特征提取器参数迁移到真实标签数据上进行微调。利用训练集[Dtrain=x1,y1,x2,y2,...,xN,yN]进行微调,经过特征提取器得到[zi=ƒ(xi,θ)],然后经过分类器[h⋅;φ]得到类别概率[pi=h(zi,φ)]。损失函数使用交叉熵损失函数,其中[Dtrain]表示[Dtrain]数据集的类别数,如公式(5)所示:

[LCE=-1Dtraini=1Dtrainyilogpi] (5)

2 实验结果与分析

本节将介绍基于自监督学习的时间序列分类算法的实验结果和分析,包括实验数据集、评价指标、自监督验证实验、对比实验、消融实验等。

2.1 实验设置以及评价指标

实验在The UCR time series archive[19]的5个标准时间序列数据集上进行,其中数据集按照80%训练集和20%测试集进行分配。具体数据集细节如表1所示。本文采用时间序列分类领域常用的准确率[accuracy]作为评价指标。

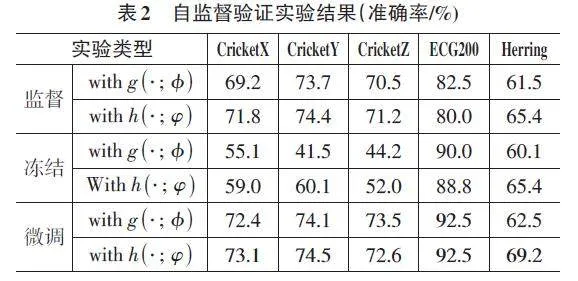

2.2 自监督验证实验

为了验证自监督预训练的有效性,本文设置了自监督验证实验。实验分为三种类型:(1) 监督:直接使用初始化特征提取器参数进行有监督训练;(2) 冻结:冻结预训练后特征提取器参数,只训练分类器;(3) 微调:加载预训练后特征提取器参数进行微调训练。实验过程中发现,使用全连接分类器[g⋅;ϕ]和带一层CNN的全连接分类器[h⋅;φ]对实验精度有不同的影响。实验结果如表2所示。

实验结果表明,模型经过自监督预训练后再微调的准确率往往高于直接使用初始化参数进行训练的准确率,这验证了自监督预训练的有效性。

实验结果还表明,使用带一层卷积的全连接分类器[h⋅;φ]比全连接分类器[g⋅;ϕ]的效果好。这是因为分类器的一层卷积网络可以对特征提取器得到的高级特征进行特征精炼操作,精炼后的特征更有利于全连接分类器分类。此外,模型增加一层卷积也提升了模型的泛化能力。

因此下文的对比实验以及消融实验均使用带一层卷积的全连接分类器[h⋅;φ],并进行微调。

2.3 对比实验

本节将本文提出的算法与现有的算法进行对比。 实验分别采用20%、40%和100%的训练集数据对模型进行微调,并比较算法的准确率。实验结果如表 3 所示。

2.4 消融实验

为了进一步验证本文提出的算法的有效性,在数据集CricketX上进行了消融实验。实验分别为:1) 预训练只进行经过3种基础数据增广的3分类任务,记为3-classification;2) 预训练只进行经过3种基础数据增广两两混合的3分类任务,记为3-mix-classification;3) 预训练经过基础和混合数据增广的6分类任务,记为self-supervised。实验结果如表4所示。

实验结果表明,自监督任务的复杂程度对模型性能有一定的影响。从上述实验可以看出,复杂的自监督任务往往能取得更好的效果。预训练阶段的自监督任务有助于提升模型性能,相较于直接使用初始化参数训练,更容易得到更好的效果。此外,模型适当挖掘数据自身局部信息有助于自监督预训练。

3 结束语

针对时间序列数据标记困难的问题,本文提出了一种基于自监督学习的时间序列分类算法。该算法通过挖掘时间序列数据的局部特征进行自监督预训练,在基准数据集上的实验结果表明,所设计的自监督方案有助于提高模型性能。

参考文献:

[1] HARUTYUNYAN H,KHACHATRIAN H,KALE D C,et al.Multitask learning and benchmarking with clinical time series data[J].Scientific Data,2019,6(1):96.

[2] REZAEI S,LIU X.Deep learning for encrypted traffic classification:an overview[J].IEEE Communications Magazine,2019,57(5):76-81.

[3] SEZER O B,GUDELEK M U,OZBAYOGLU A M.Financial time series forecasting with deep learning:a systematic literature review:2005–2019[J].Applied Soft Computing,2020,90:106181.

[4] ISMAIL FAWAZ H,FORESTIER G,WEBER J,et al.Deep learning for time series classification:a review[J].Data Mining and Knowledge Discovery,2019,33(4):917-963.

[5] LIM B,ZOHREN S.Time-series forecasting with deep learning:a survey[J].Philosophical Transactions Series A,Mathematical,Physical,and Engineering Sciences,2021,379(2194):20200209.

[6] BLÁZQUEZ-GARCÍA A,CONDE A,MORI U,et al.A review on outlier/anomaly detection in time series data[J].ACM Computing Surveys,2022,54(3):1-33.

[7] MOHAMMADI FOUMANI N,MILLER L,TAN C W,et al.Deep learning for time series classification and extrinsic regression:a current survey[J].ACM Computing Surveys,2024,56(9):1-45.

[8] XIAO Z W,XU X,XING H L,et al.RTFN:a robust temporal feature network for time series classification[EB/OL].2020:arXiv:2011.11829.http://arxiv.org/abs/2011.11829

[9] DEMPSTER A,PETITJEAN F,WEBB G I.ROCKET:exceptionally fast and accurate time series classification using random convolutional kernels[J].Data Mining and Knowledge Discovery,2020,34(5):1454-1495.

[10] JING L L,TIAN Y L.Self-supervised visual feature learning with deep neural networks:a survey[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2021,43(11):4037-4058.

[11] SHI P X,YE W W,QIN Z.Self-supervised pre-training for time series classification[C]//2021 International Joint Conference on Neural Networks (IJCNN).Shenzhen,China.IEEE,2021:1-8.

[12] LIU H,ZHAO Z B,SHE Q.Self-supervised ECG pre-training[J].Biomedical Signal Processing and Control,2021,70:103010.

[13] ZHANG K X,WEN Q S,ZHANG C L,et al.Self-supervised learning for time series analysis:taxonomy,progress,and prospects[J].IEEE Transactions on Pattern Analysis and Machine Intelligence,2024,PP:PP.

[14] FAN H Y,ZHANG F B,GAO Y.Self-supervised time series representation learning by inter-intra relational reasoning[EB/OL].2020:arXiv:2011.13548.http://arxiv.org/abs/2011.13548.

[15] YEHUDA Y,FREEDMAN D,RADINSKY K.Self-supervised classification of clinical multivariate time series using time series dynamics[C]//Proceedings of the 29th ACM SIGKDD Conference on Knowledge Discovery and Data Mining.Long Beach CA USA.ACM,2023:5416-5427.

[16] MEZIĆ I.Spectral properties of dynamical systems,model reduction and decompositions[J].Nonlinear Dynamics,2005,41(1):309-325.

[17] ISMAIL-FAWAZ A,DEVANNE M,WEBER J,et al.Enhancing time series classification with self-supervised learning[C]//Proceedings of the 15th International Conference on Agents and Artificial Intelligence.February 22-24,2023.Lisbon,Portugal.SCITEPRESS-Science and Technology Publications,2023:40-47.

[18] HE K M,ZHANG X Y,REN S Q,et al.Deep residual learning for image recognition[C]//2016 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Las Vegas,NV,USA.IEEE,2016:770-778.

[19] JAWED S,GRABOCKA J,SCHMIDT-THIEME L.Self-supervised learning for semi-supervised time series classification[M]//Advances in Knowledge Discovery and Data Mining.Cham:Springer International Publishing,2020:499-511.

[20] XI L,YUN Z C,LIU H,et al.Semi-supervised time series classification model with self-supervised learning[J].Engineering Applications of Artificial Intelligence,2022,116:105331.

【通联编辑:唐一东】