面向智能车辆的路面凹凸障碍物识别方法研究

2024-07-03邹俊逸刘畅郭文彬严运兵冉茂平

邹俊逸 刘 畅 郭文彬 严运兵 冉茂平

摘要:

对于智能车辆而言,如果感知设备可以准确快速地检测到车辆行驶前方道路上的凹凸障碍物,那就可为车辆悬架等底盘系统的控制提供重要的预瞄信息,从而实现车辆综合性能的提高和改善。针对路面上常见的凸块(减速带)、凹坑等典型的正负障碍物,提出了一种基于改进YOLOv7-tiny算法的识别方法。首先,在原YOLOv7-tiny算法的三个特征提取层引入SimAM模块,增强网络对特征图的感知能力;其次,在Neck部分采用更为平滑的Mish激活函数,增加更多的非线性表达;再次,使用CARAFE上采样算子替换最近邻上采样算子,使网络更有效地聚合上下文信息;最后,将WIoU作为定位损失函数,提高网络收敛速度以及鲁棒性。离线仿真实验结果表明:与原模型相比,改进后的模型在几乎相同参数量下,预测框与真实框交并比为0.5时的平均准确度提高了约2.5%。将改进后的模型部署到实车上,实车实验验证了模型能够有效检测出车辆前方路面出现的障碍物,说明所提出的算法模型能够准确提供障碍物检测的预前信息。

关键词:路面预瞄;凹凸障碍物;改进与优化;识别方法

中图分类号:TP391.4

DOI:10.3969/j.issn.1004132X.2024.06.001

开放科学(资源服务)标识码(OSID):

Research on Road Uneven Obstacle Recognition Method for Intelligent Vehicles

ZOU Junyi LIU Chang GUO Wenbin YAN Yunbing RAN Maoping

School of Automotive and Transportation Engineering,Wuhan University of Science and

Technology,Wuhan,430081

Abstract: For intelligent vehicles, if the sensing device might accurately and quickly detect the concave and convex obstacles on the roads ahead of the vehicles, the important preview information might be provided for the control of the chassis system such as the suspension of the vehicles, and finally realized the improvement of the comprehensive performance of the vehicles. Therefore, based on improved YOLOv7-tiny algorithm a recognition method was proposed for typical positive and negative obstacles such as bumps(speed bumps) and pits on the road surfaces. Firstly, the SimAM module was introduced in the three feature extraction layers of the original YOLOv7-tiny algorithm to enhance the networks ability to perceive the feature map; secondly, a smoother Mish activation function was used in the Neck part to add more nonlinear expressions; again, replacing the nearest proximal upsamping operator with the up-sampling operator to enable the network to aggregate contextual information more efficiently; and lastly, the WIoU was used as the localization loss function to improve the convergence speed as well as the robustness of the network. The offline simulation experimental results show that compared with the original model, the improved model improves the average accuracy by 2.5% for almost the same number of parameters with an intersection ratio of 0.5 between the predicted and real frames. The improved model is deployed to a real vehicle, and the real-vehicle experiments verify that the model may effectively detect the obstacles appearing on the road in front of the vehicles, indicating that the proposed algorithmic model may accurately provide the pre-precedent information for obstacle detections.

Key words: road preview; uneven obstacle; improvement and optimization; recognition method

收稿日期:20230825

基金项目:湖北省重点研发计划(2021BAA180);国家自然科学基金(52202480);湖北省自然科学基金(2022CFB732);湖北省教育厅科学研究计划指导项目(B2021008)

0 引言

对于智能汽车而言,可靠和有效的环境感知能力是其安全和舒适驾驶的基础。当前,国内外学者基于机器视觉和深度学习等算法,针对道路场景中的人、车、物以及交通标志的识别展开了大量研究,并且研究成果表明识别准确率和速率已经达到了较高的水平。但现有的大部分环境感知技术主要是基于智能汽车行驶安全性进行考虑的,通过对道路中的交通目标进行识别来实现先进驾驶辅助系统(advanced driving assistance system, ADAS)中的主动避撞等功能,缺乏对智能汽车舒适性方面的考虑。

智能汽车在路面上行驶时,难免会遇到凹坑、减速带或者其他凸块等障碍物,这种凹凸(正负)障碍物对汽车的舒适性、稳定性以及安全性都有着重要的影响,如果能及时准确地对路面正负障碍物进行有效识别,就能很大程度上提高汽车行驶的舒适性、安全性和稳定性。

面向智能车辆的路面凹凸障碍物识别方法研究——邹俊逸 刘 畅 郭文彬等

中国机械工程 第35卷 第6期 2024年6月

传统的对路面凹凸障碍物的识别方法主要通过加速度传感器、位移传感器获取路面参数从而进行反向辨识。LIU等[1]通过获取簧下质量加速度信息反求路面功率谱实现路面等级分类。XUE等[2]通过手机加速度传感器测量车身振动加速度以检测路面凹坑。虽然这些方法能够对路面障碍物、等级进行被动判断,但无法满足当今自动驾驶背景下路面障碍物感知的前瞻性要求。

刘家银等[3]利用激光雷达通过距离、点密度阈值进行凹坑识别。邬佳琪[4]使用激光雷达和多种传感器信息进行数据融合以获取路面高程。虽然受到Pointnet[5]的启发,许多研究人员提出了基于点云的路面检测方法,但由于激光雷达价格昂贵,加之现有的点云数据集较少且并没有路面障碍物公开点云数据,因此难以得到大规模应用。

机器视觉的方法成本低,效果好,能够满足车前路面障碍物预先感知的需要。目前的主流检测网络模型分为单阶段和双阶段两类[6]。单阶段检测方法联合定位与识别两个过程,相对于双阶段检测方法,检测速度更快、精度与速率间更为平衡。双阶段检测方法分别处理定位和识别,其检测精度较高,但降低了检测速率。单阶段检测方法的代表有YOLO(you only look once)系列[7-10]、SSD(single shot MultiBox detector)[11]、RetinaNet[12]等。双阶段检测方法的代表有R-CNN(region-based convolutional neural network)[13]、Fast R-CNN[14]、Faster R-CNN[15]等。YOLO系列算法作为单阶段检测方法的杰出代表,在智能汽车感知领域已有不少应用。韩岩江等[16]在YOLOv5s基础上融合了坐标注意力机制,在特征融合部分采用了BiFPN(bidirectional feature pyramid network)结构,针对交通标志的检测准确率相对于原始模型提高了3.9%。顾士洲等[17]采用扩增检测尺度法得到了改进的YOLOv3算法,并对道路正负障碍物进行了检测研究。刘子龙等[18]融合高分辨率特征网络Lite-HRNet提出了改进的YOLOv5模型,对小目标的检测精度提升明显。

因此,本文提出一种以YOLOv7-tiny算法为基础的路面凹凸障碍物识别方法,对路面凹凸不平特性进行识别。

1 系统架构

本文提出了一种基于路面预瞄的智能底盘控制架构,如图1所示,

通过感知设备对路面不平度、附着系数以及障碍物进行识别,再反馈到线控转向、线控制动和主动悬架进行提前控制,能很好地改善智能汽车动力学性能。

本文基于图1所示的智能底盘架构,以舒适性为目标,对车前路面凹凸障碍物进行检测,为后续的悬架、转向和制动等系统的控制提供预瞄信息。

本文提出的路面凹凸障碍物实时检测系统架构见图2,主要由三个模块构成:①样本采集模块,通过网络搜集、手持移动设备拍摄、实验车辆信息系统采集三种方式搜集原始图像数据,并对原始图像进行数据增强作为训练样本;②模型训练模块,将增强后的训练样本输入改进后的模型进行模型训练,并对收敛后的改进模型检测效果进行评估;③实车实验模块,将改进后的模型部署到课题组实验车辆上进行实时检测,测试其实际性能。

2 数据集建立及处理

2.1 原始图片采集

对路面上常见的减速带、凹坑两类障碍物采用以下三种方式获取足够数量的原始图像数据:①网上在线搜集;②使用手持移动设备线下拍摄;③使用课题组实验车辆信息采集系统拍摄。三种方式共搜集到样本图片1552张,场景包含城市、校园、乡村,环境覆盖晴天、雨天、多云三类。原始图像数据分布见表1。对采集到的图片使用LabelImg标注工具对目标进行人工标注,如图3所示。

2.2 图像数据扩充

图像样本多样性不足会导致网络模型训练中出现过拟合现象。为防止过拟合,本文利用Imgaug图像增强库对原始数据集进行离线数据增强,随机采用水平翻转、像素乘法增强、高斯内核模糊、仿射变换、随机缩放等方法中的三种方法将原始数据集中每张图片变为三张,处理后所有图片共计4656张。原始图片和数据增强后的图片如图4所示。

data enhancement

3 算法介绍

3.1 YOLOv7-tiny算法简介

YOLOv7算法[19]在官方公开的实验中无论是检测速度还是检测精度都超过了目前已知的检测器。官方根据代码的运行环境不同设计了不同版本的模型,其中YOLOv7-tiny便是面向边缘GPU的网络模型,是YOLOv7的精简版本。

YOLOv7-tiny由输入端(Input)、主干网络(Backbone)、颈部(Neck)和检测头(Head)组成,如图5所示。YOLOv7-tiny在输入端沿用YOLOv5的预处理方法,通过自适应图像裁剪对图像进行处理,将图像统一裁剪为640 pixel×640 pixel大小以满足主干网络所需。

主干部分由若干CBL卷积层、简洁版ELAN结构以及MP卷积层堆砌而成。其中CBL卷积层由Conv2D、BN(batch normalization)、Leaky ReLU组成,用以从原始数据中学习提取特征。简洁版ELAN结构则是将原YOLOv7的ELAN结构中7个CBL层精简为5个。ELAN结构是官方提出的一种高效聚合网络,当输入信息或梯度信息传递很多层后,信息可能消失或过度膨胀,而ELAN在输入和输出间包含了多个较短连接,使得网络显著加深,变得更加精确和高效。简洁版的ELAN通过调节最短和最长的梯度路径从而使网络学习到更多的特征,且具有更强的鲁棒性。在MP层中,YOLOv7-tiny取消了卷积操作,改为只使用池化下采样,以拼接不同特征。

在颈部,YOLOv7-tiny沿用YOLOv5的PAFPN结构,其中包含有若干个CBL卷积层、简洁版的SPPCSPC以及简洁版ELAN。三个特征提取层分别位于Backbone的中、中下、底部位置,分别对不同尺度的特征进行特征提取。SPPCSPC是一种特殊的SPP(spatial pyramid pooling)结构,它具有CSP(cross stage partial)模块,结构中有一个大的残差边辅助优化与特征提取,能有效扩大感受野。而简洁版的SPPCSPC则是在原结构中减少了CBL卷积的数量。

在检测头部分,笔者借鉴RepVGG网络提出了RepConv(re-parameterization conv)网络,在网络的部分结构处采用模型重参数化,在不降低模型性能的同时有效减少参数量,提高网络的运算速度。

3.2 网络模型优化

相较于YOLOv7算法,YOLOv7-tiny算法虽然体量更小,能提高特征提取速度,但同时却存在以下不足:

(1)网络主干和颈部采用了大量简洁版的ELAN结构,虽然减少了参数量,但却使得网络层数减少而降低了特征提取能力。

(2)整个网络采用Leaky ReLU函数,由于Leaky ReLU在不同区间函数不同,导致无法为正负输入提供一致的关系预测,在特征向下传递及反向传播时,随着网络的加深,梯度更新会越来越不光滑,从而影响预测结果。

(3)上采样模块采用最近邻上采样算子,仅通过像素点的空间位置来决定上采样核,并没有利用特征图的语义信息,使得感知域通常都很小。

(4)采用CIoU(complete intersection over union)作为bounding box的定位损失,其纵横比描述的是相对值,并未反映出宽高分别与置信度的不同,存在一定的模糊性,且未考虑难易样本的平衡问题。

基于以上不足,本文使用YOLOv7-tiny作为基础网络进行改进。本文的改进方法如下:

(1)为强化主干部分的特征提取能力,提高对训练图像不同区域的信息提取效率,在三个特征提取层前添加SimAM(simple attention module)注意力模块,优化特征层的表达能力,丰富提取到的有效特征层的语义信息。

(2)替换Neck部分的Leaky ReLU函数,使用更为平滑的Mish作为激活函数,增加更多的非线性表达,提高模型泛化性。

(3)采用轻量级上采样算子CARAFE改善特征融合网络融合能力,以及原网络模型中最近邻上采样存在的无法很好兼顾路面障碍物检测中速度和精度的问题。

(4)采用WIoU损失函数作为模型定位损失,聚焦于普通质量的锚框,提高检测器的整体性能。

3.2.1 SimAM注意力模块

现有的注意力模块通常被继承到每个块中,以改进来自先前层的输出。这种细化步骤通常沿着通道维度或空间维度操作,从而生成一维或二维权重,并平等对待每个通道或空间位置中的神经元。通道注意力模块对不同通道区别对待,对所有位置同等对待;空间注意力模块对不同位置区别对待,对所有通道同等对待。这种方式可能会限制其学习更多辨别线索的能力,因此三维权重注意力优于传统的一维和二维权重注意力。在现实生活中,空间注意力和通道注意力往往协同作用,共同促进视觉处理过程中的信息选择。为此文献[20]提出了一种3-D无参注意力模块,使其每个神经元被分配唯一的权重。为更好地评估每个神经元的重要性,每个神经元都被定义了能量函数et,如下式所示:

et(wt,bt,y,xi)=(yt-t^)2+1M-1∑M-1i=1(y0-x^i)2

(1)

其解析解如下:

wt=-2(t-μt)(t-μt)2+2σ2t+2λ(2)

bt=-12(t+μt)wt(3)

μt=1M-1∑M-1i=1xi(4)

σ2t=1M-1∑M-1i=1(xi-μt)2(5)

式中,wt、bt为权重和偏差;t^、x^i为目标神经元和其他神经元在相同通道上的输入特征t、xi关于wt、bt的线性变换;M为该通道上输入神经元的数量;i为空间维上的指数;μt、σ2t分别为该通道中除t以外的所有神经元的均值和方差;λ为超参量。

由此得到轻量型注意力模块SimAM。SimAM注意力模块结构如图6所示,其中,X表示特征图,C为通道数,H为特征图的高,W为特征图的宽。与现有的通道注意力模块和空间注意力模块相比,SimAM注意力模块无需向原始网络添加参数,而是在一层中推断特征图的3-D权重。

为了能在复杂行车环境下准确检测不同尺度的目标,提高凹坑和减速带的识别准确率,本文在三个特征提取层前各添加一个SimAM注意力模块以提高网络对特征图感知能力。加入SimAM后的部分网络结构如图7所示。

3.2.2 激活函数优化

YOLOv7-tiny中采用Leaky ReLU作为激活函数,定义如下:

Leaky ReLU(x)=ax x<0

xx≥0(6)

式中,a为衰减系数。

Leaky ReLU函数虽然在ReLU基础上解决了负输入下梯度为零的情况,但它在实际应用中的效果却并不稳定,无法为函数值在不同区间上提供一致的关系预测。2019年MISRA[21]提出了一种新型激活函数——Mish函数,定义如下:

Mish=xtanh(ln(1+exp(x)))(7)

Mish函数无上界有下界,其正值可以达到任何高度,避免了由于封顶而出现的饱和,从而导致梯度消失问题,同时有下界则保证了一定的正则化效应,利于网络的训练。不同于ReLU和Leaky ReLU的差分为0,可能导致部分神经元没有得到更新的缺点,Mish是非单调函数,有助于保持小的负值,从而稳定网络梯度流。

Mish函数在负区间内更加光滑,使得在求解和模型泛化性上表现更为优良。Mish函数和Leaky ReLU函数的对比如图8所示。

在YOLOv4相关实验中,Mish激活函数表现得更加稳定。鉴于此,本文在网络的Neck部分将原网络中的Leaky ReLU激活函数替换为Mish函数。

3.2.3 上采样算子CARAFE

特征上采样对密集目标检测任务至关重要,在原网络结构中,Neck部分上采样采用最近邻插值,虽然计算量小运算较快,但却仅仅依靠离待测采样点最近的像素的灰度值作为该采样点的灰度值,而没有考虑其他相邻像素点的影响,使得特征重组时忽略了一部分信息。WANG等[22]通过研究提出了CARAFE上采样算子,它主要由两个关键模块构成,即内核预测模块和内容感知重组模块。在给定大小为C×H×W的特征图X和上采样率σ后,经过CARAFE将生成一个大小为C×σH×σW的新特征图X′。对于在新特征图中的任意目标位置l′=(i′,j′),在原特征图中都有l=(i,j)与之对应,且l=i′/σ,j=j′/σ。将N(Xl,k)表示为X的k×k子域,第一步内核预测通过Xl的k×k子域预测每个位置l′的位置核Wl′,公式如下:

Wl′=ψ(N(Xl,kencoder))(8)

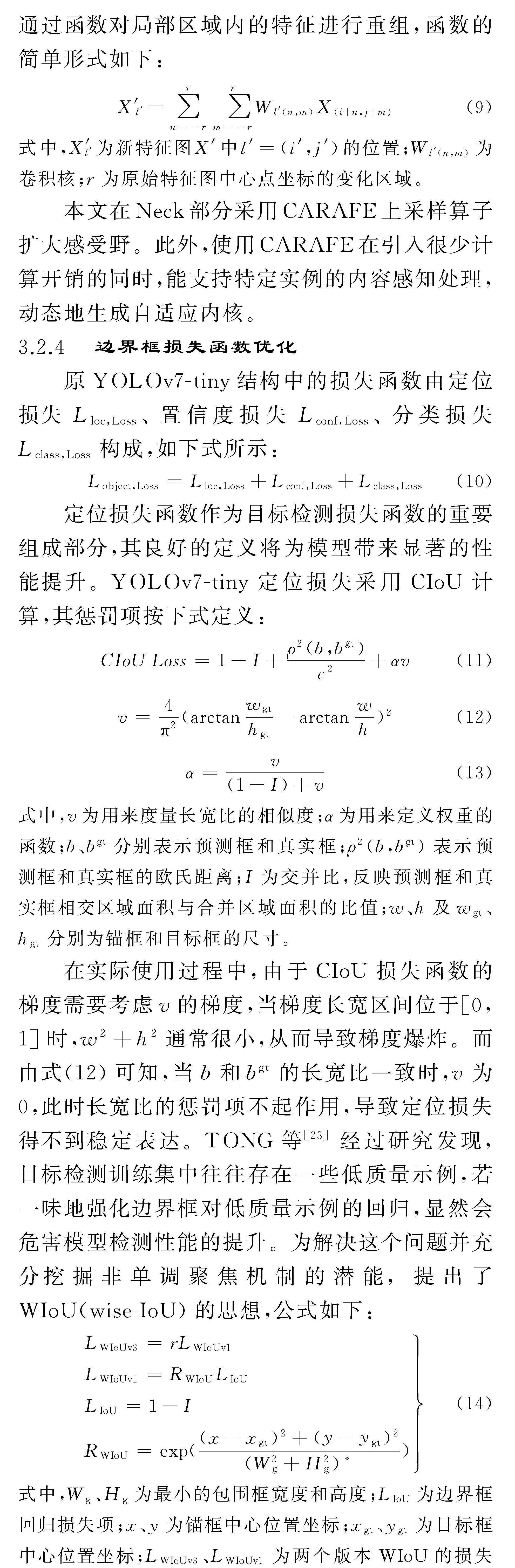

第二步内容感知重组中,对每个重组内核都通过函数对局部区域内的特征进行重组,函数的简单形式如下:

X′l′=∑rn=-r∑rm=-rWl′(n,m)X(i+n,j+m)(9)

式中,X′l′为新特征图X′中l′=(i′,j′)的位置;Wl′(n,m)为卷积核;r为原始特征图中心点坐标的变化区域。

本文在Neck部分采用CARAFE上采样算子扩大感受野。此外,使用CARAFE在引入很少计算开销的同时,能支持特定实例的内容感知处理,动态地生成自适应内核。

3.2.4 边界框损失函数优化

原YOLOv7-tiny结构中的损失函数由定位损失Lloc,Loss、置信度损失Lconf,Loss、分类损失Lclass,Loss构成,如下式所示:

Lobject,Loss=Lloc,Loss+Lconf,Loss+Lclass,Loss(10)

定位损失函数作为目标检测损失函数的重要组成部分,其良好的定义将为模型带来显著的性能提升。YOLOv7-tiny定位损失采用CIoU计算,其惩罚项按下式定义:

CIoU Loss=1-I+ρ2(b,bgt)c2+αv(11)

v=4π2(arctanwgthgt-arctanwh)2(12)

α=v(1-I)+v(13)

式中,v为用来度量长宽比的相似度;α为用来定义权重的函数;b、bgt分别表示预测框和真实框;ρ2(b,bgt)表示预测框和真实框的欧氏距离;I为交并比,反映预测框和真实框相交区域面积与合并区域面积的比值;w、h及wgt、hgt分别为锚框和目标框的尺寸。

在实际使用过程中,由于CIoU损失函数的梯度需要考虑v的梯度,当梯度长宽区间位于[0,1]时,w2+h2通常很小,从而导致梯度爆炸。而由式(12)可知,当b和bgt的长宽比一致时,v为0,此时长宽比的惩罚项不起作用,导致定位损失得不到稳定表达。TONG等[23]经过研究发现,目标检测训练集中往往存在一些低质量示例,若一味地强化边界框对低质量示例的回归,显然会危害模型检测性能的提升。为解决这个问题并充分挖掘非单调聚焦机制的潜能,提出了WIoU(wise-IoU)的思想,公式如下:

LWIoUv3=rLWIoUv1

LWIoUv1=RWIoULIoU

LIoU=1-I

RWIoU=exp((x-xgt)2+(y-ygt)2(W2g+H2g)*)(14)

式中,Wg、Hg为最小的包围框宽度和高度;LIoU为边界框回归损失项;x、y为锚框中心位置坐标;xgt、ygt为目标框中心位置坐标;LWIoUv3、LWIoUv1为两个版本WIoU的损失项;RWIoU为包围框中心归一化距离。

WIoU基于动态非单调聚焦机制设计,使用“离群度”替代IoU对锚框进行质量评估。相较于CIoU,WIoU没有对纵横比进行计算,使得其计算耗时比CIoU更少。WIoUv3在WIoUv1基础上定义离群度β来表述锚框质量:

β=L*IoULIoU∈[0,+∞)(15)

式中,L*IoU为梯度增益;LIoU为动量为m的指数运算均值。

并利用它构造了非单调聚焦系数γ应用于WIoUv1上,如下式所示:

γ=βδαβ-δ(16)

式中,α、δ为超参数。

由式(16)可知,当β=σ时,r取1;当β取定值时,锚框将获得最高梯度增益。由于LIoU是动态的,使得WIoUv3总能作出最符合当前情况的梯度增益分配策略。

改进后的网络结构如图9所示。

4 实验验证

4.1 离线实验

改进后的算法模型训练与验证依赖于高性能的硬件配置,同时参数的选择对模型的权重更新也有着密不可分的联系,本文中模型训练所用硬件相关配置如表2所示。

平均精度mAP(mean average precision)为精度P(precision)和召回率R(recall)的综合计算结果,在目标检测任务中主要用于反映整个模

型的准确率。IoU(intersection over union)反映预测框和真实框相交区域面积和合并区域面积的比值。mAP@0.5表示IoU为0.5时的mAP值,是模型的主要评价指标之一。mAP@0.5:0.95则是IoU从0.5起以0.05步距递增到0.95时的平均mAP值,反映了预测框的精准度。单张照片推理时间则反映了模型的运算效率。

改进后的网络模型与原YOLOv7-tiny的mAP结果对比如图10所示。图中原网络模型与改进后网络模型的mAP@0.5分别为0.927与0.952,mAP@0.5:0.95分别为0.694与0.749。由图中曲线增长趋势可以看出改进后的模型表现要更加优异。

(a)mAP0.5曲线

(b)mAP0.5:0.95曲线

and the original model

采用消融实验验证改进模块对模型的优化作用。表3中实验1的模型为原模型;实验2为加入了SimAM之后的模型,mAP@0.5值比原模型增大了0.6个百分点;实验3将激活函数替换为Mish函数,并采用CARAFE上采样算子;实验4在实验3基础上采用WIoU作为定位损失函数;实验5则是在实验4基础上在三个特征提取层前加入SimAM注意力模块。

为更直观地对比改进前后的检测效果,首先选取成像效果较好的凹坑、减速带各两张图片进行检测对比。图11中对减速带原模型检测的置信度分别为0.87、0.91,改进后模型检测的置信度分别为0.90、0.93;对凹坑原模型检测的置信度为0.86、0.92,改进后模型检测的置信度为0.89、0.93。由结果可知,在成像效果较好时,改进模型的检测效果优于原模型的检测效果。

为验证模型在复杂情况下造成较差成像时的检测效果,选取图12所示的多种情况下低分辨率图像进行对比实验。由图12中检测效果1对比可知,在暗光条件下,改进模型对凹坑的检测置信度为0.85,要明显高于原模型的0.27,而针对图12a中减速带两者均未有效检测,可能是由于暗光造成图像对比度低,加之成像模糊以及图中有相似颜色干扰所致。效果2中对极低分辨率图像的检测,检测结果相似,改进的模型准确率比原模型略高。效果3中对雨天道路湿滑情况下凹坑的检测,原模型检测置信度为0.66,而改进模型置信度为0.82,改进后的模型表现更加优秀,对减速带的检测两者准确率均较高。效果4中模拟复杂背景下减速带年久褪色情况下的检测,由图12d可知,改进后的模型准确率要更高。效果5则是泥泞路段连续积水凹坑检测,无论是原模型还是改进模型均能很好地检测出目标,没有漏检情况发生,但在置信度上改进模型要略高。

将改进后的模型与目标检测领域主流单阶段检测算法SSD、YOLOv3-tiny、YOLOv4-tiny、YOLOX-s等网络模型进行实验对比,结果如表4所示。为节约训练时的时间成本,在对比实验中部分网络取每5或10个学习次数计算一次mAP值,各网络的mAP变化趋势如图13所示。

由表4和图13分析可知,改进后的网络与SSD相比,参数量不到SSD参数量的六分之一,准确率提高了8.5个百分点,且推理用时明显更少;与YOLOv3-tiny相比,改进模型在检测准确度与效率上都要更高,且YOLOv3-tiny在训练时的mAP曲线振荡明显,模型不够稳定;改进后的模型与YOLOv4-tiny相比,参数量相当,但改进后的模型在准确度上有绝对优势;改进后的模型与YOLOX-s相比,虽然在准确率上略低,但参数量却比YOLOX-s少了约3×106个,说明改进后的模型在训练和部署时所需的硬件条件可以比YOLOX-s更低,且单张照片推理时间减少了3.4 ms,效率更高;与原YOLOv7-tiny相比,改进后的模型由于加入注意力等模块,使得推理时间增加了0.3 ms,但其检测速度仍具有很好的实时性,在准确率上本文改进模型高出2.5个百分点,且由图12可知在复杂条件下改进模型的表现更加优秀。

4.2 实车实验

为检验改进网络模型在实际行车过程中的使用效果,将其部署到课题组实验车辆视觉系统上。实验车辆如图14所示。

实验车辆上的感知设备为森云智能工业相机,用于路面图像的实时采集,工控机为NVIDIA Xavier,操作系统为Ubuntu,算法模型基于CUDA框架下的Pytorch开发环境进行加速计算。

图15所示为本团队编写的路面、道路环境参数实时感知系统,包括凹坑和凸块的检测,可以实时显示检测结果。由图可见,在实车行驶时部署的算法模型能够准确检测出前方不同距离路面上的障碍物,证明该算法具有一定的实用性。

5 结论

为解决当前复杂行车环境下路面障碍物预前检测问题,本文提出了一种基于改进YOLOv7-tiny算法的路面障碍物检测模型。在几乎不增加计算参数的条件下,有效提高了检测准确率。通过实车实验验证了改进的算法模型在实际应用中的有效性。本文主要的研究及结果如下:

(1)构建了常见路面障碍物数据集,分别包含凹坑、减速带两类目标,晴天、雨天、黄昏三种环境,以及城市、校园、乡村三种场景。并通过数据增强进行数据集扩充满足了多样性。

(2)基于YOLOv7-tiny算法网络,在三个特征提取层添加SimAM注意力模块,丰富特征层的表达;在Neck部分使用Mish激活函数提高网络的泛化能力;将最近邻上采样算子替换为CARAFE上采样算子,扩大感受野;使用WIoU作为定位损失函数优化边界框损失,更加高效地分配了梯度增益。

(3)通过离线实验和实车实验验证了改进模型的有效性。在离线实验对比中,改进的网路模型优于原模型及其他主流单阶段目标检测网络;在实车实验中,改进后的模型部署到实验车辆的视觉系统上,能够准确地检测出前方道路障碍物并实时反馈到交互界面上。

参考文献:

[1] LIU W, WANG R C, DING R K, et al. Online Estimation of Road Profile in Semi-active Suspension Based on Unsprung Mass Acceleration[J]. Mechanical Systems and Signal Processing, 2020, 135(C):106370.

[2] XUE K, NAGAYAMA T, ZHAO B.Road Profile Estimation and Half-car Model Identification through the Automated Processing of Smartphone Data[J]. Mechanical Systems and Signal Processing, 2020, 142(C):106722.

[3] 刘家银, 唐振民, 王安东, 等. 基于多激光雷达与组合特征的非结构化环境负障碍物检测[J]. 机器人, 2017, 39(5):638-651.

LIU Jiayin, TANG Zhenmin, WANG Andong,et al. Negative Obstacle Detection in Unstructured Environments Based on Multiple Lidars and Combined Features[J]. Robot, 2017, 39(5):638-651.

[4] 邬佳琪.基于数据融合的全地面起重机路面信息识别技术研究[D].长春:吉林大学, 2020.

WU Jiaqi. Research on Road Information Recognition Technology of All-terrain Crane Based on Data Fusion[D]. Changchun:Jilin University, 2020.

[5] QI C R, YI L, SU H, et al. Pointnet++:Deep Hierarchical Feature Learning on Point-sets in a Metric Space[C]∥Proceedings of the 31st International Conference on Neural Information Processing Systems. Long Beach,2017:5099-5108.

[6] TIAN Z, SHEN C, CHEN H, et al. FCOS:Fully Convolutional One-stage Object Detection[C]∥IEEE International Conference on Computer Vision. Korea,2020:9626-9635.

[7] REDMON J, DIVVALA S, GIRSHICK R,et al.You Only Look Once:Unified, Real-time Object Detection[C]∥Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recongnition. Piscataway:IEEE, 2016:779-788.

[8] REDMON J, FARHADI A. YOLO9000:Better, Faster, Stronger[C]∥IEEE Conference on Computer Vision and Pattern Recognition. Piscataway:IEEE 2017:7263-7271.

[9] REDMON J, FARHADI A. YOLOv3:an Incremental Improvement[C]∥2018 IEEE Conference on Computer Vision and Pattern Recongnition. Piscataway:IEEE ,2018:1-6.

[10] BOCHKOVSKIY A, WANG C Y, LIAO H Y M. Yolov4:Optimal Speed and Accuracy of Object Detection[EB/OL]. New York:Cornell University Library, 2020[2024-03-08].https:∥arxiv.org/pdf/2004.10934.

[11] LIU W, ANGUELOV D, ERHAN D, et al. SSD:Single Shot MultiBox Detector[C]∥European Conference on Computer Vison. Switzerland,2016:21-37.

[12] LIN T Y , GOYAL P, GIRSHICK R, et al.Focal Loss for Dense Object Detection[C]∥Proceedings of the IEEE International Conference on Computer Vision. Venice,2017:2980-2988.

[13] GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich Feature Hierarchies for Accurate Object Detection and Semantic Segmentation[C]∥IEEE Transactions on Pattern Analysis and Machine Intelligence.Columbus,2014:580-587.

[14] GIRSHICK R. Fast R-CNN[C]∥IEEE Interna-tional Conference on Computer Vision. Santiago,2015:10-15.

[15] REN S, HE K, GIRSHICK R, et al. Faster R-CNN:Towards Real-time Object Detection with Region Proposal Networks[J].IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6):1137-1149.

[16] 韩岩江, 王伟, 王峰萍. 融合坐标注意力和Bi-FPN的YOLOv5s交通标志检测方法[J]. 国外电子测量技术, 2022, 41(11):170-179.

HAN Yanjiang, WANG Wei, WANG Fengping. YOLOv5s Traffic Sign Detection Method Combining Coordinate Attention and BiFPN[J]. Foreign Electronic Measurement Technology, 2022, 41(11):170-179.

[17] 顾士洲, 严天一. 基于改进YOLOv3的路面正负障碍物检测研究[J]. 青岛大学学报(工程技术版), 2022, 37(2):41-46.

GU Shizhou, YAN Tianyi. Research on Road Posi-tive and Negative Obstacle Detection Based on Improved YOLOv3[J]. Journal of Qingdao University(Engineering Technology Edition), 2022, 37(2):41-46.

[18] 刘子龙, 沈祥飞. 融合Lite-HRNet的Yolov5双模态自动驾驶小目标检测方法[J]. 汽车工程, 2022, 44(10):1511-1520.

LIU Zilong, SHEN Xiangfei. Yolov5 Dual-modal Automatic Driving Small Target Detection Method Based on Lite-HRNet[J]. Automobile Engineering, 2022, 44(10):1511-1520.

[19] WANG C Y, BOCHKOVSKIY A, LIAO H Y M. YOLOv7:Trainable Bag-of-freebies Sets New State-of-theart for Real-time Object Detectors[C]∥Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition. New Orleans, 2023:7464-7475.

[20] YANG L, ZHANG R Y, LI L, et al. SimAM:a Simple,Parameter-free Attention Module for Convolutional Neural Networks[C]∥Proceedings of the 38th International Conference on Machine Learning. New York, 2021:11863-11874.

[21] MISRA D. Mish:a Self Regularized Non-monotonic Neural Activation Function[EB/OL]. New York:Cornell University Library, 2020[2024-03-08]. https:∥arxiv.org/abs/1908.08681.

[22] WANG J, CHEN K, XU R, et al. CARAFE:Content-aware ReAssembly of FEatures[EB/OL]. New York:Cornell University Library, 2019[2024-03-08]. https:∥arxiv.org/abs/1905.02188.

[23] TONG Z, CHEN Y, XU Z, et al. Wise-IoU:Bounding Box Regression Loss with Dynamic Focusing Mechanism[EB/OL]. New York:Cornell University Library, 2023[2024-03-08]. https:∥arxiv.org/abs/2301.10051.

(编辑 王艳丽)

作者简介:

邹俊逸,男,1992年生,副教授。研究方向为汽车动力学控制、线控底盘设计、智能网联汽车。E-mail:zoujunyi@wust.edu.cn。