基于WLS滤波优化的双目视觉深度图重建

2024-06-24周思琦管志光殷珊珊郭子屹林明星

周思琦 管志光 殷珊珊 郭子屹 林明星

摘要:为解决双目视觉三维重建深度图边缘不连续的问题,提出基于加权最小二乘(weighted least squares,WLS)滤波的深度图优化,经双目标定、畸变矫正、立体校正、立体匹配建立三维深度图,加入WLS滤波,通过调整正则项更改约束条件,对梯度较大的区域减少约束,保留图像边缘,对梯度较小的区域平滑处理,去除噪声,采用峰值信噪比、结构相似性指数、平均绝对误差3个参数评价图像质量。评价结果表明:与半全局匹配算法相比,此算法的峰值信噪比增大1.849 dB,图像失真更少,质量更高;结构相似性指数增大0.415 1,与原图结构相似性更强;平均绝对误差减小21.542 2,还原度更高。重建的深度图视觉效果更好,改善立体匹配不连续的问题,减小匹配误差,使视差图质量更高。

关键词:WLS滤波;双目视觉;三维重建;深度图;立体匹配

中图分类号:U463.6;TP391.41文献标志码:A文章编号:1672-0032(2024)02-0139-07

引用格式:周思琦,管志光,殷珊珊,等.基于WLS滤波优化的双目视觉深度图重建[J].山东交通学院学报,2024,32(2):139-145.

ZHOU Siqi, GUAN Zhiguang, YIN Shanshan, et al. Depth map reconstruction of binocular vision optimized by WLS filtering[J].Journal of Shandong Jiaotong University,2024,32(2):139-145.

0 引言

双目视觉的深度图是在相机拍摄后,根据相机的位置和内部参数(图像原点坐标、图像坐标系像素宽度、焦距、像素点尺寸偏差等),通过程序处理建立1个新的三维图像[1-2],在水下研究、生物探索、机械制造等领域应用广泛[3-5],例如机械臂手臂抓取目标、跟踪研究海洋生物等[6],在智能领域应用更广。深度图的重建过程受结构光、内部参数及飞行时间的影响[7],深度图成像不清晰,获取高精度、高分辨率深度图较困难[8]。

深度图所需视差通常由局部滤波器内核基于高分辨率红绿蓝(red green blue,RGB)颜色空间图像的电导率信息采样得到[9-11]。优化深度图时,采用神经网络进行立体匹配算法逐渐增多,其中粗精结合二次匹配算法[12]和加入多尺度损失函数保留图像边缘算法[13]可提高图像质量,但计算量过大,过程繁琐。改进后的AD算法和Census匹配算法计算量小[14],结合深度学习、彩色编码细化重建结果[15],对图像边缘处理效果不佳。基于滤波的算法中,同态滤波算法可提高图像亮度和对比度[16],但六角椎体模型(hue saturation value,HSV)和RGB空间转换不适用于深度图。分割图像前景和背景,用滤波估计透射率,达到细化图像的效果[17];对晕轮效应进行高斯滤波处理,得到细节完善的森林图像[18]。滤波的优化效率比神经网络高,滤波优化方法中全局优化比局部优化准确,重建的三维深度图精确度更好,选取合适的滤波就能获取针对性的、理想的处理图像。

本文提出基于加权最小二乘(weighted least squares,WLS)滤波优化深度图的重建算法,采用基于双边滤波的WLS保边滤波器,对深度图噪声明显的区域平滑去噪,同时保留深度图中的物体边缘,以期通过调整正则项(惩罚项)更改约束条件,平衡边缘和平滑区的占比,对不同环境下的深度图都有良好的适应能力。

1 坐标转换

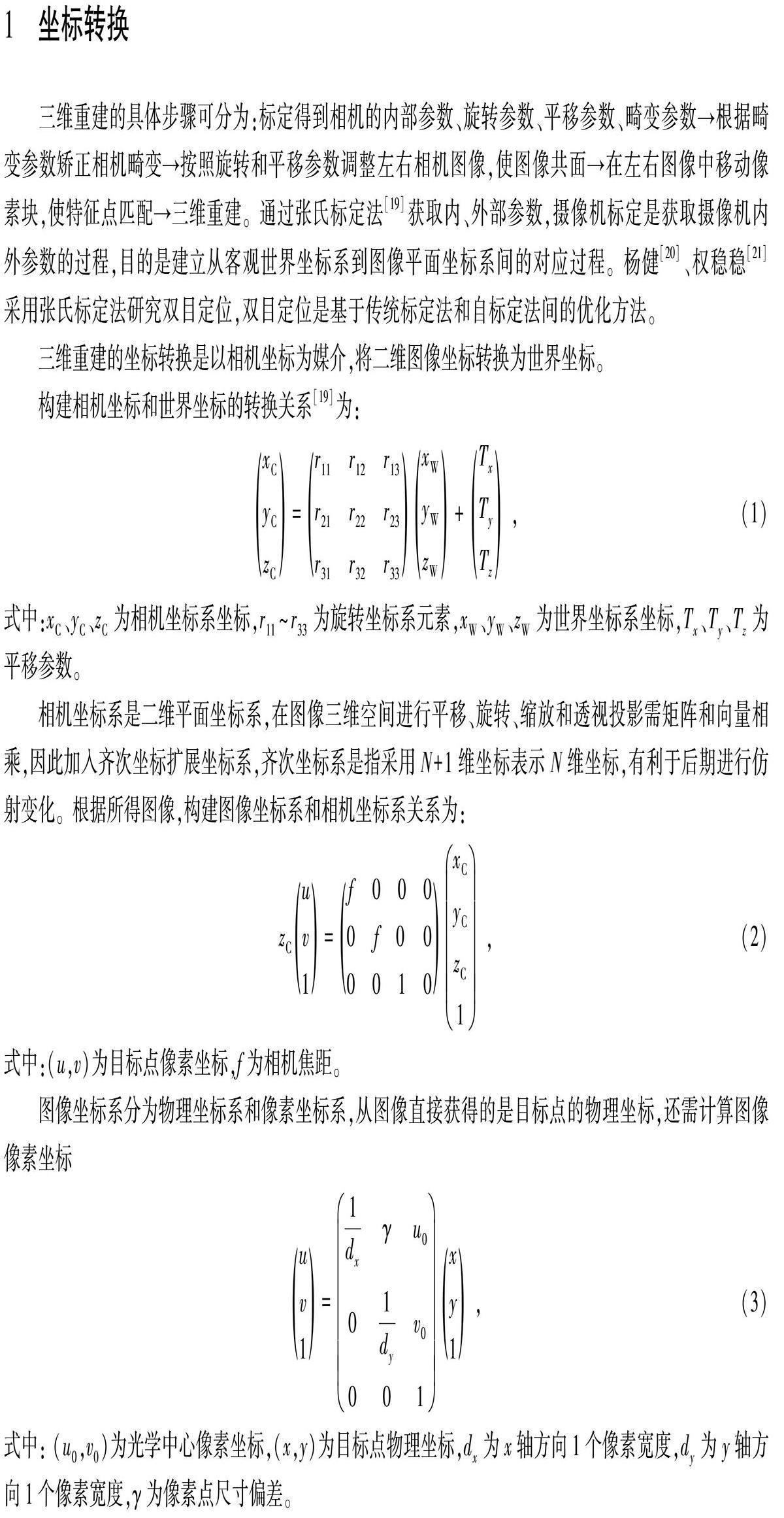

三维重建的具体步骤可分为:标定得到相机的内部参数、旋转参数、平移参数、畸变参数→根据畸变参数矫正相机畸变→按照旋转和平移参数调整左右相机图像,使图像共面→在左右图像中移动像素块,使特征点匹配→三维重建。通过张氏标定法[19]获取内、外部参数,摄像机标定是获取摄像机内外参数的过程,目的是建立从客观世界坐标系到图像平面坐标系间的对应过程。杨健[20]、权稳稳[21]采用张氏标定法研究双目定位,双目定位是基于传统标定法和自标定法间的优化方法。

三维重建的坐标转换是以相机坐标为媒介,将二维图像坐标转换为世界坐标。

构建相机坐标和世界坐标的转换关系[19]为:

xCyCzC=r11r12r13r21r22r23r31r32r33xWyWzW+TxTyTz,(1)

式中:xC、yC、zC为相机坐标系坐标,r11~r33为旋转坐标系元素,xW、yW、zW为世界坐标系坐标,Tx、Ty、Tz为平移参数。

相机坐标系是二维平面坐标系,在图像三维空间进行平移、旋转、缩放和透视投影需矩阵和向量相乘,因此加入齐次坐标扩展坐标系,齐次坐标系是指采用N+1维坐标表示N维坐标,有利于后期进行仿射变化。根据所得图像,构建图像坐标系和相机坐标系关系为:

zCuv1=f0000f000010xCyCzC1 ,(2)

式中:(u,v)为目标点像素坐标,f为相机焦距。

图像坐标系分为物理坐标系和像素坐标系,从图像直接获得的是目标点的物理坐标,还需计算图像像素坐标

uv1=1dxγu001dyv0001xy1,(3)

式中: (u0,v0)为光学中心像素坐标,(x,y)为目标点物理坐标,dx为x轴方向1个像素宽度,dy为y轴方向1个像素宽度,γ为像素点尺寸偏差。

2 三维重建

2.1 畸变矫正

受相机制造工艺限制,所得图像不能完全按理想公式计算,若不考虑畸变,可能导致三维重建失败或存在较大误差,因此,需通过计算矫正畸变。图像畸变分为桶形畸变和枕形畸变,如图1所示。由镜头形状造成的缺陷,用径向畸变和切向畸变联合表示,试验所用相机畸变小于0.3%,径向畸变和切向畸变同时存在,畸变系数是相机的内部参数,由标定结果可得畸变系数。

矫正畸变原理[21]表示为:

x′y′=1+k1r2+k2r4+k3r6xy+2p1xy+p2r2+2x22p2xy+p1r2+2y2,

式中:(x′, y′)为矫正畸变后目标点的图像物理坐标,k1、k2、k3为相机的径向畸变系数,r为径向距离,p1、p2为相机的切向畸变系数。

2.2 立体校正

视差是指同一目标点在左、右相机成像时所在位置的差异,如图2所示,C1、C2分别为左、右相机,平面M1、M2分别为左、右相机的成像面,P为极点,P1、P2分别为极点P 在左、右相机成像面的点,t1、t2分别为在P1、P2点的极线。消除视差需进行立体校正,即对M1和M2进行平行共面调整。在现实中,左右图像平行共面的理想条件不存在,进行立体校正,将图像校正为平行共面图像是计算视差的前提。

M1和M2均从图2位置旋转R/2(R为旋转矩阵)后两平面平行,共面校正矩阵为:

rL=R12rR=R-12 ,

式中rL和rR分别为左、右相机的共面校正矩阵。

建立平移矩阵T同向的行对准矩阵Rrect,使P转换到无穷远处,以e1为与T同向的极点,转换公式为Rrect=e1 e2 e3T。以左相机图像为例,归一化平移矩阵表示旋转矩阵[21]为:

e1=TT,e2=-TxTy0 Tx2+Ty2,e3=e1e2。

计算得到e1=cos αsin α0,e2=-sin αcos α0,e3=001。

将双目相机左侧相机拍摄的图片从起始位置绕e3方向向靠近右相机图像的方向旋转α,对双目相机右侧相机拍摄的图片同样方法旋转α得到立体校正图像。

2.3 立体匹配

立体匹配分为局部匹配、全局匹配和半全局匹配。局部匹配采用局部纹理约束进行视差匹配,算法速度较快,但整体上无法得到全局最优化;全局匹配需定义1个能量函数,表征左右相机成像的相似性,找到全局最小能量,对应的变化函数就是全局视差,此方法对模糊图像不敏感,但代价较高,不适合大量使用;半全局匹配综合局部匹配和全局匹配2种方法的优点,在每行寻找最佳视差路径,该视差可整行匹配,代价最低,匹配精度较高,计算量较小。

半全局匹配的步骤为匹配代价计算→代价聚合→视差计算与细化:设置单位三维矩阵XDSI存储像素的匹配代价,XDSI越小,说明左、右相机成像相似度越高;经代价聚合,XDSI才能计算最优视差,代价聚合是对XDSI进行全局优化,得到存有代价聚合的新矩阵后计算视差,选择最小视差;视差细化是对视差图进行误差消除、亚像素插值等细化操作。

视差是重建三维的关键,通过立体匹配,采用半全局匹配算法找到相机视差,半全局算法将全局最优化问题简化为多方向代价问题,用一维多个代价聚合的方式实现二维路径最优化,寻找每个像素的最优视差,生成深度图,求得目标点坐标为:

z=Qx fQx-u0-uR-uL-u0s=Qx fQx-dx=Qx fQx-duR-u0s=QxQx-dx-xcy=Qx fQx-dvR-v0s=QxQx-dy-yc,(5)

式中:Qx为左、右相机基线;(uL,vL)、(uR,vR)分别为左目、右目的目标点像素坐标;d为视差,d=uL-uR。

由式(5)可得目标点的世界坐标,建立相机三维深度图。

3 WLS滤波深度图优化

图像优化通常是指对图像采取多尺度分层处理,将图像分为平滑基础层、大尺度亮度变化层和小尺度细节残差层,分层处理后再合并为优化图像,易产生视觉伪影,把不存在的影像呈现在图像上,需避免产生视觉伪影,保留图像细节。

线性滤波的优化使图像边缘不清晰,输出图像易出现光晕,不适合多尺度图像处理。WLS滤波是基于双边滤波的加权最小二乘保边滤波,能通过调整正则项(惩罚项)更改约束条件平衡边缘和平滑区,对深度图噪声明显的区域平滑去噪,同时保留深度图中物体边缘。

设原图为G,WLS滤波输出图为W,为使W尽可能接近G,WLS滤波损失函数应取最小值,损失函数

fW=∑pWp-Gp2+δaxpG-W-x2p+aypG-W-y2p ,

式中:axp、ayp分别为图像坐标系x、y方向的梯度加权矩阵,控制不同方向的平滑程度;p为像素点坐标;Wp为WLS滤波输出图中p点的像素;Gp为原图中p点的像素;δ为正则项参数。

Wp-Gp2可确保输入图像和输出图像的相似度更高,将G和W的距离最小化,保留图像边缘;δaxpG-W-x2p+aypG-W-y2p为正则项,作用为构造辅助函数,把约束优化问题转化为无约束问题,将原图的偏导最小化,实现小梯度区域的平滑。当图像的边缘梯度较大时,约束变小,保留边缘特征;当图像的边缘梯度较小时,认为不是重要细节信息,约束变大,减少边缘特征。δ越大,输出图像越平滑,损失函数的二次型矩阵形式为:

fW=a-bTa-b+δaTDTxAxDxa+aTDTyAyDya ,

式中:a、b为图像的向量表示,Ax、Ay为图像对角矩阵,Dx、Dy为前向离散差分算子,DTx、DTy为后向离散差分算子。

为求得损失函数的最小值,令损失函数导数为0,求目标解:

(I+δL )-1a=b ,

L=DTxAxDx+DTyAyDy ,

式中:I为单位矩阵;L为五点空间异构Laplacian矩阵,随空间位置而改变。

平滑权重函数为:

axpG=-l-xpμ+ε-1aypG=-l-ypμ+ε-1 ,

式中:l为原图像对数亮度通道;axpG和aypG决定W图像梯度的灵敏度;ε为常数,为防止分母为0,ε=0.000 1。

WLS滤波器的滤波函数可表示为:

Fδ=I+δLG-1 。

式中LG为图像G的五点空间异构矩阵。

经计算和试验,优化后的WLS滤波器参数为:正则化系数为4 000,边缘敏感度为0.125,视差差异阈值为110,深度不连续半径为3像素。

4 深度图结果分析

采用双目相机像元PXYZ-H65-606,分辨率为1280像素×720像素。拍摄标定的数据集为80组图像,标定板为30 mm棋盘格,图案阵列为12格×9格。试验系统为Windows 10专业版,英特尔Core i7-7700 2.80GHz四核处理器,显卡为NVIDIA GeForce GTX 1050,试验环境为PyCharm Community Edition 2022.3.3、OpenCV4.7.0.72。

经标定和计算,左相机内部参数为905.300 4 0.960 2647.966 7 0 904.967 6308.883 6 0 0 1 ,畸变系数为(0.027 5 -0.088 6 0.001 9 0.000 6 0.149 2)。

右相机内部参数为906.348 2 0.762 3640.843 6 0 905.881 1321.577 1 0 0 0 ,畸变系数为(0.025 7-0.050 7 0.001 3 0.001 1 0.008 4),旋转矩阵为0.999 9-0.001 00.014 00.001 0 1 -0.001 4-0.014 00.001 40.999 9,平移矩阵为(-59.530 4 -0.070 2 -0.014 8)。

双目相机原图如图3所示,半全局匹配算法深度图如图4所示。采用半全局匹配在整幅图中整体寻找最优视差,对遮挡和弱纹理区域较敏感,深度图在弱纹理区域的噪声更强,还原度更差,易造成错误匹配。深度图经WLS滤波优化后如图5所示,对背景的单一弱纹理有较好的还原度,保留图像的边缘特征,去除半全局匹配深度图的噪声,可优化图像细节。

通过图像中最大像素和均方误差确定峰值信噪比,峰值信噪比越大,表示输入图像的相似度越高。结构相似性指数分别从图像亮度、对比度、结构3个方向评价图像质量,可衡量图像的失真程度或相似程度,结构相似性指数取值范围为[-1,1],结构相似性指数越大,相似度越高。平均绝对误差为输入图像、输出图像像素灰度差的绝对值除以图像像素,平均绝对误差越小,左右相机成像偏差越小。指定图像尚未有较成熟的评价体系,此处采用的3种图像质量评价参数只作参考,仍需结合人眼视觉感知综合判断图像质量。

算法峰值信噪比/dB结构相似性指数平均绝对误差

半全局匹配 9.768 00.430 543.606 0

WLS滤波优化11.617 00.845 622.063 8

为适应图像质量评价算法,对半全局匹配的深度图进行灰度反转,在3种图像质量评价算法中,以原图为参考,评价半全局匹配和WLS滤波优化2种方法生成深度图的质量,结果如表1所示。

由表1可知:与采用半全局匹配算法相比,经WLS滤波后的深度图峰值信噪比较高,图像失真较少,质量较高;结构相似性指数较大,与原图结构相似性更大,深度图呈现效果较好;平均绝对误差更小,还原度更高。在试验环境中,低纹理区域有更好的视觉效果,对海参边缘等细节还原度较高,视觉匹配的准确度较高。经WLS滤波器处理的深度图质量更好,连续性更好。

5 结论

针对双目视觉三维重建深度图边缘不连续的问题,提出基于WLS滤波的深度图优化。获取双目相机内外部参数后,对相机图像畸变、歪斜等现象进行校正,在半全局匹配算法后加入WLS滤波优化深度图,对梯度较大的区域减少约束、保留细节,对梯度较小的区域平滑处理、去除噪声,重建的深度图视觉效果更好,可改善半全局区域匹配不连续的问题,减小匹配误差,使视差图质量更高。采用3种图像质量评价指标对半全局匹配算法深度图和WLS滤波优化算法深度图进行质量评价,结合视觉感知说明WLS滤波器优化后的深度图效果更好。

参考文献:

[1] 李煊,张铭钧. 水下双目视觉系统中的目标分割和目标定位[J].华中科技大学学报(自然科学版),2017,45(12):53-59.

[2] 李光乐,谢小鹏. 水下移动双目视觉高精度定位方法[J].中国测试,2015,41(增刊1):37-39.

[3] ZHOU J C,SUN J M,ZHANG W S,et al. Multi-view underwater image enhancement method via embedded fusion mechanism[J].Engineering Applications of Artificial Intelligence: the International Journal of Intelligent Real-Time Automation,2023,121:105946.

[4] 杨皓天,万腾. 葡萄采摘机械臂的双目定位与抓取精度研究[J].农机化研究,2022,44(12):49-54.

[5] 秦朗朗,潘丰. 基于双目定位的离合器下料系统设计[J].传感器与微系统,2017,36(10):80-84.

[6] ZHOU J C,ZHANG D H,ZHANG W S. Cross-view enhancement network for underwater images[J].Engineering Applications of Artificial Intelligence: the International Journal of Intelligent Real-Time Automation,2023,121:105952.

[7] 杨敬钰,谢天昊,岳焕景. 基于多层级跨模态特征融合的深度图重建算法[J].华中科技大学学报(自然科学版),2023,51(3):52-59.

[8] 徐硕,姜言清,李晔,等. 智能水下机器人自主回收的双目视觉定位[J].哈尔滨工程大学学报,2022,43(8):1084-1090.

[9] SENUSHKIN D,ROMANOV M,BELIKOV I,et al.Decoder modulation for indoor depth completion[C]// Proceedings of the IEEE International Conference on Intelligent Robots and Systems.Piscataway, New Jersey, United States:IEEE,2021:1697-1704.

[10] IMRAN S,LONGY F,LIU X,et al.Depth coefficients for depth completion[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition.Piscataway,New Jersey, United States:IEEE,2019:12438-12447.

[11] LONG Y Q,YU H M,LIU B.Depth completion towards different sensor configurations via relative depth map estimation and scale recovery[J].Journal of Visual Communication and Image Representation,2021,32(4):25-36.

[12] 马伟苹,李文新,孙晋川,等. 基于粗-精立体匹配的双目视觉目标定位方法[J].计算机应用,2020,40(1):227-232.

[13] 孔慧芳,房亮. 基于多尺度特征融合的快速单目图像深度估计[J].合肥工业大学学报(自然科学版),2022,45(3):332-335.

[14] 符强,孔健明,纪元法,等. 基于双目视觉的无人机实时测距算法[J].电光与控制,2023,30(4):94-99.

[15] 岳焕景,廖磊,杨敬钰. 基于双重自注意力机制的人脸图像修复[J].湖南大学学报(自然科学版),2023,50(8):32-41.

[16] 邵小强,杨涛,卫晋阳,等. 改进同态滤波的矿井监控视频图像增强算法[J].西安科技大学学报,2022,42(6):1205-1213.

[17] 刘长明,曹红燕,范焱,等. 结合OSTU阈值法的自适应DCP图像优化算法[J].火力与指挥控制,2022,47(6):162-170.

[18] 孟宇彤,赵康军,赵伟. 针对森林背景的去雾图像优化[J].森林工程,2022,38(4):106-112.

[19] ZHANG Z Y. A flexible new technique for camera calibration[J].IEEE Transactions on Patern Analysis and Machine Intelligence, 2000,22(11):1330-1334.

[20] 杨健.基于视觉的水下目标识别与定位技术研究[D].桂林:桂林电子科技大学,2022.

[21] 权稳稳.基于视觉的水下目标识别与定位技术研究[D].济南:山东大学,2018.

Depth map reconstruction of binocular vision optimized by

WLS filtering

ZHOU Siqi1, GUAN Zhiguang1*, YIN Shanshan1, GUO Ziyi1, LIN Mingxing2

1. School of Construction Machinery,Shandong Jiaotong University,Jinan 250357,China;

2. School of Mechanical Engineering,Shandong University,Jinan 250061,China

Abstract:To address the issue of discontinuities in the depth map of binocular vision three-dimensional reconstruction, a depth map optimization based on weighted least squares (WLS) filtering is proposed. A 3D depth map is established through binocular calibration, distortion correction, stereo rectification, and stereo matching. WLS filtering is applied. By adjusting the regularization term to modify the constraint conditions, constraints are reduced in regions with large gradients to preserve image edges, while smoothing is applied to regions with small gradients to remove noise. The image quality is evaluated using three parameters: peak signal-to-noise ratio (PSNR), structural similarity index (SSI), and mean absolute error (MAE). The evaluation results show that compared to the semi-global matching algorithm, this algorithm increases the PSNR by 1.849 dB, resulting in lower image distortion and higher quality. The SSI increases by 0.415 1, indicating stronger similarity to the original image structure. The MAE decreases by 21.542 2, leading to higher fidelity. The reconstructed depth map shows better visual effects, which improves the issue of discontinuities in stereo matching, reduces matching errors, and enhances the quality of the parallax map.

Keywords:WLS filtering;binocular vision;3D reconstruction;depth map; stereo matching

(责任编辑:王惠)

收稿日期:2023-01-09

基金项目:山东省自然科学基金项目(ZR2020ME267);山东省重点研发计划(重大科技创新工程)项目(2019JZZY020703)

第一作者简介:周思琦(1999—),女,黑龙江嫩江人,硕士研究生,主要研究方向为水下双目定位,E-mail:1797079352@qq.com。

*通信作者简介:管志光(1980—),男,山东单县人,教授,工学博士,主要研究方向为机器视觉和水下双目视觉等,E-mail:guanzhiguang@sdjtu.edu.cn。

DOI:10.3969/j.issn.1672-0032.2024.02.019