卷积神经网络在无人机图像识别中的应用

2024-05-03茹鲜古丽苏来满吾尔尼沙依米提涂伟沪

茹鲜古丽·苏来满,吾尔尼沙·依米提,涂伟沪

(哈密开放大学 新疆 哈密 839000)

0 引言

随着无人机技术的快速发展,无人机在军事、民用和商业领域的应用逐渐成为研究和关注的焦点。在无人机的广泛应用中,图像识别技术扮演着至关重要的角色,为无人机系统提供了丰富的信息和智能决策支持[1-2]。为了提高无人机图像识别的准确性和效率,深度学习技术中的卷积神经网络(convolutional neural network, CNN)[3-4]被广泛应用。本文旨在深入研究卷积神经网络在无人机图像识别中的应用,聚焦于轻量化卷积神经网络MobileNet-V1[5-6]的结构与实际应用。本研究期望为无人机图像识别技术的不断优化和发展贡献新的见解,推动无人机系统在各个领域的更广泛而深入的应用。

1 轻量化卷积神经网络

MobileNet-V1 是一种轻量级卷积神经网络,其基本结构采用了深度可分离卷积的设计思想,整体结构包括深度可分离卷积和逐点卷积两个关键步骤。如图1 所示,该网络的核心结构包括图像输入层,3 个3×3×1 的卷积核产生的特征图,输出通道数为3,以及5 个1×1×3 的卷积核产生的特征图,输出通道数为5。

图1 轻量化卷积神经网络MobileNet-V1

MobileNet-V1 的第一步是应用3 个3×3×1 的卷积核对输入图像进行卷积操作,从而生成3 个特征图。这一步骤旨在通过小型卷积核捕捉图像中的局部特征,有助于提高网络的感知力和表达能力。接下来,通过应用5 个1×1×3 的卷积核对前一步骤产生的特征图进行卷积操作,生成5 个输出通道的特征图。这一步骤称为逐点卷积,其目的是通过使用较小的卷积核减少计算复杂度,同时在特征图之间引入非线性变换,增强网络的表达能力。

MobileNet-V1 的重要特点之一是采用深度可分离卷积,该卷积操作分为深度卷积和逐点卷积两个步骤。深度可分离卷积首先通过3×3 的深度卷积对输入特征图的每个通道进行处理,然后再通过1×1 的逐点卷积进行通道间的整合。这一设计有效地降低了参数数量,减小了计算负担,使得MobileNet-V1 适用于计算资源有限的场景,为无人机图像识别等应用提供了高效的解决方案。

2 基于MobileNet-V1 的无人机图像识别

2.1 图像增强方法

为了应对无人机图像的特征,本研究提出了一种基于直方图均衡(histogram equalization)[7-8]和高斯滤波(Gaussian smoothing)[9-10]的图像增强方法,以优化图像的对比度和降低噪声。

首先,考虑到无人机图像可能存在部分区域亮度过低或过高的问题,本研究采用直方图均衡化来调整图像的灰度分布,提高图像的整体对比度。直方图均衡的基本思想是通过拉伸原始图像的灰度级别,使得灰度值均匀分布,从而增强图像的细节。具体而言,对于一幅无人机图像的灰度直方图,其离散形式可以表示为式(1):

式(1)中,Pr(rk) 是灰度级别rk的概率密度函数,nk是灰度级别rk的像素数量,N是总像素数量。通过对累积分布函数进行线性映射,可以获得均衡化后的灰度级别,如式(2)所示:

通过对整个图像应用T(rk) 可以实现直方图均衡化,从而改善图像的对比度。其次,为了减小无人机图像中可能存在的噪声,本研究引入高斯滤波进行平滑处理。高斯滤波的离散形式可以表示为式(3):

式(3)中,G(x,y) 是高斯核,σ是高斯滤波器的标准差。通过卷积原始图像与高斯核,可以实现对图像的平滑处理,抑制噪声的影响。综合考虑直方图均衡化和高斯滤波,本研究提出的图像增强方法可以表示为式(4):

式(4)中,Ioriginal是原始无人机图像,T是直方图均衡化的变换函数,G是高斯滤波核,Ienhanced是图像增强结果。通过这一方法,本研究旨在优化无人机图像的质量,为后续基于MobileNet-V1 的图像识别方法提供更具有鲁棒性的输入。

2.2 图像识别方法

使用MobileNet-V1 进行图像识别的方法涉及图像的前向传播和特征提取过程。设输入图像为Ienhanced,MobileNet-V1 的前向传播过程可以描述为式(5):

式(5)中,Fmnv1是MobileNet-V1 的前向传播函数,Θ 表示网络参数,ϕ是网络输出的特征图。MobileNet-V1 的结构包括深度可分离卷积和逐点卷积,通过这些卷积层逐渐提取图像的抽象特征。

首先,输入图像经过深度可分离卷积层,该卷积操作分为深度卷积(depthwise convolution) 和逐点卷积(pointwise convolution)两个步骤。深度可分离卷积的数学表示为式(6)、式(7):

式(6)、式(7)中,DWConv 表示深度卷积,PWConv 表示逐点卷积,Θdw和Θpw分别是深度卷积和逐点卷积的参数。这两个步骤将输入图像分别进行通道内和通道间的信息提取,生成特征图。接下来,通过多个这样的深度可分离卷积层的堆叠,逐渐提高特征的抽象层次,形成更高级别的特征表示。最终的特征图ϕ可以通过逐点卷积操作输出:

得到特征图后,可以应用全局平均池化(global average pooling)操作将特征图转换为定长的特征向量,如式(9)所示:

式(9)中,GAP 表示全局平均池化操作。这一步骤有助于减少参数数量,降低过拟合的风险。最后,通过连接全连接(fully connected, FC)层和Softmax 层,可以得到图像的类别概率分布如式(10)所示:

式(10)中,FC表示全连接操作,Softmax 表示激活函数,Θfc和Θsoftmax分别是全连接层和Softmax 层的参数。

综合而言,使用MobileNet-V1 进行图像识别的过程经过一系列卷积、池化和全连接操作,将输入图像转换为类别概率分布。通过训练网络参数Θ,可以实现对无人机图像的高效分类。

3 实验与分析

3.1 数据集与环境配置

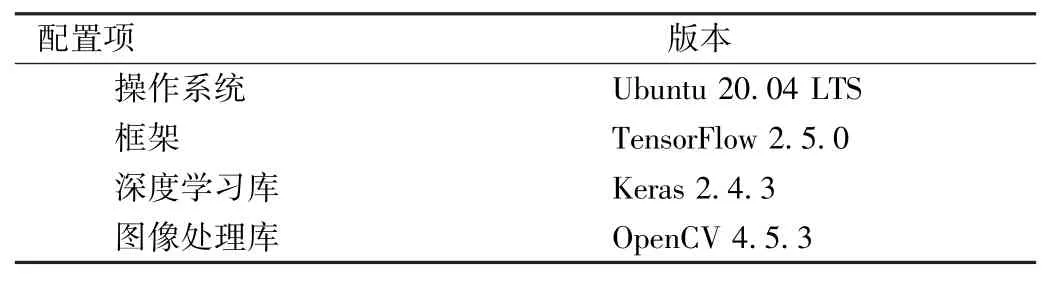

AU-AIR 数据集[11]是一个广泛应用于无人机图像处理和机器学习算法验证的开放数据集。该数据集由澳大利亚国立大学制作,包含了多个场景下的高分辨率无人机图像,涵盖了城市、农田、森林等不同地貌。AU-AIR 数据集的图像标注包括了多个类别,如建筑物、道路、车辆等,使其适用于各种无人机应用领域的研究。另外,本实验的硬件和软件环境配置分别如表1、表2 所示。

表1 硬件环境配置

表2 软件环境配置

3.2 实验方案设计

本实验的实验方案包含以下几个部分:

(1)数据准备。下载AU-AIR 数据集,并将其70%和30%分别划分为训练集和测试集。然后,对训练集进行随机旋转、翻转、缩放等操作,以扩充训练数据。

(2)数据增强。对数据进行直方图均衡和高斯滤波。

(3)网络模型构建。基于TensorFlow 和Keras 构建MobileNet-V1 模型,包括深度可分离卷积和逐点卷积层;添加全局平均池化和全连接层,以生成类别概率分布。

(4)模型训练。使用训练集对MobileNet-V1 进行端到端的训练。

(5)模型评估。使用测试集对训练好的MobileNet-V1进行评估,计算分类准确度等指标。

3.3 结果与分析

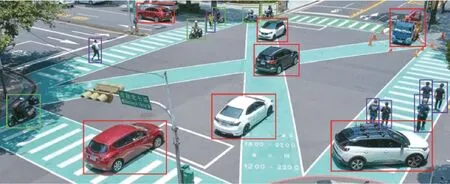

本实验的部分目标识别结果如图2 所示,可以看出所提方法准确地识别出图片中的车辆和行人等目标,其中,汽车被标为红色方框,行人被标为紫色方框,摩托车或电动车被标为绿色方框。

图2 部分目标识别结果

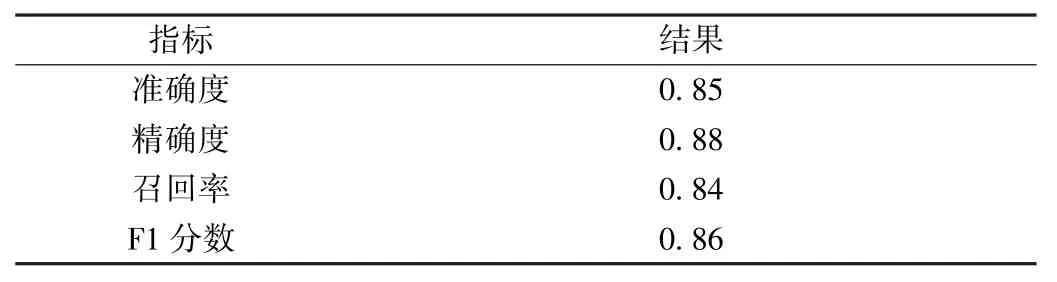

表3 展示了在AU-AIR 数据集上使用所提方法训练的MobileNet-V1 模型的性能指标实验结果。综合而言,所提方法训练的MobileNet-V1 模型在AU-AIR 数据集上表现良好。准确度、精确度、召回率和F1 分数表明模型在无人机图像识别任务中取得了较好的综合性能。然而,具体分析中还需要考虑不同类别的性能,以进一步优化模型的特定识别能力。进一步的实验和分析可以帮助深化对模型性能的理解,并为进一步改进提供有针对性的方向。

表3 实验结果

4 结语

综上所述,本文通过深入研究卷积神经网络在无人机图像识别中的应用[12],提出了一种基于轻量化网络MobileNet-V1 的方法,并在AU-AIR 数据集上进行了实证验证。实验结果表明,所提出的方法在无人机图像识别中表现出色,为轻量级网络在实际应用中的有效性提供了有力支持。通过本研究为无人机图像识别领域的进一步探索和优化提供了新的思路和方法。