作为视频世界模拟器的Sora:通向AGI的重要里程碑

2024-05-03郭全中张金熠

郭全中 张金熠

【摘要】视频生成模型Sora表现出惊艳世界的物理世界理解与模仿能力,以视频世界模拟器的身份成为AGI发展史上的又一里程碑。通过整理Sora的技术突破与技术局限,以Sora为界将AGI发展历程划分为经验积累、能力涌现与全面泛化三个阶段,并对各阶段特征进行概括梳理。基于上述梳理,归纳分析现阶段AGI对传媒业的新机遇与新挑战,包括生产力再升级、职业认知更新与市场结构重塑,并对AGI未来发展趋势进行总结,指出AI模型+智能机器人、元宇宙技术集成初显、AI鸿沟加剧与AI镜像视角拓展人类认知边界等趋势。

【关键词】生成式人工智能;AGI;传媒业;AI鸿沟;镜像视角

自2022年底ChatGPT问世以来,AGI(通用人工智能)领域曙光初现,以多模态大模型为技术路径的生成式AI推动AGI持续量变,如今,视频生成模型Sora以更逼真、更稳定、更持久的视频生成效果惊艳世界,Open AI研发人员更称其为“构建物理世界通用模拟器的一条有前途的途径”。作为通向AGI的里程碑,Sora以视频世界模拟器的身份登场,在训练量足够大的基础上产生涌现能力,其中包括对物理规则的初步理解与模仿,尽管尚有不足,却如孩童般正在快速成长。伴随能力突破,高速发展的AI也在持续加剧人们对职业前景、产业监管、社会伦理、国家安全乃至物种存亡等方面的忧虑。站在AI发展的重要节点,理解Sora及背后的技术逻辑、厘清AGI的发展历程,把握其为行业发展带来的机遇挑战,对各行各业,尤其是受到严重冲击的传媒业来说尤为重要。故本文将重点整理Sora的技术突破与技术局限,以Sora为节点梳理AGI发展历程,并基于此分析现阶段AGI对传媒业的新机遇与新挑战,以及AGI的未来发展趋势。

一、何为Sora:作为视频世界模拟器

2024年2月15日,Open AI在其官网发布了名为《作为世界模拟器的视频生成模型(Video generation models as world simulators)》,是视频生成模型Sora与大众的初次见面。作为一个能够根据文本指令或静态图像生成长达1分钟视频的扩散模型,Sora进入了文生视频领域的技术前沿,但显然尚未达到世界模拟器的预期水平,故暂且称之为“视频世界模拟器”。

(一)Sora的技术突破

与Meta推出的无监督视频预测模型V-JEPA不同,Sora生成视频中对物理世界客观规律的理解与呈现均来自规模效应,是Sora自身根据训练内容获得的。尽管Sora与GPT系列、DALL-E系列的底层思路基本一致,均践行的Scale-Law(规模标度法则),但是前者在数据处理、算法架构与模型性能方面却呈现出极具创新性的技术突破,进入视频领域的生成式AI技术前沿。

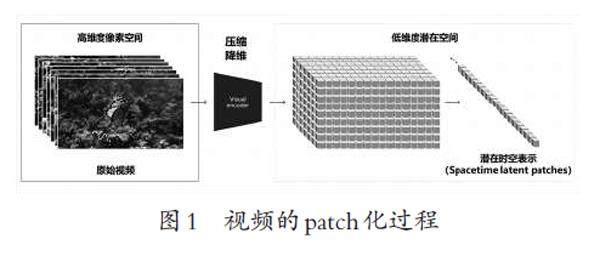

1.提出Patch(补丁)概念并应用

在数据处理方面,相对于文本、代码和图片生成,文生视频模型不仅需要理解语言,还需要理解图像及其背后的时空关联。对此,OpenAI团队从LLM(大语言模型)中汲取灵感,将视频中的视觉数据转化为Patches(补丁,类似LLM的Tokens),从而实现视觉数据的统一表示。这一过程(如图1所示)借助视频压缩网络将原始视频从高维度像素空间压缩至低维潜在空间(Latent space)并输出为潜在时空表示(Spacetime latent patches)实现,可以称为视频的patch化(patchifies)。

Patch的提出与应用为视觉生成模型提供了一种高度可扩展且有效的表示方式,使LLM的成功经验得以继承,并为DiT架构的运行打下基础,从而开辟出视觉大模型的技术实现路径。Open AI还指出,基于patches的表示方法使Sora能够训练不同分辨率、时长和宽高比的视频和图像。

2.采用Diffusion Transformer(DiT)架构

在算法架构方面,Sora所采用的DiT架构创造性融合了Diffusion(扩散模型)和Transformer(转换器模型)的技术架构。前者作为生成模型,包含正向扩散与逆向扩散两个过程,简言之,正向的扩散过程通过添加噪声扰动数据,将图片逐步变为随机噪声,逆向的扩散过程则通过降噪生成新的图片。[1]此前,Diffusion已广泛应用于图像生成、视频生成工具、3D场景生成等技术领域,主要服务于AI绘画、封面制作等业务场景,代表模型有Stable Diffusion。后者作为深度学习模型,采用Encoder-Decoder(编码器-解码器)架构并引入自注意力机制与多头注意力机制[2],具有高效性、可拓展性、可解释性等诸多优势,在NLP(自然语言处理)领域表现尤为出色,GPT系列均采用Transformer的预训练模式并具有较好的涌现能力。自2020年Google Brain提出的Vision Transformer(ViT)技术首次将Transformer应用到NLP领域之外的图像识别场景,Transformer目前也被应用于视觉任务处理,如基于文字生成图片的Transformer模型DALL-E。

DiT架构和patches及其视频压缩网络共同解决了将视频从时空维度压缩至潜在空间并转化为可输入Transformer的潜在时空表示的问题,从而突破了算法模型对视频的时空理解障碍,并通过联级扩散模型与视频潜在扩散模型提升了生成视频的分辨率、可控性以及时间一致性。经验证,伴随着训练计算量的增加,样本质量显著提高。[3]

3.提升文生视频性能

在模型性能上,相比其他文生视频模型,如Pika、Runway Gen-2,Sora的性能升级主要体现在以下三个方面。一是能够生成跨越不同持续时间、宽高比和分辨率的视频和图像,甚至可以生成一分钟的高清视频,从而突破以往文生视频模型只能执行针对特定类型、较短长度或固定分辨率的视频生成局限,并提升了视频生成的可扩展性。二是能够生成动态视角的视频,伴随着视角的移动和旋转,人物及场景元素在三维空间中仍然保持一致的运动状态。这意味着基于大規模训练,Sora获得了模拟物理世界中某些方面的能力,如动态相机运动、长期一致性和对象持久性,在视频中则表现为三维一致性与时间连贯性。三是能够基于文本、图像、视频等多种模态提示完成视频生成任务。语言(即文本指令)理解能力是支撑该性能的关键,Open AI借助高度描述性的标题生成器模型训练以提高视频生成模型的语言理解能力,在执行任务时,用户输入的简短指令经GPT增强描述性后输入Sora中,从而使Sora能够生成高质量且准确遵循用户指令的视频。在此基础上,图像与视频提示则为Sora的内容生成提供了视觉锚点,更有利于生成符合用户意图的视频内容。

(二)Sora的技术局限

目前Sora表现出的技术路径与性能提升令人瞠目,也展现出成为世界模拟器的潜力,但它在基于视频模态理解与呈现物理世界方面仍有局限。例如生成的视频内容中局部自洽但整体荒谬(如南辕北辙跑步机),运动主体间缺乏因果联系(如老奶奶吹气后蜡烛不灭),缺乏物体临界态呈现(如玻璃破碎时液体流出但杯体完好)等。上述局限可能来自patch化过程割裂全局观念,基于概率的模拟器无法精准表达物理定律,以及临界态观察数据难以获取等原因[4],也可能是受到算力需求过大而无法扩大训练规模的影响。

此外,Sora的局限性还体现在技术团队与用户群体之间存在距离,因而作为视频生成工具,Sora能否满足用户需求从而发挥更大价值,还需要Open AI重视与使用群体的对话交流。目前Sora正在向部分提供反馈的内容创作者开放,其中包括视觉艺术家、设计师和电影制作人等。

二、以Sora为界:AGI发展历程

在21世纪的第二个十年,从ChatGPT“牙牙学语”到Sora试图“理解世界”,人工智能通用性显著提升,进入AGI发展快速路。相较于专注NLP的LLM,作为视频世界模拟器的Sora对物理世界的理解与模仿能力虽较为初阶,但一定程度上实现了基于自主学习的AI模型世界模拟能力从0到1的突破,推动AI向AGI再次靠近。以Sora为界,AGI的发展历程可以分为经验积累、能力涌现与全面泛化三个阶段,且目前处于能力涌现阶段。

(一)经验积累阶段:持续深潜的ANI(专用人工智能)

自1950年“图灵测试”的提出到1956年通用问题求解器研发受阻,21世纪之前的AGI实践探索囿于认知水平、技术水平、资金水平等多方不足,一直未取得实质性进展。故21世纪初,人工智能研究者转变思路,开始面向特定领域问题并寻求专用的解决方案,即ANI,并积累了丰富的探索经验。作为评估AI算法智能水平的理想平台,竞技游戏不仅具有明确的规则和目标,还隐含着人类日常生活所涉及的决策判断与任务解决,更提供了与人类表现直接比较的途径,因此不少性能出色的AI模型往往以在竞技游戏中击败人类对手作为彰显其能力的方式。如2017年升级后的AI围棋模型AlphaGo击败当时世界排名第一的围棋选手柯洁,同年AI德扑模型Libratus击败一组世界级德州扑克职业选手,2019年AI模型OpenAI Five在Dota 2国际赛事中以2∶0打败上届世界冠军OG战队,等等。此外,其他领域的ANI发展也持续推进,如用于生产财报类新闻的智能写作平台Wordsmith、能够生成说唱歌词的AI模型DopeLearning、能够个性化分发信息的智能推荐算法、电子设备智能助手Siri/Cortana/小艺,等等。

(二)能力涌现阶段:具有涌现能力与AGI潜力的AI模型

自2022年末ChatGPT问世起,基于大规模数据训练的生成式AI向世人展现出惊人的涌现能力。与以往基于程序设定、智能程度有限的ANI不同,该阶段的AI模型首先通过大规模未标注数据的预训练,再采用微调(fine-tuning)、上下文学习(in-context learning)、零样本(zero-shot)等方式使其广泛应用于下游任务,从而获得初步的自主生成内容能力。值得注意的是,AI模型在内容生成过程中展现出的理解能力,如ChatGPT的自然语言理解和上下文对话能力、Sora的基础物理规则理解能力等,均来自模型训练,属于规模效应带来的能力涌现。此外,2024年1月Open AI推出的GPT Store涵盖DALL·E(生成图像)、写作、学术研究、编程、教育和生活等多种类型的自定义ChatGPT助手,相当于Open AI版的应用商店,体现出ChatGPT作为NLP领域的ANI已经能够胜任多模态、多场景、多样化的下游任务,具备较强的可迁移性,而这正是评估AGI水平的重要指标。

Sora通过统一视觉表示,实现了基于patches的大规模训练,并涌现出对基础物理规则的理解能力,同时借助ChatGPT完成对文本提示的精准解读,以达成用户需求的准确理解与呈现。在这一过程中,Sora并非面向特定行业或领域的ANI,而是力图实现对物理世界普遍理解的通用型视频生成模型。事实上,即便是在对物理世界的二维视觉呈现方面,Sora也远未达成对基础物理规则和交互逻辑的准确理解。然而Scale-Law在GPT系列中的出色表现令人对囿于算力局限的Sora抱有期待,伴随着训练参数规模的不断增大,GPT系列也不断向NLP领域的AGI靠近,Sora的后续发展若能延续GPT系列的成功,也有望向合格的视频世界模拟器乃至物理世界通用模拟器的方向迈进。

而在物理世界中,AGI发展的另一方向——人形机器人也在向更具AGI潜力的方向发展。在2024年2月举行的世界移动通信大会(MWC 2024)上,Engineered Arts公司研发的人形机器人Ameca二代亮相,GPT-4加持使其能够对各种问题做出实时反应,与之匹配的是Ameca灵动的表情、灵活的眼神以及协调的肢体(除双腿),这令人惊讶之余也不由滑向恐怖谷效应的情感谷底。

(三)全面泛化阶段:具有系统认知与整体视野的AGI

当人工智能不再局限于某个特定的任务或领域,具有广泛的认知能力和自我进化能力并在多样化任务和复杂环境中表现出人类级别及以上的智能水平时,可以认为其达到了AGI水平,即AGI发展进入全面泛化阶段。该阶段,AGI是具备感知、理解、学习和推理等基础思维能力且能够进行自我学习、自我提升、创造性思考的机器智能,能够理解包括物理世界和人类社會在内的复杂系统并以整体视野分析问题且做出决策。具体而言,AGI将跳出生成式交互逻辑,基于对复杂系统的整体性认知进行人机互动甚至参与社会运行。受限于数据丰富度、算法架构与算力水平,理想状态下的AGI尚未出现,Sora通过对三维物理世界的视频学习初步获取了创造数字原生世界的能力,标志着AI领域正在向全面泛化阶段的AGI靠近。同时,NLP技术、语音识别技术、视觉识别技术等不同领域的ANI发展迅猛且成效显著,协同推进AGI能力体系建设。在此基础上,软硬件公司积极合作,也将加快以类人形态为表征的AGI面世。

三、现阶段AGI对传媒业的机遇与挑战

当前,AGI作为具有泛化能力的机器智能,与现有行业结合或创造新生行业,对经济社会的影响是全面且深入的。对传媒业而言,AGI既以更高效生产工具的身份为行业赋能,又因深刻影响行业操作系统与基础设施而对行业认知与运行逻辑带来极大挑战。

(一)生产力再升级:AGI成为新的生產工具

尽管目前AGI尚不成熟,但以GPT、Sora为代表的在特定领域具备泛化任务处理能力的类AGI正在成为新的生产工具,从而提升行业生产力。在生产力升级过程中,AI技术会对行业现行逻辑与业务惯习产生冲击,体现为对生产效率的影响两极化。一方面,能够快速掌握AI技术的专业人员能够在AI赋能下实现生产效率的快速提升,例如语音识别、智能翻译、智能生成图文视频、虚拟数字人等AI技术在专业人员的运用下有效提升访谈对话、稿件撰写、封面制作、游戏美术设计、新闻播报等工作的效率。另一方面,大部分传媒从业者对新技术的接受、学习与熟练使用需要一定的时间与动力,在这一过程中,往往需要从业者打破旧的业务惯习,结合AI技术进行业务流程再造,过渡阶段可能会带来短期的效率下降。

当前,包括Sora在内的大部分自称为AGI的AI模型泛化能力尚不稳定,作为新型生产工具,其在有效性与可控性方面还有待提升,与熟练从业者相比,前者现阶段的实际生产效率未必更佳。以Sora为例,其视频生成性能远高于此前的同类模型,然而其生成的内容时常出现基础逻辑错误,如带有鹦鹉尾巴的猴子与互相穿过身体的狗狗,这都是高度成熟的影视行业不能容许也不会出现的低级问题。但长期来看,从业者对AGI工具的运用将逐渐熟练,且AGI能力也将趋于稳定可控,AGI将成为传媒业不可或缺的重要生产工具,在行业各个环节发挥重要作用。对此,传媒从业者需要积极拥抱AI技术,学习并掌握运用AI的能力,如有效的prompt组合能力与模型微调能力等,从而在AGI真正到来时继续保持人在生产活动中的主导性地位并运用AGI工具更高效地开展工作。

(二)职业认知更新:立足反身性进行传媒职业认知的双重更新

当前,以人工智能技术为核心的智能传播正在深刻影响信息传播的传播模式、生产规律、组织运营乃至职业伦理。以信息传播活动为业务核心的传媒业在这一过程中受到全方位、深层次的影响,并在实践中更新传媒从业者的职业认知。一是AGI对信息传播模式的影响。互联网时代搜索引擎曾改变人类接收信息的主要方式,而基于NLP技术和强大上下文理解能力的LLM若能在AIGC信息质量、交互性方面有所提升,将促进用户转向使用LLM进行信息搜寻的意愿[5],这无形中改变了用户的信息搜寻习惯。同时,AGI通过信息推荐算法等技术已经改变了传媒消费群体的信息接收习惯,并影响了不同价值观的传递效果[6]。二是AGI对传媒业务流程的重塑。以新闻业为例,AGI的融入有效提升了新闻检索、内容生产、产品分发、用户反馈收集等新闻业务的效率,并通过模型微调打造专用智能工具,助力新闻生产业务全流程的智能化转型。Sora的出现更是打破传统影视创作逻辑,压缩从文本创意到视频呈现的业务距离,对现有业务流程带来巨大影响。三是AGI对传媒组织结构及运作管理的影响。伴随着AGI对生产业务的效率升级和流程冲击,传媒业的组织架构或将基于AGI进行再次重组,而这意味着传媒业急需结合AGI创新组织运行与管理的战略思路与方式方法,从而实现制度层面与实践层面的动态一致,协同推进传媒管理智能升级。四是AGI对传媒职业伦理提出新要求。在AGI为传媒业提供新型生产工具并深度影响传媒业务的过程中,新闻真实、信息把关、人文关怀等基本职业伦理也需要在新环境下进行再解读与再界定。而传媒从业者需要在对AGI保持审慎态度的同时培养“通用人工智能素养”,即个体对通用人工智能的认识、理解、使用、质疑和评估的能力。[7]

在传媒业AI震荡期,人类信息传播活动在AI影响下具备了新的时代特征,从业者受到AI的强势冲击并呈现出适应态势。在基于事实的认知更新基础上,传媒从业者也经由反身性方式不断更新对自我职业认同与职业认知。作为一种更全面的反思,传媒从业者的反身性既包括积极运用AI工具进行新型内容生产以获得对传媒业务的再认识和对职业价值、职业责任的再锚定,又包括在传媒实践中与主体性逐渐增强的AGI互动,建立与新型工具或者说职业助手的关系认知。

(三)市场结构重塑:AI辅助的新型生产群体崛起

AGI对传媒业的根本性挑战是技术平权[8]。AGI的前沿推进不断降低内容生产的技术门槛,在高性能LLM问世后,NLP赋能用户使用自然语言即可实现文本、图像、音频、视频、3D等多模态内容的创意落地。在视频化生存时代,视频生成模型Sora实现文生视频的性能突破,尽管尚未面向公众开放,但对非专业用户视频生产力的提升将极其显著。目前,没接受过绘画训练的用户都能够借助Midjourney、DALL-E、Stable Diffusion等文生图AI模型进行AIGC(人工智能生产内容)创作,而社交平台小红书、抖音等已经出现不少借助多样化生成式AI进行账号运营的内容生产者。可以想象,在文生视频AI模型公测后,对视频模态的内容创作领域,尤其是中低端影视行业将会带来怎样的冲击。

正如UGC(用户生成内容)作为互联网技术赋权的突出体现曾被认为是变革传统媒体的重要力量[9],其生产主体发展成一类全职从事内容生产工作的就业群体并崛起为传媒市场的重要组成,同一数字化转型浪潮下快递员、外卖员、网约车司机、直播销售员等多种基于互联网技术的数字劳动群体也在持续涌现并形成数字经济产业,伴随着AGI的前沿推进与应用落地,包括传媒行业在内的各行各业也势将迎来基于AGI的新型生产群体的涌现,并重塑市场结构。对此,传媒业需要汲取互联网时代的经验教训,在积极拥抱技术创新的同时,加强对AI技术环境下传媒伦理与规范的持续性思考,形成“发展-治理”螺旋式上升的市场氛围。

四、AGI的未来发展趋势

作为视频世界模拟器的AI模型Sora,与GPT系列相比,学习能力和迁移能力并不理想,但360集团创始人周鸿祎认为,Sora展现的不仅仅是视频制作的能力,而是大模型对真实世界有了理解和模拟之后,会带来新的成果和突破。站在AI模型开始通过自主学习理解和模仿物理世界的节点,AGI的未来发展呈现出多元趋势。

(一)AI模型+智能机器人将成为下一阶段AGI的发展亮点

一般来说,实现AGI包括两条重要路径,即AI模型与智能机器人,目前相关研究都已经取得令人惊叹的成果。AI模型方面,Open AI连续推出GPT系列、DALL-E、Sora等多模态、跨模态生成式AI模型,不断证明Scale-Law提升AI性能的有效性。与此同时,奉行非生成式路线的AI模型也有所推进,自2022年图灵奖得主杨立昆(Yann LeCun)提出可以学习世界模型和常识等重要知识的自我监督模型“联合预测嵌入架构”(JEPA),JEPA系列也已涵盖文本、图像与视频模态。尽管技术路径不同,但AI模型的通用性能从NLP领域向图像、视频拓展,并试图理解三维物理世界并模仿,意味着AI模型正在不断向具有广泛迁移能力的AGI靠近。智能机器人方面,2024年初斯坦福三人团队发布成功克隆人类行为和任务能力的移动机器人Mobile ALOHA,其成本仅为3万美元且单个任务仅需提供50次示教便可将成功率提高至90%。[10]Mobile ALOHA展示出有效利用已有数据集进行高效迁移学习以提高机器人在复杂环境中操作能力的方式,且具有制作低成本、学习效率高、迁移能力强的特点。人形机器人Ameca二代则在模仿人类面部神情与上肢动作方面表现出色,尤其在整体调动面部要素传递神态情绪上仿真性极强。而在上述机器人都未涉及的行走能力建设方面,小鹏公司于2023年10月发布的人形机器人PX5不仅能够适应多种复杂地形,还能同时应对前后左右的冲击且具有较好的平衡能力,在行走方式上采用“直腿”、大跨步的方式,使其步态更接近人类且更节能。

基于上述技术积累,AGI的下一阶段将是把灵魂注入身体,即AI模型与智能机器人的组合,从而推进人工智能领域朝最初的梦想——像人一样的智慧机器迈进。在GPT-4加持下的人形机器人Ameca二代已经证明这一趋势的可行性,目前,专注于人形机器人研发的Figure AI公司也表示,将与Open AI合作开发下一代人形机器人AI模型。可见,AGI的下半场将是具有高级智能的人形机器人之间的较量。

(二)Sora助力元宇宙突破引爆点,元宇宙技术集成体雏形初现

Sora表现出对物理世界的理解与模仿能力令人看到打造世界模型的可行性,其文生视频能力极大降低了3D场景、人物、动作的创作成本,为元宇宙提供海量的高质量内容,有望助力元宇宙建设突破引爆点。

元宇宙不是某一项或是某几项技术简单相加[11],而需要包括区块链技术、交互技术、电子游戏技术、人工智能技术、智能网络技术和物联网技术在内的六大支柱技术和更多相关技术支撑实现,目前元宇宙的各项短板基本补齐。在脑机接口技术领域,国内外皆有植入芯片(即脑机接口)后的人类可以通过意念控制光标移动的成功案例,包括马斯克的Neuralink公司和清华大学科研团队;在空间计算技术领域,苹果公司发布空间计算设备Apple Vision Pro,称“将数字内容无缝融入真实世界,让用户处在当下并与他人保持连接”;在人工智能技术领域,Sora实现视觉数据的统一表示并推进AI模型的物理世界理解能力,英伟达公司推出面向个人终端、支持本地运行的AI模型Chat With RTX,AI模型正在拓宽其覆盖范围,向世界模拟与私人模型迈进;在智能网络技术领域,华为发布全系列、全场景的5.5G产品解决方案和通信大模型。以2024年为节点,元宇宙支柱技术发展均有所突破,以“世界模型+token/patch+空间计算+脑机接口”为雏形的元宇宙技术集成体正在聚成。

从落地场景来看,元宇宙将依次经历云游戏、数字孪生和虚实共生三个阶段[12],数字孪生阶段的核心技术本质上服务于元宇宙的场景搭建和虚拟主体维护。而AGI技术不仅能为元宇宙提供现实世界的数字孪生,还能基于AI模型为元宇宙中的虚拟主体注入“智慧新生”,即基于人工智能生成的智慧主體,从而突破现实世界的孪生局限,引爆元宇宙世界的智慧生态。此外,作为元宇宙的关键底层技术,AGI将在场景搭建、形象生成、私人助理、虚拟交互等元宇宙落地与运行中发挥持续影响,并以通用智能属性为其他技术领域提供智慧决策。

(三)“AI鸿沟”正在显化并呈加剧趋势

伴随技术性能持续升级与应用落地,Al已成为新基础设施,而伴随着AI与人类生活的紧密联系,技术带来的社会不平等终将显化并持续加剧,这种由于AI技术差异造成的社会差异,可称之为“AI鸿沟”。“AI鸿沟”的概念引申自“数字鸿沟”,后者一般分为接入沟、使用沟和知识沟三道,故基于上述三个维度对AI鸿沟展开阐述。

首先,AI鸿沟的接入沟体现在国家、社会、个人三个层面:在国家层面,鼓励创新和冒险的Al基础好的国家和其他国家之间将出现巨大的鸿沟;在社会层面,各个国家内部的AI资源富有者与AI资源贫穷者之间也将出现差异;在个人层面,体现为人们能否获取AI技术应用以便开展生产生活方面的差异。其次,AI鸿沟的使用沟关注获取AI技术应用后的使用差异,由于使用时长、使用目的以及技能掌握程度的不同,人们对AI技术的使用方式与使用效率存在差异,即AI技术的多用性带来技术使用的差异性。再次,AI鸿沟的知识沟意在回应技术接入和使用上的差异会带来怎样的社会后果这一问题,韦路和张明新指出其对知识获取的影响并强调信息和知识与社会和政治力量间的转化关系[13],而在AI鸿沟中,知识沟的形成更为明显,因为AI技术直接影响个人对信息和知识的获取程度,并基于技术效率快速拉大接入AI技术应用并熟练使用群体与其他群体在知识获取效率与知识积累程度方面的差距,从而加剧AI鸿沟并阻碍其弥合。

(四)AI为人类认知提供镜像视角,加速知识边界拓展

AI是指具备与人类智能相似能力的机器智能,生成式AI模型出现之前,AI始终依据事先指定的模板或者规则完成相应任务,而生成式AI模型基于对人类行为的数据化学习开始具备自主生成能力,尽管较为初级,但拓宽了人类社会的信息生产方式,同时也带来更强的学习迁移能力。可以说,生成式AI模型将映照人类以及现实世界的镜子从黄铜镜升级为水银镜,人类也终于能够从AI中看到自己的“影子”。

伴随着AGI技术的前沿推进,人类将获得审视自己与认识世界的全新视角,即镜像视角。从宏观层面看,Sora等大模型的能力涌现来自对可量化信息的学习与理解,其高度复杂的算法逻辑在靠近人类思维模式的同时可能生成不同于人类认知逻辑的社会知识,从而反作用于人对世界的认知,以模拟世界与现实世界的对照关系,印证或推翻部分现有认知,增加人类社会的认知维度,从而拓展人类知识边界。从微观层面看,个人的认知水平是有限的,而借助AGI工具,能够压缩个体获取知识的各项成本,有助于个人知识边界的拓宽;同时,个人与AI的互动,某种程度上也反映出潜意识或无意识中的自我欲望,而自我欲望的显化有助于个体丰富与完善自我认知,从而成长为更健全的个体。此外,个体认知的拓展将在集体中积聚,与宏观层面的认知更新一起,助推全人类知识体系从量变到质变的飞跃。

参考文献:

[1]Yang L,Zhang Z L,Song Y,et al.Diffusion models:a comprehensive survey of methods and applications[J].ACM Computing Surveys,2023,56(4):1-39.

[2]刘文婷,卢新明.基于计算机视觉的Transformer研究进展[J].计算机工程与应用,2022,58(6):1-16.

[3]Brooks T,Peebles B,Homes C,et al.Video generation models as world simulators[J/OL].(2024-02-15)[2024-03-03]. https://openai.com/research/video-generation-models-as-world-simulators.

[4]顾险峰.Sora物理悖谬的几何解释[EB/OL].(2024-02-21)[2024-03-03].https://mp.weixin.qq.com/s/HSZMbiFuNvTmBv26csZFGg.

[5]周涛,李松洮,邓胜利.用户信息搜寻转移意向研究:从搜索引擎到生成式AI[J].图书情报工作,2024,68(3):49-58.

[6]张守信,张洋.信息推荐算法对青年主流价值认同的影响及治理策略[J].中国编辑,2024(2):1-7.

[7]陈昌凤,袁雨晴.智能新闻业:生成式人工智能成为基础设施[J].内蒙古社会科学,2024,45(1):40-48.

[8]郭全中,袁柏林.从GPT看AGI的本质突破:传媒业新挑战与未来[J].新闻爱好者,2023(4):30-35.

[9]胡泳,张月朦.互联网内容走向何方?——从UGC、PGC到業余的专业化[J].新闻记者,2016(8):21-25.

[10]Zipeng Fu,Tony Z.Zhao,Chelsea Finn. Mobile ALOHA:Learning Bimanual Mobile Manipulation with Low-Cost Whole-Body Teleoperation[J/OL].(2024-01-04)[2024-03-03].https://mobile-aloha.github.io/resources/mobile-aloha.pdf.

[11]喻国明,耿晓梦.元宇宙:媒介化社会的未来生态图景[J].新疆师范大学学报(哲学社会科学版),2022,43(3):110-118+2.

[12]郭全中.元宇宙的缘起、现状与未来[J].新闻爱好者,2022(1):26-31.

[13]韦路,张明新.第三道数字鸿沟:互联网上的知识沟[J].新闻与传播研究,2006(4):43-53+95.

作者简介:郭全中,中央民族大学新闻与传播学院教授,互联网平台企业发展与治理研究中心主任(北京 100081),江苏紫金传媒智库高级研究员(南京 211199);张金熠,中央民族大学新闻与传播学院硕士生(北京 100081)。

编校:董方晓