基于互信息最大化和聚类感知的节点表示学习

2024-03-02汤乾,武浩

汤 乾,武 浩

(云南大学 信息学院,云南 昆明 650500)

网络作为一种图结构数据,通常被用于反映现实世界中实体间的关系,例如引文网络、蛋白质交互网络和社交网络等.与之相关的研究内容包括图分类[1],节点分类[2],节点聚类[3],社区发现[4],异常检查[5]和边预测[6]等.

节点表示学习是分析网络的基础方法,旨在将网络上的节点映射到一个低维、紧凑、连续的潜在空间,并尽可能保留网络有效信息[7].由于图神经网络在融合网络结构和节点特征信息方面的突出能力[8],出现了基于图自编码器的节点表示学习方法.例如图自编码器(graph autoencoder,GAE)和变分图自编码器(variational autoencoder,VGAE)[9]使用图卷积网络(graph convolutional network,GCN)编码网络结构和节点特征到低维向量空间,并通过重建网络结构的方式学习节点表示.对抗式图自编码器(adversarially regularized graph autoencoder,ARGAE)和对抗式变分图自编码器(adversarially regularized variational graph autoencoder,ARVGE)[10]使用对抗学习机制学习健壮的节点表示.然而,网络上庞大的节点数量和冗长的节点信息,导致重建每个节点的邻居信息和特征信息的代价是高昂的.

近年来,基于互信息最大化原理[11]的图对比学习方法受到越来越多的关注,该类方法可以学习区分性节点表示.例如GCA[12]对原始图增强获得两个不同的增强视图,并投影到低维向量空间最大化两个节点表示的一致性;DGI[13]最大化节点表示与全局图表示间的互信息;GIC[14]在低维表示空间中引入聚类算法获得聚类表示,最大化节点表示与聚类表示间的互信息.尽管这些方法在图分析任务中取得了很好的效果,但是它们未能同时挖掘输入空间的多视图信息与潜在空间的聚类相关的语义信息进行节点表示学习.为此,本文提出一种基于互信息最大化和聚类感知的节点表示学习模型用于学习高质量的节点表示.

本文的主要贡献如下:

(1) 提出一种基于互信息最大化和聚类感知的节点表示学习模型(MCNRL);

(2) 对原始图使用图扩散方法构造扩散图,基于互信息最大化原理,通过对比原始图的节点表示和扩散图的全局图表示,反之亦然,最大化两个图间的互信息;

(3) 将语义相似的节点聚类到同一个簇,并最大化原始图的节点表示和扩散图的节点表示间的聚类一致性.

1 相关工作

1.1 基于图自编码器的节点表示学习图神经网络(graph neural network,GNN)已经成为近年来应用于图结构数据的一种流行模型,其能够有效地融合网络结构和节点属性.一些研究致力于将图神经网络与深度学习相结合,以实现节点表示学习.例如,图自编码器GAE[9]将图卷积神经网络GCN 和自编码器结合,通过GCN 聚合邻居特征以获得每个节点的特征表示.然后,通过计算节点表示向量的内积重建网络的邻接矩阵,并通过减小重建邻接矩阵与原始邻接矩阵间的误差优化节点表示.VGAE 假设节点表示服从高斯分布并利用KL 散度将表示拟合高斯分布.ARGE 和ARVGE[10]通过分别向GAE 和VGAE 添加对抗性约束学习稳健的节点表示.DGAE[15]首先使用GCN 作为编码器编码邻接矩阵和特征矩阵到潜在空间获得节点表示,最后使用GCN 作为解码器重建邻接矩阵和特征矩阵,通过最小化重建误差学习节点表示.

1.2 基于互信息最大化原理的图对比学习基于互信息最大化原理[11]的图对比学习方法,通常先对一个锚样本构造正样本对和负样本对,然后最大化正样本对的一致性,最小化负样本对的一致性,从而学习判别性节点表示或图表示.根据表示的不同对比层次,可以分为节点与节点间的对比,节点与全局间的对比,节点与聚类原型间的对比.对于节点与节点间的对比方法,GCA[12]使用边扰动方法和特征随机掩码方法对原始的网络结构和节点特征进行增强,获得两个不同的增强视图,并投影到低维向量空间进行对比表示学习;GMI[16]最大化输入图和编码器输出间关于边和节点特征间的互信息学习节点表示;对于节点与全局间的对比方法,DGI[13]将节点表示池化为全局图表示,通过最大化局部的节点表示和全局的图表示间的互信息获得节点表示.对于节点与聚类原型间的对比方法,GIC[14]在DGI 的基础上引入一个节点与聚类对比正则化项,它最大化同一个簇的节点间的互信息,期望模型可以同时学习粗粒度和细粒度的节点表示.

2 模型描述

2.1 基本符号给定一个无向图G={V,E,X},其中V={v1,v2,···,vN} 是节点集,E={e1,e2,···,eN}是边集,X∈RN×d是节点特征矩阵.G的网络结构用邻接矩阵A∈RN×N表示,其中Ai,j=1,满足 (vi,vj)∈E;否则Ai,j=0.此外,本文的无向图也可以表示为G={X,A}.

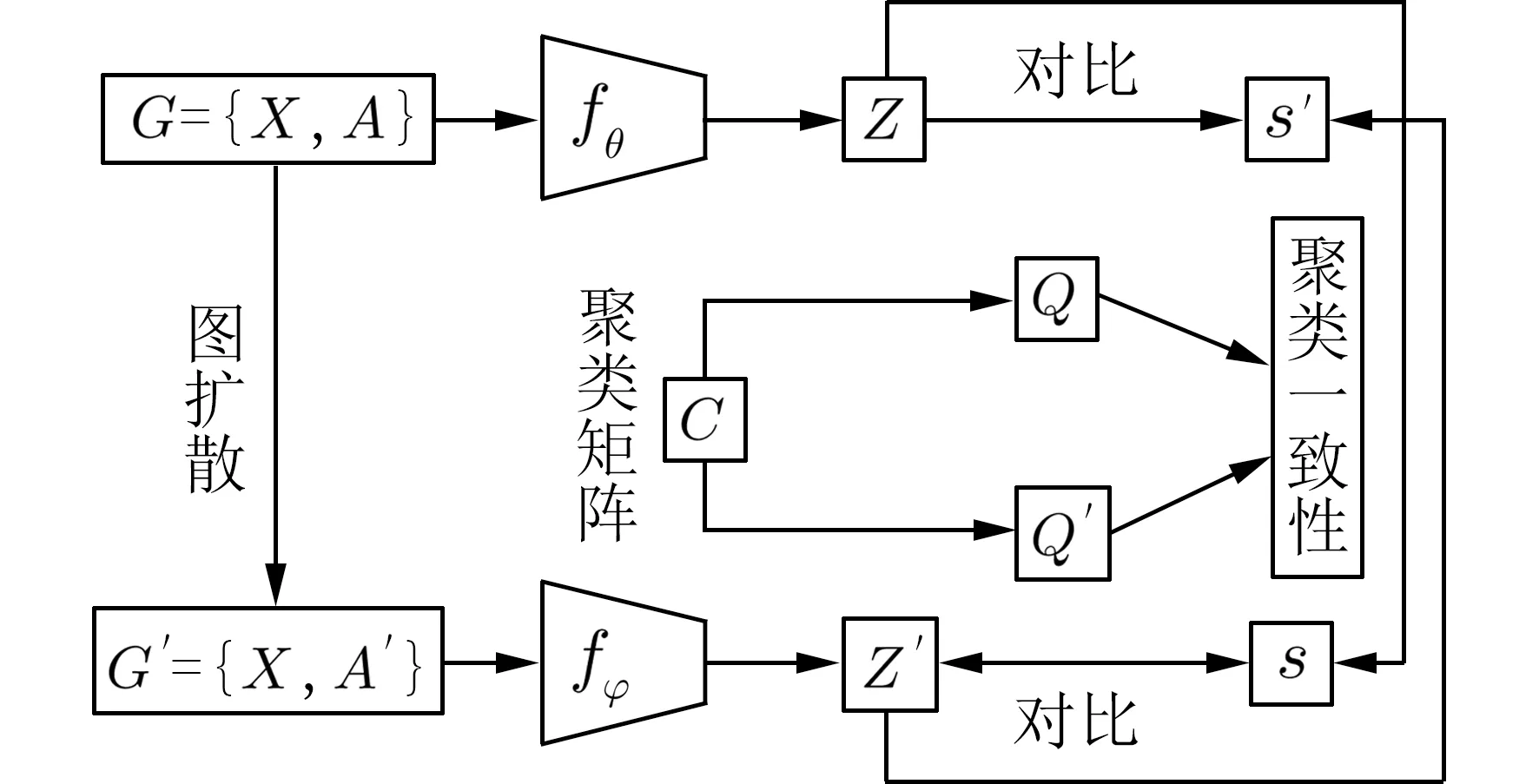

2.2 模型框架本文提出的MCNRL 模型结构如图1 所示.首先,对原始图G={X,A}的网络结构A使用图扩散方法得到扩散图G′={X,A′}.然后,两个图被喂入到不共享权重的图卷积网络fθ和fφ提取节点表示Z和Z′,并经过平均池化获得全局图表示s和s′.接着,基于互信息最大化原理,通过最大化节点表示Z和全局图表示s′,节点表示Z′和全局图表示s间的一致性最大化两个图间的互信息,使节点表示Z和Z′同时学习局部和全局邻居信息.同时,在潜在向量空间中预先构造一个可学习的聚类矩阵C,节点表示Z和Z′经 过C得到聚类分配表示Q和Q′,最大化聚类分配表示间的一致性可以挖掘节点表示间潜在的语义信息.

图1 MCNRL 模型结构Fig.1 The structure of MCNRL model

2.3 扩散图图扩散方法已经被广泛用于图节点表示学习提供更大范围的邻居信息[17].为此,对原始图G的邻接矩阵A使用基于个性化PageRank 的图扩散方法,具体如下:

式中:D∈RN×N为度矩阵,其对角线上的每个元素为A的每一行之和;α为传送概率,通常设置为0.2.然后得到扩散图G′={X,A′}.

2.4 图编码器本文使用图卷积网络作为基本编码器融合图结构和节点特征信息.对原始图的邻接矩阵A使用重归一化技巧得到一个对称归一化邻接矩阵其中的度矩阵.设计两个不共享参数的单层图卷积网络分别为:

2.5 基于互信息最大化原理的节点与全局对比优化目标基于互信息最大化原理的表示学习[11]旨在学习一个特征提取器f,使得输入样本,例如G,和该输入的表示Z=f(G)间的互信息最大化,表示为maxI(G,Z).

基于互信息最大化原理的图对比学习[12]旨在最大化图G的节点表示Z和该图经过扰动后的图G′的节点表示Z′间的一致性,从而学习扰动不变性特征,表示为 maxI(Z,Z′).

类似地,为了同时学习一阶邻居信息和高阶邻居信息,本文基于互信息最大化原理,最大化节点表示Z和全局图表示s′,节点表示Z′和 全局图表示s间的一致性,表示为:

本文从多视图信息瓶颈角度出发[18],给出如下关系:

式中的s和s′可以被聚类表示i∈[1,k]替换,进一步有:

式(5)和(6)为实现节点与节点层次,节点与聚类原型层次,节点与全局层次的表示间的对比学习提供了理论依据.

式(4)作为本节的优化目标,使用Jensen-Shannon估计器估计互信息,于是优化损失定义为:

式中D(·,·)用于评估节点表示和全局图表示间的一致性,使用双线性评分函数估计:

2.6 聚类一致性优化目标本文引入一个可学习的聚类矩阵它由k个聚类质心向量ci∈组 成.对于原始图G,计算任一节点表示zi和k个质心向量间的相似度,如下:

然而,直接优化式(11)可能导致平凡解,使所有的样本划分到同一个簇.

为解决这个问题,目标是让N个样本节点可以均匀地划分到k个聚类质心.假设有Q=[q1,···,是聚类分配矩阵,为实现前面提的目标可以按式(12)优化Q.

式中:tr()为矩阵的迹,表示矩阵的主对角线之和;H为熵函数是N维全一向量,1k是k维全一向量.优化式(12)的作用:Q要相似于CTZT并替代它,同时CTZT要相似于Q∈T,并且当Q中的每个元素服从均匀分布且都为时,此时H(Q)最大.ε是一个参数,在CTZT由Q表示时调节Q的聚类分配的均匀程度,本文设置ε=0.05.Q与CTZT彼此约束可以保证聚类矩阵C中的每个聚类质心向量ci至少被N个样本节点选中次,从而达到N个样本被均匀划分到k个聚类质心的目的.式(12)可以看作一个最优传输问题,它的解Q可以写成归一化指数矩阵[19]:

式中:u∈Rk×1和v∈RN×1为重归一化向量,可以使用Sinkhorn-Knopp 算法计算u和v.

同理可以按式(12)计算扩散图的Q′.最后按列归一化Q和Q′,式(11)可重写为:

此外,为确保聚类质心向量尽量彼此远离,引入分离损失:

本研究结果表明,广州市湖泊、河涌、航道以及入海口4类地表水体溶解相中HHCB、AHTN和MK的浓度比颗粒相高。冯柳(2011)通过研究也得出相似的结论,主要原因是合成麝香微溶于水,且本研究水体中合成麝香浓度较低。此外,无论是溶解相还是颗粒相,HHCB的浓度均远高于AHTN和MK。这与国内外的许多研究结果是一致的(Peck et al.,2004;Stevens et al.,2003;陈多宏等,2009),因为香水、面霜、肥皂和沐浴露等日用化工品中的主要合成麝香均为HHCB(Reiner et al.,2006;王征,2012)。

2.7 总体优化目标最终MCNRL 模型的总体优化目标如下所示:

式中 λ1和 λ2是权衡系数.模型优化后,将学习到的节点表示Z和Z′相加用于下游图分析任务.

3 实验结果与分析

3.1 实验数据集提出的模型在两个广泛使用的引文网络Cora 和Citeseer 进行实验.网络上的节点代表论文,边对应于引用关系,节点特征是二进制词向量.数据集的统计信息见表1.

表1 实验数据集统计Tab.1 Statistics of experimental dataset

3.2 评估指标对于节点分类任务,使用准确率(accuracy,AAC)作为评估指标,它是指模型预测正确的标签数量和所有标签数量的比值,计算方法如下:

式中:TP、FP、TN和FN分别表示真正样本数,假正样本数,真负样本数和假负样本数.考虑到数据集中存在样本不均衡现象,为此使用F1 值作为评估指标,它是精确率(precision,P)和召回率(recall,R)的加权调和平均,其定义如下:

式中:P表示预测为正的样本中实际为正的样本的比例,R则表示实际为正的样本中被预测为正的样本的比例.P和R分别定义如下:

对于节点聚类任务,采用聚类准确率(clustering accuracy,ACA),归一化互信息(normalized mutual information,INM)和调整后的兰德指数(adjusted rand index,IAR) 评估聚类结果.假设C={c1,c2,···,ck}且P={p1,p2,···,}分别代表聚类结果和包含N个数据的数据集的预定义的类别.这里k和k′分 别是簇C和类别P数;Ni,j是簇C和类P的公共目标数;是簇ci中数据点数;是类pi中数据点数.

ACA表示聚类结果中正确分类的数据点与预定义类标签的百分比,计算公式如下:

INM可以有效地测量随机变量共享的统计信息量,这些变量代表集群分配和对象的预定义标签分配,计算公式如下:

3.3 对比方法对于节点分类任务,本文使用DGI、GMI、GIC、GCA 等基线模型对比实验结果.

DGI[13]:专注于单视图,通过对比节点表示和全局图表示学习同时学习节点表示和图表示.

GMI[16]:核心在于直接最大化图神经编码器的输入和输出间在节点特征和拓扑结构方面的互信息.

GIC[14]:学习节点表示时,不仅考虑到了节点表示和全局表示间的互信息,还引入可微分Kmeans 聚类算法最大化同一个簇的节点间的互信息.

GCA[12]:通过对同一个输入视图进行增强得到两个视图,并最大化一个视图的节点表示与另一个视图的节点表示间的互信息学习具有扰动不变性特征的节点表示.

对于节点聚类任务,使用GAE、VGAE、ARGAE、ARVGAE 基线模型.

GAE、VGAE[9]:使用图卷积网络作为编码输入的图拓扑结构和节点特征,并重建图的拓扑结构来学习节点表示.VGAE 在GAE 的基础上,要求学习到的表示匹配一个先验高斯分布,使得学习到的节点表示的分量具有一定概率分布特点.

ARGA、ARVGA[10]:在GAE 和VGAE 的基础上引入了对抗学习机制,期望学习到的表示具有一定的鲁棒性.

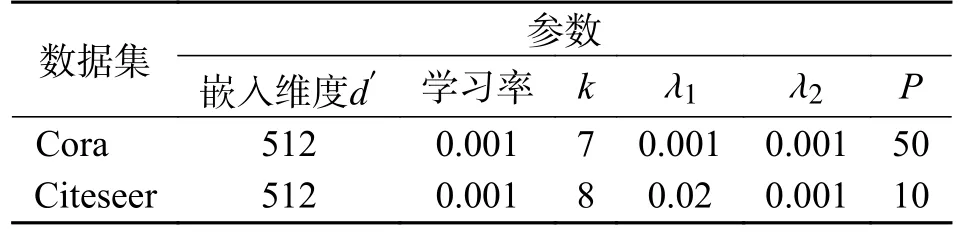

3.4 参数设置实验中会影响到MCNRL 模型性能的超参数有嵌入维度d′,学习率,聚类矩阵C的聚类质心数目k,权衡系数 λ1和 λ2.模型使用Adam优化,并引入早停技术停止训练,早停参数为P.MCNRL 模型的超参数设置见表2.

表2 MCNRL 模型的超参数设置Tab.2 Hyperparameters settings of MCNRL model

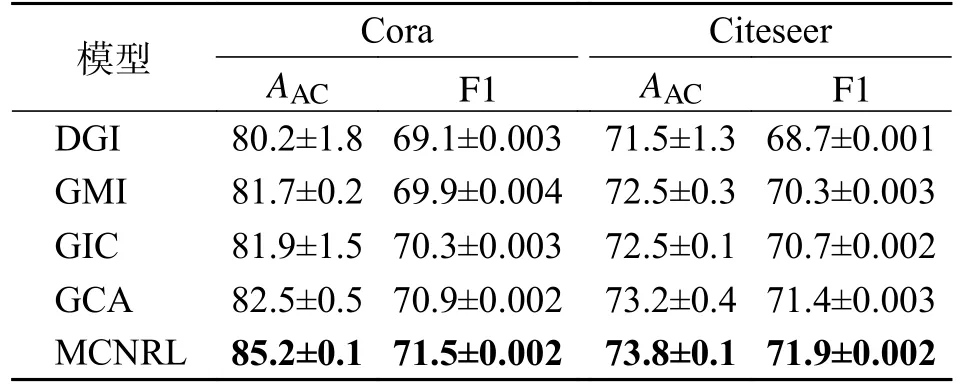

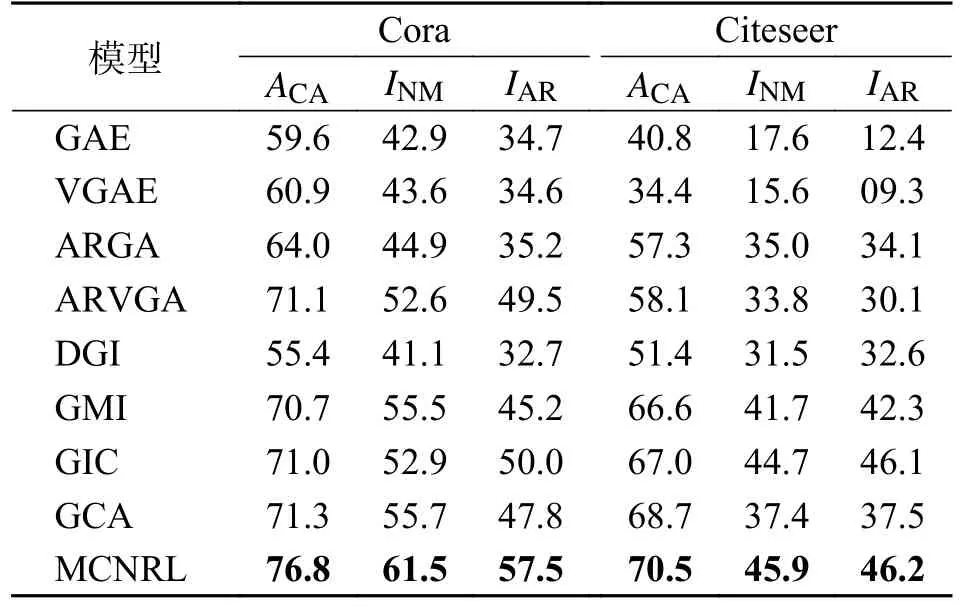

3.5 结果对比所有方法在Cora 和Citeseer 上进行节点分类和节点聚类,实验结果见表3、4,最佳值表示为粗体.

表3 所有方法在Cora 和Citeseer 上的节点分类结果Tab.3 Node classification results of all methods on Cora and Citeseer %

对于节点分类实验,分析表3 中数据可以看出,GIC 和GMI 在所有数据集上的所有评估指标均优于DGI,这是因为DGI 只考虑了节点表示和全局表示间的互信息最大化,而GMI 同时考虑了拓扑结构和节点特征相关的互信息最大化;GIC 同时考虑了节点表示和全局表示以及同一个簇的节点表示间互信息最大化.GCA 作为多视图节点与节点级别的对比学习方法,是最强的基线方法,这说明多个视图可以提供更加丰富的对比信息.本文所提出的模型MCNRL 是多视图对比节点与全局的对比学习方法,而且使用聚类方法,挖掘了潜在空间中的节点表示间的语义信息,所以MCNRL 实现了最好的性能.具体而言,对比GCA,本方法在Cora数据集上准确率和F1 值指标分别提高了2.7 和0.6 个百分点;在Citeseer 数据集上准确率和F1 值指标分别提高了0.6 和0.5 个百分点.

对于节点聚类实验,分析表4 中数据可以看到,对比所有基线方法,MCNRL 仍然实现了最好的性能,这可以归因于聚类过程依赖于全局信息,而本文模型使用了对比学习方法最大化节点表示和全局表示间的一致性.此外,还鼓励两个视图间的聚类一致性,这有利于聚类过程.

表4 所有方法在Cora 和Citeseer 上的节点聚类结果Tab.4 Node clustering results of all methods on Cora and Citeseer %

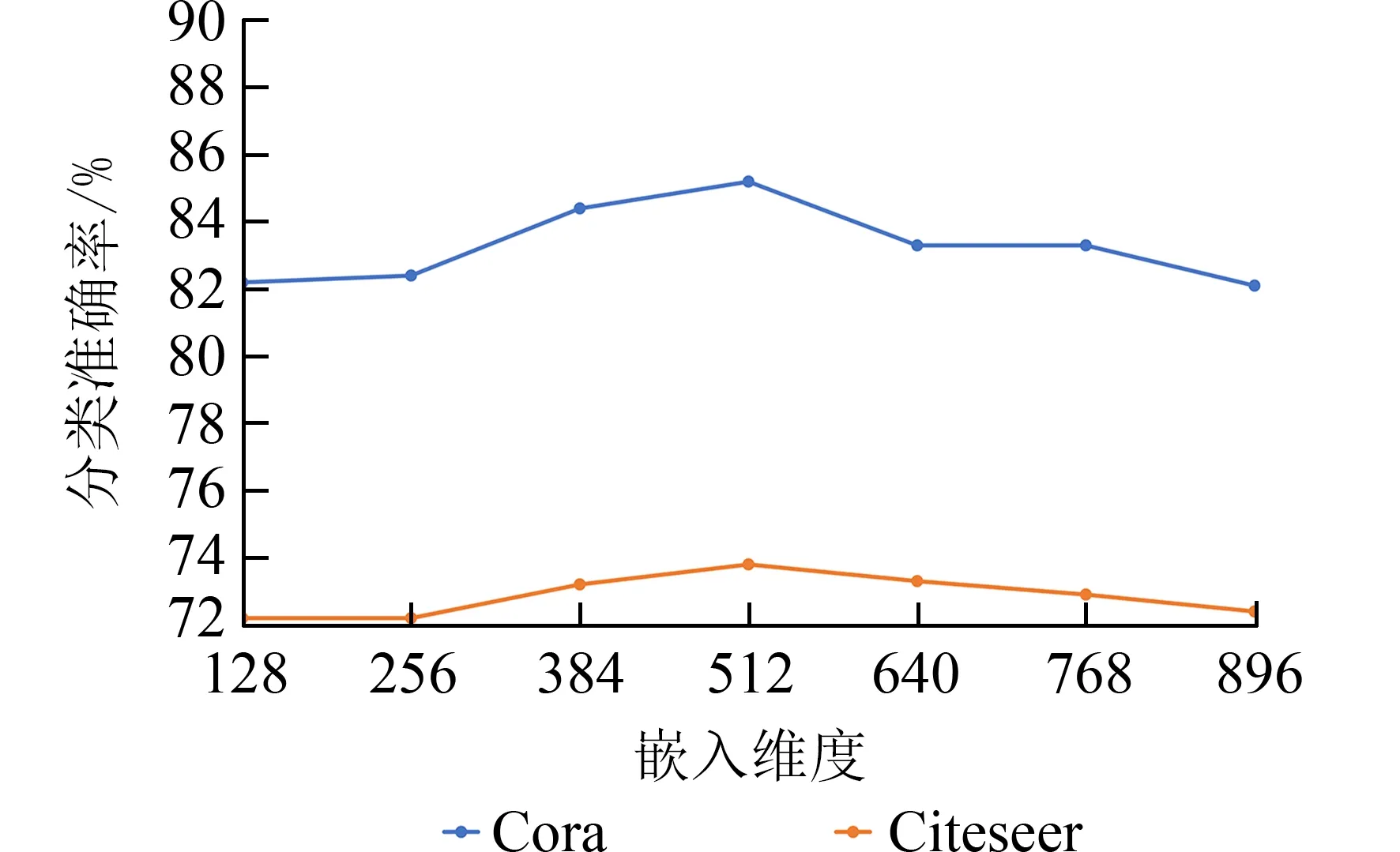

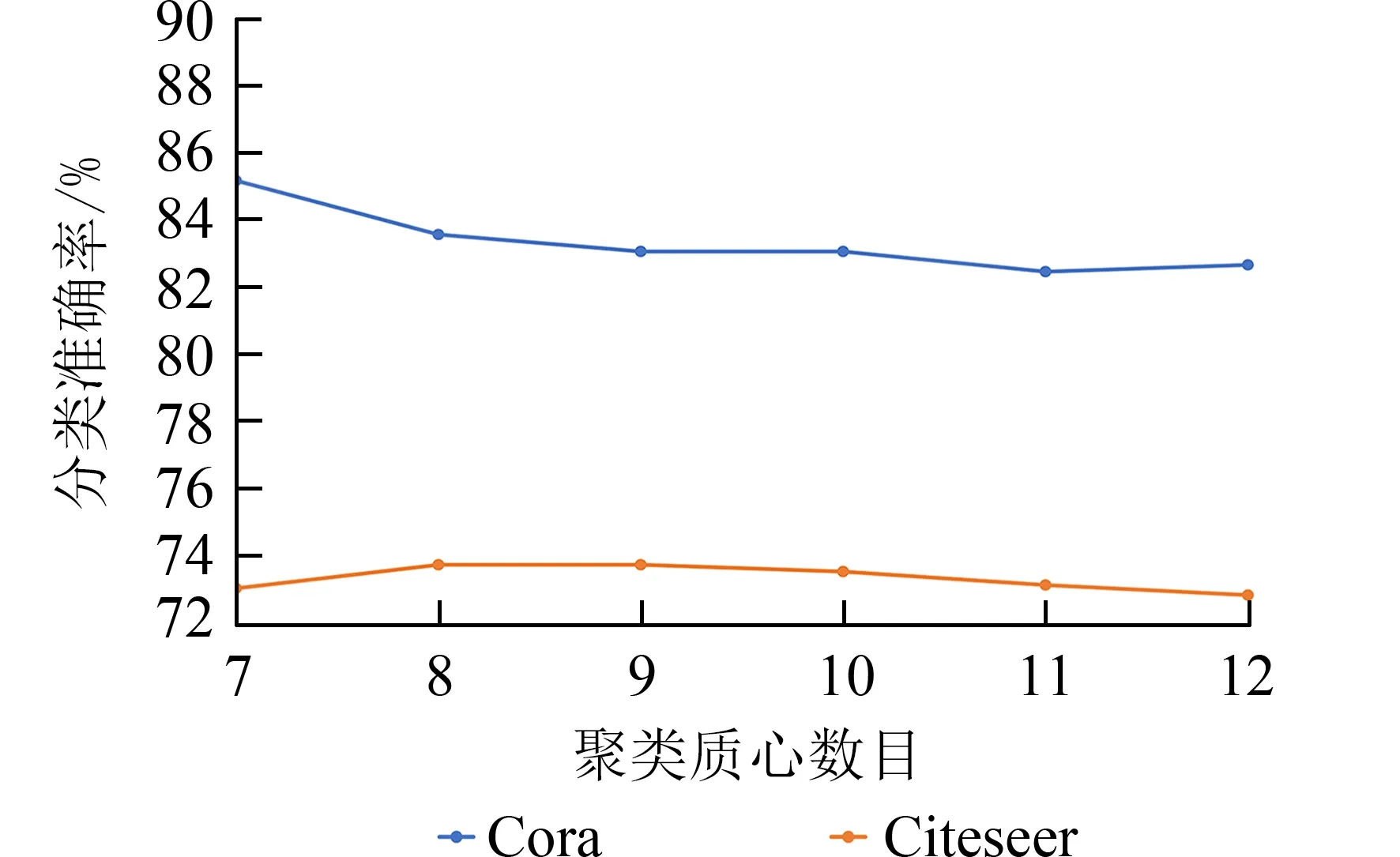

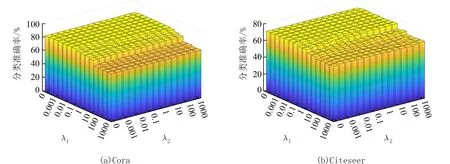

3.6 参数分析本节在节点分类实验上研究嵌入维度d′、聚类质心数目k以及权衡系数λ1和λ2对MCNRL模型的影响,其他模型参数保持不变.嵌入维度d′的大小直接影响节点表示和全局表示间的互信息的计算.聚类质心数目k影响两个视图的节点表示间的聚类一致性程度.λ1和 λ2是权衡系数用于调整正则化损失Lconsistency和Lseparate与主损失Llocal-global的关系对模型性能的影响程度.实验结果如图2~5 所示.

图2 MCNRL 模型在不同嵌入维度下的节点分类准确率Fig.2 Node classification accuracy of MCNRL model under different embedding dimension

从图2中可以看出,随着嵌入维度的增大,模型的分类准确率也随之提高,在嵌入维度d′=512时,模型取得最好效果.但是随着嵌入维度继续增大,模型性能也开始降低,这是因为过大的特征维度会导致表示学习冗余特征,而过小的特征维度会导致学习的表示损失信息,这表明适当的嵌入维度更有利于模型的性能.

从图3 中可以看出,对于Cora 和Citeseer 数据集,聚类质心数目分别取k=7 和k=8 时,节点分类效果最好.尽管Citeseer 实际类别数目是6,但是同一分类下的所有节点也可以继续进一步分类,从而挖掘更细粒度的语义信息.最后,借助t-SNE 技术[20],图4 给出了真实标签下Cora 和Citeseer 的节点表示的可视化结果.图中的实心黑点表示聚类质心,其他不同颜色的点表示不同类别节点.

图3 MCNRL 模型在不同聚类质心数目 k下的节点分类准确率Fig.3 Node classification accuracy of MCNRL model under different number of clustering centroid k

图4 真实标签下的节点表示的可视化结果Fig.4 Visualization results of node representations under ground truth labels

从图5 可以看出,当 λ1在[0.000 5,0.001,···,1 000]范围时,随着权衡系数 λ1增大,模型在Cora和Citeseer 上的分类准确率逐渐下降,这是因为在模型训练过程中侧重优化主损失Llocal-global,但是正则化损失Lconsistency的值远大于主损失,所以应该调整 λ1使得 λ1×Lconsistency略小于Llocal-global.为此,本文在Cora 上设置 λ1=0.001,在Citeseer 上设置λ1=0.02. 当 λ2>0时,明显发现模型分类准确率比λ2=0时 更好,同时,为调整 λ2使得 λ2×Lseparate略小于Llocal-global,为此,本文在Cora 和Citeseer 上均设置λ2=0.001. 最后,当 λ1>0,λ2>0时,模型分类准确率比 λ1=0,λ2=0时更好,这说明优化聚类一致性损失和簇心向量分离损失确实可以进一步提高模型性能.

图5 不同权衡系数 λ1,λ2下节点分类准确率Fig.5 Node classification accuracy under different number of λ1 andλ2

4 结论

节点表示学习是研究各类图结构数据的基础.本文提出的基于互信息最大化原理和聚类感知的无监督节点表示学习方法,不仅考虑输入空间中的一阶和高阶邻居信息,而且进一步挖掘节点在潜在空间中的语义信息,从而学习高质量的节点表示用于下游图分析任务.本模型在两个引文数据集上进行了节点分类和节点聚类实验,与基线方法相比,所提出的模型取得了最好的效果.未来考虑基于多视图信息瓶颈最大化多视图间的共享信息,同时最小化多视图间非共享信息进行节点表示学习.