光电载荷下的红外和可见光图像融合综述

2024-01-18刘爽利黄雪莉张锦宝杨江楠

刘爽利,黄雪莉,刘 磊,谢 宇,张锦宝,杨江楠

西南科技大学 信息工程学院,四川 绵阳 621000

近年来,高空侦察技术对防空安全有着重要的意义,如结合红外和可见光传感器的光电吊舱被广泛应用于无人机侦察中。由于机载光电吊舱存在高速运行、抖动等原因,其光电探测模块所拍摄的红外与可见光图像会出现几何畸变、模糊退化以及亮度和色彩失真等问题,所以机载光电载荷下的红外与可见光图像融合算法与传统的,如在地面上静止的吊舱应用到行人检测、军事检测等图像融合算法存在较大差异。所以针对远距离弱小目标,提出能够实时融合复杂背景红外与可见光图像各自优势的图像处理算法、提高后续检测跟踪精度成为当下需要解决的难题。

关于图像融合的研究和综述较多[1-3],但针对光电吊舱这一应用背景下的红外与可见光图像融合算法工作进行整理的相对较少,且在无人机上光电吊舱所拍摄的高空数据集没有公开。本文结合光电载荷背景下图像融合过程中弱小目标、纹理信息缺失和计算效率的问题,总结近年来红外与可见光传统图像融合方法的进展,分析了现在还未解决的问题以及对未来研究的展望,对后续光电吊舱下的图像融合技术的改进起到参考价值和推动作用。

1 介绍

掌握战场态势的发展和瞬时变化的情报信息是获取未来战场主动权的关键,为实现这一目标,需要能精确、实时地采集情报信息的系统装备[4]。过去主要由光学侦察卫星和有人驾驶侦察飞机承载这类装备,但用侦察卫星对某一区域进行全天连续监视,必须拥有一个庞大的星群,其装备费用十分惊人[5]。如何提高有人机的战场生存能力,避免或减少飞行人员伤亡或被俘事件是各国面临的难题[5]。

根据载机平台不同,机载光电载荷可以分为:固定翼作战飞机机载光电载荷、直升机机载光电载荷、无人机机载光电载荷等。按照任务使命和使用需求,机载光电载荷分为:光电探测与对抗系统、辅助导航系统、情报收集、侦察与监视系统、搜索跟踪瞄准系统,其中侦察、瞄准系统应用最为广泛光电吊舱的应用范围已经由最初的侦察监视,逐步向远程预警、网络化协同作战、快速打击、察打一体、无人作战等需求方向拓展。目前,国外先进机载光电载荷的稳定精度已达到亚像素级,其主要的研制公司有雷神公司、洛克希德·马丁公司、FLIR 系统公司等,与发达国家相比,国内无人机载光电载荷的发展还存在一定差距。一些主要的光电载荷系统及功能如表1所示。

表1 一些主要的光电载荷系统及功能Table 1 Some major optoelectronic load systems and functions

机载光电载荷平台具有系统集成度高、数字化程度高、可装载光电传感器多、探测精度高、探测范围广、应对各种复杂恶劣环境条件和地形条件的能力、目标检测跟踪与图像处理能力、自主目标引导与定位能力等特点。但是机载光电载荷平台在获取目标图像时,受光电平台本身设计、装调、无人机抖动等因素的影响,导致图像中的目标表现出的位置、方向、大小、外形等会有所失真,即导致图片出现几何畸变、模糊退化、亮度和色彩误差[6]等问题,并且机载光电平台在实际工作过程中所遇到的环境是比较恶劣的,目标小且背景环境复杂,对于天气的变化引起的成像质量也存在较大差异,这都使后续的图像处理算法面临一定挑战。

多源传感器图像融合技术是针对同一场景,取适当的图像处理技术将不同时间、不同拍摄角度、不同分辨率的多源图像融合成一幅图像,利用不同传感器的特点进行优势互补,从而可以减少后续图像处理任务的数据处理量的技术[7-10]。根据传感器获取图像来源的不同,图像融合技术可以分成医学图像融合[11]、遥感图像融合[12]、红外与可见光图像融合[13]等。其中,红外与可见光融合广泛用于目标检测[14]、自动驾驶[15]等领域,因其在红外测温、军事战争[16]中起到的突出作用,在图像融合技术中占有重要地位。

搭载红外与可见光传感器的机载光电平台可昼夜工作,且红外与可见光传感器获取的图像含有大量互补信息,可以实现多数据、多种功能融合的目标,将其装备到卫星或无人机上可大大降低成本并且获得更加准确、全面的信息。融合图像具有更好的特征有利于后续的检测跟踪,尤其是在类似于战场特殊情况下侦察和瞄准有助于后续指挥决策。同时,在光电载荷背景下对图像处理的实时性有较高要求,但是由于负载能力的限制,平台内部空间有限,导致计算能力不足。如何在机载平台狭小的空间中安装能满足实时性的图像融合系统将是一个技术的难点[6],引起了国内外众多学者的广泛关注[17-18]。另外,红外与可见光相机的拍摄环境恶劣,拍摄到的图像模糊并且信噪比较低,因此航空图像融合相比传统的红外与可见光图像融合的难度更高,需要提出一个适合光电载荷背景下的算法。在光电载荷背景下为了获得融合效果更好的图像,即能够获得既具有红外热辐射目标信息又具有可见光图像细节信息的融合图像,有必要针对机载图像融合进行深入的研究。所以在光电载荷背景下图像融合要考虑出现目标弱小、细节模糊和实时性的问题的情况。

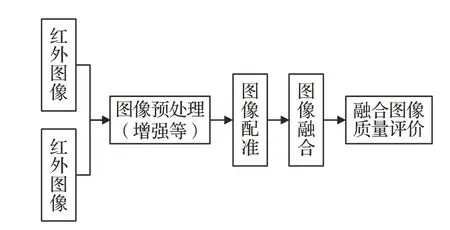

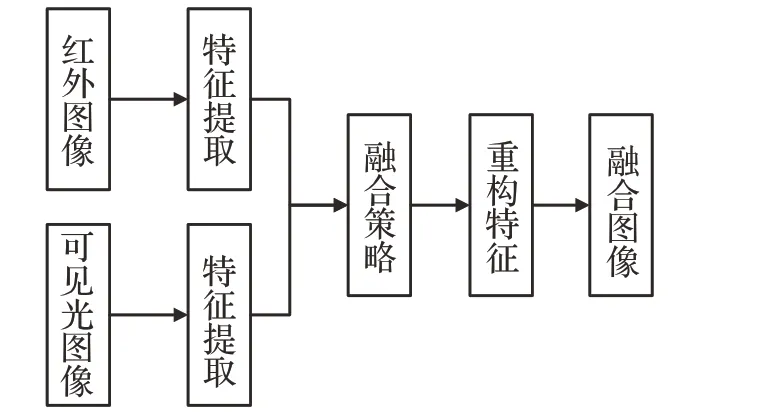

如图1 所示为红外与可见光图像融合的技术流程。红外图像与可见光图像融合的算法有很多。传统图像融合算法包括基于多尺度变换的[19]、基于空域的[20]以及基于稀疏表示的[21]。依据图像处理方式的不同和图像信息的抽象化程度,又可将图像融合算法分为以下三个层次:像素级图像融合[22]、特征级图像融合[23]和决策级图像融合[24],其结构如图2 所示。目前多数的融合算法都是针对像素级融合方法进行研究,特征级融合与决策级融合大部分都是基于像素级融合进行的改进。像素级图像融合方法可分为以下三种:基于空间域的融合、基于变换域的融合以及基于混合模型的融合。传统的红外与可见光图像融合的步骤如图3所示。

图1 红外与可见光图像融合技术流程Fig.1 Process of infrared and visible image fusion technology

图2 图像融合层级划分Fig.2 Hierarchical division of image fusion

图3 传统红外与可见光图像融合框架Fig.3 Traditional infrared and visible image fusion frame

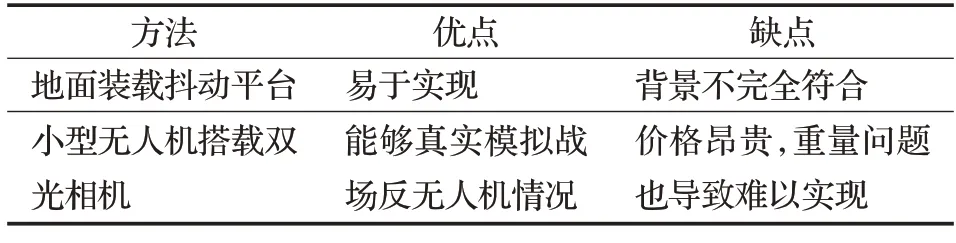

红外与可见光图像融合中常用的数据集如表2 所示,其中军事场景中常用的是TNO数据集等,查阅多种资料可知在无人机上光电吊舱所拍摄的双光高空数据集暂时没有公开。拍摄航空双光数据集的方法主要有地面对空拍摄和小型无人机搭载双光相机拍摄等方法。地面拍摄数据集方法主要方法效果对比如表3所示。

表2 红外与可见光图像融合常用数据集Table 2 Common data sets for infrared and visible image fusion

表3 构建数据集方法Table 3 Building dataset method

在地面搭建抖动平台模拟高速运转无人机抖动的问题,利用小型无人机模拟战场飞机,该方法优点为易于实现,缺点为地面对空场景下目标背景干净,无法模拟真实战场环境下的复杂背景,如巷战中的建筑背景;小型无人机搭载双光相机拍摄无人机的方法优点为能够尽量还原战场环境下空对空、空对地反无人机情况,缺点就是实施困难、价格昂贵,小型无人机无法搭载成像质量好、重量较重的红外与可见光相机。

下面对光电载荷应用背景下红外与可见光图像融合将会遇到的目标弱小[31]、细节模糊[32]、实时性[33]的问题进行整理和综述。

正聊得兴起,高潮突然想起下班时在地铁站口拿到的上访材料,猛拍一下脑门,暗骂自己一句傻逼,就急急忙忙给“诗的妾”道别:老婆,我还有工作要做,可能要鏖战到鸡叫头遍,告辞了。

2 光电载荷下的红外与可见光图像融合

2012年,Liu等人[34]提出了一种基于Dempster-Shafer(D-S)证据理论的混合粒子滤波多目标联合检测与跟踪。但是基于D-S 证据理论的复杂环境下多目标检测方法存在如何建立合理有效的异构信息分布函数融合方法的难点。2015 年,Fan 等人[35]提出了一种基于红外与可见光图像融合的目标检测算法解决了文献[34]中的问题。但是该算法主要起到监视的作用,并没有对目标的检测效果量化。2019年,赵烨[36]在针对小目标的检测中运用传统的形态学检测算法,并利用DS 证据理论框架,对不同特征信息赋予目标的可信度,再基于该框架提出了红外与可见光的二次融合识别方式,其融合后的可信度大大增加,不确定性迅速下降,且小目标检测的精度比单一传感器的高,证明了红外与可见光融合能够增加检测的精度,具有研究价值。

2.1 弱小目标图像融合

在复杂环境中的多目标检测已成为研究热点[37]。可见光相机具有高分辨率,可以提供场景的空间细节。但在低能见度等复杂环境下可见光图像不清晰。热红外相机是一种被动源传感器,它捕捉所有温度超过绝对零度的物体发出的红外辐射。这些类型的传感器通常部署在视觉系统中,以消除正常灰度和RGB 相机的照明问题[38]。光电载荷的背景下,后续检测跟踪的目标具有弱小的特点,即对比度低、目标像素少。对于红外传感器远距离小目标的检测,尤其是当目标的温度低于周围环境的温度的时候检测的概率往往很低[39]。针对这一特性,在目标检测时需要可见光图像来提供细节信息,红外图像来提供目标高亮信息。两种图像融合来提高小目标检测的精度。

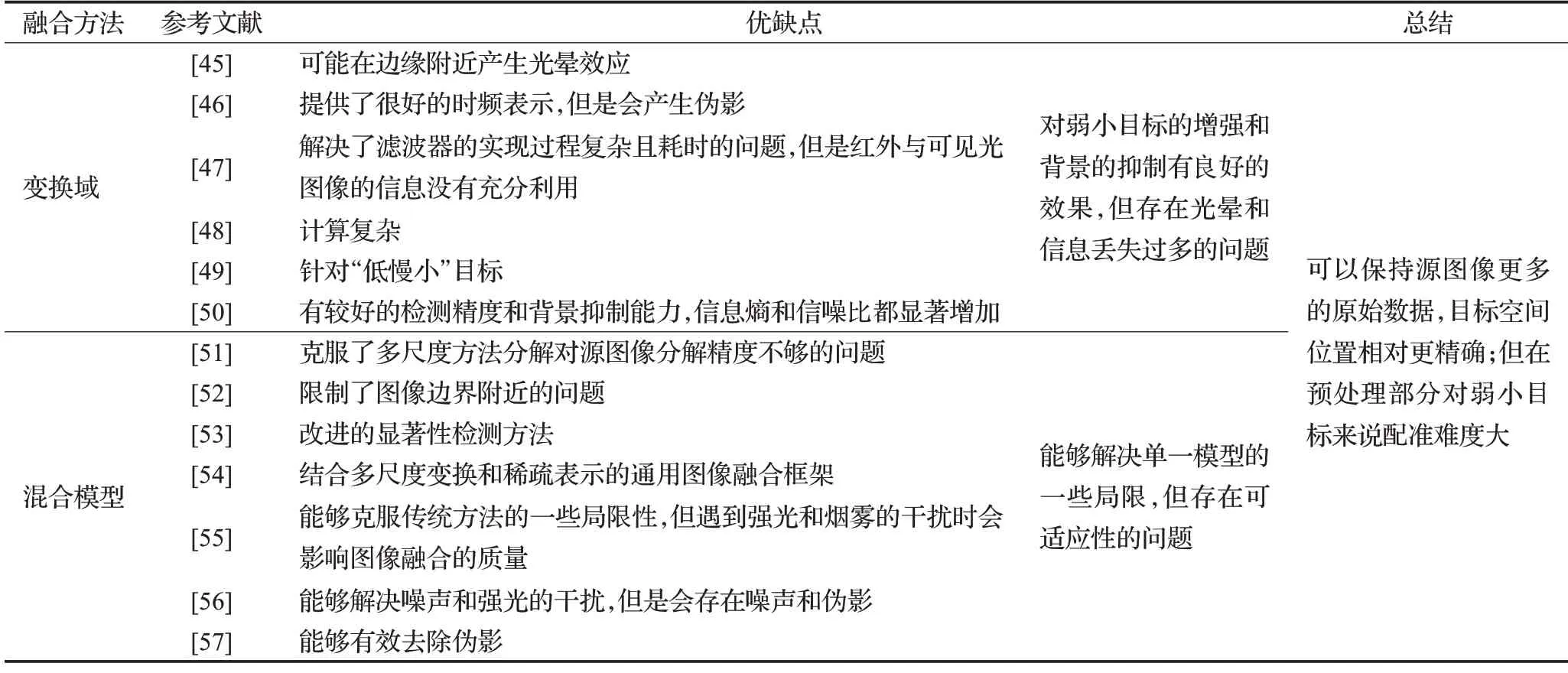

在像素级图像融合中,针对弱小目标图像融合的文章大都基于变换域和混合模型的算法。基于变换域方法的基本思想是首先利用变换工具将源图像分解为一系列的变换系数,然后通过预先设计的融合规则来组合变换系数,最后通过反转融合的变换系数得到融合的图像。基于变换域的方法还可以细分为金字塔变换[40]、多尺度变换[41]、稀疏表示[42]等。由于小目标无法提取有用的特征,因此很难使用基于深度学习的算法。Jin等人[43]提出的基于对比度金字塔方向滤波器组的红外与可见光图像融合采用克隆选择优化算法;Chandana等人[44]提出的一种基于双树复小波变换的拉普拉斯金字塔分解的图像融合技术,这些基于梯度、拉普拉斯、形态差异、比值、对比度、filter-subtract-decimate金字塔的方法都是基于变换域图像融合的著名方法,但这些简单的方法可能会在图像纹理边缘附近产生光晕效应。表4 所示为当前解决弱小目标问题的基于像素级算法对比总结。曾祥通等人[45]提出的颜色对比度增强的红外与可见光图像融合方法。与金字塔相比,小波提供了很好的时频表示,因此离散小波变换(discrete wavelet transform,DWT)[46]被运用在图像融合中。由于DWT 是移位变体,它可能会在融合的图像中引入伪影。大多数的多尺度融合方法需要两个以上的分解水平才能获得令人满意的结果,但是这些滤波器的实现过程复杂且耗时。Bavirisetti等人[47]提出了一种基于双尺度图像分解和显著性检测的图像融合算法和Naidu等人[48]应用组合策略在可见和红外图像目标提取的过程中有效地解决了上述问题,但是可见光和红外图像的信息并没有得到充分的利用。2021 年Sun 等人[49]提出了一种基于红外与可见图像融合对低空低速小目标的远程探测算法,该算法融合图像的细节和目标都有增强,在单传感器视觉效果较差时仍有较好的检测精度,但是存在噪声放大的问题。2023年Li 等人[50]提出了一种基于稀疏先验联合显著性检测和潜在低秩表示的四阶微分方程的红外可见图像融合方法,该显著性算法具有较高的检测精度和良好的背景抑制能力,其信息熵和信噪比都有显著增加。总的来说,在弱小目标的情况下最大的难点就是融合过程中目标被背景淹没。所以基于变换域的方法对弱小目标的增强和背景的抑制有良好的效果,但是也会存在信息丢失过多的问题,如背景过抑制丢失目标。

表4 像素级弱小目标图像融合算法对比Table 4 Comparison of pixel-level dim target image fusion algorithms

基于空间域的方法直接提取源图像的显著区域或清晰块,生成最终融合图像。但是现在用传统的红外与可见光图像融合的方法大多是基于混合模型的方法,即结合变换域和空间域的方法。基于混合模型的方法结合了上述方法的优点,提高了红外和可见光图像融合的性能。为了克服多尺度分解对源图像分解精度不够的问题,Wei 等人[51]提出了一种非下采样轮廓波变换的精确分解方法。Ren等人[52]提出了改进了制导滤波器以便于更好地分解图像,限制了图像边界附近的伪影。Zhang 等人[53]提出了一种局部边缘保持滤波器,将源图像分解为底层和细节,并使用改进的显著性检测方法来检测红外图像的显著目标区域。Yu 等人[54]提出了一种结合多尺度变换和稀疏表示的通用图像融合框架,克服融合的局限性。Ma等人[55]提出了一种结合视觉显著性映射和加权最小二乘优化的融合方法能够克服传统方法的一些局限性。当可见光图像受到烟雾和强光等干扰时,上述融合算法的图像融合质量会受到干扰。所以,Lin 等人[56]提出了一种基于滚动制导滤波器和显著性检测的自适应红外和可见光图像融合方法,但是存在一定的噪声和伪影。2023 年Liu 等人[57]提出了一种海洋环境下舰载光电吊舱的红外与可见图像融合,从主观来看该算法在去伪影和显示目标特性有较好的效果,客观来看其信噪比、平均梯度、空间频率等都优于其他算法。

基于混合模型的算法在弱小目标问题时会综合空间域、变换域和其他模型的优缺点,能够综合空间域中空间簇互相邻接的问题和变换域目标丢失的问题。因为弱目标亮度信息很低,小目标边缘特征较弱,弱小目标边缘信息和亮度信息都很差,所以在目标弱小的情况下很少使用基于特征的图像融合算法。决策级图像融合结合目标检测算法能够提高弱小目标检测的精度,并且可以根据不同的场合选择合适的检测器。决策级红外与可见光融合的算法较新,表5所示为总结的决策级融合的部分算法。国内已知最早实际应用到决策级融合的是2011年肖旭光等人[58]提出的利用Hu不变目标尺寸特征进行融合,但该方法的确匹配率较低。2020年白玉等人[59]提出了对通过检测结果加权融合的决策方法。该方法使检测精度达到了84.7%,与单一传感器相比检测精度分别提高了2.44%和21.98%。2022 年朱铠铠[60]提出的多源数据层融合方法在提高效率的同时能够提高目标检测的精度。刘莲[61]提出的利用多层卷积特征融合的决策级融合算法的检测精度提高了3.38%,成功率提高了10.07%。2023 年宁大海等人[62]改进了唐聪等人[63]的算法使得白天的漏检率降低了8.16%,夜晚的漏检率降低了9.85%,但是该方法增加了计算时间复杂度。Hu等人[64]提出的基于光传感器的决策级融合策略,提高了在低光照下红外与可见光融合后的目标检测精度,并获得了69.0%的最优AP值。

表5 决策级图像融合算法对比Table 5 Comparison of decision level image fusion algorithms

在战场状态下机载光电吊舱往往跟踪的是弱小目标,红外与可见光图像融合能够突出待检测跟踪的目标。此时处理双光图像主要有像素级处理方法和决策级处理方法。弱小目标边缘和亮度信息很弱所以不直接采用基于特征的方法。在用像素级方法处理时,基于变换域的方法对弱小目标的增强和背景的抑制有良好的效果,但存在光晕和信息丢失过多的问题。基于混合模型的方法能够解决单一模型的一些局限,但存在可适应性的问题。总的来说基于像素的方法可以保持源图像更多的原始数据,目标空间位置相对更精确;但在预处理部分对弱小目标来说配准难度大。决策级方法可适应性强,后续目标检测精度高,但是会丢失大量信息。但是现有的这些针对弱小目标融合增强的算法都是在较为理想的环境下实现的,没有在复杂环境下进行现实的验证,因此在复杂环境下的可适应性是现在算法改进的切入点。

2.2 纹理细节模糊

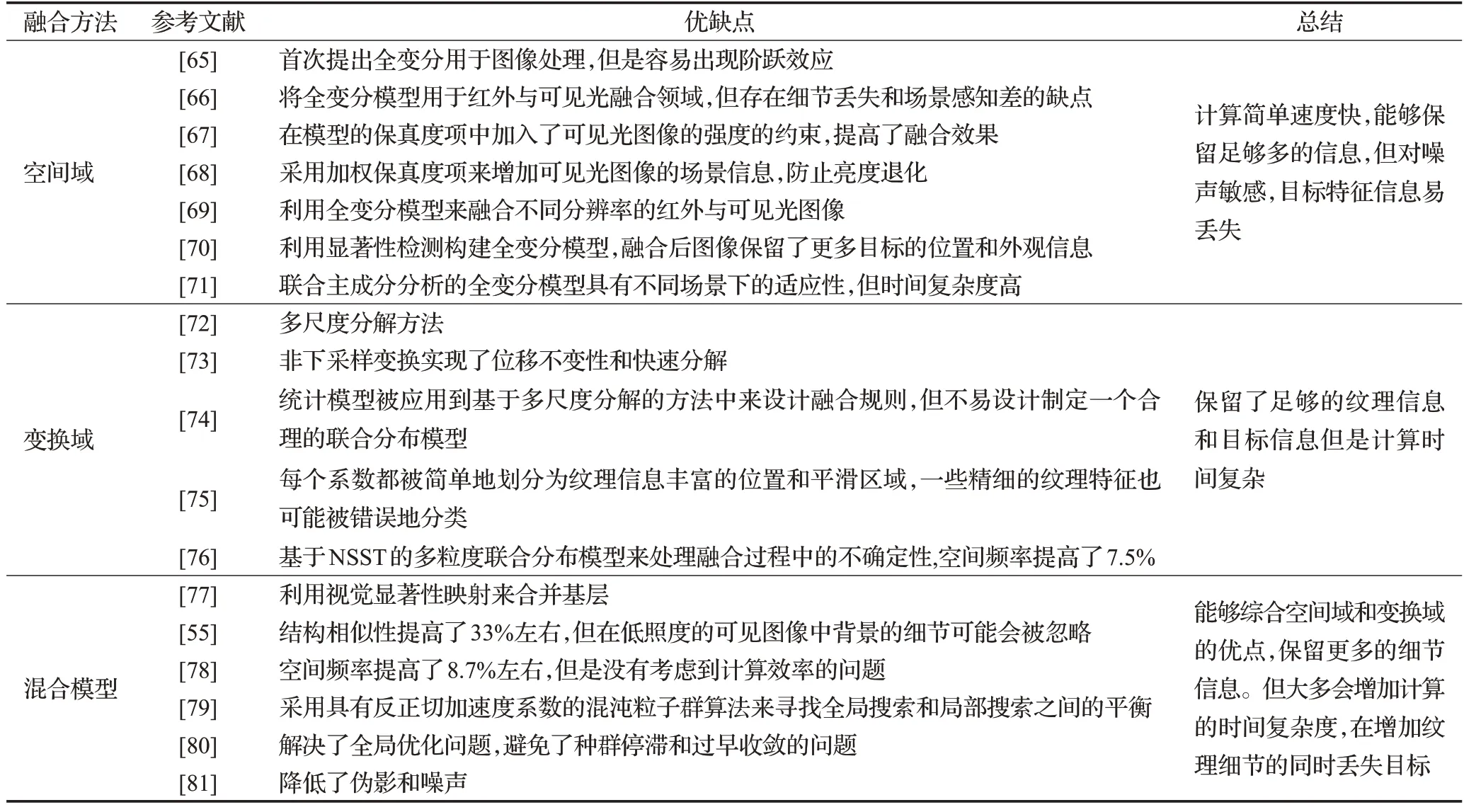

纹理细节的问题通常考虑像素级图像融合方法。在光电载荷的背景下所拍摄的图像目标背景通常是较为复杂的,红外图像缺乏纹理信息而可见光图像具有纹理信息可以用来弥补红外相机的不足,所以提出了红外与可见光图像融合的技术来增加复杂环境下的有效信息。但是在融合的过程中会出现边缘模糊的问题,所以近年来一些学者提出了一系列改进算法。纹理细节模糊的算法优缺点总结如表6所示。

表6 解决纹理细节模糊的算法Table 6 Algorithm to solve texture detail blurring

基于空间域的算法中Rudin 等人[65]在1992 年首次提出了全变分(total variation,TV)的概念,并通过最小化全变分将其应用于图像去噪。Rudin 的TV 模型出现在有界的变分空间中,可以得到不连续的解,从而在保持边界特性的同时有效地去除噪声。但是,当使用该模型时,会出现阶跃效应,在原始图像的一些相对平坦的区域可能会出现假边。四阶去噪模型成功地避免了阶跃效应。Ma等人[66]将TV模型引入红外-可见光图像融合领域,但该模型没有考虑可见光图像的强度特征,存在细节丢失和场景感知差的缺点。Guo 等人[67]通过在模型的保真度项中加入对可见图像强度的约束,减少了融合图像的光晕。Nie等人[68]使用加权保真度项来增加可见光图像的场景信息,并在正则化项中增加约束,以防止亮度退化。考虑了多分辨率图像中的噪声放大和信息丢失问题,Du 等人[69]提出了利用全变分模型融合不同分辨率的红外和可见光图像。上述算法由于忽视了多源图像和不加区别地提取不同特征将会损失融合图像的质量。所以Zhao等人[70]利用结构转移和局部显著性检测构建了一个TV 模型,融合后的图像保留了更多关于目标的位置和边界信息。随着算法的不断改进,对于TV 算法的模型越来越复杂,时间复杂度也越来越高,并且红外和可见光图像保真度项的权重确定通常依赖于实验经验,需要对不同的场景进行手动调整,所以Zhang等人[71]提出了联合主成分分析的全变分红外与可见光图像融合,该算法对于不同场景具有适应性。多尺度分解(multi-scale decomposition,MSD)方法已经成为图像融合最活跃的领域之一,该方法的分解机制类似于人类视觉系统,为图像的几何抽象和表征提供了一个高水平的变换域[72]。其中,非下采样信号变换克服了以往MSD方法的缺点,实现了位移不变性和快速分解[73]。统计模型也被应用到基于MSD 的方法中来设计融合规则[74],而如何制定一个合理的联合分布模型仍然是一个很大的障碍。传统的上下文隐藏马尔可夫模型,倾向于使用双态高斯混合模型来模拟MSD 系数的分布,即每个系数都被简单地划分为纹理信息丰富的位置和平滑区域[75],一些精细的纹理特征也可能被错误地分类为小状态,导致统计模型不准确,进一步影响融合图像的质量。由于系数的水平仅限于大或者小,这与信息的层次结构相矛盾,影响了确定转移特征的准确性。为了更好地反映各系数的显著性,Luo 等人[76]提出了一个基于非下采样剪切波变换的多粒度联合分布模型来处理融合过程中的不确定性,该算法的空间频率提高了7.5%。基于各种MSD 的多尺度融合方法的巨大成功,证实了尺度分离在图像融合过程中的重要性。针对传统的用于基层的“平均”融合规则并不能有效地充分利用这些低频信息,通常会导致融合图像的对比度损失,所以可以使用视觉显著性映射[77]来合并基层。所以基于空间域算法计算简单快速,在已有的用于目标检测中的论文中精度高,但是也存在场景感知差的缺点;基于变换域的算法保留了足够多的细节信息,但是时间复杂度较高。

传统的红外与可见光图像融合技术需要严格配准,2023 年,Li 等人[82]创新性地提出了一种无配准融合,他根据两幅源图像之间的空间关系,联合学习调制参数和动态卷积核使其模态在高级特征空间中对齐。该方法应用了三层网络结构训练,在复杂多变的战场环境部署困难,但也为红外与可见光图像融合提供了新的思路。Dong等人[83]提出了一种利用提出了一种让源图像参与到融合过程中,共同提取和融合特征的技术,该算法与现有的融合框架不同,无需根据不同的融合任务调整融合策略和神经网络模型。

针对纹理细节模糊这一问题主要是基于像素级的图像融合方法。在处理纹理细节问题时,基于空间域的方法计算简单速度快,能够保留足够多的信息,但对噪声敏感,目标特征信息已丢失;基于变换域的方法保留了足够的纹理信息和目标信息但是计算时间复杂;基于混合模型的方法是现在主流的方法,该方法能够综合空间域和变换域的优点,保留更多的细节信息。但大多会增加计算的时间复杂度,在增加纹理细节的同时丢失目标。但是在考虑图像细节的算法中并没有考虑到目标和计算效率的问题,所以怎么在突出目标且不丢失背景的情况下减少计算的时间是传统红外与可见光图像融合算法改进的方向。

2.3 实时性

光电载荷背景下红外与可见光图像的实时融合对于计算的速度要求是十分高的。如果图像处理的速度太慢,帧率太低就会导致人眼所看到的画面是卡顿且不流畅的。现在无人驾驶技术的流行和发展,实时红外与可见光图像融合成为研究的热点,给该方向上提出的算法和技术带来一定的参考价值。目前的多传感器图像融合方法计算复杂度高,在硬件上难以实现,但在光电载荷背景下需要一个新的稳定的、计算速度快的、处理效率高的算法,所以仍然有研究的意义。现有的实时红外与可见光图像融合的算法也有借鉴的价值,以下就对一些满足实时处理的融合算法做出概述。实时融合方法如表7所示。

表7 实时性融合算法Table 7 Real-time fusion algorithm

空间域图像融合不需要对源图像进行分解。但是空间域方法存在有低对比度和空间退化的问题[84],Aydin等人[85]在FPGA 上利用基于颜色空间变换、均值和方差的高级合成(high-high synthesis,HLS)工具等技术实现了图像融合方法,改善了图像的颜色信息,但是该方法会使图像融合后的图像性能变差且可适应性低,因此在考虑融合的实时性问题时通常考虑采用变换域的方法。Sims 等人[87]首次利用金字塔变换实现图像融合的实例,四个层次的金字塔分解,有四个独立的梯度算子,都可以在一个设备上运行,而不需要片外存储器,并且能够在2.8 GHz Pentium-4 上提供大约100 倍的加速。Song等人[88]利用流水线的拉普拉斯融合算法,该算法较为耗时且有伪影。在实时的图像融合中常用方法为多尺度变换法。与DWT相比,金字塔方法的信噪比较低,并且为了克服DWT 是移位变体这一问题,采用时移不变离散小波变换(shift invariant wavelet transform,SIDWT)[86]代替DWT 来提高融合性能,但是SIDWT 的功耗也很高,这使得SIDWT 也不适用于低功耗的设备。为了克服基于DWT和SIDWT的方法的缺点,就采用了非下采样轮廓波变换(non-subsampled contourlet transform,NSCT)[89]。但是为了存储所有的波段,NSCT在图像融合的初始步骤中至少需要72个内存块[90],其中几乎一半用于存储融合的信息进行重建。此外,在基于硬件的解决方案中,保持NSCT中使用的滤波器组的精度也很困难,并且在复杂的空间结构中不能保持源图像的边缘,所以在实时图像融合时不考虑NSCT。此外,主成分分析、熵检测和改进的拉普拉斯算子之和具有有限的图像特征,不适用于红外和可见图像融合,并且上述算法计算量大、耗能大[91]。

基于上述的问题,Mishra等人[92]提出了实时应用中基于改进的Frei-Chen算子的红外与可见光传感器图像融合。与现有的融合算法相比,该方法在总边缘转移、结构相似性和夜视对比度方面分别提高了48%、15%和100%,在Xilinx 开发工具上可以以每秒90 帧的速度处理高清分辨率(1 920×1 080)的图像。但是该算法可能会出现闪烁的伪影。Jeong等人[93]提出了一种基于多导滤波器的实时可见红外图像融合,该算法处理320×270的图像时帧率为58 FPS,虽然牺牲了时间,却大大减少了视频图像中闪烁的伪影并且不会出现卡顿的现象,但是该算法对于纹理却当作了噪声处理。由于两个视频信号由两个不同的源产生,因此两个视频信号在相应的视频帧开始之间有不可避免的启动延迟,因此没有特殊的硬件同步机制,不能在同一时间启动,并且该延迟不是随时间恒定的;其次由于视频源中内部电气或机械硬件的限制,每个视频源都有一个小的帧率偏差。当输入的视频被解码成数字格式的信号时,为了准备处理,上述问题被继承到数字视频信号中,视频融合需要在可见光和红外视频中处于相同空间位置的像素被同时访问和处理。Awad等人[94]提出了一种集成的现场可编程逻辑门阵列(field programmable gate Array,FPGA)架构和实现的视频处理系统解决了上述的问题,该实现消耗的FPGA 资源很少,因此更适合相机硬件集成,处理720×480大小的图片帧率可以达到30 FPS。

上述的实时红外与可见光图像融合没有考虑到小目标融合的效果以及没有为进一步图像处理创造条件。2022 年,Zhang 等人[95]提出了一种嵌入式实时红外和可见图像融合算法来检测无人机,目标检测的检出率高达0.926,在ZedBoard上的帧率可以达到205.3 FPS,在TX1上的帧率为36.6 FPS,在ARM上的帧率为5.4 FPS。为解决炫光、烟雾等因素影响,2021年,Li等人[96]提出了一种基于引导滤波和显著性检测的红外可见图像融合的实时FPGA 实现,并将高级语言转换成硬件语言,通过硬件实现的图像融合速度是PC 图像融合速度的63倍,帧率可达55.6 FPS,文献[96]在去除光晕方面相比于其他算法有较好的效果。考虑实时性问题还可以从硬件角度出发,2022 年,黄西莹等人[97]提出了在FPGA 上对融合算法并行实现来对运行时间进行优化。

所以,基于空间域的算法虽然不会对源图像进行分解减少了计算的难度,但是会导致空间退化等问题;基于变换域的算法在像素级方法中处理效果较好,但会存在功耗过大的问题;基于混合模型的算法能够折中变换域和空间域的优缺点但是计算复杂;通过并行处理加速能够优化时间。由于机载设备有重量的要求,所以在机载光电吊舱上的计算能力是有限制的。在有限的计算能力之内要达到效率的最大化是现在需要解决的难题。传统的图像融合处理方法比深度学习的方法所用到的资源更少。总的来说,兼顾融合效果和计算能力不能用复杂的算法来解决,在单一模型中计算效率和融合效果往往是对立的,基于混合模型能够折中这两个问题。虽然现有的实时处理算法在仿真图像模型上都有着良好的效果,但目前还没有已发表的文献涉及实际复杂自然环境中的试验数据,且实时的图像融合研究相对较少。

3 总结与展望

红外与可见光图像的增强、配准融合是为了后续对目标跟踪检测做预处理,基于预处理的图像使后面的跟踪检测能够更加准确。发展到目前,红外与可见光的增强和配准融合已经覆盖了军事、辅助驾驶、电力、边防等领域。虽然目前的增强、配准融合算法有很多,但是在不同的应用场景有不同的应用需求。在本文中根据光电载荷目标检测的需求,既要满足融合的精度又要满足融合的实时性,所以目前还没有一个完整全面讲到增强、配准融合的算法来应用到光电载荷的应用场景中,且还没有一个可靠的光电载荷下拍摄的数据集,所以双光融合的落地仍面临着一些挑战。

(1)针对红外与可见光图像融合现在还没有一种全面的图像配准算法能够适用于所有的应用场合。融合前要对图像配准,相对于基于深度学习的算法,传统的配准计算量较小,不需要大量的数据进行训练。所以针对光电载荷这一背景,需要提出更加能够具有计算量小、配准精度高、实时性好的算法。由于配准的难度较大,精度较小,所以无配准融合为红外与可见光图像融合提供了新的思路。对于弱小目标也可采用决策级融合,此时对异源图像配准的要求小,当异源图像判断为目标时并且做出相关决策后进行融合来凸显出目标。

(2)针对红外与可见光图像融合,双光融合的过程中存在着噪声放大、细节丢失、目标淹没等问题,所以在光电载荷中计算能力有限的情况下,亟需提出新的针对复杂背景弱小目标的后续检测跟踪改进的红外与可见光图像融合算法。融合效果与融合时间需要进行折中,在实际应用中对融合速度的提升更为迫切。现有的传统双光融合算法对于实时性的要求还能满足,处理图像时帧率很低,对于人眼观测的数据有较大的延迟,这对光电载荷上软硬件都有较高的要求,并且现有的算法大多是在融合算法上的创新,而很少能够进行实时融合的测试。所以传统双光融合算法仍然有较高的研究价值。

(3)机载光电载荷下实景拍摄的数据集缺乏。针对机载光电平台的图像处理技术没有实景的测试,所以需在机载光电载荷平台上拍摄图像数据对来构建光电载荷下的红外与可见光图像数据集。