基于粗细网络模型分步训练的地震数据重建方法

2024-01-01葛康建王长鹏张春霞张讲社熊登

摘要:由于地形等复杂条件的限制,叠前地震数据在空间上存在不完整或不规则分布的情况,导致数据出现缺失或混淆等现象。近年来,基于卷积神经网络的方法已经广泛应用于缺失地震数据重建工作。然而一步训练过程的网络模型不足以重建具有宽振幅范围的缺失地震数据,低振幅缺失部分的重建结果仍需改进。因此本文提出一种具有分步训练过程的粗细网络模型。该模型由粗网络和细网络组成,分步恢复宽振幅范围内的缺失地震数据。在细网络中引入离散小波变换代替池化操作,其可逆性在上采样阶段有利于保留细节特征。模型采用混合损失函数重建缺失信号的真实细节。粗网络的初步恢复结果经过掩码操作处理后输入到细网络,细网络进一步精确恢复缺失部分的低振幅信号。实验结果表明,与残差网络(ResNet)、U型网络(UNet)和多级小波卷积神经网络(MWCNN)的重建方法相比,本文方法在合成数据和真实数据上展现出更卓越的重建性能:在缺失75%的合成数据上,信噪比为18.818 5 dB;在缺失50%的真实数据上,信噪比为12.255" 1 dB。在消融研究中,本文模型重建的均方误差为1.689 3×10-4,信噪比为19.284 6 dB,峰值信噪比为 43.743 5 dB,结构相似性为0.984 1,均优于其他三组对照实验。

关键词:粗细网络;混合损失;离散小波变换;地震数据重建

doi:10.13278/j.cnki.jjuese.20230097

中图分类号:P631.4

文献标志码:A

Supported by the National Natural Science Foundation of China (12001057) and the Fundamental Research Funds for the Central Universities in Chang’an University (300102122101)

Seismic Data Reconstruction Method Based on Coarse-Refine Network

Model with Stepwise Training

Ge Kangjian1, Wang Changpeng1, Zhang Chunxia2, Zhang Jiangshe2, Xiong Deng3

1. School of Science, Chang’an University, Xi’an 710064, China

2. School of Mathematics and Statistics, Xi’an Jiaotong University, Xi’an 710049, China

3. Research amp;Development Center, BGP, Zhuozhou 072751, Hebei, China

Abstract:Due to the limitation of complex conditions such as topography, the pre-stack seismic data are spatially incomplete or irregularly distributed, resulting in phenomena such as missing or confusing data. In recent years, methods based on convolutional neural networks have been widely used in the reconstruction of missing seismic data. However, the network model of one-step training process is not enough to reconstruct the missing seismic data with a wide amplitude range, and the reconstruction results of the low-amplitude missing part still need to be improved. Therefore," a coarse-fine network model with a stepwise training process is proposed in this paper. The model consists of a coarse network and a fine network to recover the missing seismic data with a wide amplitude range in a step-by-step process. Discrete wavelet transform is introduced in the fine network instead of pooling operation, and its reversibility facilitates the preservation of detailed features in the up-sampling stage. Using a hybrid loss function, the model reconstructs the true details of the missing signals. The preliminary recovery results of the coarse network are processed by masking operation and input to the fine network, which further accurately recovers the low amplitude signal of the missing part. The experimental results show that compared with the reconstruction methods of residual network (ResNet), U-shaped network (U-Net) and multilevel wavelet convolutional neural network (MWCNN), the method in this paper demonstrates superior reconstruction performance on both synthetic and real data: the signal-to-noise ratio is 18.818 5 dB" on synthetic data with 75% missing, and 12.255 1 dB on real data with 50% missing. In the ablation study, the mean square error of the model reconstruction in this paper is1.689 3×10-4, the signal-to-noise ratio is 19.284 6 dB, the peak signal-to-noise ratio is 43.743 5 dB, and the structural similarity index is 0.984 1, all of which are better than the other three sets of control experiments.

Key words: coarse-refine network; hybrid loss; discrete wavelet transform; seismic data reconstruction

0 引言

在地震数据处理领域中,从缺失道重建完整的叠前数据是一项长期的任务。由于建筑物、湖泊和冰川等复杂地形条件的限制,地震采集系统通常很难收集完整的野外地震叠前数据,导致采集的地震数据出现不完整或不规则分布,使数据存在缺失或混叠现象。在实际应用方面,地震数据作为后续处理和反演的先天之本,对其进行高信噪比、高保真、高效的重建具有十分重要的现实意义。

目前已经被提出用于地震数据重建的方法可以分为两类:基于模型驱动的方法和基于数据驱动的方法。基于模型驱动的方法大致分为三种:基于波动方程的地震数据重建方法[1]、基于稀疏变换的地震数据重建方法[23]、基于低秩矩阵完备的地震数据据重建方法[45]。这些方法独立于数据,在很多方面得到了广泛的应用,但是它们在使用之前通常需要基于一定的先验知识和预先假设,存在一定的局限性,在面对更复杂的地震数据时表现不佳。

近年来,以深度学习为代表的数据驱动方法已经广泛应用于地震数据的重建[69]。它不受预先假设的限制,具有强大的特征提取能力,可以有效解决阻抗反演[1011]、地震断层解释[1213]和地震数据降噪[1415] 等地震勘探问题。一些经典网络如卷积自编码(CAE)[16]、残差网络(ResNet)[17]、U型网络(UNet)[18]和生成对抗网络(GAN)[19]已被用于解决缺失数据重建任务。随着网络深度的不断增加,网络性能并非提升,反而出现退化现象。针对此问题,以残差块为基础的ResNet被提出,该网络通过在残差块中引入跳连接,实现了信息在多层间的直接传递。此设计有效缓解了梯度消失问题。Wang等[17]将残差学习框架和卷积神经网络相结合来解决地震数据插值问题。Chai等[18]用UNet解决了规则和不规则缺失地震数据的重建问题。UNet的第一个特点是其对称的下采样和上采样过程;第二个特点是其中间的长连接。下采样可以增加输入数据干扰的鲁棒性,降低运算量,扩大感受野;上采样将抽象的特征解码到原图尺寸。长连接将下采样过程中得到的高级特征保留下来,联系了输入数据的许多信息,有助于还原下采样过程中的信息损失。虽然这些方法可以恢复大部分缺失信号,但没有关注到地震数据中的纹理和结构差异,因此往往会产生模糊的结果,缺乏细节。考虑到这一事实,Yu等[20]提出了添加注意力机制来关注全局信息的模型,并使用结合结构相似性(SSIM)和L1范数的混合损失函数来增强纹理细节。在卷积神经网络模型中,通常使用池化操作来扩大感受野,但这可能会丢失数据的细节特征,影响地震数据的精确重建。尽管扩张卷积可以增大感受野而不增加计算成本,但它可能受到网格效应的限制。多级小波卷积神经网络(MWCNN)[21]采用离散小波变换代替池化,并使用逆小波变换进行上采样,有效扩大感受野同时保留细节,实现了效率和性能之间的平衡。

基于以上分析,本文提出了一种具有分步训练过程的粗细网络模型;地震数据首先通过粗网络UNet得到一个粗略的重建结果;然后基于粗网络的插值结果,细网络MWCNN采用离散小波变换代替池化过程,学习更精细的特征,促进信号细节的恢复。最后,通过合成数据和真实数据,与一步训练过程的网络模型进行对比,以证实本文模型提高缺失数据重建质量的有效性。

1 方法原理

1.1 粗细网络

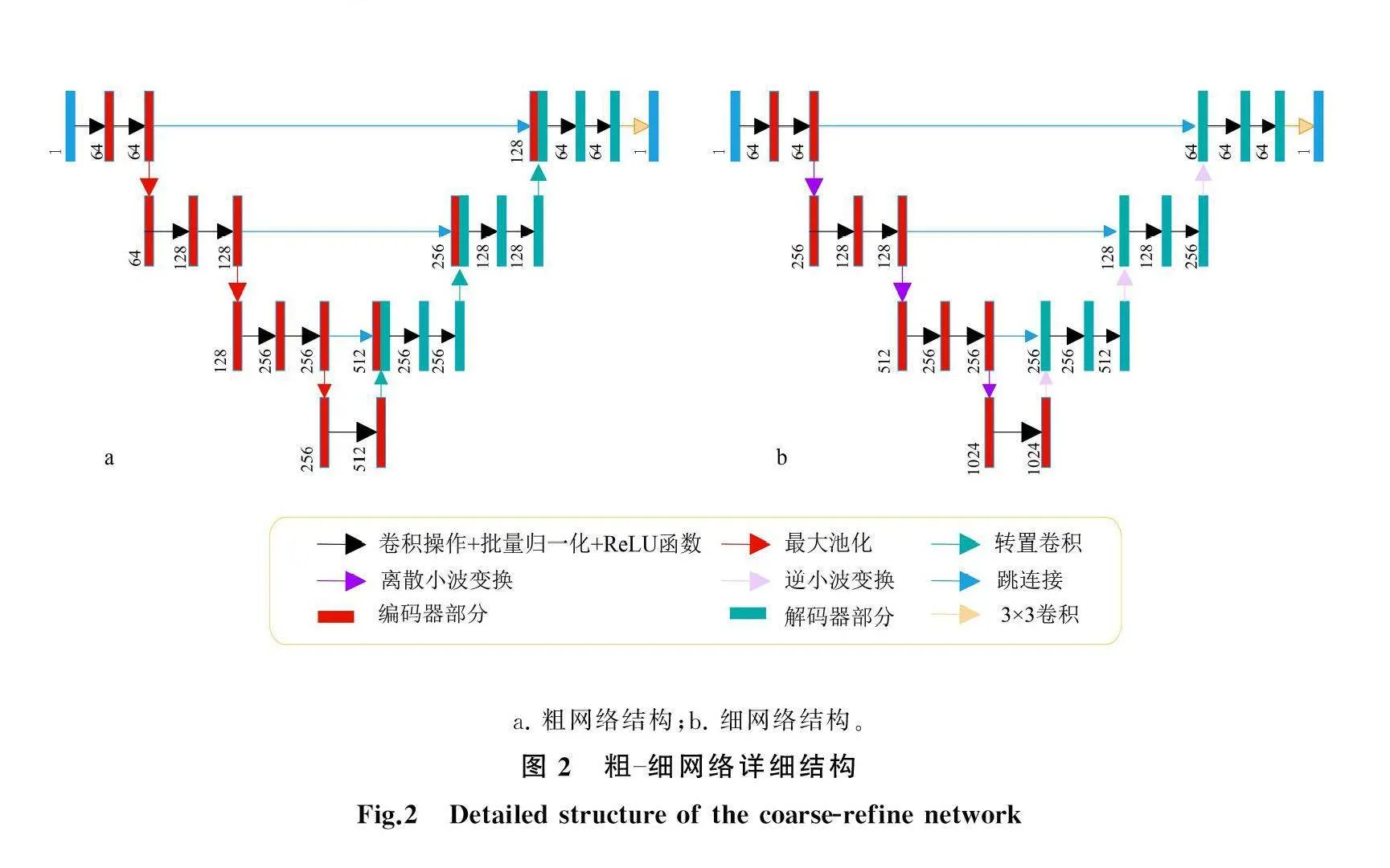

在图像处理领域,虽然单一网络(如UNet)[22]已经被广泛应用,表现出良好的性能,但编码器[23]的下采样过程和损失[24]的像素级计算导致了混叠和过平滑等问题的出现。为了解决单一网络架构所带来的问题,具有分步训练过程的粗到细网络已广泛应用于图像修复[2527]领域。使用两个连续的神经网络,而不是一个网络扩大感受野,稳定了训练过程[26]。在地震数据处理领域,He等[28]使用多个UNet来提高地震道插值的性能。因此,我们设计了由粗到细的网络,其结构如图1所示。使用UNet作为粗网络,MWCNN作为细网络,图2为粗细网络的详细结构。粗网络和细网络均为U型结构,两者的差异主要是细网络使用离散小波变换代替下采样过程,使用逆小波变换代替上采样过程。

在粗细网络架构中,粗网络使用缺失地震数据Iin=Igt⊙M作为输入(⊙表示Hadamard乘积),返回重建数据的粗略结果Icoa。通过引入二进制掩码,减少了网络需要学习的任务量,加速了网络收

敛。基于Icoa,细网络使用Igt⊙M+Icoa⊙(1-M)作为输入,并返回细网络的重建结果Iref。最终,粗细网络模型的重建结果为I~=Igt⊙M+Iref⊙(1-M)。

在粗细网络训练的第一步,粗网络损失函数Lcoa对粗网络参数θcoa进行偏导计算得到梯度,然后使用反向传播算法将梯度信息从输出层向输入层传递,以更新粗网络参数。在训练的第二步,细网络损

失函数Lref对细网络参数θref和粗网络参数θcoa再次计算梯度,连续更新粗网络与细网络的参数。

1.2 离散小波变换

离散小波变换是一种信号分析工具,它在时域和频域上具有多分辨率分析能力,能将输入数据分解为描述不同频带特征的多个子集。以Haar小波为例,输入图像通过一个低通滤波器fll和三个高通滤波器flh、fhl、fhh进行处理,分解为四个子图xll、xlh、xhl和xhh,分别表示图像在不同方向上的频率特征。这个过程本质上是一种特殊的卷积下采样,具体操作如下:

xll=(fll*x)↓2;

xlh=(flh*x)↓2;

xhl=(fhl*x)↓2;

xhh=(fhh*x)↓2。

(1)

式中:*表示卷积操作;↓2表示步长为2的下采样操作。由于小波变换的正交性,可以通过逆小波变换来精确地重构输入图像。因此,通过引入离散小波变换和逆小波变换来保持卷积层的特征图,可以减小原始数据重建的误差,增强重建模型的性能。

1.3 混合损失

在网络训练过程中,损失函数计算模型前向传播结果与真实值之间的差距,从而指导下一步训练向正确的方向进行。适当的损失函数可以加速模型收敛,更好地度量样本间的相似性。均方误差(MSE)损失作为一种像素级损失函数,广泛用于地震数据重建。如图1所示,本文模型采取两步参数更新策略,基于第一步中粗网络的初步插值,第二步获得比第一步更完整的输入,从而获得更好的特征表示。在第一步,Lcoa选择MSE损失更新粗网络参数。

Igt. 完整地震数据;M. 完整地震数据对应的随机掩码(缺失道设置为0,有效道设置为1);Iin. 输入;Lcoa. 粗网络损失函数;θcoa. 粗网络参数;Icoa. 粗网格重建结果;Lref细网络损失函数;θref细网络参数;Iref细网络重建结果。

单一的MSE损失经常产生过度平滑的结果,不能很好地重建缺失信号的局部峰值和细节。Yu等[20]提出了结合SSIM和L1范数的联合损失,增强了纹理细节,缓解了插值结果过于平滑的问题。SSIM是一种图像质量评估指标,衡量两幅图像之间的细节纹理差异[29]。在处理地震数据重建任务时,可以将数据视为图像形式。因此,对于重建结果x和真值y,他们的SSIM被定义为

SSIM(x,y)=(2μxμy+c1)(2σxy+c2)(μ2x+μ2y+c1)(σ2x+σ2y+c2)。(2)

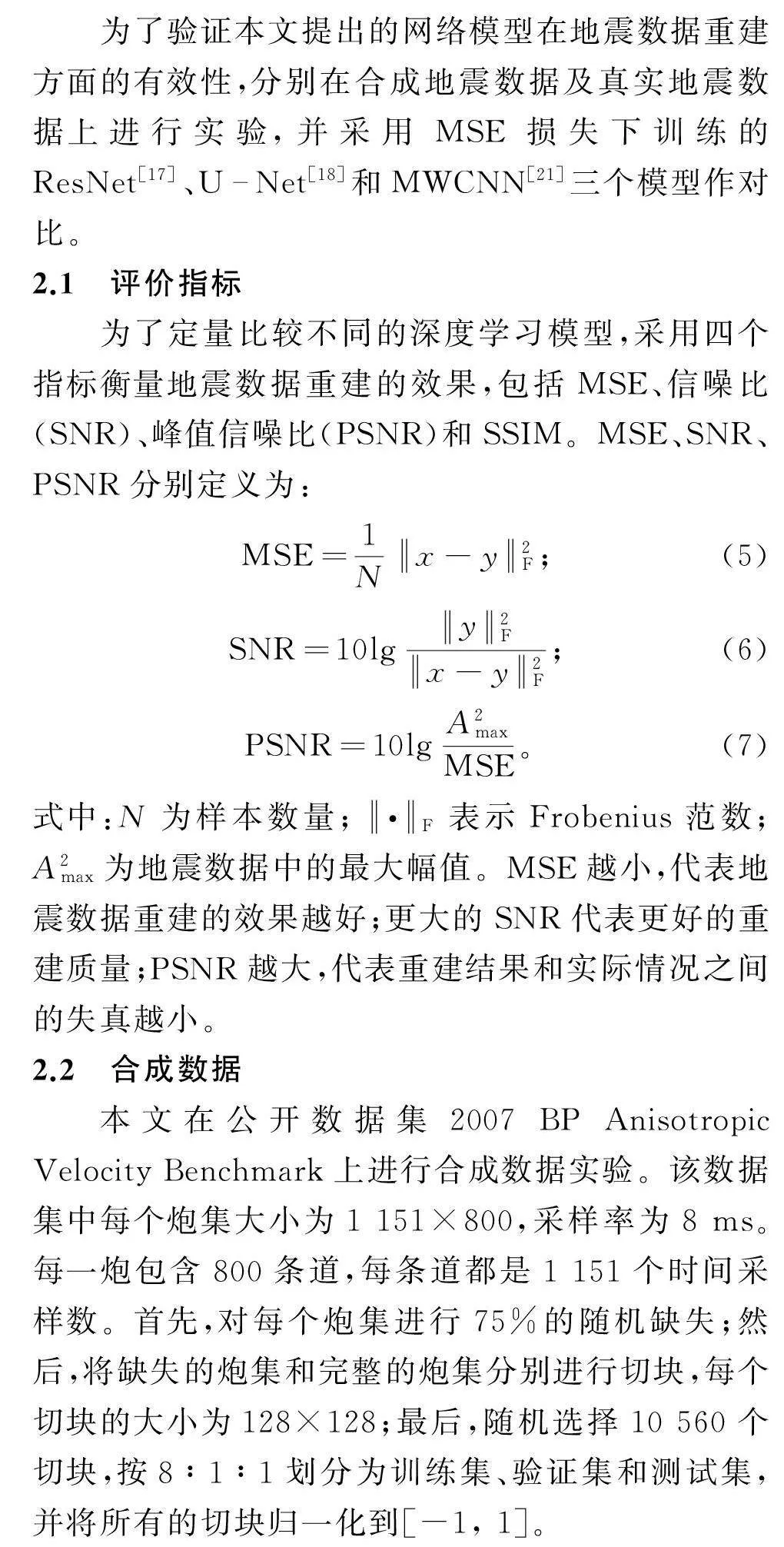

式中:μx和μy分别为x与y的平均值;σx和σy分别为x与y的标准差;σxy为x和y的协方差;c1和c2为常数,用以避免分母为零引起的系统误差。SSIM取值范围为[0, 1],值越大表示x和y之间越有较强的相似性。而地震数据重建的目标是最小化真值和重建结果之间的差异,故SSIM的损失函数被定义为

LSSIM=1-SSIM(x,y)。(3)

结合L1范数的损失函数LL1,最终训练过程中细网络的损失函数为

Lref=λ1Lcoa+λ2LSSIM+λ3LL1。(4)

式中,λ1、λ2和λ3用于调整不同损失的权重。即在第二步,整个模型通过式(4)给出的混合损失进行反向传播,连续更新粗网络与细网络的参数。

2 实验

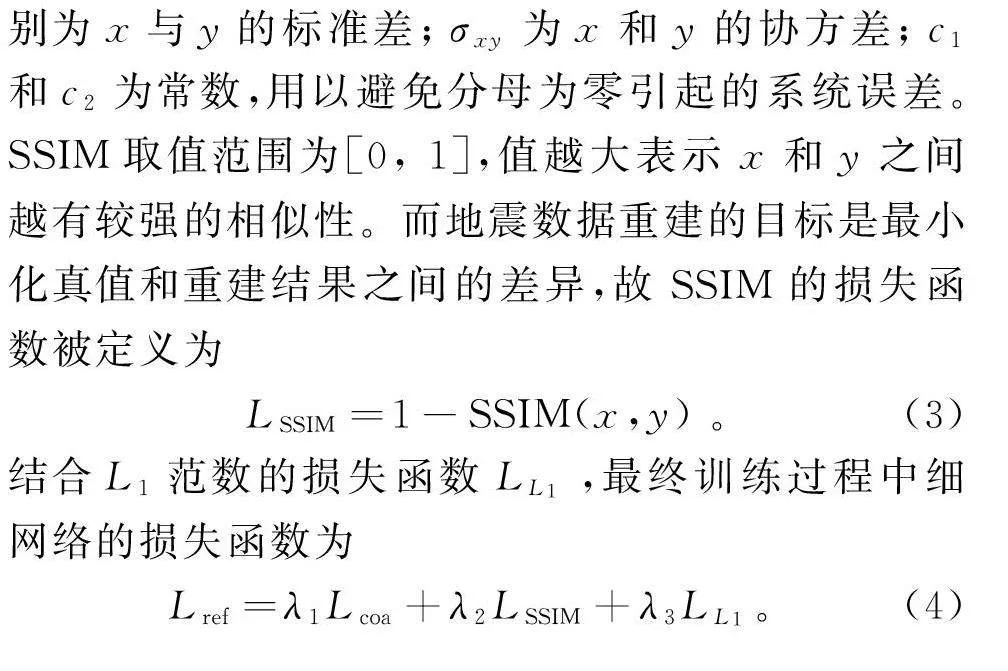

为了验证本文提出的网络模型在地震数据重建方面的有效性,分别在合成地震数据及真实地震数据上进行实验,并采用MSE损失下训练的ResNet[17]、UNet[18]和MWCNN[21]三个模型作对比。

2.1 评价指标

为了定量比较不同的深度学习模型,采用四个指标衡量地震数据重建的效果,包括MSE、信噪比(SNR)、峰值信噪比(PSNR)和SSIM。MSE、SNR、PSNR分别定义为:

MSE=1Nx-y2F;(5)

SNR=10lgy2Fx-y2F;(6)

PSNR=10lgA2maxMSE。(7)

式中:N为样本数量;·F表示Frobenius范数; A2max为地震数据中的最大幅值。MSE越小,代表地震数据重建的效果越好;更大的SNR代表更好的重建质量;PSNR越大,代表重建结果和实际情况之间的失真越小。

2.2 合成数据

本文在公开数据集2007 BP Anisotropic Velocity Benchmark上进行合成数据实验。该数据集中每个炮集大小为1 151×800,采样率为8 ms。每一炮包含800条道,每条道都是1 151个时间采样数。首先,对每个炮集进行75%的随机缺失;然后,将缺失的炮集和完整的炮集分别进行切块,每个切块的大小为128×128;最后,随机选择10 560个切块,按8∶1∶1划分为训练集、验证集和测试集,并将所有的切块归一化到[-1, 1]。

模型的粗网络和细网络都采用Adam优化器,学习率为5×10-4,批量大小设置为32。细网络损失函数的权重λ1、λ2和λ3均设置为1。实验基于PyTorch深度学习框架,在Windows 10的NVIDIA GTX3060下进行。对于合成数据,粗网络和细网络使用批量归一化。通过上下翻转、旋转和放缩等方式进行数据扩充,可以丰富缺失地震数据的类型,提高网络模型的鲁棒性。对比模型ResNet、UNet、MWCNN除了采用MSE损失训练以外,其他参数均与本文模型参数设置一致。

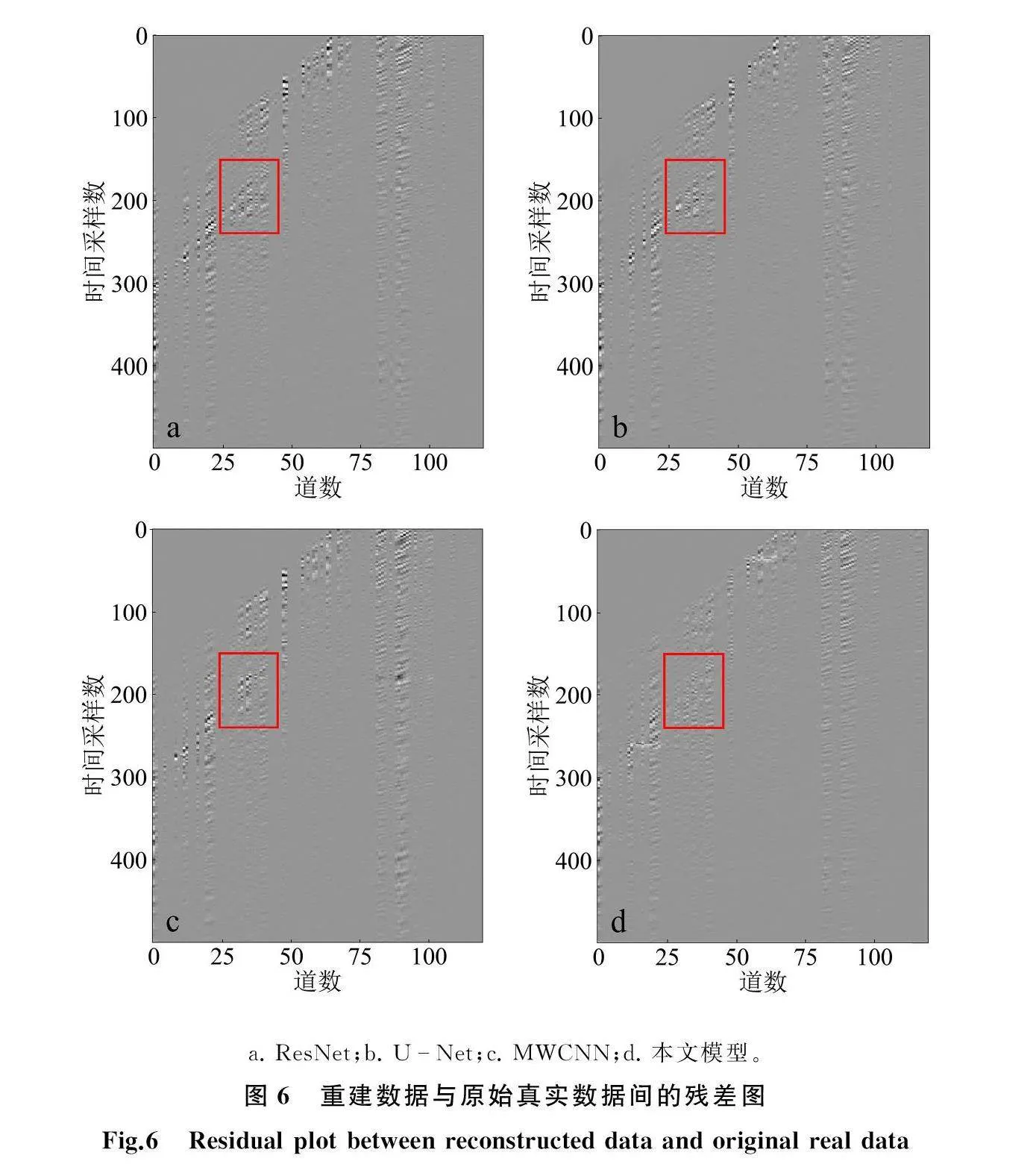

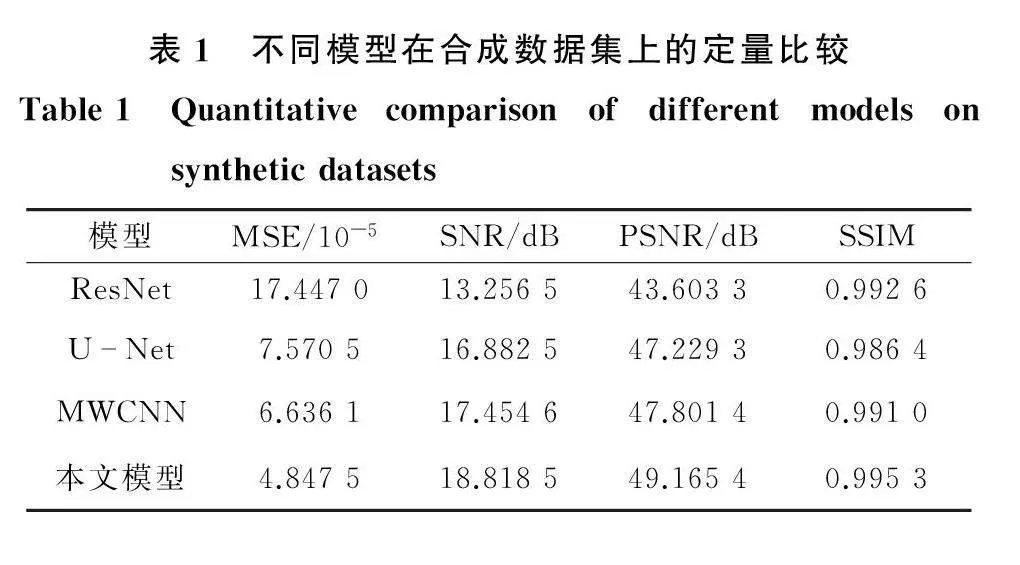

对于ResNet、UNet、MWCNN和本文模型在地震数据上的重建结果,我们分别作定量比较与定性比较。定量比较的结果如表1所示。可以看到,本文模型在所有评估指标上都优于其他方法。

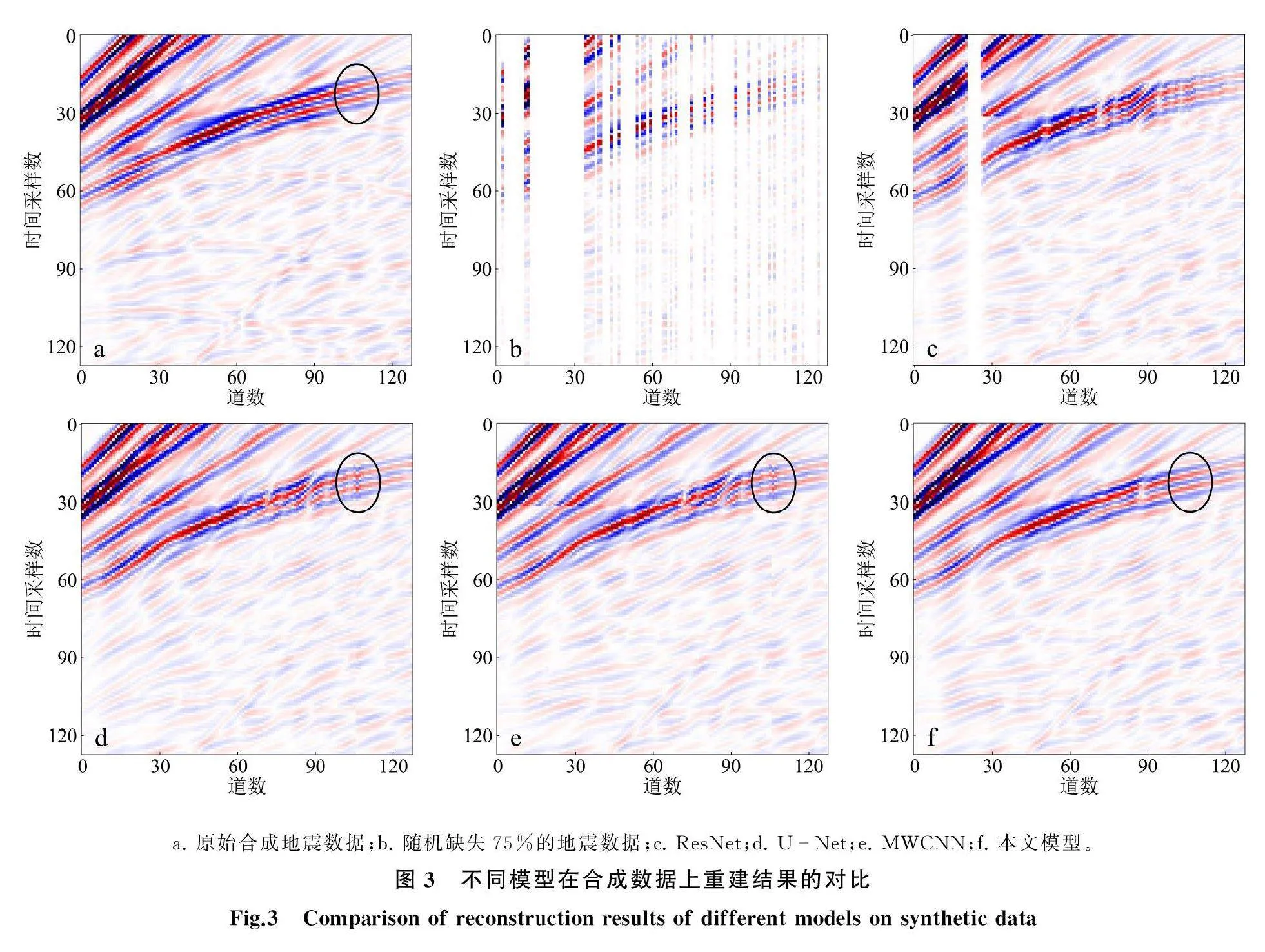

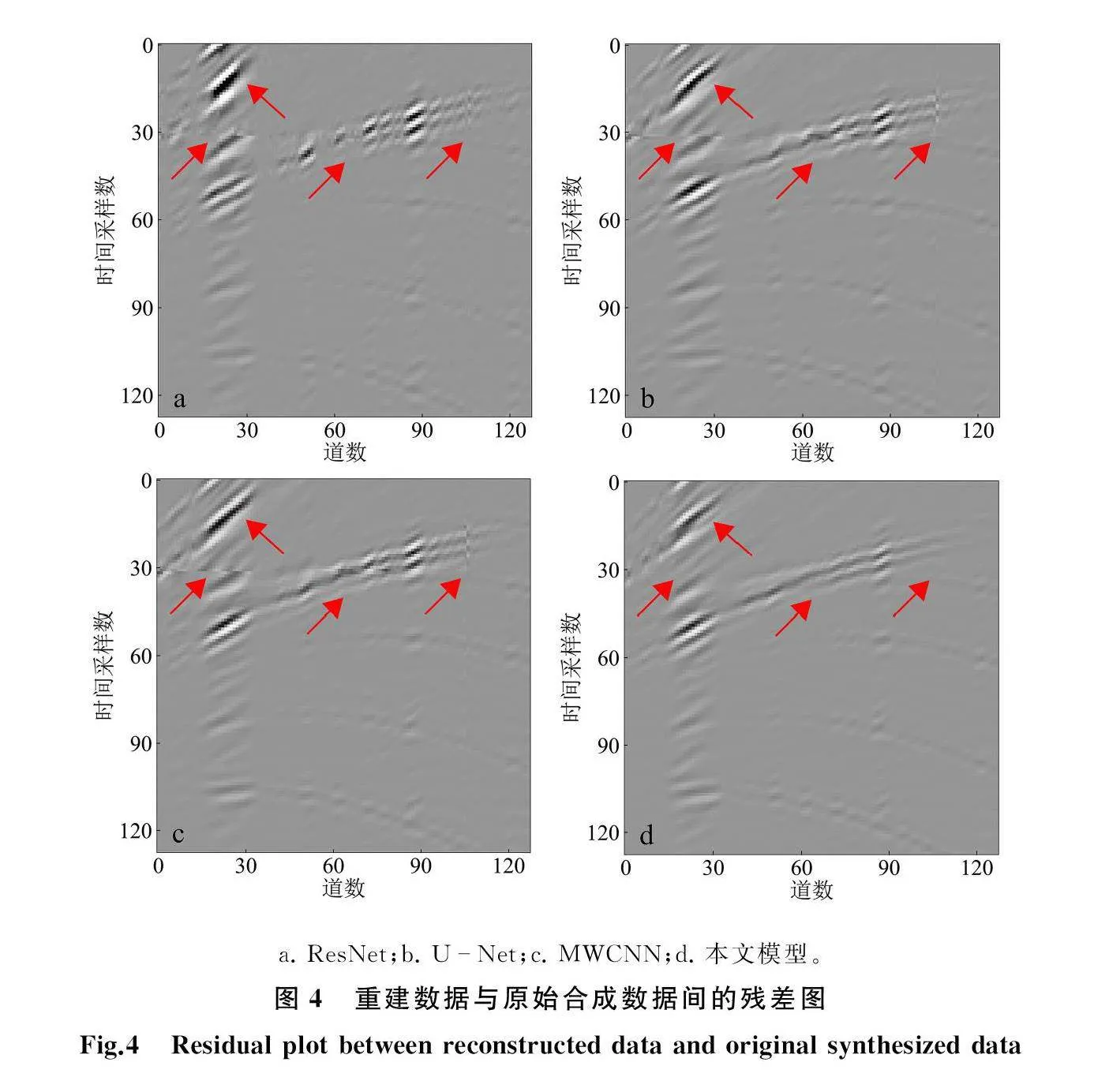

四个模型重建结果的定性比较如图3所示,通过合成数据上的一个测试块展示结果。直观上来看:对于连续缺失区域,ResNet的重建结果不理想,出现了明显的不连续区域;UNet和MWCNN总体上能够实现信号的连续性,但对数据细节的恢复不够完备,例如黑色圆圈所标区域,UNet和MWCNN的重建结果都存在偏差;而本文模型能够较好地恢复缺失数据,重建的信号更加精确。

为了更直观地展示重建效果,将四个模型的重建结果分别与原始数据作残差,结果如图4所示。从图4可以看出,本文模型的重建结果相对其他三个模型有了进一步

改善(红色箭头处)。本文模型的重建结果误差更小,对数据细节的恢复更加完备,生成的纹理更加丰富。

在该合成数据集上,不同模型的训练次数与总时间如表2所示。本文模型训练总时间略高于其他模型,但是达到收敛的训练次数却比其他网络少,这意味着本文模型可以更好地拟合给定数据集,预测效果更好。

2.3 真实数据

在真实数据Mobil Avo Viking Graben Line 12上评估本文方法,该数据集包含1 001个炮集,采样间隔为4 ms。每一炮包含120条道,1 500个时间采样点。对于原始数据和重建数据,选取其中500个时间采样点进行展示。首先,将每个炮集都随机缺失50%的道;然后,将缺失炮集和完整炮集分别进行切块,每个切块的大小为96×96;最后,随机选择11 700个切块,按8∶1∶1划分为训练集、验证集和测试集,并将所有的切块归一化到[-1, 1]。真实数据参数和模型训练均与合成设置相同。

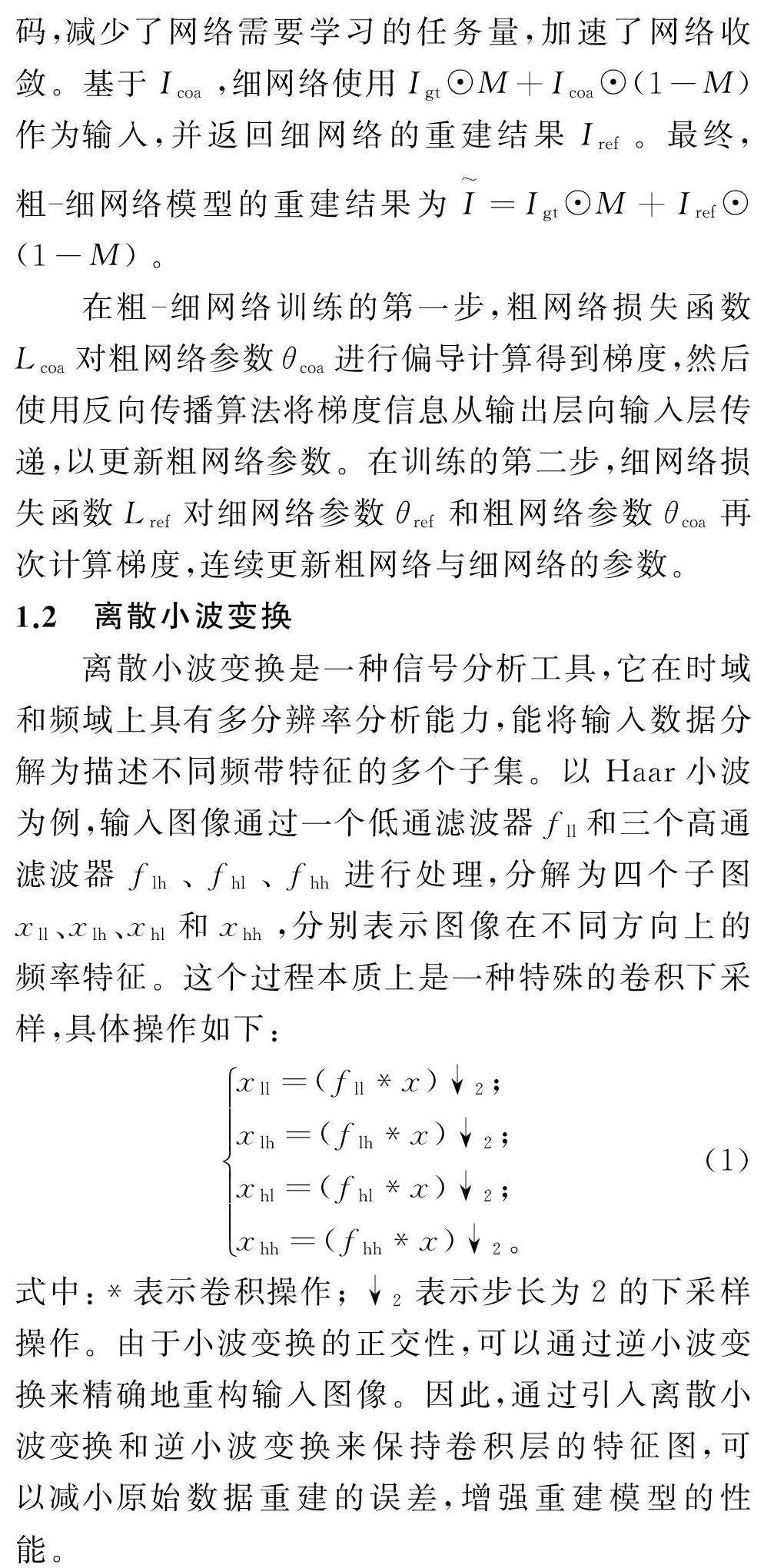

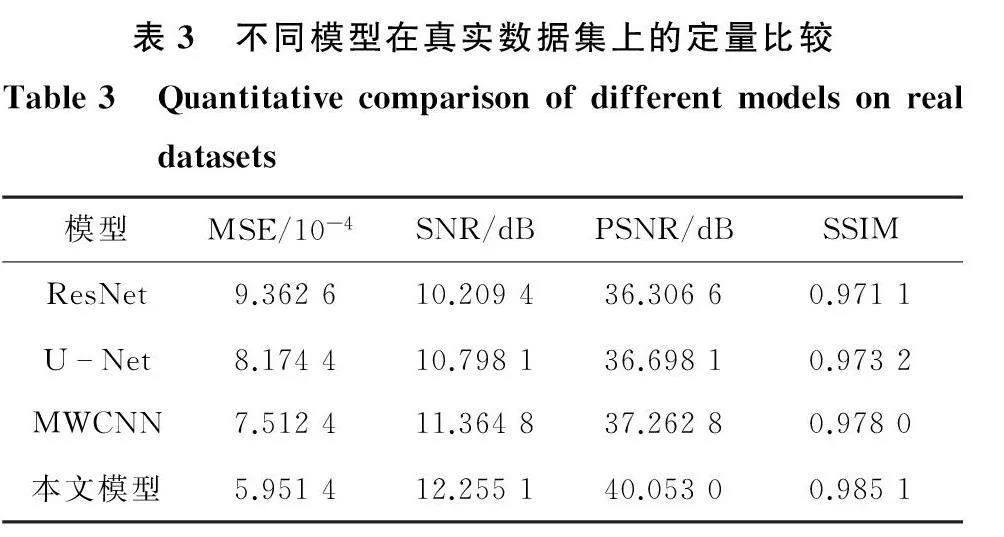

把四个模型在真实地震数据上的重建结果分别做定量与定性比较,定量比较的结果如表3所示。可以看到,本文模型在所有评估指标上都优于其他方法。

四个模型重建结果的定性比较如图5所示,通过真实数据上的一个测试炮集展示结果。四个模型对于缺失区域都在一定程度上重建出了缺失信号,然而对于黑色椭圆的低振幅缺失区域,本文模型的重建信号与原始数据更为接近。

为了更直观地比较四个模型的重建结果,我们展示原始真实数据和重建数据之间的残差,结果如图6所示。可以看到,相比于其他三个模型,本文模型的重建结果具有较浅的阴影和较少的信号损失,

例如方框处;这进一步表明本文模型在地震数据重建方面的有效性。

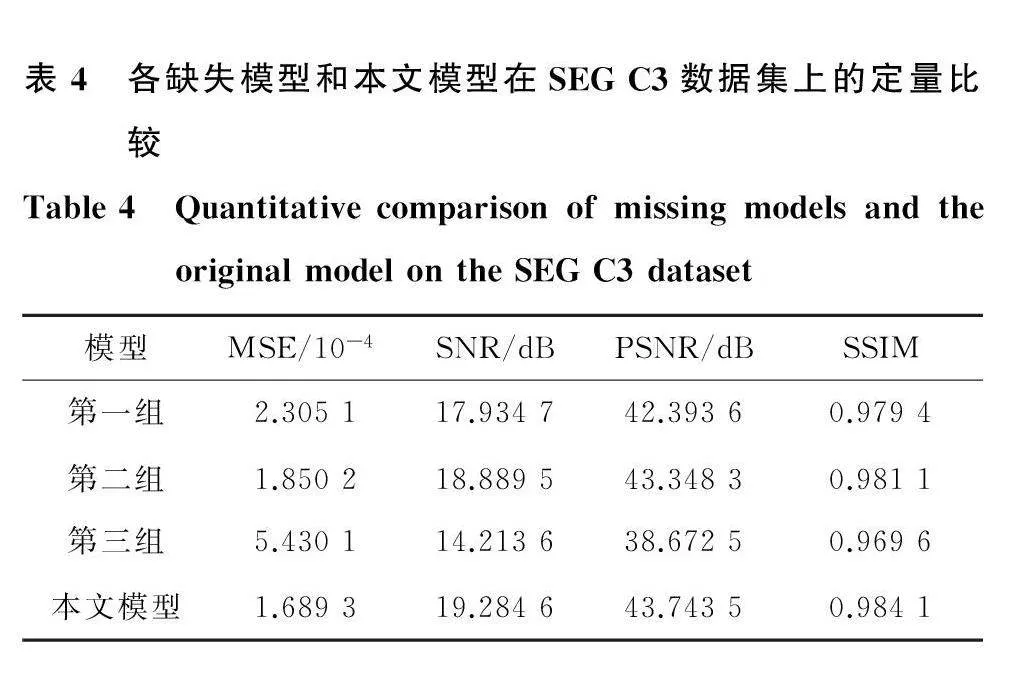

3 消融研究

通过去除或更换模型部分,我们设计了三组对照实验,包括粗网络和细网络的模型选择、训练过程中细网络的损失函数选择和粗细网络的训练过程选择,进一步验证本文模型的优越性。

第一组对照实验粗网络和细网络都使用UNet,以验证本文模型细网络使用离散小波变换替代采样过程的合理性。第二组对照实验粗网格损失不参与细网格损失进行反向传播,以证明本文模型细网络损失函数设计的合理性。第三组对照实验粗细网络采用一步训练过程,只由式(4)给出的混合损失进行反向传播,更新粗细网络的参数,以证明本文模型粗细网络训练过程的合理性。

在数据集SEG Advanced Modeling Program’s C3 Project(SEG C3)上进行消融研究,将控制变量设计的三组对照实验与本文模型进行对比,定量比较结果如表4所示。可以看到,本文模型在所有评估指标上都优于其他模型,证明了本文模型在地震数据重建任务中的优越性。

4 结论

1)本文提出具有分步训练过程的粗细网络模型用于地震数据重建,由粗到细两个网络逐步恢复缺失信号,由粗网络损失、结构相似性损失和L1损失构成的混合损失函数引导细网络进一步关注缺失信号,增强纹理细节,提升插值效果。

2)合成数据和真实数据的实验结果表明,本文模型与目前最先进方法的定量比较、定性比较都获得了更好的重建性能。

3)三组消融实验验证了网络模型和损失函数设置的合理性和缺失信号重建的有效性。

4)本文方法在训练过程中计算时间较长,如何在保证高精度的条件下提高计算效率也是另一个研究方向。

参考文献(References):

[1] Fomel S. Seismic Reflection Data Interpolation with Differential Offset and Shot Continuation[J]. Geophysics, 2003, 68(2): 733744.

[2] Ma J W, Plonka G, Chauris H. A New Sparse Representation of Seismic Data Using Adaptive Easy-Path Wavelet Transform[J]. IEEE Geoscience and Remote Sensing Letters, 2010, 7(3): 540544.

[3] Naghizadeh M, Sacchi D. Beyond Alias Hierarchical Scale Curvelet Interpolation of Regularly and Irregularly Sampled Seismic Data[J]. Geophysics, 2010, 75(6): 189202.

[4] 杨帆,王长鹏,张春霞,等. 基于联合加速近端梯度和对数加权核范数最小化的地震数据重建[J]. 吉林大学学报(地球科学版),2023,53(5):15821592.

Yang Fan, Wang Changpeng, Zhang Chunxia, et al. Seismic Data Reconstruction Based on Joint Accelerated Proximal Gradient and Log-Weighted Nuclear Norm Minimization[J]. Journal of Jilin University (Earth Science Edition), 2023, 53 (5): 15821592.

[5] Naghizadeh M, Sacchi M. Multidimensional De-Aliased Cadzow Reconstruction of Seismic Records[J]. Geophysics, 2013, 78(1): 15.

[6] Yu J, Wu B. Attention and Hybrid Loss Guided Deep Learning for Consecutively Missing Seismic Data Reconstruction[J]. IEEE Geoscience and Remote Sensing Letters, 2022, 60: 18.

[7] Wang B, Zhang N, Lu W, et al. Deep-Learning-Based Seismic Data Interpolation: A Preliminary Result[J]. Geophysics, 2019,84(1): 1120.

[8] 张岩,刘小秋,李杰,等. 基于时频联合深度学习的地震数据重建[J]. 吉林大学学报(地球科学版),2023,53(1):283296.

Zhang Yan, Liu Xiaoqiu, Li Jie, et al. Seismic Data Reconstruction Based on Joint Time-Frequency Deep Learning[J]. Journal of Jilin University (Earth Science Edition), 2023, 53 (1): 283296.

[9] Fang W, Fu L, Zhang M, et al. Seismic Data Interpolation Based on UNet with Texture Loss[J]. Geophysics, 2021, 86(1): 4154.

[10] Wu X, Yan S, Bi Z, et al. Deep Learning for Multidimensional Seismic Impedance Inversion[J]. Geophysics, 2021, 86(5): 735745.

[11] Chen H, Gao J, Zhang W, et al. Seismic Acoustic Impedance Inversion via Optimization-Inspired Semisupervised Deep Learning[J]. IEEE Geoscience and Remote Sensing Letters, 2022, 60: 111.

[12] Wu X, Shi Y, Fomel S, et al. FaultNet3D: Predicting Fault Probabilities,Strikes,and Dips with a Single Convolutional Neural Network[J]. IEEE Geoscience and Remote Sensing Letters, 2019, 57(11): 91389155.

[13] Liu N, He T, Tian Y, et al. Common-Azimuth Seismic Data Fault Analysis Using Residual Unet[J]. Interpretation, 2020, 8(3): 2537.

[14] 李盼池,石彤,李学贵. 基于循环神经网络的微地震数据降噪方法[J]. 吉林大学学报(理学版),2022,60(3):685696.

Li Panchi, Shi Tong, Li Xuegui. Denoising Method for Microseismic Data Based on Recurrent Neural Network[J].Journal of Jilin University (Science Edition), 2022, 60(3): 685696.

[15] 刘霞,孙英杰. 基于融合残差注意力机制的卷积神经网络地震信号去噪[J]. 吉林大学学报(地球科学版),2023,53(2):609621.

Liu Xia, Sun Yingjie. Seismic Signal Denoising Based on Convolutional Neural Network with Residual and Attention Mechanism[J]. Journal of Jilin University (Earth Science Edition), 2023, 53 (2): 609621.

[16] Wang Y, Wang B, Tu N, et al. Seismic Trace Interpolation for Irregularly Spatial Sampled Data Using Convolutional Autoencoder[J]. Geophysics, 2020, 85(2): 119130.

[17] Wang B F, Lu W K, Geng J H, et al. Seismic Data Interpolation Using Deep Learning Based Residual Networks[C]//80th EAGE Conference and Exhibition. [S. l.]: EAGE, 2018: 15.

[18] Chai X T, Gu H M, Li F, et al. Deep Learning for Irregularly and Regularly Missing Data Reconstruction[J]. Scientific Reports, 2020, 10(1): 118.

[19] Chang D K, Yang W Y, Yong X S, et al. Generative Adversarial Networks for Seismic Data Interpolation[C]//2018 SEG Maximizing Asset Value Through Artificial Intelligence and Machine Learning Workshop. Beijing: China University of Geosicences, 2018: 4043.

[20] Yu J X, Wu B Y. Attention and Hybrid Loss Guided Deep Learning for Consecutively Missing Seismic Data Reconstruction[J]. IEEE Transactions on Geoscience and Remote Sensing, 2022, 60: 5902108. Doi: 10.1109/TGRS. 2021.3068279.

[21] Liu P J, Zhang H Z, Zhang K, et al. Multi-Level Wavelet-CNN for Image Restoration[C]//IEEE/CVF Conference on Computer Vision and Pattern Recognition Workshops. Salt Lake: Institute of Electrical and Electronics Engineers, 2018. doi: 10.1109/CVPRW.2018. 00121.

[22] Ronneberger O, Fischer P, Brox T. UNet: Convolutional Net-Works for Biomedical Image Segmentation[C]//International Conference on Medical Image Computing and Computer-Assisted Intervention. Berlin: Springer International Publishing, 2015: 234241.

[23] Zhang R. Making Convolutional Networks Shift- Invariant Again[C]//Proceedings of the 36th International Conference on Machine Learing.

Long Beach:[s.n.], 2019: 73247334.

[24] Zhao H, Gallo O, Frosio I, et al. Loss Functions for Image Restoration with Neural Networks[J]. IEEE Trans Comput Imag, 2017, 3(1): 4757.

[25] Yi Z, Tang Q, Azizi S, et al. Contextual Residual Aggregation for Ultra High-Resolution Image Inpainting[C]//Computer Vision and Pattern Recognition. Seattle: Institute of Electrical and Electronics Engineers, 2020: 75087517.

[26] Yu J, Lin Z, Yang J, et al.Generative Image Inpainting with Contextual Attention[C]// Computer Vision and Pattern Recognition. Salt Lake: Institute of Electrical and Electronics Engineers, 2018: 55055514.

[27] Yu J, Lin Z, Yang J, et al.Free-Form Image Inpainting with Gated Convolution[C]// International Conference on Computer Vision. Seoul: Institute of Electrical and Electronics Engineers, 2019: 44714480.

[28] He T, Wu B, Zhu X. Seismic Data Consecutively Missing Trace Interpolation Based on Multistage Neural Network Training Process[J]. IEEE Geoscience and Remote Sensing Letters, 2022, 19: 15.

[29] Wang Z, Bovik C, Sheikh R, et al. Image Quality Assessment: From Error Visibility to Structural Similarity[J]. IEEE Trans Image Process, 2004, 13(4): 600612.