基于梯度引导加权‒延迟负梯度衰减损失的长尾图像缺陷检测

2023-10-21李巍梁斯昕张建州

李巍,梁斯昕,张建州

基于梯度引导加权‒延迟负梯度衰减损失的长尾图像缺陷检测

李巍*,梁斯昕,张建州

(四川大学 计算机学院,成都 610065)( ∗ 通信作者电子邮箱wana@stu.scu.edu.cn)

针对目前图像缺陷检测模型对长尾缺陷数据集中尾部类检测效果较差的问题,提出一个基于梯度引导加权‒延迟负梯度衰减损失(GGW-DND Loss)。首先,根据检测器分类节点的累积梯度比值分别对正负梯度重新加权,减轻尾部类分类器的受抑制状态;其次,当模型优化到一定阶段时,直接降低每个节点产生的负梯度,以增强尾部类分类器的泛化能力。实验结果表明,在自制图像缺陷数据集和NEU-DET(NEU surface defect database for Defect Detection Task)上,所提损失的尾部类平均精度均值(mAP)优于二分类交叉熵损失(BCE Loss),分别提高了32.02和7.40个百分点;与EQL v2(EQualization Loss v2)相比,分别提高了2.20和0.82个百分点,验证了所提损失能有效提升网络对尾部类的检测性能。

长尾数据集;累计梯度比值;加权损失;图像缺陷检测;卷积神经网络

0 引言

随着全球信息化的发展,图像由于它的便利性和生动性逐渐成为新一代信息表达的主要方式。在图像的生成和传输过程中,由于电流电压不稳定或者线路传输故障等原因,很容易导致最终呈现的画面出现各种缺陷[1],这些图像缺陷包括但不限于坏点、亮度异常、偏色、马赛克、图像噪声等。图像缺陷检测[2]旨在发现图像中的外观瑕疵,是保障图像质量、满足用户需求的重要技术之一。

以往的图像缺陷检测主要通过人工目测实现,然而传统的人工巡检方法存在较大不足:首先人力成本过高且耗时长;其次人的判断具有强烈的主观性,没有一个具体量化的标准;再次人在长时间工作下还会产生误判、漏判等问题。基于传统图像处理的工业缺陷检测算法[3-5]由于速度快、精度高,并且极大地减少了人工干预,得到较大发展和应用;但是这些算法大多针对特定的场景,特征提取过程繁琐,而且无法适应背景复杂多变的缺陷类型。基于深度学习的缺陷检测方法[6-8]不仅能适应多变的工业场景,也避免了复杂的人工特征设计,同时保持较高的速度和精度,具有非常重要的研究价值和广阔的应用前景。

与通用的目标检测任务相比,缺陷检测需要考虑具体的任务需求和数据样本的获取情况。在图像缺陷检测任务中,正常样本居多,因此可用于训练的缺陷图像较少;此外在不同的应用场景采集的数据集,各类别间的缺陷图像样本数也可能相差较大。例如,对于某些图像捕获设备,由于图像传感器光线采集点的异常造成的坏点发生率远大于其他类型的图像缺陷,而在经由某些劣质传输介质的图像传输设备中,搜集的缺陷主要是噪声类型。因此,对于大多图像缺陷检测任务,数据集稀缺且呈现长尾分布,直接在长尾数据集上进行缺陷检测训练将面临较大的挑战,尤其是尾部类。一方面,头部类占据了数据集的绝大部分,主导了训练的过程;另一方面,由于尾部类自身缺乏足够的数据输入,使得模型对尾部类学习不充分。

基于以上问题,本文提出一个新的损失函数——梯度引导加权‒延迟负梯度衰减损失(Gradient-Guide Weighted-Deferred Negative Gradient decay Loss, GGW-DND Loss),以提升缺陷检测模型在应用该损失函数后对尾部类的检测效果。

本文的主要工作如下:

1)根据检测模型中分类器节点提取的累计梯度比值粗略地估计不同类别实例的分布情况,平衡不同分类节点每次产生的正负梯度,强调尾部类相关节点的学习过程。

2)对训练后期冗余的负梯度作衰减处理,避免尾部类由于正样本过少产生的过拟合和弱泛化问题。

3)与当下主流的损失函数进行实验比较,在应用GGW-DND Loss后,图像缺陷检测模型对尾部类的检测效果提升明显。

1 相关工作

1.1 缺陷检测

在机器视觉任务中,缺陷的定义[9]通常是一个主观的概念,不同的检测任务具有不同的检出目标。缺陷检测常用于发现各种工业制品的外观缺陷,包括织物、材料、药品、芯片和建筑等。根据不同的缺陷认知模式检测手段分为两种。第一种是根据已有的缺陷样本,总结缺陷出现的位置和表现形式,它与传统意义上的目标检测任务最相似。根据是否产生区域建议,主流的缺陷模式已知的深度学习缺陷检测分为一阶段目标检测[10-12]和两阶段目标检测[6-8]。两阶段目标检测在输入图像经过骨干网络的特征图上生成区域建议,将生成的候选区域提取特征分别送入分类器和回归器;而一阶段目标检测则直接在骨干网络输出的特征图上同时作分类和回归。第二种缺陷检测的方法是利用无标注样本或正常样本构建检测模型,通过分析异常样本与正常样本之间的差异程度检测缺陷。基于深度学习的异常检测技术包括距离度量[13-15]、分类面构建[16]、图像重构[17-19]和结合传统技术的混合方法[20-22]。一方面,距离度量和分类面构建的方法均对正常样本存在的特征空间分布有着严格要求,因此不适用于图像等复杂背景的缺陷检测。例如,Ruff等[13]提出深度支持向量数据描述(Deep Support Vector Data Description, DSVDD)方法,假设正常样本在特征空间中存在单峰分布,但是这在复杂多变的医学图像或自然图像上很难保证。另一方面,图像重构的异常检测方法存在重构模糊、对缺陷样本过拟合的隐患和优化困难等问题。例如,Gong等[23]在自编码器基础上,使用记忆模块存储具有代表性的特征向量,虽然提高了模型对异常样本过强的适应能力,但是显著提高了空间存储要求,而且对于自然图像仍然存在重构模糊问题;Schlegl等[24]提出AnoGAN(Anomaly detection with Generative Adversarial Network)模型,通过迭代优化重构图像显著提升了图像质量,但是它的效率较低,难以应用在实时监测任务。基于以上分析,针对图像缺陷检测任务,本文考虑从已知缺陷样本出发,训练一个缺陷检测网络。

1.2 长尾目标检测

图像缺陷检测与目标检测仍存在些许不同。首先,模型最终取得的性能很大程度上与可供训练的样本数有关。通常用于目标检测的数据集,如COCO(Common Objects in COntext)数据集[25]、VOC(Visual Object Class)数据集[26]等,包含了大量的可供训练的实例样本;而在缺陷检测中,实际获取的缺陷样本数有限。其次,目标检测数据集中的图片经过人工精心挑选后,每个类别的样本实例数相对均衡;而在实际图像缺陷检测中,不同场景下采集的缺陷样本在不同类别中通常表现极端地不平衡。

在目标检测子领域也有针对这种数据不平衡现象的研究,即长尾目标检测。目前缓解此类类别样本不平衡的方法主要有重采样、加权损失和迁移学习。重采样方法根据采样对象具体可以分为对头部类作欠采样[27-29]和对尾部类作过采样[27,30-31]。Chawla等[32]详细分析了重采样方法的缺陷,指出当数据极度不平衡时,欠采样会导致数据严重不足,而过采样则会导致模型对小部分类产生过拟合,两种方法均不能取得较理想的结果。加权损失通过为类级别[33-37]或实例级别[38-40]样本赋予自适应权重,影响反向传播中的参数更新。自适应权重通常以数据集中各类样本的频率为参考,多数研究也是在此基础上展开。如Cui等[33]强调在类别损失计算中添加有效样本数量参数;Cao等[37]考虑给予尾部类更大的分类边界和一种延迟加权的训练策略。迁移学习的方法[41-43]则是将从头部类丰富的数据中学习的特征知识迁移到尾部类,以弥补尾部类数据的不足。Yin等[41]提出基于中心的特征迁移方法,解决了部分受试者样本不足的问题,但是这类方法只适用于特定领域,如人脸识别,对复杂多变的自然场景收效甚微。Liu等[42]采用动态元嵌入的方法将视觉记忆库中的记忆特征和直接学习的观察特征进行融合与调整,但是较难生成视觉记忆库。

2 梯度引导加权-延迟负梯度衰减损失

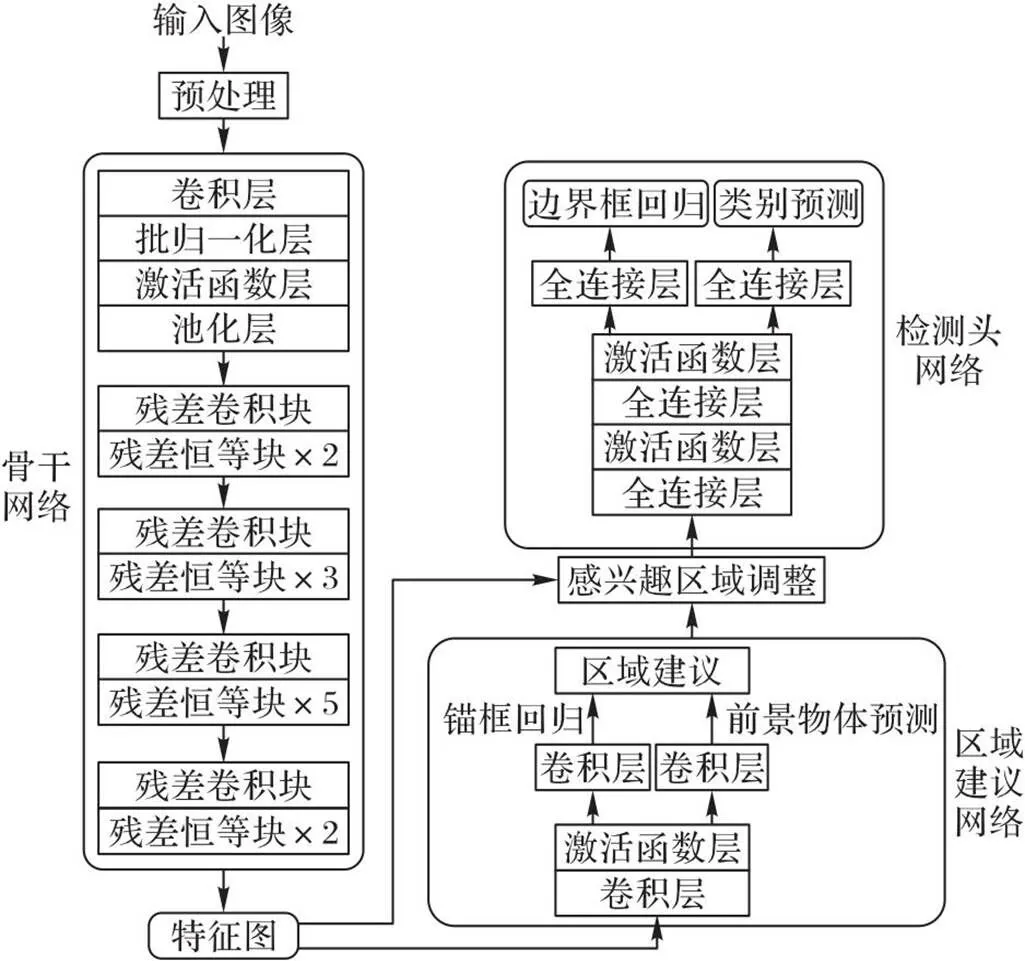

本文实验均基于两阶段目标检测框架Faster R-CNN(Faster Region-based Convolutional Neural Network)[44],它的基本网络结构如图1所示。输入图片经过预处理后,送入骨干网络提取特征图,其中骨干网络为具备残差连接的残差网络ResNet-50(Residual Network-50)[45],由卷积层、批归一化(Batch Normalization, BN)层、修正线性单元(Rectified Linear Unit, ReLU)激活函数层、池化层(最大池化)、残差卷积块(残差网络中用于改变输出维度的基本模块)和残差恒等块(残差网络中用于保持输出维度的基本模块)组成。区域建议网络(Region Proposal Network, RPN)[44]将特征图作为输入,首先经过一组公共的卷积层和ReLU激活函数层;其次基于预定义的锚框生成相应的区域建议,其中上分支用于判断锚框中是否存在前景目标,下分支用于对锚框的边界进行回归;最后,将区域建议和特征图经过感兴趣区域调整(Region Of Interest Align, ROI Align)[46]池化后送入检测头网络。检测头网络共用两组全连接层和ReLU激活函数层,再分别送入一次全连接层后进行类别预测和边界框回归。

图1 Faster-RCNN的基本网络结构

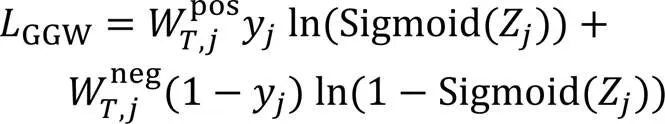

图2为现有缺陷检测网络中,检测头网络中类别预测对单个输出向量计算损失的过程。在得到单个逻辑输出向量后,通过Sigmoid函数将它转换为各类别的概率分布预测,再与真实标签计算交叉熵损失。本文简单地将检测头的类别预测网络看作一个多分类网络,对于每个RPN输出的候选区域实例,只有一个与标签对应类别处的逻辑输出值需要产生较高的分数,而其他类别需要产生较低的分数。即为了尽可能在标签对应类别处生成最大预测值,此类别相关的神经元应当更有可能被激活;相应地,其他神经元应当遭到抑制。

图2 基于GGW-DND Loss的类别预测网络

2.1 梯度引导加权损失

为了解决上述问题,早期的通用做法是将数据集中各类别实例数占总实例数之比作为损失函数调节因子。然而,由于网络输入的多样性和难易样本的存在,各样本对损失函数的贡献也不同,例如,对于简易样本,与其他样本实例数的差异并不会过多地影响最终检测效果。Focal Loss[38]利用预测输出与真实标签的相近程度,在考虑正负样本失衡的同时,顾及了模型对于难易样本的学习。本文则观察样本数和样本难易程度共同作用的指标——反向传播的累计梯度[47]。

通常情况下,数据集中实例数的不足将导致尾部分类器节点的累计梯度比值长期远小于1。大量的正负梯度差异将导致分类器节点的更新长期遭到抑制,不利于后续的分类测试。因此,依据各分类器节点的累积梯度比值对后续反向传播中的正负梯度进行加权,本文称为梯度引导加权损失(Gradient-Guide Weighted Loss, GGW Loss)。

2.2 延迟负梯度衰减损失

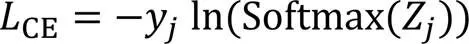

交叉熵损失(Cross Entropy Loss, CE Loss)[33]和二分类交叉熵损失(Binary Cross Entropy Loss, BCE Loss)[33]是常见的用于分类器中计算损失的函数。如式(6)~(7)所示,BCE Loss与CE Loss中将分类器逻辑输出向量转换为各类别概率输出向量所采用的激活函数:CE Loss采用Softmax函数,而BCE Loss采用Sigmoid函数。CE Loss假定每个输入样本只对应一个真实类别,因此通过Softmax函数计算的概率值之间相互关联且互斥;而BCE Loss将多分类任务看作多个独立的二分类任务,通过Sigmoid函数计算的概率值之间相互独立。根据前文分析,如果在训练阶段,长期抑制尾部分类器节点的激活状态,则在测试阶段,它的预测值也将偏低。如果采用带有互斥性质的Softmax函数与CE Loss作为损失函数,将无法有效改善尾部分类器节点的受抑制状态,因此本文选择BCE Loss。

根据文献[37],在对学习率衰减之前,使用BCE Loss或者CE Loss的算法生成的特征优于重新加权算法和重采样算法。本文采用此设置,将训练过程中引入ND Loss的时机推迟到学习率衰减之后,计算过程仍参考式(9)。因此,本文将统一使用延迟负梯度衰减损失(Deferred Negative gradient Decay Loss, DND Loss)代替ND Loss。

2.3 梯度引导加权‒延迟负梯度衰减损失

在2.1节中,GGW Loss利用累计梯度比值对正负梯度加权;在2.2节中,DND Loss对训练后期的负梯度进行缩放处理。将两个损失函数结合可以得到梯度引导加权‒延迟负梯度衰减损失(GGW-DND Loss),计算过程如下:

3 实验与结果分析

3.1 数据集

为了验证GGW-DND Loss的有效性,本文分别基于自定义的图像缺陷检测数据集和NEU-DET(NEU surface defect database for Defect dEtection Task)数据集[48]展开实验。自定义的图像缺陷检测数据集共包含6种典型的图像缺陷:马赛克、偏色、亮度异常、高斯噪声、椒盐噪声和坏块。训练集共包含2 900张图像,每张图像至少包含1种指定类型的缺陷,但也可能包含其他类型的缺陷。前3种缺陷类型各有2 000张图像,后3种缺陷类型各有20张图像,不同类型的图像缺陷样本如图3所示。验证集共包含300张图像,每种类型的缺陷各搜集了200张图像,并且在该验证集上比较检测结果。NEU-DET数据集中包含了热轧钢带场景下6种典型的表面缺陷:银纹(Crazing)、夹杂物(Inclusion)、斑块(Patches)、麻点表面(Pitted_surface)、轧入氧化皮(Rolled-in_scale)和划痕(Scratches)。该数据集对每种缺陷均搜集了300个样本,各缺陷实例数最多为981个,最少为430个。

3.2 设置

3.2.1评估指标

在对长尾缺陷检测数据集训练后,本文在相应的平衡验证数据集上评估检测模型,并报告所有类的平均精度均值(mean Average Precision, mAP)。此外,参考文献[35],本文额外根据每个类的训练样本数将这些类划分成两组:头部类和尾部类,并分别报告每组的mAP值用于比较。为作区分,定义头部类的平均精度均值为mAPf;尾部类的平均精度均值为mAPr。

3.2.2实施细节

3.3 与其他缺陷检测模型比较

本节主要对比了主流缺陷检测模型在面临图像缺陷检测数据集存在长尾现象时的表现。

在实验中,二阶段缺陷检测模型Faster R-CNN采用ResNet-50作为骨干网络,设置它的分类器分别基于CE Loss、BCE Loss计算损失,并报告评估指标。SSD(Single Shot multibox Detector)[50]与YOLOv5[51]是典型的一阶段缺陷检测模型,直接从输入图像中学习深度特征并预测类别和边界框。本文设置SSD的骨干网络为VGG-16(Visual Geometry Group-16)[52],分类器损失函数为CE Loss;设置YOLOv5的骨干网络为CSP-DarkNet(Cross Stage Partial-Dark Network)[53],分类器损失函数为BCE Loss。

从表1可以看出,直接在不平衡缺陷数据集上训练时,基于CE Loss和BCE Loss作为分类器损失函数的Faster R-CNN对于尾部类的检测指标mAPr均优于SSD和YOLOv5,即二阶段缺陷检测模型Faster R-CNN对尾部类的检测精度相较于一阶段缺陷检测模型具有一定的优势,因此本文后续将基于Faster R-CNN进行实验。

表1 不同缺陷检测网络的检测结果对比 单位:%

3.4 与其他损失函数比较

将GGW-DND Loss与多种当前主流的应用于长尾数据集学习的损失函数进行对比实验。对比损失函数包括:

1)CE Loss[33]。通过Softmax函数预测类别概率,并回传预测向量中真实标签为1处的梯度。

2)BCE Loss[33]。通过Sigmoid函数预测类别概率,并对整个预测向量进行梯度回传;

3)Focal Loss[38]。从损失函数中样本难易分类角度出发,解决样本非平衡带来的模型训练问题;

4)Logit Adjustment[54]。基于标签频率扩大逻辑输出向量中头部类与尾部类之间的差值。

5)EQL(EQualization Loss)[55]。简单地忽略稀有类别的梯度解决长尾问题。

6)BAGS(BAlanced Group Softmax)[40]。将标签分组,通过分组训练平衡检测框架内的分类器。

7)EQL v2[47]。根据累计梯度比值对训练过程中的正负梯度进行动态重新加权,平等地重新平衡每个类别的训练过程。

如表2所示,Focal Loss在极端的数据不平衡的场景下,对尾部类的检测效果较差;Logit Adjustment和EQL在一定程度上都能提升对尾部类的检测;BAGS在原始模型上通过微调适应尾部类的学习,但在缺陷检测训练集数量有限的前提下,不能取得很好的结果;EQL v2依据历史正负梯度比值对本轮批次的梯度作加权,取得了较好的结果;GGW-DND Loss在mAPr上取得了最优值,相较于BCE Loss和EQL v2,分别提高了32.02和2.20个百分点。

表2 基于不同损失函数的检测结果对比 单位:%

3.5 超参选择

本文共涉及2个损失函数、4个超参数。下文对应用GGW-DND Loss的Faster R-CNN在不同超参数组合下的缺陷检测性能作比较。

图4 不同和组合下的映射函数

Fig. 4 Mapping functions under different combinations of and

表3 不同组合参数和下的检测结果

表4 不同下的检测结果

表5 不同下的检测结果

图5 不同下缩放后的对应负梯度

3.6 损失函数分析

表6为将Faster R-CNN中分类器损失函数分别设置为BCE Loss和GGW-DND Loss后各分类节点的累计梯度比值。其中:前3类(马赛克、偏色和亮度异常)的样本在数据集中较多,属于头部类;后3类(高斯噪声、椒盐噪声和坏块)的样本在数据集中较少,属于尾部类。从表6可知,采用BCE Loss后,头部类与尾部类分类器节点之间的累计梯度比值差异较大;而采用GGW-DND Loss后,各节点之间的累计梯度比值差距明显缩小。

表6 基于BCE Loss和GGW-DND Loss的分类器节点的累计梯度比值

3.7 消融实验

表7 消融实验结果 单位:%

3.8 NEU-DET数据集上的实验

为了验证本文所提损失函数对不同数据集的泛化性,遵循文献[37]中的设置,本文制作了NEU-DET的长尾版本的训练集,具体情况如表8所示。

表8 NEU-DET数据集

表9 NEU-DET数据集上基于不同损失函数的检测结果比较 单位:%

4 结语

本文从实际应用角度出发,研究了图像缺陷检测中对长尾数据集的处理方式,提出基于梯度引导加权‒延迟负梯度衰减的损失(GGW-DND Loss)。首先,基于分类器中各分类节点的累积梯度比值,分别放大和缩小相应的正负梯度,缓解尾部类长期正梯度不足且负梯度泛滥的现象;其次,直接限制训练后期产生的负梯度,缓解尾部类的过拟合和弱泛化问题;最后,基于两类数据集的实验结果均表明所提损失函数的有效性。但是,针对NEU-DET上的实验结果,本文损失函数在面对复杂缺陷和实例数悬殊的场景下,尾部类的检测性能仍远不及头部类,后续工作将从这一方面展开。

[1] 王志明. 无参考图像质量评价综述[J]. 自动化学报, 2015, 41(6):1062-1079.(WANG Z M. Review of no-reference image quality assessment[J]. Acta Automatica Sinica, 2015, 41(6): 1062-1079.)

[2] 房亚男. 数字视频图像质量检测关键技术研究[J]. 科技创新导报, 2013(16): 22-26.(FANG Y N. Research on key technologies of digital video image quality detection[J]. Science and Technology Innovation Herald, 2013(16): 22-26.)

[3] WANG F L, ZUO B. Detection of surface cutting defect on MagNet using Fourier image reconstruction[J]. Journal of Central South University, 2016, 23(5): 1123-1131.

[4] WEE C Y, PARAMESRAN R. Image sharpness measure using eigenvalues[C]// Proceedings of the 9th International Conference on Signal Processing. Piscataway: IEEE, 2008: 840-843.

[5] HOU Z, PARKER J M. Texture defect detection using support vector machines with adaptive Gabor wavelet features[C]// Proceedings of the 7th IEEE Workshops on Applications of Computer Vision. Piscataway: IEEE, 2005: 275-280.

[6] CHA Y J, CHOI W, SUH G, et al. Autonomous structural visual inspection using region-based deep learning for detecting multiple damage types[J]. Computer-Aided Civil and Infrastructure Engineering, 2018, 33(9): 731-747.

[7] TAO X, ZHANG D P, WANG Z H, et al. Detection of power line insulator defects using aerial images analyzed with convolutional neural networks[J]. IEEE Transactions on Systems, Man, and Cybernetics: Systems, 2020, 50(4): 1486-1498.

[8] HE Y, SONG K C, MENG Q G, et al. An end-to-end steel surface defect detection approach via fusing multiple hierarchical features[J]. IEEE Transactions on Instrumentation and Measurement, 2020, 69(4): 1493-1504.

[9] 陶显,侯伟,徐德. 基于深度学习的表面缺陷检测方法综述[J]. 自动化学报, 2021, 47(5):1017-1034.(TAO X, HOU W, XU D. A survey of surface defect detection methods based on deep learning[J]. Acta Automatica Sinica, 2021, 47(5): 1017-1034.)

[10] LI J Y, SU Z F, GENG J H, et al. Real-time detection of steel strip surface defects based on improved YOLO detection network[J]. IFAC-PapersOnLine, 2018, 51(21): 76-81.

[11] ZHANG C B, CHANG C C, JAMSHIDI M. Concrete bridge surface damage detection using a single-stage detector[J]. Computer-Aided Civil and Infrastructure Engineering, 2020, 35(4): 389-409.

[12] CHEN S H, TSAI C C. SMD LED chips defect detection using a YOLOv3-dense model[J]. Advanced Engineering Informatics, 2021, 47: No.101255.

[13] RUFF L, VANDERMEULEN R A, GÖRNITZ N, et al. Deep one-class classification[C]// Proceedings of the 35th International Conference on Machine Learning. New York: JMLR.org, 2018: 4393-4402.

[14] BERGMANN P, FAUSER M, SATTLEGGER D, et al. Uninformed students: student-teacher anomaly detection with discriminative latent embeddings[C]// Proceedings of the 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2020: 4182-4191.

[15] LIZNERSKI P, RUFF L, VANDERMEULEN R A, et al. Explainable deep one-class classification[EB/OL]. (2021-03-18) [2022-09-09].https://arxiv.org/pdf/2007.01760.pdf.

[16] GOLAN I, EL-YANIV R. Deep anomaly detection using geometric transformations[C]// Proceedings of the 32nd International Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2018: 9781-9791.

[17] HASELMANN M, GRUBER D P, TABATABAI P. Anomaly detection using deep learning based image completion[C]// Proceedings of the 17th IEEE International Conference on Machine Learning and Applications. Piscataway: IEEE, 2018: 1237-1242.

[18] SAKURADA M, YAIRI T. Anomaly detection using autoencoders with nonlinear dimensionality reduction[C]// Proceedings of the MLSDA 2nd Workshop on Machine Learning for Sensory Data Analysis. New York: ACM, 2014: 4-11.

[19] ZHOU C, PAFFENROTH R C. Anomaly detection with robust deep autoencoders[C]// Proceedings of the 23rd ACM SIGKDD International Conference on Knowledge Discovery and Data Mining. New York: ACM, 2017: 665-674.

[20] GUPTA K, BHAVSAR A, SAO A K. Detecting mitotic cells in HEp-2 images as anomalies via one class classifier[J]. Computers in Biology and Medicine, 2019, 111: No.103328.

[21] NAPOLETANO P, PICCOLI F, SCHETTINI R. Anomaly detection in nanofibrous materials by CNN-based self-similarity[J]. Sensors, 2018, 18(1): No.209.

[22] CANDÈS E J, LI X D, MA Y, et al. Robust principal component analysis?[J]. Journal of the ACM, 2011, 58(3): No.11.

[23] GONG D, LIU L Q, LE V, et al. Memorizing normality to detect anomaly: memory-augmented deep autoencoder for unsupervised anomaly detection[C]// Proceedings of the 2019 IEEE/CVF International Conference on Computer Vision. Piscataway: IEEE, 2019: 1705-1714.

[24] SCHLEGL T, SEEBÖCK P, WALDSTEIN S M, et al. Unsupervised anomaly detection with generative adversarial networks to guide marker discovery[C]// Proceedings of the 2017 International Conference on Information Processing in Medical Imaging, LNCS 10265. Cham: Springer, 2017: 146-157.

[25] LIN T Y, MAIRE M, BELONGIE S, et al. Microsoft COCO: common objects in context[C]// Proceedings of the 2014 European Conference on Computer Vision, LNCS 8693. Cham: Springer, 2014: 740-755.

[26] EVERINGHAM M, GOOL L van, WILLIAMS C K I, et al. The PASCAL Visual Object Classes (VOC) challenge[J]. International Journal of Computer Vision, 2010, 88(2): 303-338.

[27] BUDA M, MAKI A, MAZUROWSKI M A. A systematic study of the class imbalance problem in convolutional neural networks[J]. Neural Networks, 2018, 106: 249-259.

[28] HE H B, GARCIA E A. Learning from imbalanced data[J]. IEEE Transactions on Knowledge and Data Engineering, 2009, 21(9): 1263-1284.

[29] OUYANG W L, WANG X G, ZHANG C, et al. Factors in finetuning deep model for object detection with long-tail distribution[C]// Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2016: 864-873.

[30] BYRD J, LIPTON Z C. What is the effect of importance weighting in deep learning?[C]// Proceedings of the 36th International Conference on Machine Learning. New York: JMLR.org, 2019: 872-881.

[31] SHEN L, LIN Z C, HUANG Q M. Relay backpropagation for effective learning of deep convolutional neural networks[C]// Proceedings of the 2016 European Conference on Computer Vision, LNCS 9911. Cham: Springer, 2016: 467-482.

[32] CHAWLA N V, BOWYER K W, HALL L O, et al. SMOTE: synthetic minority over-sampling technique[J]. Journal of Artificial Intelligence Research, 2002, 16: 321-357.

[33] CUI Y, JIA M L, LIN T Y, et al. Class-balanced loss based on effective number of samples[C]// Proceedings of the 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2019: 9260-9269.

[34] WANG Y X, RAMANAN D, HEBERT M. Learning to model the tail[C]// Proceedings of the 31st International Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2017: 7032-7042.

[35] HUANG C, LI Y N, LOY C C, et al. Learning deep representation for imbalanced classification[C]// Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2016: 5375-5384.

[36] ZHANG X, FANG Z Y, WEN Y D, et al. Range loss for deep face recognition with long-tailed training data[C]// Proceedings of the 2017 IEEE International Conference on Computer Vision. Piscataway: IEEE, 2017: 5419-5428.

[37] CAO K D, WEI C, GAIDON A, et al. Learning imbalanced datasets with label-distribution-aware margin loss[C]// Proceedings of the 33rd International Conference on Neural Information Processing Systems. Red Hook, NY: Curran Associates Inc., 2019: 1567-1578.

[38] LIN T Y, GOYAL P, GIRSHICK R, et al. Focal loss for dense object detection[C]// Proceedings of the 2017 IEEE International Conference on Computer Vision. Piscataway: IEEE, 2017: 2999-3007.

[39] LI B Y, LIU Y, WANG X G. Gradient harmonized single-stage detector[C]// Proceedings of the 33rd AAAI Conference on Artificial Intelligence. Palo Alto, CA: AAAI Press, 2019: 8577-8584.

[40] LI Y, WANG T, KANG B Y, et al. Overcoming classifier imbalance for long-tail object detection with balanced group softmax[C]// Proceedings of the 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2020: 10988-10997.

[41] YIN X, YU X, SOHN K, et al. Feature transfer learning for face recognition with under-represented data[C]// Proceedings of the 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2019: 5697-5706.

[42] LIU Z W, MIAO Z Q, ZHAN X H, et al. Large-scale long-tailed recognition in an open world[C]// Proceedings of the 2019 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2019: 2532-2541.

[43] CHU P, BIAN X, LIU S P, et al. Feature space augmentation for long-tailed data[C]// Proceedings of the 2020 European Conference on Computer Vision, LNCS 12374. Cham: Springer, 2020: 694-710.

[44] REN S Q, HE K M, GIRSHICK R, et al. Faster R-CNN: towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[45] HE K M, ZHANG X Y, REN S Q, et al. Deep residual learning for image recognition[C]// Proceedings of the 2016 IEEE Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2016: 770-778.

[46] HE K M, GKIOXARI G, DOLLÁR P, et al. Mask R-CNN[C]// Proceedings of the 2017 IEEE International Conference on Computer Vision. Piscataway: IEEE, 2017: 2980-2988.

[47] TAN J R, LU X, ZHANG G, et al. Equalization loss v2: a new gradient balance approach for long-tailed object detection[C]// Proceedings of the 2021 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2021: 1685-1694.

[48] HE Y, SONG K, MENG Q, et al. An end-to-end steel surface defect detection approach via fusing multiple hierarchical features[J]. IEEE Transactions on Instrumentation and Measurement, 2019, 69(4): 1493-1504.

[49] KINGMA D P, BA J L. Adam: a method for stochastic optimization[EB/OL]. (2017-01-30) [2022-07-13].https://arxiv.org/pdf/1412.6980.pdf.

[50] LIU W, ANGUELOV D, ERHAN D, et al. SSD: single shot multiBox detector[C]// Proceedings of the 2016 European Conference on Computer Vision, LNCS 9905. Cham: Springer, 2016: 21-37.

[51] KUZNETSOVA A, MALEVA T, SOLOVIEV V. YOLOv5 versus YOLOv3 for apple detection[M]// KRAVETS A G, BOLSHAKOV A A, SHCHERBAKOV M. Cyber-Physical Systems: Modelling and Intelligent Control, SSDC 338. Cham: Springer, 2021: 349-358.

[52] SIMONYAN K, ZISSERMAN A. Very deep convolutional networks for large-scale image recognition[EB/OL]. (2015-04-10) [2022-07-24].https://arxiv.org/pdf/1409.1556.pdf.

[53] REDMON J, FARHADI A. YOLOv3: an incremental improvement[EB/OL]. (2018-04-08) [2022-08-09].https://arxiv.org/pdf/1804.02767.pdf.

[54] MENON A K, JAYASUMANA S, RAWAT A S, et al. Long-tail learning via logit adjustment[EB/OL]. (2021-07-09) [2022-05-22].https://arxiv.org/pdf/2007.07314.pdf.

[55] TAN J R, WANG C B, LI B Y, et al. Equalization loss for long-tailed object recognition[C]// Proceedings of the 2020 IEEE/CVF Conference on Computer Vision and Pattern Recognition. Piscataway: IEEE, 2020: 11659-11668.

Long-tailed image defect detection based on gradient-guide weighted-deferred negative gradient decay loss

LI Wei*, LIANG Sixin, ZHANG Jianzhou

(,,610065,)

Aiming at the problem that the current image defect detection models have poor detection effect on tail categories in long-tail defect datasets, a GGW-DND Loss (Gradient-Guide Weighted-Deferred Negative Gradient decay Loss) was proposed. First, the positive and negative gradients were re-weighted according to the cumulative gradient ratio of the classification nodes in the detector in order to reduce the suppressed state of tail classifier. Then, once the model was optimized to a certain stage, the negative gradient generated by each node was sharply reduced to enhance the generalization ability of the tail classifier. Experimental results on the self-made image defect dataset and NEU-DET (NEU surface defect database for Defect dEtection Task) show that the mean Average Precision (mAP) for tail categories of the proposed loss is better than that of Binary Cross Entropy Loss (BCE Loss), the former is increased by 32.02 and 7.40 percentage points respectively, and compared with EQL v2 (EQualization Loss v2), the proposed loss has the mAP increased by 2.20 and 0.82 percentage points respectively, verifying that the proposed loss can effectively improve the detection performance of the network for tail categories.

long-tail dataset; cumulative gradient ratio; weighted loss; image defect detection; Convolutional Neural Network (CNN)

This work is partially supported by China Postdoctoral Science Foundation (2022M712235), Postdoctoral Research and Development Foundation of Sichuan University (2022SCU12074).

LI Wei, born in 1998, M. S. candidate. His research interests include defect detection, object detection.

LIANG Sixin, born in 1995, Ph. D. candidate. His research interests include machine vision, camera calibration, medical image processing.

ZHANG Jianzhou, born in 1962, Ph. D., professor. His research interests include machine vision, computer vision.

1001-9081(2023)10-3267-08

10.11772/j.issn.1001-9081.2022091413

2022⁃09⁃26;

2022⁃12⁃04;

中国博士后科学基金资助项目(2022M712235);四川大学专职博士后研发基金资助项目(2022SCU12074)。

李巍(1998—),男,江苏泰州人,硕士研究生,主要研究方向:缺陷检测、目标检测; 梁斯昕(1995—),男,云南曲靖人,博士研究生,主要研究方向:机器视觉、摄像机标定、医学图像处理; 张建州(1962—),男,河北邯郸人,教授,博士,主要研究方向:机器视觉、计算机视觉。

TP391

A

2022⁃12⁃12。