“人机互生”时代可供性理论的契机与危机

2023-04-12陈秋心邱泽奇

摘 要:本研究旨在从“提示词”这一具体、微小但关键的人机交互中介入手,借助可供性理论透视当下以ChatGPT为代表的人工智能技术革命的意义与影响,同时也利用最新的社会现实来测试可供性理论的稳健性,指出其发展可能与潜在危机。基于理论梳理、交互实践和用户、社群、社交媒体观察,研究者发现提示词是大语言模型可供性的“诱出机制”,为人们习得可供性提供场所、降低门槛,并且促成认知超越,但同时也可能带来“想象力焦虑”。进一步地,提出人机互生时代催生了一种复杂多元的可供性生成机制,其中人机互动、人与人的互动、机器之间的互动都发挥了重要作用,而可供性的社会性和想象力因此变得更加重要。此外研究者还提出了“预设的可供性(Presupposed Affordances)”概念,并指出可供性理论面临着一个深层危机:人、物二元性的模糊。

关键词:提示词;可供性;ChatGPT;大语言模型;人机互生

作者简介:陈秋心,苏州大学传媒学院讲师,主要从事信息技术与社会、网络舆论、互联网史研究;邱泽奇,北京大学中国社会与发展研究中心主任,社会学系教授、博士生导师,主要从事组织社会学、社会研究方法、城乡社会学、技术应用与社会变迁研究。

基金项目:江苏省教育厅项目“中国信息技术的‘工程隐喻’研究”(项目编号:2022SJYB1421)、“江苏省卓越博士后计划”资助项目以及苏州大学人文社会科学研究团队资助项目(项目编号:22XM0004)的阶段性成果。

中图分类号:G206 ""文献标识码:A ""文章编号:1001-4403(2023)05-0172-11

DOI:10.19563/j.cnki.sdzs.2023.05.015

人工智能早期阶段主要依赖于编程规则或简单的机器学习算法,对于输入的处理通常是直接映射到预定义的输出。然而,当前人工智能的革命性进展是以深度学习和自然语言处理技术的进步为基础的,大语言模型(Large Language Models,LLMs)已经可以处理开放式的文本输入,这就为人机交互打开了一个突破口,并将“提示词(Prompts)”这样一个概念推向了显要位置——这个与“代码”“指令”相比气质殊异、介于技术术语和生活用语之间的词汇,是人机交互过程中启发生成式AI进行输出的关键要素。

本文拟以“提示词”这一人类与大语言模型交互的必备要素为研究视角,基于可供性理论,剖开一个较为微观的技术情境来探讨如下问题:当下的人机交互形态发生了什么变化、有何种特征?人机关系有何进展?可供性理论在新的技术情境下又面临怎样的更新契机与危机?

一、“提示词”:一个新概念的引入

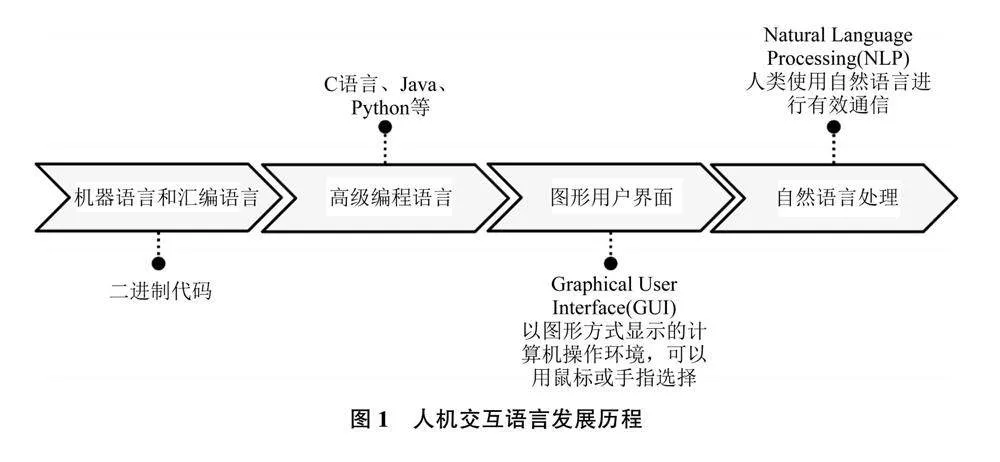

从人工智能的发展历程来看,人机交互的“语言”经历了多种形式,如图1所示:

人机交互语言进化的根本逻辑是逐渐减少人的认知负担——在图1各阶段中,机器语言和汇编语言对普通用户来说非常难以使用,因为它们要求对计算机硬件和底层结构有深入的理解;高级编程语言(如C语言、Java、Python等)相对容易,但仍需要掌握专门的计算机编程知识,键入复杂的命令行代码。而图形用户界面(GUI)阶段,人类通过一系列的创新使人机交互变得更加直观和友好——从1968年美国科学家道格拉斯·恩格尔巴特制作第一只鼠标到今天智能手机应用上的手指操作,皆为GUI阶段的成就。①【①高斯寒:《图形用户界面发明史》,《世界科学》2023年第3期,第54页。】当下的自然语言处理技术革命将人机交互转入了新的范式:人可以使用自己的自然语言和机器互动,而大语言模型则可以理解和生成复杂的自然文本,使得人机交互更加流畅和高效——但截至目前仍需要通过一种中介物来进行,即提示词。

当下阶段提示词的存在有其必要,因为LLMs是由大量实例(语元和语元关联度)构成的模型,必然高度依赖语料,而人类规模语料“鱼龙混杂”,基于统计原理的大模型无法保证在多个不同甚至矛盾的答案间总是做出正确的选择——其工作原理导致其必然会出错,于是两种针对性解决方案被引入:“细调”(Fine-tuning,又译微调、精调)和“提示”(Prompting)。前者针对特定任务,用适量的补充数据对预训练模型进行后续加工,可明显提升给定类任务的性能,但其他类任务的性能可能下降。后者是在提问时提供更多关键性信息,帮助大模型激活有用的关联度,使符合预期的回答更容易“脱颖而出”。②【②陈小平:《出乎预料的发展?陈小平:人工智能正引发第一次重大社会实验》,2023-06-22,https://mp.weixin.qq.com/s/xIZOD6_PjYyYuxyyjxn8uQ.】

此轮人工智能技术变革来得如此迅疾、突然,一个表征是“提示词”这样一个全新的概念,被引入生活世界时直接跳过了“定义”(what)阶段,进入“如何操作”(how)阶段——公共讨论中一时涌现大量关于如何写好提示词的内容,并且催生了一系列相关概念,例如“提示词工程(Prompt Engineering)”“提示词工程师(Prompt Engineer)”“提示词交易”等,此外还有大量隐喻,例如提示词又被称为“咒语”“魔咒”,具备提示词创作素养的人被称为“咒语师”,而提炼有效提示词则被称为“炼金术”……这些表达中包含了使用者对新技术的朴素理解与功能想象,但都不具有权威定义作用。鉴于此,本文将“提示词”定义为一种用于与人工智能模型交互的语言,其用途是告知模型需要生成何种内容。例如在图像生成领域,提示词通常由三个部分组成:绘画对象、对象描述词和风格修饰词。当用户向AI发送一段自然语言,提示词往往指的是其中那些引导或激发AI生成特定回应的语言成分——因为定义了问题或任务的范围和方向,它们对确定AI的输出至关重要。通过优化提示词撰写可以使AI生成的结果更符合使用者的期望,而写出好的提示词需要对大模型的工作原理有较深入的了解。①【①③陈小平:《出乎预料的发展?陈小平:人工智能正引发第一次重大社会实验》,2023-06-22,https://mp.weixin.qq.com/s/xIZOD6_PjYyYuxyyjxn8uQ.】备受瞩目的“提示词工程”的重点即在于选择合适的单词、短语、句子及标点符号等来制作(craft)出最佳的文本输入,因此要求掌握特定的AI工具和语言能力。

综上所述,至少在当前阶段因LLMs技术原理的限制,人机互动中仍然需要提示词这样的中介性存在。不过也有观点认为,人工智能工作原理会很快迭代改进,或者人机交互方式可能改变——例如不再通过自然语言而是通过脑机接口直接进行,那么提示词便是昙花一现的现象。这一判断并不是没有依据——当下部分AI应用(例如Midjourney)已经可以做到通过某个产出结果倒推提示词,或是自动标识出自然语言指令中的有效成分(可被视为提示词的部分)和无效成分,以帮助用户更快地掌握提示技法——似乎人类在努力习得驯服机器的语言,同时也在不断积蓄力量试图超越这种交流方式,以让人机交互趋向于无中介。不过本研究认为,提示词并不应简单地被视为一种交互工具,而应被视为人机从间接交互到无中介交互过程中的一个必经环节,以及勾连人的主观能动性和机器功能的联结点——那么它即便是一种短暂存在,也仍然具有深刻的意义可供挖掘。

二、人机互生:一种人机关系的新进展

提示词在人机交互中无疑引入了一个新的维度,为人与机器的互动带来了前所未有的语义灵活性,使得非技术背景的人也能与复杂的AI系统进行流畅交互。这种互动方式不仅增强了适应性和创新性,还催生了许多全新的应用和服务场景,允许用户以各种方式引导、挑战甚至教育模型。总的来说,提示词开启的人机交互的崭新篇章,使得人们不得不重新思考机器的“类人地位”以及人机关系的新变化。

(一)大语言模型“自主意识”的祛魅

当下AI工作模式的拟人化以及时常超出用户预期的生成内容(AI-generated content,AIGC)所引发的震撼,使得AI“自主意识论”“替代人类论”前所未有地占据了公众视线。但在梳理大语言模型的工作原理之后,学界普遍倾向于认为LLMs并非真正像人类一样依赖内在的意识、感知或者经验来理解和使用语言②【②胡泳:《当ChatGPT产生幻觉,一个“幻觉时代”要来临了》,2023-03-01,https://mp.weixin.qq.com/s/Qqs__1bXtJg4KW3MbMstIw.】,所以距离拥有自主意识还很遥远。陈小平认为人类对大模型的拟人化想象是“投射效应”引起的:人类将自身独特的“脑补”能力所产生的内涵投射到大模型的回答上,有了机器自主思考的幻觉,但这并没有科学依据。大模型与人类相比,一个本质差异在于前者并无生命冲动和生命体验——这两者才是人的语言内涵的重要来源。而大模型只是在模仿人的生命冲动和体验的语言痕迹。简而言之,“生命是火,思想是火发出的光,语言是光的影子,大模型是影子的影子”③。计算机科学家Jacob Browning和Yann Lecun甚至认为LLMs这种表面上的模仿甚至使人类背离了通向真正人工智能的道路:“仅靠语言训练的系统永远不会接近人类智力,即使从现在开始训练直到宇宙热寂”④【④“A system trained on language alone will never approximate human intelligence,even if trained from now until the heat death of the universe.”见Jacob B amp; Yann L.AI And The Limits Of Language,2022-08-23,https://www.noemamag.com/ai-and-the-limits-of-language/.】。人工智能专家朱松纯持同一看法——虽然大型语言模型已经取得了一些惊人的进展,但如果对照通用人工智能的实现标准(无限任务、自主性、价值系统),它的方向其实并不完全一致。⑤【⑤机器之心编辑部:《关于AGI与ChatGPT,Stuart Russell与朱松纯这么看》,2023-02-27,https://mp.weixin.qq.com/s/TL1TCfQMetQh2nM3XykRBg.】

(二)人机互生带来的理论更新契机

在认知科学领域早就有两种设想:一是用机器认知取代人类认知;二是运用人机交互辅助乃至增强人类认知。①【①Winograd T.Shifting Viewpoints:Artificial Intelligence and Human-Computer Interaction.Artificial intelligence,2016,170(18),p.1257;Pavlou P A.Internet of Things-Will Humans Be Replaced or Augmented?.NIM Marketing Intelligence Review,2018,10(2),p.43.】“大模型自主意识”的祛魅,提示人类目前仍处于后一条道路上。但人机关系并非原地踏步——人们已不再单纯视AI为人类智能的辅助工具,而是意识到机器认知也在发展,它们不再只是执行预定程序,而是学会了通过试错进行创新性探索,包括提出人类不曾想象的问题、目标、假设、分析。在认知发展的四个环节:信息获取、信息加工、认知形成和认知影响中,机器认知与人类认知已不是并存式的“共生”,更不再是简单的一方对另一方的辅助,而是相互激发与演进,进而构成两者之间的“互生”——当下社会已从“人机共生”迈入“人机互生”阶段。②【②邱泽奇:《认知域:从习以为常到人机互生》,《人民论坛·学术前沿》2023年6月上期,第23页。】这种认识捕捉到了大语言模型昭示的新变化,也在事实上承认了机器地位的提升——它不是一种僵死的、被支配的工具,而是至少具有了形式上的能动性,成为一个可以互动与交往的对象。杜骏飞以“数字交往”来描述这种进展,他认为数字交往1.0时代的特征是人与人、人与非人之间的数字化交往,那么现在人类进入数字交往2.0时代,是人与人、人与非人之间的AI辅助交往(AI aided association,AAA)。其本质的变革是发生于人的生命与人工生命之间的联结——一种跨生命的交往。③【③杜骏飞:《ChatGPT:跨生命交往何以可能?》,《新闻与写作》2023年第4期,第1页。】而在这种交往形态下,人类认知与机器认知相互激发、共同创造,即“互生”。

“人机互生”是一种新型交往关系,甚至可能参与建构将来新的生存环境,譬如“认知圈(Cognisphere)”。④【④段伟文:《深度智能化时代算法认知的伦理与政治审视》,《中国人民大学学报》2022年第3期,第30页。】它的出现为社会科学理论发展带来了新的灵感——尤其适合作为“可供性(affordance)”理论的新认知起点。自20世纪中叶以来,技术决定论与社会建构论的对立,或者在更广义层面的“结构/能动”二元框架便是社会科学研究的焦点之一,而近年来学者们试图摆脱这一沿袭的二元结构,方向是致力于发掘人的具身性与技术/物的物质性共同导向的一种主客体平等的互动框架——在这一框架下“互动”是关键,而可供性理论因较好地覆盖了这一过程而被赋予期待,被从生态心理学迁移到认知科学、设计学、社会学、传播学等多种学科领域。然而论及“互动”的两端,学界长期对于人的能动性有充分关注,对技术/物的探讨却还处于起步阶段,更多情况下是泛泛而谈交互却并无实质性的交互分析⑤【⑤⑥孙凝翔,韩松:《“可供性”:译名之辩与范式/概念之变》,《国际新闻界》2020年第9期,第135、123页。】,因而需要更多的研究者回到微观、具体的“人-物”互动之中探索发生的过程——当下“人机互生”时代的到来恰好提供了这一契机,而提示词现象则为探讨这种互动开辟了一个微观的场域。

三、可供性视域下的提示词现象

(一)吉布森的可供性思想脉络

近年来“可供性”在学术界的流行让提出者詹姆斯·吉布森遭遇了“作者已死”的困境——此概念诞生之后,原初思想被转义、二次转义并经由理论旅行抵达其他学科,过程中内涵逐渐偏离,在诸多不审慎的理论套用中甚至走向了吉布森意图的反面。⑥确切来说,吉布森思想的原创性建立在对知觉直接性的揭示上。传统知觉理论主张知觉是由刺激引起感觉后转化而成的,即“间接知觉论”,而吉布森认为知觉是人与外界接触的直接产物,是外界物理能量变化的直接反映,不需要思维的中介过程。⑦【⑦Gibson J J.The perception of the visual world.Houghton Mifflin,1950,pp.75-76.】“可供性”的提出也是建立在这一思想基础上。在吉布森看来,可供性是生物(或有机体)对环境对象的有用性的感知。也就是说,生物与环境之间存在相互关联、互惠互补的关系,这种关系被生物的知觉直接捕捉,进而使得它们能够采取相应的行为以达成意义。①【①罗玲玲、王磊:《可供性概念辨析》,《哲学分析》2017年第4期,第124-125页;景义新、沈静:《新媒体可供性概念的引入与拓展》,《当代传播》2019年第1期,第92页。】所以可供性是一个位于主客体间的概念,强调了两个关键特质:其一是知觉来源的直接性,即知觉与行动之间的强耦合(coupling)关系②【②③Gibson J J.The Ecological Approach to Visual Perception.Houghton Mifflin,1979,pp.73-76,p.127.】;其二是生物与环境的“互补性”(complementarity),即生物与环境之间的强耦合关系。③

若单独瞩目人类社会,那么可供性就是“环境/物为行动者呈现的行动机会或发出的行动邀请”④【④“Affordances,in short,are opportunities for or invitations to action that things present to actors.”见Lievrouw L A.Materiality and media in communication and technology studies:An unfinished project.Media technologies:Essays on communication,materiality,and society,2014,pp.48;Gillespie T,Boczkowski P,Foot K A,et al.Media technologies:Essays on communication,materiality,and society.MIT Press,2014,pp.21-52.】。这里的“环境/物”可以理解为既包括自然环境也包括人工物,而其促成的行动不仅依赖于“环境/物”固有的属性,还要依赖行动主体的“察觉(perception)”。如上文所述,这是吉布森着重强调的一个概念,也是理解可供性的重要环节,因为一个对象可能有多种可供性,但最终实现了哪一种,有赖于行动主体察觉的特定方式。综上,我们可以总结吉布森的“可供性”有如下特征:

(1)可供性表示的是主客体之间的关系(relational)而不是某种性状⑤【⑤从这一点来看,affordance翻译成“示能”似更妥当,但鉴于“可供性”已经成为约定俗成的译法,本文亦沿用之。】,它是潜在的、自为的,是基于客体的功能属性、因主体的察觉而凸显,但其存在不受主体意志或需要决定。

(2)不同主体的觉察方式不同,导致一个事物的可供性可能是丰富的,但受客体属性所限,这种丰富又是有限、有边界的,而不是无止境的。

(3)不同主体觉察同一个事物的可供性可能不同;相同主体觉察同一个事物的可供性也可能不同——当目的、动机或者情境改变的时候,可供性也会发生改变。

(4)一个事物的可供性有可能促进某些有目的的行动——使能(enabling);也可能阻碍或限制(constrain)某些行动⑥【⑥Hutchby I.Affordances and the analysis of technologically mediated interaction:A response to Brian Rappert.Sociology,2003,37(3),pp.583.】,即具有“功能性(functional)”。

(5)当行动主体为人时,个体通过经验积累,掌握一系列与环境/物交互、联结的方式、技能或策略,但其可能根据文化和社会的价值观而有所不同,所以可供性是具有习得性(learned)的。进一步而论,可供性并不一定是人与环境/物相遇瞬间就清晰地、穷尽地呈现出来的,也可能在与技能、文化等其他因素相互作用很长时间之后才呈现出来。

(二)提示词作为可供性“诱出”机制

1.可供性习得之通路

在当代社会,人类所处的环境中充斥着人工物,特别是技术产品,致使环境相对于自然界可能发生快速变化,而这在某种程度上对吉布森的“直接知觉”主张构成了挑战。吉布森认为生物对环境可供性的知觉无需任何中介或解释,但很显然,当新的技术物频繁出现或旧的技术物不断迭代时,人类如何仅凭直接感知就能理解环境的可供性呢?

实际上,早已有学者研究过吉布森的可供性理论如何适应技术环境。例如唐纳德·诺曼(Donald Norman)在设计和人机交互领域引入了可供性概念,特别关注用户如何感知和利用技术提供的可能性。伊恩·赫奇比(Ian Hutchby)也在通信技术的社会学研究中应用了可供性的概念。这些研究都对吉布森的理论进行了一定的调整和扩展,强调技术的可供性是通过社会构建过程形成的,人们需要通过社会互动和学习来获得对技术可供性的感知,而技术可供性也会随着技术的改进和用户的学习而变化。从这一点来看,当下正是人机互生的“磨合期”,以大语言模型为代表的生成型人工智能的可供性无法直接感知,无论是演化天性还是习得经验,在这个全新的事物面前都失效了。人们需要通过交互操作——发送提示词、获得反馈来感知模型,通过学习如何提问、如何理解模型的回答、如何改进模型表现以及模型有何局限,才能开始理解其存在。这个过程可能涉及更多的间接感知,依赖于推理和解释。而一旦人们习得了如何使用模型,经验便开始累积,就像人们通过学习和实践逐渐惯于使用键盘和鼠标进行计算机操作——当这些新的技术物逐渐沉淀为生存环境的一部分,人类才可能开始直接感知并与新的技术环境耦合。

因此从可供性视角出发,提示词可以被看作是大语言模型向人类发出的邀请而不仅仅是人类对模型的命令或请求——它是可供性建立的前塑阶段,是对可供性的“诱出”,是人习得可供性的通路和场域。提示词提供了一种机制,使得模型可以被训练、使用和理解,而用户对提示词的反应则可以看作是他们对可供性的适应,因而人工智能模型的主动性和社会性、人机交互的互动性和双向性也就浮现了出来。

2.提升认知超越可能性

此外,提示词的“可供性诱出”还有更深一层涵义:如上文分析,由于主体察觉方式的不同,一个事物带来的可供性可能是丰富(但有上限)的,而相比其他技术物,大语言模型带来的可供性,或者说其“使能”水平是前所未有的级别。究其原因,LLMs的目标是理解和生成人类语言,而语言本身可以用于表述和讨论任何主题,从基础的事实性信息到深奥的哲学观点皆包含在内,那么不同人群与LLMs的交互究竟可以激发多少行动可能性,也许已经超越了设计者的初始目标和想象。①【①2023年2月《纽约时报》专栏作家凯文·卢斯(Kevin Roose)与微软New Bing机器人交谈被后者疯狂示爱的“事故”或许是一个典型例证,以致于各大LLMs研发团队不得不对大模型的功能进行人为限制,例如关键词过滤、不可联网等。】在这种情况下,具有“激发交互”功能的提示词不仅是一种实用工具,也是一种促进理解、承载创新探索的媒介——人可以施放一个试探性的用法或某种灵感在提示词上向LLMs发送,而提示词就像探照灯,有可能意外照亮LLMs“可供性海洋”中未知的区域。

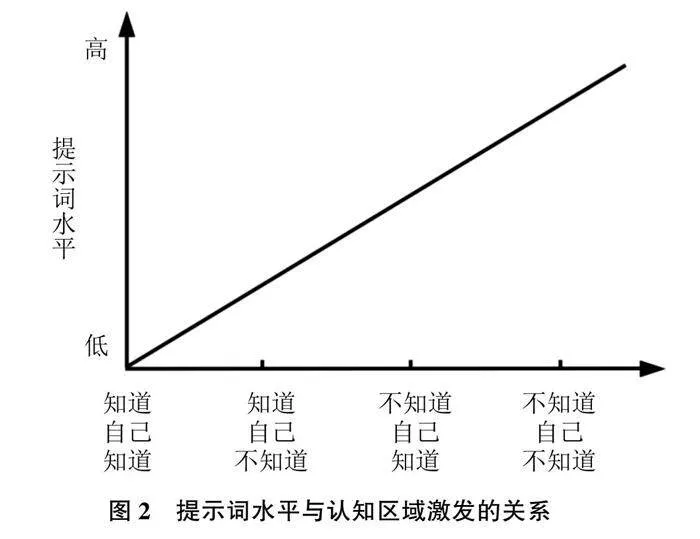

图2 提示词水平与认知区域激发的关系就发生机制而言,人类的认知有四种情形:知道自己知道、知道自己不知道、不知道自己知道、不知道自己不知道。过去的技术创新增效的上限只到了“知道自己不知道”这部分,例如通过搜索引擎等手段,人们可以快速查找自己想要了解但尚未掌握的知识——抛出一个确定性需求,返回一个确定性结果。当下也有观点认为大语言模型不过是一种可对话的、更高级的搜索引擎,这未免低估了其能力。LLMs真正的超越性在于它还能够通过认知交互,激发人类更迅速地进入“不知道自己知道”和“不知道自己不知道”这两部分。在LLMs出现之前,人们若想触碰这两块区域,只能通过学习(例如阅读或上课)、反思、内省、试错、交流互动等传统认知方式,而现在LLMs的显著增效不仅是因为“AI永不眠”②【②杜骏飞:《AI永不眠:交往革命与“赛博格阶梯”》,《探索与争鸣》2023年第5期,第16页。】、可以随时随地迎接对话,以及“类人应答”给人类提供的心流体验,更是因为在人机互生情境下,机器掌握着比人类使用者庞大得多的认知资源,于是提示词这个“激发物”中就包含了帮助人类进行认知超越的可能性(图2)。

使用者的认知储备和使用目标各不相同导致每一次人机交互都是个性化的,所以图2纵轴中的“提示词水平”是针对使用者个体而言的,并非普适标准——但“高”或“低”的相对性中又包含一定的绝对性,例如提示词工程师所创造的提示词对于绝大多数其他人而言都可能是具有启发性的和“高水准”的。

3.降低可供性探索门槛

提示词在可供性诱出上最卓越贡献在于它是可复制、可传播的。究其原因,个体的想象力是有限的,如图3所示,假如一个普通用户永远靠自己创作提示词,那么在与LLMs一段时间的交互后就可能体会到,自己极少有机会突破自己的认知上限、获得超出想象力的结果,这可能是用户自身的认知边界和思维习惯影响了他们与模型的交互方式,而个人已有的知识、经验储备也可能影响他们从交互中获取新知和洞察的能力。但对于人类总体而言,提示词的一端连接着全球使用者的脑力跃动,另一端连接着多种多样的行动可能,每一条提示词里凝固的最珍贵的信息不是使用者的具体诉求,而是提示词的写作方式——优质的提示词能够直接启发他人怎样才是LLMs“更正确的打开方式”——通过提示词可以直观感受大语言模型的可供性。例如ChatGPT上线数月后,全球用户通过交互实践和社交媒体讨论逐渐普及了一些常规用法:学外语、润色文字、写脚本……而专业人士可能另辟蹊径,例如中国软件开发工程师吕靖在一次直播中分享了一条ChatGPT角色扮演“圆桌会议”提示词:

“谢谢你的演讲大纲。我的名字叫吕立青,是一名软件开发工程师,跟我一起参加直播的还有一位商业顾问,名叫A,擅长企业战略及经营咨询业务,主持人B则是一名行为干预专家,擅长社群运营。请为今天晚上总时长为1小时左右的直播讨论进行预演,请扮演三个人进行对话讨论。”①【①吕立青:《【回放】ChatGPT时代的自主:未来(仍然)来得不够快》,2023-02-27,https://www.bilibili.com/video/BV1oM4y1d7kJ/?vd_source=f1b624365cdd080ed661b50944915b51.为保护隐私,提示词原文中提及的真实姓名用字母代替。】

这则提示词显示创作者充分知悉“角色提示(Role Prompting)”可提升LLMs反馈效果的通用技巧,并且还展示了如何绕过使用者本人的认知上限,让AI分饰三角自我激发,碰撞出使用者可能根本想象不到的智力内容——对于ChatGPT而言,作为独立角色或“分裂”为若干角色参与讨论的资源消耗几无差异,于是这则提示词拓展了人类对LLMs可供性的感知边界,相比之下,这次圆桌讨论的议题对参与者之外的他人并不是很重要。套用麦克卢汉的著名观点“媒介即讯息”来解释——提示词的重要性在于其写作方法本身,而不是它的具体诉求。而当提示词的复制和传播成本理论上趋近于零,诸如此类的提示词若能得到普及,全人类针对大语言模型的可供性探索与习得门槛就会大大降低,整体认知水平也就更有机会提高。

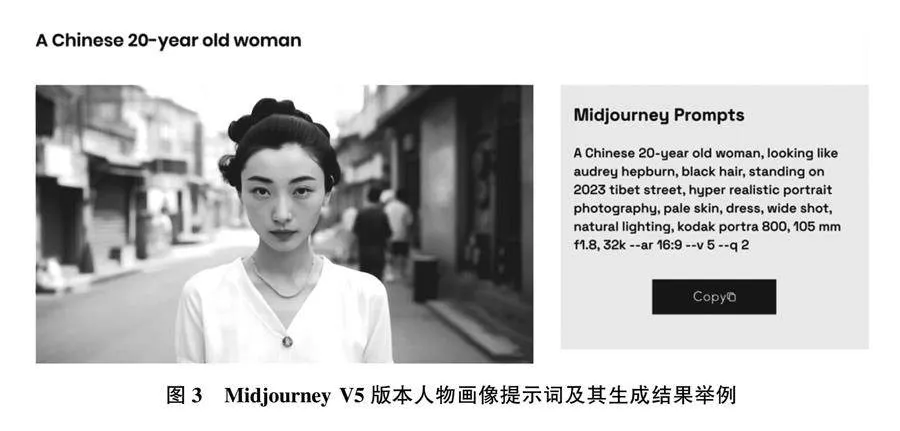

在现实生活中,优质提示词确实具备了传播价值。例如图3为2023年3月某推特网民针对Midjourney V5版本创作了一则人物画像提示词,其中使用了详细的时间、地点、外貌修饰词,甚至使用了摄影器材参数,使得生成图获得了高清相机的拍摄效果。这种提示方式也具有强烈的启发性,但对于普通人而言仍是有门槛的,毕竟不是每个人都了解相机参数,更不知道参数能用到提示词中。故而这则提示词的传播价值更高了。其随后在推特、微信上流传开来,亦被针对Midjourney专门建立的提示词网站①【①例如www.freemidjourneyprompts.com。】收录。其他人使用时只要更改其中的年龄、明星名字等关键信息,就能生成自己心仪的图片。

在ChatGPT等大模型话题热度最高的时段,类似的“富有魔力”的提示词、合集以及各类写作技巧总结在社交媒体上广为传播,但因为人们的需求多样,优质提示词注定稀缺,于是它很快被商品化,变成了交易物,传播成本随之增高。但从另一方面而言,“有利可图”是否也可能进一步激发提示词创作?这部分内容已超出属于本文讨论范畴,有待后续研究深入探讨。

(三)提示词的抑制效应:想象力焦虑

从可供性角度考察提示词,所得当然不仅是“使能”,也有“限制”。例如研究者在对ChatGPT用户和相关社群的长期观察中,发现了一种“想象力焦虑”:在ChatGPT话题热度高峰期,普通人会接触到大量别人的实践示例、热门的提示词列表或者相关讨论,而这时大模型还没有普及。于是一些人先意识到了通过精心设计的提示词能够引导LLMs做许多事,进而他们期望自己也能创造出这样有深度和独特性的提示词,从而探索到LLMs更丰富的可供性。然而如果他们对自己的创造力或语言表达能力有所怀疑,或者在后来的交互实践中时常无法获得理想结果,那么这种预期的压力便会形成一种“想象力焦虑”,即认为自己问不出好问题、不足以激发大语言模型的真正潜力,进而可能错失先机、落后他人。换言之,“想象力焦虑”的根源可能在于,人们在充分感知LLMs的可供性之前,先过早、过度感知了提示词的可供性。从这种意义上来说,提示词的可供性有可能抑制LLMs的可供性。

“想象力焦虑”进一步提示了AIGC涉及的平等问题:大语言模型将人机关系从复杂的编程语言中解放出来,让普通人用自然语言就能交互,这是一种“数字平权”吗?答案自然不会那么简单。仅从提示词创作角度看,其中的专业壁垒就可能在未来造成“二八定律”,即20%的用户生产80%的高质量提示词,使得大部分人只能被动接收和消费这些内容。这种情况下,虽然所有人都有可能接触到大语言模型,但能充分利用和创新其可供性的人仍然相对有限。有学者认为AIGC会走上UGC的旧路:“UGC革命已经失败了……(关于AIGC)我们还在早期欢呼阶段,但往后,一部分人的提示能力就是比另一部分人强。内容生产会回到老路上,从发散重新收敛。”②【②胡泳:《对话|北大教授胡泳:当AI流行,我在期待和害怕什么》,2023-05-21,https://mp.weixin.qq.com/s/aRqWR0jmb8YAW4goc8R3Mw.】因此,大语言模型并不能完全解决数字平权问题——它“平权”的同时也可能在某种程度上加剧了数字鸿沟。

四、可供性理论的更新契机与危机

在人机互生时代的发端,可供性理论可以帮助人们获得理解新事物的视角,但也同时呈现出理论解释力不足之处——总的来说是因为人机互生涉及一种更复杂、更多元的可供性生成机制。

(一)可供性的社会性

吉布森的可供性理论主要着眼于环境/物和个体的交互关系,即环境如何“提供”信息,以及个体如何“感知”并“行动”,并且感知和行动主要依赖于个体能力③【③虽然可供性理论解释的对象也包括蜂群、蚁群、狼群这样的社会性动物群体,但社会性并不是吉布森的关切重心。】,因此社会性并不是可供性理论的考量重点。但考察大型语言模型时,社会性因素显得尤为重要,因为在人机互生中不但充斥着个体与环境/物的互动,更充斥着大量个体与个体之间的互动。换言之,大语言模型(如GPT-4)的使用是深度嵌套在社会文化环境和社会交往过程中的。这时模型的可供性不仅仅取决于其自身的技术特性,也受到社会文化因素的深刻影响。提示词的使用和传播就是一个典型的社会性过程,它涉及知识的社会化生产和分配,以及网络社群的形成和发展等。

人与人之间的知识交流与信息传播在当下的人机关系中扮演了重要角色,机器与机器之间的交互亦然。从技术角度看,LLMs的设计和功能受到了当前计算和网络技术的限制和激励,例如它从互联网上获得巨大的数据来源用于训练和更新模型,也常运行在云端的计算资源上,既包括执行模型推断的计算服务器,也包括用于存储模型参数和数据的硬件设施。此外LLMs也可能与其他AI技术相结合,例如图像识别、语音识别等,以实现更多元的功能。近年来人文社科研究发生“物质性转向”,诸如“行动者网络”之类的理论倾向于将非人类实体(包括技术设备)也视为行动者,将它们的相互关系也看作是社会网络的一部分。因此机器之间的交互也可被视为可供性的“社会性”中的一个组成部分重新加以考量。

(二)“预设的可供性(Presupposed Affordances)”

上文提及的“想象力焦虑”带来的理论洞察是,当下新技术的普及可能滞后于相关信息的传播,导致个体与新技术的初次接触并非一次对未知的全新体验;相反,他们往往已经拥有对其功能的预期理解。以LLMs为例,ChatGPT和同类的“文心一言”等大模型,在本文写作之时仍然没有实现社会性普及,但人们早已通过各种途径(如人际交流、新闻报道、网络视频文章等)获得了相关信息,特别是关于如何利用提示词激发LLMs能力的信息,使人们可能提前抱有“这个技术具有广阔的潜能,能否发掘出这些潜能取决于我自己”的心态,而非像过去的人们面对新技术降临,多在等待实际操作以获取直接的反馈。这一变化标志着人机交互从以往的“直接探索式交互”转为“预设驱动的交互”。

基于这种情况,本文提出“预设的可供性(Presupposed Affordances)”这一概念,即在接触并利用一种新技术或工具之前,用户因为社会性信息传播,已经对此技术或工具的可供性有了先验认知和预期——预设的可供性先于交互实践产生,并且会参与影响接下来的实际交互。“预设的可供性”是在“可供性的社会性”背景下提出的,尤其适合用来分析深度媒介化时代新技术的社会应用过程。

需要指出的是,此前已有学者探讨过预期在可供性感知中的作用,例如Nagy和Neff提出了“想象的可供性(Imagined Affordance)”,以此来强调用户如何基于自己对技术物的期望、态度和感觉来想象和理解它们的可供性。这个概念具有三个面向:中介(Mediation)、物质性(Materiality)和情动(Affect),最显见的贡献是将人的知觉和感官元素纳入到了对技术物的研究中,因为两位研究者希望覆盖一种容易被忽视的情形:“对技术的期望在有意识的、理性的知识中没有完全实现。”①【①Nagy P,Neff G.Imagined Affordance:Reconstructing a Keyword for Communication Theory.Social Media+Society,2015,1(2),p.1.】而“想象的可供性”也平衡了此前学者过分注重技术/物如何被社会文化环境影响和塑造的倾向,是一种更微观、更注重个体经验和主观性的视角。

本文提出的“预设的可供性”和“想象的可供性”不同。虽然两者都关注的是个体在实际接触和使用一种技术或工具之前对其性能和可供性的认知和期待,但“预设的可供性”强调的是社会性信息传播和技术普及之间的时间差所造成的观念影响,重视传播作为一种社会性要素参与可供性塑造的过程;而“想象的可供性”不仅包含了用户的感知、态度和期待,也涵盖了技术的物质性和功能性,以及设计者的意图及其感知。换言之,“想象的可供性”更侧重于想象的过程,强调的是个体的心理活动和主观体验。

(三)可供性与想象力的关系

此外,提示词的存在令想象力②【②仍旧不同于“想象的可供性”,这里的想象力是“imagination”而不是“imagining”“imagined”。】这个要素前所未有地凸显了出来。这是因为大语言模型的可供性超越了物理属性和直接知觉的范畴,更多地涉及语境理解、语义推理以及创新思维等高级认知活动,其带来的可供性前所未有的辽阔。而此时用户启动想象力和创新思维主动参与人机交互就变得非常重要。这意味着人不仅仅是在现有知识和技能的基础上应用模型,更是在理解和掌握模型原理的基础上,通过创新思维创造出新的、有意义的使用方式。

在大语言模型的时代,面对其提供的丰富可能性,个体是否主动拓展其想象力将决定其在人机交互中的经验和收获。倾向于在人机互动中主动想象的人群,有可能使用AI工具进行创新思维和高级认知活动,引领创新的方法论革新,为社会带来新的思维模式和解决方案。相比之下,不主动想象的人群可能陷入被动、依赖、跟随的局面,而接纳和使用技术方式的差异化,可能基于技术理解和应用能力的社会分层。在这种分层中,想象力和创新思维成为区分不同群体的关键特征,它们可能会影响个体在社会、经济和文化中的地位和权力。

鉴于此,一种新型的、以想象力为核心、以社会性为主要特征的多元、复杂的可供性生成机制出现了,它表明单项技术物带来的可供性不是孤立存在的,而是依赖于个体与社会的互动,以及个体、社会对该技术物的共同理解和预期。思考人机互生时代的可供性时,必须将注意力扩大到包括想象力在内的多元互动过程中,才能更全面、更准确地体察其本质;它要求人们真正注意的,是当下社会中包括人与非人在内的万事万物之间越来越广泛且深刻的相互关联。

(四)可供性的危机:人、物二元性的模糊

当下处于人机互生时代的发端,人仍然保有自己的主体性,然而若再深入思考可供性理论,便会发现它面临着一个深层危机:人、物二元性的模糊。

在吉布森的可供性理论中,人和物的二元性是基本假设:人是主体,物是客体,而可供性是主客体间的一种本真关系,即“二元论基础上的一元构造”①【①孙凝翔,韩松:《“可供性”:译名之辩与范式/概念之变》,《国际新闻界》2020年第9期,第125页。】。然而,大语言模型这样的高级人工智能技术挑战了这一假设——它不是普通工具而是认知工具,它不是单纯的“被使用”而是会基于庞大的人类语言认知资源反过来影响和塑造使用者的想法、情绪、想象力和决策过程。人的主体性边界就此被突破了。

此外吊诡的是,大语言模型实际上既不是人也不是纯然的“物”,而是人类语言及认知的滋生物,是对人思维的模拟,是一种模仿生命的“类人交往对象”。当下LLMs的生成内容全部基于人类语料库加工,而可以预见在不久的将来,LLMs的训练语料库中会混入大量AIGC,近似于“类人物的滋生物”,这会让LLMs往“物性”的一端再稍微移动一些,但本质上它仍旨在作用于人的主体性。

当下这种人机互生关系,确实使人工智能从客体位置上“一跃而起”,将整个社会推向一种“后‘人-物’二元性(Post-human-object Dualism)”时代。这个转变对于可供性理论的影响是深远的,因为它要求人们重新考虑该如何理解和评价人和技术之间的关系——如果使用者的主体性可以被机器所影响,那么,我们如何理解和评估他们的感知、进而如何捕捉技术的可供性呢?在这种新情况下,可供性不是来自人感知的物的固有属性,而是人和物共同创造的结果。如此,那么研究者需要开发新的理论工具和框架以理解这个日趋复杂的世界。可供性理论会就此终结吗?这个问题还需要时间来给出证明。

五、总结

人机关系可以从宏观、中观、微观等不同层面进行讨论。截至目前,学界对当下以大语言模型为代表的人工智能技术革命的关切大多聚集在宏观议题,例如后人类、生产力革命、认知格局再造等,少有从微观情境切入者。而本研究旨在从“提示词”这一具体、微小但关键的人机交互中介入手,借助可供性理论视角来透视当下的AI技术进步对于人和社会究竟意味着什么。更重要的是,也反过来利用最新的社会现实来测试可供性理论的鲁棒性,指出其发展可能与潜在危机。

在人类思想史上,对主体性的守卫是一条贯穿始终的线索,因而在技术发展进程中,机器但凡有一点主体僭越迹象都要被人类狠狠打压,然而现代社会对效率的无限追逐又营造了一种反作用力,这使得与人类认知互生的机器智能之诞生不可避免,ChatGPT、文心一言等大语言模型都属此类,它们既为人类认知的增强提供了支撑,又给干预人类认知提供了机会,并直接带来了人类认知独立性的失效①【①邱泽奇:《认知域:从习以为常到人机互生》,《人民论坛·学术前沿》2023年6月上期,第12页。】,连带效应便是人与物之间二元分野的失效和可供性理论的危机。纵观整个过程可知,技术物虽然尚未僭越,但已经“不安于”客体的位置,而未来它们会是人类自我超越的契机还是生存威胁?悲观和乐观的回答都已被陈述完毕,但在结局揭晓之前,人们有责任并有必要随时审视与这些技术的交互方式、审视自身独立性,思考人和机器共享空间、共享工作,甚至共享认知的可能路径,最终去理解、适应我们所在的这个时刻变动、日趋复杂的世界。

Opportunities and Challenges of Affordance Theory in the Age of Human-Machine Symbiosis:An Examination Based on the Phenomenon of Prompts

CHEN Qiu-xin1 QIU Ze-qi2

(1.School of Communication,Soochow University,Suzhou Jiangsu" 215123,China;

2.China Center for Social and Economic Research,Peking University,Beijing 100871,China)

Abstract:This study aims to explore the implications and effects of the current AI technology revolution,exemplified by ChatGPT,from the perspective of Affordance Theory,using the specific yet critical human-computer interaction medium of “prompt”.Meanwhile,it uses the latest social realities to test the robustness of Affordance Theory,and to pinpoint its potential development and underlying crises.Through theoretical sorting,interaction practices,and observations of users,communities,and social media,the study reveals that prompts act as an “elicitation mechanism” for the affordances of large language models,providing a venue for people to learn affordances,lowering the barrier,facilitating cognitive transcendence,while potentially inducing “imagination anxiety”.Furthermore,it is proposed that the era of human-machine symbiosis has given rise to a complex and diverse affordance generation mechanism in which human-machine interaction,human-human interaction,and machine-machine interaction all play important roles,thereby enhancing the importance of sociality and imagination in affordances.In addition,the concept of “presupposed affordances” is introduced,pointing to an impending fundamental crisis in affordance theory:the blurring of the human-object dualism.

Key words:prompts;affordance;ChatGPT;LLMs;human-machine symbiosis