基于TPH-YOLO的无人机图像麦穗计数方法

2023-03-31鲍文霞谢文杰胡根生杨先军苏彪彪

鲍文霞,谢文杰,胡根生,杨先军,苏彪彪

基于TPH-YOLO的无人机图像麦穗计数方法

鲍文霞1,谢文杰1,胡根生1,杨先军2※,苏彪彪1

(1. 安徽大学农业生态大数据分析与应用技术国家地方联合工程研究中心,合肥 230601;2. 中国科学院合肥物质科学研究院,合肥,230031)

在无人机上安装光学传感器捕捉农作物图像是一种经济高效的方法,它有助于产量预测、田间管理等。该研究以无人机小麦作物图像为研究对象,针对图像中麦穗分布稠密、重叠现象严重、背景信息复杂等特点,设计了一种基于TPH-YOLO(YOLO with transformer prediction heads)的麦穗检测模型,提高无人机图像麦穗计数的精度。首先,为了减小光照不均匀对无人机图像质量造成的影响,该研究采用Retinex算法进行图像增强处理。其次,在YOLOv5的骨干网络中添加坐标注意力机制(coordinate attention,CA),使模型细化特征,更加关注麦穗信息,抑制麦秆、麦叶等一些背景因素的干扰。再次,将YOLOv5中原始的预测头转换为Transformer预测头(transformer prediction heads,TPH),该预测头具有多头注意力机制的预测潜力,可以在高密度场景下准确定位到麦穗。最后,为了提高模型的泛化能力和检测精度,采用了迁移学习的训练策略,先使用田间采集的小麦图像数据集对模型进行预训练,接着再使用无人机采集的小麦图像数据集对模型进行参数更新和优化训练,并在无人机采集的小麦图像数据集上进行了试验。结果表明,该研究方法精确率、召回率及平均精确率分别为87.2%、84.1%和88.8%,相较于基础的YOLOv5平均精确率提高4.1个百分点,性能优于SSD、Faster-RCNN、CenterNet、YOLOv5等目标检测模型。此外,该研究利用公开数据集Global Wheat Head Detection(GWHD)在不同目标检测模型上进行对比试验,该数据集的小麦样本是多样的和典型的,与SSD、Faster-RCNN、CenterNet和YOLOv5等模型相比,平均精确率分别提升11.1、5.4、6.9和3.3个百分点,进一步验证了该研究所提方法的可靠性和有效性,研究结果可以为小麦的产量预测提供支撑。

无人机;图像处理;麦穗计数;YOLOv5;注意力机制;transformer编码器;迁移学习

0 引 言

小麦是重要的农作物品种之一,是世界粮食安全的基础[1],全球年产量约为7.3亿t。然而小麦在生产过程中经常出现各种生物和非生物逆境,小麦产量会受到很大影响。近年来,利用无人机遥感技术对小麦生长进行监测已成为稳定产量的重要途经。无人机以其灵活、小巧、成本低等优势逐渐受到研究者们的关注和青睐。结合无人机图像对麦穗进行检测和计数,可以大大降低人工成本,实现自动化估产。传统小麦计数主要包括人工计数方法和传统机器学习方法。其中人工计数方法不但十分繁琐、耗费不少的人力和物力成本,而且很容易出现错误[2]。传统机器学习则是一种简单而有效的实现麦穗自动计数的方法。ZHOU等[3]利用半自主多传感器田间表型平台获取小麦图像,先使用最大熵分割方法进行粗分割,然后应用形态学重建理论对图像进行精细分割,最后实现麦穗计数。FERNANDEZ-GALLEGO等[4]通过使用滤波和寻找最大值的方法,有效地提高了田间麦穗的识别精度。刘哲等[5]提出了一种改进的K-means聚类方法,该方法以颜色特征聚类为基础,把聚类区域内的子区域数作为麦穗数估计值,从而大大提高了麦穗计数的准确率。在大田环境下,上述传统方法对纹理、颜色等依赖性较强,受土壤、光照、小麦麦叶等影响较大,对麦穗的计数效果并不理想。

近年来,深度学习已成为人工智能领域的研究热点,同时该技术也被研究者们应用到麦穗检测和计数领域中。鲍文霞等[6]针对灌浆期田间小麦图像麦穗密集的特点,引入一种拥挤场景识别网络(congested scene recognition network,CSRNet)来构建麦穗密度图估计模型,实现田间小麦麦穗数估计。孙俊等[7]以CSRnet为基础网络构建WECnet网络,有效地提高灌浆期小麦的计数精度,同时对麦穗进行准确密度评估。李云霞等[8]设计了一种冬小麦田间长势参数估算系统,该系统基于残差网络ResNet18构建长势参数估算模型,实现麦穗长势参数估算;基于Faster R-CNN并结合非极大值抑制构建麦穗计数模型,实现开花期麦穗准确计数。目前,目标检测算法在麦穗检测的任务上取得了显著的进步。小麦麦穗检测任务的成功,使得田间麦穗计数方法也获得了较高的准确性[9-10]。MADEC等[11]利用R-CNN对麦穗进行检测,根据检测到的麦穗个数实现麦穗计数。杨蜀秦等[12]为准确获取单位面积麦穗数,提出了基于改进YOLOX的单位面积麦穗检测方法,利用采样框直接实现单位面积麦穗计数。YANG等[13]结合卷积神经网络和注意力机制技术,创建了一种用于麦穗检测的CBAM-YOLOv4 计数方法。陈佳玮等[14]构建了一种MobileNetV2-YOLOV4 深度学习模型,对单位面积中的麦穗进行识别,通过安卓软件YQ-M离线识别手机拍摄的麦穗数量,实现田间产量预测和结果输出等功能。

以上方法虽然在田间麦穗的检测和计数领域取得了一定的效果,但是无人机图像具有麦穗分布稠密、重叠现象严重、尺寸小、背景信息复杂等特点,容易导致错检和漏检,从而使麦穗检测精度降低,无法进行准确计数。基于此,该研究以无人机小麦图像为研究对象,提出了一种基于TPH-YOLO的麦穗计数方法。该研究在YOLOv5的骨干网络中添加坐标注意力机制(coordination attention, CA),使模型能够细化特征,更加关注麦穗,抑制麦秆、麦叶等一些复杂背景的干扰。同时,该研究采用具有多头自注意力机制的Transformer编码器模块替换Neck中的CSP(cross stage partial)模块,将原始的预测头转换成Transformer预测头(transformer prediction heads,TPH)[15-16],获取全局信息和丰富的上下文信息,实现高密度场景下的麦穗计数。在模型训练过程中,该研究采用迁移学习的策略,先使用田间采集的小麦图像数据集对模型进行预训练,然后再使用无人机采集的小麦图像数据集对模型参数进行调整和优化,提高了模型的泛化能力和检测精度。最后,将其与SSD、Faster-RCNN、CenterNet和YOLOv5等模型进行对比试验,验证该研究所提方法的有效性。

1 材料和方法

1.1 数据采集

本试验的研究区域是安徽省合肥市巢湖市坝镇(北纬31°16′23.9″,东经117°36′18.3″),该基地主要承担小麦、水稻等多种农作物的表型信息采集工作。数据采集时间为2021年5月3日09:00-16:00,多云天气,减少了强光照对数据采集的干扰。温度范围18~25 ℃,湿度范围在30%~50%之间。本试验使用的图像采集设备为大疆Mavic Air 2无人机,它装有一个4 800万像素的可见光摄像机,摄像机类型是DJI FC3170,光圈值为f/2.8,曝光时间为1/50 s,ISO速度为ISO-100,最大续航时间为34 min,最远传输距离为10 km,最大飞行速度为19 m/s,所拍摄图像的分辨率大小是8 000像素´6 000像素,摄像机与地面垂直90°,拍摄时无人机的飞行高度是3 m,获取3幅无人机小麦图像。无人机获取的小麦图像如图1a所示。

此外,该研究使用数码相机对田间小麦数据进行采集。为了计算单位面积的麦穗数,该研究制作一个40 cm´50 cm大小的纸盒,使用佳能EOS80D数码相机进行拍摄,采用自然曝光模式以多种倾斜角度对麦穗进行拍摄,每幅图像的像素均为5 184像素´3 456像素。从采集的图像中选取342幅图像,构建田间采集的麦穗图像数据集。数据集图像示例如图1b所示。

图1 无人机和田间采集的麦穗图像示例

1.2 数据处理

1.2.1 数据裁剪

为了便于模型处理,将得到的无人机图像按照800像素´600像素的大小进行裁剪,这样原始图像就被分割成了300幅小麦子图像,并且以7∶2∶1的比例划分为训练集、验证集和测试集。

1.2.2 数据增强

大田环境下获取的小麦图像由于光照强度的变化,在视觉上会与物体本身的颜色呈现出差异,从而影响模型对麦穗检测和计数的准确性。为了减少光照不均匀对图像质量造成的影响,该研究采用Retinex算法进行图像增强处理。Retinex算法认为物体对光线的反射能力会决定物体的颜色[17],人类视觉获得的图像可以看作是由入射图像和反射图像组成:

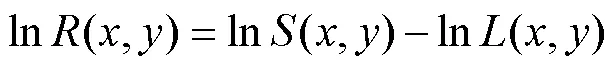

式中(,)表示人眼捕获的视觉图像,(,)表示物体的反射图像,(,)表示入射图像,(,)是图像中像素点的坐标。从(,)中得到(,),(,)可以表示为

对式(2)进行对数变换可得:

假设可以得出(,)的值,则可根据式(3)计算出(,)。因为入射光线的强度在被照表面变化相对较慢,所以(,)可以用图像中的低频分量来表示。通过计算原始图像中像素点与周围区域的加权平均(,)来估计照度的变化并将其去除,最后只保留物体的反射属性,则入射图像(,)可表示为

式中(,)为中心环绕函数。则

因此,将lnR(x,y)变换为实数域,可以从人眼视觉图像S(x,y)中得到反射图像R(x,y),达到图像增强的目的。增强后的图像示例如图2所示。

1.3 麦穗检测方法

1.3.1 TPH-YOLO模型

大田环境下无人机图像麦穗分布稠密、重叠现象严重,会出现许多错检和漏检的现象;同时,麦穗尺度小、背景复杂也增加了检测的难度,这些问题导致在无人机图像中无法对麦穗进行准确地检测和计数,因此,需要选择一种有效的检测模型对麦穗进行检测。YOLO(You Only Look Once)是一种只需一个卷积神经网络就可直接得到不同目标的类别概率和位置坐标的目标检测模型,可以更好地区分目标区域和背景区域,YOLO系列一般包括YOLO[18]、YOLO9000[19]、YOLOv3[20]、YOLOv4[21]和YOLOv5。YOLOv5是当前YOLO系列最新的目标检测模型,大致可分为 4个模块:输入端、骨干部分(backbone)、颈部(neck)以及预测头(prediction head)。该模型具有检测精确、速度快等优点,在开源数据集上具有良好效果,但是在大田环境下对无人机图像中麦穗的检测和计数任务上仍需要改进。

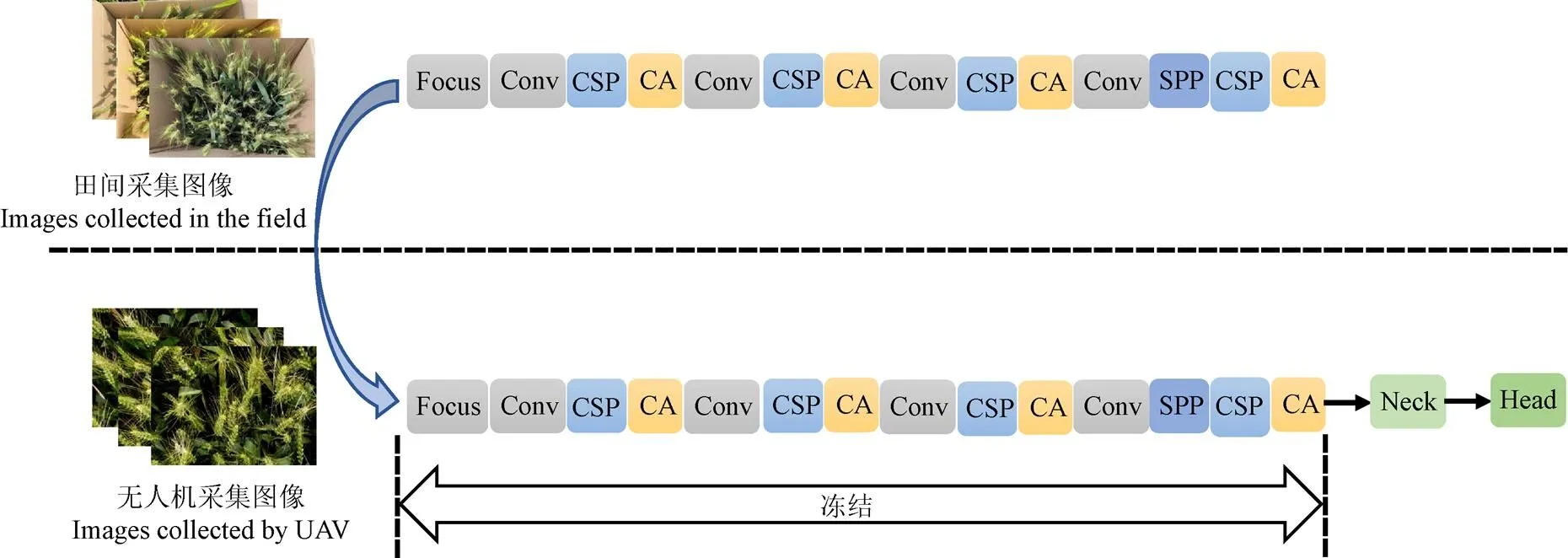

为此,该研究引入了一种简单灵活的坐标注意力机制[22](CA),将其加在骨干网络CSPDarkNet-53中的CSP(cross stage partial)模块和卷积模块之间,模型结构如图3所示,使模型能够细化特征,提高特征提取的能力,从而能更加关注小麦麦穗,抑制麦秆、麦叶等背景因素的干扰。当图像输入到TPH-YOLO骨干网络部分中时会进行切片操作,即特殊的下采样,把高分辨率的特征图拆分为多个低分辨率的特征图,然后将得到的特征输入到不同深度的CSP模块中进行特征提取,CSP模块将输入特征经过两个部分,然后通过跨阶段层次结构将其合并,其目的是实现更多的梯度组合信息从而获取更加丰富的麦穗特征。同时,该研究采用了具有多头自注意力机制的Transformer编码器模块。Transformer的出现为视觉特征研究提供了一种新的思路[15]。与卷积神经网络相比,基于Transformer的视觉模型在众多领域[16]取得了很好的效果。该研究使用Transformer编码器模块替换Neck中的一些CSP模块,将原始预测头转换成Transformer预测头(transformer prediction heads,TPH),实现具有多头注意力机制的预测潜力,捕获全局信息和充足的背景信息,进而在高密度场景中准确地定位到麦穗。

注:Focus为切片操作,Conv为卷积操作,CA为坐标注意力机制,Slice为切片后的特征图, SPP为空间金字塔池化结构,Maxpool为最大池化操作, Concat为特征融合函数,Upsample为上采样操作,Trans为Transformer编码器结构,TPH为Transformer预测头结构。

1.3.2 训练策略

在该研究模型训练过程中采用了迁移学习的训练策略。迁移学习[23-24]广泛应用在众多领域,它可以增强训练,通过调参,逐步优化模型。该研究先使用田间采集的小麦图像数据集对模型进行预训练,得到了预训练模型,接着使用无人机采集的小麦图像数据集对模型进行参数更新和优化训练,如图4所示。训练过程如下:

1)从田间采集的小麦图像数据集上训练TPH-YOLO的骨干网络Backbone即CSPDarkNet-53网络,得到预训练模型;

2)将预训练模型加载到TPH-YOLO中,冻结骨干网络Backbone预训练模型参数,再从无人机采集的小麦图像数据集上训练TPH-YOLO,只对后端的Neck和Head进行重新训练和更新参数。

田间采集的小麦图像和无人机采集的小麦图像颜色、轮廓、纹理等基础结构相近,这些基础结构在卷积神经网络中属于底层信息,靠近输入端的骨干网络部分保留了大量的底层信息,所以骨干部分提取的特征是可以通用的。该研究通过田间采集的小麦图像数据集对模型进行预训练得到预训练模型,由于田间采集的图像分辨率更高,模型参数效果更好。此时,将预训练得到的权重加载到TPH-YOLO中,冻结Backbone预训练模型参数,可以减少网络层数,此时训练数据需要的更少,从而防止数据不足引起的过拟合。此外,模型不用从头开始进行训练,加快了训练效率,泛化能力更好,鲁棒性更高。

注:CSP为跨阶段层次结构,Neck为颈部结构,Head为预测头。

1.3.3 试验参数及评价指标

该研究试验是基于Ubuntu16.04 LTS 64位操作系统来实现的,显卡为NVIDIA GTX2080Ti,内存为32 G,使用Python编程语言和PyTorch深度学习框架训练目标检测模型。试验的初始学习率设置为0.01,采用随机梯度下降(stochastic gradient descent,SGD)的方法优化训练过程中的损失,迭代次数为300,批处理尺寸设置为8,权重衰减为0.000 5。该研究使用精确率(precision,)、召回率(recall,)以及平均精确率(average precision,AP)作为评价指标[25]来综合评价深度学习算法的性能。

2 结果与分析

2.1 数据增强对检测结果的影响

考虑到大田环境下采集的小麦图像会由于光照不均匀对图像质量造成影响,为提高检测精度,该研究采用Retinex算法进行图像增强处理。试验分别使用经过增强处理的图像与未经过增强处理的图像对TPH-YOLO网络模型进行训练,得到两个不同的训练模型,用以验证图像增强对检测结果的影响,试验结果如表1所示。在未经过增强处理的数据集上模型的平均精确率为87.1%,而在经过增强处理的数据集上模型的平均精确率为88.8%,证实了数据增强的必要性和有效性。

表1 数据增强对检测结果的影响

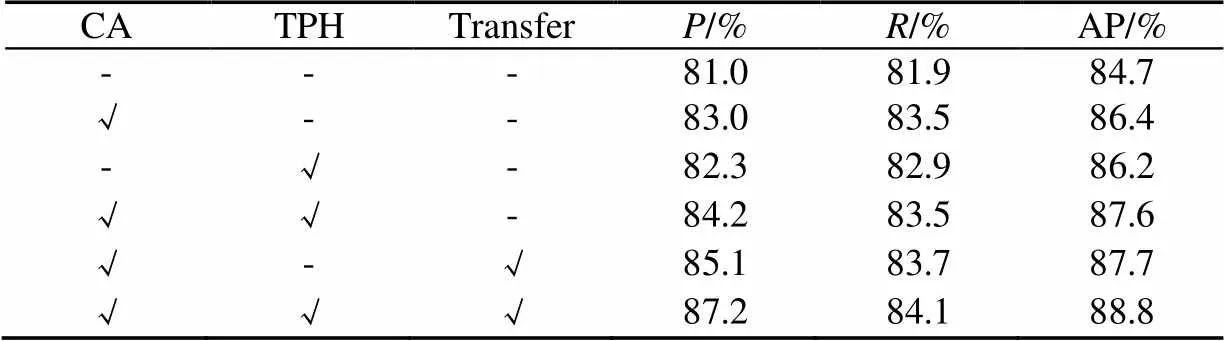

2.2 消融试验

为了验证该研究方法的有效性,对TPH-YOLO网络模型进行消融试验。该研究以YOLOv5为基础网络,分别在骨干部分加入CA、原始预测头转换为TPH预测头、采用迁移学习训练策略等进行试验,消融试验结果如表2所示。在不使用CA、TPH预测头和迁移学习的情况下,模型的平均精确率为84.7%。加入CA后,模型的平均精确率达到86.4%,说明加入CA注意力机制后,模型能够更准确地提取到小麦图像中的麦穗信息。将原始预测头转换为TPH预测头后,实现了多头注意力机制的预测潜力,从而可以获取全局信息和丰富的上下文信息,进而在高密度场景中准确地定位到麦穗,提升网络的检测结果。在训练过程中,采用迁移学习策略,不仅提高了模型的泛化能力,而且模型的平均精确率达到88.8%。使用CA、TPH预测头和迁移学习,模型能更好地提取到小麦图像中的麦穗信息以及在高密度场景中准确地定位到麦穗位置,比基准模型高了4.1个百分点。

表2 消融试验结果

2.3 不同检测模型对比试验

为了进一步验证该研究方法对无人机图像中麦穗检测的有效性,将该研究提出的模型与一些主流目标检测模型进行对比试验,对比的检测网络有:SSD[26]、Faster-RCNN[27]及CenterNet[28],试验结果如表3所示。从表3可以看出,所提模型的检测结果优于SSD、Faster-RCNN、CenterNet等检测模型。

表3 本研究模型与主流模型对比结果

图5以测试集中3幅小麦图像为示例展示YOLOv5模型及本研究模型的检测结果,图6为图5在麦穗重叠问题上的局部放大示例图。通过图5和图6可以看出,本研究模型可以更加注意到麦穗信息,能够在高密度场景准确定位到麦穗位置,并且有效地缓减了麦穗重叠现象,从而降低了麦穗的漏检和误检率。

注:方框表示预测框,箭头表示麦穗漏检或者误检的位置。

2.4 麦穗计数相关性研究

通过所得的检测图,即可得出每幅图的麦穗数量。将该研究研究所获得的麦穗数估计值与真实值加以比较,并通过线性回归法对结果进行了相关研究。麦穗估计值和真实值的拟合结果,如图7所示。从拟合结果来看,决定系数2值在0.95左右,说明该研究所提模型对小麦麦穗数的估计数和真实值之间存在着明显的线性关联。

图6 不同模型在重叠问题上的检测结果示例

图7 麦穗数量计数值与真实值的拟合结果

该研究在测试集的每一幅图像上都进行了10次人工统计,取平均值作为麦穗数量的真实值,并使用CSRNet[29]可视化分布麦穗图像中的麦穗位置。该研究统计出测试集的30幅小麦图像麦穗真实值为1 415,TPH-YOLO模型生成的麦穗数为1 384,错误个数为31,错误率为0.022,表明所提模型对图像中的麦穗计数误差较小。图8给出了部分图像麦穗计数结果,从图8中可以看出,TPH-YOLO模型生成的麦穗数与麦穗真实数量比较接近,验证了该研究所提方法的可靠性。

注:GT表示麦穗数的真实值;图8c中数值为TPH-YOLO模型计数值。

2.5 TPH-YOLO模型有效性分析

为了验证该研究所提模型的有效性,在公开数据集(Global Wheat Head Detection, GWHD)[30]上进行了验证分析。GWHD数据集包含3 376张RGB图像,共有145 665个小麦麦穗,图像像素大小为1 024像素´1 024像素。这些小麦图像来自世界的不同地区,获得的图像有很大的差异,包括不同的品种、不同的种植条件以及不同的图像采集方法。按照7∶2∶1的比例构建训练集、验证集和测试集,利用不同目标检测模型进行试验,其中SSD、Faster-RCNN、CenterNet、YOLOv5平均精确率分别为80.5%、86.2%、84.7%、88.3%,而本研究模型平均精确率为91.6%,优于其他检测模型,因此该研究所提模型有较好的泛化能力。

该研究研究过程中无人机飞行高度为3 m,如果希望单幅图像获取的田间面积更大则需要增加无人机的飞行高度,这时获取到的图像中的麦穗分辨率会下降,因此,在利用该研究算法计数之前需要对图像进行超分辨率重建,这也是该研究后续的研究工作。

3 结 论

该研究针对无人机图像具有麦穗分布稠密、重叠现象严重、背景信息复杂等特点,提出了一种基于TPH-YOLO的目标检测模型,能够在无人机图像中准确检测出麦穗和计算出麦穗数量。通过在YOLOv5骨干网络中加入CA模块,使模型能够细化特征,更加关注小麦麦穗,抑制麦秆、麦叶等一些背景因素的干扰。同时,将原始预测头转换为(Transformer预测头),从而可以在高密度场景准确定位到小麦麦穗。最后,在训练过程中,采用迁移学习策略来提高模型的泛化能力和加快模型收敛速度。试验结果表明,TPH-YOLO在无人机小麦图像测试集上AP值可达88.8%,相较于基础YOLOv5提高了4.1个百分点,从而说明该研究的研究结果可以为小麦在检测和计数的任务上提供有价值的帮助。此外,该研究利用公开数据集GWHD在不同目标检测模型上进行对比试验,进一步验证了该研究所提方法的可靠性和有效性。

[1] Liu H, Wang Z, Yu R, et al. Optimal nitrogen input for higher efficiency and lower environmental impacts of winter wheat production in China[J]. Agriculture Ecosystems & Environment, 2016, 224: 1-11.

[2] Xiong H, Cao Z, Lu H, et al. TasselNetv2: In-field counting of wheat spikes with context-augmented local regression networks[J]. Plant Methods, 2019, 15(1): 1-14.

[3] ZHOU C, LIANG D, YANG X, et al. Recognition of wheat spike from field based phenotype platform using multi-sensor fusion and improved maximum entropy segmentation algorithms[J]. Remote Sensing, 2018, 10(2): 246-270.

[4] Fernandez-Gallego J A, Kefauver S C, Gutiérrez N, et al. Wheat ear counting in-field conditions: High throughput and low-cost approach using RGB images[J]. Plant Methods, 2018, 14(1): 22.

[5] 刘哲,黄文准,王利平. 基于改进 K-means 聚类算法的大田麦穗自动计数[J]. 农业工程学报,2019,35(3):174-181.

Liu Zhe, Huang Wenzhun, Wang Liping. Field wheat ear counting automatically based on improved K-means clustering algorithm[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2019, 35(3): 174-181. (in Chinese with English abstract)

[6] 鲍文霞,张鑫,胡根生,等. 基于深度卷积神经网络的田间麦穗密度估计及计数[J]. 农业工程学报,2020,36(21):186-194.

Bao Wenxia, Zhang Xin, Hu Gensheng, et al. Estimation and counting of wheat ears density in field based on deep convolutional neural network[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2020, 36(21): 186-194. (in Chinese with English abstract)

[7] 孙俊,杨锴锋,罗元秋,等. 基于无人机图像的多尺度感知麦穗计数方法[J]. 农业工程学报,2021,37(23):136-144.

Sun Jun, Yang Kaifeng, Luo Yuanqiu, et al. Method for the multiscale perceptual counting of wheat ears based on UAV images[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(23): 136-144. (in Chinese with English abstract)

[8] 李云霞,马浚诚,刘红杰,等. 基于 RGB 图像与深度学习的冬小麦田间长势参数估算系统[J]. 农业工程学报,2021,37(24):189-198.

Li Yunxia, Ma Juncheng, Liu Hongjie, et al. Field growth parameter estimation system of winter wheat using RGB digital images and deep learning[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(24): 189-198. (in Chinese with English abstract)

[9] Khoroshevsky F, Khoroshevsky S, Bar-Hillel A. Parts-per-object count in agricultural images: Solving phenotyping problems via a single deep neural network[J]. Remote Sensing, 2021, 13(13): 2496.

[10] Wang D, Zhang D, Yang G, et al. SSRNet: In-field counting wheat ears using multi-stage convolutional neural network[J]. IEEE Transactions on Geoscience and Remote Sensing, 2021, 60: 1-11.

[11] Madec S, Jin X, Lu H, et al. Ear density estimation from high resolution RGB imagery using deep learning technique[J]. Agricultural and Forest Meteorology, 2019, 264: 225-234.

[12] 杨蜀秦,王帅,王鹏飞,等. 改进YOLOX检测单位面积麦穗[J]. 农业工程学报,2022,38(15):143-149.

Yang Shuqin, Wang Shuai, Wang Pengfei, et al. Detecting wheat ears per unit area using an improved YOLOX[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(15): 143-149. (in Chinese with English abstract)

[13] Yang B, Gao Z, Gao Y, et al. Rapid detection and counting of wheat ears in the field using YOLOv4 with attention module[J]. Agronomy, 2021, 11(6): 1202.

[14] 陈佳玮,李庆,谭巧行,等. 结合轻量级麦穗检测模型和离线 Android 软件开发的田间小麦测产[J]. 农业工程学报,2021,37(19):156-164.

Chen Jiawei, Li Qing, Tan Qiaoxing, et al. Combining lightweight wheat spikes detecting model and offline Android software development for in-field wheat yield prediction[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2021, 37(19): 156-164. (in Chinese with English abstract)

[15] VASWANI A, SHAZEER N, PARMAR N, et al. Attention is all you need[C]//Advances in Neural Information Processing Systems (NIPS), Long Beach: NIPS, 2017: 5998-6008.

[16] Wang W H, Xie E Z, Li X, et al. Pyramid vision transformer: A versatile backbone for dense prediction without convolutions[C]//In Proceedings of the 2021 IEEE/CVF International Conference on Computer Vision (ICCV). Montreal, Canada: IEEE, 2021: 548-559.

[17] Sun J, Yang Y, He X, et al. Northern maize leaf blight detection under complex field environment based on deep learning[J]. IEEE Access, 2020, 8: 33679-33688.

[18] REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: Unified, real-time object detection[C]// Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Las Vegas: IEEI, 2016: 779-788.

[19] REDMON J, FARHADI A. YOLO9000: Better, faster, stronger[C]//Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition, Honolulu: IEEE, 2017: 6517-6525.

[20] REDMON J, FARHADI A YOLOv3: An incremental improvement[EB/OL]. (2018-04-08) [2022-08-12] https://arxiv.org/abs/1804.02767.

[21] ALEXEY B, WANG C, LIAO H. YOLOv4: Optimal speed and accuracy of object detection[EB/OL]. (2020-04-23) [2022-08-12] https://arxiv.org/abs/2004.10934.

[22] HOU Q, ZHOU D, FENG J. Coordinate attention for efficient mobile network design[EB/OL]. (2021-03-04) [2022-08-12] https://arxiv.org/abs/2103.02907.

[23] Weiss K, KhoshgoftaaR T M, Wang D D. A survey of transfer learning[J]. Journal of Big Data, 2016, 3(1): 9.

[24] GAO Y, MOSALAM K M. Deep transfer learning for image‐based structural damage recognition[J]. Computer-Aided Civil and Infrastructure Engineering, 2018, 33(9): 748-768

[25] 孙丰刚,王云露,兰鹏,等. 基于改进 YOLOv5s 和迁移学习的苹果果实病害识别方法[J]. 农业工程学报,2022,38(11):171-179.

SUN Fenggang, WANG Yunlu, LAN Peng, et al. Identification of apple fruit diseases using improved YOLOv5s and transfer learning[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2022, 38(11): 171-179. (in Chinese with English abstract)

[26] LIU W, ANGUELOV D, ERHAN D, et al. SSD: Single shot multiBox detector[C]// European Conference on Computer Vision. Amsterdam, the Netherlands: Springer, 2016: 21-37.

[27] REN S, HE K, GIRSHICK R, et al. Faster R-CNN: Towards real-time object detection with region proposal networks[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2017, 39(6): 1137-1149.

[28] Zhou X, Wang D, Krhenbühl P. Objects as points [EB/OL]. arXiv preprint arXiv: 1904.07850v2, 2019. (2022-03-10). https://arxiv.org/abs/1904.07850.

[29] LI Y, ZHANG X, CHEN D. CSRNet: Dilated convolutional neural networks for understanding the highly congested scenes[C]//Proceedings of 2018 Computer Vision and Pattern Recognition. Las Vegas: IEEE, 2018: 1091-1100.

[30] DAVID E, SEROUART M, SMITH D, et al. Global wheat head detection 2021: An improved dataset for benchmarking wheat head detection methods[J]. Plant Phenomics, 2021, 2021: 277 - 285

Wheat ear counting method in UAV images based on TPH-YOLO

BAO Wenxia1, XIE Wenjie1, HU Gensheng1, YANG Xianjun2※, SU Biaobiao1

(1.,230601,;2.,,230031,)

Optical sensors have been widely installed on unmanned aerial vehicle (UAV) to capture images of all kinds of crops in recent years. The economic and effective way can greatly contribute to yield prediction and field management in modern agriculture. However, the great challenge of wheat ear counting still remains in the dense distribution of wheat ears, the serious overlap phenomenon, and the complex background information in the images. In this study, a detection model of the wheat ear was designed to improve the accuracy of the wheat ear counting in the UAV images using the transformer prediction heads “you only look once” (TPH-YOLO). The UAV wheat ear images were also taken as the research object. Firstly, the Retinex algorithm was used to deal with the enhancement of the wheat ear images that collected by the UAV, in order to reduce the influence of the uneven illumination on the image quality. Secondly, the coordinate attention mechanism (CA) was added to the backbone network of YOLOv5. In this way, the improved model was utilized to refine the features after treatment. As a result, the TPH-YOLO network was focused mainly on the wheat ear information, at the same time to avoid the interference of some background factors, such as the wheat stalk, and the wheat leaf. Once more, the original prediction head in the YOLOv5 was converted into the transformer prediction head (TPH) in this case. Correspondingly, the improved prediction head was obtained for the prediction potential of multiple head attention mechanism, in order to accurately fix the position of the wheat ears in a high-density scene. In the end, the training strategy was adopted to improve the generalization ability and the detection accuracy of the TPH-YOLO network using transfer learning. The image dataset of the wheat ear that was collected in the field was used to pre-train the model, and then the wheat ear image dataset collected by the UAV was used to update and optimize the model parameters. A series of experiments were conducted on the wheat ear images collected by the UAV. The performance of the target detection model was evaluated by the three indicators: Precision, recall, and average precision (AP). The experimental results show that the precision, recall, and average precision (AP) of the improved model were 87.2%, 84.1%, and 88.8%, respectively. The average precision of the improved model was 4.1% higher than the original YOLOv5 one. The performance was also better than the SSD, Fast RCNN, CenterNet, and Yolov5 target detection models. In addition, Global Wheat Head Detection (GWHD) dataset was selected to carry out the comparative experiments on the different target detection models, due to the diverse and typical wheat samples from the GWHD dataset. Compared with the target detection models such as SSD, Faster-RCNN, CenterNet and YOLOv5, the average precision increased by 11.1, 5.4, 6.9 and 3.3 percentage points respectively. The comparative analysis of the detection further verified the reliability and effectiveness of the improved model. Consequently, the finding can also provide strong support for the wheat yield prediction.

UAV; image processing; wheat ear counting; YOLOv5; attention mechanisms; transformer encoder; transfer learning

10.11975/j.issn.1002-6819.202210020

TP391.41

A

1002-6819(2023)-01-0155-07

鲍文霞,谢文杰,胡根生,等. 基于TPH-YOLO的无人机图像麦穗计数方法[J]. 农业工程学报,2023,39(1):155-161.doi:10.11975/j.issn.1002-6819.202210020 http://www.tcsae.org

BAO Wenxia, XIE Wenjie, HU Gensheng, et al. Wheat ear counting method in UAV images based on TPH-YOLO[J]. Transactions of the Chinese Society of Agricultural Engineering (Transactions of the CSAE), 2023, 39(1): 155-161. (in Chinese with English abstract) doi:10.11975/j.issn.1002-6819.202210020 http://www.tcsae.org

2022-10-02

2022-12-28

安徽省自然科学基金项目(2208085MC60);国家自然科学基金项目(62273001)

鲍文霞,博士,教授,研究方向为农业与生态视觉分析与模式识别。Email:bwxia@ahu.edu.cn

杨先军,博士,研究员,研究方向为智能信号处理。Email:xjyang@iim.ac.cn