一种基于物影匹配算法的道路小目标跟踪方法

2023-01-05项新建胡海斌姚佳娜丁祎郑永平金立

项新建,胡海斌,姚佳娜,丁祎,郑永平,金立

(1.浙江科技学院,自动化与电气工程学院,杭州 310023;2.浙江省交通运输科学研究院,杭州 310023;3.浙江小桥流水环境科技有限公司,杭州 310023)

0 引言

随着交通道路的快速发展,车流量增长导致道路抛洒物事件激增。小型抛洒物,例如石块、包装袋等掉落与抛洒具有速度快、难以躲避的性质;会对行车造成视野遮挡与车辆破损,进而引发严重的交通事故,对道路司乘人员造成极大的安全隐患[1]。复杂光照条件下,小目标的检测较为困难,传统的目标跟踪算法难以胜任,因而在复杂道路环境下的小目标抛洒物准确检测与跟踪[2],成为智慧交通领域一个较为困难但十分有意义的问题。

田会娟等[3]和王瑞等[4]基于视频感知道路信息,但视频图像受光线、天气、复杂动态背景、抖动等因素影响,常见的检测方式难以有效处理交通领域出现的各种情况。

目前主流的视频检测跟踪方法采用目标检测与滤波跟踪相结合的方式。Henriques 等[5]提出核相关滤波算法(KCF)视频目标跟踪模型,该类方法一定程度上减少了模型计算量,KCF利用循环矩阵可以在傅里叶域对角化的性质,大幅缩短了处理时间,但算法易产生边界效应导致跟踪效率不高。Kiani 等[6]提出一种基于交替方向乘数法(ADMM)的方法使滤波器应用多通道特征,扩大搜索域的同时减少计算量。Danelljan等[7]提出一种精准尺度估计的跟踪算法(DSST),该类方法在跟踪过程中实时对目标进行尺度预测,可一定程度上提高算法跟踪的精度和鲁棒性,但对于变化较大的抛洒物目标,易出现尺度估计不准,且该算法对定位器精度要求较高。Pu 等[8]提出一种利用视觉注意的交互学习算法,在深度学习损失函数中引入注意力正则有效地消除了背景干扰。Sun等[9]提出一种感兴趣判别区域(ROI)池化相关滤波(RPCF)算法,通过ROI 池化结果限制滤波器权重提升模型的性能。

Yan 等[10]通过Transformer 学习鲁棒的时空联合表示,将多张图像的骨干网络特征沿空间维度展开后拼接,得到一个同时包含空间与时序信息的特征序列作为编码器的输入,以学习一种强大的时空联合表示。Lin等[11]对每个像素建立高学习率与低学习率双混合高斯模型,利用前景中抛洒物的消散帧差来判断抛洒物的静止帧。Dwivedi等[12]采用帧差法提取前景,加入canny算子检测前景目标边缘,比较连续帧边缘质心判别是否为丢弃物。该类方法可将复杂环境下的检测问题转化为简单前景检测问题,一定程度上抑制了复杂光变化对检测精度造成的影响。

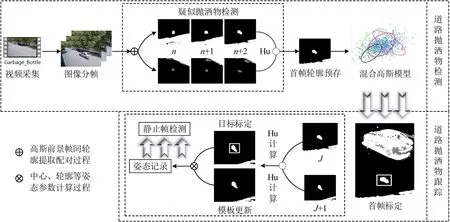

根据道路抛洒物及其空中运动时产生独立物影闭轮廓的特性,本文提出一种基于物影匹配算法的道路小目标跟踪方法。包括抛洒物首帧定位模块与跟踪模块,使用混合高斯模型与物影匹配算法(OSMA),将复杂环境下的道路小目标抛洒物的运动跟踪,转化为高斯域前景目标跟踪。通过大量自采数据集验证其算法的有效性。

1 混合高斯与阴影检测

1.1 混合高斯模型背景分离

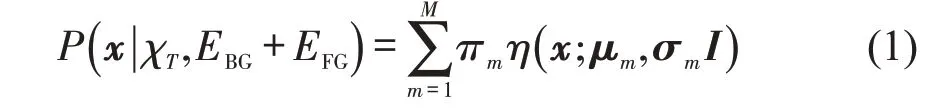

使用具有M个分布的混合高斯分布模型确认视频图像中每个像素点的前背景归属。

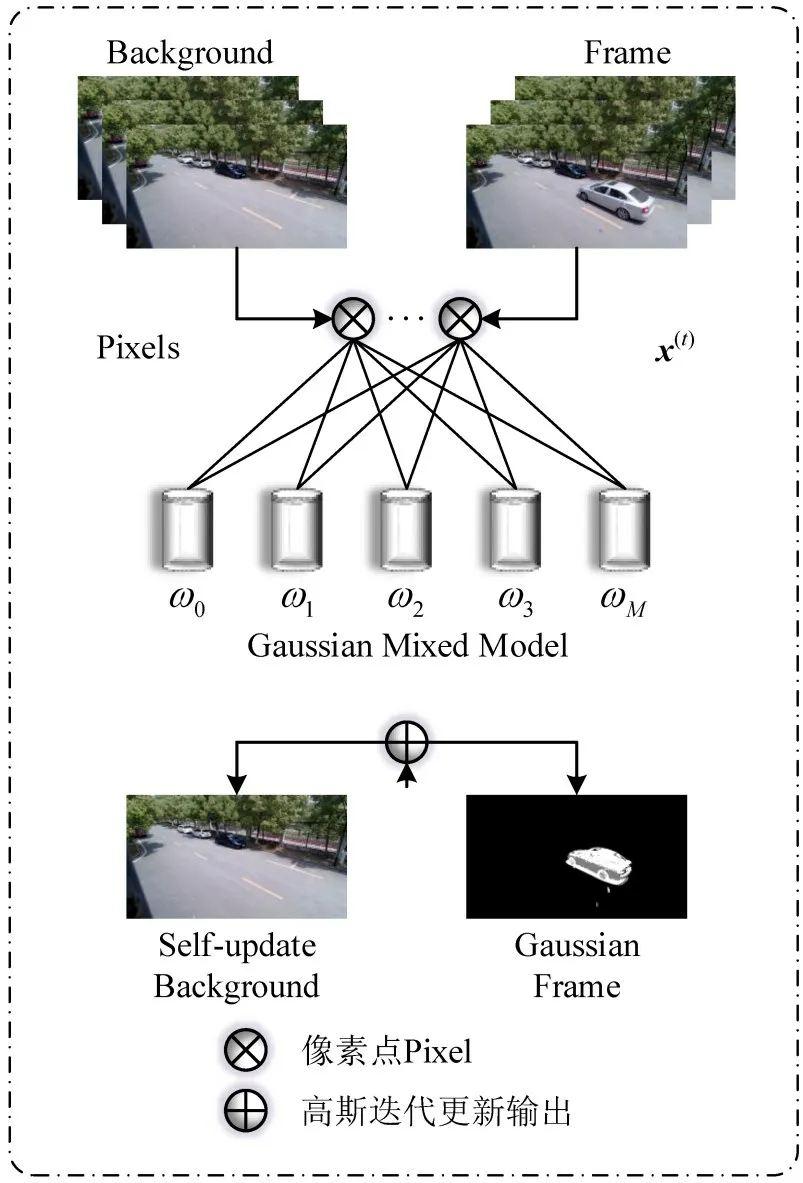

式中:时间t时的样本集χT={x(t),…,x(t-T)}用于表示在时间窗口T内不断增加新样本更新背景模型,以适应复杂环境变化;x(t)为t时刻的样本;x为像素值;m为像素点归属的子分布序号;EBG与EFG分别为背景、前景分量;πm为M个混合模型的权重;η为高斯分布的概率密度函数;μm与σmI分别为t时刻像素点的均值与协方差矩阵,其中,σm为高斯分布方差估计值,I为单位矩阵

模型更新方程为

式中:中心向量δm=x(t)-μm;α为指数级下降的包络曲线,用以限制旧数据的影响;为像素x(t)符合分布模型的归属因子,最符合的分布模型归属为1,其余模型为0。像素x(t)马氏距离是否小于3 倍的标准差用于判别该像素是否符合现有高斯分布,马氏距离公式为

混合高斯模型背景分离具体流程如图1所示,图中ωM为混合高斯模型的M个子分布。

图1 GMM算法流程Fig.1 GMM algorithm flow

1.2 阴影区域检测

为优化混合高斯模型的背景更新模式,引入阴影检测模块。阴影检测在色度分析上进行,适用于移动物体阴影检测,且对背景阴影具有抑制效果。阴影像素点St(x,y)的判别式为

式中:ρ,β,τH,τS为亮度与噪声的敏感度调节参数;It(x,y)为t时刻的图像;Bt(x,y)为t时刻图像的B分量;H,S,V为图像RGB 转换为HSV 空间的HSV分量。

2 道路抛洒物跟踪方法

2.1 算法研究思路

强光下道路行车抛物会导致复杂光环境的产生,增加小目标的定位与追踪难度。基于道路抛洒物运动过程中产生独立闭环阴影的特性,OSMA首先对混合高斯背景分离模型进行训练。训练完成后导入新帧对其参数更新,利用阴影检测模块配合前背景分离模型提取前景与阴影,对每帧导出的前景与阴影进行膨胀腐蚀的形态学处理保持前景轮廓的完整性。然后通过三帧疑似抛洒物判定法定位疑似抛洒物,最后通过疑似抛洒物轮廓帧间匹配与运动轨迹计算对道路各类抛洒物进行跟踪。

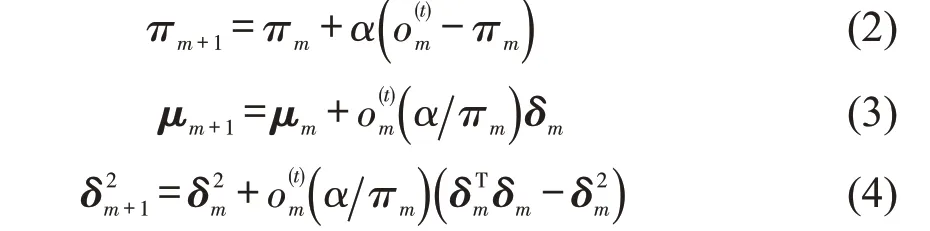

2.2 疑似抛洒物定位与跟踪

OSMA 主要是利用道路抛洒物在运动中产生独立物影轮廓的特性,对混合高斯模型产生的前景图采用三帧疑似抛洒物判定法定位疑似抛洒物,通过疑似抛洒物轮廓帧间匹配与更新来跟踪抛洒物的运动状态,具体步骤如图2 所示,图中n与J为匹配帧序号。

图2 疑似抛洒物定位跟踪算法Fig.2 Suspected projectile positioning tracking algorithm

主要步骤如下。

Step 1 利用已训练好的混合高斯模型提取视频前景,将视频从RGB彩色域转换为高斯域,高斯域对背景、前景与阴影分配的像素分别为0、127与255。对提取的前景进行先腐蚀,后膨胀的形态学操作,获取完整的前景目标。

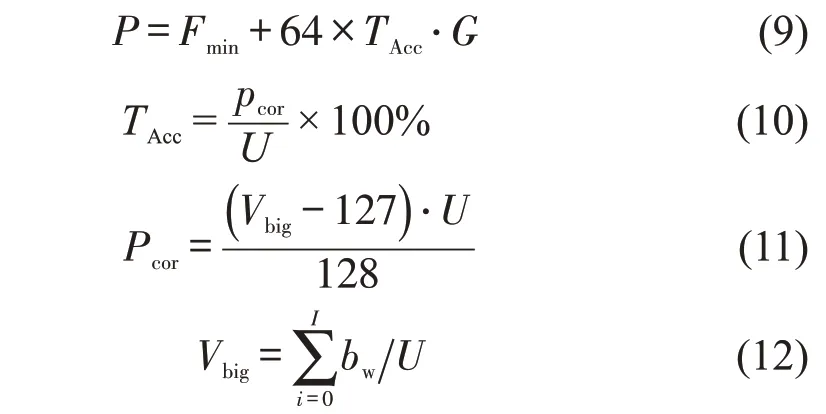

Step 2 提取当前帧所有独立闭环轮廓,并使用轮廓均值像素分割法判别轮廓类别(前景或阴影),判别式为

式中:P值用于分割当前帧中前景与阴影轮廓;TAcc为当前帧中最大轮廓前景点分割正确的概率(视频最大轮廓都为车辆、行人等运动物体,理论轮廓像素均值应为255);Fmin为分割临界值,本文取127,用于保证分隔值P处于127~255;pcor为最大轮廓分类正确的点;Vbig为最大轮廓的轮廓像素均值;U为目标像素点集合;bw为目标像素值;式(9)中64表示均值像素191(前景255 与阴影127 的平均值)与阴影像素127之差,根据单帧混合高斯模型对各轮廓判断情况的相似性,将TAcc作为当前帧正确分割概率在每帧中进行自适应更新;增益系数G用于放大自适应值TAcc的影响,并将P至127~255 全范围,用以适应各种分割情况。

Step 3 引入Match算子,利用Hu矩平移、缩放、旋转不变性,匹配目标轮廓与阴影轮廓。对出现物影匹配成功的第j帧进行物影轮廓预存,在第j+1,j+2 帧中进行预存物影轮廓更新筛选,并将多帧匹配结果的高斯域疑似抛洒物前景轮廓模板与姿态初始化保存。

Step 4 疑似抛洒物定位完成后,利用式(9)对新进帧前景做阴影剔除,获取前景目标。使用首帧疑似抛洒物轮廓模板对后续前景目标做帧间轮廓匹配与姿态判定,完成疑似抛洒物的跟踪。最后,根据疑似抛洒物多帧质心变化确定静止帧结束跟踪。

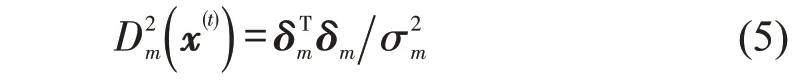

2.3 静止抛洒物判定及匹配跟踪方法

本文算法对运动过程中的疑似抛洒物做轨迹偏移判定,实现对抛洒物的动态跟踪。由于噪声与混合高斯存在,会对前景的部分误判,跟踪过程中易出现满足帧间轨迹偏移判据的噪点,导致跟踪框偏移及算法失败。因此引入影模板的更新匹配,用以限制噪点及高斯误判前景对跟踪造成的影响。抛洒物下落至道路后进入静止状态,随混合高斯模型背景模板的更新,多帧后会将抛洒物所处像素区域更新至背景模板,前景抛洒物随着模板更新出现轮廓逐帧消散的情况,不完整的轮廓对跟踪框尺度及跟踪精度都造成了较大影响,因此对视频帧采用多帧中心偏移判别抛洒物静止帧获取静止时的质心与外轮廓,降低前景消散造成的尺度与精度影响。算法步骤如图3所示。

图3 抛洒物跟踪及静止帧判别方法Fig.3 Method of scattering object tracking and static frame discrimination

主要步骤如下:

Step 1 通过联合判据记录每帧的抛洒物的质心位置,设置多帧平均偏移来判断抛洒物是否处于静止状态,对运动状态的抛洒物在高斯域做外轮廓搜索与前景判定来确定为疑似抛洒物,通过帧间质心偏移对疑似抛洒物进行跟踪,跟踪过程中对抛洒物前景模板不断更新,引入帧间模板与疑似抛洒物的外轮廓匹配方法增强跟踪的可靠性。

Step 2 针对疑似抛洒物前景目标静止后在二值域前景像素消散造成外轮廓变化及轮廓缺失导致跟踪尺度变化与跟踪失败的问题,对成功跟踪帧的疑似抛洒物做质心提取与预留,再下一帧开始前对已完成跟踪的多帧进行平均质心偏移度计算,平均质心偏移度小于阈值X,则判定为静止状态,阈值X由多个实验视频结果分析得出,视混合高斯模型学习速率而定,本文取X=2。对判定为静止帧的抛洒物,则对后续帧沿用静止帧的跟踪框与质心,结束本次跟踪。

3 实验结果与分析

3.1 实验环境

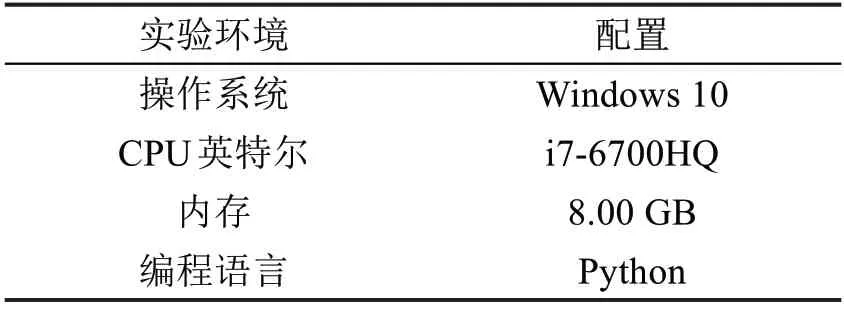

本文提出物影匹配的道路小目标抛洒物跟踪的实验环境如表1所示。

表1 实验环境配置Table 1 Experimental environment configuration

3.2 数据集与评价指标

3.2.1 数据集介绍

本文采用的视频数据为某市道路不同时间段的自采数据,抛洒物种类包括石块、橘子皮、纸巾、水瓶、3D打印小圆柱与小纸箱等6类中小目标抛洒物。为验证算法的实用性,视频拍摄地点选取周边具有泊车及外界环境树荫干扰的复杂交通路段。为验证算法在复杂道路下各类抛洒行为跟踪的有效性,对视频拍摄采用行车抛洒、骑车抛洒、行人抛洒等3种不同的抛洒行为。6条视频(对应6类抛洒物),每一条视频时长均约为45 s,帧率为30 frame·s-1,分辨率为1920×1080。其中,石块、橘子皮、纸巾、水瓶、3D打印小圆柱与小纸箱等6类中小目标抛洒物在前景中出现到消散的帧数分别为65,90,80,155,200,126 frame。

3.2.2 评价指标

本文使用4种评价指标评判算法的有效性。

(1)精确度指标。计算每一帧标注框中心点与算法输出预测框中心点的欧氏距离,计算满足中心误差阈值T0的帧占总跟踪帧数的比值。

(2)Accuracy指标。计算每一帧标注框与算法输出预测框的交并比(IOU),对所有跟踪帧的IOU取平均值作为Accuracy。

(3)AUC精准度指标。计算每一帧标注框与算法输出预测框的IOU,统计IOU大于给定阈值的视频帧数占总帧数的百分比。

(4) 每秒处理帧数(FPS)指标。算法对目标存在期间跟踪所用的时间与跟踪帧数的比值,即每秒跟踪的帧数,值越大表示跟踪的速度越快。

其中,精确度指标能较好描述预测值与已知数据真值之间的差距(与理论值相符合的程度);准确率与精准度指标可以总体上衡量一个跟踪算法的准确性,也可体现算法对跟踪框漂移的抑制能力。FPS指标则是衡量算法速度最适用的标准。

3.3 实验结果分析

3.3.1 疑似抛洒物判定实验

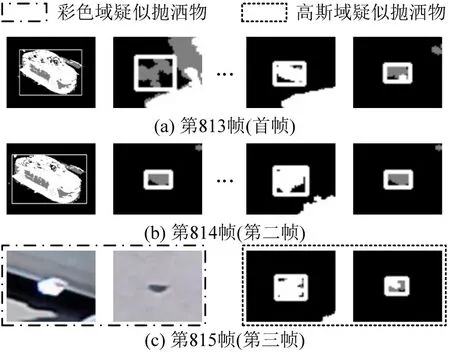

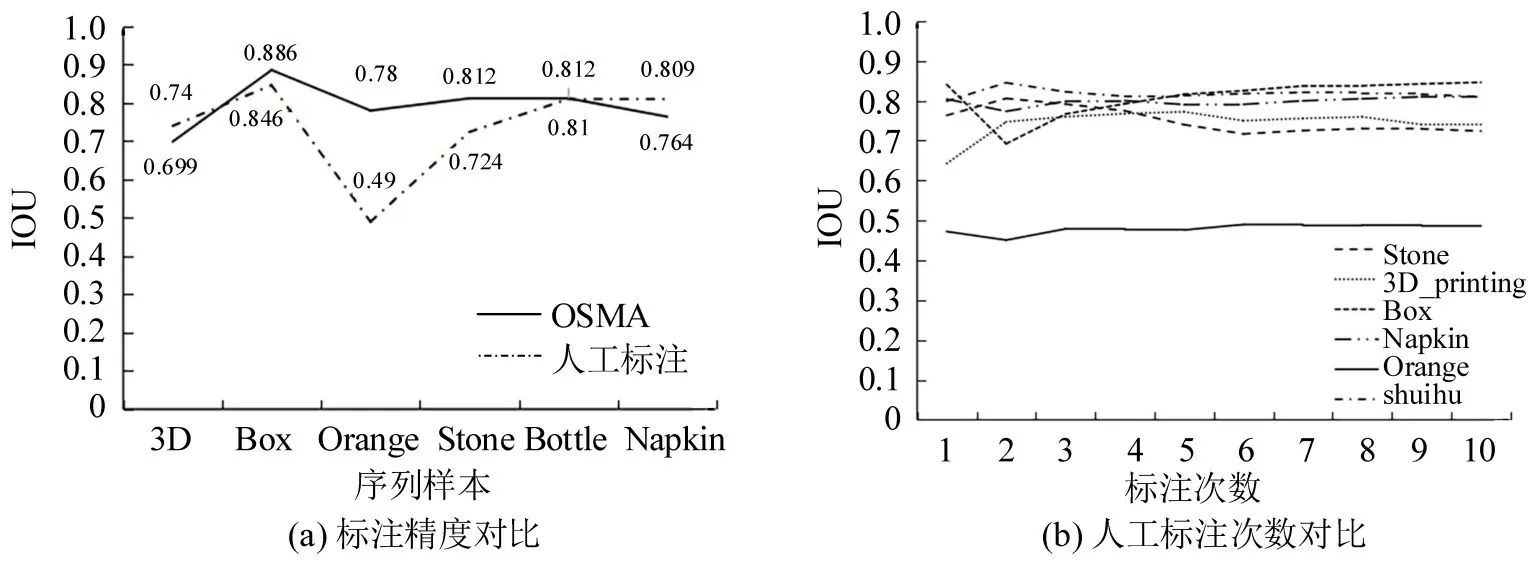

本文将脱手、与车辆分离后的物体视为抛洒物,并于脱离帧采用三帧判定法进行疑似抛洒物的判定与定位,图4为stone序列为采用三帧判定法下匹配轮廓对的变化。

图4 Napkin序列三帧判定结果图Fig.4 Napkin sequence three frame decision result diagram

如图5所示,三帧疑似抛洒物判定法依据道路脱手、脱离车辆的抛洒物存在独立物影轮廓的特征,对其脱离后的前3 帧进行物影对交叉匹配,逐帧更新匹配对,将疑似抛洒物物影对从中判出。Napkin 序列在第813 帧存在多对成功匹配的物影对,第814 帧随着混合高斯的更新,去除了部分误判为阴影的噪声。因帧间质心变化、交叉匹配等因素限制,最终在第815帧的高斯域中判出符合轨迹变化与独立物影特征的物影对,将其前景视为疑似抛洒物。

图5 Napkin序列三帧判定结果图Fig.5 Napkin sequence three frame decision result diagram

首帧目标位置判定的精确程度直接影响跟踪算法后续帧的跟踪效果。依据标注获取首帧位置、人工框定的方式无法实现自动化标注,难以应用于实际工程。相较于目标检测算法,本文提出适用于抛洒物的三帧物影匹配标定法,能够较好标定首帧抛洒物的位置并降低算法对硬件平台的要求。如图5 所示,测试多人多次对首帧目标进行标注,计算各视频序列平均交并比,与三帧物影匹配初始化的结果进行对比,结果显示,本文提出的初始化标定方法能够较好替代人工标注的方式,实现自动化标注的同时获取到较高的首帧标注精度。

3.3.2 疑似抛洒物轮廓模板更新实验

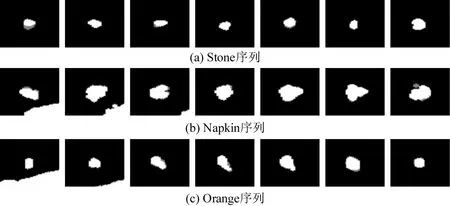

在三帧疑似抛洒物判定法对抛洒物进行分割提取后,获取到初始跟踪帧的抛洒物位置、轮廓等信息,在后续帧中利用帧间疑似抛洒物轮廓模板匹配与轨迹判断的方式进行跟踪。图6 为Stone、Napkin、Orange等序列部分帧的疑似抛洒物轮廓模板更新图。

图6 疑似抛洒物帧间模板更新图Fig.6 Inter-frame template update diagram of suspected dispersion

由图6可知,空中运动的疑似抛洒物存在高速旋转与位置角度变化的特点,对其设置单一模板进行匹配会存在多帧后轮廓变化过大导致匹配失败的问题,本文采用疑似抛洒物帧间轮廓匹配的方式,在多个序列中可以观察到帧抛洒物帧间变化较小,对疑似抛洒物轮廓进行帧间更新能够降低匹配失败的概率,提高算法跟踪能力。

3.3.3 物影匹配的小目标跟踪实验

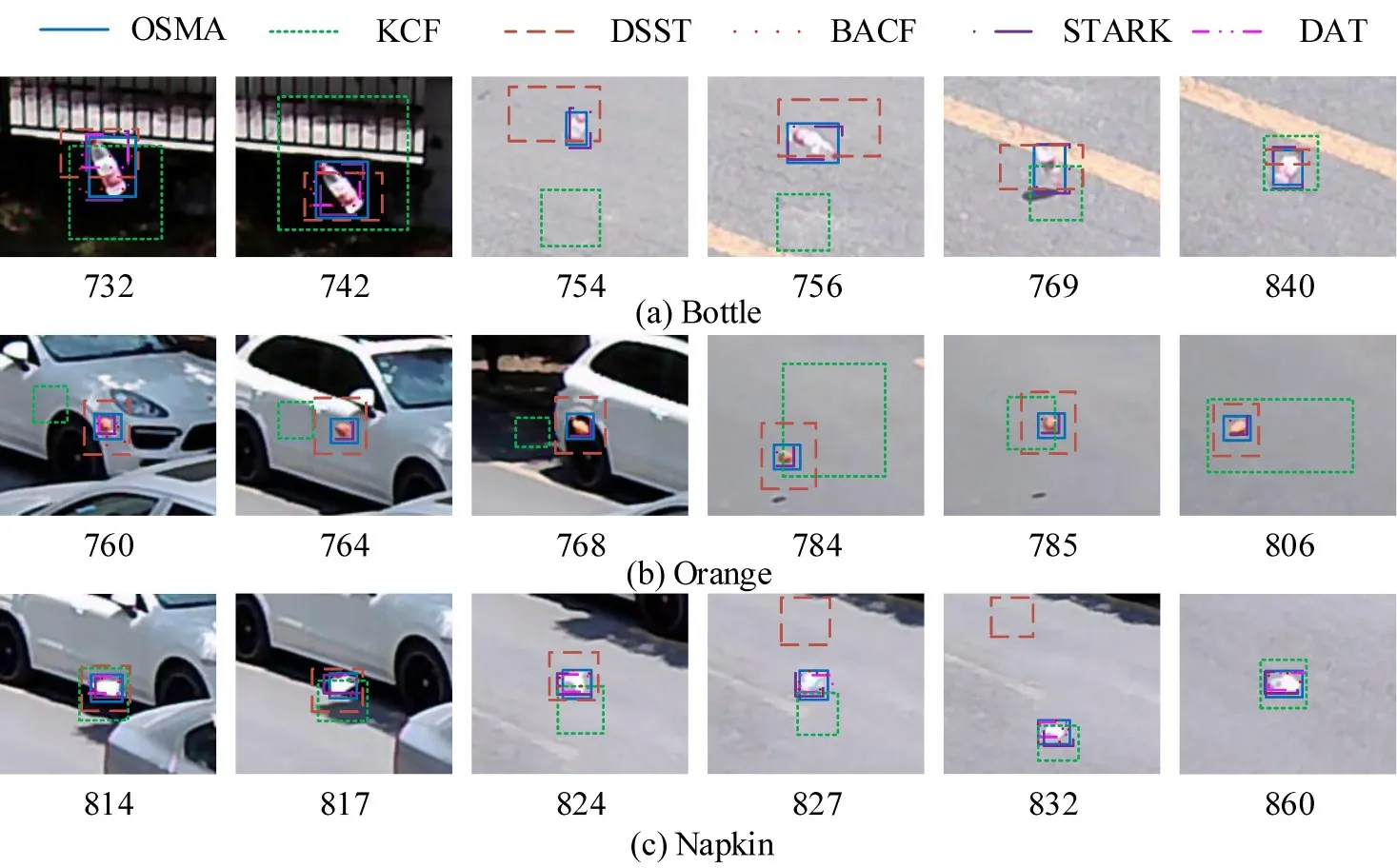

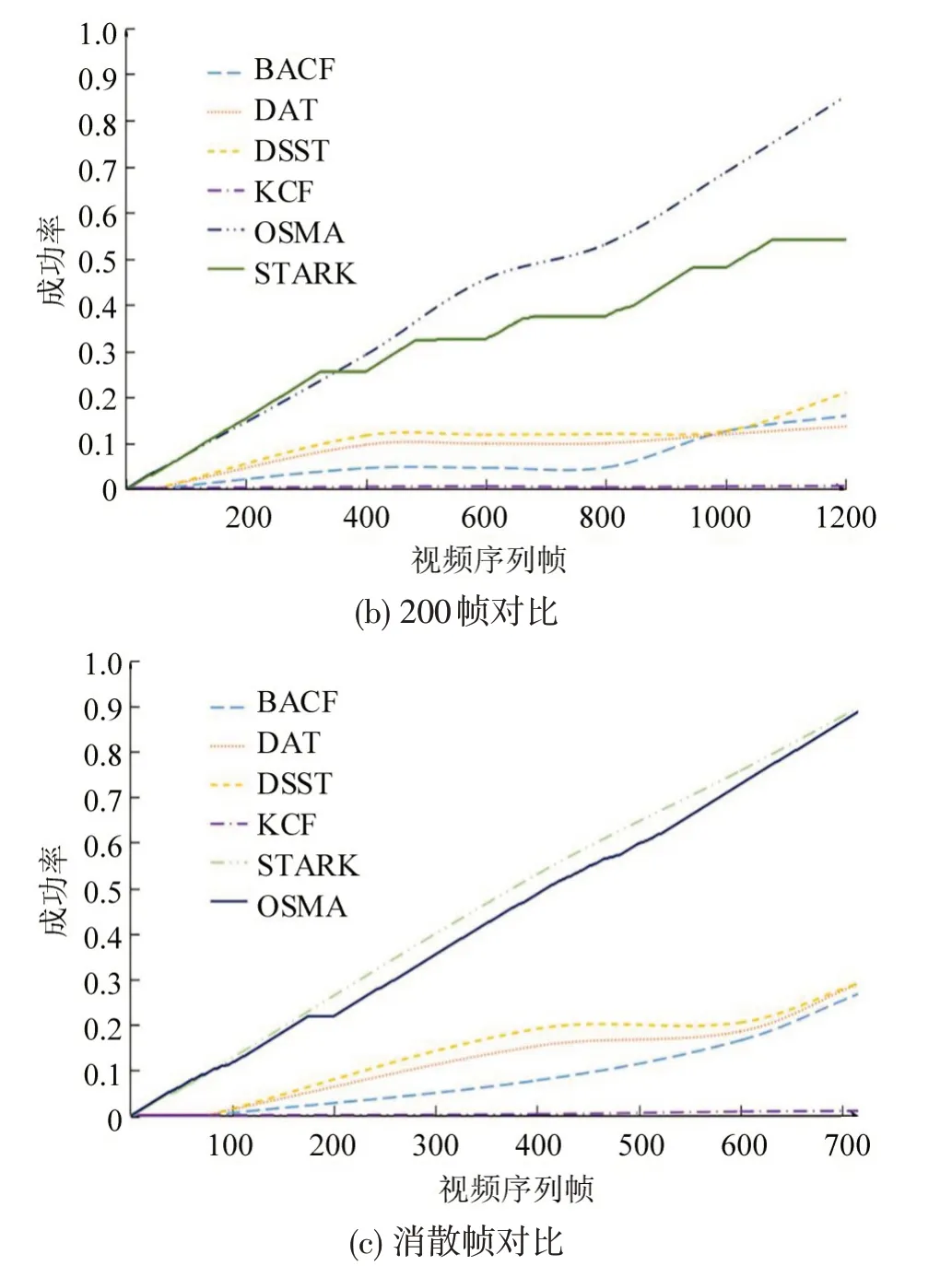

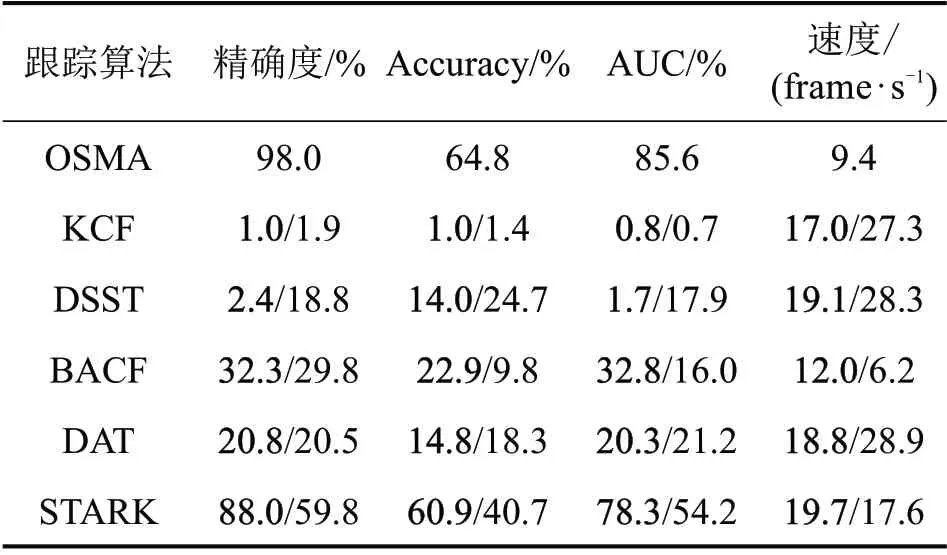

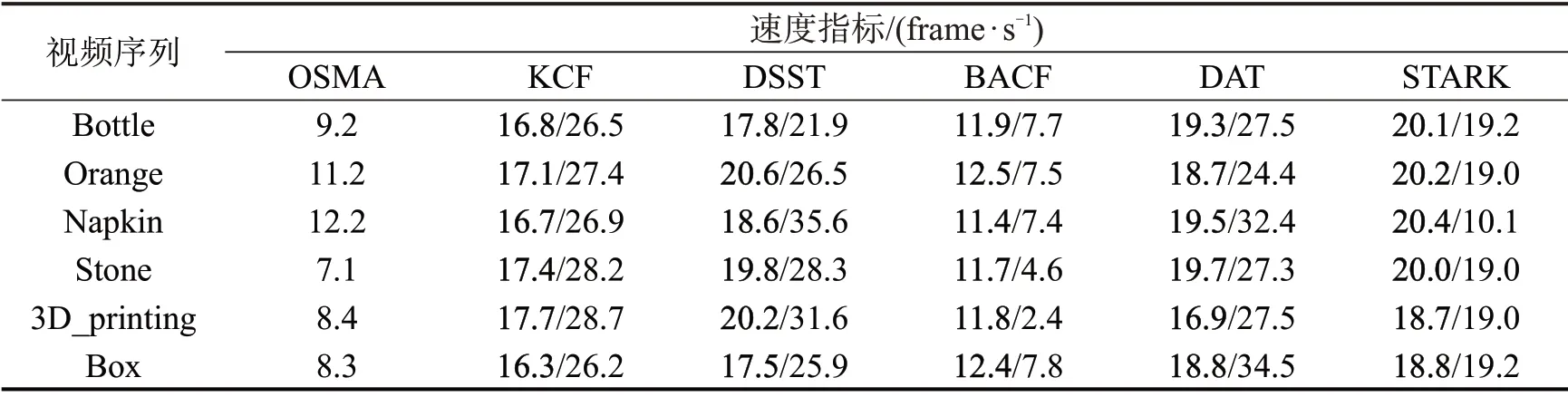

为客观验证OSMA算法及各模块的有效性,对6类常见的小型、中小型道路抛洒物(水瓶、橘皮、纸巾、石块、3D 打印物、纸箱等)视频序列进行测试,并与KCF、DSST、BACF、DAT、STARK 等算法在高斯域及彩色域上进行跟踪效果对比,并对高斯域中前景未消散帧与运动后200 frame 进行对比,验证静止帧检测的有效性。实验结果如图7~图9、表2~表6所示。

图7 是各算法在Bottle、Orange、Napkin 等6 个序列上的跟踪结果。由于视频中抛洒物快速移动、旋转等影响,KCF 与DSST 算法均出现了跟踪失败、跟踪框漂移等现象;BACF 与DAT 算法能够较好地跟踪到Napkin、Box等帧间偏移较慢的中型抛洒物,但在Stone、Orange 等小型抛洒物中表现较差;STARK 算法对中小型抛洒物都有较好的适应能力,但在Stone 序列中出现无法应对抛洒物与背景过于相似,且存在复杂光变化的情况导致误跟踪;本文提出的OSMA 能够较好地适应快速移动、旋转、复杂光照、背景相似等问题,跟踪尺度框基于轮廓获取,具有较好的跟踪效果。

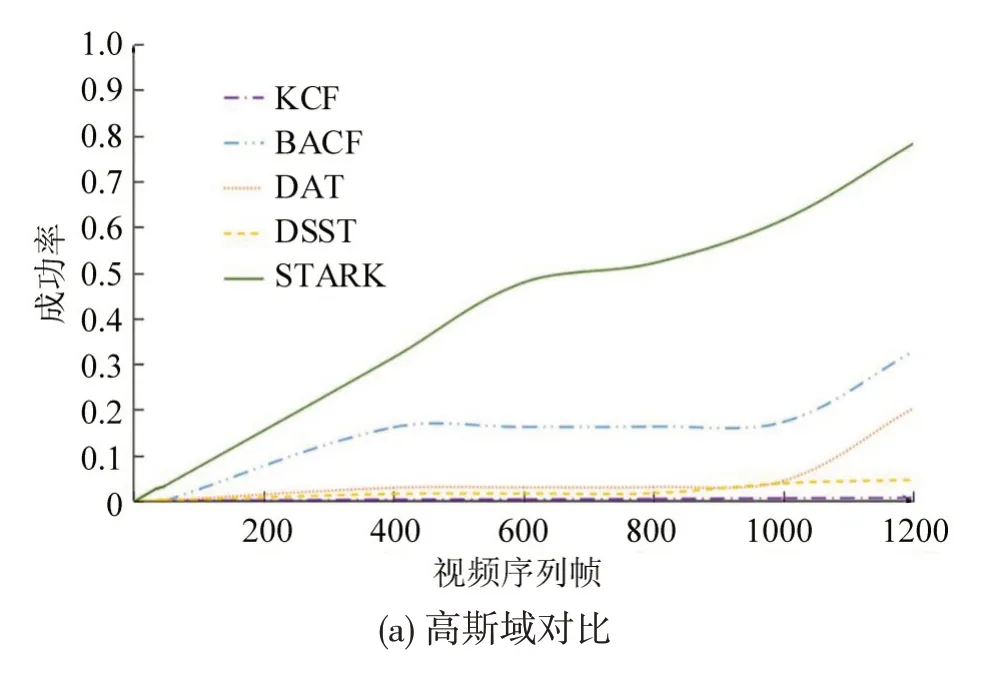

图7 各序列跟踪结果对比图Fig.7 Comparison of tracking results for sequences

为评估本文提出跟踪方法的有效性与模型性能,在6 个视频序列上进行实验。将本文方法与5个最先进的跟踪器进行比较,如图8(a)彩色域跟踪结果与图8(c)高斯域跟踪结果所示,本文所提出的高斯域下进行目标跟踪对彩色域中背景前景相似、复杂光变化等因素具有一定抑制能力,各算法在高斯域中跟踪成功帧数量有所提升。图8(b)与图8(c)均为高斯域中获得的结果,其中,图8(b)为起始帧至前景消散帧的跟踪结果,图8(c)为起始帧后200 frame 的跟踪结果。由于前景消散融于背景后会出现目标丢失导致跟踪失败的情况,本文提出的静止帧判断提前对静止帧预测框留存,故在前景消散后未过多影响精度和成功率。

图8 高斯域、彩色域下各算法跟踪成功帧对比图Fig.8 Successful frame contrast map tracked by algorithms in Gauss and color domains

图9 为6 个序列上各算法的总体精度与成功率,其中,KCF、DSST 算法难以应对本文数据存在的各类复杂问题,易出现跟踪漂移与跟踪失败问题;BACF 与DAT 算法对Napkin、Box 等序列有较好的跟踪性能,但难以处理小目标、快速运动旋转的情况,在小目标抛洒物的跟踪中效果较差;STARK 算法与本文OSMA 在6 个序列中有较相似的总体精度与成功率,但在Stone 序列中本文OSMA算法性能更优于STARK算法。

表2~表6 为5 类对比算法在彩色域、高斯域下跟踪各指标的结果。其中,加粗一方为RGB 彩色域下的跟踪结果(下同),OSMA 算法应用于高斯域,故只取高斯域下的运行结果作为对比。由表2可得,KCF、DSST、DAT 算法在高斯域下跟踪效果均有提升,本文OSMA 算法各指标均与STARK 算法相近,在Stone 序列中OSMA 表现更优。OSMA在精确度、准确率与精准度上的平均表现均优于各类算法,在速度上略低于对比的5类算法。这是由于本算法需要对前景物影轮廓进行交叉匹配导致的,复杂前景会占用较多的匹配时间。因此当道路环境复杂时,会导致跟踪时间延长,但仍能满足正常道路抛洒物实时跟踪的要求。

表2 各算法在6个视频序列彩色域、高斯域的平均跟踪结果对比Table 2 Comparison of average tracking results of each algorithm in six video sequences in Gaussian and color domains

表6 各算法在6个视频序列速度指标对比Table 6 Comparison of FPS indicators in six video sequences by different algorithms

表4 各算法在6个视频序列彩色域、高斯域的准确率结果对比Table 4 Comparison of accuracy results of each algorithm in six video sequences in Gaussian and color domains

表5 各算法在6个视频序列彩色域、高斯域的精准度结果对比Table 5 Comparison of AUC of each algorithm in six video sequences in Gaussian and color domains

表3~表6 列出了OSMA 与对比算法在6 个序列上的精确度、准确率、精准度和速度,OSMA 与STARK算法在精确度、准确率与精准度这3个指标中表现均较好。对纸巾、橙子皮等运动产生复杂光变化的小目标抛洒物进行跟踪时,KCF、DSST、BACF、DAT 算法易产生跟踪框漂移与误跟踪导致跟踪失败。OSMA通过混合高斯获得前景,有效去除了复杂背景;在前景中进行物影轮廓匹配判断道路抛洒物能够较好抑制复杂光变化导致的跟踪失效;通过引入水瓶等中小型抛洒物,提高算法的鲁棒性。因此,应对复杂道路场景下,小目标抛洒物的检测跟踪,OSMA 具有更好的跟踪能力与鲁棒性。

4 结论

针对传统依据标注获取首帧位置、人工框定获取首帧位置,无法实现自动化标注,难以应用于实际工程的问题,本文提出一种适用于道路抛洒物的三帧物影匹配标定方法,实现自动标注获取首帧目标的同时,精度可较好替代人工标注精度。针对复杂道路环境下小目标抛洒物难以被检测跟踪及抛洒物落地后静止,前景像素消散导致目标丢失与跟踪框漂移的问题,本文提出一种帧间匹配的道路小目标跟踪方法。该算法将混合高斯模型获得的前景目标划为疑似目标、疑似阴影与无关目标,对疑似目标与疑似阴影轮廓交叉匹配,实现疑似抛洒物判定,通过位置姿态变化对后续帧进行跟踪,引入帧间目标轮廓比对提高跟踪准确性,最后判断多帧抛洒物质心变化来确定物体是否处于静止状态。三帧物影匹配标定与帧间抛洒物模板匹配方法构成本文OSMA跟踪算法。

实验结果表明,与KCF、DSST 算法相比,跟踪精确度、准确率与精准率都有较高的提升;和BACF、DAT 算法相比,OSMA 能够更好地跟踪快速移动变化的小目标抛洒物;和STACK算法相比,OSMA在道路环境复杂,存在背景相似的小目标抛洒物与复杂光变化时,OSMA能够更好地从复杂环境中区分出抛洒物目标,抛洒物目标特征获取更为准确,不易产生跟踪框漂移及误判等问题,能够在一般道路环境下实现实时检测跟踪。