多车协同目标跟踪方法

2022-12-01龚诗雄王旭孔国杰龚建伟

龚诗雄,王旭,孔国杰,2,龚建伟

(1.北京理工大学 机械与车辆学院,北京 100081;2.北京特种车辆研究所,北京 100081)

0 引言

多车协同感知技术在网联车辆或多平台作战系统中具有重要应用价值[1],相对于单车感知技术,通过多车之间的信息交互与融合,可以减小感知盲区,提升系统环境感知效果,并实现感知资源的高效利用。

在协同目标检测方法层面,Chen等[2]利用车辆GPS定位与IMU位姿将点云重建为整体点云数据,在此基础上设计了一种稀疏卷积神经网络实现多车融合点云数据的目标识别,能够在车辆定位不稳定的情况也能较为准确的检测目标。此后,Chen等[3]在之前研究的基础上将感知数据融合并利用Voxelnet进行特征提取,对提取的特征依据不同车辆位姿进行合并,实现了较为准确的目标检测结果。Kanaki等[4]基于连续帧的栅格地图实现单车对环境动态目标进行检测,并基于卫星定位实现多车检测数据进行拼接。在协同目标跟踪研究层面,协同跟踪方案设计依据多车协同数据融合方式的不同主要分为两种:一种方案是数据级[5]融合,先将多辆车采集的数据进行拼接融合,再进行目标检测以及目标跟踪等操作。Kanaki等[4]基于此方案提出了一种基于规则的数据关联方式用于多轮式机器人联合目标跟踪,一定程度上解决了同一目标在不同激光雷达量测系统中出现量测冲突的情况。另一种方案是轨迹级[6]融合,将多辆车先看做独立个体进行感知数据的处理,再将不同车的目标跟踪轨迹进行融合。Gabb等[7]分析了多种协同目标跟踪的轨迹级融合方法,提出一种融合道路边缘设备跟踪目标轨迹与车载设备跟踪目标轨迹的方法,该方法简化了融合步骤,适用于环境信号存在干扰的情况,其融合效果在仿真环境中得到了验证。Ozaki等[8]采用此方案提出了一种多轮式机器人联合的目标跟踪方法,机器人通过激光雷达独立对目标进行跟踪,当两机器人在一定距离范围内有交集时则融合跟踪轨迹得到更为稳定的跟踪结果,一定程度上解决了单一机器人在目标遮挡时无法跟踪的情况。

以上方法仅考虑了环境中的动态目标,没有考虑周边的静态环境。由于没有建立协同感知系统的整体模型,导致目标经常出现短暂丢失现象。本文主要针对地面无人系统多车协同目标检测与跟踪问题开展讨论,通过对环境进行整体建模,得到多车融合后的全局环境栅格地图,减少静态环境障碍物遮挡的影响,并在此基础上进行协同目标检测与跟踪,得到融合后的全局动态检测目标,设计并使用合适的数据关联与级联匹配方法,提高了检测与跟踪的连续性及稳定性。

1 多车协同感知系统设计与建模

1.1 多车协同感知系统设计

本文设计一种基于激光雷达的多车协同感知系统,协同方案设计如图1所示。本文采用结果级融合的集中式方案,系统中每辆车都搭载有处理环境感知数据的运算平台,能够对复杂环境进行表征。为了能够获得环境的全局表征数据,将每辆车的环境表征数据上传至部署在指挥车上的主控端,执行环境表征数据的融合。在得到全局环境表征地图后,可以在此基础上完成其他功能模块的设计,如多车协同定位模块[9]、多车协同建图[10]模块及多车协同目标检测与跟踪模块[11]等。本文在此基础上设计了一种多车协同目标检测与跟踪方法,主控端在获得融合结果后,环境表征融合数据与动态目标跟踪结果可以为主控端的协同规划与协同任务[12-13]布置提供环境信息,而下发的跟踪目标状态并与车端的环境表征数据结合可以为车端局部路径规划[14]提供环境数据。

1.2 多车协同感知系统建模

1.2.1 多车时间对准

由于每辆车由于上位机硬件时钟存在不一致的情况,使得多辆车在同一时刻的探测数据存在不同的时间戳,导致数据传至主控端进行融合操作时无法利用时间戳将同一时刻感知数据进行融合,故采用图2所示GPS授时方法来统一不同平台的时间戳。

系统中每辆车均接收GPS信号的统一时间戳作为车辆本地时间,并将时间戳赋予协同系统中用于交互传输的数据,从而使得同一时刻不同平台得到的感知数据具有相同的时间戳。进一步地,主控端通过多线程与队列的方式实现各平台数据的时间同步。首先,各平台的感知数据发送至主控端后均被放入队列中进行缓存。接着,提取各队列头部消息的时间戳进行比对,以其中时间戳最晚的消息作为同步基准,其他队列数据的时间戳与该基准通过最近邻的方式进行同步。

1.2.2 多车空间对准

由于每辆车的传感器数据是以本车自身坐标系作为基准,导致数据传至主控端进行融合操作时无法将基于不同坐标系的数据进行融合,故需要将多辆车的数据转换到同一坐标系下。在多车空间对准方面,单车部分首先要有稳定的定位结果。本文利用卫星差分定位技术提供的经纬度与航向信息将车辆位置转至全局坐标系UTM[15]。

在获得多辆车在全局坐标系下各自的位置后,由于UTM平面坐标系数值较大,不利于将不同车辆局部坐标系下的栅格状态或目标位置信息进行融合。因此,本文利用UTM坐标系作为全局坐标系实现车间局部坐标系的变换对准,即以某一辆车的坐标系为基准,其余车辆均对准至该坐标系下进行感知数据的融合,如图3所示。图3中,坐标原点O为地球中央子午线与赤道的交点,N为子午线所在轴北向,E为赤道所在轴东向,R21和Rn1表示车2和车n到车1的旋转矩阵,T21和Tn1表示车2和车n到车1的平移矩阵。

对于全局坐标系下两个局部坐标系间的变换矩阵求解,设定绝对坐标系的原点OU,先将设定为融合坐标系的某一车辆坐标系转至全局坐标系下,如(1)式:

(1)

其余车辆也将车辆局部坐标系转至全局坐标系下:

(2)

在得到所有车辆的变换矩阵后,由于最终的目的是将其余车辆坐标系转换至某一固定融合用车辆坐标系下,还需要将其余车辆坐标系利用(3)式进行转变。

(3)

至此就完成了协同感知系统中的多车空间对准。

1.2.3 多车协同感知环境模型构建

如图4所示,在得到多车协同感知系统中车辆之间的时间、空间相对关系后,为减小因为盲区或遮挡问题导致被遮挡车辆无法感知到前方环境中静态障碍物的情况,有效增大被遮挡车辆的感知范围,本文采用D-S证据理论[16]将多车间的环境栅格地图进行融合得到全局环境栅格地图。

同时,为能够准确且全面地表征检测结果,提高计算效率,采用二维占据栅格地图[17]的形式来对点云进行压缩表征处理,结果如图5所示。

如图6所示,将不同车辆的激光雷达构建的栅格图进行融合,以确定最终融合后的栅格图中每个栅格的状态,从而实现多车传感器融合的环境表征栅格图。根据在单车环境栅格地图中,其状态主要包含了占据和空闲两类,即状态空间为Θ={O,F}。进一步地,D-S理论则将状态空间扩展为命题集合2Θ={O,F,Θ,∅},因此对于每一个栅格状态,D-S证据理论会计算其基本概率分配函数,得到状态空间中这4个状态的信度为[m(F),m(O),m(Θ),m(∅))],这4个状态分别为空闲、占据、未知以及空集。

此外,还需要针对单车表征栅格的不同状态设定基本概率分配函数,当单车表征的栅格为占据时,设定分配函数为

m(F)=0,m(O)=0.94,m(Θ)=0.06,m(∅)=0

(4)

当单车表征的栅格为空闲时,设定分配函数为

m(F)=0.88,m(O)=0,m(Θ)=0.12,m(∅)=0

(5)

当单车表征栅格为未知时,设定为

m(F)=0,m(O)=0,m(Θ)=1,m(∅)=0

(6)

则每辆车所获得的栅格图状态均有一个基本信任度集,即

Si={mi(F),mi(O),mi(Θ),mi(∅)}i=1,2,…,n

(7)

式中:n为系统中无人车的数量。

利用上述信任度集对两车获取的栅格状态进行融合,需要符合上述D-S合成规则:

(8)

获得状态集S={m(F),m(O),m(Θ),m(∅)} 后,需要对状态集进行判断以得到最终多车数据融合后的栅格状态。此处设m(F)>0.5时栅格状态为空闲;m(O)>0.5时栅格状态为占据;m(Θ)>0.5时栅格状态为未知。

图7(a)所示为两车点云数据。图7(b)所示为融合栅格图数据。由图7可以看出,融合后的图能够更全面地表征环境,对于橘色车辆,前方由于蓝色车的遮挡而无法对前向障碍物有很好的探测,而融合后的表征图则对全局障碍物进行了显示,利用蓝色车的结果对橘色车的探测不足进行了补充。

2 多车协同目标检测与跟踪

多车协同目标检测与跟踪框架如图8所示,各车先采用基于雷达鸟瞰图的目标检测、得到检测目标,然后将检测结果与环境栅格地图结合获取环境中的动态目标,对多车检测目标采用非极大值抑制的方法解决检测冲突,然后采用联合概率数据关联和卡尔曼滤波方法,并设计了合理的跟踪管理方法,完成目标跟踪。最后将协同检测后的结果下发给各车。

2.1 目标检测

基于点云深度学习的目标检测由点云表征方式的不同进而产生了许多不同的方法,本文采用一种基于激光雷达鸟瞰图BEV(Bird’s Eye View)的目标检测方法BirdNet+[18],具体网络结构如图9 所示。

在实际车辆采集的激光雷达数据上的检测结果如图10所示。

如图11所示,最终将检测结果进行坐标与尺度变换投影至动态栅格图以区分环境中的动态目标与静态目标。

2.2 多车目标融合规则

由于采取了不同车辆独立对环境进行障碍物检测的方式,两车的检测结果在感知量测重叠的范围内会出现重复检测而产生冲突,为此需要采取一定的方式来解决多目标检测重叠的问题,采取的流程如图12所示。

两车数据传到主控端后,主控端利用协同架构内车辆的定位信息首先率除掉协同架构内车辆相互检测的结果。在滤除架构中车辆的检测结果后,采用NMS的方式对多车检测同一目标结果进行滤除。当两个检测框的交并比(IOU)大于一定阈值时,表明这两个目标属于同一个目标,此时保存目标检测概率较大的那一个以此来滤除检测冲突。

IOU的原理如图13所示,具体计算见(9)式。

(9)

式中:A、B为矩形的面积。

此外,为保证冲突目标能够正确筛出,本文不仅使用了IOU来计算两个检测目标是否冲突,还加入了欧式距离度量来测试两个目标间的距离。两目标中心点欧式距离计算如(10)式:

(10)

当两个边界框的IOU大于一定值并且两边界框中心点距离小于一定阈值时,表明这两个目标存在检测冲突,滤除检测概率较小的一个。最终多车检测冲突处理的结果如图14所示,图14(a)为未进行目标冲突匹配的结果,深橘色为车1检测结果,深绿色为车2检测结果,可以看到在两车数据进行融合后,部分目标产生了重叠,如红圈部分。利用上述匹配规则进行目标冲突消除得到的结果如图14(b)所示,可以看到车2检测的车1结果被滤除,两车检测的环境目标结果也无冲突,其中绿色为行人,紫色为车辆。

2.3 目标跟踪

2.3.1 多目标数据关联

联合概率数据关联(JPDA)[19]方法利用跟踪轨迹周围一定范围内的观测值,计算每一个观测与目标轨迹的关联概率,实现联合概率加权更新目标轨迹状态。对于观测与目标轨迹匹配的限定范围,本文采用卡方检验跟踪门的方式来限定跟踪轨迹目标的关联范围。

当量测与轨迹预测目标之间的马氏距离满足状态量维数对应的卡方检验值的要求[20],如(11)式,并且量测与轨迹目标间的欧式距离也满足一定阈值的情况下,表明这个量测与轨迹预测目标是有关联的。

(11)

式中:Zi(k)为k时刻编号i的某一观测值;S(k)为k时刻量测估计分布的协方差;chi2inv为卡方检验函数。

关联矩阵构成示意图如图15所示。最终利用上述判定条件对各观测值与轨迹进行匹配,生成类似如下图右侧的关联矩阵。矩阵的行数为当前量测数量,而列数为跟踪轨迹目标的数量加1,即矩阵的第1列,为虚警类。虚警是指在跟踪过程中对轨迹状态估计存在干扰的部分。这里假设每一个量测都与虚警相关联,即每一个量测都可能是虚警而不是实际的跟踪轨迹量测。图15中,坐标系原点o表示车辆后轴中心位置,坐标系oxy平行于地面,车辆前进方向为y轴正方向,垂直于车辆前进方向朝右为x轴正方向,Ω表示关联矩阵。

Ω=[ωjt],ωjt的含义如(12)式,j=1,2,…,mk;t=0,1,…,q,j表示矩阵的行,t表示矩阵的列,mk为量测的个数,q为跟踪轨迹个数。

(12)

在得到关联矩阵后,利用关联矩阵求解得到每一个观测值与目标轨迹的关联概率如(13)式所示。

(13)

在得到目标与量测相互关联概率后,需要利用量测值的概率加权对轨迹状态进行更新,即需要利用状态估计滤波器的估计结果与量测值实现滤波器最终的状态值估计。卡尔曼滤波如(14)式所示:

k|k-1=AXk-1|k-1+qk

k|k-1=Hk|k-1

(14)

式中:Xk-1|k-1为k-1时刻的系统状态向量;k|k-1为根据k-1时刻的系统状态量得到的k时刻估计状态向量;A为状态转移矩阵;qk为k时刻系统噪声;k|k-1为根据k-1时刻的系统状态量得到的k时刻量测估计值;H为观测矩阵。

令vjt(k)表示第j个量测与t个目标量测估计间的差值,即(15)式:

(15)

进一步地,对于目标t在k时刻与所有量测的差值的和,有

(16)

得到上述结果后,JPDA令状态更新如下:

(17)

式中:Kt(k)为目标t在k时刻的卡尔曼增益[21]。

vt(k)vt(k)T]Kt(k)T

(18)

2.3.2 跟踪管理

2.3.2.1 目标跟踪初始化与剔除

目标跟踪初始化与剔除的主要功能是维持当前跟踪轨迹的稳定性与可靠度,保证跟踪轨迹的连续性,对同一目标不产生过多的跟踪Nid跳变,能够对跟踪轨迹状态进行划分,对误检目标进行判断。

图16所示为本文所设计的跟踪管理方案,其中Nhit表示目标被匹配的次数,Nage表示当前跟踪轨迹未被匹配的次数。首先,对于第1帧检测结果,跟踪管理模块不对目标轨迹进行初始化,而是保存检测结果与下一时刻检测结果,利用匈牙利算法进行匹配,只有匹配上的目标才进行跟踪初始化。初始化后的跟踪目标状态设置为Sunconfirmed,表明对当前跟踪的信任程度,当该跟踪目标在后续又被匹配上时,跟踪目标的Nhit值加1,当Nhit>3时,跟踪目标状态转为Sconfirmed,表明该跟踪目标状态稳定,如图16中的①所示。对于状态为Sconfirmed的目标将其与观测进行JPDA方法关联,而Sunconfirmed的跟踪目标则与剩下未匹配的观测目标进行匈牙利算法数据关联,这样能够在一定程度上保证稳定状态跟踪目标的跟踪稳定性,也能够对不稳定状态跟踪是否误检进行快速辨别,并降低算法的运算消耗。

进一步地,当跟踪目标未在当前获得匹配观测目标时,对于Sunconfirmed状态的跟踪目标,其状态转为Sdelete,表明不稳定的跟踪在匹配无效后会被直接删除,如图16中的②所示;对于Sconfirmed状态的跟踪,跟踪管理模块会进行保留,并在一段时间内对该跟踪状态进行预测维持,每进行一次状态预测,Nage值就会加1,直到该跟踪目标获得匹配,Nage值清零;当该跟踪目标连续多帧未获得匹配,即Nage值大于一定值时,该跟踪状态转为Sdelete,如图16中的③所示。这样设计跟踪目标剔除方案的好处在于,对于稳定状态的跟踪,能够在该跟踪目标由于漏检或遮挡在观测时消失几帧后还继续进行关联匹配,保证了跟踪Nid的稳定以及跟踪轨迹的完整程度;对于不稳定状态的跟踪,则能够较快速地判别该目标是否为误检以剔除,降低算法整体的运算负担。

目标跟踪最终效果如图17所示。由图17可以看到,目标检测在t时刻未能检测出车辆前方Nid为1的移动目标,但是由于跟踪管理保留了该目标的运动轨迹,其在这一帧通过预测得出了该目标当前的位置。当t+1时刻再次检测到该目标时,保留的轨迹预测值与该目标进行匹配,赋予该目标当前轨迹的Nid,使得对该目标的跟踪保持了连续性,不会由于检测器误检的情况丢失跟踪目标。

2.3.2.2 目标跟踪结果剪枝

由于JPDA算法对于跟踪目标的状态更新利用了多个与跟踪目标满足关联关系的观测目标,跟踪目标与实际观测并不是一一对应的关系。但实际跟踪目标的状态只能表示环境中的某一个运动物体,因此需要将该跟踪状态与环境中的目标进行一一关联。

如图18所示,本文采取目标跟踪值与环境观测值的欧式距离构建代价矩阵,利用匈牙利算法求解的方式实现跟踪目标与环境目标一一对应,以实现跟踪目标结果的剪枝。

此外,为保证跟踪目标尺寸与航向的稳定,需要对剪枝后与跟踪目标关联的目标尺寸依据跟踪目标历史尺寸进行更新。考虑到在连续时刻内,目标的航向、尺寸不存在较大变化,当检测目标尺寸变动或目标检测航向与跟踪历史目标的偏差较大,则不采用当前检测的尺寸或航向,而采用原有值对跟踪目标尺寸进行显示,如图19所示,可以看出对于当前帧的检测其航向与实际偏差较大,因此不采用当前检测结果,而采用历史帧的结果对当前的检测结果进行描述,从而降低了检测目标尺寸表述不准确的情况。

最终,跟踪结果下发至协同架构中的每辆车,其中包含了目标的位置、速度以及Nid。

3 试验及结果分析

3.1 多车协同动目标跟踪静态试验

静态试验的目的主要为了测试静态下多车协同感知相对于单车感知在感知范围上的优势以及对受到障碍物遮挡的目标跟踪的稳定性。

静态试验设计如图20(a)所示,两协同车辆朝向夹角约90°,静止停放在地面上,为体现协同在传感器量测范围上的优势,设定两车间距离约为40 m,目标车辆与目标人员从约为两车朝向连线构成的角度的角平分线方向相向而行,路线为绿色线所示,当车辆与人走出两车的感知量测范围时试验结束。实际测试数据如图20(b)所示。

测试可视化结果如图21所示。图21中显示了试验目标的轨迹跟踪情况,其中绿色与蓝色方框为协同架构下的车辆,红色为所跟踪目标车辆轨迹,浅蓝色为跟踪行人目标轨迹。从图21(b)中可以发现:当行人与车辆相向而行并在场地某一位置相遇产生交互时,行人由于受到车辆的遮挡,对于蓝色位置的车辆其感知系统无法对行人进行检测,而绿色位置车辆则仍旧可以对目标行人进行探测,交互过程持续时间约1 s左右;当车辆与人结束交互时,蓝色位置车辆再次可以探测到行人目标。在整个交互过程中,行人在协同架构下始终能够被探测,因此其跟踪轨迹保持连续,未发生Nid跳变,也未出现漏检;目标车辆由于始终被协同架构下两车探测,未出现漏检,跟踪较稳定,也未出现Nid跳变。

进一步地,对跟踪目标的状态进行分析,目标车辆检测器输出结果与跟踪器输出状态及文献[7]的轨迹级融合法比较结果如图22所示。目标行人的状态比较结果如图23所示。图22(c)和图23(c)中的速度曲线,蓝色为通过检测位置直接计算得出的结果,红色为跟踪器输出状态结果。

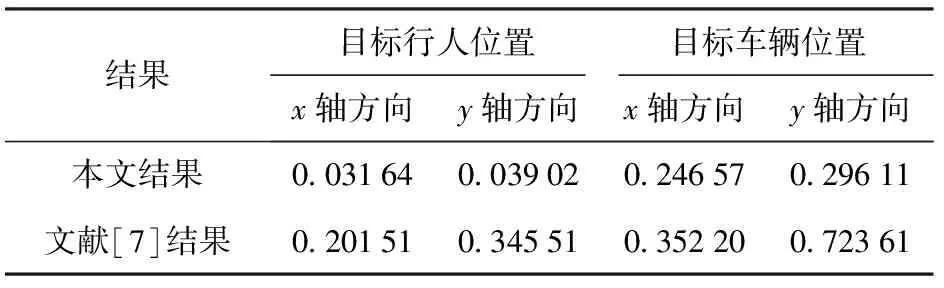

由图22(a)、图22(b)与图23(a)、图23(b)可以看出:静态情况下,本文所提检测器检测结果较为稳定,无论是行人或车辆目标定位均较为准确,与真值相差较小;协同情况下的跟踪器输出位置状态结果与检测结果十分贴合,曲线整体过渡平滑,误差较小,具体均方根误差结果如表1所示。其中行人的状态估计误差相对于车辆的估计误差较小,这是因为车辆目标较大,目标检测结果易产生尺寸上的变动,使得车辆几何中心位置的估计产生偏差;而行人目标较小,检测结果的尺寸变动较小,目标中心位置不会产生较大变动,使得整体状态估计较为准确。

文献[7]的轨迹级融合方法得到的目标跟踪状态相对于目标真值波动较大,这是因为不同车辆在不同视角对同一目标的检测结果存在偏差,造成不同车辆对该目标的状态估计也存在偏差,使得最终不同轨迹融合获得的目标状态估计不稳定,其状态估计结果如表1所示,相对于本文的方法,目标位置的估计偏差较大。由图22(c)和图23(c)的速度曲线可以看出,通过直接计算得出的速度曲线跳变较为剧烈,而跟踪器输出结果曲线较为平滑,更符合目标的运动规律。

表1 静态试验目标位置估计均方根误差

3.2 多车协同动目标跟踪动态试验

动态试验的目的主要是为了验证多车协同感知框架在协同车辆行驶过程中对目标跟踪的稳定性。

动态试验设计如图24(a)所示,当车辆以队列行驶时,最后方车辆由于受到前车的遮挡而无法获取目标车辆信息,而中间的车辆则可以感知到前车信息,以此来测验多车协同框架在动态场景下受到目标遮挡时的目标检测能力;当后车加速超越前方两车队列时,其传感器逐渐不受前车遮挡从而检测到目标车辆,这时两辆车均能感知到目标车辆,以此来测试动态行驶下多车检测数据融合的性能。

测试的可视化结果如图25所示。由图25可以看到,协同架构下目标获得了连续稳定的跟踪路径,未发生Nid跳变。由图25(a)可见,对于队列跟车中位于队尾的车辆,其在受前车遮挡而无法对所跟踪目标进行检测的情况下也能够获得目标的位置与状态信息。如图25(b)所示,当该车进行超车操作时,该车辆检测到目标与原有目标经过处理并没有出现多个检测目标发生冲突的情况,框架下所跟踪的目标仍旧十分稳定,没有出现Nid切换以及漏检的情况。

进一步地,对跟踪器获取的跟踪目标状态进行分析,其中检测器检测结果与跟踪器输出状态结果如图26所示。

图26(a)为目标沿x轴位置的变化,可以看出在动态情况下由于目标检测模块存在一定的不稳定性,整体目标的位置随着时间变化出现了一定的波动,而实际上在短时间内目标的运动应是连续的,跟踪器的输出结果相对于原有检测结果更为平滑。但状态估计结果与真值仍存在一定的偏差,如表2所示,其偏差相对于静态试验的偏差要小,这是因为在跟车过程中,打在前方车辆的点云较为密集,检测器对前方车辆的尺寸估计较为准确,其几何中心未产生较大偏差。

从图26(b)中可以看到,文献[7]的轨迹级融合方法在250~350帧间的目标位置估计产生了较大抖动,该阶段是在后车超越前车时两车同时检测到目标车辆的时刻,此时两车均对目标产生跟踪结果并融合。该阶段目标的位置估计产生抖动的原因在于后车超越前车的过程中后车会逐渐检测到目标车辆,但该车辆检测到的目标较为不稳定,目标的尺寸与几何中心位置随着车辆的运动产生一定的变化,使得该过程中两车跟踪结果融合后得到的目标状态估计值不稳定,具体偏差如表2所示。

表2 动态试验目标位置估计均方根误差

此外,对于速度估计(见图24(c)),跟踪器输出的状态估计结果相对于计算结果更加连续平滑,比较符合目标的实际运动速度变化。

4 结论

本文针对单车传感器因存在视野盲区及目标受到遮挡导致的目标跟踪不连续不稳定问题开展讨论,得出主要结论如下:

1)提出了一种多车协同感知的结果级融合系统模型,相对于单车感知在环境表征上能够获得更全面的环境信息,有利于目标的协同检测与跟踪。

2)提出了一种多车协同目标检测方法,设计了合理的目标融合冲突解决方案,得到了准确的协同目标融合结果。

3)提出了一种级联动态目标匹配与跟踪管理方法,跟踪器输出位置状态结果与检测结果误差较小,能够对所跟踪目标的状态进行准确估计;目标检测与跟踪更为稳定,当出现目标遮挡时未发生Nid跳变,跟踪轨迹仍保持连续,也未出现漏检。

本文在目标检测精度方面并没有做相应的研究,未来可以设计相关试验来验证协同框架对检测精度提升的优越性;在车辆定位方面采用的是定位精度较高的差分定位,未来可以对车辆定位存在偏差时的多车协同定位方法进行研究;在试验设计方面,由于起伏地形会使得本车姿态不时发生较大的变化,这对多目标协同探测时的时空一致性提出了更高的要求,未来可以开展后续的相关研究工作。