机器视觉在军事领域的应用现状及发展趋势

2022-11-19宫黎明

陈 静,宫黎明

机器视觉在军事领域的应用现状及发展趋势

陈 静,宫黎明

(中国人民解放军93160部队 北京 100076)

机器视觉技术凭借其非接触测量、实时性好、可持续工作等优点,在军事领域中有着广阔的应用前景。在对机器视觉光学照明系统、成像系统、视觉信息处理系统等关键技术进行概述的基础上,详细分析了机器视觉技术在军事领域进行典型目标物识别、人员识别、装备缺陷检测等典型场景以及典型军事装备上的应用现状。在此基础上,指出了机器视觉在军事领域的应用,仍然存在视觉传感器硬件系统难以适应极端环境、复杂的军事目标适应性不足、目标识别的实时性难以保证、多传感器融合获取军事目标信息能力缺乏等问题。同时,对机器视觉技术在军事领域应用的未来发展趋势进行了展望,研究分析结果可为机器视觉在军事领域的进一步实用化提供参考。

机器视觉;军事装备;目标识别;缺陷检测

引 言

机器视觉是建立在计算机视觉理论工程化基础上的一门学科,主要利用计算机来模拟人或再现与人类视觉有关的某些智能行为,从客观事物的图像中提取信息进行处理并加以理解,从而高效精准地完成复杂环境辨识与判断等相关任务[1]。机器视觉涉及到光学成像、视觉信息处理、人工智能、机电一体化等相关技术[2],具有高实时性、准确性及智能化的特点,在生产生活中有着广阔的应用前景[3]。近年来,机器视觉已逐步在汽车制造、食品检测、交通、军事、纺织加工等多个领域得到应用,市场规模不断扩大[4]。

《中国工程技术2035发展战略》中明确指出了发展包含图像信息在内的智能传感及互联互通网络的重要性[5],鼓励相关技术基础理论的突破并与工程实际进行有机融合。特别是伴随着军事信息化时代的到来,《中华人民共和国国民经济和社会发展第十四个五年规划和2035年远景目标纲要》中明确提出,“坚持以机械化为基础、信息化为主导、智能化为方向,推动机械化信息化智能化融合发展,在推进智能化进程中发展高度发达的机械化和更高水平的信息化,引领国防和军队现代化转型升级”。为此,将先进的工程技术应用于军事装备,大力提升其智能化水平,对于提升作战能力具有重要意义。其中,机器视觉技术作为信息化的重要技术手段之一,对于提升武器装备的打击精度、拓展装备适用范围、提高部队作战能力具有重要意义[6, 7]。

从20世纪70年代开始,国外科研人员便开始探索模式识别与图像处理技术在军事领域的应用[8]。随着视觉传感器硬件系统的不断更新及相关算法不断取得突破,机器视觉技术在武器装备及战场环境中的应用效果不断凸显,应用范围不断扩大。我国从上个世纪末也开展了军事领域机器视觉相关技术的研究,在复杂环境下的目标物及人员识别、装备缺陷检测等方面取得了一系列的研究成果,提升了部队在战场上的感知与决策能力。特别是近年来,随着计算机科学、控制科学、仪器科学等学科的飞速发展与多学科交叉融合的不断深入,机器视觉相关技术发展迅猛,我军的作战水平得到快速提升。

本文围绕机器视觉技术特点以及在军事领域不同方向的应用,对相关研究成果进行了综述,并提出了机器视觉在军事领域应用过程中所存在的突出问题。在此基础上,对未来发展趋势进行了分析。分析成果可为基于机器视觉的军事装备的发展及作战指挥提供一定的参考。

1 机器视觉技术概述

机器视觉技术是用电子设备模仿人的视觉功能,从环境的图像中提取信息并进行处理。机器视觉技术主要包括目标取像、分析数据、输出结果这三部分,该过程往往需要多个机器视觉系统协作完成。一般来说,机器视觉系统由光学照明系统、成像系统、视觉信息处理系统等组成[9]。

1.1 光学照明系统

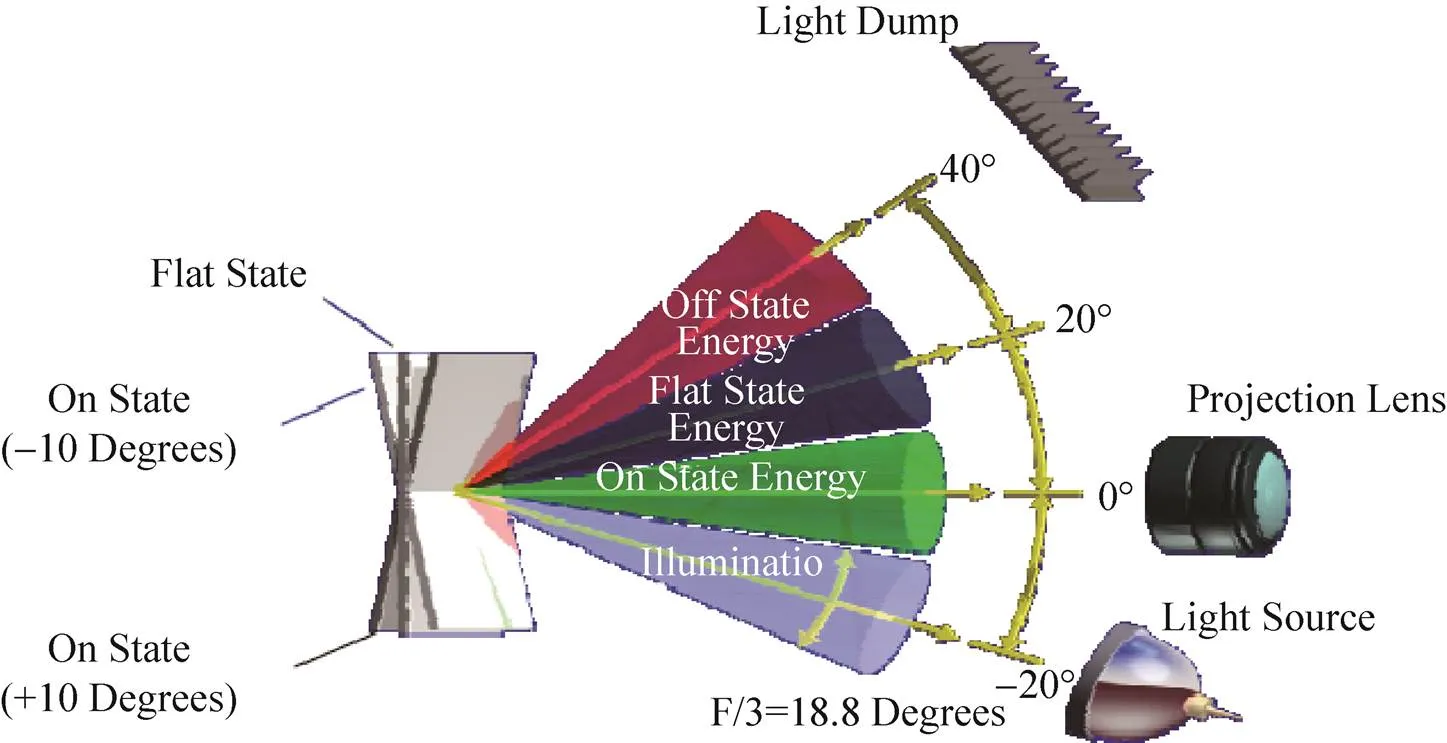

光学照明系统将特定光源以特定方式照射到被测物体,以在取像时突出被测目标的特定特征并抑制非必要特征。正确运用光学照明系统能够更好地将目标与背景分离,以降低图像的分析难度。最常见的照明方式为日光照明,例如,长春理工大学吕家祺[10]提出了一种基于混合式聚光方法的日光照明系统,该系统采用双抛物面聚光模块和无漏光导光板实现聚光,并建立了相应的数学模型,从而为建筑提供更均匀的辐照度。然而,日光照明系统并不适用夜晚等日光不足的场景,常常需要增加辅助照明方式。部分学者以发光二极管LED为基础建立了照明系统。与日光相比,LED具有耗能少、体积小、寿命长等优点,但其仍然存在照明不均等问题。为此,黄从高[11]提出了一种基于多级配光组合的窄光束均匀照明系统。该系统首先依据光学原理设计出用于初级聚光的复合抛物面聚光器,在此基础上,采用菲涅尔透镜控制LED等光的溢散,而后通过非透镜实现光线的均匀输出。周壹义[12]通过在光源点与目标平面之间建立能量对应关系,设计了自由曲面透镜和反射器,实现了平面光照的均匀分布,如图1所示。在军事领域中,将LED灯作为光源容易暴露自身,为此,许多学者针对隐蔽性更高的红外线照明系统进行了研究。张建忠[13]研究了数字微镜器件DMD(Digtial Micromirror Devices)对红外光的调制特性,依据衍射原理计算出不同波段下光束经调制后的光强分布,从而设计了相应的照明系统,并抑制了杂光,最终能够完美地将DMD的工作波段从可见光延伸到红外波段,实现对目标的照明。针对飞机探测等远距离照明要求,孙盈[14]利用Dammann光栅分束器与开普勒望远镜相结合的方式构建了照明光学系统,该光学照明系统可实现对8 m~60 m距离内的目标进行照明,并形成相应的图像。此外,许多学者对光源的颜色展开了研究,例如在文献[15]中,李俊采用蓝色光能够较好地分辨出红色瓶盖与白色字,便于后续的文字识别。VRIESENGA等[16]通过改变光源的颜色来提高图像的对比度,如图2所示。虽然光学照明系统已经有了许多研究,然而在军事应用时的环境是复杂多变的,现有的光学照明系统通用性较差,需要根据不同的背景、目标等选择不同的照明强度、颜色、照射方案等以达到目标和背景的最佳分割效果。为此,需要提出新型照明方式,并具有更好的通用性。

图1 实现照度均匀的透镜设计示意图

1.2 成像系统

成像系统是机器视觉技术中“视”的部分,包括镜头、工业相机、图像采集卡等相关设备。

镜头相当于眼睛中的晶状体,其作用是将目标的光图像汇聚于光敏阵上。按照等效焦距可将镜头分为广角镜头、中焦距镜头、长焦距镜头;按功能可将镜头分为变焦距镜头、定焦距镜头、定光圈镜头等。在选择镜头时,需要考虑焦距、工作距离、畸变[17]等因素,选取合适的焦距能够获得真实反映目标物体大小形状的图片。同时,选择镜头时需要考虑镜头光敏面阵可接受的光源波长,以保证镜头对光线具有很好的透过性。

图2 改变光源颜色提高图像对比度

工业相机是一个光电转换器件,它将所接收到的光辐射转变为视频/数字电信号。光电转换器件包括光电转换、外围电路、图像输出接口等部分。按照相机内传感器的不同,相机可分为面阵式与线阵式两类。面阵相机能一次性获得目标和背景的整幅图像,应用面较广,经常应用于目标的面积、形状和尺寸等测量。线阵相机呈线性获取目标图像,长度很长,但宽度却只有几个像素,能够使高扫描频率和高分辨率成为可能。面阵相机主要应用于工业、医疗等领域,最典型的应用是检测连续材料的缺陷。因此,在选择工业相机时需要考虑光电转换模块以及响应速度等因素。

图像采集卡能够将采集的图片转化为数字信息进行存储,通过与相机协作实时完成图像数据的高速采集与读取等任务,针对不同的相机,图像采集卡的选择也不尽相同。

1.3 视觉信息处理系统

视觉信息处理系统是机器视觉系统的关键部分。在获得目标图像后,通过对图像进行处理、分析和识别,从而实现对特定目标的准确辨识。视觉信息处理系统可以分为图像预处理和特征分析理解两部分。

图像预处理包括图像增强、平滑、分割、去噪、配接等过程,主要用于提高图像质量,便于后续图像处理。由于各种干扰,初步获取的图像常常含有高斯、泊松等多种噪声,存在图像模糊等现象,因此需要对图像去噪来改善图像质量。常用的去噪方法一般可分为空间域去噪法与变换域去噪法[18]。

图像特征分析常常先对图像进行分割,然后从分割的图像中提取形状等关键特征[19, 20],最后引入模式匹配[21]、深度学习[22]等方法实现目标的分类与检测。图像分割具体指:根据目标的特性将图像划分为多个具有特征的区域,从而便于确定目标的位置以及所占区域的大小,常见的图像分割方法包括阈值分割方法[23]、区域分割方法[24]、基于边缘的分割方法[25]、基于神经网络的语义分割方法[26]等。在图像分割后,对图像进行特征提取,常用的图像特征有:形状特征、纹理特征、颜色特征等。在提取完特征,引入分类算法,如图3所示的支持向量机分类算法,通过模式匹配[27]、深度学习等方法对特征进行分类,从而完成图像的处理与识别。

图3 基于支持向量机的视觉分类算法

将深度学习算法引用到视觉处理中以增加识别速度与识别准确率是现阶段研究的热点。例如,大连科技学院秦放等[28]针对特种车辆的识别问题,基于深度学习算法建立了多模态融合图像识别方法。该方法基于Inception V3深度网络结构(如图4所示)建立了多模态识别框架,经过实验,特种车辆的识别准确度提高到了97%,可应用于特种车辆紧急避让等。兰州财经大学边柯登[29]基于深度卷积神经网络建立了玉米常见病害图像识别算法,网络结构如图5所示。该算法对数据量要求较小、识别率高且能够适应复杂环境下的任务,能够识别出玉米大斑病、玉米锈病和玉米褐斑病这三种玉米常见病害,以减少玉米病害可能性。上述方法均具有较好的可移植性,具有进一步应用于军事领域的可能性。

图4 Inception V3网络结构

图5 基于深度学习卷积神经网络结构

2 机器视觉在军事领域的应用现状

2.1 机器视觉的典型应用场景

2.1.1 典型目标物的识别

机器视觉技术能够应用于海面可疑舰船、飞机跑道等特定军事目标的识别,对保障航空航海等方面的安全有着重要的意义。

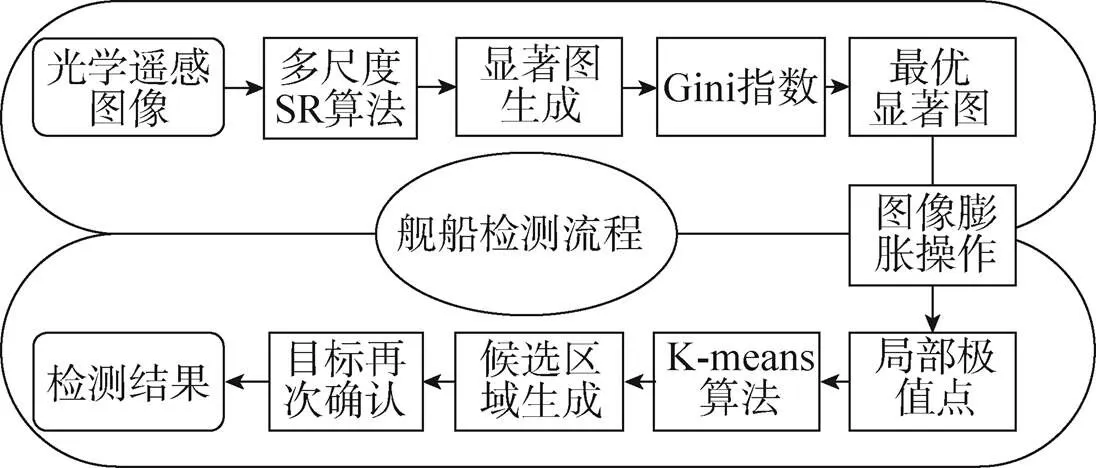

部分学者基于机器视觉技术建立了海面船只检测系统[30, 31],该系统能够依据各船只的特征进行识别,跟踪航行舰船并获取航行信息,辅助海军维护海上秩序,极大提高国土安全。在海面上,传统光学遥感图像检测海面船舰目标容易受海岛、云雾、海浪等复杂背景的干扰,从而导致检测失败。针对此问题,国防科技大学赵浩光等[32]基于多尺度视觉显著性图提出了一种适用于复杂背景的舰船目标检测方法,原理图如图6所示。该算法针对目标尺度多变的问题,提出新的方案分离目标和背景像素点,有效解决了复杂背景对船只检测的影响,经试验,检测成功率达到93%。

图6 基于多尺度视觉显著性图的舰船目标检测方法

飞机轨道的定位也是机器视觉技术的主要应用领域,通过对各类跑道的准确辨识,可以辅助飞机更加精准地完成飞行任务。例如,中国民航大学智能信号与图像处理重点实验室韩萍等[33],针对现有跑道检测方法算法复杂、难以进行实时检测的问题,提出了一种基于机器视觉技术与局部二值模式特征分类算法的跑道实时检测方法。该方法利用传感器数据和地形数据生成跑道特征,并实时进行图像采集,通过将采集到的图像与模板进行匹配,从而完成跑道区域的检测。检测过程如图7所示,该方法匹配精度高、实时性好,较现有跑道检测方法能够节省87.7%的时间。在飞机着陆时,常常会遇到雷达等传感设备失灵的问题导致着陆失败。针对此问题,卡塞萨特大学Senpheng等[34]提出一种基于计算机视觉的固定翼无人机(UAV)自动着陆辅助系统,该系统结合现有的轨道检测算法,实现了无人机的探测以及轨道的实时定位。海军装备部的刘佳铭[35]提出一种基于机械视觉技术的舰载机空间定位方案,该方法能够使航母舰载机在起飞前实时准确地获得其在甲板上的空间位置,对提升舰载机的出动率与成功率有重要意义。此外,空军工程大学Wang等[36]将机器视觉技术应用于空中加油任务中,提出了一种基于单目视觉检测的自定位方法,解决了两架飞机间难以快速、准确地对准空中加油口的问题,通过该方法能够准确、安全地对油孔进行检测以及3D定位。此外,部分学者将机器识别技术应用于战场中伪装目标[37]、动态目标[38]的识别,并取得了一定的研究成果。

图7 飞机跑道检测过程

2.1.2 人员的识别

利用机器视觉了解并获取军事区域重要人员的信息,不仅能够全面、实时地掌握相关区域人员的活动情况,还能够减少军事活动中人员的任务参与度,对国家安全、我军士兵生命安全有着重要意义。

拉夫堡大学Irhebhude等[39]提出了一种基于机器视觉的对陆军、海军和空军人员的自动识别和分类系统。该系统首先通过支持向量机对不同兵种的制服、帽子和徽章的特征进行分类并集成到一个系统中,然后通过视觉识别技术机对陆军、海军和空军进行识别。该系统能够正确区分敌我身份,可用于加强军事基地或设施的安全。查罗塔尔科技大学Patoliya等[40]在一款间谍机器人上增加了视觉系统,能够实现对战区或边境地区人类活动的检测,同时能够在军事武装介入战区之前了解该区域的情况,从而保证人员的安全。SRM大学Sathishkumar等[41]同样研制了一款带有视觉功能的间谍机器人,该机器人能够代替士兵在复杂环境中监测和识别人员信息,同时配有红外照明,能够在完全黑暗的情况下进行侦察,对打击不法分子、维护国家安全具有重要意义。此外,许多专家学者都对不同工况下的人员识别方法展开了研究,取得了一定的研究成果[42-45]。综上所述,机器视觉对不同人员的识别在国防安全应用中发挥出至关重要的作用。

2.1.3 装备缺陷的检测

通过机器视觉技术对各类军事装备进行缺陷检测,能够大幅度降低人工检测时的主观性差异,更加准确、可靠、客观地检测枪械、弹药、装备等是否存在缺陷,不仅能够提高检测精度、提高生产效率和自动化程度,同时能够应用于人工视觉难以完成检测任务的场景,对提升武器装备安全性能有着重要意义。

在对枪械、弹药等武器装备进行检测时,人工检测的方式存在工作量大、检测效率低、主观性差异大等问题,而采用机器视觉技术可以高效地进行精确检测。例如,长春理工大学刘立欣等[46]基于零交叉算子和边缘检测方法对枪械内膛疵病图像进行检测,具有边缘定位准确、运算速度快的优点,有利于图像的分析和处理,在实际应用中展示出了良好效果。王百荣等[47]将视觉识别技术应用于炮弹检测中,设计了一种基于X射线的无损炮弹检测识别系统,并通过实物验证了方法的有效性。解放军军械工程学院史进伟等[48]建立了基于机器视觉与BP神经网络的炮弹外观缺陷检测系统,系统检测流程如图8所示,该系统自动对枪弹外观进行取像、分割,并最终对外观有缺陷的枪弹进行识别与分类,经过实物验证正确识别率达91.7%,表现出较好的准确性和鲁棒性。此外,其他学者也基于机器视觉技术对不同弹药的检测展开了研究[49,50],如图9所示为基于缺陷识别算法的一种弹芯的检测过程。除了武器装备外,机器视觉技术还应用到了由于频繁使用而易于疲劳的装备检测当中。例如,上海民航职业技术学院邵欣桐等[51]提出了一种基于机器视觉的智能轮胎快速检查的方法,该方法将机器视觉引入到飞机轮胎检查的工作中,针对飞机轮胎出现的胎面异常擦伤、胎面点状磨皮、胎面扎伤、胎面污染腐蚀均有较好的效果,解决了传统人工方式进行飞机轮胎检查遇到的经验不足、光线较差、检查位置过于隐蔽、机轮损伤不易发现等缺点。

图8 基于BP神经网络的炮弹外观检测原理图

图9 基于缺陷识别算法的弹芯检测原理图

2.2 机器视觉在典型武器装备中的应用

2.2.1 陆地装备中的应用

在陆军装备中,机器视觉主要用在火炮、导弹及无人车辆等装备中。机器视觉能够提高火炮、导弹的精度,提高无人车辆的自动化及智能化程度,因此具有广阔的应用前景。海军工程大学Li等[52]将机器视觉引入到火炮的瞄准过程中,通过对目标的识别和定位,有效提高了炮兵系统校准目标时的效率。在导弹方面,针对因GPS等卫星信号出现干扰而导致导弹定位失效的问题,海军航空工程学院寇昆湖等[53]通过将视觉识别技术引入到飞航导弹中,实现了定位误差的快速实时修正,使飞航导弹在无卫星导航下能够进行精确打击。导航巡航模型如图10所示,该模型通过放置于导弹前端的视觉设备实时观测导弹相对于被测地表的位置和姿态,从而进行误差的快速修正。同时,因为其具有方法原理简单、所需装置较少、易于工程实现的优点,能够显著提升高速运动下飞航导弹的性能。在无人车辆领域,美国陆军研究了机器视觉技术在机器人和无人驾驶车辆中的使用,并提出在未来会开发配备有机器视觉的美国陆军未来装甲系统[54]。与此同时,美国国防高级研究计划署开发了配有智能摄像头的无人驾驶车辆,使其能够在战场环境进行信息的获取,从而提高无人驾驶车辆获取信息的能力[55]。

图10 基于前置摄像头的导弹巡航模型

2.2.2 空中装备中的应用

在空中装备中,机器视觉主要应用在飞行员头盔、无人机等装备中。在飞行员头盔方面,瑞典国防研究局Stephen等[56]将机器视觉技术与飞行员的头盔结合起来,极大地扩展了飞行员的视野,并且在快速飞行中能够辅助飞行员完成瞄准等任务,从而保证空中作战的优势,掌握作战主动权。Deng等[57]将机器视觉引入到飞机靠泊中,在飞机停泊过程中实时对位置进行修正,保证了停靠的准确性,极大的提高了飞机停泊的效率及准确性。对于无人飞行器,机器视觉技术的应用能够极大地减轻人员操作负担,轻松完成战区侦察任务。考虑到飞行器在着陆时,由于缺乏关于着陆场信息及可能受到外部大气扰动作用而导致的飞行器极易着陆失败的问题,部分学者[58, 59]将机器视觉技术应用到无人飞行器上,使其能够在强风等复杂环境下安全、精确地着陆。因此,机器视觉技术能够提升飞行员及飞行装备的作战能力,对于提升空军战斗力有着重要意义。

2.2.3 水下装备中的应用

将机器视觉技术应用于水下装备,可提升水下装备在完成水下水雷排除、有毒废除处理等任务时的自主能力,能够在人员投入较少的情况下高质量地完成高相关任务。

在水下装备方面,机器视觉主要应用在水下排雷机器人、水下检测装备和水下无人推进器中。由于受水中能见度、阻力等因素的影响,工作人员难以分别水雷的种类,此时就需要带有视觉的水下机器人进行作业。为此,中国科学院沈阳自动化研究所苗锡奎等[60]将视觉技术应用到水下排雷机器人中,使其能够高效准确地识别出水雷的种类,从而完成排雷工作。在水下无人推进器方面,通过引入视觉识别技术,能够显著提高水下机器人的定位精度和在复杂环境下的定位能力[61]。在水下检测装备方面,利用视觉技术代替人工识别的方式进行水下定位与检测,能够扩宽获取信息的宽度和广度,保证信息的实时性[62,63]。例如,Kakani等[64]通过将机器视觉引入水下探索装备,实现对海洋生物的实时跟踪,完成对海洋的探索。

3 现阶段存在的问题

尽管机器视觉相关技术取得巨大的进展,但目前的应用主要集中在交通、农业、工业等领域。由于军事领域常见的应用环境复杂多变,对各类算法的实时性要求较高,机器人视觉在军事领域的大规模工程应用还相对较少,机器视觉的应用仍然存在以下问题。

3.1 视觉传感器硬件系统对极端环境适应性有待提高

机器视觉的应用效果高度依赖于视觉传感器的硬件性能。现有视觉传感器种类繁多,但大多为通用型传感器,传感器的性能面向工业、农业等场合,具有应用范围广、适用性强等特点。然而,对于军事场合而言,野外环境包含高温热带环境、高海拔高原环境、极低温严寒环境等极端环境,这就要求视觉传感器能够在上述环境下进行正常作业。而现有传感器难以满足极限环境下的作业要求。例如,视觉传感器(FUWEI,FV-SJ2016PM-12S-WBN)工作温度为0~50 ℃,湿度为20%~95%RH,那么其在严寒环境或极端干燥的沙漠环境下则难以正常应用。为此,亟需研发能够适应极端环境的视觉传感器,使其能够满足军事应用需求。

此外,针对不同的应用目标,还应研发不同类型的系列化视觉传感器。例如,在某些战场环境下,对于视觉传感器的精度并没有过高要求,但对于运行的可靠性、抗干扰能力有很高的要求;在某些情况下,对于分辨率或帧率有更高的要求;而有些战场环境视野开阔、纵深较大,对于视觉传感器的要求又有不同。现有视觉传感器的技术开发大多集中在有效像素或最大分辨率的提升,缺乏针对军事领域的系列化产品。

3.2 图像获取能力难以适应复杂的军事目标环境

军事领域应用场景复杂多变,这对于视觉识别的准确性提出了更高的要求。一方面,在战场环境中,视觉传感器的视野内大多同时存在不同的人或物而非单一对象,且可能存在因遮挡导致的视野受阻或因烟尘而导致的视野受限等问题,这都不利于机器视觉的大范围应用;另一方面,视野内可能存在多个人或物处于高速运动情况下,在较短时间内准确捕捉目标物的典型特性并进行准确分析较为复杂,这就使得通过机器视觉实现环境识别的难度较大。

随着科技的发展,虽然GloogLeNet深度网络结构、ResNet残差网络、DenseNet前馈网络模型等智能算法已经应用于机器视觉当中,并在不断提高复杂环境下的视觉识别的准确性,但是现有智能识别算法主要集中在日常生活领域,例如人脸识别、商标检测等,其往往需要大规模的数据样本进行学习,才能够获得较好的识别效果。然而,军事目标环境的样本往往很少,且不具有通用性。因此,如何根据常规目标的少量样本图像进行学习,从而使算法具有泛化能力和稳健性,在复杂的军事目标环境下完成多个目标的识别,是有待解决的问题。

此外,机器视觉需要依靠照明系统、成像系统获取图像信息。然而,目前没有普适的机器视觉照明方案,往往需要针对具体的应用环境对照明方案进行调整。对于军事环境而言,往往存在光线昏暗甚至是夜间的作业场景,但由于使用需求不便于设置照明设置,或由于环境受限无法给足充分的照明,这就使得机器视觉所采集的图像效果大打折扣,无法准确地对图像信息进行判断。另一方面,跨介质的视觉处理也是机器视觉在军事领域应用的一大难点。在某些情况下,战场环境不是单一介质,可能存在多种不同的介质,如何在不同介质间实现图像的准确提取与判断也是需要考虑的问题。例如,某些情况下,需要从水中对陆地的场景进行识别与判断,但跨介质很容易导致判断失真或失效。为此,需要对相关问题进行深入研究。

3.3 图像处理速度难以满足军事上实时性要求

战场信息瞬息万变,军事活动中要动态、实时、全面地掌握军事目标的信息,这就对图像处理的实时性提出了很高的要求。一方面,为了针对动态环境提高环境识别的准确性,需要快速高效地对大量的图像和视频进行有效处理,及时提取有效信息,实时地掌握军事目标的动态信息,因此要求视觉处理算法必须具有较快的计算速度,否则会导致系统明显的时滞,难以提高实时掌握动态信息。另一方面,机器视觉处理算法应具有很强的抗干扰能力,即在战场环境中存在干扰信号的情况下,也能够保证快速对图像进行准确处理,使得图像处理的结果准确和不失真,并将结果反馈给指挥系统。

此外,对于基于机器视觉的武器装备无损检测等应用场合,虽然对于实时性的要求低于战场环境的要求,但由于部分武器装备数量及种类繁多,检测速度仍然难以满足工业化生产线上及检修过程中对于损伤高效检测的需求,基于机器视觉的无损检测方法的检测效率仍然有待于提高。

3.4 多传感器融合获取军事目标信息能力缺乏

在战场复杂环境下,单一视觉传感器的视野范围与成像模式无法适应复杂多变的场景。为获取更加可靠、准确的数据结果,需要通过融合多个视觉传感器来解决单一视觉传感器采集数据结果受限的问题。与单传感器相比,多传感器融合在监测、跟踪和识别目标方面能够提高系统的可靠性,增强数据的可信度,同时提高数据的精度。然而,多个视觉传感器所采集的信息在融合过程中存在数据量大、冗余信息多、特征空间维度高等问题,数据的处理难度大幅增大。然而,现有多视觉传感器的信息融合算法仍然有待进一步提高,针对复杂场景下的多信息处理速度还需加强。

此外,除了多个视觉传感器进行信息的高效融合外,还需要考虑不同类型传感器的融合。例如,对于排雷排爆机器人,其除了安装视觉传感器外,可能还安装有激光测距仪、加速度传感器等不同类型的传感器,机器人对于路径的规划需要基于多个不同类型的传感器进行综合判断分析。然而,现有对多信息的高效融合与精准决策技术还有待于进一步突破,导致机器人难以在复杂环境下自主进行精准决策。

4 未来发展趋势

4.1 研发具有耐高温、抗严寒、耐腐蚀的视觉传感器硬件系统

针对高温、高寒等极端战场作战环境,应突破具有极端环境适应性的材料研发、具有高稳定性的结构设计、具有高可靠性的微小型零件高精密加工工艺等关键技术,防止在极端条件下因材料性能发生变化、传感器精密结构失稳或感知器件受损而导致视觉传感器功能失效。同时,对视觉传感器硬件系统极端环境下不确定因素下的可靠性、疲劳特性、使用寿命等性能进行建模分析,通过优化改进不断提高影响系统的综合性能。为降低成本,针对军事领域的视觉传感器硬件系统应在性能上各有侧重,除了对于高温、严寒、存在腐蚀性气体或液体等不同环境具有差异化的硬件系统外,在功能方面也应具有不同的针对性。例如,对于野外背景单一但严寒的高原环境,视觉传感器硬件系统对于复杂环境的辨识能力要求低于对于极端环境的可靠性要求。通过上述研究,最终形成系列化产品。

此外,机器视觉系统将向小型化、高稳定性、高集成度的嵌入式机器视觉系统方向发展。随着嵌入式微处理器功能增强以及存储器集成度增加,小型化、集成化产品是机器视觉技术发展的重要方向,嵌入式的机器视觉系统可以植入到任何地方,能够更隐蔽和高效地获取军事目标信息。将嵌入式系统与机器视觉结合,能够突破机器视觉系统体积对于应用的限制,进一步拓展机器视觉技术在军事领域的应用。

4.2 杂乱、动态及光线不足环境下实现视觉图像高实时性的精准获取

基于面向军事领域的不同类型的视觉传感器硬件系统,进一步对视觉处理算法进行研究,利用机器学习、人工智能等算法,突破背景复杂环境下的特征精确辨识与提取、动态高速目标及光线不足条件下的特征分析等关键技术,使得机器视觉能够在野外复杂环境下实现对图像信息的捕捉与提取,满足机器视觉技术在各类不同场景下对人或物的信息提取。

此外,机器视觉的军事应用正向着立体成像方向发展。二维机器视觉系统将客观存在的立体成像技术空间压缩至二维空间,其性能容易受到环境光、目标伪装等因素的干扰,无法满足获取军事目标信息的需求。目前的立体成像技术视觉军事应用主要集中于模拟训练领域,随着立体成像技术和传感器技术的成熟,从战场可视化、三维战术地图、目标立体识别、三维重构到立体成像打印,三维技术在军事的各领域都有广阔的应用空间,立体成像技术的军事应用将更加丰富,范围更加广泛。

同时,机器视觉技术正向着图像高速处理的方向发展。军事领域的特殊性意味着对机器视觉技术有着更高的要求,对于作战领域,其环境复杂多变。针对军用视觉系统分析数据量大、实时性要求高的需求,将不断通过改进处理算法、提升硬件水平,开发高效的机器视觉系统,使其分析和处理速度满足军事行动的需求。

4.3 复杂环境下多传感器信息高效融合与精准决策

在军事活动中,常常需要配有视觉识别技术的装备在高温、高压、严寒、多遮蔽物、多干扰物、浓雾、黑暗等的复杂乃至极端环境下进行工作,为此需要进一步突破多传感器融合技术,消除单一传感获取数据不准确的问题,从而获得更加准确、更加智能的结果。同时,针对不同环境特点、不同目标建立新的多信息融合与解耦方法,解决采集信息之间互相耦合、数据海量以及信息之间相互影响而限制感知能力和精度等问题,从而高效准确地获取目标图像,满足机器视觉技术在各类不同场景下对人或物的信息提取。

此外,军事装备需要配有机器视觉技术的决策系统。军事领域的有用讯息往往稍纵即逝,针对军用装备对安全性、实时性等特殊要求,将不断开发、改进与装备及视觉系统匹配的决策算法,使其能够在初期进行初步判断,以保证任务的顺利完成。

5 结束语

随着科技的发展,机器视觉技术已经在军事领域得到了广泛的应用,在火炮的辅助瞄准、可疑人员识别、自动化无人装备的环境监测等领域表现出了良好的应用效果。该技术能够不断提升武器装备的作战能力与智能化水平,同时减少人员投入、提高作战效率。在未来,机器视觉技术将进一步向着具有耐高温、抗严寒、耐腐蚀的视觉传感器硬件系统发展,在杂乱、动态及光线不足环境下实现视觉图像高实时性的精准获取,并朝着在复杂环境下多传感器信息高效融合与精准决策的方向发展,在提升军队战斗力、维护国家安全方面起到越来越重要的作用。

[1] 张五一, 赵强松, 王东云. 机器视觉的现状及发展趋势[J]. 中原工学院学报, 2008, 19(1): 9–12, 15.

ZHANG Wuyi, ZHAO Qiangsong, WANG Dongyun. Current situation and development trend of machine vision[J]. Journal of Zhongyuan Institute of Technology, 2008, 19(1): 9–12, 15.

[2] 宋春华, 彭泫知. 机器视觉研究与发展综述[J]. 装备制造技术, 2019, (6): 213–216.

SONG Chunhua, PENG Xuanzhi. Review of machine vision research and development[J]. Equipment Manufacturing Technology, 2019, (6): 213–216.

[3] 尹仕斌, 任永杰, 刘涛, 等. 机器视觉技术在现代汽车制造中的应用综述[J]. 光学学报, 2018, 437(8): 11–22.

YIN Shibin, REN Yongjie, LIU Tao, et al. Overview of the application of machine vision technology in modern automobile manufacturing [J]. Journal of Optics, 2018, 437(8): 11–22.

[4] 朱云, 凌志刚, 张雨强. 机器视觉技术研究进展及展望[J]. 图学学报, 2020, 41(6): 871–890.

ZHU Yun, LING Zhigang, ZHANG Yuqiang. Research progress and Prospect of machine vision technology[J]. Journal of Graphics, 2020, 41(6): 871–890.

[5] “中国工程科技2035发展战略研究”项目组. 中国工程科技2035发展战略[M]. 北京: 科学出版社, 2019.

[6] 秦亚航, 苏建欢, 余荣川. 机器视觉技术的发展及其应用[J]. 科技视界, 2016,(25): 153–154.

QIN Yahang, SU Jianhuan, YU Rongchuan. Development and application of machine vision technology[J]. Science and Technology Horizon, 2016,(25): 153–154.

[7] 黄少罗, 张建新, 卜昭锋. 机器视觉技术军事应用文献综述[J]. 兵工自动化, 2019, 38(2): 16–21.

HUANG Shaoluo, ZHANG Jianxin, BU Zhaofeng. Literature review of military application of machine vision technology[J]. Ordnance automation, 2019, 38(2): 16–21.

[8] FU K, ROSENFELD A. Pattern-recognition and image-processing[J]. IEEE Transactions on Computers, 1976, 25(12): 1336–1346.

[9] STEGER C, ULRICH M, WIEDEMANN C. 机器视觉算法与应用(第2版)[M]. 北京: 清华大学出版社, 2019.

[10] 吕家祺. 基于混合式聚光方法的日光照明系统[D]. 长春: 长春理工大学, 2021.

[11] 黄从高. 面光源均匀照明系统设计与实验研究[D]. 杭州: 杭州电子科技大学, 2021.

[12] 周壹义. 大功率LED照明系统的二次光学设计研究[D]. 广州: 华南理工大学, 2012.

[13] 张建忠. 红外双波段视景仿真器光学系统的研究[D]. 长春: 中国科学院研究生院(长春光学精密机械与物理研究所), 2013.

[14] 孙盈. 非扫描成像激光雷达达曼光栅阵列照明性能研究[D]. 哈尔滨: 哈尔滨工业大学, 2009.

[15] 李俊. 机器视觉照明光源关键技术研究[D]. 天津: 天津理工大学, 2007.

[16] VRIESENGA M, HEALEY G, PELEG K, et al. Controlling illumination color to enhance objectdiscriminability[C]// IEEE Conference on Computer Vision and Pattern Recognition, 1992.

[17] 张云, 吴晓君, 马廷武, 等. 基于机器视觉的零件图像采集及识别的研究[J]. 电子工程师, 2006, 32(4): 29–31, 65.

ZHANG Yun, WU Xiaojun, MA Tingwu, et al. Research on part image acquisition and recognition based on machine vision [J]. Electronic Engineer, 2006, 32 (4): 29–31, 65.

[18] RAJNI, ANUTAM. Image denoising techniques-An overview[J]. International Journal of Computer Applications, 2014, 86(16): 13–17.

[19] ANNABY M H, FOUDA Y M, RUSHDI M A. Improved normalized cross-correlation for defect detection in printed-circuit boards[J]. IEEE Transactions on Semiconductor Manufacturing, 2019, 32(2): 199–211.

[20] 郭智杰, 王明泉, 张俊生, 等. 基于机器视觉的轮毂在线识别分类技术研究[J]. 测试技术学报, 2019, 33(3): 233–237.

GUO Zhijie, WANG Mingquan, ZHANG Junsheng, et al. Research on on-line recognition and classification technology of wheel hub based on machine vision[J]. Journal of Testing Technology, 2019, 33(3): 233–237.

[21] ZHOU X, WANG Y, XIAO C, et al. Automatedvisual inspection of glass bottle bottom with saliencydetection and template matching[J]. IEEE Transactions on Instrumentation and Measurement, 2019, 68(11): 4253–4267.

[22] DING R, DAI L, LI G, et al. TDD-Net: A tiny defect detection network for printed circuit boards[J]. CAAI Transactions on Intelligence Technology, 2019, 4(2): 110–116.

[23] YUAN X, WU L, PENG Q J. An improved otsu method using the weighted object variance for defect detection[J]. Applied Surface Science, 2015, 349: 472–484.

[24] ZHU L J, GAO Y, YEZZI A, et al. Automatic segmentation of the left atrium from MR images via variational region growing with a moments-based shape prior[J]. IEEE Transactions on Image Processing, 2013, 22(12): 5111–5122.

[25] FERRARI V, FEVRIER L, JURIE F, et al. Groups of adjacent contour segments for object detection[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2008, 30(1): 36–51.

[26] GIRSHICK R, DONAHUE J, DARRELL T, et al. Region-based convolutional networks for accurate object detection and segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2016, 38(1): 142–158.

[27] ZHOU X, WANG Y, XIAO C, et al. Automatedvisual inspection of glass bottle bottom with saliencydetection and template matching[J]. IEEE Transactions on Instrumentation and Measurement, 2019, 68(11):4253–4267.

[28] 秦放, 曾维佳, 罗佳伟, 等. 基于深度学习的多模态融合图像识别研究[J]. 信息技术, 2022(4): 29–34.

QIN Fang, ZENG Weijia, LUO Jiawei, et al. Research on multi-modal fusion image recognition based on deep learning[J]. Information Technology, 2022(4): 29–34.

[29] 边柯橙. 基于深度学习的玉米常见病害图像识别研究及应用[D]. 兰州: 兰州财经大学, 2021.

[30] LIU Jian, GAO Wei. Maritime target detection and tracking[C]//2019 IEEE 2nd International Conference on Automation, Electronics and Electrical Engineering (AUTEEE), 2019.

[31] ZHANG M , CHOI J, DANIILIDIS K, et al. VAIS: A dataset for recognizing maritime imagery in the visible and infrared spectrums[C]//2015 IEEE Conference on Computer Vision and Pattern Recognition Workshops(CVPRW), 2015.

[32] 赵浩光, 王平, 董超, 等. 结合多尺度视觉显著性的舰船目标检测[J]. 光学精密工程, 2020, 28(6): 1395–1403.

ZHAO Haoguang, WANG Ping, DONG Chao, et al. Ship target detection combined with multi-scale visual saliency[J]. Optical precision engineering, 2020, 28(6): 1395–1403.

[33] 韩萍, 万义爽, 刘亚芳, 等. LBP特征分类的极化SAR图像机场跑道检测[J]. 中国图象图形学报, 2021, 26(4): 9.

HAN Ping, WAN Yishuang, LIU Yafang, et al. Airport runway detection based on LBP featureclassification in PolSAR images[J]. Journal of image and graphics, 2021, 26(4): 9.

[34] SENPHENG M, RUCHANURUCKS M. Automatic landing assistant system based on stripe lines on runway using computer vision[C]//2015 International Conference on Science and Technology(TICST), 2015.

[35] 刘佳铭. 基于视觉测量的舰载机空间定位方法[J]. 中国舰船研究, 2019, 14(5):152–158.

LIU Jiaming. Spatial positioning method of shipborne aircraft based on visual measurement[J]. China Ship Research, 2019, 14(5): 152–158.

[36] WANG X, KONG X, ZHI J, et al. Real-time drogue recognition and 3D locating for UAV autonomous aerial refueling based on monocular machine vision[J]. Chinese Journal of Aeronautics, 2015, 28(6): 1667–1675.

[37] HUA X, WANG X, WANG D, et al. Military object real-time detection technology combined with visual salience and psychology[J]. Electronics, 2018, 7(10): 216.

[38] 常川, 刘科成. 基于机载机器视觉的无人机自主目标跟踪研究[J]. 网络安全技术与应用, 2019, (7): 47–51.

CHANG Chuan, LIU Kecheng. Research on autonomous target tracking of UAV based on airborne vision[J]. Network Security Technology And Application, 2019, (7): 47–51.

[39] IRHEBHUDE M, EDIRISINGHE E. Military personnel recognition system using texture, colour, and surf features[C]// Automatic Target Recognition, 2014.

[40] PATOLIYA J, MEHTA H, PATEL H. Arduino controlled war field spy robot using night vision wireless camera and android application[C]//2015 5th Nirma University International Conference on Engineering(NUiCONE), 2015.

[41] SATHISHKUMAR K, MARISELVAMA K. War field spying robot with wireless camera using brain robot interface[J]. International Journal of Engineering Development and Research, 2015, 3(1): 422–427.

[42] MAHESHWARI T, KUMAR U, NAGPAL C, et al. Capturing the spied image-video data using a flexi-controlled spy-robot[C]// Third International Conference on Image Information Processing, 2016.

[43] MA M. Simulation of intelligent unmanned aerial vehicle(UAV) for military surveillance[C]// 2013 International Conference on Advanced Computer Science and Information Systems(ICACSIS), 2013.

[44] YLMAZER B, SOLAK S. Cloud computing based masked face recognition application[C]// 2020 Innovations in Intelligent Systems and Applications Conference(ASYU), Istanbul, Turkey, 2020.

[45] VOYNICHKA I, MEGHERBI D. Analysis of the effects of image transformation, template selection, and partial information on face recognition with time-varying expressions for homeland security applications[C]//2013 IEEE International Conference on Technologies for Homeland Security(HST), 2013.

[46] 刘立欣, 王文生, 刘广利. 枪械内膛疵病图像的边缘检测算法[J]. 兵工学报, 2005(1): 105–107.

LIU Lixin, WANG Wensheng, LIU Guangli. Edge detection algorithm of gun bore defect image[J]. Journal of Ordnance Engineering, 2005: 105–107.

[47] 王百荣, 张国华, 蒋以山. X射线无损检测在炮弹识别中的应用[J]. 核电子学与探测技术, 2006, 26(1): 14–15.

WANG Bairong, ZHANG Guohua, JIANG Yishan. Application of X-ray in shell nondestructive testing[J]. Nuclear Electronics and Detection Technology, 2006, 26(1): 14–15.

[48] 史进伟, 郭朝勇, 刘红宁. 基于机器视觉的枪弹外观缺陷检测系统研究[J]. 组合机床与自动化加工技术, 2013, (4): 59–64.

SHI Jinwei, GUO Chaoyong, LIU Hongning. Research on bullet appearance defect detection system based on machine vision[J]. Modular machine tools and automatic processing technology, 2013, (4): 59–64.

[49] 张亚军, 齐杏林, 董成基. 基于机器视觉的枪弹钢芯自动检测系统[J]. 兵工自动化, 2012, 31(7): 8–11.

ZHANG Yajun, QI Xinglin, DONG Chengji. Automatic detection system of bullet steel core based on machine vision[J]. Ordnance Automation, 2012, 31(7): 8–11.

[50] 柳革命, 刘鹏. 基于机器视觉的弹壳多尺寸测量[J]. 工业控制计算机, 2016, 29(4): 60–61.

LIU Geming, LIU Peng. Multi dimension measurement of cartridge case based on machine vision[J]. Industrial Control Computer, 2016, 29(4): 60–61.

[51] 邵欣桐, 刘省贤. 基于机器视觉的飞机轮胎检查技术研究[J]. 科学技术创新, 2020, (35): 18–20.

SHAO Xintong, LIU Shengxian. Research on aircraft tire inspection technology based on machine vision[J]. Science and Technology Innovation, 2020, (35): 18–20.

[52] LI X, MING Y, HUANG S. Design of target recognition system based on machine vision[C]//2010 International Conference on Computational Intelligence and Software Engineering, 2010.

[53] 寇昆湖, 张友安, 柳爱利. 视觉辅助飞航导弹INS定位误差快速修正方法[J]. 系统工程与电子技术, 2013, 35(2): 397–401.

KOU Kunhu, ZHANG Youan, LIU Aili. Fast correction method of INS positioning error of vision assisted cruise missile[J]. Systems Engineering and Electronic Technology, 2013, 35(2): 397–401.

[54] WILSON J R. Machine vision[J]. Military & Aerospace Electronics, 2001, 12(8): 14.

[55] KELLER J. Artificial intelligence and machine vision for unmanned vehicle smart cameras is aim of DARPA mind's eye program[J]. Military & Aerospace Electronics, 2010, 21(5): 36–39.

[56] STEPHEN D, CONNELL O, MARTIN C, et al. Eye tracking-based target designation in simulated close range air combat[C]//Proceedings of the Human Factors and Ergonomics Society Annual Meeting, 2012.

[57] DENG L, ZHANG Z, XIANG W, et al. Machinevision-based method and system for aircraft docking guidance and aircraft type identification: EP20150828078[P]. 2017-07-26.

[58] MILLER A, MILLER B. Stochastic control of light UAV at landing with the aid of bearing-only servations[C]//Eighth International Conference on Machine Vision, 2015.

[59] DENG C, WANG S W. Machine vision-based unmanned aerial vehicle positioned landing method and ystem: CN105388908A[P]. 2016-03-09.

[60] 苗锡奎, 朱枫, 许以军, 等. 基于视觉的水雷目标识别方法研究[J]. 海洋工程, 2012, 30(4): 154–160.

MIAO Xikui, ZHU Feng, XU Yijun, et al. Mine object recognition method research of AUV based on vision[J]. The Ocean Engineering, 2012, 30(4): 154–160.

[61] 高明. 基于视觉和惯性导航的水下机器人组合定位设计[D]. 杭州: 浙江大学, 2014.

[62] 陈元杰, 朱康武, 葛耀峥, 等.基于双目视觉的水下定位系统[J]. 机电工程, 2011, 28(5): 567–573.

CHEN Yuanjie, ZHU Kangwu, GE Yaozheng, et al. Binocular vision based locating system for underwater inspection[J]. Journal of Mechanical & Electrical Engineering, 2011, 28(5): 567–573.

[63] 史言彬.基于单目视觉的水下目标识别和定位方法研究[D]. 哈尔滨: 哈尔滨工程大学, 2016.

[64] KATIJA K, ROBERTS P L D, DANIELS J, et al. Visual tracking of deepwater animals using machine learning-controlled robotic underwater vehicles[C]// 2021 IEEE Winter Conference on Applications of Computer Vision(WACV), 2021.

Application status and development trend of machine vision in military field

CHEN Jing, GONG Liming

(Unit 93160 of the People's Liberation Army, Beijing 100076, China)

With the advantages of non-contact measurement, good real-time and sustainable work, machine vision technology has broad application prospects in the military field. Based on the overview of key technologies, such as machine vision optical lighting system, imaging system and visual information processing system, the application status of machine vision technology in typical scenes, such as typical target recognition, personnel identification, equipment defect detection, and typical military equipment in military field were analyzed in this paper. On this basis, the problems that still exist in the application of machine vision in the military field, such as the visual sensor hardware system is difficult to adapt to the extreme environment, the adaptability of complex military targets is insufficient, the real-time performance of target recognition is difficult to ensure, and the ability of multi-sensor fusion to obtain military target information is insufficient, all those were pointed out in detail. Then the future development trend of machine vision technology in military field was prospected. The results of this study can be used as a reference for the further practical application of machine vision in the military field.

Machine vision; Military equipment; Target recognition; Anomaly detection

Website: ycyk.brit.com.cn Email: ycyk704@163.com

TP391

A

CN11-1780(2022)06-0124-12

10.12347/j.ycyk.20211115001

陈静, 宫黎明.机器视觉在军事领域的应用现状及发展趋势[J]. 遥测遥控, 2022, 43(6): 124–135.

10.12347/j.ycyk.20211115001

: CHEN Jing, GONG Liming. Application status and development trend of machine vision in military field[J]. Journal of Telemetry, Tracking and Command, 2022, 43(6): 124–135.

2021-11-15

2022-06-28

陈 静 1988年生,本科,工程师,主要研究方向为机械设计制造及其自动化。

宫黎明 1981年生,硕士,工程师,主要研究方向为计算机科学与技术。

(本文编辑:傅 杰)