悲伤表情识别能力影响疼痛共情

——一项ERP 研究 *

2022-11-16钟伟芳郭永兴

钟伟芳 郭永兴

(1 广东司法警官职业学院,广州 510520) (2 广州市格米网络科技有限公司,广州 510660)(3 华南师范大学心理应用研究中心,广州 510631)

1 引言

疼痛共情(empathy for pain)指个体对他人疼痛的感知、判断和情绪反应(Danziger et al., 2006;Meng et al., 2012)。研究表明,疼痛共情可以帮助个体理解他人的痛苦并做出合适的情绪与行为反应,有助于个体建立和维持良好的人际关系,并可促进个体的亲社会行为,抑制其暴力、欺负等反社会行为(高雪梅 等, 2015; 孟景 等, 2010; Jolliffe &Farrington, 2004)。近十多年,随着认知神经科学的发展,疼痛共情成为研究的热点,许多研究关注了疼痛共情的影响因素及其影响机制,探索改善个体疼痛共情能力的方法。

面部表情(以下简称表情)指通过眼部肌肉、颜面肌肉和口部肌肉的变化来表现各种情绪状态。研究指出,识别他人表情可以帮助个体了解他人的情绪状态、社会意图等,并做出合适的反应(刘宏艳, 葛列众, 2014; Keltner & Kring, 1998)。由此可见,表情识别能力与个体理解他人情感,即共情有着密切关系。正如Stel 等(2008)发现的,表情能诱发个体对他人情绪状态的自动感知,产生共情。先前很多研究关注了疼痛共情是否影响个体对他人表情的识别能力,并得到了较肯定的结果(颜志强 等, 2016; Vervoort et al.,2013),但较少研究探讨表情识别能力会否影响个体疼痛共情(宋娟 等, 2019)。不少研究探讨了疼痛共情的影响因素及机制,其中,主体因素会否及如何影响疼痛共情是一个研究重点(孟景 等,2010)。可见,要进一步了解主体因素对个体疼痛共情的影响效应及机制,很有必要对此问题进行探讨。

有研究发现,对他人表情识别能力的缺损与个体愤怒、攻击行为有重要关系。例如,Dodge(1993)发现,对模棱两可的表情作倾向于敌意等消极解释的个体更多地发生攻击行为。Penton-Voak 等(2013)进一步发现,提升个体从他人含有愤怒和快乐的表情中识别出快乐情绪的能力,可以抑制其愤怒和攻击行为。关于表情识别与疼痛共情关系的研究则发现,当个体识别到他人悲伤、痛苦表情时,相关脑区会得到激活,并产生疼痛感觉体验(Goubert et al., 2005);相较于中性表情,个体在识别到他人痛苦等表情时,相关脑电活动会显著增强(Han et al., 2016)。既然在模棱两可表情中识别出快乐情绪的能力会影响个体的愤怒和攻击行为,而对他人悲伤、痛苦表情的识别可能与疼痛共情有重要关系,那么个体在模棱两可表情中识别出悲伤、痛苦情绪的能力会否影响其疼痛共情呢?解答该问题对于了解表情识别能力会否及如何影响疼痛共情,进一步揭示表情识别能力对个体社会行为的影响具有重要意义。

事件相关电位(event-related potential, ERP)研究发现,疼痛共情包括早期情绪分享和疼痛感知(自下而上的自动加工)及晚期认知评价(自上而下的控制加工)两个过程(Fan & Han, 2008; Han et al., 2008)。如果悲伤、痛苦表情识别能力影响个体疼痛共情,那么其影响疼痛共情的早期情绪分享和疼痛感知,还是晚期认知评价过程呢?对于了解表情识别能力对个体疼痛共情的影响机制,这是一个待探讨的问题。

为探讨上述问题,本研究设计了一个实验。实验中,先采用快乐-悲伤表情分界测验区分出悲伤表情高、低识别力两组被试,之后让两组被试完成脑电测验(记录被试观看他人疼痛和非疼痛图片时的脑电反应),通过比较两组被试的脑电反应揭示悲伤表情识别能力会否影响个体疼痛共情及影响的时程特点。先前研究指出,ERP 早期成分N1、P2、N2 反映了疼痛共情过程中的早期情绪分享和疼痛感知,晚期成分P3 和LPC 则反映了晚期认知评估(Cui et al., 2016; Luo et al., 2018;Meng et al., 2019)。如果在这些成分的1 个或多个上,被试类型与图片类型有显著交互作用,就证明悲伤表情识别能力会影响个体疼痛共情。进一步分析被试类型与图片类型的交互作用出现在早期还是晚期ERP 成分上,就可以揭示出悲伤表情识别能力影响个体疼痛共情的时程特点。

本研究预期,脑电测试将出现被试类型与图片类型有显著交互作用的结果,但是,由于表情分界测验所用的是从快乐到悲伤连续变化的表情图片,这一结果也可能说明了快乐表情而非悲伤表情识别力会影响个体疼痛共情。为排除此可能性,本研究将采用从快乐到惊讶连续变化的表情图片(悲伤状态下个体较少出现惊讶表情,因此本研究设想识别到惊讶表情不影响个体疼痛共情),通过让上述被试完成快乐-惊讶表情分界测验,区分出快乐表情高、低识别力被试,之后对比两组的ERP 数据。如果此时被试类型与图片类型无显著交互作用,就可以排除上述可能性,转而支持悲伤表情识别能力影响个体疼痛共情的结论。

2 研究方法

2.1 被试

30 名大学生自愿参加本实验。其中,悲伤表情高识别力组15 名(男7 名),平均年龄19.87±1.51 岁,低识别力组15 名(男8 名),平均年龄19.53±1.19 岁;快乐表情低识别力组14 名(男8 名),平均年龄19.21±1.12 岁,高识别力组16 名(男7 名),平均年龄20.13±1.41 岁(分组方法下述)。被试均右利手,视力或矫正视力正常,无精神病及长期药物使用史。

2.2 实验材料

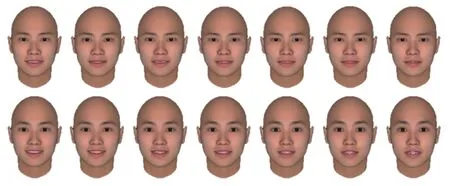

表情分界测验中,采用从快乐到悲伤,及从快乐到惊讶连续变化的两系列各7 张表情图片为材料。图片用FaceGen Modeller 软件生成,面孔设置为20 岁、中性、面部对称的东南亚人面孔。快乐-悲伤系列图片中快乐和悲伤成分依次为:65%、35%;60%、40%;55%、45%;50%、50%;45%、55%;40%、60%;35%、65%(见图1 上)。快乐-惊讶系列图片快乐和惊讶成分依次为:80%、20%;70%、30%;60%、40%;50%、50%;40%、60%;30%、70%;20%、80%(见图1 下)。18 名不参加正式实验的大学生(男11 名)对两系列图片分别进行了从最快乐到最悲伤和从最快乐到最惊讶的排序,平均正确率分别为90.45%(SD=13.86%)和87.30%(SD=14.61%)(图1 展示的为正确图序),说明两系列图片均很好地描述了表情的连续变化。

图1 表情分界测验所用的面部表情图片

脑电测试采用256 张经评定的、常见且无歧义的疼痛-非疼痛的彩色图片为材料,两类图片各128 张。其中,疼痛图片是个体的手或脚受伤的图片;非疼痛图片则与之相反,并配对出现(示例见图2)。所有图片的大小和像素均相同。

图2 脑电测试所用的疼痛(左)和非疼痛(右)图片示例

2.3 实验设计

2(被试类型:悲伤表情高识别力、低识别力,或快乐表情高识别力、低识别力)×2(图片类型:疼痛、非疼痛)×3(电极位置:左半球、中线、右半球)混合设计。其中,第一个因素为被试间因素,后两个为被试内因素。因变量为被试在测试中的ERP 数据。

2.4 实验程序

实验首先以快乐-悲伤表情分界测验选取悲伤表情高识别力和低识别力两组被试。招募大学生被试若干,让被试观察图1(上)的图片并划出快乐和悲伤表情的分界线。实验将分界线划在中间图片左侧或右侧的被试分别归入悲伤表情高识别力或低识别力组,并据此选出两组各15 名,共30 名被试。

之后,让被试接受快乐-惊讶表情分界测验,观察图1(下)的图片后划出快乐和惊讶表情的分界线。实验将分界线划在中间图片左侧或右侧的被试分别归入快乐表情低识别力或高识别力组,区分出快乐表情低和高识别力者14 和16 人。

最后,让被试接受脑电测试。测试在光线柔和且安静的实验室中进行。被试坐在舒适的椅子上,距离电脑屏幕约80 cm,水平和垂直视角均在5°以内。每个试次中,先以随机时间呈现注视点“+”400~600 ms,之后随机呈现一张疼痛或非疼痛图片1 5 0 0 m s,接着以随机时间呈现空屏400~600 ms。要求被试评价别人发生图中的事情时会否疼痛,并对应按“J”或“F”键。实验共有两个组块,每个组块128 个试次。每个组块的图片均不重复出现,疼痛与非痛疼图片各半。配对的疼痛和非疼痛图片不在同一个组块中出现。每个组块中的试次随机呈现。组块呈现顺序和被试按键反应手在被试间平衡。

2.5 脑电数据记录与分析

采用Neuroscan 系统采集与分析脑电数据。采集数据时,使用10-20 系统64 导Ag/AgCl 电极Easycap 电极帽,以左侧乳突为参考,设置采样率为1000 Hz,频带宽度为0.05~100 Hz,电阻小于5 kΩ,将水平和垂直眼电电极置于两眼外侧眼角和左眼上下眼眶。离线分析时,将数据转换为以双侧乳突平均值为参考,做带宽为0.8~20 Hz、陡阶为24 db/Oct 的无相位移滤波,采用Neuroscan 系统默认方法自动矫正眨眼等伪迹。ERP 分析时程为刺激呈现前200 ms 至后1000 ms。根据刺激类型(疼痛和非疼痛图片)叠加数据,并在叠加前剔除伪迹使电压大于100 μV 的事件。按有任一刺激类型的脑电事件被剔除超过40%的标准删除无效被试,结果无被试被删除。

对N1、P2、N2、P3 和LPC 等成分进行分析。在参考前人研究及分析ERP 图形的基础上,确定N1、P2、N2、P3 和LPC 的分析时间窗为分别为90~150 ms、150~210 ms、210~290 ms、300~450 ms 和400~800 ms,并选取FP1、FPz、FP2、F3、Fz、F4、FC3、FCz、FC4 电极点分析N1、P2、N2,选取F3、Fz、F4、FC3、FCz、FC4、C3、Cz、C4 电极点分析P3,选取FC3、FCz、FC4、C3、Cz、C4、CP3、CPz、CP4 电极点分析LPC(宋娟 等, 2016; Fan & Han, 2008; Han et al., 2008)。

3 结果

3.1 悲伤表情高识别力和低识别力组的反应正确率和反应时

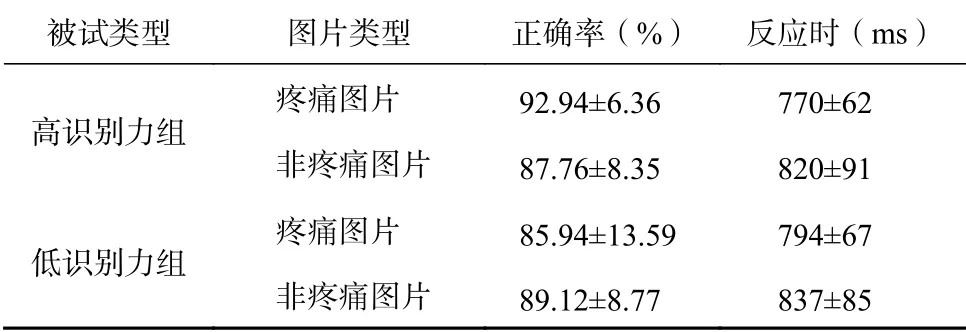

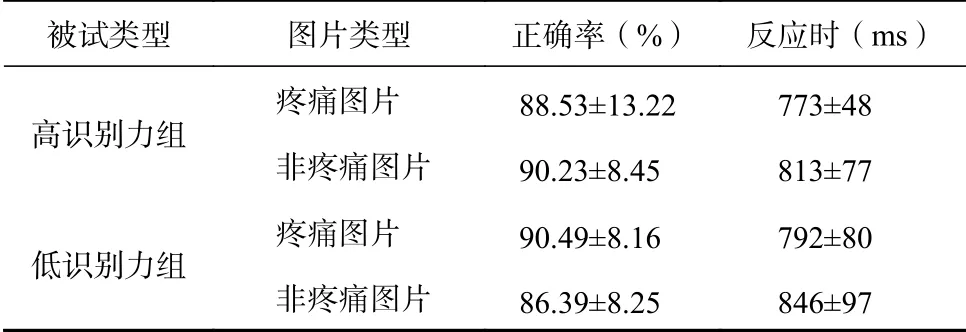

不同组别被试的图片判断正确率和反应时如表1 所示。

表1 不同悲伤表情识别力组的图片判断平均正确率和反应时

对正确率和反应时分别进行2(被试类型)×2(图片类型)重复测量方差分析。对正确率的分析表明,所有主效应均不显著(ps>0.05),两因素交互作用边缘显著,F(1, 28)=14.68,p=0.100,=0.09。简单效应分析表明,对于悲伤表情高识别力被试,疼痛图片的正确率高于非疼痛图片,F(1, 14)=14.68,p=0.047,=0.25,对于悲伤表情低识别力被试,两类图片的正确率无显著差异,F(1, 14)=0.55,p=0.470。对反应时的分析(删除错误反应及两个标准差外的数据)表明,图片类型主效应显著,F(1, 28)=14.68,p<0.001,=0.34,其他效应均不显著(ps>0.05)。这些结果在一定程度上表明,悲伤表情高识别力者的疼痛共情水平更高。

3.2 悲伤表情高识别力和低识别力组的ERP

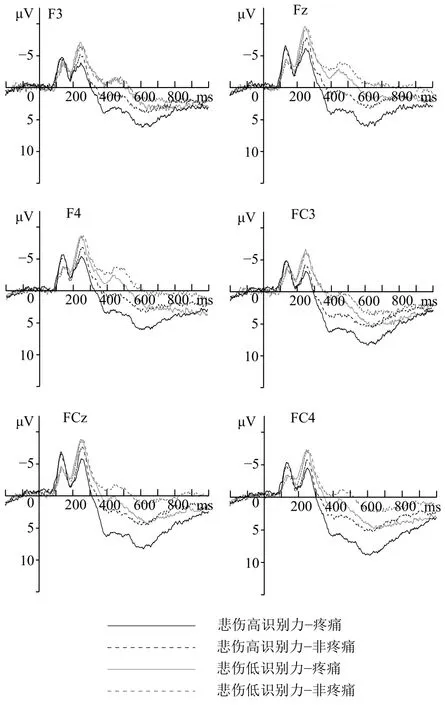

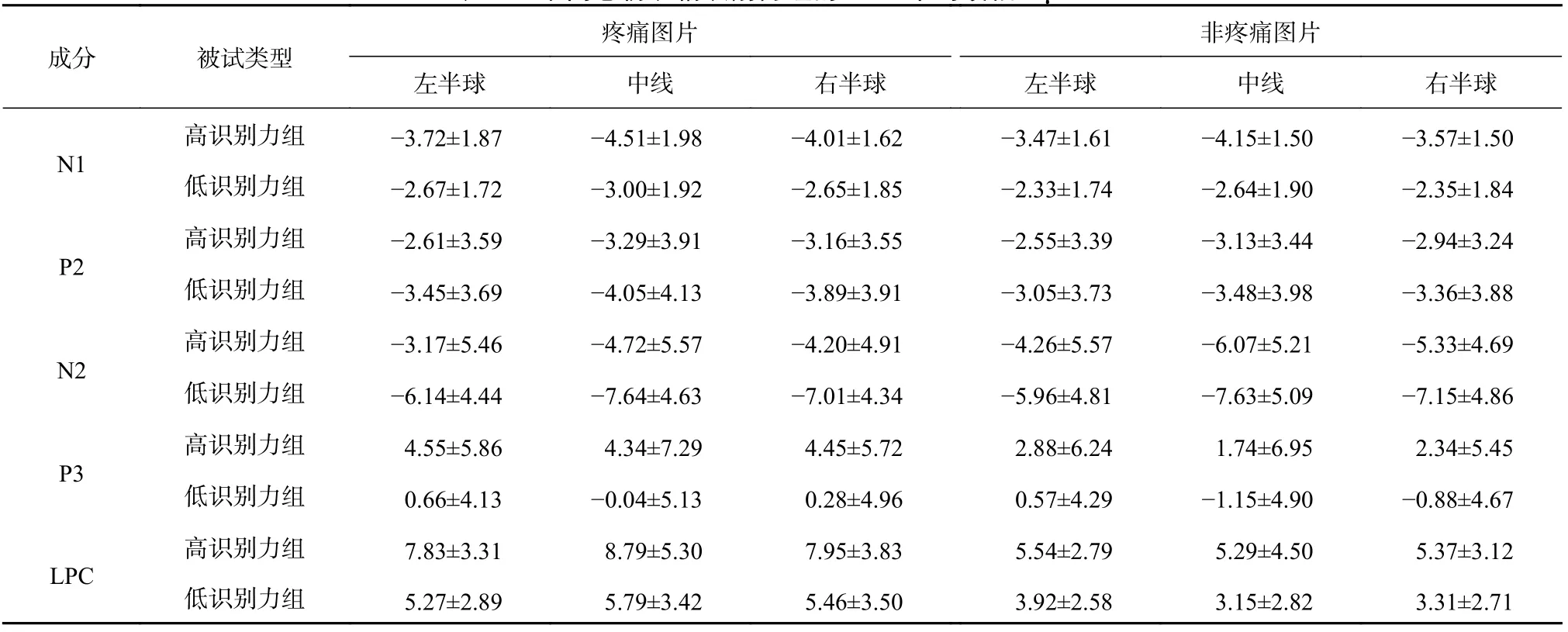

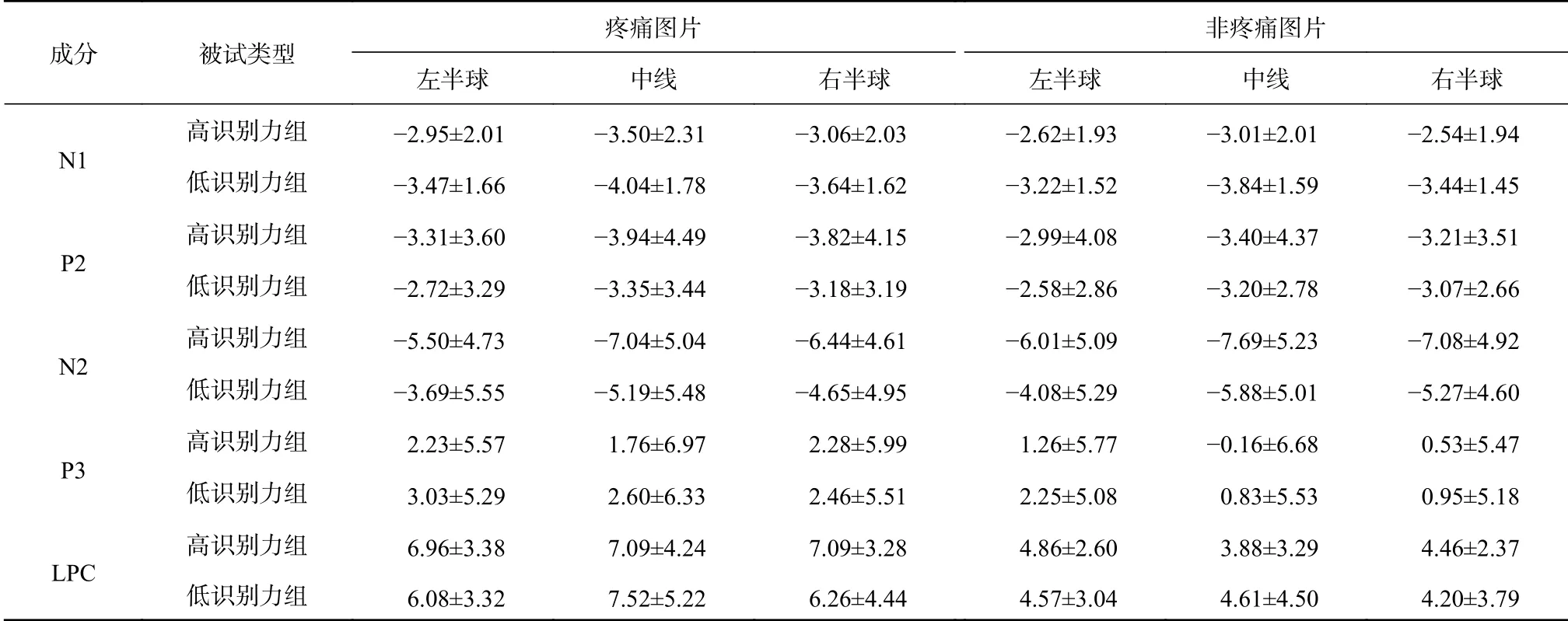

不同组别被试在不同实验条件下的ERP 平均波幅见表2,波形图见图3。

图3 不同悲伤表情识别力组在不同实验条件下诱发的ERP 总平均

表2 不同悲伤表情识别力组的ERP 平均波幅(μV)

对N1、P2、N2、P3 及LPC 波幅分别进行2(被试类型)×2(图片类型)×3(电极位置)重复测量方差分析。结果如下。

对N1 的分析表明:被试类型主效应显著,F(1, 28)=4.68,p=0.040,=0.14;图片类型主效应边缘显著,F(1, 28)=3.04,p=0.090,=0.10;电极位置主效应显著,F(2, 56)=16.89,p<0.001,=0.38;交互作用均不显著(ps>0.05)。

对P2 的分析表明:被试类型和图片类型主效应均不显著(ps>0.05);电极位置主效应显著,F(2, 56)=12.58,p<0.001,=0.31;交互作用均不显著(ps>0.05)。

对N2 的分析表明:被试类型主效应不显著,F(1, 28)=1.67,p=0.210;图片类型主效应显著,F(1, 28)=4.37,p=0.046,=0.14;电极位置主效应显著,F(2, 56)=26.38,p<0.001,=0.49;图片类型和被试类型交互作用显著,F(1, 28)=4.64,p=0.040,=0.14;其他交互作用均不显著(ps>0.05)。简单效应分析表明:对于悲伤表情高识别力被试,疼痛图片诱发的N2 波幅显著小于非疼痛图片诱发的,F(1, 14)=6.12,p=0.030,=0.30;对于悲伤表情低识别力被试,两类图片诱发的N2 波幅无显著差异,F(1, 14)=0.004,p=0.950。

对P3 的分析表明:被试类型主效应边缘显著,F(1, 28)=3.18,p=0.080,=0.10;图片类型主效应显著,F(1, 28)=26.03,p<0.001,=0.48;电极位置主效应边缘显著,F(2, 56)=2.88,p=0.060,=0.09;图片类型与电极位置交互作用显著,F(2,56)=15.43,p<0.001,=0.36;图片类型与被试类型交互作用显著,F(2, 56)=5.51,p=0.030,=0.16;其他交互作用均不显著(ps>0.05)。简单效应分析表明:对于两组被试,疼痛图片均比非疼痛图片诱发了更大的波幅(ps<0.05);对于疼痛图片,悲伤表情高识别力被试的波幅显著更大,F(1,28)=4.35,p=0.046,=0.13,对于非疼痛图片,两组被试的波幅无显著差异,F(1, 28)=2.07,p=0.160。

对LPC 的分析表明:被试类型主效应边缘显著,F(1, 28)=4.08,p=0.050,=0.13;图片类型主效应显著,F(1, 28)=67.79,p<0.001,=0.71;电极位置主效应不显著,F(2, 56)=0.17,p=0.840;图片类型与电极位置交互作用显著,F(2, 56)=15.96,p<0.001,=0.36;其他交互作用均不显著(ps>0.05)。

这些结果显示:疼痛和非疼痛图片诱发的N2、P3、LPC 波幅均有显著差异,说明实验图片能很好地描述疼痛和非疼痛两种状态;更重要的是,在N1、P3、LPC 成分上悲伤表情高、低识别力被试有显著或边缘显著差异,在N2 和P3 成分上被试类型与图片类型有显著交互作用,提示对悲伤表情识别能力会影响个体疼痛共情,悲伤表情高识别力者的疼痛共情水平更高,且此效应同时出现在疼痛共情的早期情绪分享和疼痛感知,及晚期认知评价之上。

3.3 快乐表情高识别力和低识别力组的实验数据

为分析实验效应是否由快乐表情而非悲伤表情识别力的不同引致的,将被试分为快乐表情高、低识别力两组,比较两者的行为数据及ERP。两组被试在不同实验条件下的正确率、反应时,以及N1、P2、N2、P3 和LPC 的平均波幅见表3 和表4。

表3 不同快乐表情识别力组的图片判断平均正确率和反应时

表4 不同快乐表情识别力组的ERP 平均波幅(μV)

对正确率和反应时分别进行2(被试类型)×2(图片类型)重复测量方差分析。对正确率的分析表明,所有主效应及交互作用均不显著(ps>0.05);对反应时的分析表明,图片类型主效应显著,F(1, 28)=15.07,p<0.001,=0.35,其他效应均不显著(ps>0.05)。这些结果一定程度上排除了实验效应由快乐表情识别力不同引致的可能性。

对各成分的波幅分别进行2(被试类型)×2(图片类型)×3(电极位置)重复测量方差分析。结果如下。

对N1 的分析表明:被试类型主效应不显著,F(1, 28)=1.08,p=0.310;图片类型主效应边缘显著,F(1, 28)=2.93,p=0.090,=0.10;电极位置主效应显著,F(2, 56)=15.91,p<0.001,=0.36;交互作用均不显著(ps>0.05)。

对P2 的分析表明:被试类型和图片类型主效应均不显著(ps>0.05);电极位置主效应显著,F(2, 56)=12.68,p<0.001,=0.31;交互作用均不显著(ps>0.05)。

对N2 的分析表明:被试类型主效应不显著,F(1, 28)=1.04,p=0.320;图片类型主效应边缘显著,F(1, 28)=3.71,p=0.050,=0.12;电极位置主效应显著,F(2, 56)=26.29,p<0.001,=0.48;交互作用均不显著(ps>0.05)。

对P3 的分析表明:被试类型主效应不显著,F(1, 28)=0.12,p=0.740;图片类型主效应显著,F(1, 28)=21.53,p<0.001,=0.44;电极位置主效应边缘显著,F(2, 56)=2.89,p=0.060,=0.09;图片类型与电极位置的交互作用显著,F(2,56)=14.51,p<0.001,=0.34;其他交互作用均不显著(ps>0.05)。

对LPC 的分析表明:被试类型和电极位置主效应均不显著(ps>0.05);图片类型主效应显著,F(1, 28)=64.49,p<0.001,=0.70;图片类型与电极位置的交互作用显著,F(2, 56)=15.85,p<0.001,=0.36;其他交互作用均不显著(ps>0.05)。

这些结果显示:五个成分的波幅均无显著被试类型差异,且被试类型与图片类型交互作用均不显著。这一结果可以排除上述实验效应源于快乐表情识别力影响个体疼痛共情的可能性,进一步支持悲伤表情高识别力者疼痛共情水平更高的推论。

4 讨论

疼痛共情是一种对人类生存具有重要意义的心理过程或能力。为进一步揭示疼痛共情的影响因素及其影响机制,本研究探讨了悲伤表情识别能力这一主体因素会否影响个体疼痛共情以及影响的时程特点。脑电实验的正确率数据显示,被试类型和图片类型交互作用边缘显著,悲伤表情高识别力者的疼痛图片正确率高于非疼痛图片的。ERP 数据显示,在N1、P3、LPC 成分上,悲伤表情高、低识别力被试的波幅有显著或边缘显著差异,在N2、P3 成分上,被试类型与图片类型有显著交互作用,悲伤表情高识别力者观看疼痛与非疼痛图片时的波幅差异比低识别力者的更大。先前研究指出,早成分N1、P2、N2,以及晚成分P3、LPC 分别反映了疼痛共情过程中的早期自动情绪分享和疼痛感知,以及晚期有意识评价过程(宋娟 等, 2016; Fan & Han, 2008; Han et al.,2008)。因此,本研究结果提示,悲伤表情识别能力会影响个体疼痛共情,且同时影响个体疼痛共情自下而上的早期情绪分享和疼痛感知,以及自上而下的晚期认知评估过程。

先前研究指出,N2 反映了疼痛共情过程中对他人疼痛的早期、自动感知和情感分享(Cheng et al., 2017);也有研究认为N2 与对负性信息注意定向有关,波幅增大意味着对新异负性刺激投入更多注意(宋娟 等, 2019; Campanella et al.,2002)。不少研究还发现,相较于非疼痛图片,疼痛图片诱发的N2 波幅更小(Fan & Han, 2008; Han et al., 2016; Sheng & Han, 2012)。本研究悲伤表情高识别力组的结果与这些研究相同,而悲伤表情低识别力组观看疼痛和非疼痛图片的N2 波幅无显著差异,因此本研究N2 上的结果提示,悲伤表情高识别力者的疼痛共情水平更高,他们能更自动地感知他人疼痛,以及进行情感分享。先前研究同时指出,P3 反映了疼痛共情中的自上而下的认知评价过程,波幅越大表示个体的唤醒水平越高,投入的认知资源越多,而且疼痛图片诱发的P3 波幅一般都比非疼痛图片诱发的更大(宋娟 等,2016; Meng et al., 2012)。本研究结果显示,在P3 上,悲伤表情高、低识别力组被试在观看疼痛图片时的波幅均更大,而且对于非疼痛图片,两组被试的波幅无显著差异,对于疼痛图片则悲伤表情高识别力者的波幅更大。因此,这一结果进一步提示悲伤表情高识别力者的疼痛共情水平更高,他们对他人疼痛的有意识评价唤醒水平更高。综上,本研究的结果提示,悲伤表情高识别力者的疼痛共情更强,他们能更自发地对他人疼痛进行感知和情感分享,对他人疼痛的有意识评价过程也更强。

Penton-Voak 等(2013)发现,提升个体从他人含有愤怒和快乐情绪的模棱两可表情中识别出快乐情绪的能力,可以抑制个体的愤怒和攻击行为。本研究表明,悲伤表情高识别力者的疼痛共情水平比低识别力者的显著更高,提示可能可以通过提升个体对他人悲伤表情的识别能力,进而提升其疼痛共情水平。当然,本研究是一项相关研究,所得结果并不能清晰地揭示提升悲伤表情识别能力能否因果性地提升个体疼痛共情水平。未来有必要开展因果研究,进一步揭示可否通过提升个体悲伤表情或其他表情的识别能力来提升其疼痛共情能力,从而为改善个体疼痛共情能力提供更有价值的参考。

本研究在实验设计上存在一些不足,可能会影响实验效度。首先,为排除实验效应源于快乐表情识别力而非悲伤表情识别力对个体疼痛共情的影响的可能性,本研究采用快乐-惊讶表情分界测验区分了高、低快乐表情识别力者,并比较了两者的ERP。然而,这一处理可能并不能达到目的,因为对惊讶表情的识别力可能并不像本研究预期的那样不影响个体疼痛共情。其次,近年有研究表明,情绪状态等因素会影响个体疼痛共情(宋娟 等, 2020; Meng et al., 2012),但与近年不少同类型研究一样,本研究并未很好地匹配被试的情绪状态等可能影响实验效应的特质。最后,本研究的被试样本量较少,可能会影响统计检验力,尤其是对于行为数据的统计分析。因此,为清晰揭示悲伤表情识别力是否影响个体疼痛共情,未来需要在优化实验设计与处理后开展进一步的探讨。

5 结论

(1)悲伤表情识别能力会影响个体疼痛共情,悲伤表情高识别力者的疼痛共情更强;(2)悲伤表情识别能力会同时影响个体疼痛共情的早期自发加工及晚期有意识认知评价。