基于深度学习的乳腺断层合成成像计算机检测与诊断应用进展

2022-11-16张博雅李席如

张博雅,李席如

1.南开大学医学院,天津 300071;2.解放军总医院第一医学中心普通外科,北京 100853;*通信作者 李席如2468li@sina.com

乳腺癌居恶性肿瘤发病率首位[1]。基于乳腺X线摄影的乳腺癌普查策略有助于早发现、早诊断、早治疗。数字乳腺断层合成(digital breast tomosynthesis,DBT)是一种新兴的三维成像技术,可以减轻传统乳腺X线摄影常见的伪影,改善病灶征象显示水平,提高乳腺病变的检出率[2]。

深度学习(deep learning,DL)以其强大的自动图像特征提取能力,可以处理大量医学影像数据,基于深度学习的计算机辅助检测与诊断系统(computeraided detection and diagnosis systems,CAD)有望给人工智能(artificial intelligence,AI)乳腺影像领域带来变革。此外,DBT的临床应用仍处于普及阶段,为DLCAD能附加到严格的医疗管理的工作流程提供了一个独特的机会[2]。本文对深度学习的相关概念、在数字乳腺断层合成中的研究进展、临床效能及面临的挑战和对策进行综述。

1 深度学习的概念

深度学习是一种以多层神经网络为架构的计算模型,较传统CAD的最大优势是其可以自动提取并学习特征信息,发掘人类认知以外的图像的深层信息[3]。深度学习在医疗影像中的应用可以概括性地分为图像级别及像素级别,图像级别主要用于判断是否存在病灶及良恶性分类,像素级别可以用于病灶检测及分割[3]。深度学习算法各异,其中卷积神经网络(convolutional neural networks,CNN)是最具代表性的神经网络,作为一种前馈神经网络,其中主要包括5种类型的层:输入层、卷积层、池化层、全连接层及输出层,输入层输入原始图像,卷积层自动提取图像特征,池化层简化特征信息,全连接层拟合分类,输出层输出预测结果[3]。其中卷积层和池化层多层交替排列,可以实现从低层级向高层级不断地自动提取特征,简化特征信息[3]。

2 深度学习在数字乳腺断层合成中的研究进展

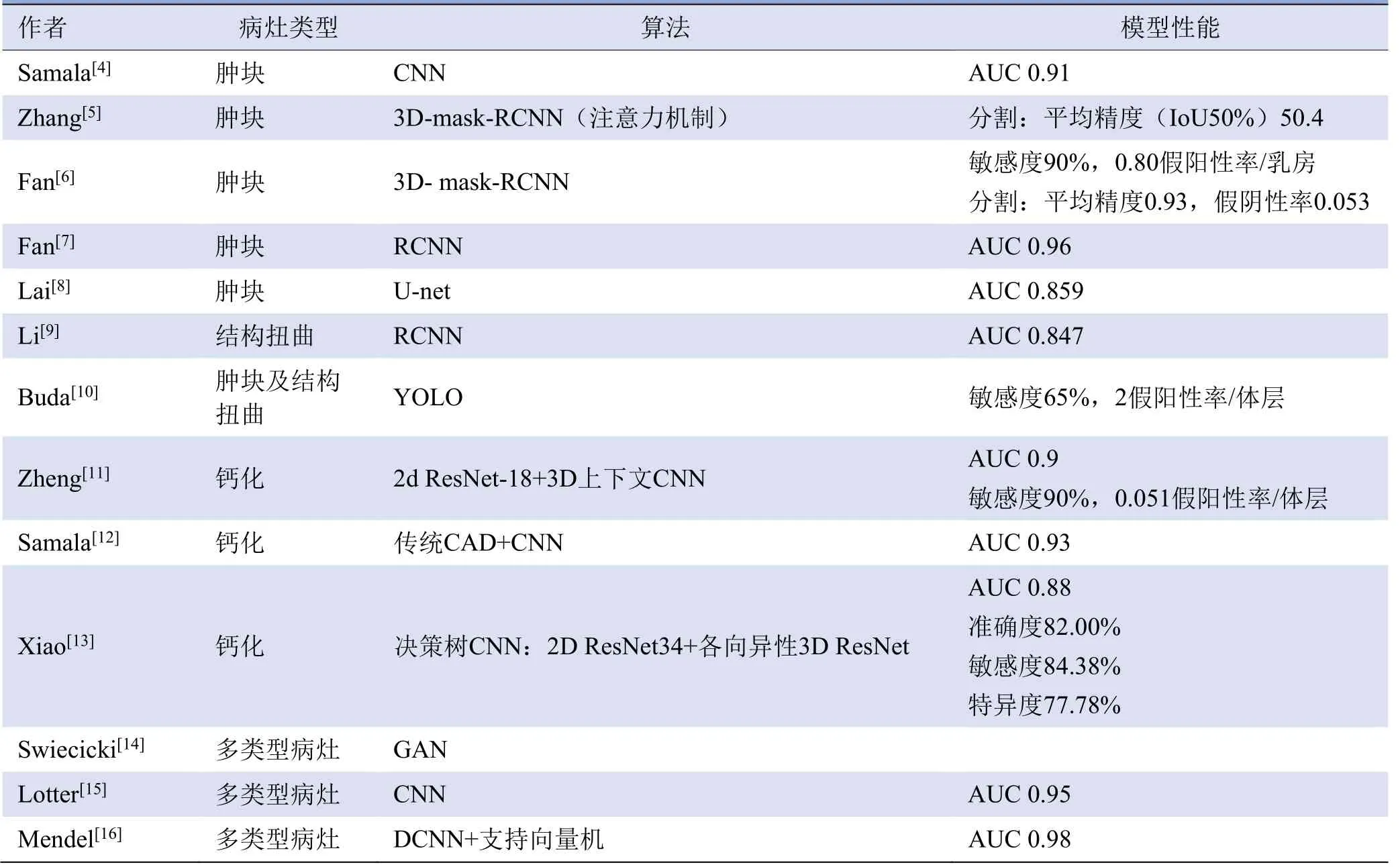

影像科医师阅片时主要关注两类病灶:软组织病灶及钙化灶,其中软组织病灶可以分为肿块、结构扭曲及不对称。深度学习在数字乳腺断层合成中的应用进展见表1。

表1 深度学习在数字乳腺断层合成中的应用研究

2.1 软组织病灶分类、检测及分割模型 肿块的DLDBT模型因肿块易于标记定位较常见,然而检测结构扭曲是DBT较传统乳腺X线摄影成像的主要优势,DBT可以减轻腺体对病灶的遮盖[17]。Samala等[4]建立了一个DL-DBT肿块检出模型,将在自然影像集ImageNet中训练的CNN模型,在DBT数据集中分阶段微调迁移学习,ROC曲线下面积(AUC)可达0.91。Fotin等[18]对比深度学习与机器学习的DBT肿块及结构扭曲检出分类模型性能,深度学习的敏感度、AUC等均优于机器学习。然而与分类模型相比,影像科医师对于病灶检测与分割的需求更为迫切。部分模型利用深度学习提取特征,机器学习分类实现肿块定位,Yousefi等[19]利用深度卷积神经网络从二维图像上提取图像特征,再应用多实例随机森林行肿块良恶性分类;Li等[9]设计的基于RCNN的结构扭曲检测模型,在80%的敏感度时,假阳性率为1.95假阳性率/体层。但鉴于RCNN计算时间过长,医学影像较自然影像复杂,目前普遍采用faster RCNN分析医学影像数据。Fan等[7]提出一个基于faster RCNN的肿块检测模型,为每层DBT影像生成具有检测到肿块的置信度的候选框,若同一组多层DBT 影像乳房肿块的候选框的交互比>0.5,则将其合并,最终肿块的置信度为候选框中的最大置信度,据此检测病灶,该模型的AUC为0.96(敏感度为90%,0.76假阳性率/乳房),优于基于深度卷积神经网络模型。该团队在此基础上开发了一种基于3D-掩膜(mask)-RCNN的模型,以ResNet-FPN为主干网络,不仅可以检测病灶,还可以处理病灶分割任务,结果显示3D-mask RCNN病灶检测性能优于2D-mask RCNN和Faster RCNN[6]。执行肿块分割任务时,平均精度达到0.93,假阴性率为0.053[6]。Zhang等[5]在ResNet-FPN的基础上开发了REPLICA模型,引入基于注意力机制的卷积神经网络于ResNet和FPN之间,使模型专注于影像中的必要特征,整合全局信息,平均精度(交互比取50%时)达到50.4,至少高于作为基线的faster RCNN模型13.1%,注意力机制提高病灶检测与分割任务的效能。

基于YOLO算法的一阶段模型是目前的研究热点,可以同时执行病灶分类和位置信息表征,是一个统一的、端对端的过程[20]。YOLO将检测问题转化为回归问题,首先将图像以网格均分,对每个单元格行候选框及置信度预测,直接得到候选框的定位及分类。与二阶段模型滑动候选框方法相比,YOLO可以显著提升病灶检测速度[20]。此外,YOLO算法泛化能力强,迁移学习时模型鲁棒性高[20]。Buda等[10]提出一个基于YOLO的肿块及结构扭曲的检测模型,该模型在应用焦点损失函数优化参数时性能最佳,敏感度为65%时,假阳性率为2假阳性率/体层,与faster RCNN的二阶段模型相当。Hassan等[21]对比了faster R-CNN与多个YOLO算法检测DBT病灶的性能,结果显示faster RCNN预测的准确性更高,可能与YOLO算法本身精确性较RCNN不佳、适用条件受限有关。但随着YOLO v1到YOLO v5、YOLOF的不断迭代,相信YOLO在DBT病灶检测领域具有广阔的应用前景。

与经典的CNN利用像素块逐个分类不同,U-net作为全卷积网络的经典架构将CNN全连接层全部替换成卷积层,可以实现对图片逐像素的预测,是经典的端到端的分割方法,模型更加高效,避免了像素块带来的重复存储和计算卷积的问题[22]。Lai等[8]基于此提出一个23层的基于U-net的肿块分割模型。逐层对DBT影像行概率预测,并将预测整合出最终结论。研究对比线性判别分析、支持向量机、CNN等多种算法,U-net算法的性能最优(AUC=0.86)。

2.2 钙化分类、检测模型 乳房微钙化点簇可以用于检测乳腺癌,并预测其侵袭性。鉴于微钙化点簇散布在DBT的多个成像层面中,且直径较小,影像科医师易漏诊。鉴于2D-CNN不能充分利用DBT的三维图像的空间信息,并且浅层卷积网络不能提取出更具代表性的信息。Wichakam等[23]提出标准3D-CNN模型(8层卷积层)。因此,卷积模型的复杂度越高,模型性能可能越好。标准卷积网络不能有效提取分辨率各向异性的DBT的信息。Xiao等[13]建立了2D ResNet34和3D各向异性ResNet融合的决策树模型,待2D和3D模型独立做出结论后,在输出时取2个模型的平均值,AUC可达0.88,且文中复现了前文所述的模型,对比可得该模型性能最佳。Zheng等[11]亦提出一个以ResNET-18作为主干网络,综合考虑2D、3D全局信息的模型,模型AUC可达0.98,敏感度为90%时,0.051假阳性率/体层,值得注意的是,该模型在877例中国女性DBT检查数据库中训练测试。

2.3 多类型病灶检测模型 上述DL-DBT模型多仅针对一种病变类型,临床应用较低效。对于DL-DBT多病灶类型检测模型,Mendel等[16]应用VGG19深度卷积神经网络提取特征,然后将这些特征输入支持向量机分类器,以预测乳腺钙化、肿块及结构扭曲恶性的可能性,AUC可达0.98。Lotter等[15]提出一种三阶段的全自动深度学习模型。第一阶段,训练一个预先训练好的ResNet模型进行病灶分类,这个经过训练的ResNet 用作RetinanNet 的主干网络;第二阶段,RetinanNet用于病灶检测;第三阶段,利用第二阶段提取的候选区域对DBT简化后的二维图像分类。为了验证模型的泛化性,该模型在5个中心进行测试,AUC平均为0.95,经河南省人民医院测试发现,在低筛查率和乳腺致密腺体比例较大的中国人群中,AUC可达0.97[15]。鉴于现有网络均需要强标注的数据集进行训练,耗费人力、物力,Swiecicki等[14]提出一个以图像补全算法为核心的DBT无监督病灶检测模型,该模型以生成对抗网络为基础,利用无病灶的DBT图像训练,先移除一部分图像,再利用生成对抗网络补全缺失部分图像,两图像的差异以MSE或鉴别器损失量化,差异值越大,则该补全区域为病灶的概率越大。然而,该研究未对病灶和正常组织分割的差异值做出界定。

3 深度学习在数字乳腺断层合成应用中的效能

AI系统整合至DBT病灶评估的工作流程中,影像科医师可以在AI-DBT系统的定位和导航报告的基础上进行评估,通过点击DBT简化后的二维图像上标注出的病灶,可以跳转至病灶分布所在层的DBT影像,减少工作负荷,提高评估的准确性。Pinto等[24]将AI辅助诊断系统附加到影像科医师的工作流程中,在190例患者DBT检查数据中进行分析,结果显示AI辅助诊断的影像科医师AUC(0.88)大于独立诊断医师(0.85),并且敏感度提高5%,假阳性率降低27%。Conant等[25]的AI系统在辅助影像科医师评估260例DBT检查的软组织和钙化灶时,AUC、敏感度和特异度均得到显著提高,并且阅读时间减少53%。Chae等[26]的研究均得到相似的结果。然而,AI辅助下影像科医师的表现均不如AI单独诊断,提示影像科医师可能过于依赖AI诊断结果,未能正确利用AI。因此,一方面需要对AI系统定期跟踪检测性能;另一方面,有必要加强对影像科医师的严格培养和AI辅助系统应用的正确宣教。最后,亟须大规模、多中心研究验证AI辅助诊断系统的临床应用效果。

4 深度学习模型在数字乳腺断层合成应用中的挑战及对策

深度学习对DBT的检测与诊断模型的性能主要受两方面因素影响:算法及数据,上文已叙述算法的进展。数据量的大小及组成直接影响深度学习模型的性能。此外,深度学习决策过程的不可解释性也是受到关注的问题,直接影响其临床推广应用的价值。

4.1 深度学习训练数据 DL-DBT的模型训练依赖于大量、高质量标注的训练集,公开数据集是广大研究者开发、评估模型的坚实基础。目前主要的公开数据集是乳腺X线摄影数字化数据集和Optimam乳腺X线摄影数据集[27]。Buda等[10]发布了5 060例DBT检查的数据集;Zhang等[5]的模型开发已经利用该数据集,为了使深度学习在医疗领域更好地发展,提倡研究者公开数据集。目前为了解决数据量不足的问题,主要有以下几个解决方案:①迁移学习可以有效解决高质量标注数据缺乏的问题。即利用源领域高质量数据预训练模型,再通过微调卷积层参数将模型迁移至数据匮乏的目标领域,以提升模型的泛化性能[28]。自然图像集和传统乳腺X线摄影数据集的预训练模型均在迁移至DBT后表现出良好的性能[16,28]。②数据增强,利用旋转、翻转、缩放等数据增强技术,在现有DBT图像的基础上生成新的训练样本,克服数据不足的缺点,提高分类精度[29]。③利用弱标签数据训练模型,Lotter等[15]为了解决强标记数据缺乏的问题,采用少量强标签和大量弱标签相结合的形式训练模型,而U-net模型仅需利用弱标签数据集训练模型,即可实现病灶的检测与分割。④数据非均衡问题需要引起重视,在检测任务中,由于含有病灶的DBT图像数量非常有限,训练难度很大。Swiecicki等[14]建立的生成对抗网络图像补全模型,有效利用了大量非病灶的影像数据,为解决该问题提供了一个有价值的思路。

4.2 深度学习的可解释性 深度学习的“黑盒”模型是深度学习临床应用的主要阻碍。深度学习无法提供决策过程。一个合格的医疗系统必须是透明的、可理解的、可解释的,被医师和患者信任。为了更好地让医师及患者理解模型,定位和分割模型较分类模型在可解释性上具有明显优势,病灶定位标注是一种直观的、增强可解释性的方案[6-7,10,15]。对于模型内部而言,算法间的可解释性亦不同,注意力机制的引入提高了模型的可解释性,基于注意力机制的网络可以控制不同空间位置处特征的重要性,以引导网络其他部分可见的信息[30]。

5 总结与展望

深度学习在数字乳腺断层合成领域展现出巨大的应用潜力,工程师及影像科医师共同努力不断完善深度学习模型。然而目前仍面临诸多挑战:①深度学习的不可解释是临床推广最主要的障碍,亟须可解释性更好的模型。②DL-DBT量化分析有望建立短期肿瘤复发率及远隔器官转移风险预测模型。此外,亦可监测全身信息,整合影像学、基因组学、病理学、电子医疗档案等数据,建立评估疗效、预后及制订全身诊疗模式的通用模型,推动个体化诊疗的发展,有潜力给肿瘤诊疗模式带来变革。③AI-DBT的临床推广需要克服一些基本的法律及伦理问题。

利益冲突 所有作者均声明不存在利益冲突