结合注意力门控与特征融合的图像去雾网络*

2022-11-11刘树东梁中越

刘树东, 梁中越, 张 艳

(天津城建大学 计算机与信息工程学院,天津 300384)

0 引 言

雾天空气中的悬浮微尘很容易在成像区域内使光线发生折射和散射现象[1]。这种现象对图像的捕捉与获取会造成较大影响,因此进行图像去雾是一项具有重要意义的工作。目前对图像进行去雾处理的方法可分为两种:基于图像增强的方法和基于图像复原的方法[2]。在基于图像增强这一方法中,可分为基于直方图均衡化[3]和基于Retinex[4]等方法。这些方法的本质在于对图像的整体视觉效果进行改善,因此会造成严重的颜色失真,无法从真正意义上匹配原图。基于图像复原法则大多围绕大气散射模型[5~7]展开I(x)=t(x)J(x)+(1-t(x))A,其中,I(x)为有雾图像,J(x)为无雾图像,t(x)为透射率,A为大气光值。但无雾图像、透射率、大气光值均为未知参数,因此主要通过估算大气光值及透射率进行去雾处理。但由于对大气光值及透射率进行估算是一项较为艰巨的工作,故传统方法通常会依靠先验条件进行估算。如He K等人[8]提出的暗通道先验方法等,但此类方法会在实际测试中因简化的物理模型导致大气光值和透射率估算出现较大误差,从而使去雾后的图像有很大偏差。

随着深度学习的兴起,使用卷积神经网络(CNN)进行去雾处理的方法逐渐成为了主流,该类方法可分为间接处理方法与直接处理方法。其中,间接处理方法是通过网络估算大气光值、透射率或其他中间参数,并遵循大气散射模型的公式恢复无雾图像。Cai B等人[9]提出的Dehaze-Net与Ren W等人[10]提出的MSCNN,根据大气散射模型,利用网络估算有雾图像的透射率。Li B等人[11]提出的AOD-Net,通过重新构造大气散射模型,将大气光值与透射率转换为一个参数,并利用网络进行估算。上述间接处理的方法较于传统方法有较大提升,具有较强的普适性,但仍会因参数估算的不准确,对去雾图像造成一定影响。直接处理方法则是通过网络直接学习有雾图像到无雾图像之间的映射关系来恢复无雾图像。如Qu Y等人[12]提出的EPDN,Chen D等人[13]提出的GCA-Net。此种方法摆脱了大气散射模型的约束,通常能够获得去雾效果更佳的图像,但由于网络通过不断地下采样操作提取图像相关信息,故极易丢失图像的细节特征,从而产生颜色失真现象。

本文采用全卷积神经网络(full convolutional neural network,FCN)以估算无雾图像与有雾图像之间的差值图像实现图像去雾,摆脱了大气散射模型的约束,从而获得了更好的去雾效果。并针对图像细节特征易丢失的问题,提出了一种结合注意力门控与特征融合的去雾网络,该网络在FCN的基础上,基于注意力门控与特征融合设计了特征提取模块、注意力门控模块和图像重建模块,对所提取的差值图像细节特征进行了完善,从而进一步提升了去雾图像的质量。

1 相关工作

1.1 空洞卷积

Yu F等人[14]提出的空洞卷积(dilated convolution)属于卷积操作的一种衍生版本,其可以在扩大感受野的同时避免因池化等操作而导致部分特征信息有所丢失。空洞卷积的对比示意图如图1所示。其表达式如下

Rf dilated=(x-1)×(Wsize-1)+Wsize,x≥2

(1)

式中Rf dilated为空洞卷积的感受野,x为空洞率(当其为1时,视为标准卷积),Wsize为卷积核尺寸。空洞卷积通过在卷积核中每个相邻像素点间以添加零像素的方式,增加卷积核的尺寸,从而扩大感受野。

图1 标准卷积与空洞卷积的感受野对比

但空洞卷积也会因添加空洞过多从而对特征信息的连续性造成损失,进而造成网格化效应。基于此等问题,Wang P等人[15]则提出了混和空洞卷积(hybrid dilated convolution)对空洞卷积进行稀疏化设置。本文采取相同策略,在网络的特征提取模块中引入了稀疏化设置的空洞卷积,以提升特征提取的性能。

1.2 注意力机制

深度学习中的注意力机制与人类的视觉注意力机制非常类似,其主要通过除去冗余信息,提取有效特征,从而达到对目标区域的关注。其表达式如下

Foutput=FA⊗Fa

(2)

式中Foutput为通过注意力机制后的特征信息,Fa为注意力特征,FA为输入特征,⊗为判别函数。

深度学习中的注意力机制可分为仅对输入特征中指定位置信息进行关注的硬注意力机制[16],和对输入特征中所有位置信息进行不同程度关注的软注意力机制[16]。其中在各类软注意力机制下的空间注意力机制[17],仅需使用输入特征的二维权值系数对输入特征自身进行调整,即可加大特征信息中有效区域的关注度,该方法易于实现且有效,却忽略了不同特征之间的信息关联性。因此,结合FCN的结构,本文采用了一种对空间注意力机制进行相应优化的注意力门控(attention gate,AG),通过充分利用网络的上下文信息,以进一步加大特征信息中有效区域的关注度。

2 本文方法

2.1 网络结构

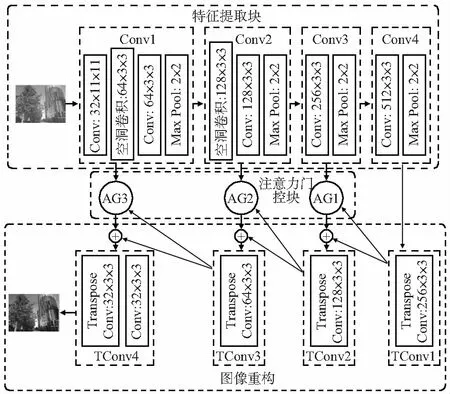

本文方法的网络结构如图2所示。

图2 网络结构示意

2.2 特征提取模块

如图2所示,本文设计的特征提取模块包含4个卷积块(Conv1~4),通过多个卷积块逐步提取的方式,获得由浅至深不同层次的多尺度特征信息,最大程度保留图像场景中原有的细节特征,从而提升特征信息的利用率。前2个卷积块中通过各添加一层空洞卷积以进行稀疏化设置,扩大浅层特征信息的感受野。前3个卷积块所提取的浅层特征信息将分别传输到跳跃连接通道及下一个卷积块中,最后一个卷积块所提取的深层特征信息在输出后将直接传输到图像重建模块中。

2.3 注意力门控模块

如图2所示,注意力门控模块共包含3个注意力门控(AG1~3)。将传输到跳跃连接通道的浅层特征信息(Conv1~3所提取的特征)作为其输入特征(input feature)的基础上,添加了与各输入特征相匹配的上采样块(TConv1~3)输出特征作为输入特征的判别特征(discriminant feature),使其能够充分利用网络的上下文信息,进一步加大有效区域的关注度,从而提升浅层特征信息的表达能力。

注意力门控的结构如图3所示,在输入特征与判别特征进入注意力门控模块后,首先使用保持原通道数的点卷积操作与加和操作,重新分配特征信息的权重,并使用ReLU函数除去冗余信息,达到门控的作用;然后使用1通道数的点卷积与Sigmoid函数实现对特征信息的系数化处理,生成注意力特征(attention feature);最后使用注意力特征对输入特征进行调整,即可得到注意力门控的输出特征

Fa=Sigmoid(He(ReLU(H1(FA,W1)+H1(FB,W1)),We))

(3)

FAGout=FA×Fa

(4)

式中FAGout为表注意力门控的输出特征,Fa为注意力特征,FA与FB分别为输入特征与判别特征,H1为保持原通道数的点卷积函数,W1则为其卷积核权值,He为1通道数的点卷积函数,We则为其卷积核权值,ReLU与Sigmoid分别为ReLU函数与Sigmoid函数。

图3 注意力门控结构示意

2.4 图像重建模块

如图2所示,图像重建模块共包含4个上采样块(TConv1~4)。该模块采用深层特征信息(Conv4所提取的特征)作为初始的输入特征,通过多个上采样块逐步估算出无雾图像与输入图像之间的差值图像,在此过程中,会与注意力门控模块输出的浅层特征进行融合,从而逐步完善差值图像的细节特征。最后将差值图像与原输入图像进行加和操作,即可重建出清晰自然的无雾图像。

前3个上采样块输出的各特征信息使用加和操作,与注意力门控模块输出的各浅层特征进行特征融合,并传输到下一个上采样块中,最后一个上采样块输出的差值图像则与输入图像使用加和操作,实现无雾图像的重建。

3 实验与结果分析

3.1 实验设置

本文实验环境为Intel®Xeon®Gold 6154 CPU@3.00 GHz,64 GB内存,NVIDIA Tesla V100—PCIE,操作系统为Ubuntu 18.04 64 bit,编程语言为python。

本文方法所使用的数据集为RESIDE室外图像数据集,从中选取包含500幅合成有雾图像的SOTS小样本子集作为训练集,用于训练网络参数模型,并从OTS、HSTS及RTTS子集中共抽取100幅合成有雾图像以及100幅自然有雾图像作为测试集,用于进行合成图像与自然图像的去雾效果测试。在进行网络训练时,选用均方误差(mean squared error,MSE)作为损失函数,选用自适应性矩估计(adaptive moment estimation,Adam)算法作为优化器,其中学习率设置为0.000 1,batch-size设置为4。

为验证本文方法的可行性与有效性,首先,对本文方法的网络结构进行消融实验对比分析;然后,分别通过合成图像和自然图像两方面与三种主流方法(MSCNN[10],AOD-Net[11],GCA-Net[13])进行对比分析。

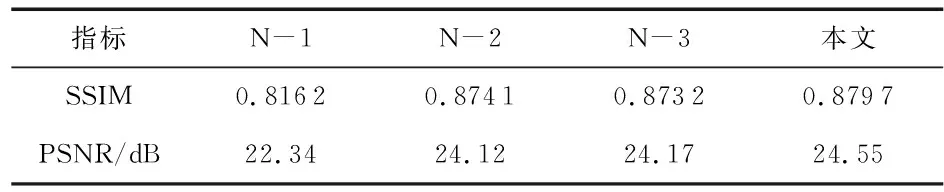

3.2 消融实验对比分析

为验证本文方法的可行性,本文在合成图像测试集上进行了消融实验对比。并采用结构相似比(structural similarity index,SSIM)和峰值信噪比(peak signal to noise ratio,PSNR)作为客观评价指标。如表1所示,N-1代表无注意力门控与特征融合的基础FCN结构,N-2代表添加了特征融合的N-1,N-3代表添加了空间注意力机制的N-2。可以看出,较于基础FCN结构N-1,N-2与N-3的PSNR与SSIM均有较大提升。本文方法较于N-3的SSIM与PSNR又高出0.006 5,0.38 dB,其原因在于本文方法的网络结构在N-2基础上,引入了充分利用上下文信息的注意力门控,相较于N-3的空间注意力机制,进一步提升了浅层特征信息的表达能力,从而使所恢复图像的细节特征更加完善。

表1 不同网络结构的SSIM与PSNR值

3.3 合成图像去雾效果对比分析

本文在合成图像测试集上进行了与不同对比算法间的测试。 测试结果的客观评价指标如表2所示,可以看出本文方法虽然使用小样本集进行训练,但其指标表现仍然很好,其中SSIM相较于对比方法中表现最好的文献[13]方法高出0.002 2,PSNR高出3.11 dB。

表2 不同方法的SSIM与PSNR值

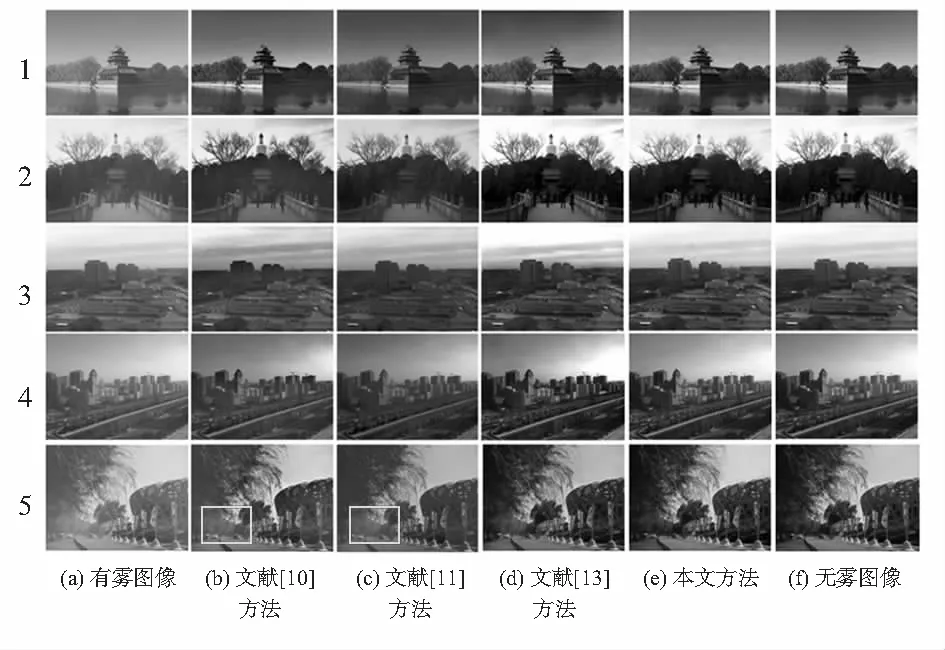

图4与表3所示为部分测试图像的对比。可以看出,文献[10]方法中图4(b)第1幅图像存在严重的颜色失真现象,且部分区域仍有残雾存留,如图4(b)第5幅图像为方框标记区域;文献[11]方法中图4(c)第1幅图像同样有一定程度的颜色失真,且图4(c)第5幅图像为方框标记区域同样有残雾存留;文献[13]所恢复的图像整体去雾效果较好,但图4(d)第1幅图像也有一定程度的颜色失真;而本文方法所恢复出的图像颜色失真程度更小,去雾效果更彻底,且更好地保留了图像原有结构。

图4 部分合成图像的去雾效果

表3 图4所示合成图像的SSIM与PSNR值

3.4 自然图像去雾效果对比分析

本文在自然图像测试集上也进行了相应测试。部分测试图像如图5所示,同属基于大气散射模型进行图像去雾的文献[10,11]方法由于估算的参数不准,因此,恢复图像仍然存在着颜色失真现象;文献[13]方法则由于细节特征有所丢失,因此,恢复图像也皆有较为严重的颜色失真现象;而本文方法通过注意力门控与特征融合,使得所恢复的图像更加清晰自然。

图5 部分自然图像的去雾效果

4 结束语

本文提出了一种以估算无雾图像与有雾图像之间的差值图像实现图像去雾的FCN。通过注意力门控与特征融合,将所提取的浅层多尺度特征信息与深层特征信息进行有效融合,完善了差值图像的细节特征,进而能够恢复出高质量的清晰图像。经与其他方法去雾效果的对比分析表明:本文方法在客观评价指标及主观视觉效果上均有良好的表现。但在实验过程中发现,本文方法在处理具有浓雾场景的图像时效果不佳,因此下一步工作重点将在于如何进一步优化网络结构,以获得质量更高的去雾图像。