改进型轻量级GAN的红外图像超分辨率方法

2022-08-24胡德敏闵天悦

胡德敏,闵天悦

(上海理工大学 光电信息与计算机工程学院,上海 200093)

E-mail:happysky1997@163.com

1 引 言

单帧图像超分辨率技术(Single image super-resolution,SISR)旨在根据低分辨率(Low resolution,LR)图像通过计算机技术重新构建成为高分辨率(High resolution,HR)图像.近年来,其在医学影像学、卫星遥感、安防监控等领域的广泛应用而受到了关注.

图像超分辨率重建方法分为基于插值、重构和学习的方法.基于深度学习的方法用神经网络构建LR至HR的端到端模型,重建效果优于传统方法;目前很多图像超分辨率重建工作是围绕着充满丰富纹理与色彩的RGB图像进行的,下采样后分辨率较高,模型加深加宽可以提取更多有用的不同频次的细节特征信息以有效改善重建质量.而红外图像通道单一、对比度差,在红外街景路况图像数据集CVC-09/14[1]中,通过下采样分辨率只有160×120;图像中有连续黑色、白色与灰色的像素均匀分布区域,例如图像中的天空为纯黑色区域;这些区域纹理变化不明显,灰度值较为平均,在训练数据预处理中随机裁剪原始图像易捕捉到过多的像素均匀分布区域,模型难以学习到足够纹理特征;红外街景路况图像数据分布相比于RGB图像更加集中,使用轻量级网络能以低成本、高效率提取图像中的像素特征,以满足部分小型移动设备对于轻量化模型的要求;基于生成对抗网络[2](GAN)的重建方法SRGAN[3]可以有效改善红外图像重建后的细节纹理效果,但是重建后在细节边缘处易出现伪影,原始的GAN优化KL散度,易使模型难以收敛、产生模式奔溃.

针对上述问题,本文改进SRGAN的结构提出一个适合重建街景路况红外图像的轻量级生成对抗网络模型.在生成器和判别器中去除不适合重建工作的批量归一化(Batch Normalization,BN)层,生成器中引入以低成本获取相同数量特征图的深度可分离卷积使模型轻量化,在局部残差连接中添加注意力机制自适应对局部特征图设置不同感受野,增强信息提取与特征图利用的效率;综合全局残差连接和跨层特征融合保证不同频次信息能够有效传递到深层;改进生成器中的内容损失减少重建后的伪影产生,改进对抗损失使模型稳定收敛.针对红外街景路况图像存在许多像素均匀区域,单一使用CVC-09/14数据集难以使模型学习到足够特征,因此在训练中引入纹理丰富的近红外图像辅助学习纹理特征信息,在跨层特征融合中加入红外特征图线性灰度变换改善重建效果.

2 相关工作

图像超分辨率重建是从稀疏数据提取信息的问题,其需通过有限的信息生成包含更多信息的图像.董超[4]等人提出的SRCNN模型首先将卷积神经网络(CNN)应用于图像超分辨率重建;ESPCN[5]中提出亚像素卷积层进行上采样,改善了双三次插值法和反卷积的上采样效果.浅层的卷积神经网络性能有限,在学习中可以提取到的像素特征信息较少.随着ResNet[6]和DenseNet[7]的提出,大多模型采用残差连接与密集连接的深层网络构建重建模型;VDSR[8]使用残差连接加深网络,提升了模型重建性能,SRDenseNet[9]模型采用密集连接构建了一个极深网络,取得了较好的重建效果,雷鹏程[10]等人结合分层特征融合与注意力机制重建图像,有效利用不同频次信息.SRGAN模型采用生成对抗网络,在生成器中引入残差连接和BN层,通过构建对抗损失和感知损失取得了更加真实的视觉感知效果;ESRGAN[11]改进了该结构,在残差单元中集成密集连接块(RRDB)取得了更好的效果.

Choi[12]等人将SRCNN用于红外图像的超分辨率重建,与传统插值方法相比提升有限;Zhang[13]等人将压缩感知与神经网络结合来重建红外图像;Du[14]等人将RGB与红外特征图融合输入模型,其需要大量红外与RGB图像对.邵保泰[15]等人考虑SRGAN能够改善视觉效果的特性,将其应用于红外图像超分辨率,视觉感知仍有较大提升空间;邢志勇[16]等人在此基础上,通过引入残差中的残差块和特征判别器有效改善了红外图像的重建质量.基于GAN的红外图像超分模型对所有特征图采用相同感受野,平等对待特征图,参数都相对庞大,且使用原始的GAN条件,即优化KL散度进行对抗训练,模型难以收敛,易产生模式崩溃.

本文在SRGAN架构的基础上分别改进其生成器与判别器,提出改进型轻量级生成对抗网络的红外图像超分辨率模型(LI-SRGAN).去除判别器中的BN层,通过融合注意力机制的无BN层的轻量级注意力残差块(LARB)构建生成器网络,其中大量采用Xception模型[17]中提出的深度可分离卷积(Depthwise separable convolution),将卷积操作与通道变换操作分开,大卷积核替代为小卷积核,大幅度降低了参数,结合局部残差连接中添加轻量级注意力机制高效率提取像素特征信息,在LARB外设置跨层特征融合与全局残差连接,使低频与中频信息能够有效传递到深层,为重建出边缘细节清晰的红外图像提供帮助;模型生成器结合Huber损失[18]和特征激活前的感知损失进行优化来减少重建后伪影的产生,采用WGAN[19]的思想构建对抗损失使模型稳定收敛.廖小华[20]等人用灰度变换增强红外特征图以改善重建效果,本文应用此思想在跨层特征融合中加入红外特征图线性灰度变换,在训练中引入近红外图像辅助学习纹理特征信息.

3 改进型轻量级GAN的红外图像超分辨率模型

3.1 总体架构

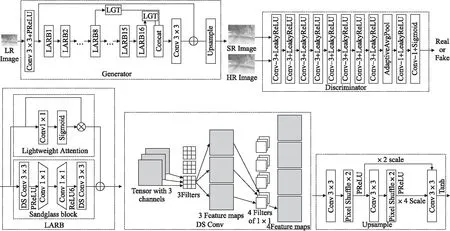

本文的LI-SRGAN模型基于生成对抗网络的零和博弈思想,如图1所示,其根据低分辨率输入图像LR估算高分辨率重建图像SR,以使SR尽可能接近真实的高分辨率图像HR,通过训练生成器(Generator)网络G不断优化达到目的.生成器即一个非线性函数,如式(1)所示:

ISR=Gθ(ILR)

(1)

其中ISR、ILR分别表示超分辨率图像、低分辨率图像,θ表示网络参数.生成器生成的SR图像与真实HR图像一同输入判别器(Discriminator)用sigmoid函数二分类判别真假,通过二值交叉熵损失和对抗损失优化判别器,用内容损失和对抗损失优化生成器,两者不断对抗训练优化权重,如式(2)所示:

θ=arg min∑LSR(ISR,IHR)

(2)

其中,IHR表示原始高分辨率图像,LSR表示重建误差;不断优化θ使得判别器难以判别真假,输出超分辨率图像.

3.2 生成器架构

本文的生成器架构如图1的Generator模块所示,其中包含低频信息提取、残差特征提取和上采样重建模块.使用一个3×3卷积进行低频特征提取,中间为16个轻量级注意力残差块(LARB)进行残差特征提取,张量经过第8个和第16个残差块时分别进行红外特征图线性灰度变换(Linear grayscale transform,LGT)后在通道维度拼接(Concat),与低频特征的全局残差权重相加后输入上采样重建模块,进行多尺度亚像素卷积操作;由于本文针对的红外图像尺寸较小,像素分布均匀,采用3×3卷积操作提取高频特征输出高分辨率图像可以使模型更加轻量化.

3.2.1 轻量级注意力残差块

如图1的LARB模块所示,轻量级注意力残差块(Lightweight attention residual block,LARB)中包含了轻量级注意力(Lightweight Attention)和沙漏形状块(Sandglass block).MobileNeXt[21]使用了沙漏形状的残差块,在图像识别与分类中相比于MobileNet V2[22]的倒置残差块减少了参数的同时取得了更好的效果.本文受此启发将其引入图像超分辨率重建领域,在瓶颈结构中增设1×1卷积层进一步实现通道数变换.常规残差块进行通道收缩、卷积、通道扩大;倒置残差块与上述操作相反;而沙漏形状的残差块将深度可分离卷积放在两侧,中间先进行通道收缩再进行放大,这种结构在减少参数的同时有利于反向传播时的梯度传递.SRGAN生成器的残差块如图2所示,本文的轻量级注意力残差块去除了不适用于图像重建的批量归一化(Batch Norm)层,在两端设置3×3的深度可分离卷积层(DS Conv),在中间设置1×1卷积分别进行通道收缩至1/2与扩张至原来大小.为了有效利用不同的特征图信息,在残差连接中设置了轻量级注意力机制.

图1 LI-SRGAN模型框架Fig.1 LI-SRGAN model structure

图2 SRGAN生成器的残差块结构Fig.2 Residual block structure of SRGAN′s generator

1)轻量级注意力

注意力机制旨在设置不同权重来关注更多有用信息,在自然语言处理中被广泛使用.SENet[23]首次在计算机视觉领域引入此机制,通过挤压和激励对通道之间的关系建模,增强了网络的图像分类能力.CBAM[24]修改SE模块,结合通道与空间两部分的注意力.

RCAN[25]模型首次在图像超分辨率中引入注意力机制,通道注意力机制对于RGB图像丰富的色彩重建效果较好,然而红外图像色彩与通道单一,因此考虑引入一个轻量级的注意力机制.Zhao[26]等人提出了一种适合轻量级架构的像素注意力机制,在上采样阶段提取全局注意特征,本文将其改进用至轻量残差块中的跳跃连接中,提取局部注意特征.轻量级注意力如图1的Lightweight Attention模块所示,其仅有一个1×1卷积层和Sigmoid函数,与输入前的张量进行对应位相乘,放在残差连接中自适应对红外图像特征图设置不同的感受野,从而在模型轻量的同时高效率提取特征信息、保证重建图像的质量.

2)深度可分离卷积

深度可分离卷积首次在Xception模型中被提出,其被用于代替常规卷积以减少参数实现轻量化.对于输入张量,常规卷积的操作中每个卷积核通道与输入张量相同,输出与卷积核相同个数的特征图.而深度可分离卷积分为深度卷积和逐点卷积,首先经过与输入张量通道数相同的单通道卷积核,得到的特征图再分别经过1×1的逐点卷积得到输出特征图.以一个三通道的输入张量输出4个特征图为例,图1中DS Conv模块显示了深度可分离卷积的两步操作.

根据两种不同卷积操作的原理可以得出常规卷积的计算量为H×W×K×K×M×N.深度可分离卷积的计算量为H×W×K×K×M+K×K×M×N.其中H和W分别为高和宽,K为卷积核大小,M和N分别为输入通道数与输出通道数,以3×3卷积核大小为例,深度可分离卷积的运算量约为常规卷积的1/8.

3.2.2 红外特征图线性灰度变换

红外特征图相比于RGB特征图灰度分布范围较为集中,即像素分布更均匀,对比度较差,因此在模型生成器中的跨层特征融合前考虑加入灰度变换来增强红外特征图以改善重建效果.

灰度变换有线性与非线性之分,考虑本文对于模型轻量化的需求,使用线性灰度变换(Linear grayscale transform,LGT),如图1的Generator模块LGT操作所示,在跨层特征融合中加入此算法对神经网络参数量影响较小.对不同通道使用线性灰度变换如公式(3)所示:

fmapout,i=ai·fmapin,i+bi

(3)

其中i表示通道编号,fmapout和fmapin分别表示输出特征图和输入特征图,a和b分别表示对比度调节因子和亮度调节因子.

3.2.3 上采样重建模块

上采样重建模块采用亚像素卷积层进行2倍和4倍的放大,并且进一步经过一个卷积层提取特征,输出高分辨率图像.如图1的Upsample模块所示,生成4倍放大图像时采用多尺度上采样提取,即先生成2倍放大图像,再进一步放大2倍.具体过程为生成放大2倍的图像时先将通道转换为4倍,然后进行2倍放大的Pixel Shuffle层并通过PReLU激活,生成4倍率图像时在激活后继续将通道数变为4倍,即原来的16倍,然后进行2倍放大的Pixel Shuffle层并激活.激活后进一步通过一个卷积层提取特征经Tanh函数激活后输出SR图像.

3.3 判别器架构

判别器结构如图1的Discriminator模块所示,其输入为原始高分辨率图像和生成器超分辨率图像,本文在判别器中去除了BN层,大幅度减少了冗余的参数.设置了8个3×3卷积层和LeakyReLU激活函数提取特征,经过1个平均池化层,2个1×1卷积层,最后通过Sigmoid函数进行二分类的判断.

3.4 损失函数

3.4.1 对抗损失

为了稳定模型训练,采用WGAN中提出的Wasserstein距离来描述生成图像与真实图像之间的距离.因此在原有GAN的对抗损失增加梯度约束.对抗损失如公式(4)所示:

ladv=E[D(IHR)-D(ISR)]+λE[‖∇ID(I)2-1‖2]

(4)

其中,等式右侧第1项描述判别器判断超分辨率图像和原始高分辨率图像的距离,第2项为惩罚梯度,λ为惩罚系数.

3.4.2 内容损失

目前许多图像超分辨率模型使用L2损失函数和L1损失函数,前者与客观评价指标峰值信噪比(PSNR)直接挂钩,后者能使模型较快收敛.然而L1用于神经网络训练会让梯度始终较大,虽然能稳定收敛模型,但在结束时易遗漏最小值.而L2损失函数,对异常值惩罚较大,其为开口向上的抛物线结构,在接近最小值时收敛速度较慢.

本文综合两者优势,在内容损失中采用在语义分割与目标检测中常用的Huber损失函数,如式(5)所示.因为其围绕的最小值会逐步减小梯度,相比L2损失函数,它对异常值更加鲁棒.其中设置了一个可学习参数δ,可以在训练中自适应调节函数更趋近于L1或者L2损失.

lδ(IHR,ISR)=1W×H(IHR-ISR)2,for |IHR-ISR|≤δ

δ|IHR-ISR|-1W×Hδ2,otherwise

(5)

其中,W、H表示图像的尺寸;感知损失以预训练VGG-19模型提取HR与SR的高维特征.在一般RGB图像中能产生令人愉快的纹理效果,但一些细节处容易出现伪影,而在红外图像中会放大这个缺陷.在深层网络中,使用激活后的特征值易导致高频特征稀疏,产生冗余的特征图降低网络性能.本文使用激活前的特征值构建感知损失,如式(6)所示:

lper=1W×H∑Wx=1∑Hy=1(φi(IHR)x,y-φi(G(ILR)x,y))2

(6)

其中φ表示通过VGG-19模型进行特征提取.感知损失结合Huber 损失成整个内容损失,这样可以保证减少伪影的产生并提高评价指标.因此,模型总损失L如式(7)所示:

L=ladv+λlδ+μlper

(7)

其中λ和μ分别为权重系数.

4 实 验

本文需要重建的图像最低分辨率为160×120,主要针对目标物体较少的CVC-09/14数据集的红外街景路况图像,此时能保留一部分信息用于重建,若小于此尺寸,图像信息丢失严重,难以重建.2倍率模型从320×240重建至640×480,4倍率模型从160×120重建至640×480.

4.1 数据集与实验细节

由于红外图像超分辨率没有标准的训练数据集和测试数据集,因此从CVC-14数据集中抽取了3500张热红外街景路况图像设置为训练集,在NIR数据集[27]中选取了400张纹理更丰富的近红外图像进行辅助训练以增强模型重建能力;在训练集中随机抽取图像进行旋转和镜像使得模型更加鲁棒.使用自建测试数据集EVAL-1和EVAL-2评估模型,分别来自NIR数据集9张图像,FLIR数据集(1)https://www.flir.cn/oem/adas/adas-dataset-form/与CVC-09数据集的100张图像.这样可有效避免过拟合现象,保证实验评估的有效性.

实验使用的操作系统为Windows 10,使用CUDA加速的PyTorch深度学习框架,IDE为PyCharm;硬件采用英特尔Core i5 9300H CPU,内存16GB,GPU为英伟达GeForce GTX 1660Ti,显存6GB.训练模型时使用Adam优化器,设置初始学习率α为0.0001,衰减率β为0.9;受显存大小限制,2倍率模型批量大小batch size设置为64,裁切分辨率为96×96的HR图像通过双三次插值下采样至48×48的LR图像作为图像对;4倍率模型batch size为32,裁切192×192下采样至48×48作为图像对.使用近红外图像NIR数据集训练生成器得到预训练生成器模型,周期epoch为50,最后将近红外图像与红外街景路况图像CVC-14数据集一同在GAN模型中训练,周期epoch为300.

4.2 评价指标

使用峰值信噪比(PSNR)和结构相似度(SSIM)作为客观 评价指标,如公式(8)和公式(9)所示,其得分越高越好;峰值信噪比直接体现SR图像与HR图像之间的灰度值均方误差.结构相似度体现HR图像与SR图像的亮度、对比度等相似关系.

PSNR=10logW×H(2n-1)2∑Wx=1∑Hy=1[IHR(x,y)-ISR(x,y)]2

(8)

SSIM=(2μHRμSR+C1)(2σHR,SR+C2)(μ2HR+μ2SR+C1)(σ2HR+σ2SR+C2)

(9)

其中,H、W分别为图像的高和宽,(x,y)为各个像素点的坐标;μ表示灰度平均值,σ表示方差;C1和C2是保持等式有效的常数.

4.3 实验结果与分析

生成器和判别器损失变化如图3所示;生成器模型在第50个epoch出现明显收敛趋势,但有所震荡,接近300次迭代后损失值变化较为平缓,可以认为模型训练完成.由于GAN的特性,判别器相对生成器更难收敛,加入了WGAN思想的判别器有效改善了此种情况.

图3 损失变化曲线Fig.3 Loss function curves

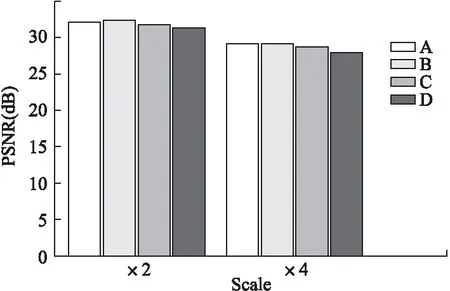

4.3.1 消融对比实验分析

为了进一步验证一些拟议模块的有效性,本文进行了消融对比实验.设计进行4种结构的对比,训练50个epoch,在本文测试数据集EVAL-2比较PSNR.

对比结构A:本文的模型LI-SRGAN.

对比结构B:本文模型生成器的头尾两个卷积替换为9×9的大卷积核,增大感受野,其他部分不变.

对比结构C:本文模型中深度可分离卷积替换为常规卷积,保留残差连接中的轻量级注意力,其他部分不变.

对比结构D:本文模型中LARB的残差连接去除轻量级注意力,其他部分不变.

消融实验结果如图4所示,结构A和B的对比得出,在热红外图像的重建上,设置9×9的大卷积核效果提升不明显,但参数数量增长了约300K.A和C对比得出,轻量级注意力用在轻量级模型上效果更好.A和D的对比得出在残差连接上加入注意力机制能够大幅度提升模型表现效果.

图4 消融实验结果Fig.4 Result of the ablation experiment

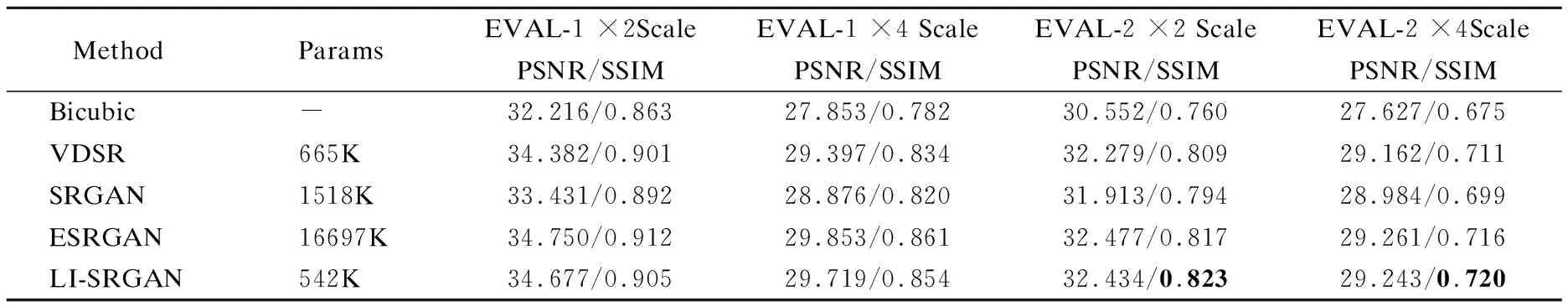

4.3.2 算法对比实验分析

实验与主流模型在红外图像上的重建效果进行了对比,分别有双三次插值法、VDSR、SRGAN和ESRGAN,参数数量(2倍率模型)与客观评价指标如表1所示.其中,基于生成对抗网络的重建模型SRGAN、ESRGAN和本文模型统计其生成器参数数量,VDSR是普通的SR网络模型,客观评价指标会更加具有优势,基于GAN的模型以生成清晰图像为主要目的,在客观评价指标方面稍弱.

表1 本文的方法和其他4种方法在自建红外图像测试集的比较结果Table1 Comparison of LI-SRGAN and the other four methods on our infrared image test datasets

实验结果如表1所示,客观评价指标PSNR与SSIM中,本文的模型以更少的参数超越了SRGAN模型,接近ESRGAN.

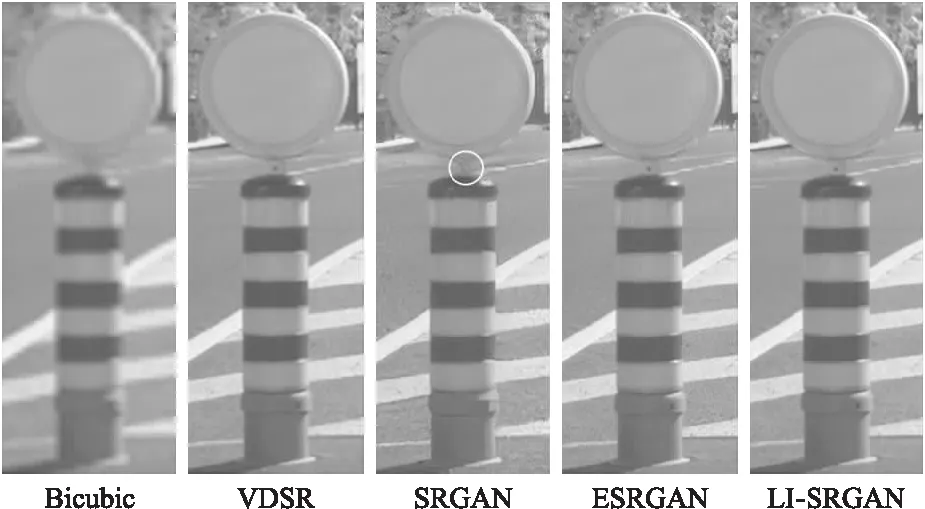

在近红外图像的测试中,以4倍放大倍率为例,如图5和6所示;SRGAN在地面处,圆盘与柱子连接处出现了伪影.本文模型在边缘处更接近真实,减少了平滑和伪影的产生,ESRGAN模型参数为16697K,远超于本文模型542K的参数数量,网络更加复杂,因此PSNR稍高,本文模型在热红外图像上的SSIM更高.在热红外图像的测试中,以2倍放大倍率为例,如图6所示,SRGAN的重建图像锐度更高,但是在数字边缘处出现了伪影,在示例中车牌数字9与8有些相似,本文模型观感上更好.

图5 NIR数据集测试样例局部放大Fig.5 Partial zoom of examples of test results on NIR

为进一步验证本文模型相比于SRGAN的优势,分别对SRGAN和本文模型的重建结果进行锐化操作查看噪声情况,如图7所示,可见SRGAN在地面处噪声较多,本文模型对噪声进行了抑制.

5 总结与展望

本文改进SRGAN的结构构建了一个适用于红外图像超分辨率重建的轻量级生成对抗网络模型;去除BN层,引入含有轻量级注意力机制和深度可分离卷积的残差块,结合特征激活前的感知损失、Huber损失和Wasserstein距离优化整个网络.

本文模型在像素均匀、目标物较少的街景路况红外图像上表现较好,但对于纹理变化更为剧烈的近红外图像在客观评价指标方面有待提高.下一步将研究怎样以较高的效率重建近红外图像.

图6 NIR数据集与CVC-09数据集测试样例Fig.6 Examples of test results on NIR and CVC-09 dataset

图7 锐化结果Fig.7 Result of image sharpening