一种优化孪生网络的小样本辐射源个体识别方法*

2022-06-28梁先明

梁先明

(中国西南电子技术研究所,成都 610036)

0 引 言

近些年,国内外对于辐射源的“指纹”识别技术研究一直都在持续进行,提出了多种可用的分类特征。文献[1]利用提取信号功率谱峰值特征和包络模板,构造通信辐射源个体特征向量,通过朴素贝叶斯分类算法与个体特征矢量相结合,可进行有效通信辐射源个体识别。前期研究结果显示,通常暂态特征对于个体识别更明显和有效,但是暂态特征持续时间短且捕获困难。在稳态特征方面,有研究者基于分形理论,通过研究稳态信号的包络盒维数、步维数及信息维数完成信号细微特征分析,并利用不同信噪比条件下的信号分形维数作为通信电台个体识别的特征,可有效进行通信电台个体识别[2]。

然而,随着元器件制作工艺的改进、通信和雷达装备制作水平的提升,辐射源个体之间的差异性正在逐渐缩小。传统个体识别方法中的信号特征将难以体现个体之间的差异,依赖人为提取特征的传统辐射源个体识别方法正逐渐失去作用,必须从信号本身出发提取更高层次的辐射源细微特征。

随着机器学习以及深度学习技术发展,有研究者基于高阶谱和时域分析的电台稳态特征提取进行深度学习提取指纹识别,提升识别准确度[3]。随着流形学习理论的深入研究,有研究者先对信号样本进行双谱变换,然后利用正交局部样条判别嵌入方法深入提取辐射源的指纹特征,改善辐射源个体特征识别方法的鲁棒性。由于深度学习具备自动抽象的提取特征能力,也有研究者直接采用IQ数据作为输入,利用支持向量机(Support Vector Machine,SVM)、卷积神经网络(Convolutional Neural Network,CNN)、深度卷积网络(Deep Convolutional Neural Network,DNN)等神经网络进行识别,重点强调多阶段训练的机制[4]。有研究者利用卷积神经网络进行射频指纹识别,对7台ZigBee设备进行了验证,准确率达到了92.29%[5];或对辐射源信号的IQ数据采用复值神经网络进行分类识别[6]。

对于小样本辐射源个体识别研究,文献[7]先通过高阶谱变换预处理提取高维特征,利用大量无标签样本首先对特征提取模型进行预训练,再通过少量有标签样本进行监督精校,从而可以提高在小样本条件下对通信辐射源指纹特征的表征能力;文献[8]提出了基于半监督矩形网络,通过将提取的电台信号的积分双谱特征扰动并结合解码器重构低维特征进行无监督学习,从而实现弱标签电台信号的个体识别,能够得到比较准确的识别结果,不过主要针对样本多但是标注少的问题;文献[9]对于小样本特征提取提出了变分模态分解提取稳态信号高维信息熵,再利用指数半监督判别法映射信息熵形成个体特征,再通过极端梯度提升树算法(eXtreme Gradient Boosting,XGBoost)进行辐射源个体识别;文献[10]提出了基于预测置信度进行迭代的改进算法,结合双谱变化、主成分分析降维以及直推式支持向量机,能够大幅降低运算量,也适用于标签样本少、无标签样本多的样本场景;文献[11]基于数据相似度量学习,利用孪生网络结构实现了类别多而样本少的人脸识别方面,取得了比较好的识别效果;文献[12]基于改进深度孪生网络提取交通标识图像多尺度特征,结合空间变化器网络实现高效分类器,提升交通识别准确率。

本文主要考虑没有大样本数据辅助训练仅有小样本标签训练模型的情况下,基于度量学习原理提出一种孪生网络优化的方法实现小样本通信辐射源的个体智能识别,提升不同类样本之间特征距离增大速度和相似类样本特征之间的距离减小速度,实现损失函数的快速收敛,从而提升小样本个体识别的性能。

1 基于孪生网络的个体识别

在小样本条件下采用基于度量学习的方法,能够学习到一种特征空间,基本思想是学习数据点之间的距离函数。度量学习算法通过将测试样本与训练集进行比较来对其分类,测试样本标签取决于与其最接近的训练样本。

常采用的分类方式是使用k近邻方法,即使用神经网络训练后,在测试阶段仅需计算测试样本与训练集中每个样本的欧氏距离,选择最小值的标签:

(1)

但该方法并未在训练阶段考虑到样本间的距离问题,且欧氏距离会陷入严重的维度灾难问题。因此本文在小样本条件下,采用孪生网络方法[4]对辐射源个体分类。

孪生网络属于基于度量学习的方法,其原理是将两个样本数据输入卷积神经网络,输出标签0和1,其中0代表两个样本类别相同,1代表两个样本类别不同,通过神经网络架构同时输入两个样本,输出它们属于同一类别的概率。

假设x1和x2是数据集中的两个样本,颠倒输入样本顺序,输出概率完全相同,孪生网络依赖该对称性设计。因此让两个输入样本通过结构相同、共享参数的网络,然后使用绝对差分作为线性分类器的输入。该共享参数的网络选用深度残差网络(ResNet),孪生网络结构如图1[13]所示。

图1 孪生网络模型结构图

图1中X1、X2是网络的输入,W是ResNet网络共享的参数,GW(X1)、GW(X2)为ResNet网络的输出,负责将原始样本向特征空间转化,称为映射函数。计算X1和X2之间的相关性,能量函数EW(X1,X2)表示X1与X2样本低维特征相似性度量,相似性度量为映射函数的欧氏距离:

EW(X1,X2)=‖GW(X1)-GW(X2)‖。

(2)

为使X1、X2来自同一类时EW(X1,X2)小,反之则EW(X1,X2)大,因此孪生网络的损失函数设为

L(W,(Y,X1,X2)i)=(1-Y)LG(EW(X1,X2)i)+

YLI(EW(X1,X2)i)。

(3)

式中:Y为二进制标记,0表示相同对,1表示不同对,(Y,X1,X2)i为第i个样本对;LG为相同对的损失函数;LI为不同对的损失函数。将欧氏距离作为相似性度量函数,式(3)可改写为

(4)

式中:m为超参数,当X1、X2属于不同类别,Y=1,随着EW(X1,X2)增大,则损失函数减小;当X1、X2属于相同类别,Y=0,随着EW(X1,X2)减小,损失函数减小,如图2所示。因此对于孪生网络,训练过程也就是不断增大不同对的EW(X1,X2),减小相同对的EW(X1,X2),从而不断迭代减小损失函数。

图2 损失函数与EW的关系图

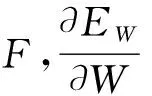

孪生网络的损失函数使相同类别样本间距减小,不同类别样本间距增大。该模型也可以用弹簧模型来说明。

通常弹簧模型可以用以下公式表达:

F=-KX。

(5)

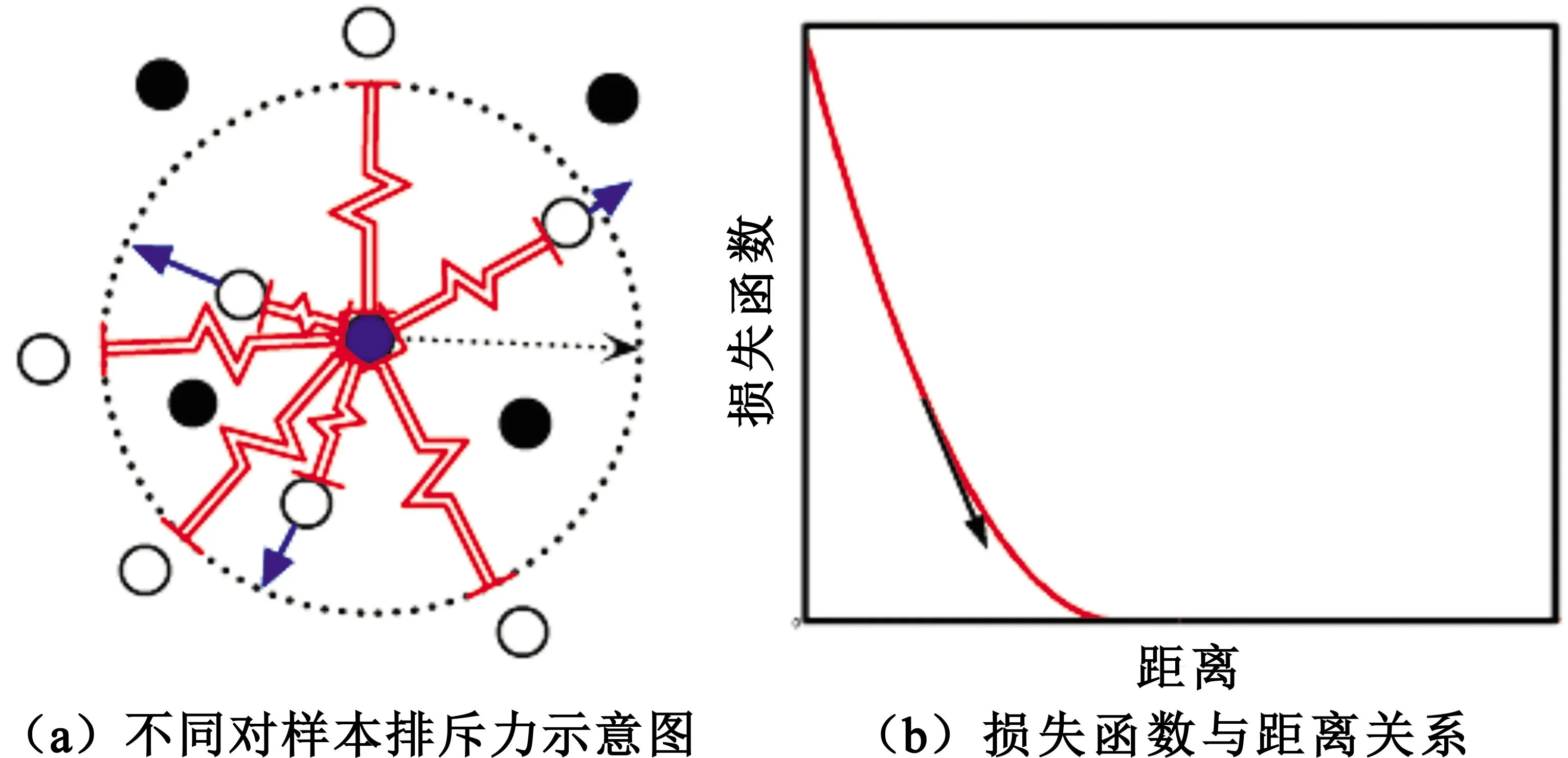

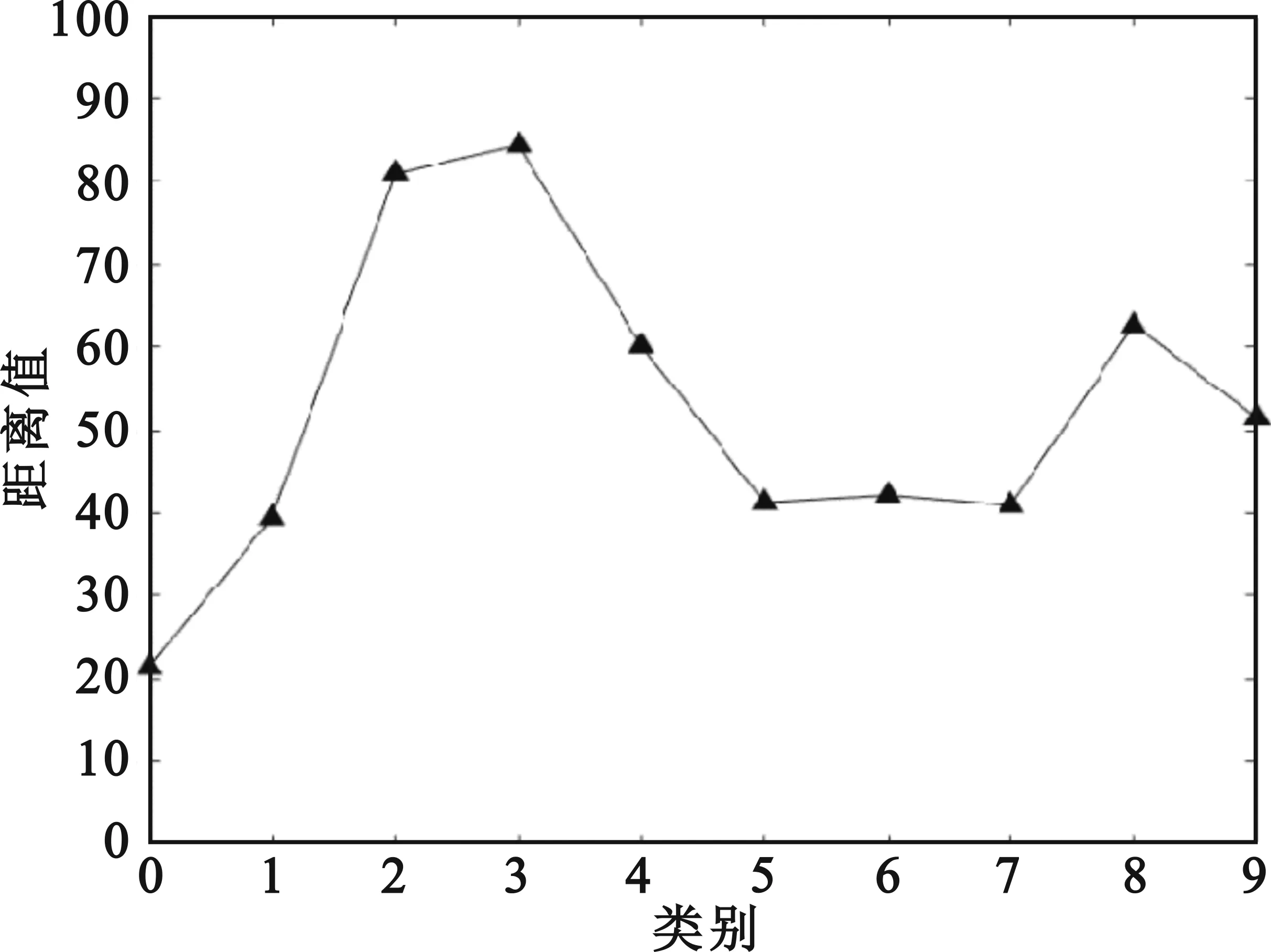

式中:F是弹力;K是弹簧系数;X是弹簧从静止长度的位移,负表示排斥力,正表示吸引力。假设弹簧静止长度为m,那么当X>m时弹簧两端则只有吸引力,而X 先考虑损失函数在相同对的损失函数 LG梯度为 (6) 图3 相同对的弹簧模型 再考虑不相同样本训练损失函数 LI梯度为 (7) 图4 不同对的弹簧模型 对于图3中弹簧吸引力模型,不能简单认为需要达到EW=0的最终状态,因为不同的相同对都会对于中心点产生吸引力,如图5所示,相同对样本b1与b2、b1和b3都会产生与中心点样本b1的吸引力,如果减小样本b1和b2的EW,那么会增大样本b1和b3之间的EW,最终的损失函数需要达到所有不同对之间的综合平衡。 图5 相同对之间的综合平衡图 由于孪生网络输入是数据对,采用逐对训练,所以会有平方级别对的信号样本对来训练模型,即训练数据对的数量相较单个数据数量增多,从而也可以使模型不易过拟合。 在采用孪生网络方法解决小样本问题时,仍会存在以下问题:一是孪生网络更关注于不同样本间的距离关系,即聚类损失,而忽略了样本的分类损失,使特征空间的不同维度的意义不明;二是仅使用距离度量作为损失函数时,训练过程较为不稳定,识别准确率差别较大。 因此针对上述问题,本文优化孪生网络损失函数,使之更适用于小样本条件下的辐射源分类识别任务。 根据信息论中交叉熵的概念,观察者调整自己输出的主观概率q,通过网络学习可以达到与实际概率p相同时,交叉熵最小[13]。交叉熵在神经网络中应用非常广泛,因此考虑在孪生网络损失函数基础上引入交叉熵损失函数: (8) 引入加权因子α,损失函数改写为 α(J(Gw(X1),Y1)+J(Gw(X2),Y2))。 (9) 式中:α用于调节交叉熵损失函数与孪生网络损失函数的权重比值——当α取0,上式即为孪生网络损失函数,趋于聚类损失;当α取值较大,上式趋于分类损失。在该试验中,α取值与m一致,均为5。因此,改进后孪生网络输入标签为Y、Y1、Y2,其中Y代表两个样本类别是否相同,标签Y1、Y2为输入样本x1、x2的类别标签,改进孪生网络结构如图6所示。其中ResNet网络的输出为1×10维的特征向量,既用于距离度量,也用于分类。 图6 改进孪生网络结构图 采用优化后的孪生网络实现小样本个体识别算法流程如下: Step1 使用ResNet11分类网络构建孪生网络结构,将辐射源1~10的所有样本随机两两分类,两样本属于同一类时打上标签0,否则标签为1。将重新编排后的数据送入孪生网络进行训练。 Step2 训练完成后,保存孪生网络权重。 Step3 将训练集辐射源1~10送入孪生网络结构中的ResNet11中进行预测,得到样本映射至了新的特征空间,并计算该类样本在特征空间的平均值,作为这类数据在特征空间的位置。 Step4 输入测试集,将测试集样本映射至特征空间,计算其与每一类数据在特征空间的欧氏距离,取与其最近的类别作为样本预测标签,输出识别结果。 识别具体流程框图如图7所示。 图7 基于孪生网络的小样本识别流程图 试验中以10部某型号同批次的通信电台辐射源信号作为数据集,电台通信频段为超短波,调制方式为8PSK;信号持续时间为20 ms,调制速率为50 kb/s;单个样本为10 000点的IQ基带信号,每类训练集为5个样本。验证集为5个样本,测试集为20个样本。为排除其他因素对试验结果的影响,采用相同接收机采集信号,且10台发射机发射信号内容均相同。 为排除训练过程随机因素产生的影响,每个试验均进行了10次,取平均值为该方法的识别准确率,如表1所示。 表1 不同网络小样本个体识别准确率对比 表2是10次ResNet训练准确率情况,10个辐射源个体识别混淆矩阵如图8所示,平均正确率在69%左右,同时对于辐射源1、2、6、10的个体识别率都小于35%。 表2 ResNet网络多次训练个体识别结果 图8 Resnet网络个体识别混淆矩阵 表3为10次孪生网络训练准确率情况,10个辐射源个体识别混淆矩阵如图9所示,平均正确率在83%左右,对于辐射源9、10个体识别效果最差,其识别准确率优于50%。 表3 孪生网络多次训练个体识别结果 图9 孪生网络个体识别混淆矩阵 3.3.1 识别准确率 表4为对于孪生网络经损失函数修改后的训练准确率情况,10个辐射源个体识别混淆矩阵如图10所示,平均正确率在88.5%左右;同时对于辐射源7、10个体识别效果最差,其识别准确率优于60%以上。 表4 孪生网络优化后多次训练个体识别结果 图10 孪生网络优化个体识别混淆矩阵 在孪生网络进行个体识别中,网络优化后性能得到了提升,为了尝试分析其原因,笔者进行了部分样本测试试验:孪生网络中ResNet网络主要完成低维特征提取,因此观察ResNet的10维输出,寻求其规律。 3.3.2 当孪生网络不进行优化 ResNet输出特征空间上10类训练集样本的中心点数据如图11所示,第0行即为第一个样本中心点的数据。 图11 孪生网络不优化ResNet输出特征 由图11可知,在10维的特征空间上,每一维没有明确的意义,比较杂乱。 3.3.3 孪生网络优化后 ResNet输出特征空间上10类训练集样本的中心点数据如图12所示,第0行即为第一个样本中心点的数据。 图12 孪生网络优化后ResNet输出特征 由图12可知,在10维的特征空间上,可以看出,训练集中心点在该类别的维度上的值最大,具有明显的特征,也具备一定的特征向量可解释性。 对于大多数的常规样本,通常比较典型的测试样本经孪生网络中的ResNet网络输出的特征向量满足图12的分布,例如第1个测试集样本的特征向量如表5所示。 表5 样本1的ResNet网络输出特征向量(10维) 该样本采用ResNet分类,与度量分类均可正确分类为第0类,其与各类别中心的距离如图13(a)所示。 (a)样本1 (b)样本4图13 样本与各类别中心距离 对于少数的特殊样本,例如第4个测试集样本的特征向量如表6所示。 样本4本来属于辐射源编号0,如果采用ResNet分类,其ResNet网络输出特征向量期望是第一个值最大,而实际上特征向量第6维上值最大,因此会将其分为第6类;若采用度量分类,其与第0类的训练集中心点的欧氏距离小于第6类,因此会将其正确分为第0类,其与各类别中心的距离如图13(b)所示,由此也可以说明采用孪生网络适应能力比单纯ResNet网络更适应于小样本分类的情形。 本文主要针对小样本信号辐射源个体识别网络难以稳定收敛的问题,提出了孪生网络以及一种损失函数优化的网络模型,并对模型进行了分析,论证了训练过程中可以实现不相同样本之间特征距离增大和相同类样本特征之间的距离减小的弹簧模型以及实现损失函数的快速收敛的原理。基于该模型进行了通信电台信号小样本辐射源个体识别试验验证,个体识别效果得到明显的提升,针对每类不大于10个训练样本集的通信电台能够达到88%以上个体识别准确率。初步分析了网络优化提升的可解释性,说明了方法的有效性和稳定性。 本文中孪生网络弹簧模型也可以用于优化一般二分类或者包含未知的开集识别,提升分类的收敛速度和泛化能力。

2 孪生网络的网络优化

3 试验验证

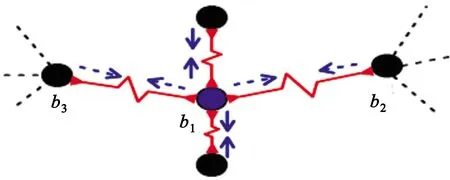

3.1 Resnet网络的试验验证

3.2 孪生网络的试验验证

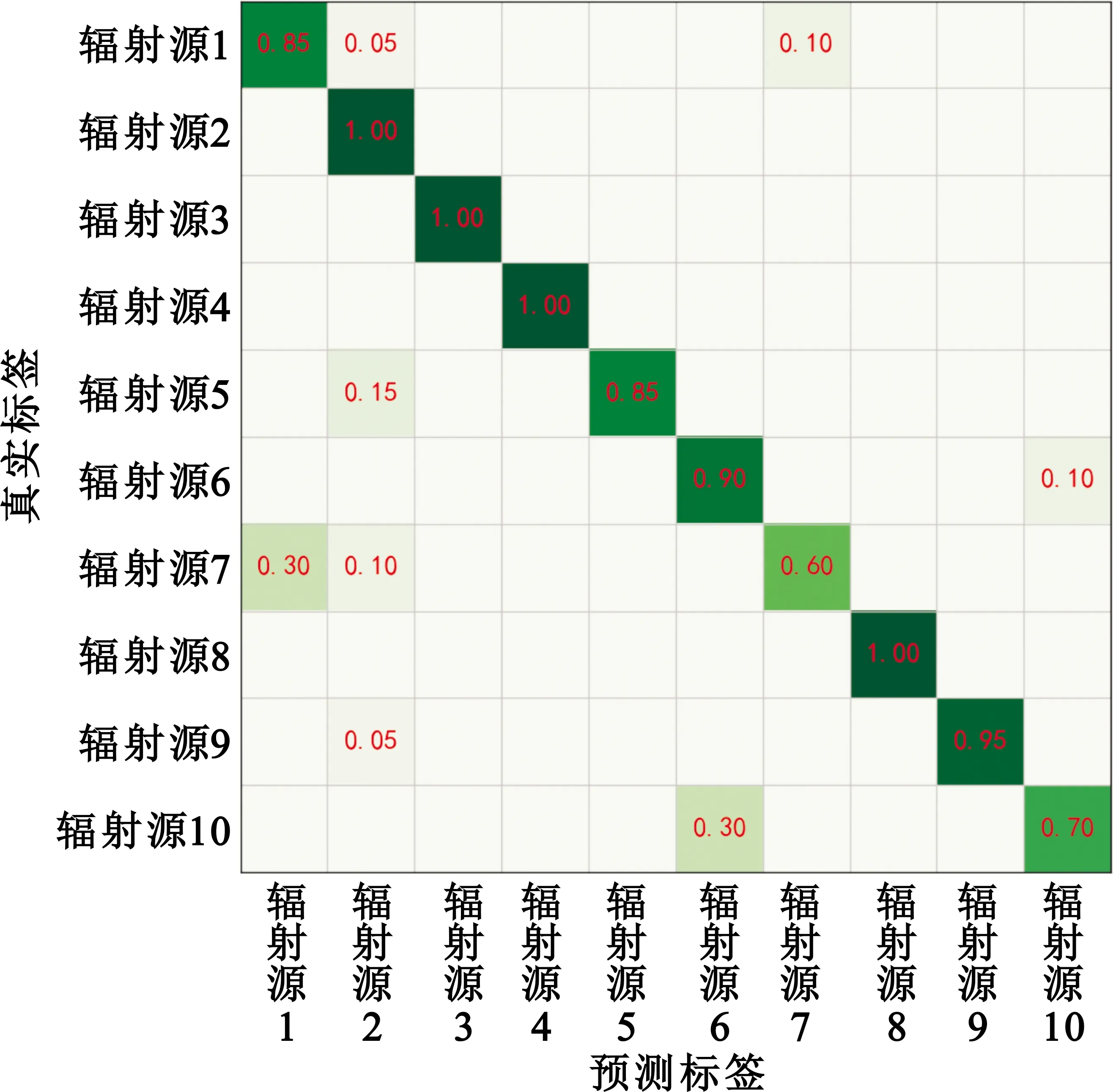

3.3 孪生网络优化的试验验证

4 结束语