航空遥感影像中的轻量级小目标检测

2022-06-23薛雅丽马瀚融

薛雅丽, 孙 瑜, 马瀚融

(南京航空航天大学,南京 210000)

0 引言

随着目标检测技术的迅猛发展,其应用遍布各行各业。遥感图像大多产生自飞机和卫星拍摄,其中可识别目标包括湖泊、森林、飞机、车辆、桥梁、建筑物等物体,其目标识别广泛应用于农业产值测算、灾害监测、城市建设规划等领域。在军事战争中,各类目标的检测和定位可以将海量遥感数据快速转化为目标情报,有利于战场形势剖析、锁定攻击目标位置,进而制定精准且及时的军事行动。因此,对遥感图像中目标进行实时检测对社会和经济发展具有重要的意义。

当前主流深度学习目标检测算法分为基于回归分析的单阶段检测算法和基于候选区域的双阶段检测算法。双阶段目标检测算法(如RCNN系列[1-3]和Cascade RCNN[4]等)先通过Selective Search或者Edge Boxes等算法在输入图像中选出候选区域,再对这些可能包含目标的候选区域进行分类和位置回归,进而得到更为精确的检测结果。单阶段目标检测算法也称为基于回归分析的目标检测算法,以YOLO系列[5]和SSD系列[6]为代表,直接通过密集网络得到目标分类和位置信息,只需经过一次图片处理,因此检测速度快,更能满足实时性要求较高的场景需求。

1 单阶段目标检测算法

在速度和精度上可以达到较高平衡的YOLOv5[7]算法通过设置灵活的配置参数,得到不同复杂度的模型。其检测速度快等特点使其可以在实时性高的场景需求下,完成在移动端的快速嵌入部署;其输入端采用了MixUP和CutMix等多图片融合、自适应图片缩放、DropBlock等模拟图片遮挡的数据增广算法;其主干网络部分先后共进行5次下采样,主要模块为Focus和CSP结构;其Neck结构中引用了扩大感受野的SPP[8]模块和增强多通道特征之间交流的PANet实现特征的跨层融合。然而,YOLOv5算法在画幅大、背景复杂的光学遥感图像中表现不佳,遥感图像中目标小且排列紧密,小目标采样易丢失,因此检测精度并不理想。

2 实时目标检测算法改进

本文为了满足实时性要求,对基于速度快、模型小的YOLOv5s结构进行改进。针对光学遥感图像的画幅大、尺度变化多样、目标尺度差异巨大、排列紧密等特性,引入BmFPN结构加强网络特征融合、降低网络的参数和计算量,并在最后的边框回归中引入CIoU[9]损失函数。

2.1 双向加权特征融合

对于大分辨率图像中的小目标检测,随着网络加深语义信息更加清晰,取而代之的是位置信息的缺失。如果将原始图像(如16 000×16 000,单位为像素,下同)直接输入到检测网络中,多次下采样后每格特征图的感受野较小(如YOLOv5主干网络进行5次下采样后,输入图像中32×32的目标大小也只有1×1),当原始图像中目标的宽或高小于该阈值,网络很难学习到目标的特征信息,检出效果并不好。

YOLOv5中借鉴了在图像分割领域表现出色的双向FPN结构PANet[10]。其通过FPN结构自顶向下传达强语义信息,PANet自底向上传达强定位特征,让高阶特征输出中也有了低阶细节,相辅相成,将来自于不同主干层的特征针对不同检测层进行参数聚合,进一步提高了网络的特征提取能力。

本文改进EfficientDet[11]模型中的BiFPN结构,代替原有的PANet作为特征网络实现特征融合。与PANet相比,它移除了只有一个输入边的节点,增加了跨层链接,通过双向传播实现更高级的特征融合。

图1 改进后的特征网络BmFPN

(1)

(2)

传统方法中,不同分辨率特征图被调整到相同的分辨率,然后在融合时一视同仁地直接相加。但其实它们对最后输出特征的贡献是不同的,因此更合理的做法是本文所用的加权平均融合。

2.2 更稳定的损失回归

YOLOv5使用BCEcls二分类交叉熵损失计算类概率Lcls,GIoU Loss[12]和BEC Logits损失计算目标得分Lobj,GIoU Loss计算边框回归Lbox。网络总损失为L=Lobj+Lcls+Lbox。GIoU损失函数为

(3)

式中:P与Pgt分别为预测框与真实框;Z为其最小外接矩形。可见LGIoU的优化对象为两框之间的面积,可初步解决LIoU为零的情况。其虽然能在一定程度上体现锚框的方向性差异,但当两框相交值相同时,无法反映具体的相交情况。DIoU损失函数为

(4)

式中:c为两框最小外接矩形的对角线;ρ2(b,bg t)为预测框中心点b和真实框中心点bg t间的欧氏距离。可见,LDIoU将预测框与目标框之间的归一化距离最小化,将目标与锚框之间的距离和重叠率都考虑进去,因此其收敛速度更快。

为了使目标框包裹预测框时也能完成快速稳定边框回归,本文在损失中引入LCIoU代替原损失函数LGIoU,带来了更快的收敛和更好的性能。算式为

(5)

3 实验分析与可视化

3.1 数据集准备

本文采用DOTA[13]数据集对算法进行评估,其中包含不同传感器和平台所采集的2860幅遥感图像。该数据集中有15种常见目标由旋转框标注,特点是尺度变化多样、检测难度高。由于遥感图像分辨率跨度大,有些高达上万像素,因此不应对图像直接缩放,需要对数据集进行切割。本文将含有小型车辆(SV)、大型车辆(LV)两类目标的图像作为原始图像,将其切割为640×640的子图像,并保证两幅子图像间重叠区间为200像素。在裁剪过程中,只保留中心点在子图像内部的标注,并调整标注数值。处理前、后数据集如图2所示。

图2 处理前、后数据集示例

处理后共得图像10 621幅,其中,训练集约占58%(6152幅),验证集约占14%(1513幅),测试集约占28%(2956幅),两类目标各占约1/2。本文所用的小目标遥感数据集M-DOTA比COCO数据集中小型目标比例更高,单幅图像目标多(平均每幅图像的目标数为9.97),且物体大多为非中心分布,检测难度大。处理后数据集中目标大小的分布占比与COCO数据集对比见图3。

图3 目标大小分布占比

3.2 模型部署与评价指标

本文以Ubuntu 18.04作为实验平台对所设计网络结构进行验证,训练与测试中均使用2块GeForce RTX 2080 SUPER作为图形处理单元。如无特殊强调,验证采用的深度学习框架均为Pytorch,网络训练中使用SGD优化器,初始学习率设置为0.01,权重衰减系数为0.000 5。网络中锚框均使用同一组,其由K-Means聚类算法得出,最佳召回率(BPR)为0.998 1。

本文采取的评价指标为召回率R(Recall)、准确率P(Precision),定义为

(6)

(7)

式中:TP(True Positive)与FP(False Positive)的判别条件是识别为正例的对象与Ground truth区域间的IoU是否大于规定阈值;FN(False Negative)指遗漏未被检出的Ground truth。

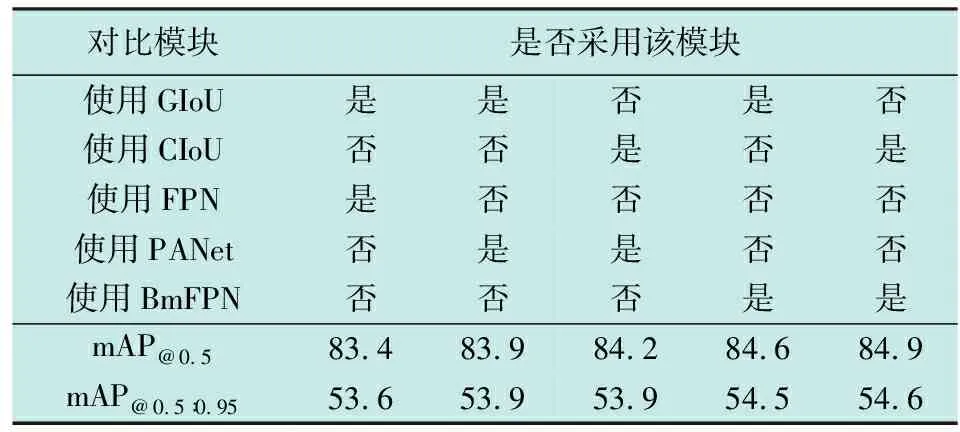

3.3 消融实验分析

为了验证本文所提算法改进的有效性,采用消融实验的方法分析改进模块对算法性能提升的有效性。表1展示了使用LCIoU,LGIoU做损失回归,和在Neck中使用FPN,PANet及本文设计的BmFPN特征融合网络检测效果的对比。表中:mAP@0.5指在LIoU阈值为0.5的情况下,对每类AP值求平均;mAP@0.5∶0.95指取步长0.05,分别计算LIoU阈值由0.5递增至0.95时各类的平均精度。

表1显示本文提出的BmFPN模块可以将mAP@0.5和mAP@0.5∶0.95提高0.6~0.7个百分点,说明双向融合和权重的加入丰富了特征图中小目标的特征信息,使网络计算出的特征图能够更加有效地表征物体。引入使用CIoU函数和使用BmFPN结构的两个模块组合的检测效果最好,在mAP@0.5和mAP@0.5∶0.95下分别提高0.9和0.7个百分点,该结果证明了本文所设计模型的合理性与优越性。

表1 消融实验结果对比

模型大小及参数量对比见表2。表中,浮点计算量单位为10亿次浮点运算数/s。

表2 模型大小及参数量对比

如表2所示,BmFPN在提升性能的同时并没有大幅度增加模型大小及浮点计算量,依然保持了轻量级模型尺寸,便于在算力有限的场景下部署。

3.4 对比实验分析

各算法检测精度与速度对比情况如表3所示。

表3 各算法检测精度与速度对比

表3对比了YOLO-BM,YOLOv5和YOLOv3模型在测试集上的检测速度和精度,可以看到,YOLOv5模型中的最小尺度YOLOv5s模型检测速度最快,达到128.8 帧/s;YOLOv5m模型牺牲了约30%的检测速度,将检测精度提升了0.5个百分点;YOLOv3模型的精度虽高于YOLOv5s模型,但检测速度非常慢,只有6.3 帧/s。本文设计的YOLO-BM模型在将检测精度提高了1个百分点的前提下,只比速度最快的YOLOv5s模型低4.4 帧/s,检测速度远优于其他算法。

3.5 可视化分析

图4展示了YOLO-BM,YOLOv5s,YOLOv5m和YOLOv3的可视化结果。小型车辆(SV)和大型车辆(LV)的检测结果显示在不同的彩色框中。由于遥感图像的背景复杂多样、目标体积小、排列紧凑,因此,在检测过程中经常会出现误检和漏检,随着检测精度的提高,这种现象将逐渐减少。

图4 各算法检测效果可视化

阴影区域检测效果对比如图5所示。为了更清楚地显示细节,图5放大了橙色和蓝色阴影部分以进行比较。

图5 阴影区域检测效果对比

图5中,图像橙色部分漏检率较高,特别是对于YOLOv3和YOLOv5s模型。同时,蓝色阴影区域覆盖了许多排列紧密的小目标。可以看到,在保持轻量级模型大小和快速检测的同时,在本文提出的YOLO-BM算法下漏检误检的数量远少于其他算法。

4 结束语

本文算法针对目标复杂的航空遥感图像,通过分析其中目标尺度差异大、排布密集等特点,提出了一种双向加权特征融合网络的高效目标检测算法。该算法加强了对底层特征信息的提取,对各层特征图加入权重机制,并且在边框回归中引入收敛更快、更为稳健的CIoU损失函数。改进后的网络结构尺寸小、检测速度快、检测精度高,完全可以满足实时性场景的要求,有非常高的实用价值。