用于遥感图像语义分割的多重预测网络

2022-06-16倪家辉周激流

倪家辉,周激流

(1.四川大学电子信息学院,成都 610065;2.四川大学计算机学院,成都 610065)

0 引言

遥感图像的语义分割是遥感图像处理中最基本和最具挑战的任务之一,特别是在一些具有超高分辨率的遥感图像中,通过对遥感图像进行精确的分割,能够有效地实现道路建筑的提取、土地覆盖的分类以及地貌变换的监测等。相对于自然图像的分割任务,遥感图像可以具有多光谱的信息用于提取不同类别的语义特征,但同时,由于遥感图像的地貌类别较为复杂、像素级的精确标注难度较大以及不同数据集的差异,遥感图像的语义分割任务难度较大。而近年来,由于卷积神经网络在图像特征提取与物体表征的强大能力,越来越多基于深度学习的模型被应用于遥感图像的语义分割,其中,全卷积网络(fully convolutional network)在图像分割任务中取得了巨大的进步。与此同时,常见的卷积神经网络受限于卷积核的局部感受野以及短程的上下文语义信息,图像分割仍是一个十分具有挑战性的任务,特别是对于具有更加复杂地貌类别的遥感图像来说,难度进一步加大。为解决图像长短距离的依赖关系并进一步提取更显著的语义特征,目前提出了穹状空间金字塔池化模块(ASPP),金字塔池化模块(PPM)动态地获取不同大小池化区域的特征表示;另一方面,为了获取密集的像素级的上下文语义特征,研究者提出了自注意机制去增强不同像素之间的关系。但是,大多数方法是对较深特征图的单一层次的预测输出,并且常常忽略了相同类别和不同类别之间关系。鉴于此,本文提出了基于多层次特征预测的模型来进一步提高遥感图像语义分割的效果。

本文的模型先利用特征提取网络获得不同深度的特征图,对于同一层次的特征来说,先利用卷积注意力机制模块(CBAM)获取全局的依赖关系,将通道数转化为输出类别的通道数,生成预监督的类别亲和特征图,用于加强类别内和类别间的语义特征关系,最后输出语义分割的结果。本文所提出的模型考虑了不同深度特征的差异性,实现了多层次预测结果的输出,能够有效地实现语义分割任务。本研究在两个不同遥感图像语义分割数据集上验证了该方法的有效性,并对比了常见的遥感语义分割模型,证明了该方法的先进性,在相关的评价指标上有一定的提升。

1 方法

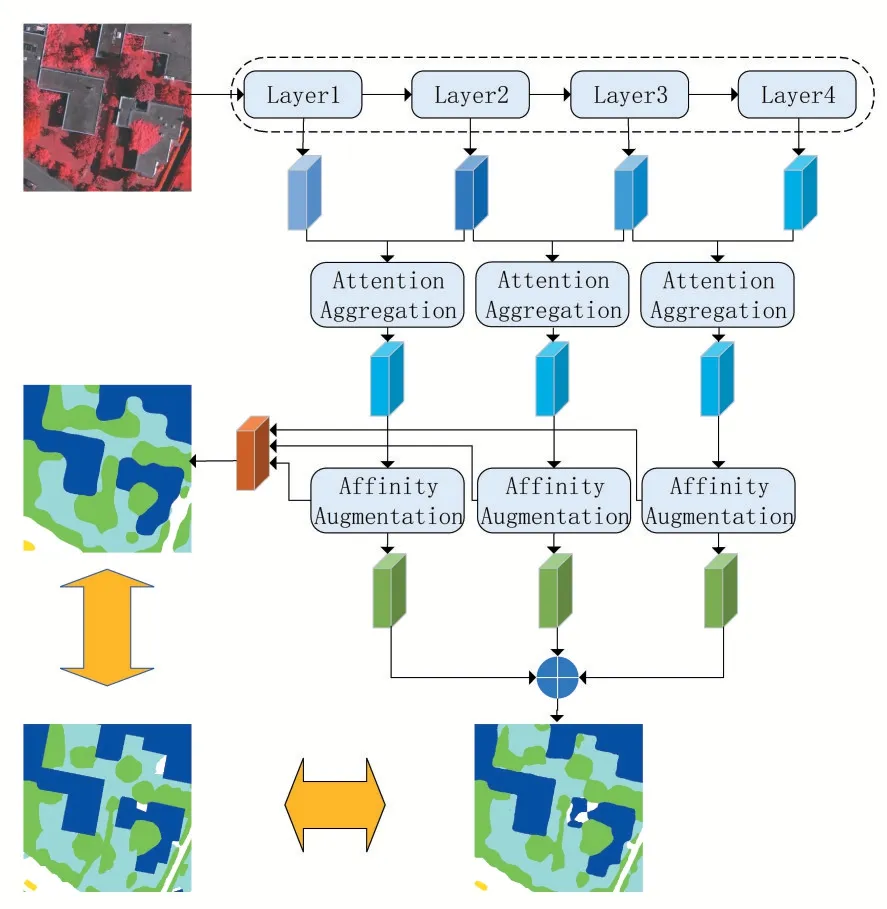

如图1所示,本文所提出的多层次预测网络以ResNet101为基本骨干网络提取不同深度的语义特征,然后将相邻的特征图利用注意力整合模块进行特征重构,得到相应层次的特征图。这些特征图随后被输入到对应的亲和图增强模块中,输出语义信息增强的特征图和对应的具有类别数的亲和特征图。语义增强的特征随后会经过一个1×1 的卷积层转化为具有类别数的特征图。最后,将多个层次的输出特征图相加并上采样到输入图像的分辨率大小,最终得到相应的分割图。

图1 网络结构

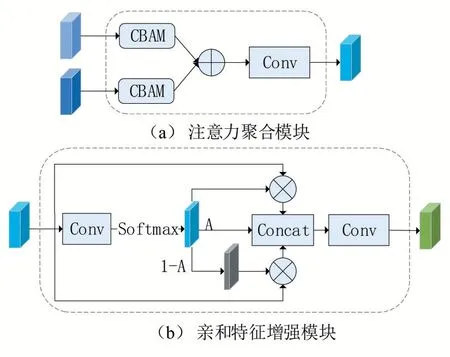

为了聚合不同深度的语义特征,本文利用注意力机制去整合ResNet 网络提取的相邻特征图。使用了卷积核注意力机制模块(CBAM),本文将相邻特征图分别输入到空间注意力模块和通道注意力模块,将提取到的有用的特征相加,再经过一个卷积层得到自适应的注意力重构特征。如图2(a)所示。

对于亲和特征增强模块,我们先利用两个卷积层将重构后的特征转为具有类别数的特征,再经过Softmax激活函数得到类别亲和图特征A,并用此类别亲和图特征点乘输入的原始特征,用于加强该层的类内的语义关系,并用一个大小相同的全1矩阵减去类别亲和特征,得到类间亲和特征图1-A,用于加强类间的语义信息特征,最后,将类内特征图、类间特征图以及类别亲和特征图拼接在一起, 得到输出的亲和增强特征图,如图2(b)所示。本文将多个层次输出的结果相加得到最终的分割结果,并与标签计算损失,进行网络的优化。除此之外,我们将多层的亲和图相加得到全局亲和图,将此全局亲和图与语义分割的标签计算交叉熵损失,进行初步的约束,以此实现不同层次的输出关注不同类别区域的特征。

图2 模块结构示意图

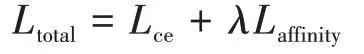

最终该模型的损失函数可以大致分为两类:一个是多分类的交叉熵损失,另一个是基于亲和图的辅助损失,这个辅助损失不仅能使网络关注不同类别区域,还能提升网络的性能,使网络更加易于收敛。最后,该模型的总损失函数可以表示如下:

其中,表示总的多分类的交叉熵损失,表示亲和图辅助损失,为超参数,用于权衡不同的损失,实验中按经验设置为0.5。

2 实验

为了验证该模型的有效性,本文选择经典的语义分割网络FCN为基准网络,并对比了几个常见的语义分割方法,在ISPRS 2D 语义分割数据集Vaihingen和Potsdam进行实验。对于结果的定量指标,本文计算了每一类前景的分数、平均的分数、平均的交并比(mean IoU)以及总的分类准确率(overall accuracy)。

2.1 数据集

实验中,本文选用了ISPRS 比赛的两个遥感图像语义分割数据集。其中,Vaihingen 数据集包含33 张超高分辨率的遥感图像,每张图像有三个光谱带(红、绿, 近红外)以及一个归一化的数字曲面模型(DSM)。该数据集的空间分辨率为9 cm,图像的平均大小为2494×2064 像素,并且每张图像都有较为精确的像素级手工标注,包含6个土地覆盖类(5个前景类以及1个背景类别)。在具体实验中选择了其中的16张图像用于训练,另外的17 张用于测试。而Potsdam 2D 语义标注数据集包含了38 张高分辨率的遥感图像,其空间分辨率为5 cm,包含了四个光谱带(红、绿、蓝,近红外)以及归一化的DSM 图像。同样地,依据之前的工作,本文将其中24 张图像用于训练,剩下的14 张用于测试。在实验中,未使用DSM图像。

2.2 实验设置

实验中选用在ImageNet 上预训练好的ResNet101 网络为模型的特征提取骨干网络,并且骨干网络是可训练的,其学习率与其他网络层相同。对于不同数据集,初始的学习率都设置为0.01,使用了Poly 学习率调整策略。对于优化器,使用SGD进行网络梯度的反向传播,优化器的权重设为5e-04,动量设为0.9。同时,网络训练时使用了几种数据增强的方法,包括随机裁剪、随机旋转、随机翻转和随机放缩。该模型是基于Pytorch框架实现的,并且在GTX 1080 Ti显卡上进行了200 k迭代训练。

2.3 实验结果

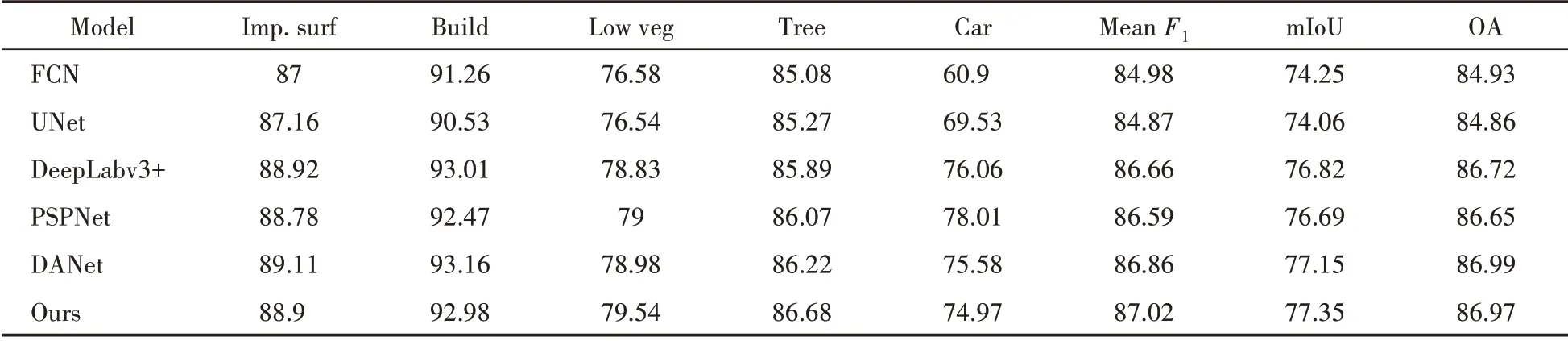

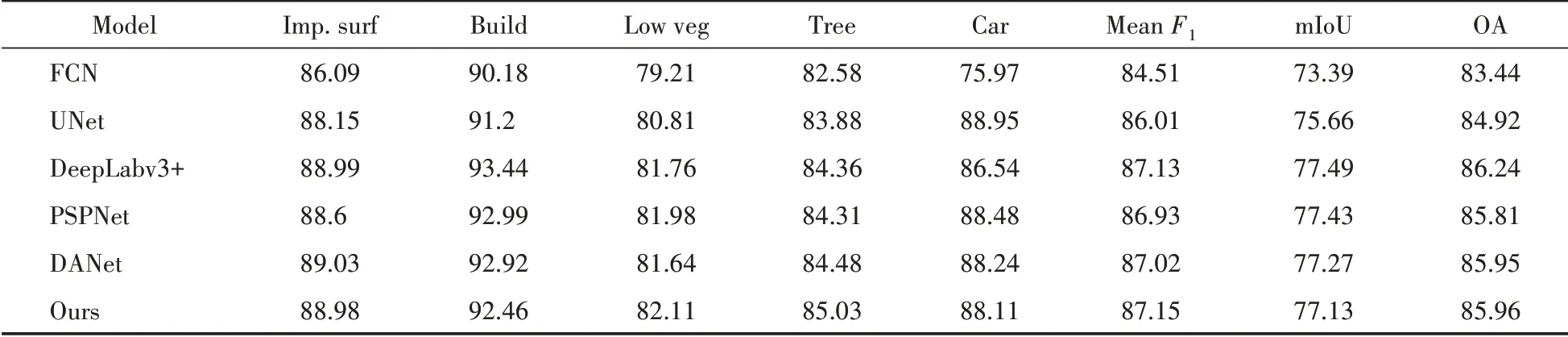

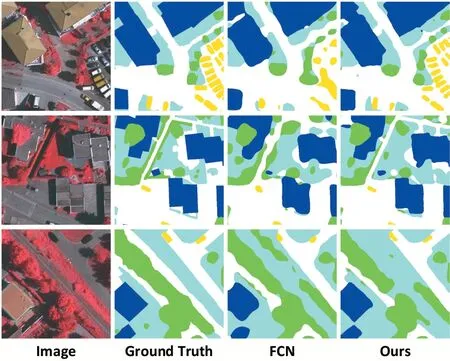

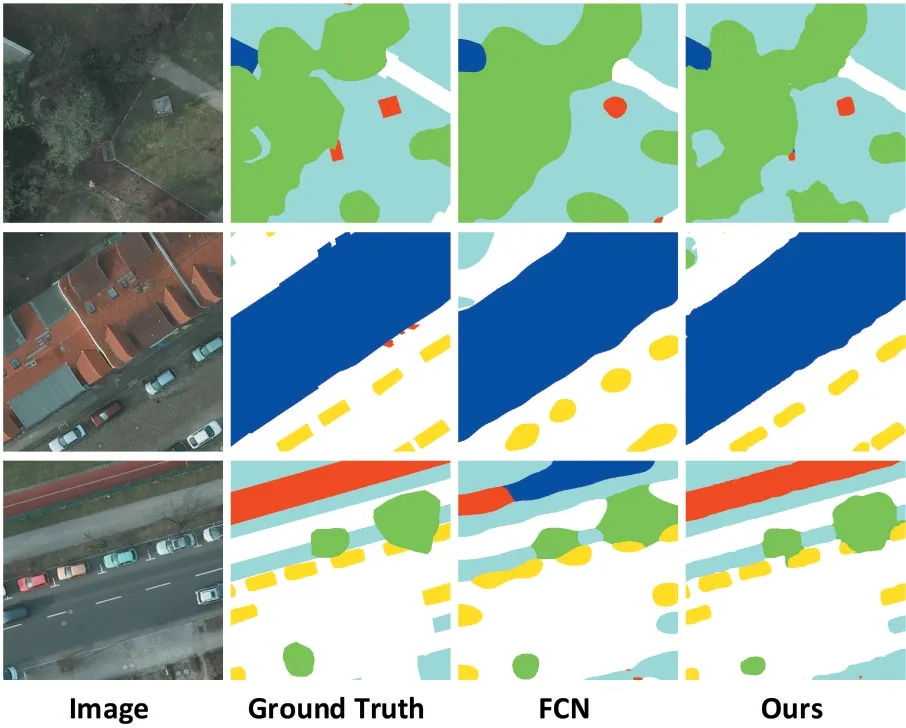

为了得出综合性的评价,实验将该模型与现有的五种分割方法进行了比较,包括FCN、UNet、 Deep Labv3+、 PSPNet以 及DANet。Vaihingen 数据集上的定量评估指标如表1 所示。整体可以看到,该方法在平均指标、平均交并比和总的分割准确率上都优于其他方法。相较于基线方法,该方法在各个指标上都有较大的性能提升,在平均分数、平均交并比和总的分割准确率上都有约2%的提升,这也证明了本文所提出的相应模块能有效地获取类内和类间的语义信息。同时,为了进一步展示该方法的优越性,本文展示了该方法与基线网络在Vaihingen 测试集上的几个分割结果例子,如图3 和表1 所示。从图中可以看到,该模型能够更加平滑地分割建筑物,表明我们的模型能够学习长短距离的上下文语义信息;而且,该模型对小物体的车辆分割效果也十分的明显,不会像基线网络那样无法区别不同的车辆,表明该模型对不同尺度的物体都有较好的鲁棒性。除此之外,本文在Potsdam数据集上也进行了实验,其定量和定性的结果分别如表2 和图4 所示,这进一步证明了该模型的有效性。

表1 不同方法在Vaihingen数据测试集上的分割指标比较

表2 不同方法在Potsdam数据测试集上的分割指标比较

图3 该方法与基线网络在Vaihingen测试集上的分割结果实例(白色:不透水表面;蓝色:建筑物;青色:低矮的植被;绿色:树木;黄色:汽车)

图4 该方法与基线网络在Potsdam测试集上的分割结果实例(白色:不透水表面;蓝色:建筑物;青色:低矮的植被;绿色:树木;黄色:汽车;红色:杂物/背景)

3 结语

本文提出了一个用于遥感图像语义分割的多重预测分割网络,每个分支能够自适应地关注不同尺度的类别特征,在每一分支都包含一个特征聚合模块和亲和特征增强模块,最后,将多个层次的综合预测结果用于分割,与标签图像计算交叉熵损失。在两个遥感图像分割数据集上进行实验,该模型在定量和定性结果上性能都有明显的提升,该模型能够学习长短距离的上下文信息,对不同大小的物体都能进行有效的分割。