基于门控图神经网络的新闻要素信息抽取方法

2022-06-13党雪云

党雪云,王 剑*

(1.昆明理工大学 信息工程与自动化学院,云南 昆明 650500;2.云南省人工智能重点实验室,云南 昆明 650500)

0 引 言

随着现代互联网信息技术的飞快发展,网络上涌现越来越多的新闻文本信息。这类信息通常以非结构化、错综复杂的文本形式出现,使得人们理解新闻文本信息的难度越来越大。新闻要素信息是指新闻文本中的人名、地名、新闻领域要素等内容。对这些要素信息的抽取,可以帮助人们更便捷地理解海量的新闻信息。本文以涉案新闻文本要素信息抽取为例,提出一种基于门控图神经网络模型的要素信息抽取方法,通过构建字粒度字词关系组合图的方式对新闻文本和领域词汇进行建模,提高新闻文本要素信息抽取的性能。

涉案新闻要素信息抽取技术能够帮助人们更便捷地分析新闻文本中出现的主体之间的关系,通过对涉案新闻文本进行分析,归纳出这些数据存在的一些特点。如图1 所示,一是存在要素信息的简称识别不全问题;二是存在组合要素识别不全的问题;三是歧义词干扰的问题,在这个示例中“人品”就是一个歧义词。这些特点的存在导致了识别新闻文本要素信息时效果不佳。观察到这些内容和涉案新闻案件领域词相关性很大,因此本文提出一种融合案件相关词典的方法,通过图神经网络将案件相关词汇知识融入到涉案新闻文本内容中,通过挖掘其潜在的语义特征提高涉案新闻文本要素信息抽取方法的性能。

图1 涉案新闻文本要素信息抽取问题分析

1 相关工作

新闻要素信息抽取任务可以看作面向特定领域的命名实体识别(Named Entity Recognition,NER)任务。当前,NER 方法主要分为基于规则的NER 方法、基于机器学习的NER 方法以及基于深度学习的NER 方法三大类。

基于规则的NER 方法主要是针对不同领域实体的特点,通过人工制定实体识别规则模板,比如基于特定领域的词典、句法模式、词法模式等实现命名实体识别。ZHANG 等人[1]设计了一个提取生物医学文本中的命名实体的框架,该框架包括一个种子词提取器、一个名词词组分块器、一个IDF 过滤器以及一个基于分布语义的分类器,此方法可以应用于不同的设置和应用程序;QUIMBAYA 等人[2]提出了一种用于电子健康病历领域的命名实体识别方法,该方法结合了模糊匹配原则和词干匹配原则,在公开数据集上的实验表明命名实体的召回率获得明显的提升;沈等人[3]通过分析中文组织机构名的全称特征,设计并构建了中文组织机构词库、规则集,最后利用规则匹配与决策、相似机构名称合并的方式识别出中文组织机构名的全称,之后又通过类似的分析过程对中文组织机构名简称进行识别。虽然利用基于规则的方法可以取得不错的性能,但针对涉案新闻文本,其文本杂乱无章、表达方式不规范,想要构建完备的实体识别规则库较为困难。

基于机器学习的NER 方法主要是利用大规模标注语料库自动学习文本的词、词性及上下文特征,自动构建特征模板,利用特征模板和支持向量机(Support Vector Machine,SVM)等统计机器模型,预测文本中每个字的实体标签。JI 等人[4]提出一种联合模型来对twitter 文本中的不规则的地点信息进行识别,并将识别到的地点和定义规范的地点文本进行链接,该联合模型允许使用全局特征,缓解了传统结构存在的错误传播的问题。LIU 等人[5]提出了一种处理特定领域的远程监督NER 的方法,该方法利用了基于标题扩展词典的思想和动态规划推理的方式,取得了优于之前相关算法的性能。AGERRI 等人[6]展示了如何在最少的人工干预情况下开发跨语言和数据集的命名实体识别系统,充分结合了单词浅层的、局部的特征表示,通过实验证明了如何更有效地根据可用原始数据组合各类型单词的表示特征。

近年来,深度学习方法在自然语言处理方向的研究取得了较好的性能。神经网络不仅具备强大的向量表达能力、捕获上下文依赖信息的能力,而且可以通过端到端训练自动学习文本中潜在的高维语义信息。ZHANG 等人[7]提出一个晶格结构的LSTM 模型,该模型编码字符粒度的源文本和通过字典匹配来的潜在词,得到词与词之间的序列信息表征,其中门控循环单元使得模型选择出与文本最相关的字符、单词,获得了更好的NER 效果;LI 等人[8]提出了一个可以同时解决普通NER和嵌套NER 的框架,该框架将NER 任务转换为机器阅读理解问题,将每个实体的类型当作问题,然后利用问题去文中匹配识别对应的实体;王等人[9]利用双向编码器表征量(Bidirectional Encoder Representations from Transformers,BERT)模型作为特征表示层,提取文本中的全局特征、局部特征,最后利用Bi-LSTM 提取上下文特征,用常见的条件随机场(Conditional Random Fields,CRF)模型进行解码得到实体识别结果。虽然机器学习方法和深度学习方法都能取得不错的效果,但它们都依赖于大规模的标注数据,而针对涉案舆情这一垂直领域要素识别数据集规模很小且标注不易,一时很难获得大规模的标注数据。

2 融合词典的涉案新闻要素信息抽取方法

合案件相关词典的涉案新闻要素信息抽取方法,模型的整体架构如图2 所示。模型共包括3 个部分:首先,融合案件相关词典的字词关系组合图构建是模型的输入部分,它显式地建模了涉案新闻文本和案件相关词典的交互信息;其次,使用门控图神经网 络(Gated Graph Neural Network,GGNN)[10]模型对组合图的信息进行编码得到特征空间;最后,使用常见的Bi-LSTM-CRF 模型进行解码,预测出最终的要素实体标签。接下来对以上内容进行详细介绍。

图2 融合法律领域词典的图神经网络模型

本文以涉案领域的新闻文本为例,提出一种融

2.1 融合案件相关词典的字词关系组合图构建方法

本文构建的组合图的定义为G=(V,E),其中V代表结点集合,E代表边的集合。结点集合V={xc,vs,ve},其中xc代表输入新闻文本按字符切分的集合,vs和ve用于标记新闻文本在词典中匹配到的要素信息的位置标记,vs代表匹配到的要素的起始位置,ve代表匹配到的要素的结束位置;边集合E={ec,ev},其中ec是输入的新闻文本字符vc之间的边集合,ev指新闻文本匹配到词典中的词时产生的边集合。

如图2 所示,输入层包括一个案件相关词典和一段涉案新闻文本“近日,浙江省中院审结了一起放火盗窃罪案件,被告人品某良被依法判处有期徒刑两年。”。此文本共包含39 个字符,文本和词典共匹配到3 组要素信息,分别是机构名“浙江省中院”、罪名“防火盗窃罪”和人名“品某良”,所以图中共包含45 个结点,其中x1,x2,…,x39是指输入的新闻文本按字符粒度切分后共39 个结点,vs和ve分别是从词典中匹配到要素时的起始位置标记、结束位置标记,共6 个结点。其次,共包含44 条有向边,其中38 条是新闻文本字符xc之间的边,也就是按照句子的自然语序依次在相邻字符间添加从左向右的边,它建模了输入文本的语序信息;6 条是含有vs、ve的边,它建模了输入文本和词典之间的交互信息。以上过程完成了融合案件相关词典的组合图的构建过程。该图不仅编码了新闻文本中字符间的顺序信息,同时也编码了文本和词典的交互信息。

2.2 门控图神经网络建模方法

门控图神经网络(Gated Graph Sequence Neural Networks,GGNN)[10]是一种基于门控循环单元的模型,其优点在于其能够选择性记忆邻居结点的隐藏信息,还可以记忆结点迭代过程中的隐藏信息。首先对结点v的初始状态进行初始化,即hv(0)=[char_vec,bichar_vec],其中char_vec代表字向量,即one-hot向量,bichar_vec代表双字符向量,即采用2-gram语言模型的向量。图的结构化信息存储于邻接矩阵A中,其中A∈RD|V|×2D,|V|是图中结点的个数。邻接矩阵A决定了图中结点之间传递信息的方式,矩阵的系数结构对应图中的边,每个子矩阵中的参数由图中边的方向确定。邻接矩阵A还用于在每一个时间步检索其邻居结点的状态信息,Av:∈RD|V|×2D表示结点v对应的入射边和出射边的集合。隐藏层的状态信息通过GRU 进行更新,它的推导公式如下:式中:hv(t)是结点v在时间步t时的隐藏状态,Av是结点v在邻接矩阵中对应的行向量;W和U是需要学习的参数。式(1)创建了时间步(t-1)时的状态矩阵H;式(4)表示要通过相邻节点传播信息的方法;剩余的步骤结合邻居节点的信息和时间步(t-1)的隐藏状态,计算出时间步t时的隐藏状态hv

(t),最终经过T个时间步,得到结点的最终状态

2.3 Bi-LSTM-CRF 解码层

本模型的解码层选择最常用的Bi-LSTMCRF 模型[11],它主要是双向长短时记忆网络(Bidirectional Long-short Term,Bi-LSTM)模型和条件随机场(Conditional Random Fields,CRF)模型两者组合而成,其中Bi-LSTM 用于提取上下文语义特征,CRF 用于对上下文信息进行约束性的解码,将上一步通过图神经网络得到的特征表示{hv|T||v∈T},按照输入文本的自然语序将每个字符的特征表示输入到标准的Bi-LSTM-CRF 模型,最终生成预测的要素标签序列。

3 实 验

3.1 数据集

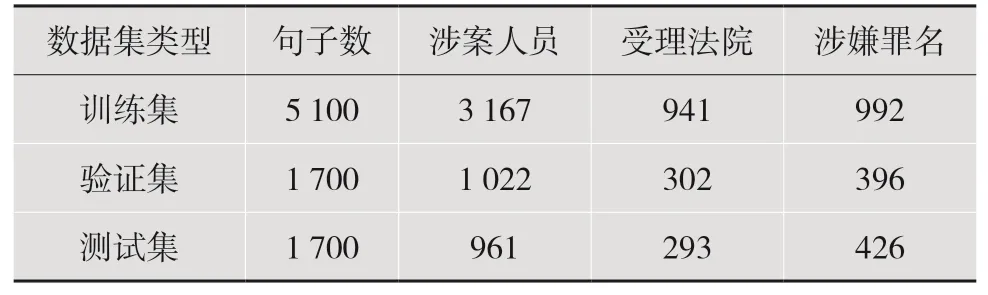

本文使用的涉案新闻要素信息语料集一共有8 500 条包含要素信息的句子,即真实涉案新闻文本进行数据清洗后通过人工筛选并标注的带有要素的句子。使用时训练集、验证集、测试集的比例是7 ∶2 ∶1。涉案新闻要素信息语料统计情况如表1 所示。

表1 涉案新闻要素信息语料统计表

3.2 案件相关词典构建方法

本文构建了一个规模为1 200 词的词典,包括人名、法院名及罪名共3 种类型的词,其中法院名和罪名分别包含其全称和简称。主要方法是使用正则匹配的方法从法律文书这类专业数据中匹配得到人名、罪名、法院名,部分罪名词来自于搜狗输入法词库的法律罪名专用词库。

3.3 评价标准

为了更好地评估模型的效果,需要进行对比试验。目前常用到准确率(Precision,P)、召回率(Recall,R)、和F1值(F1-Measure)作为评价指标。准确率P、召回率R和F1值的计算公式如下所示:

式中:TP表示把正例预测成正的概率,FP表示把负例预测成正的概率,FN表示把正例预测成负的概率。

3.4 实验设置

实验使用one-hot向量和2-gram双字符向量拼接的方式对输入数据进行初始化,得到其向量化表示,维度均为200 维。训练时,Dropout设置为0.5,学习率lr设置为0.01,训练轮次epoch 设置为100,batch_size设置为10,优化器使用SGD。

3.5 实验结果与分析

本文选择了6 个基准模型,分别在标注好的涉案新闻要素信息语料集上进行实验。基准模型包 括Bi-LSTM-CRF,CAN,Lattice LSTM,LGN,LR-CNN,MG-GNN。 其 中,Bi-LSTM-CRF[11]包括Bi-LSTM 层和CRF 层,是常用的序列标注模型;CAN[12]融合本地注意力机制和卷积神经网络,利用这种方式挖掘相邻字符和上下文中的信息;Lattice LSTM[7]设计了一种晶格LSTM 模型,同时编码输入文本和字典匹配而得的潜在词,充分挖掘文本中的语义特征;LGN[13]研究引入图神经网络的方式利用全局语义特征,该网络使用词汇知识连接字符来捕获局部信息,且全局中继节点可以捕获全局句子语义和长期依赖关系,基于字符、潜在词和全句语义之间的多种图的交互作用可以有效地处理词语歧义问题。LR-CNN[14]提出了一种基于卷积神经网络的方法,利用反思的方式来整合词汇信息。该方法可以并行建模与句子匹配的所有字符和潜在词汇信息,反思机制还可以通过反馈高层次特征来解决词汇冲突的问题,从而细化网络。MG-GNN[15]提出了一种基于多向图结构的图神经网络方法,自动学习如何将多个不同类型的词典结合到NER 系统中,显式地建模字符与词典的相互作用,将来自不同词典的信息加权组合,基于上下文信息解决了匹配冲突问题。

表2 不同模型对比

在采用F1值的评价方法中,本文模型与其他模型相比,F1值有2.12%~5.34%的提升。对比Bi-LSTM-CRF、CAN 和本文模型,说明了在图神经网络模型的基础上融入词典的优越性。对比Lattice LSTM、LGN、LR-CNN 和本文模型,同样都是融入了词汇信息,但是融入特定领域相关的词汇知识产生了显著的效果,说明融入领域词典的方法在新闻文本要素信息识别任务上的优越性。对比MGGNN 和本文模型,同样都是基于图的方法,但是本文具有更显著的效果,说明在图的基础上融入案件相关词典信息是有作用的。

为了验证词典对实验结果的影响,本文针对不同词典规模进行了对比实验,具体实验结果如表3 所示,这里采用随机采样的方式分别构建规模为300 词、500 词及800 词的词典作为对比。分析表3 可知:不采用词典(0 词)与采用1 200 词的词典相比,在准确率上有3.48%的提升,在召回率上有1.98%的提升,在F1值上有2.44%的提升;采用300 词的词典与采用1 200 词的词典相比,在准确率上有1.96%的提升,在召回率上有0.27%的提升,在F1值上有1.89%的提升;采用500 词的词典与采用1 200 词的词典相比,在准确率上有0.65%的提升,在召回率上有0.23%的提升,在F1值上有0.76%的提升;采用800 词的词典与采用1 200 词的词典相比,在准确率上有0.14%的提升,在召回率上有0.08%的提升,在F1值上有0.06%的提升。从整体来看,词典的规模越大,模型的效果越好,刚开始随着词典规模增大,效果提升显著,随着词典规模越来越大,模型效果的提升逐渐趋于缓和。

表3 采用不同规模的词典时本文模型的效果对比

4 结 语

本文针对新闻文本要素信息识别任务,以涉案新闻文本为例对要素信息抽取方法进行研究,提出了融合案件相关词典的要素信息抽取方法,利用图神经网络挖掘新闻文本和词典组合后的潜在语义特征。结果表明,要素信息抽取的性能得到了有效提升。