基于改进PSPnet的无人机农田场景语义分割

2022-05-13刘尚旺张杨杨蔡同波唐秀芳王长庚

刘尚旺,张杨杨,蔡同波,唐秀芳,王长庚

基于改进PSPnet的无人机农田场景语义分割

刘尚旺1,3,张杨杨1,2,3,蔡同波1,3,唐秀芳1,3,王长庚1,3

(1.河南师范大学 计算机与信息工程学院,河南 新乡 453007;2.中国农业科学院 农田灌溉研究所,河南 新乡 453002;3.“智慧商务与物联网技术”河南省工程实验室,河南 新乡 453007)

【】改进PSPnet语义分割模型在无人机农田场景下的性能。对PSPnet语义分割模型进行3方面改进:①通过不同维度特征级联,在强化场景解析的基础上保留更多图像细节特征。②利用深度可分离卷积模块构建轻量级语义分割模型,使其更加高效。③改进激活函数,提升模型分割效果。所建模型的平均像素准确率和平均交并比分别为89.48%和82.38%,比改进前的模型提高了18.12%和18.93%,且分割结果优于Unet和DeeplabV3+等模型。改进后的模型能够有效进行无人机遥感农田场景语义分割。

PSPnet;语义分割;特征级联;深度可分离卷积;激活函数

0 引 言

【研究意义】随着智慧农业和信息化技术的快速发展,全面、高效获取和解读农田数据变得越来越迫切。无人机技术作为获取遥感信息的一种方式,具有高灵活、高效率、低成本等特点;可以为作物分类、农业产量预估、粮食安全检测、农业用水规划等应用领域的研究提供有力的支持。

【研究进展】目前以机器学习为代表的人工智能方法在无人机农田场景中得到了广泛应用。有学者利用无人机遥感图像,结合以支持向量机为代表的传统机器学习方法获得了农田植被和土地利用情况[1-3]。然而,传统机器学习方法往往需要人工参与设计,在处理海量数据和多分类问题上存在费时费力和无法保证精度的局限性[4]。除传统的机器学习之外,深度学习作为人工智能领域的重要方法已经进一步推动了多个研究领域的发展。其中,深度语义分割能够对图像中的每个像素进行分类,最终输出图像中不同对象的语义分割结果,在农田场景中也得到了广泛的应用。杨丽丽等[5]改进Unet实现了农田道路的高精度识别;Yang等[6]探索了Segnet和FCN等深度学习模型在无人机农田场景下地膜覆盖制图方面的应用;杨蜀秦等[7]改进DeeplebV3+网络,结合多光谱遥感影像对作物进行分类;李云伍等[8]利用空洞卷积神经网络,构建了田间道路的语义分割模型;易诗等[9]提出了一种红外实时双边语义分割网络,利用红外图像实现了夜间农田场景的实时语义分割。

Long等[10]于2014年提出了全卷积网络(Fully Convolutional Networks,FCN),首次将卷积神经网络应用于图像分割领域,实现图像端到端的语义分割。随后基于对FCN语义分割模型的改进,Ronneberger等[11]实现了基于Encoder-Decoder(编码器-解码器)结构的Unet语义分割模型,通过对不同维度的特征进行融合,提升了分割精度;Chen等[12]提出的DeeplabV3+,通过扩展卷积在不降低空间维度的前提下增大了卷积操作的感受野,改善了分割效果。Zhao等[13]提出的PSPnet,通过添加金字塔池化模块对不同区域的语境进行聚合,加强了对图像的场景解析,提高了图像分割的质量。【切入点】基于深度学习的语义分割方法通常会经过下采样(特征提取)和上采样(恢复尺寸)2个过程[10-13]。下采样过程中,主干特征提取器会从低维到高维依次进行特征提取,低维特征通常包含图像中的一些细节信息,如位置、边缘、角度等图像细节特征;高维特征往往包含图像的语义特征[14]。语义分割往往使用语义更加丰富的高维特征进行分割,但是无人机农田场景下获得的图像细节特征非常丰富,仅利用高维特征进行分割会因为丢失图像部分细节,造成分割边缘粗糙的情况。另外,利用无人机采集的图像往往分辨率较高,现有的特征提取器常使用传统卷积神经网络进行特征提取,其参数量庞大[15],高分辨率图像运算速度慢,分割效率低下。

【拟解决的关键问题】为此,针对PSPnet模型,本文构造多维度特征融合的金字塔池化结构;利用MobileNet作为主干特征提取器使模型轻量化;使用Swish激活函数保留图像的负值特征。从而,构建更加精准高效的无人机农田场景语义分割模型。

1 研究方法

1.1 无人机农田场景图像特点

与卫星遥感数据相比无人机更接近地面,获得的图像数据像素高且细节特征丰富,有利于精细地识别地物特征,但是由于其复杂的前景和背景,也给无人机图像数据的语义分割带来了挑战。以图1所示的无人机农田场景为例,背景方面不同种类的对象如垃圾、地膜、裸土等被归为背景,前景方面拥有不同颜色和纹理特征的植物被分为同一类别。要实现无人机农田场景下的精准语义分割,一方面要考虑如何保证更多的细节特征,另一方面还要考虑如何在高分辨率的前提下提高分割效率。

1.2 改进PSPnet语义分割模型

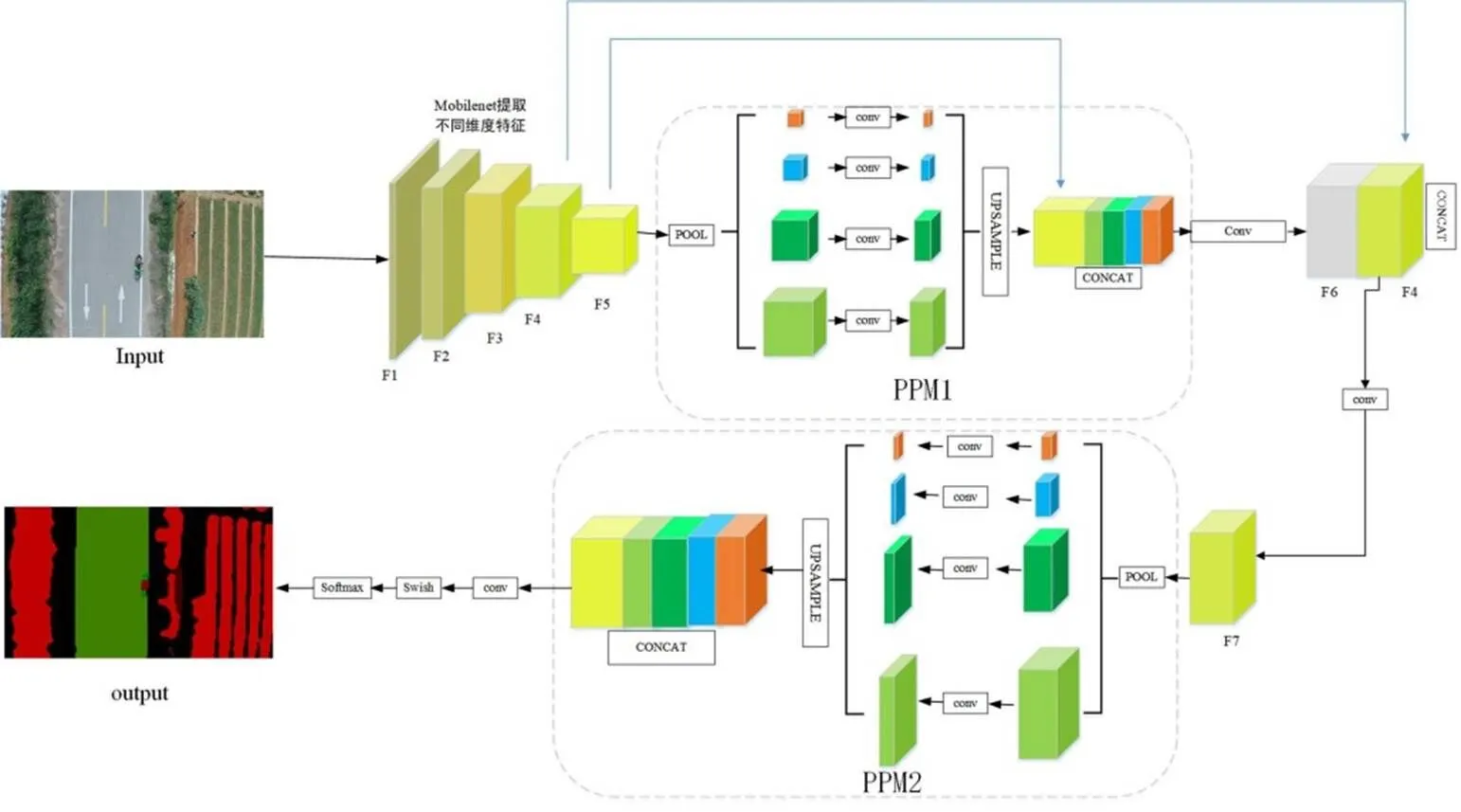

鉴于无人机农田场景下获得的数据具有像素高和细节特征多的特点,想要获得较佳的分割效果,分割模型需要同时兼顾单一特征层的深度解析和不同维度特征的利用。Unet模型[11]采用了Encoder-Decoder结构,其中Encoder进行了4次下采样得到5个特征层,图像大小缩小16倍,Decoder进行了4次上采样将特征层恢复至原图大小,每次上采样前对相同大小不同维度的特征层级联,使不同维度的特征进行融合,最大程度的利用了图像不同维度的特征;PSPnet模型[12]采用了金字塔池化模块,对语义信息丰富的高维特征层进行了深度解析,使该特征层的全局和局部联系共同作用于最终的预测,可以提高图像的分割质量,但是对于细节特征丰富的无人机农田场景图像而言,在解析过程中只对高维特征进行解析难免会丢失图像中的细节,造成分割边缘模糊。为了获得更适合无人机农田场景的语义分割模型,本文借鉴Unet多维度特征级联的方式,并结合深度可分离卷积,以及Swish激活函数等方法,对PSPnet模型进行改进;其整体框架图,如图2所示。

图2 改进PSPnet语义分割模型结构图

从图2可以看出,本文模型的主要流程是:首先,经过以深度可分离卷积为基础的MobileNet进行特征提取,生成从不同维度的特征层;然后,对不同维度的特征层进行场景解析和级联,最后,经过Swish激活函数传入softmax分类器进行像素分类,最终生成分割图像。具体来讲,本文对PSPnet进行了3方面改进:①在利用金字塔池化模块(PPM1)对特征层进行深度解析的基础上,借鉴Unet模型不同维度特征级联的操作,对主干特征提取网络提取到的低维特征进行级联,构建多维度融合的金字塔池化结构,在充分利用特征层全局上下文信息的基础上最大限度地保留图像中的细节特征,从而提高分割准确率;②为减少模型参数量,使用以深度可分离卷积为基本组件的MobileNet为主干特征提取网络构建主干特征提取器,使模型轻量化,提高整个模型的分割效率;③为保留图像的负值特征,将Relu激活函数替换为Swish激活函数,从而提升分割效果。

1.2.1 多维度特征融合的金字塔池化结构

本文借鉴Unet多维度特征级联的方式,在PSPnet模型的金字塔池化模块(简称PPM,Pyramid pooling module)基础上,提出了多维度特征融合的金字塔池化结构,利用多尺度池化操作保留更加全面的全局上下文信息的同时保留更多维度的图像特征。其中PPM将传统的池化操作分解为1×1、2×2、3×3、6×6共4个池化层,4个池化层分别将输入的特征图池化到目标尺寸;然后,通过上采样操作将不同的池化结果恢复到输入大小,并将恢复到统一大小的特征层进行级联;最后,将级联后得到的特征层用于分割操作。多维度特征融合的金字塔池化结构的关键是需要进行多次金字塔池化(如图2中的PPM1和PPM2),保证更多维度的特征能够进行深度解析。具体操作是首先将图片传入主干特征提取器得到F1、F2、F3、F4、F5共5个特征层,其次将包含语义信息最丰富的高维特征F5传入PPM1得到F6,将F6与F4进行级联并经过1×1卷积调整维度得到F7,然后将得到的F7传入PPM2,得到最终的特征层用于分割操作。为便于理解,图2中只显示增加了一个维度上的特征融合,在实际应用中可以根据实际需要进行更多维度上的特征融合。

1.2.2 利用深度可分离卷积神经网络构造轻量化模型

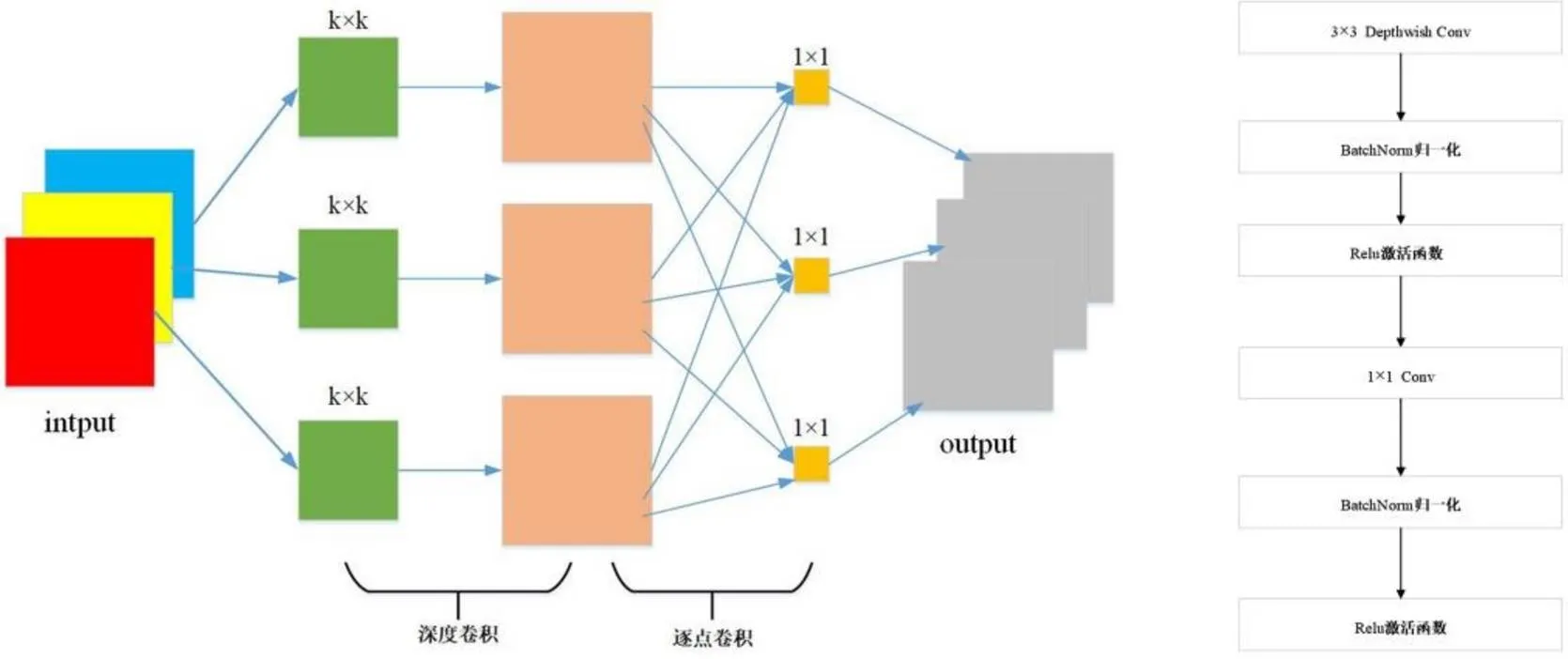

传统的卷积神经网络通过卷积和池化等操作依次的产生从低到高不同维度的特征层,而其强大的特征提取能力是依靠网络层数的不断增加,这样会导致模型参数量剧增,计算复杂度高。Howard等[15]提出的MobileNet网络,采用了深度可分离卷积代替传统卷积,在保持模型性能的同时大大减少了权重参数,提高了运算效率。在MobileNet网络中,深度可分离卷积是基本组件,同时加入了batchnorm归一化操作来提升网络收敛速度,并使用Relu激活函数强化网络训练。深度可分离卷积具体操作和MobileNet的网络结构,如图3所示。

图3 “深度可分离卷积”和“MobileNet”网络结构

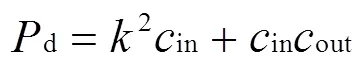

式中:表示卷积核的长度;和分别表示图像的高和宽;in和out分别表示输入图像和输出图像的维度;和d分别表示普通卷积参数量和深度可分离卷积参数量。

与普通卷积不同,深度可分离卷积将普通的卷积过程分为了2个步骤,即深度卷积和逐点卷积。其中深度卷积使用不同的卷积和对输入图像的每个通道进行卷积操作,而逐点卷积采用1×1的卷积核对输入图像进行卷积操作。经式(3)计算可得普通卷积参数量是深度可分离卷积参数量的通道数倍数。本文使用以深度可分离卷积为基础的MobileNetV1网络构建主干特征提取器来改进模型,旨在达到轻量化模型的效果,提高模型的运算效率。

1.2.3 激活函数的改进

在PSPnet模型中,无论是特征提取阶段,还是模型中的其他阶段均使用Relu作为激活函数。虽然Relu凭借其线性非饱和的形式,使得神经网络的训练速度加快,但Relu完全抛弃图像中的负值特征,会使网络学习能力偏低。不同于Relu,Swish激活函数[16]能够提取负值特征信息,进而保留更多的图像特征。Relu函数和Swish函数结构,如图4所示。

从图4可以看出,Swish激活函数具有无上界有下界、平滑、非单调的性质。其线性表示与Relu相似,具备Relu优点的同时,能够收集负值特征。因此本文使用Swish激活函数替换Relu激活函数的方式改进模型,旨在训练出更加优秀的分割模型,适用于前景和背景均比较复杂的无人机农田场景图像。

2 结果与分析

本文训练数据采用Aeroscapes数据集[17]。该数据集中的数据使用商业无人机从5~50 m高度范围内拍摄,包含3 269张720 p的真实图像和语义标签,拍摄场景包括农田、湖泊、桥梁等不同场景。其中的对象包含行人、自行车、汽车、无人机、动物、障碍物、船、建筑、植被、道路、天空等11个类别。本文利用该数据集的农田场景图像为研究对象(从数据集中筛选出农田场景图像623张),从中选取23张有代表性的图像用于模型性能测试。剩余图像做了以下数据增强操作:将原图和标注图分别旋转:90度、180度、270度,将原图和标注图沿垂直方向做镜像操作。经过数据增强后农田场景图像总数扩增为2 400张,按照9∶1的比例将数据分为训练集和验证集。

本文硬件环境为DELL7920工作站(包括2颗至强4210处理器,128 G内存,1 T固态硬盘+4 T硬盘),搭载两块NVIDIA 1080ti显卡(显存22 G)。软件环境:操作系统Ubuntu 20.04,采用tensorflow+keras深度学习框架。训练过程使用迁移学习的思想,下载相应主干特征提取网络MobileNet在ImageNet上的训练权重进行特征提取。epoch为100次,学习率为0.000 1,batch_size为4。利用keras的回调函数ReduceLROnPlateau函数对训练过程中的学习率进行优化,并调用EarlyStopping函数对验证集的损失函数进行监控,当损失值不再减小时停止训练。

为验证本文方法有效性,采用以下评价指标:平均像素准确率(Mean Pixel Accuracy,)、平均交并比(Mean Intersection Over Union,)、训练时间等。具体表示如下:

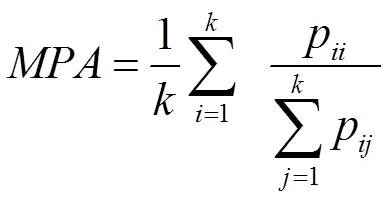

1):表示图像内所有类的平均像素准确率,计算如式(4)所示:

2):交并比(Intersection Over Union,)是指真实像素值和预测像素值2个集合的交集和并集之比。而平均交并比(Mean Intersection Over Union,表示图像像素每个类的值累加后的平均值,计算如式(5)所示:

式中:表示像素的类别数;p表示实际类别为、预测的类别也为的像素的数目;p表示实际类别为、预测的类别为的像素的数目;p表示实际类别为、预测的类别为的像素的数目。

3)训练时间:表示从训练开始到训练结束所用时间,可以评估模型运行速度,以分钟(min)为单位计算。

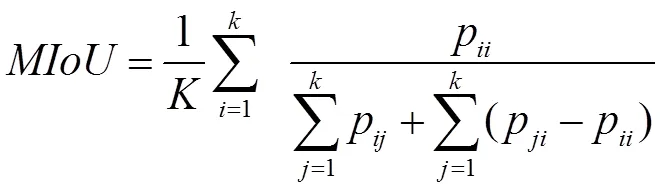

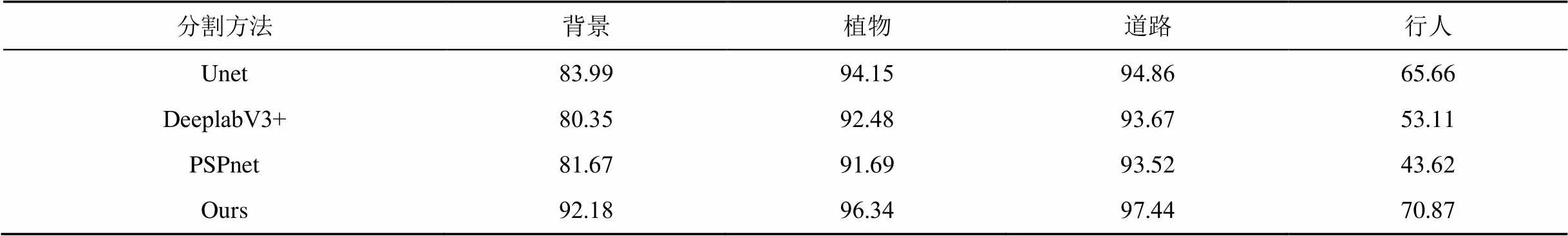

为了验证模型有效性,在相同的训练参数下,将本文方法分别与Unet、DeeplabV3+、改进前的PSPnet等传统的语义分割模型分割结果进行对比。实验选择对比的模型特点如下:Unet对不同维度特征级联,注重特征融合;DeeplabV3+采用扩张卷积的方法扩大卷积操作的感受野,注重场景解析;改进前的PSPnet模型采用池化金字塔模块作用于特征层,也是注重场景解析;本文的方法既注重不同维度的特征融合又注重场景解析,与其他3种方法对于农田场景中常见的植物、道路、行人以及背景等对象的分割情况,如表1所示。

表1 不同模型下不同类别对象的平均交并比

由表1可知,本文方法对背景、植被、道路、行人等农田场景中的常见对象分割,平均交并比达到了92.18%、96.34%、97.44%、70.87%,均优于改进前的PSPnet模型,并且均优于Unet和DeeplabV3+模型的结果。所有模型在不同对象的分割结果上都呈现了“道路>植物>背景>行人”的趋势,说明当对象轮廓明显或特征相对单一时分割比较容易,但是当分割对象比较小或者比较复杂时分割相对困难。对于植物和道路等轮廓清晰、特征相对单一的对象,所有模型的都能够达到90%以上,而本文方法更加有效,将其进一步提升至96.34%和97.44%。对于背景(包括裸土、地膜、垃圾等)和行人(无人机农田场景中的小对象),Unet、DeeplabV3+和改进前的PSPnet的分割效果并不理想,而本文的构建的多维度金字塔池化结构融合了图像多维度的特征,并对多维度特征融合后的结果进行深度解析,将背景和行人的提升至92.18%和70.87%。说明对于复杂对象和小对象,本文构建的多维度融合金字塔池化结构的方法在分割过程中,能够利用更多的细节特征,使分割更加精准。

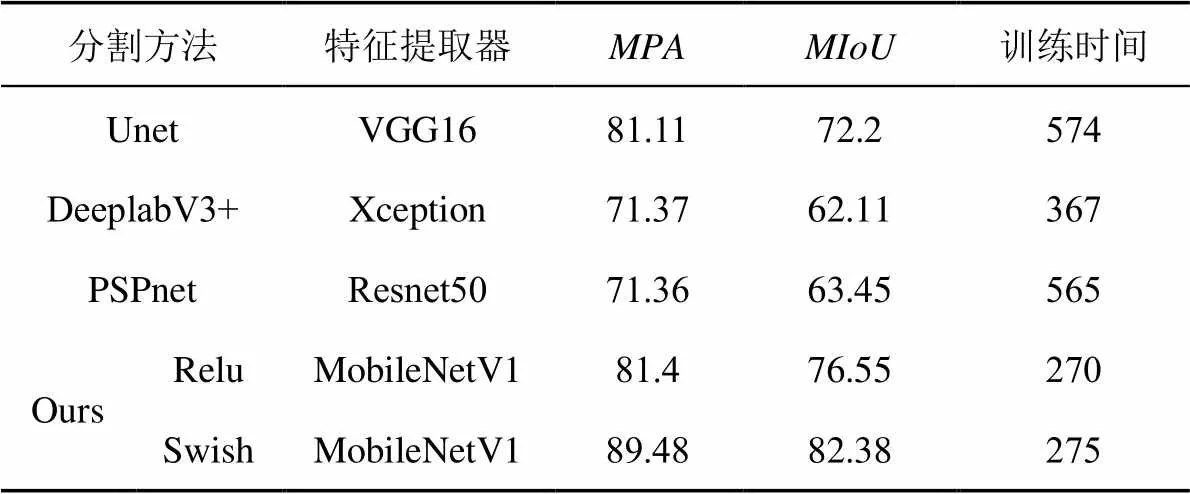

为了评价模型的整体性能,以下从平均像素准确率()、平均交并比()和训练时间几个方面对不同模型进行评价。结果如表2所示。

表2 不同模型的评价参数

由表2可知,Unet、DeeplabV3+和PSPnet三者的比较中,Unet的分割效果较好,Unet在每次上采样前对低维特征进行级联,促进了不同维度特征的融合,可以有效的收集无人机农田场景中的各类小目标和细节特征,但是训练时间较长;而DeeplabV3+和PSPnet二者均属于注重场景解析的模型,在二者的比较中,PSPnet的分割效果较好,说明在无人机农田场景下,金字塔池化模块对图像特征层解析更好;但是DeeplabV3+采用了以深度可分离卷积为基础的Xception网络作为主干特征提取器,训练时间比Unet和DeeplabV3+短,模型效率较高。本文的方法构建了多特征融合的金字塔池化模块,使模型既保证了对高维特征的深度解析,又实现了不同维度的特征融合,保留了更多的图像细节,在使用Relu激活函数时,分割结果比改进前的PSPnet模型提高了10.04%和13.1%,并且均优于Unet模型和DeeplabV3+模型。而且采用Swish激活函数后保留了更多的图像特征,分割结果比使用Relu激活函数的模型进一步提高了8.08%和5.83%。说明本文的方法对PSPnet的改进是有效的。

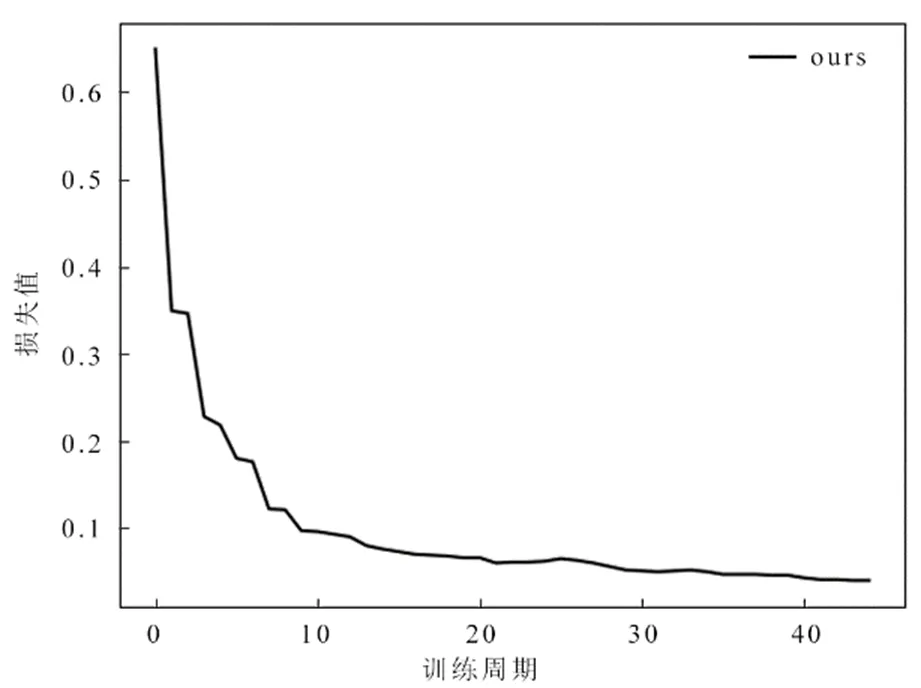

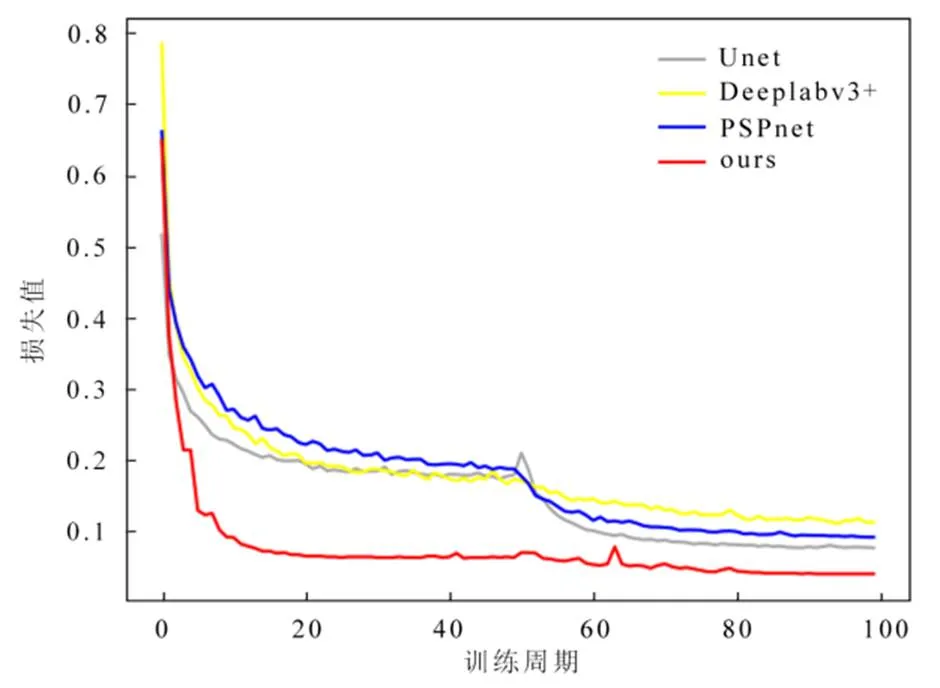

在提升模型效率方面,本文使用以深度可分离卷积为基础的MobileNetV1替代传统卷积神经网络进行特征提取,减少了模型的训练参数,使模型轻量化,改进后的模型训练时间减少49%。在模型收敛速度方面,本文方法的损失值变化趋势如图5所示,不同模型的损失值变化趋势如图6所示。而在不同模型损失变化对比中,为了使模型间的对比更具科学性,所有模型均使用交叉熵损失函数,并且均不使用EarlyStopping函数使训练提前结束。

图5 改进PSPnet模型的损失值变化趋势

图6 不同模型的损失值变化趋势对比

由图5可知,在使用keras的EarlyStopping函数对验证集进行监控,损失值不再减小则训练停止的情况下,改进后的PSPnet模型经过46轮训练即可达到收敛。综合图5、图6可知,相对于其他3种方法,本文方法的损失值下降最快且最平稳,证明了本文方法更加高效。综合表1、表2以及模型的损值失变化情况可知,本文无论分类别指标还是整体指标均优于Unet、DeeplabV3+和改进前的PSPnet,并且训练时间最短,效率最高,证明其更加适用于分辨率高且细节特征多的无人机农田场景。

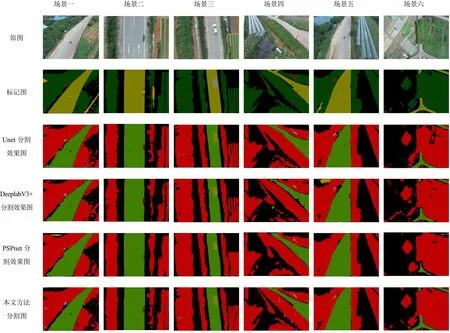

本文模型与其他模型在无人机农田场景下的图像分割视觉结果对比,如图7所示。基于不同的拍摄角度以及不同的拍摄距离,图7选择了6个不同的无人机农田场景图像进行对比。

场景一场景二场景三场景四场景五场景六 原图 标记图 Unet分割效果图 DeeplabV3+分割效果图 PSPnet分割效果图 本文方法分割图

在图7所示的无人机农田场景图像中,既有轮廓较大的对象,如大片相连的植物、大面积的裸土等,又有轮廓较小的对象,如裸土中的细小植物等。由图7可以看出,DeeplabV3+模型存在大对象分割不完整,小对象丢失的情况(如场景二中植物和裸地相间,未识别部分植物),并且在部分场景中存在过度分割(如场景五、场景六)。Unet模型能够识别更多的图像细节(如场景二中植物的行间裸土间隔较小,Unet的分割效果最好),但是对于大轮廓的裸土有边缘丢失的现象(如场景五中部分植物未被正确分割)。PSPnet模型在大的轮廓下对不同对象间的分割效果更好,但是存在细节丢失(场景一至场景六中均存在小对象目标丢失的情况)。相对而言,本文的方法在轮廓大的对象和轮廓小的对象分割方面都能够达到最优结果,分割结果更接近于标注。

3 讨 论

在无人机农田场景中,由于图像采集距离更接近地面,所以获得的图像往往分辨率较高。而且由于不同纹理、颜色等特征的对象可能被分为同一类,所以图像的前景和背景都相对复杂。想要做到对无人机农田场景的有效语义分割,必须同时考虑如何更多地利用图像细节以及如何提高分割模型的效率,本文针对这2个问题对PSPnet语义分割模型进行了改进,取得了一定的进步,但是仍有相应的不足。

3.1 充分利用图像细节特征方面

本文借鉴了Unet模型不同维度间特征级联的操作,构建了多特征融合的金字塔池化模块,在使用特征金字塔模块对高维特征层进行解析后对低维度的特征进行级联,然后再次传入特征金字塔模块进行场景解析。这个操作使模型既保留了图像高维特征层中包含的语义特征,又保留了图像低维特征层中的细节特征,同时又保证了对所有信息的充分解读。

从不同模型间的对比结果看,Unet模型的分割效果优于PSPnet模型和DeeplabV3+模型,说明特征融合在无人机农田场景图像的语义分割中成效明显。而本文的方法正是利用了特征融合的方法改进PSPnet模型,使改进后的模型能够进行充分的场景解析的同时获取更多的细节特征,另外在激活函数方面使用可以收集负值特征的Swish替换Relu,使模型能够更多的收集图像细节。由表1、表2可知,改进后的模型在与改进前的PSPnet、Unet和DeeplabV3+等模型的比较中取得了最好的结果。

不足之处有以下几个方面:首先对于构建的多维度特征融合的金字塔池化模块,改进的方向只是使用了特征融合,并未对PSPnet模型的场景解析模式进行深层次的改进;在激活函数方面,考虑到要对图像负值特征进行收集,但是仅采用了单一的Swish函数进行试验,并未对更多的激活函数做出尝试。针对这2项不足,在接下来的工作中会从改进图像场景解析模式的角度进行更多尝试,使模型更加精准。

3.2 提高模型效率方面

本文使用以深度可分离卷积为基础的MobileNet对模型进行轻量化改进,使模型参数量减少,以此来提高模型效率,另外使用EarlyStopping函数来节省模型训练时间。由表2、图5可知,轻量化改进后的模型训练时间只占改进前的49%,在EarlyStopping函数的情况下模型经过46轮训练即可收敛,模型效率大大提高。图6中的试验结果可知,相比于Unet、PSPnet和DeeplabV3+,本文的模型训练时间最短且收敛速度最快。不足之处是对于深度可分离卷积,本文仅使用了谷歌公司2017年提出的MobileNetV1来提高模型效率,而在深度可分离卷积的应用发展方面,已经拥有了MobileNetV2、MobileNetV3等不同版本的MobileNet,而本文并未做更多尝试。

综上,相比于文中提及的几种深度学习语义分割模型,本文方法更加适合于无人机农田场景下,但是依然有改进的空间。下一步将针对上述问题开展更多对比试验,尝试改进图像场景解析模式,并拓展更多激活函数和深度可分离卷积用法,使模型更加精准高效。

4 结 论

通过构造多维度特征融合的金字塔池化结构,利用深度可分离卷积轻量化分割模型,修改激活函数等3方面改进了PSPnet语义分割模型。将平均像素准确率和平均交并比等指标提高至89.48%和82.38%,训练时间缩短为改进前的49%,且模型收敛速度最快。虽然本文的方法在分割准确率和分割效率上取得了一些进步,但是由于对比试验较少,在网络结构、深度可分离卷积应用以及激活函数应用等方面,依然有改进的空间。

[1] 韩文霆, 郭聪聪, 张立元, 等. 基于无人机遥感的灌区土地利用与覆被分类方法[J]. 农业机械学报, 2016, 47(11): 270-277.

HAN Wenting, GUO Congcong, ZHANG Liyuan, et al. Classification method of land cover and irrigated farm land use based on UAV remote sensing in irrigation[J]. Transactions of the Chinese Society for Agricultural Machinery, 2016, 47(11): 270-277.

[2] 戴建国, 张国顺, 郭鹏, 等. 基于无人机遥感可见光影像的北疆主要农作物分类方法[J]. 农业工程学报, 2018, 34(18): 122-129.

DAI Jianguo, ZHANG Guoshun, GUO Peng, et al. Classification method of main crops in northern Xinjiang based on UAV visible waveband images[J]. Transactions of the CSAE, 2018, 34(18): 122-129.

[3] WU M Q, YANG C H, SONG X Y, et al. Evaluation of orthomosics and digital surface models derived from aerial imagery for crop type mapping[J]. Remote Sensing, 2017, 9(3): 239.

[4] 刘丹, 刘学军, 王美珍. 一种多尺度CNN的图像语义分割算法[J]. 遥感信息, 2017, 32(1): 57-64.

LIU Dan, LIU Xuejun, WANG Meizhen. Semantic segmentation with multi-scale convolutional neural network[J]. Remote Sensing Information, 2017, 32(1): 57-64.

[5] 杨丽丽, 陈炎, 田伟泽, 等. 田间道路改进UNet分割方法[J]. 农业工程学报, 2021, 37(9): 185-191.

YANG Lili, CHEN Yan, TIAN Weize, et al. Field road segmentation method based on improved UNet[J]. Transactions of the Chinese Society of Agricultural Engineering, 2021, 37(9): 185-191.

[6] YANG Q C, LIU M, ZHANG Z T, et al. Mapping plastic mulched farmland for high resolution images of unmanned aerial vehicle using deep semantic segmentation[J]. Remote Sensing, 2019, 11(17): 2 008.

[7] 杨蜀秦, 宋志双, 尹瀚平, 等. 基于深度语义分割的无人机多光谱遥感作物分类方法[J]. 农业机械学报, 2021, 52(3): 185-192.

YANG Shuqin, SONG Zhishuang, YIN Hanping, et al. Crop classification method of UVA multispectral remote sensing based on deep semantic segmentation[J]. Transactions of the Chinese Society for Agricultural Machinery, 2021, 52(3): 185-192.

[8] 李云伍, 徐俊杰, 刘得雄, 等. 基于改进空洞卷积神经网络的丘陵山区田间道路场景识别[J]. 农业工程学报, 2019, 35(7): 150-159.

LI Yunwu, XU Junjie, LIU Dexiong, et al. Field road scene recognition in hilly regions based on improved dilated convolutional networks[J]. Transactions of the Chinese Society of Agricultural Engineering, 2019, 35(7): 150-159.

[9] 易诗, 李俊杰, 贾勇. 基于红外热成像的夜间农田实时语义分割[J]. 农业工程学报, 2020, 36(18): 174-180.

YI Shi, LI Junjie, JIA Yong. Real-time semantic segmentation of farmland at night using infrared thermal imaging[J]. Transactions of the Chinese Society of Agricultural Engineering, 2020, 36(18): 174-180.

[10] LONG J, SHELHAMER E, DARRELL T. Fully convolutional networks for semantic segmentation[J]. IEEE Transactions on Pattern Analysis and Machine Intelligence, 2015, 39(4): 640-651.

[11] RONNEBERGER O, FISCHER P, BROX T. U-net: Convolutional networks for biomedical image segmentation[C]//Medical Image Computing and Computer-Assisted Intervention - MICCAI 2015, 2015: 234-241.

[12] CHEN L C, ZHU Y K, PAPANDREOU G, et al. Encoder-decoder with atrous separable convolution for semantic image segmentation[C]// Computer Vision - ECCV 2018, 2018: 833-851.

[13] ZHAO H S, SHI J P, QI X J, et al. Pyramid Scene Parsing Network[J]. IEEE Computer Society, 2016: 6 230-6 239.

[14] LIN T Y, DOLLÁR P, GIRSHICK R, et al. Feature pyramid networks for object detection [EB/OL]. 2016: arXiv: 1612.03144 [cs.CV]. https://arxiv.org/abs/1612.03144

[15] HOWARD A G, ZHU M L, CHEN B, et al. MobileNets: Efficient convolutional neural networks for mobile vision applications[EB/OL]. 2017.

[16] RAMACHANDRAN P, ZOPH B, LE Q V. Searching for activation functions[EB/OL]. 2017: arXiv: 1710.05941 [cs.NE]. https://arxiv.org/abs/1710.05941

[17] NIGAM I, HUANG C, RAMANAN D. Ensemble knowledge transfer for semantic segmentation[C]//IEEE Winter Conference on Applications of Computer Vision. IEEE, 2018.

An Improved PSPnet Model for Semantic Segmentation of UAV Farmland Images

LIU Shangwang1,3, ZHANG Yangyang1,2,3, CAI Tongbo1,3, TANG Xiufang1,3, WANG Changgeng1,3

(1. College of computer and information engineering, Henan Normal University, Xinxiang 453007, China;2. Farmland Irrigation Research Institute, Chinese Academy of Agricultural Sciences, Xinxiang 453002, China;3. Henan Engineering Laboratory of ‘Smart Business and Internet of Things Technology’, Xinxiang 453007, China)

【】Deep Learning is an important method in artificial intelligence but has limited applications in agriculture. This paper aims to fill this technology gap based on farmland images acquired using unmanned aerial vehicle (UAV) and the PSPnet segmentation method. 【】Different dimensional features in the UAV images were concatenated based on the principle of preserving as many detailed image features as possible via the enhanced scene analysis. A lightweight semantic segmentation model was built using the deep separable convolution module. Finally, the activation function was replaced to improve the segmentation effect of the model. 【】Experimental results show that the mean pixel accuracy and the mean intersection over the union of our proposed method are 89.48% and 82.36%, respectively, and their associated segmentation accuracy was improved by 18.12% and 18.93%, respectively. Overall, the segmentation of the proposed method was better than that of Unet and DeeplabV3+.【】The proposed method can effectively segment the farmland images acquired by UAV.

PSPnet; semantic segmentation; feature concatenate; deep separable convolution; activation function

1672 - 3317(2022)04 - 0101 - 08

TP753

A

10.13522/j.cnki.ggps.2021406

刘尚旺, 张杨杨, 蔡同波, 等. 基于改进PSPnet的无人机农田场景语义分割[J]. 灌溉排水学报, 2022, 41(4): 101-108.

LIU Shangwang, ZHANG Yangyang, CAI Tongbo, et al. An Improved PSPnet Model for Semantic Segmentation of UAV Farmland Images[J]. Journal of Irrigation and Drainage, 2022, 40(4): 101-108.

2021-08-26

河南省高等学校重点科研项目(21A520022)

刘尚旺,男。副教授,博士,主要研究方向为计算机视觉、图像处理。E-mail: shwl08@126.com

责任编辑:赵宇龙