基于眼球定位和头盔定位的综合视线跟踪技术*

2022-03-23黄耀锋黄丽琼尚婷婷赵逢元

黄耀锋,黄丽琼,尚婷婷,王 芳,赵逢元

(西安北方光电科技防务有限公司,西安 710043)

0 引言

头盔定位属目视目标跟踪定位技术,实时计算头部运动信息,获取头盔瞄准线相对于飞机轴线的空间角度,利用飞行员头部转动灵活、快速的特点,引导导弹、雷达、稳瞄等武器装备快速截获目标,有效地提高了飞行员的战斗效率,其在航空火控领域有着重要地位。但单纯的头盔定位存在的主要问题是:1)只运用了头部位置变化,未发挥人眼视线在瞄准过程中的作用;2)具有一定的跟踪范围和响应速度的限制;3)飞机加速运动条件下,飞行员的头部和手部活动受到极大限制。这些问题制约了目视目标跟踪定位技术的进一步发展。

人眼在瞄准追踪目标时,先是眼球快速转向目标,然后头部才会转向目标,即眼球移动先于头部移动[1]。但目前国内现役战机装备的头盔瞄准系统,其瞄准线与头盔是固连的,只能依靠头部的转动改变方向,还没有做到瞄准线与视线保持一致,这使得瞄准速度还不够快捷灵敏。另外,人眼依靠机载设备观察时,观察设备随动的是头盔,而不是人眼,这不符合人眼观察和获取信息的习惯[2-4]。

虽然眼球定位在速度和飞行员观察习惯上有很大的优势,是更加符合观察和瞄准习惯的目视目标定位技术,但由于眼睛的运动平台是人的头部,不与头部(头盔)定位相结合的单纯眼球定位没有实际使用价值。

基于眼球定位和头盔定位的综合视线跟踪系统包括:头盔跟踪定位子模块、眼球跟踪定位子模块和综合视线跟踪子模块。

1 头盔跟踪定位子模块

头盔定位的过程是利用头盔(头部)运动来获得目标位置(驾驶员瞄准线)相对于飞机轴线的空间角度的过程。图像式头盔跟踪定位模块包括头盔部件、传感器部件和电子部件。其中,头盔部件集成了红外LED和头盔驱动盒,头盔驱动盒中的电路驱动板驱动LED 阵列。通过左、右传感器部件实时拍摄头盔定位LED 阵列的位置,然后经过电子部件进行空间位置解算,实时计算头部运动信息,从而获取头盔视线相对于飞机轴线的空间角度。

图像式头盔跟踪技术已成熟地应用于列装产品中,所以,本文主要阐述眼球定位模块及其与头盔跟踪定位方式的组合。

2 眼球跟踪定位子模块

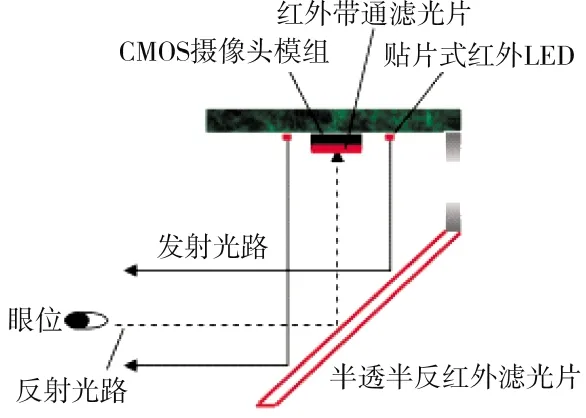

眼球跟踪定位技术,是利用机械、电子、光学等各种检测手段获取受试者当前“视觉注意”(注视)方向的技术[2]。系统由头盔、眼动传感组件、视轴检测电路等3 部分构成,其中,眼动传感组件包括单环红外光源、红外带通滤光片和眼动摄像机。眼动传感组件组成原理如图1 所示。

图1 眼动传感组件组成原理图

单环红外光源采用贴片式红外LED,并采用体积和重量均非常小的CMOS 摄像头模组,有效减小了装置的体积和重量,克服了现有技术采用亮/暗瞳差分方案硬件复杂、体积和重量过大而无法装备于头盔瞄准显示器的缺点。通过合理选用元器件,设计体积小、重量轻、视场无遮挡的眼球定位系统。

眼球跟踪定位过程如下:

1)眼动摄像机在单环红外光源的辅助照射下,采集眼部瞳孔图像,通过图像处理得到瞳孔中心的像素坐标(Xt,Yt);

2)将像素坐标(Xt,Yt)代入视线方向映射模型,得到视线注视的目标点在屏幕上的像素坐标(mt,nt),根据公式tan(AZt)=smt/L,tan(ELt)=snt/L,解算得到视线相对头盔瞄准线的方位和俯仰角(AZt,ELt),其中,s为屏幕上一个像素对应的实际尺寸,L为眼睛距离屏幕的垂直距离。

为使眼球跟踪定位能实时、客观、准确地记录受试者当前的视线方向或视线落点位置,在跟踪之前需要解决视线方向映射模型的标定问题;在跟踪过程中需排除环境光照影响和人眼无意识的抖动等因素,进行稳定防抖动的跟踪;最后,由于人眼运动的随意性和快速性,需要研究掌握眼动规律,针对性地进行处理,进行眼球运动的“主动预测”,从而达到高效可靠眼球跟踪的目的。

2.1 视线方向映射模型的标定

在进行眼球跟踪定位前,需要对视线跟踪系统进行标定,确定视线方向映射模型若干待定参数的过程。操作者面部及眼睛生理特征、拍摄眼睛图像的摄像机相对眼睛的位置等因素决定这些待定参数的取值[5]。标定过程如下所述:

首先,移动标定屏幕上的标定符号,直至测试人员平视正前方时恰好注视到标定符号,以此时测试人员眼部与标定符号的连线方向为视线零位方向;

其次,控制屏幕上依次显示N个标定符号,且已知N个标定符号在屏幕上的像素坐标和相对于视线零位方向的方位和俯仰角度。第i次显示的标定符号在屏幕上的像素坐标为(mi,ni),相对于视线零位方向的方位和俯仰角度为(AZi,ELi);当屏幕显示第i个标定符号时,根据过程a计算其在瞳孔图像中的像素坐标为(Xi,Yi),i=1,2,3,…,N。N个标定符号按照椭圆形呈现不均匀分布,所述椭圆形是以视线零位方向为中心的椭圆形,接近视线零位方向的区域标定符号分布稀疏,远离视线零位方向的区域标定符号分布密集。

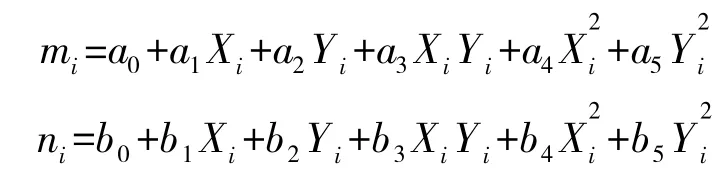

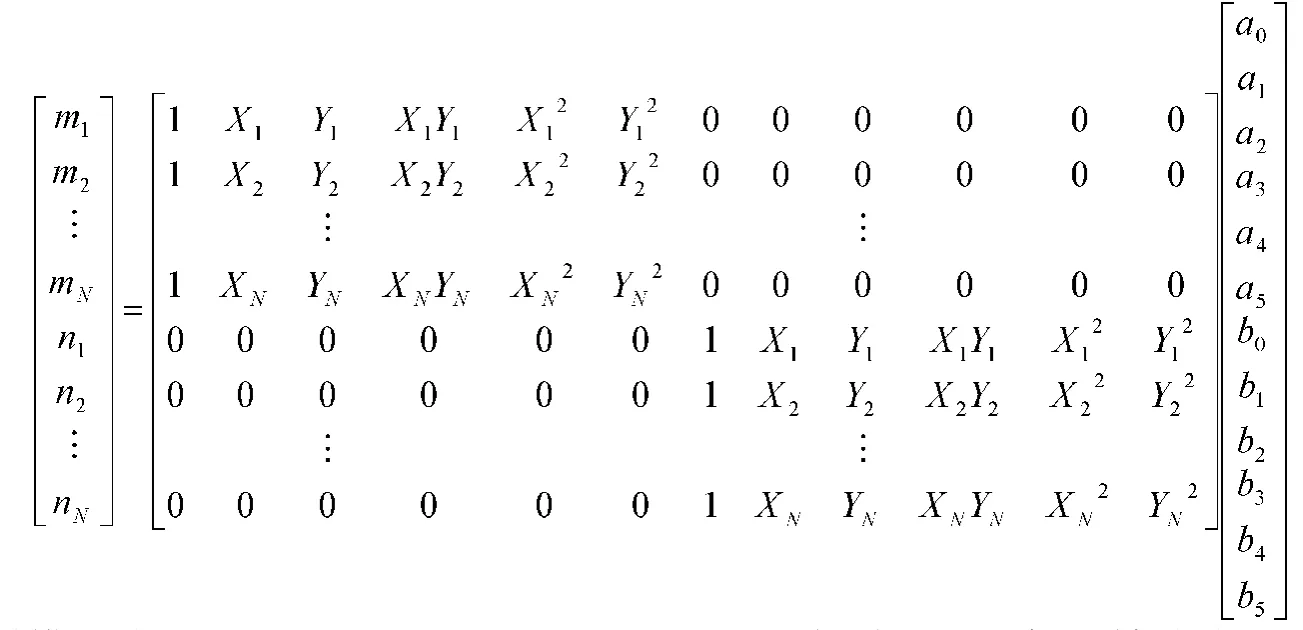

最后,将数据(mi,ni)以及(Xi,Yi),i=1,2,3,…,N代入视线方向映射模型得到并求解如下超定方程组:

其中,视线方向映射模型为:

得到视线方向映射模型待定参数a0、a1、a2、a3、a4、a5、b0、b1、b2、b3、b4、b5。

2.2 稳定防抖动

影响眼球定位稳定性的因素主要来自3 个方面:光照变化、眨眼和睫毛干扰、眼球无意识抖动[6]。

针对光照变化影响定位稳定性的问题,采用均衡直方图概率累加方法确定阈值,这是一种自适应的分割方法,解决了从人眼图像中分割瞳孔时,位于滤光片通带以内的背景辐射干扰和单环红外光源驱动电路电流波动干扰的问题,即使背景辐射和驱动电流实时变化,分割成功率在99%以上。

针对眨眼和睫毛干扰问题,基于大量实验数据,通过分析眨眼和睫毛干扰的统计特征,完成眨眼和睫毛干扰识别。

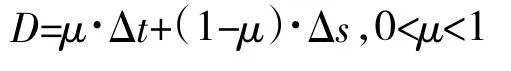

针对跟踪抖动问题,提出了基于时空距离的参考帧防抖方法,定义时空距离:

当D>Dth时,将参考帧眼球中心(Xref,Yref)更新为当前帧眼球中心;当D<Dth时,参考帧眼球中心(Xref,Yref)保持不变。系统始终输出自参考帧提取的眼球位置信息,第1 帧既是参考帧又是当前帧。其中,Dth为区分瞳孔抖动与正常运动的阈值;Δt为参考帧至当前帧的时间间隔,Δs为参考帧眼球中心与当前帧眼球中心之间的欧氏距离;Dth和μ均存在,并且可以根据实验确定。

眼球定位整体方案中,提出“重心法+单帧独立跟踪”方法,即每一帧均走一遍“预处理-分割-定位-特征提取”的流程,使各帧跟踪效果独立,互不干扰,克服了现有跟踪方法当前跟踪结果与上一次跟踪结果相关,产生误差传递的缺点,从而解决了眼球定位的稳定性问题。

2.3 眼动规律研究

人眼的转动非常随意和快速,并且时刻伴随着眼球的高频振动[7],眼动的灵活性将带来不可靠和瞄准标志控制不随心所欲的问题,所以,必须掌握眼球的运动规律,研究高效可靠的头盔眼跟踪技术,实现瞄准标志的随意控制。

精确定位瞳孔中心,准确区分眼姿势,研究对眼位运动的“主动预测”[8],是成功实现高效可靠眼位跟踪的基础。这就需要建立代表眼睛运动本质的定量表征体系,主要包括:瞳孔运动、眼姿势的定量表征体系;有意眼动、无意眼动的规律及其机理;眼睛注视、眼跳和平滑追随运动3 种基本行为模式的运动规律及其机理。

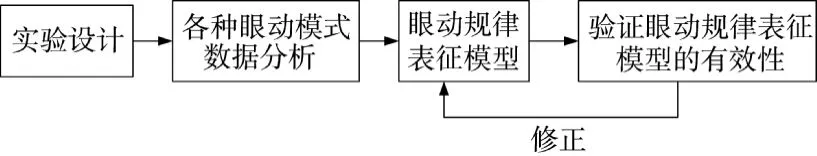

研究眼动规律的具体实施途径:首先,建立眼动仿真环境,为眼动实验提供基础条件;采用眼跟踪系统采集眼动样本,应用模式识别和数字图像处理技术分析样本中的变量和不变量,建立眼动及各种眼姿态下易识别的、稳定的物理量/统计量(眼动表征体系);采用智能算法,应用样本不断修正表征体系并检验表征体系的科学性,将图像采集的眼动位置映射到显示坐标系,完成驾驶员眼球对瞄准目标的随意控制。

图2 建立眼动规律表征模型的流程框图

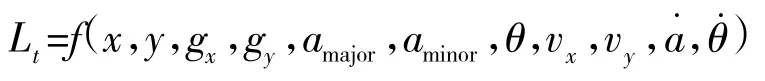

对各类眼动模式的显著特征进行分析,眼部表征特征主要包括瞳孔、瞳孔椭圆、瞳孔椭圆中心、瞳孔椭圆长轴与垂直方向的角度、角膜矢量、眼球中心与眼睑间的距离等;眼球运动特征主要包括:瞳孔椭圆在x和y方向的运动速度、瞳孔-角膜矢量的变化率、瞳孔椭圆长轴与垂直方向的角度变化率等。瞳孔的运动状态Lt主要可由15 个状态特征变量表征:

其中,x,y为瞳孔中心位置;gx,gy为角膜反射光点;amajor,aminor为瞳孔椭圆的长轴和短轴;θ为瞳孔椭圆长轴与垂直方向的角度;vx,vy为瞳孔椭圆在x,y方向的运动速度;a˙为瞳孔椭圆尺度的变化率;θ˙为θ的变化率。Lt的变化能充分反映眼球运动,为视线方向估计提供了依据,从而对眼位运动进行主动预测。

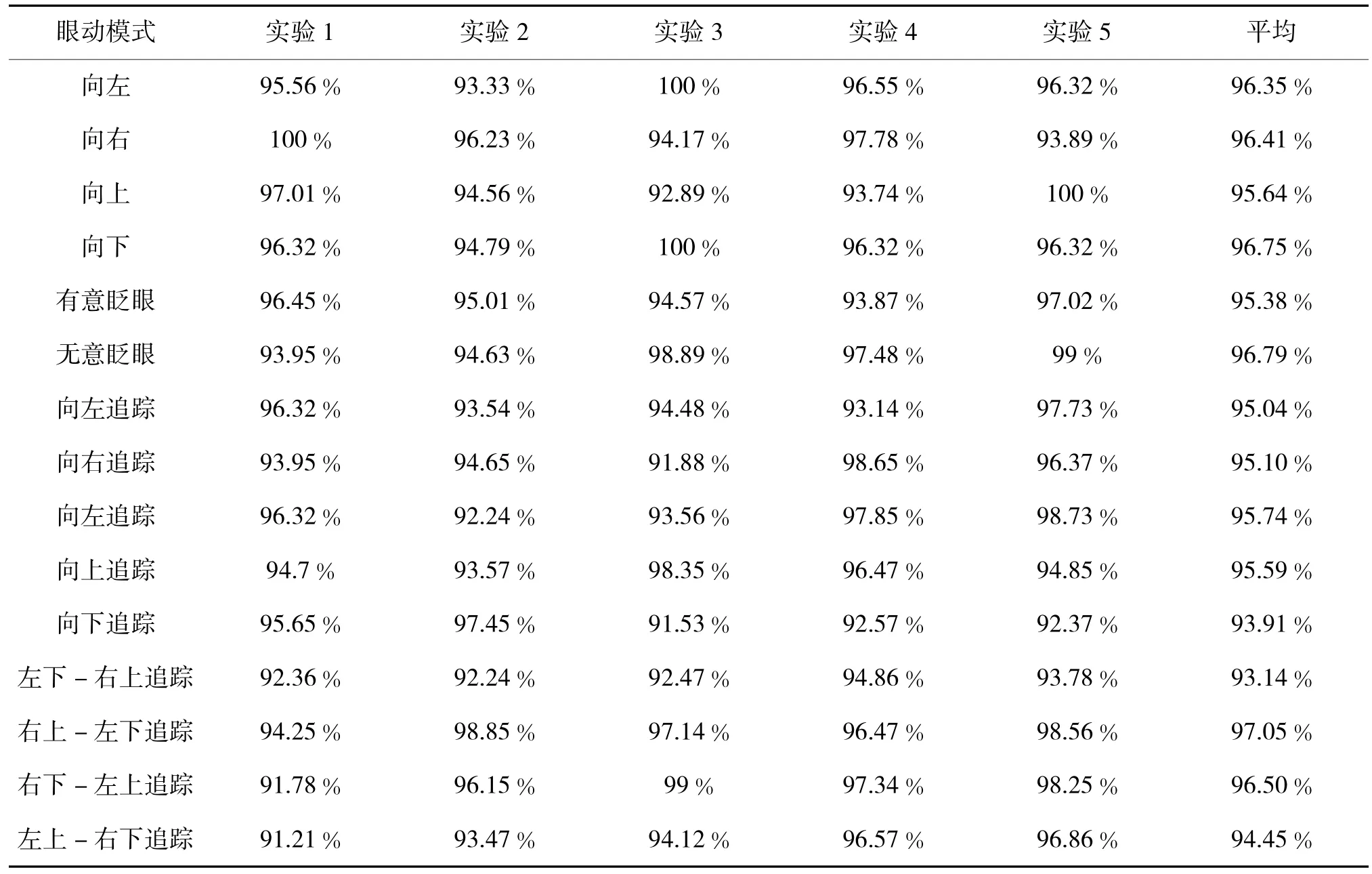

采用支持向量机(SVM)来验证建立的表征模型的有效性,使用眼跟踪系统采集到的每个样本均可用眼动表征模型Lt表示,只是具体表征模型参数不同。针对每种眼动模式使用SVM 算法,采用高斯核函数将Lt进行高维变换后进行分类。学习完成后执行SVM 分类,得出眼动模式的识别准确度如表1 所示。实验结果表明,基于眼动规律表征模型的眼动模式分类取得不错的效果,平均识别率达到93%以上,则说明眼动表征模型的建立有效,为眼动在人机交互中的应用奠定了基础。

表1 眼动模式的识别准确度

3 综合视线跟踪子模块

在头盔定位和眼球定位各自完成后,综合跟踪技术通过坐标变换,最终获得视轴相对于飞机轴线的指向数据,实现了通过检测视线方向来测量人的注意力,综合运用了人的视觉、认知和注意力,使飞行员可以真正通过眼睛瞄准目标,并控制火控系统,用于武器系统和观察设备搜索、跟踪控制过程。综合视线跟踪把人的视线引入火力控制系统,实际上是把受人脑控制的眼睛作为“智能探测器”引进火控回路[9]。

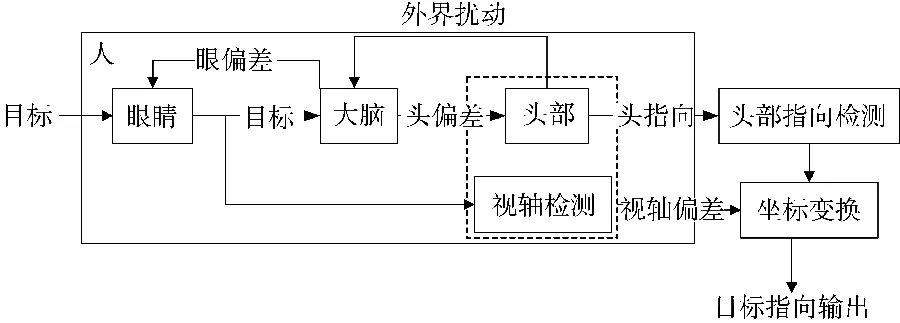

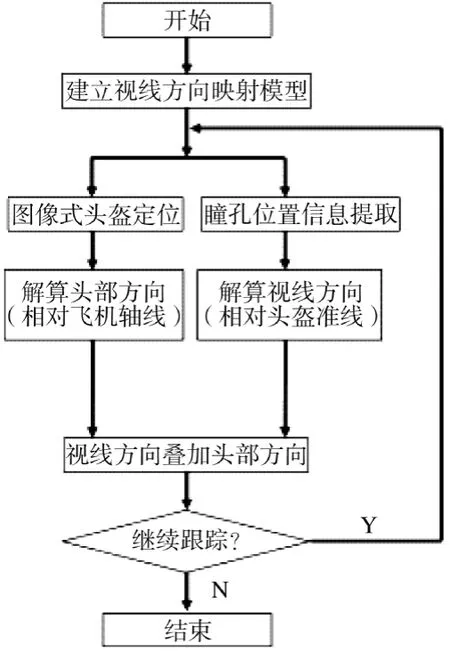

如图3 所示,视轴检测电路通过眼动摄像机拍摄到的眼睛图像解算出视轴坐标,坐标变换电路同时接收视轴坐标和头盔指向,完成坐标变换、输出目标在飞机坐标系的目标指向。其系统流程图如下页图4 所示。

图3 眼球定位+头盔定位模型

图4 基于眼球定位和图像式头盔定位的综合视线跟踪方法

将头盔定位得到头盔瞄准线相对飞机轴线的方位和俯仰角,与眼球定位得到视线相对头盔瞄准线的方位和俯仰角叠加,采用方向余弦进行坐标系转换实现[10]。

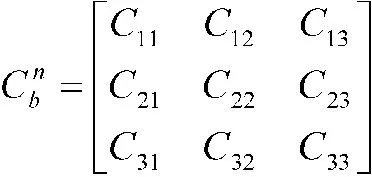

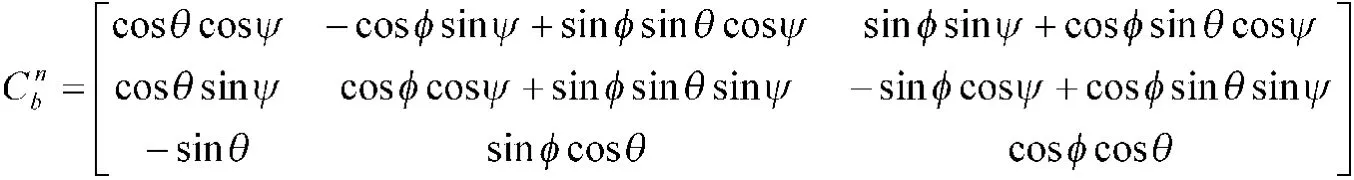

设需要进行转换的坐标系分别为b坐标系和n坐标系,则方向余弦矩阵用符号表示,是一个3×3 的矩阵,矩阵的列表示b坐标系中的单位矢量在n坐标系中投影。的分量形式如下:

第i行、j列的元素Cij表示n坐标系i轴和b坐标系j轴夹角的余弦。并且Cij可以由绕b 坐标系的欧拉转动角表示:

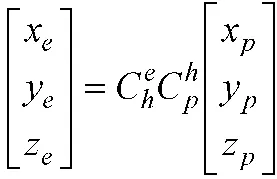

其中,(xe,ye,ze)、(xp,yp,zp)分别为空间同一点在眼睛瞄准线e系、飞机轴线p系的坐标。

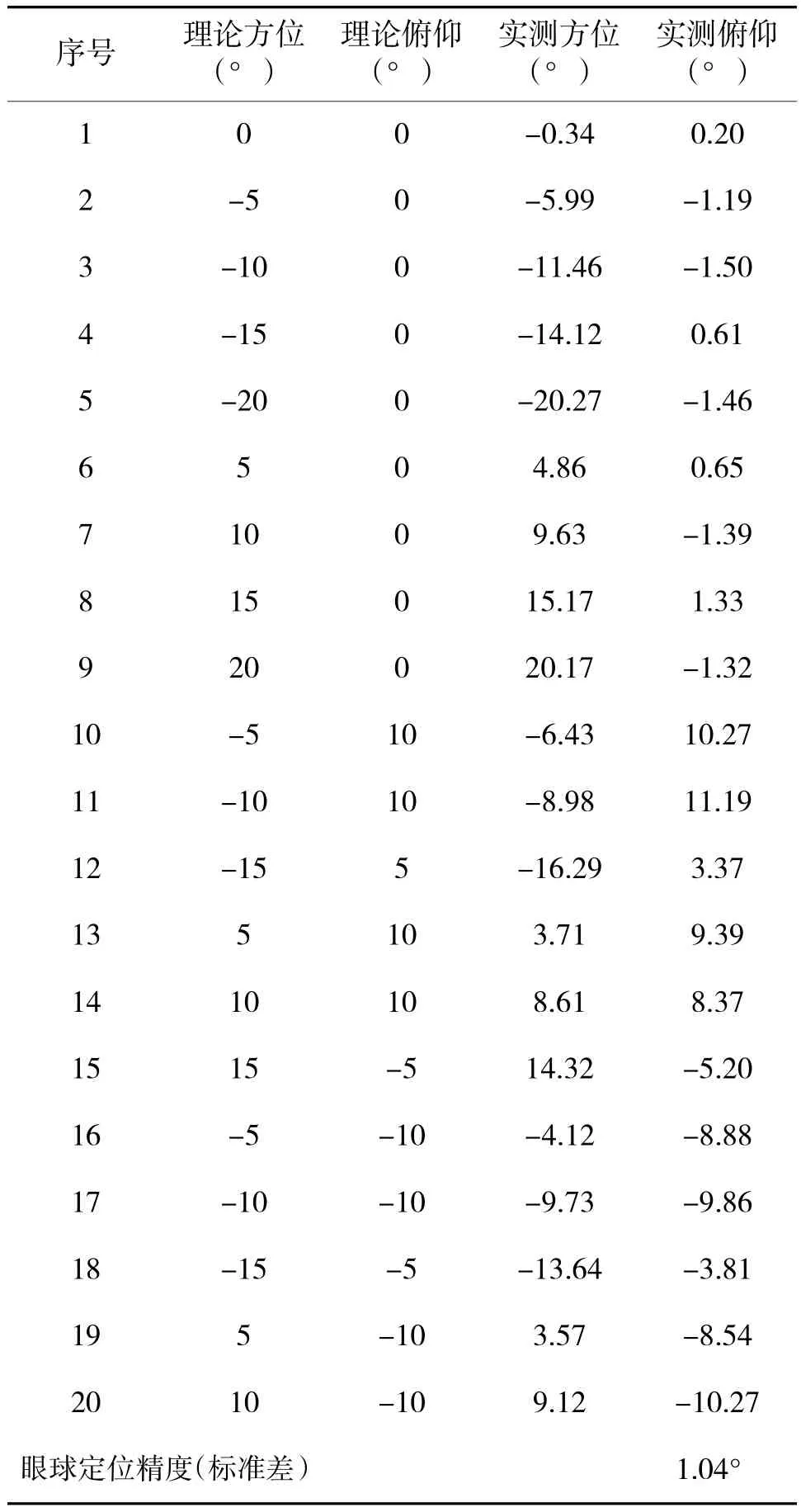

综合视线跟踪性能仿真测试由于人眼在回路中,所以,单独测试头盔定位精度和眼球定位精度。头盔定位仿真测试在六轴测试台上进行,测试方法成熟,测试精度稳定。眼球定位测试包括眼球跟踪系统、全息投影屏幕、投影仪等,选取25 个测试点进行眼部视界范围和跟踪精度测试。眼球定位精度测试结果如表2 所示。

表2 眼球定位精度测试

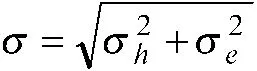

头盔定位和眼球定位测量的随机误差互不相关,根据误差合成的基本规律和基本方法,采用方和根法测量综合视线定位误差[11]:

其中,σ为综合视线定位标准差,σh为头盔定位标准差,σe为眼球定位标准差。实际测得σh为0.43°,σe为1.04°,则总误差σ为1.13°。

4 结论

图像式头盔定位精度高,解算稳定可靠,技术成熟度高,在国内外多型号飞机上列装。并且由于国内飞机座舱电磁环境的复杂性,电磁式头盔定位系统无法满足头盔定位精度需求,国内飞机多装备图像式头盔。

综合视线跟踪技术在图像式头盔定位系统的基础上增加眼球定位系统,从眼动图像中提取瞳孔特征向量,将其输入标定好的视线方向映射模型,实时解算出相对于头盔瞄准线(眼睛稳定正视时的视线)的视线方向。由于人眼运动的复杂性,通过采用稳定防抖动技术及对眼动规律的研究,实现眼球的实时、稳定跟踪,在环境光变化、眨眼、睫毛、眼球无意识随机抖动的情况下,仍能完成眼球的亚像素准确定位。跟踪正确率93%以上;帧速可达60 帧/s,最高可达到120 帧/s。

集成综合视线跟踪技术的头盔显示器,相比于单纯的头盔定位能更快速地定位目标,尤其在空空格斗时有高过载的情况下,飞行员有时不能转动他们的头部,但可以一直使用他们的眼睛去跟踪。并且在多目标搜索情况下,眼位置和头部位置保持着一定的角偏离。因此,眼跟踪具有实际应用上的巨大价值。综合视线跟踪技术使飞行员和飞机融为一体,实现目视过程和自动跟踪过程的有机结合,使战机更加快速地跟踪目标、锁定目标并准确地对目标进行攻击,在格斗中赢得宝贵时间,增加获胜机会,从而提高战机的生存能力和作战能力。