基于数字媒体技术的图像融合算法分析

2022-02-28韩晓娟

韩晓娟

晋中职业技术学院,山西 晋中 030600

0 引言

随着我国技术水平不断提高,数字媒体技术逐渐进入人们的视野,其主要使用信息技术以及通信技术,全面处理图像、文字等信息,最终将信息转化成数据。图像融合主要是把具有不同成像理念设备所收集的图像进行相互融合,以下是图像融合算法的具体分析。

1 图像融合概述

1.1 图像融合的概念

图像融合最早出现在20世纪,其是一种不同传感设备可视信息部分的融合,通过将不同设备收集到的图像经过统一的图像处理,提取所需要的数据信息,最后将其形成统一的图像,以此为后续工作提供较大的便利。图像融合综合了较多的技术形式,例如:图像处理、信息处理、数据显示以及人工智能等。由于图像融合技术具有一定的数据探测性,因此,在世界上技术发展较快的国家逐渐受到较高程度的重视,并产生了较为良好的成绩。图像融合形式一般可以分为以下几种:不同传感器在不同时间收集到的图像进行融合;不同传感器在相同时间收集到的图像进行融合;单一传感器在不同时间,或是不同地点下收集到的图像进行融合。图像融合可以高效地利用上述场景或时间收集图像信息,结合精准的融合算法形成所需要的图像,以此对其进行后续检测、分析和跟踪。将两个传感设备看作A和B,形成信息构成图(图1)。

图1 多源图像的信息构成

通过图像融合技术可以使图像中相关信息更加明显,并逐渐提高图像的精准性,从而使图像中目标更加清晰,由此看来,这种计算方式可以获得更加可靠的数据结果,进一步使该系统具有较强的实用性。与此同时,数据融合可以最大限度地提高图像的分辨率,避免出现图像模糊不清的情况,并的改善图像分类性。在此基础上,图像融合在层次上有明显的分类,主要可以划分为:像素级、特征级以及决策级。

现如今,通过运用图像融合技术对图像进行处理,具有以下关键目的。①获取图像中更多的信息,提高图像的分辨率,避免出现传感设备收集到的图像模糊不清的问题。②合理改善图像空间分辨率,使图像中光谱信息逐渐加强,从而为后续图像识别工作提供便利。③将不同图像根据场景变化情况进行合理分类。④可以将不同图像进行融合,使其形成立体感较强的三维图像,上述这种方式主要应用在立体投影、数据测量等工作领域中。⑤根据其他传感设备图像,收集所丢失的图像信息。根据以上目的来看,图像融合技术与其他图像技术不同,其具有更强的创新性以及准确性,从而在短时间内成为图像处理领域中全新的技术形式[1]。

1.2 图像融合的层次

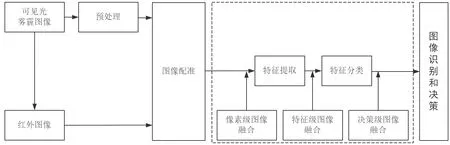

在不同融合应用过程中,由于应用方式、所运用的数据信息,以及融合处理工作前对数据处理程度不同,使融合系统要在不同层次上,对数据信息进行针对性处理,每个层次都有相对应的数据级别。结合数据形式来看,可以将图像融合系统分为三个部分:像素级、特征级以及决策级。融合层次在一定程度上直接影响着算法形式、适用范围。图2是在图像处理工作过程中,图像融合所代表的层次信息。

图2 不同层次的多源图像融合示意图

2 图像融合过程

图像融合在一定程度上主要是指将使用方式不同的传感设备收集到的场景图像,通过图像融合算法计算得出精准性较高的新图像,图像融合过程大多包含以下几个方面。

2.1 图像预处理

图像预处理主要是将两张或两张以上的图像进行事先处理,所处理的图像一般来自不同使用方式的传感设备,图像预处理过程主要包括图像去噪声、图像增强以及图像配准等流程,上述过程的关键就是全方位提高所有图像的对比度以及识别度[2]。

(1)图像校正。图像校正主要可以划分成几何校正、灰度校正。结合几何校正来看,其主要理念就是通过已经获取的数据,也就是根据坐标之间的数据关系以及相关系数,使其作为其他象限的基础。几何校正的方式一般是先建立针对性的数学模型,再根据相关图像信息明确模型中的参数数据,最后结合图像进行几何对比。实际流程可以划分为两步。第一,变换图像对应的坐标,建立适当的坐标体系以及坐标点,使二者形成映射,从而解决上述关系中的参数数据,最后结合映射对坐标进行调整。第二,明确掌握不同像素之间的灰度值。与此同时,结合灰度校正来看,根据图像自身的不同情况以及需要的不同特点选择相对应的修正方式。

下列是使用较多的三种方式。第一,灰度级别校正。由于图像之间存在曝光不清楚的问题,这种现象会使图像变得忽明忽暗,为了解决上述问题,可以对于图像进行适当的灰度级别校正,从而保证图像在灰度上均匀分布。第二,灰度变换。由于部分图像存在曝光不均匀的问题,因此可以运用灰度变换的方式,其能够最大限度提高图像之间的对比度。第三,直方图修正。这种方式能够为图像有均匀灰度提供关键保障,进而有针对性选择需要的部分图像,以此满足不同需要。

(2)图像滤波技术。在图像收集过程中,由于图像会受到周围地理位置、环境、使用设备以及电压等不同因素的影响,图像收集工作极容易受到信号的干扰,上述信号就是生活中的噪声,会或多或少对图像造成干扰。其中,最相似的干扰特点就是导致图像分辨率降低,使图像变得更加模糊,甚至出现图像目标无法呈现的问题,从而对后续图像分析、处理工作造成较大影响。上述噪声具有较多的种类,分类标准也各有不同。例如,根据噪声产生情况,可以划分为外部噪声以及内部噪声;根据噪声分布情况来看,可以分成随机噪声以及校验噪声;根据噪声与信号之间的相互影响,可以划分成加性噪声以及乘性噪声等。针对上述不同种类的噪声,去除噪声的方式可以划分成以下两种。

①空域滤波去噪。这种方式主要是调整图像中的灰度值,进而进行图像运算。生活中最常见的空域滤波去噪方式主要有均值滤波、中值滤波以及空间域低通滤波法。根据上述方式来看,维纳滤波是适应性较强的去噪方式,其在运用过程中选择性较高,因此,可以对图像进行高质量的保护,特别是对白噪声有较好的控制效果。

②变换域去噪。这种方式主要是在图像的某一部分内,对图像经过相关变换后产生的系数进行处理,进而再进行反变换,从而真正实现去除噪声的要求。生活中经常使用的方法主要有:频率域低通滤波法、小波变换法等。现如今,小波变换法仍然处于摸索阶段,整体来看,其具有较好的去噪效果,但计算方式较为繁琐。由此看来,不同的计算方式会对图像产生不同的影响[3]。

2.2 图像融合主要过程

图像融合主要过程就是清晰掌握图像融合的级别,例如图像的像素级别、决策级别、特征级别、图像融合算法以及相关融合处理过程等,上述过程是图像融合工作的重中之重。

2.3 融合效果评价

融合效果评价是对融合算法的运算方式进行合理检测以及评价,通过融合效果评价,可以促进后续生产有效改进并高质量完善,进而对后续工作提供关键的依据。对于融合图像的后续处理工作来说,要对处理完毕的融合图像进行后续检测、信息识别、数据跟踪以及最终决策等,上述流程会包括不同工作范围的相关应用。

3 图像融合算法

3.1 融合图像算法流程

①通过将红外热图像进行事先处理,根据分段的方式进行变化,从而逐步增加红外热图像的分辨率以及对比度,这种方式可以更加清晰地区分红外热图像。②通过将事先处理完毕的红外热图像以及可见光图像进行方向、尺度上的变化,由此可以得到更加精准的图像数据信息以及高频子带系数。③根据融合图像的相关算法规则来看,要对图像数据信息、高频子带系数进行不同的数据融合,从而得出与其对应的子带系数。④通过对上述系数进行变化,最后能够得到所需要的融合图像。

3.2 红外图像预处理

红外图像自身在抗噪声方面功能性较差,并且对比性与边缘处理情况都有处理上的问题。为了进一步实现图像融合的要求,必须要运用分段性的方式对红外图像进行相关处理,通过合理提高图像数据对比度,增强图像中目标的识别系数。这种运算方式相对简单,不需要较长的运算时间,因此对后续工作不会产生较大的影响。

分段性变换计算方式的公式如下:

上述公式中I(x,y)代表红外图像在(x,y)中像素变化情况,g(x,y)代表经过变换后的像素变化情况。

3.3 图像融合处理

(1)将事先处理完毕的可见光图像与红外图像进行方向、尺度上的变化,以此得到不同图像在频率变化中的子带系数。

(2)通过全方位分析不同子带系数的相关特点,获取不同的数据信息,进而结合图像场景中的融合处理要求,选择最适宜的融合方式,从而进行融合处理,最终得到不同图像的子带数据信息。

(3)通过上述流程能够得到不同方向、尺度的融合系数,在对融合系数进行相关变换后,最终获得融合图像。

3.4 融合规则

融合规则主要运用区域性的计算方式,这种方式与窗口方式在运用过程中具有较大的相似性,具体不同主要体现在其没有限制性的方形小窗,融合形状可以选择不同形式的形状。这主要由于红外图像中所有目标在形状都各有不同,运用上述规则形式可以适应融合区域特点。

4 图像融合算法的性能评价

4.1 平均梯度

平均梯度指标主要是指图像的清晰情况,其是衡量图像清晰度的关键方式之一,具体代表图像在垂直以及水平不同方向上的区别。平均梯度指标在实际应用中能够反映出图像中纹理情况的变化程度,并且其对像素灰度有较大的敏感性。以下是平均梯度的相关公式:

4.2 信息熵

信息熵主要是指图像中价值水平较高的数据信息间的含量,也代表着图像中像素灰度自身的频率特点以及次数情况,因此能够代表像素灰度情况的概率信息。信息熵的情况能够直接预测着融合图像自身的数据价值情况,这侧面证明着融合效果的质量情况[4]。以下是信息熵的相关公式:

E=-∑Pi×log2pi

4.3 互信息

互信息主要是用在观察不同图像间的相似情况,是图像融合质量的关键检测方式之一。互信息数据越大,就代表融合图像中信息数据量越丰富,因此,其自身就具有较强的融合性。若融合图像中A、B通过融合的方式生成了图像F,则以下就是互信息的计算方式:

4.4 空间频率

图像中空间频率主要是指图像在不同方向中的相差数据值与垂直方向的相差数值之和,也可以理解为,其代表图像自身的活跃情况。以下是空间频率的相关公式:

SF=√(RF)2+(CF)2

4.5 标准差

标准差主要是指图像在像素灰度与数据水平中的实际差异,在计算过程中代表着像素的类别,数据值越大就表明像素之间具有较大的差异,层次性就更显著。以下是标准差的相关公式:

SD(F)=√1/M X N∑(F(i,j))-F)2

根据上述计算方式进行针对性的仿真实验,主要是将可见光图像与红外线图像进行对比;将变化算法与NSCT算法进行对比;将PCNN算法与其他算法进行对比。结合最终对比情况来看,运用变换算法的图像在目标部分更加显著,但融合图像后没有良好地保存相关数据信息,因此,运用上述计算方式的融合图像质量较差。运用NSCT算法的图像在目标场景方面有较好的保留性,图像显示更加清晰,但在对比度方面仍有缺陷[5]。PCNN算法在场景融合过程中有高质量的信息保存性,但在边缘区域较为模糊,对比性较差。表1是上述方式的具体指标对比。

表1 图像融合算法评价指标对比表

结合表1可以看出其他算法的融合图像在平均梯度、信息熵、互信息、空间频率以及标准差方面都有明显的提高[6]。

5 结语

综上所述,图像融合技术是数字媒体技术中较为关键的技术之一,其可以把不同设备收集到的图像运用数字媒体技术进行相互融合,从而使图像中的物体逐渐显现。图像融合技术可以储存更多关键的场景,具有较高的准确性,为后续相关工作顺利进行奠定坚实的基础。