不规则金属物料的抓取位姿实时检测方法研究

2022-02-25陈苗苗叶文华马庭田张权

陈苗苗,叶文华,马庭田,张权

(南京航空航天大学 机电学院,江苏 南京 210016)

0 引言

近年来,随着工业自动化的快速发展,工业机器人的应用愈加广泛。作为智能化和自动化时代的重要发明,机器人的应用将会影响经济的各个方面[1]。工业机器人具有准确、高效、适应性强等特点,在物料分拣、物体搬运、自动化喷涂、切割、检测等领域,展现出比较明显的优势。在物体的抓取方面,机器视觉技术的运用可以快速识别目标物,并引导机器人完成一系列抓取动作,极大地提高了生产的自动化程度。目前,基于机器视觉的目标物抓取技术已经在自动化生产线上得到广泛应用,但抓取的对象多是已知的物体,且采用传统的模板匹配方式进行识别抓取。在实际应用中多是形状未知、姿态不确定的物体,且工业生产要求成本低、效率高。因此,研究基于机器视觉技术实现对未知物体抓取的方法具有重要意义。

为了实现对不规则物料的准确、快速地抓取,抓取位置的检测是关键,国内外许多学者近些年来对此进行了深入的研究。MARON Z C等[2]提出一种基于单一角度方向感知数据建立物体模型的方法,提取感兴趣区域,拟合出物体模型,再利用抓取规划方法生成抓取点,选择最满足力封闭性的进行抓取。这种依靠感知设备还原物体的形状或提取重要特征的方法工作量大,计算复杂;朱海波[3]基于 Hough 链码对工件形状进行识别,并根据几何不变矩确定工件表面中心和长轴朝向,对工件进行定位。但是这种方法难以检测出最佳的抓取位置;郑晶怡等[4]提出了一种基于形状先验模型的工件抓取位姿检测,并采集点云信息拟合工件平面,计算最佳抓取位姿。该方法可以适应复杂环境,但是仅适用于平面型物体的抓取;林强强等[5]通过建立一种工件旋转模型获得抓取角度,采用Canny算子提取工件边缘轮廓,计算抓取的手爪开合大小,方法简单有效,但是仅适用于长轴类等形状规则的零件。随着深度学习的迅猛发展,机器视觉在机械手抓取方面的应用更加灵活,如LENZ I等[6]于2015年用两个深度网络系统组成一个两步级联的系统,采用滑动窗口选取抓取位置;夏晶等[7]提出一种基于级联卷积神经网络的机器平面抓取位姿快速检测法,可抓取单目相机下任意姿态的物体。该类基于深度学习的方法检测位姿准确,但需要准备大量的数据集进行训练,所需时间长,且特征提取受到光照、环境等多方面的影响[8]。

综上所述,对物体的抓取位姿检测仍存在难以判断最佳位姿、准备工作复杂等问题。为此,本文设计一种简单的物料位姿检测方法,仅通过物料轮廓和形心的位置关系即可计算出最佳的抓取位姿。

1 不规则金属物料分类

机器人抓取时通常会根据物料的颜色、形状特点、质量等进行物料分类,但是这些方法所对应的特征均比较单一,若要使得抓取稳定,应抓取物料的质心位置。由于图像处理难以获得质心的信息,故本文依据形心代替质心作为判断依据。此外,物料的轮廓信息也是抓取操作中重要的特征之一。对于形状任意不规则的物料,形心点坐标和轮廓形状的相对位置不总是相同的,因此根据物料形心和轮廓的相对位置关系,将物料分为形心在轮廓内(包括形心在轮廓上)和形心在轮廓外两大类。

图像处理是通过算法从图像中获取必要的信息,让图像中包含的信息得到有效利用[9]。其中轮廓检测是一种常用的图像处理方法,在进行轮廓特征提取时,传统的边缘检测算法可以达到像素级别的精度。但随着技术发展的需求,更高精度的亚像素边缘提取方法得到更广泛的应用[10]。常用的亚像素边缘提取方法大致分为3类:基于矩、基于曲线拟合和插值、邻域等[11]。本文采用基于邻域[12]的亚像素边缘提取算法提取轮廓,获得轮廓上所有点的坐标(ui,vi),计算物体形心即为所有点的算术平均值,即

(1)

通常,在进行轮廓提取时,经常会出现一些细小的孔洞。为了避免孔洞对后续步骤的影响,本文通过设置合理的阈值对孔洞进行填充。

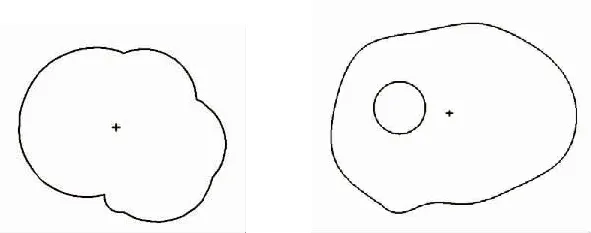

经过图像处理之后,可以直观地对金属物料进行分类。形心在轮廓内的物体如图1所示。

图1 形心在轮廓内

属于形心在轮廓外类型的,如图2所示。

图2 形心在轮廓外

2 物料抓取位姿检测方法

2.1 形心在轮廓内的物料位姿检测方法

1)直线求交法基本原理

直线求交法的基本原理是过形心每隔一定角度作一条直线,每条直线与物体轮廓交于若干个点。比较相邻点之间的距离,选择最小欧氏距离的一对交点,且最小欧氏距离应在手爪开合范围之内,则该交点所在的直线方向即为抓取角度,两交点距离即为手爪开合度w。

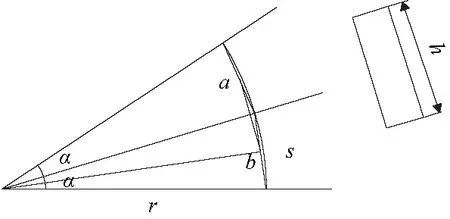

如图3所示,以圆形轮廓物体为例,半径为r,手爪的宽度为h。当选择分割角度为α(0≤α<180°)时,为便于计算,取圆弧中点为线段中点a、b,根据等腰三角形性质,a、b点之间的距离与α的对边线段s相等,理想状态为手爪宽度h与线段s相等,已知s的计算公式为

(2)

图3 分割角度计算图

本文研究中手爪的宽度为50mm,抓取的物体大小范围是80~200mm,因此r的范围是40~100mm。可计算出理想状态下的α是29°~ 77.4°。为满足所有抓取情况,应选取29°,为了方便计算,对其圆整,取α为30°。

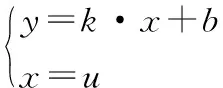

故对任意物体轮廓,可根据直线相交法得到6条过形心(u,v)且相隔30°的直线,直线方程如下:

(3)

提取直线与轮廓的若干个交点信息,当直线与轮廓相交时,可能会出现没有交点的情况,因此规定阈值为一个像素,同一像素下的亚像素点为同一点。规定按交点的纵坐标依次从大到小命名为P1、P2,…,Pn。若纵坐标相等,则按横坐标从小到大排序。分别计算每条直线上相邻两点的欧式距离,即P1P2、P3P4,…,Pn-1Pn等。因为一条直线与轮廓必定有偶数个交点,且若交点个数>2,则相邻的交点必定属于形状上不同封闭的点,可以抓取。因此每条直线上有

PxiPyi=min(|P1P2|,|P3P4|…|Pn-1Pn|)

(4)

其中:i=1~6;n为该条直线上交点的个数。

最后比较6条直线中的最小值:

PxmPym=min(|Px1Py1|,|Px2Py2|…|Px6Py6|)

(5)

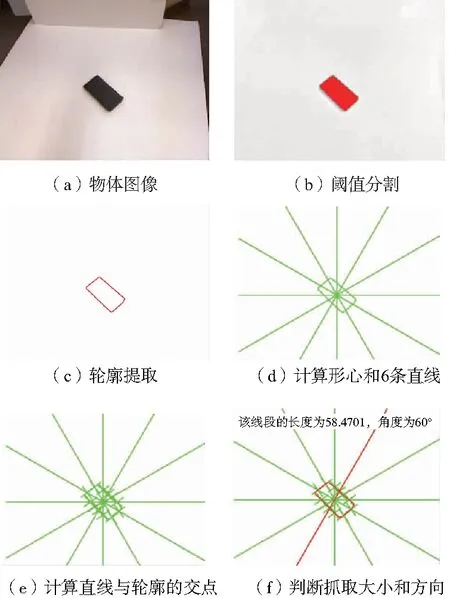

2)基于直线求交法的位姿检测

按照直线求交法,对一张图像分析,如图4所示。图4(a)中是一个形心在轮廓内的物体,经过图像处理后可以获得物体的轮廓及形心点,如图4(c)中闭合红线所示,过形心点每隔30°作出6条直线。根据最短欧氏距离选择,图4(f)中红色直线对应的角度即为抓取方向(本刊为黑白印刷,如有疑问请咨询作者)。

图4 直线求交法求解位姿

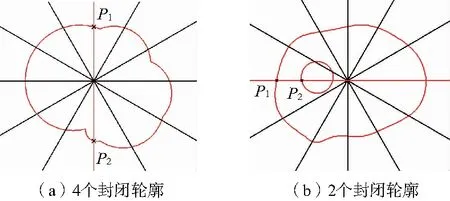

基于此方法,另外对一组形心在轮廓内的形状进行判断。实验结果如图5所示。图5(a)中有一个封闭轮廓,根据直线求交法得到P1P2点所在的直线角度即为抓取方向,P1P2的中点即为手爪抓取的中心点。根据实验结果可知,直线求交法可以完成对形心在轮廓内形状的抓取位姿检测。

图5 直线求交法求解位姿实例

2.2 形心在轮廓外的物料位姿检测方法研究

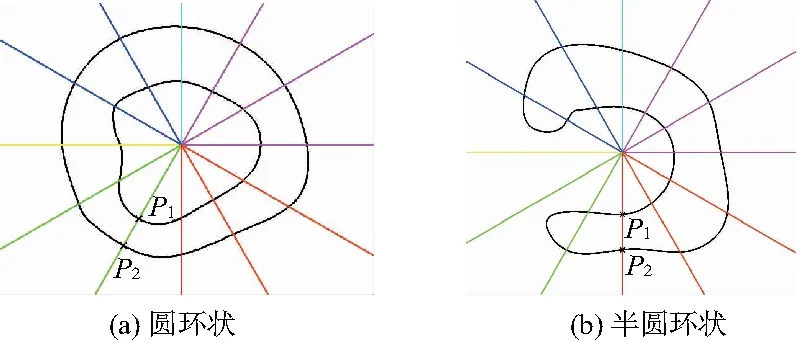

1)射线求交法算法原理

在本章第1节中提出了一种基于物体形心和轮廓相对位置信息的直线求交法用于检测物体抓取位姿,但是这种方法比较适合形心在轮廓内部的物体抓取。为了减少复杂物体轮廓的计算量,基于直线求交法又提出了一种射线求交法(图6),用于检测形心在轮廓外的物体位姿。

图6 位姿射线法

直线求交法的原理是6条经过形心的直线,射线求交法中将直线换成每隔30°的射线,环绕形心点一周,共计12条射线,直线方程与之前一致,x取值范围不同。

(6)

每条射线与轮廓的交点命名规定及计算方法同直线求交法:

PxjPyj=min(|P1P2|,|P3P4|,…,|Pn-1Pn|)

(7)

其中:j=1~12;n为该条射线上交点的个数。

最后比较12条射线中的最小值:

PxtPyt=min(|Px1Py1|,|Px2Py2|,…,|Px12Py12|)

(8)

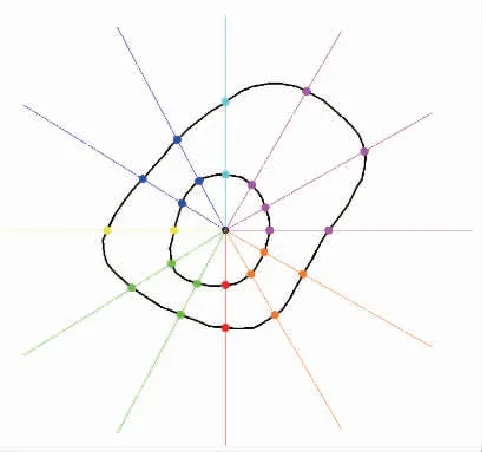

2)基于射线求交法的位姿检测

采用射线求交法计算抓取位姿,如图7所示。图7(a)是一个圆环形状,形心在轮廓外的物体,经过图像处理后可以获得物体的轮廓及形心点。过形心点每隔30°作出12条射线,根据最短欧氏距离选择,P1P2点所在的直线角度即为抓取方向,且P1P2的中点即为手爪抓取的中心点;图7(b)是一个半圆环形状,也是在轮廓外的物体,具体检测方法同上。

图7 射线求交法求解位姿

3 实验验证

3.1 抓取实验验证

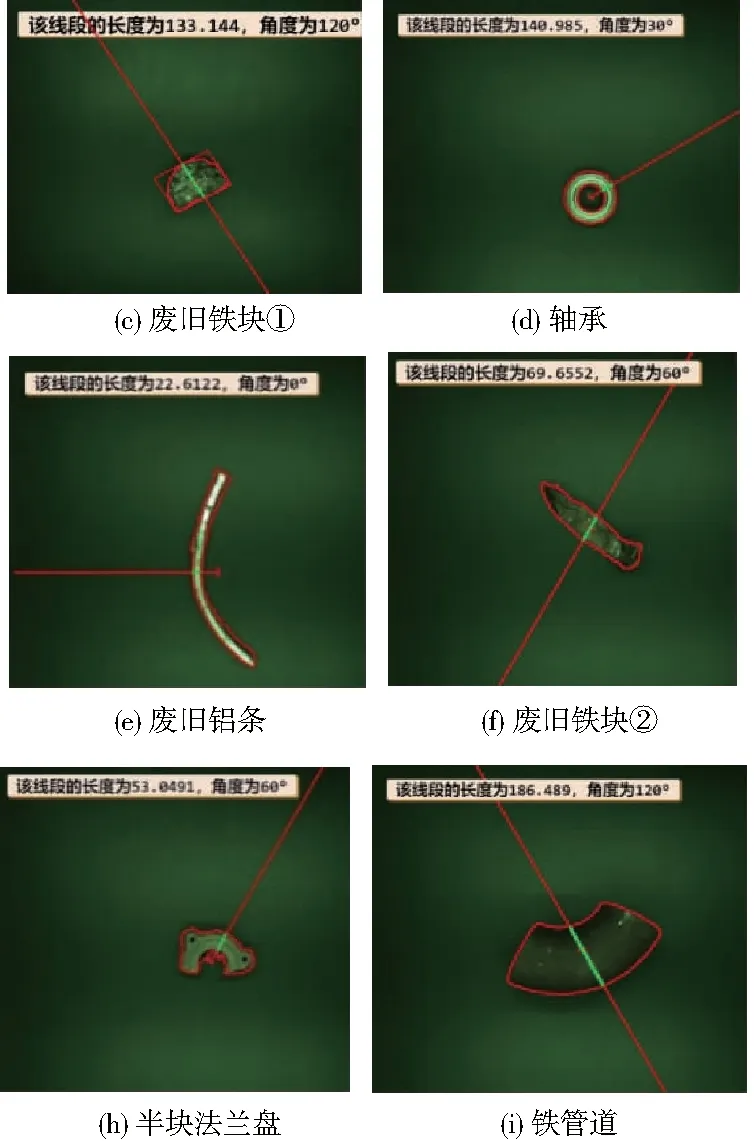

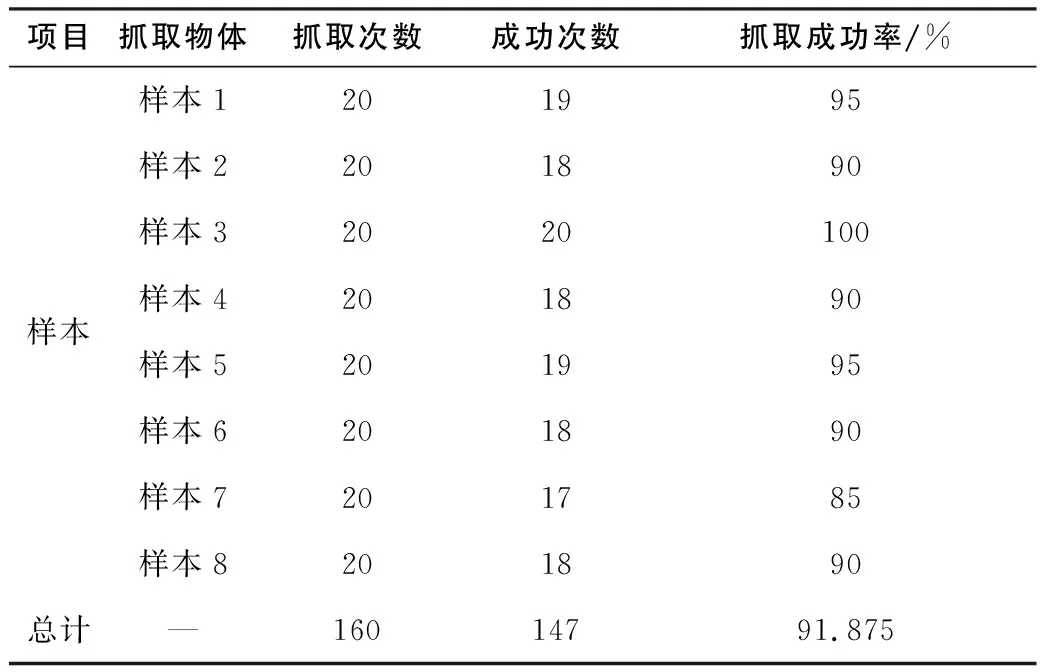

选择8种任意形状的物体,且每种物体根据摆放姿态的不同均进行20次试验,部分抓取结果如图8所示。采用“点线式”的展示方法,图中绿色线段长度即为手爪的开合宽度,且绿色线段的角度即为手爪抓取的方向。其中图8(a)蓝色黏土块、图8(b)橙色黏土块、图8(c)废旧铁块①、图8(f)废旧铁块②、图8(i)铁管道均属于形心在物体轮廓内的情况,用直线求交法检测抓取位姿;而图8(d)轴承、图8(e)废旧铝条、图8(h)半块法兰盘的形心均在物体轮廓外,用射线求交法检测抓取位姿。统计结果如表1所示,共进行试验160次,抓取失败13次。这种抓取方案的平均成功率为91.875%,本次试验证明了该方案的实用性和准确性。

图8 样本图片及抓取实验

3.2 算法对比实验

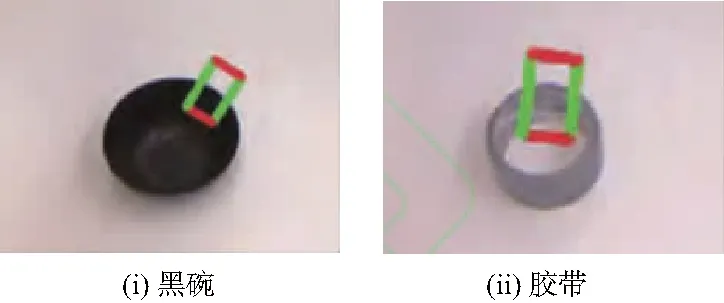

当前用于检测机器人抓取位姿的主流方法是深度学习,康奈尔(Cornell)数据集[6]是针对机器人抓取位姿检测制作的一组数据集,包含244种日常物品,且每种物品有多种摆放姿态,许多研究均应用该数据集训练、验证。本文选择其中几张图片进行验证,如图9所示。其中图9(a)是夏晶等人[7]在英特尔i7、CPU为NVIDIA GeForce GTX 1080TI的计算机上训练17 h的抓取结果,图9(b)图是采用本文提出的位姿检测算法实时检测位姿,采用“点线式”的展示方法,在英特尔i5-8250U、Inter(R)UHD Graphics Family的笔记本上实验。绿色线段代表抓取长度,其中点即为抓取中心点。根据两组图片的对比,可以看出本文研究的位姿检测方法可以有效地检测出抓取位姿,相较于深度学习检测的方法,既不需要过高的显卡设备,还可以节省长时间的训练学习。

表1 对不同位姿的样本抓取实验结果统计

图9 Cornell数据集验证结果对比

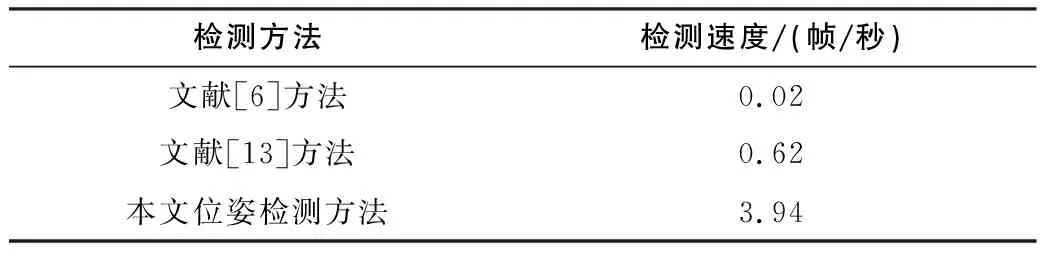

另一方面,在实验过程中还记录了每张图片提取位姿所需要的时间,计算出平均处理一张图片时长为254ms,即3.94帧/秒。表2中列出了其他已公开检测方法的文献中说明的检测速度,可以直观地看出本文提出的方法在检测速度上远远超过两种已公开的方法。

表2 不同方法的检测速度对比

4 结语

针对机器人抓取不规则金属物料存在的抓取位姿检测问题,提出基于轮廓和形心特征的抓取位姿判断方法,以过形心的直线或射线与物料轮廓相交点的最短欧式距离作为主要判断依据。该方法首先将物料分为形心在轮廓内和形心在轮廓外两种类型。对于第一种物料,提出直线求交法判断抓取位姿,对另外一种物料提出射线求交法判断抓取位姿;确定最佳的抓取位姿;最后通过实际抓取实验证明该算法可以实现对不规则的金属物料进行实时、稳定、准确的抓取。搭建实验平台做抓取验证,并与基于深度学习的抓取位姿检测结果作对比。结果表明:该算法能够满足实时的检测图像中不规则废旧金属的最佳抓取位姿,且不需要大量的训练和学习,非常适用于工业上分拣抓取作业。