基于级联卷积神经网络增强CT图像肾脏及肾肿瘤的定位分割研究*

2022-01-26吴倩倩周蕾蕾王思雨刘成友程龙田书畅蒋红兵

吴倩倩,周蕾蕾,王思雨,刘成友,程龙,田书畅,蒋红兵,3△

(1. 南京医科大学附属南京医院(南京市第一医院)临床医学工程处,南京 210006;2. 南京医科大学附属南京医院(南京市第一医院)医学影像科,南京 210006;3.南京市急救中心,南京 210003)

1 引 言

肾肿瘤是泌尿系统常见肿瘤之一[1]。据统计,全球每年有34~40万名患者被诊断为肾肿瘤,另有13~17万名患者因其死亡[2]。在临床治疗中,准确判断肾脏及病变区域对病情诊断、功能评估等非常关键[3],肾肿瘤的精确分割更是手术方案制定及预后评价的重要基础。近年来影像学技术不断发展,增强CT被广泛用于腹部肿瘤诊断,其不仅能够提供病灶形态学信息,而且能够反映血供情况及病灶强化程度,有利于辅助影像医师进一步鉴别诊断[4]。增强CT对肾脏病变的检测和表征更是具有高敏感性和特异性,是肾肿瘤检出与诊断的常用影像学方法之一[5]。然而肾脏解剖形状的不规则性、组织密度的不均匀性[6],使得其解剖结构的边界变得不确定、不连续。此外,CT图像中腹部灰度和纹理分布相似的组织器官可能与肾脏组织发生部分重叠[7]。因此,快速精确分割肾脏组织仍是医学图像处理领域中一个具有挑战性的问题。

近年来,国内外学者在医学图像肾脏处理方面做了很多研究与贡献,对其分割方法大致可分为传统方法与深度学习方法两类。传统方法多为利用图像信息与先验知识以实现图像分割。Al-Shamasneh等[8]提出一种基于能量最小化的新型Mittag-Leffler函数用于肾脏分割,分割结果较传统能量函数分割有很大改进,但分割结果图上增加了许多噪声点,不利于临床医师判断。Kronman等[9]提出的Robust-Seed可在不影响分割精度的情况下,自动减少基于种子的分割方法相对于种子位置的可变性,但该方法仅适用于单个用户定义的种子,且假设初始种子位于目标结构内,而这并不符合自动种子算法的定义。除此之外,传统方法对于描绘放射图像中模糊的器官边界能力也有限,容易出现图像噪声和伪影,导致边界的缺失或弥散[10]。

与传统分割方法不同,深度学习算法能够通过自主学习从输入数据中提取复杂的特征层次结构[11],多将卷积神经网络(convolutional neural network,CNN)与图形处理单元及大型训练数据集相结合,不仅能以秒级的运行时间快速处理数据,更是激发了计算机视觉能力的巨大进步,目前已成为医学图像分析和计算机辅助诊断系统中的关键步骤[12],且广泛应用于肾肿瘤分类[13-14]以及肾组织分割[15-17]等领域。Efremova等[15]利用CNN进行肾脏与肾脏肿瘤分割,采用KiTS19数据集测试,最终整体的分割准确性较高,Dice为0.819,但肿瘤Dice仅为0.674,仍有提升空间;Reddy等[16]对U-Net网络及训练超参数进行微调,应用于腹部CT图像的肾脏分割,肾脏与肿瘤整体分割Dice为0.83,但该研究未进一步实现肾脏与肾脏肿瘤分割;Vu等[17]将整个肾脏与肿瘤区域、单个肿瘤区域分别作为标签输入U-Net,最后将分割结果进行融合得到肾脏与肿瘤分割模型,该模型对肾脏分割的准确率较高,但肿瘤Dice仅为0.408。因此,利用深度学习的方法进行肾脏组织分割,尤其是肾肿瘤分割仍是一项具有挑战性的工作。

本研究提出一种基于级联卷积神经网络的增强CT图像肾脏及肾脏肿瘤定位与分割的方法。一级模型实现正常肾与肿瘤肾的定位,二级模型进一步实现肾脏及肾脏肿瘤的精细分割。对比实验表明,该模型能较准确定位且分割肾脏及肾脏肿瘤,分割的定量指标优于其直接进行分割的网络模型。

2 资料与方法

2.1 实验数据

本研究数据由两部分组成。KiTS19数据集:该数据库公开了2010年至2018年在明尼苏达大学医学中心接受一个或多个肾肿瘤的部分或根治性肾切除术210例患者的术前动脉期腹部CT图像,并提供全肾和肾肿瘤的轮廓标签。所有患者均进行仰卧图像采集,图像的高度宽度来源患者的左前方(除第160例图像大小为796×512外,其余均为512×512),层数对应于轴向视图,层索引从上到下增加,层厚度范围1~5 mm。本研究去除了其中63例(临床信息缺失26例,图像质量影像诊断20例,标签错误17例),将剩余147例纳入研究。本院肾肿瘤数据集(our hospital images,OHI):回顾性收集南京市第一医院2018年12月至2019年10月行腹部增强CT检查且定性为占位性病变患者图像,共40例。Philips lngenuity128、联影uCT760螺旋CT机进行腹部扫描,使用高压注射器静脉团注非离子型碘对比剂,剂量为1.5~2 mL/kg,注射速度 2.5~3.0 mL/s,并用对比剂自动触发技术。所有患者都进行仰卧图像采集,图像的高度宽度来源患者的左前方(图像大小为512×512),扫描层厚5 mm。由3名影像医师使用ITK-SNAP软件完成全肾、肾肿瘤的手动勾画。数据集具体信息见表1。

2.2 图像预处理

在输入模型前,首先通过编程将所有DICOM格式图像的窗宽、窗位分别调整为300、25 Hu,使肾脏成像清晰,有助于突出显示肿瘤结构及边界;然后将图像批量换为PNG格式并手动去除不含肾脏及肾脏肿瘤的片层,将图像大小调整为256×256,数据归一化以提高训练效率。输入一级模型与二级模型的数据集分别进行如下预处理:

2.2.1一级模型数据集 将标签图像感兴趣区(region of interests,ROI)进行放大,见图1(a),以保证肾脏及肾脏肿瘤边界输入的完整性,其中C点坐标为(x,y),D为(x+w,y+h),A、B分别为0.98(x,y)、1.02(x+w,y+h),以A、B两点为对角线所在矩形即为扩大后输入的标签图像ROI大小。

2.2.2二级模型数据集 首先简单修正一级模型定位结果使肾脏和肿瘤完全包含在框内,然后分别截取左右肾并将其调整至256×256(长边放大至256,短边依照原标签框按比例调整,其余区域填充为黑色,见图1(b))。既充分地利用了图像特征,同时又能最大限度发挥网络性能。

2.3 模型结构

本研究的基本网络选用目前主流医学图像分割网络U-Net[18]、Attention U-Net[19]以及Res U-Net[20]。U-Net是一种编码器-解码器结构,编码器逐渐减少池化层空间维度,解码器逐步恢复图像细节与空间维度,二者之间的跳跃连接提高了数据利用率,使之运用少量样本即可实现端到端的训练[21];Attention U-Net将注意力机制引入U-Net中,使得模型在训练过程中着重学习对特定任务有用的显著特征;Res U-Net则是在U-Net中加入了残差连接,将编码器与解码器直接相连保留了不同层信息,同时在一定程度上减少了处理时间。目前很多网络[22-25]也是基于三者的变体。

本研究设计的肾脏及肾脏肿瘤定位和分割的级联卷积神经网络模型,分别以上述三种网络为基本结构,即一级定位模型与二级分割模型的组合方式分别为Attention U-Net + Attention U-Net、Res U-Net + Res U-Net、U-Net + U-Net。同时,为验证级联模型分割性能是否更优,使用增强CT图像原图直接对Attention U-Net、Res U-Net、U-Net分别进行训练,并测试其分割效果。

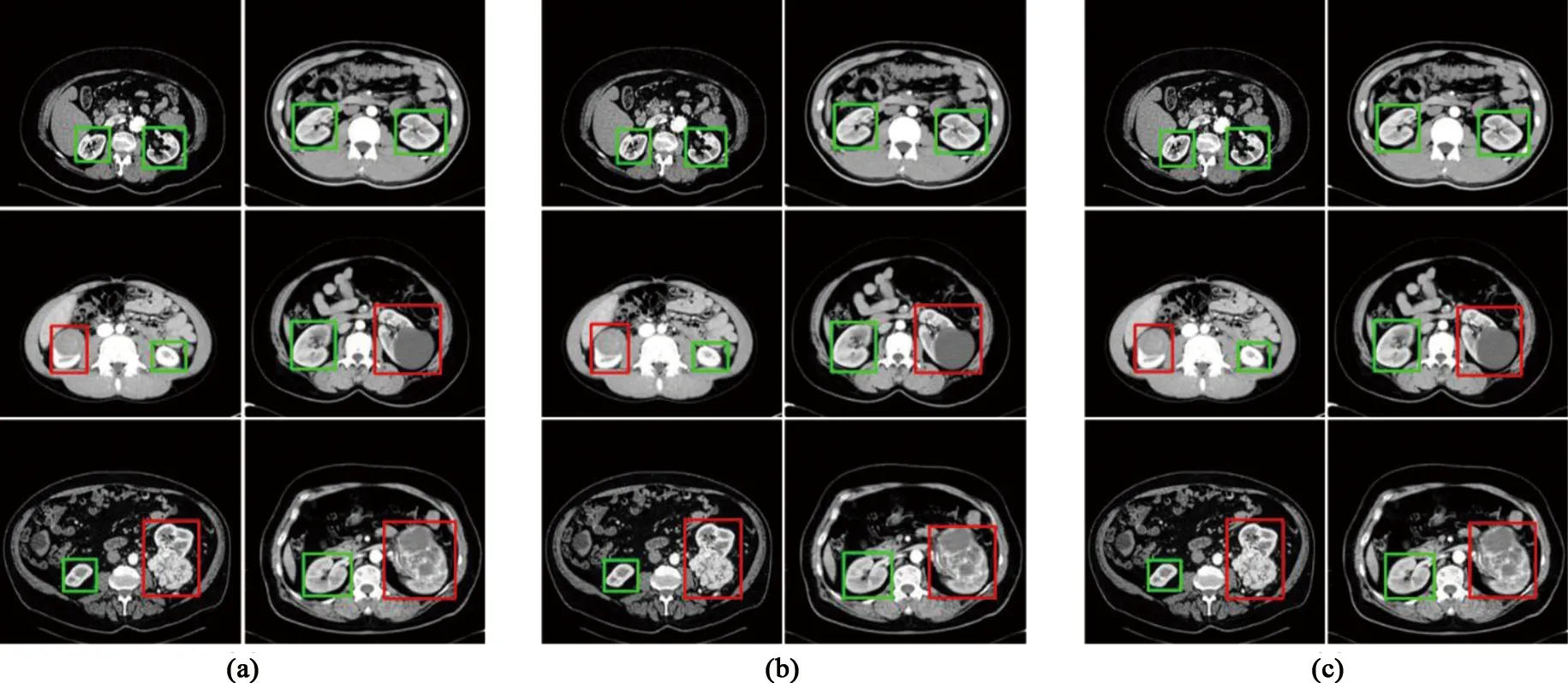

级联模型整体定位分割流程,见图2。将预处理后的数据,输入至一级模型完成正常肾及肿瘤肾的定位与检测(正常肾以绿色框显示,肿瘤肾以红色框显示);再从一级模型定位结果中截取左右肾并适当调整尺寸后,输入至二级模型实现肾脏与肾脏肿瘤的进一步精细分割(肾脏正常区域以绿色标记,肿瘤以红色标记)。

2.4 模型的训练与验证

随机选取KiTS19数据集的85%为训练集(123例,9 806张切片),15%(24例,2 134张切片)及OHI数据集(40例,912张切片)为测试集,同一数据集中包含同一患者所有片层。对所有模型,超参数设置如下:batch_size为16,使用Adam优化器,学习率为10-3,loss值采用BCEWithLogitsLoss(Bloss)计算,公式如下:

图2 级联神经网络模型整体流程

Bloss=-[ylog(σ(x))+(1-y)log(1-σ(x))]

(1)

(2)

其中,x为预测结果,y为金标准。

采用Early-Stopping技术控制迭代停止,设置为当test loss在连续7个epoch内增长或epoch为200时,停止训练,认为模型收敛。实验所用计算环境如下:Intel(R) Core(TM) i9-10920 CPU @ 3.50 GHz (12核,2线程/核,64 GB内存),系统为Ubuntu16.04。在该系统上搭建两块RTX 3090显卡(显存为24 G/块),并行计算架构加速计算。构建系统开发语言环境和深度学习框架,python版本为3.7.5,采用pytorch1.7.1框架。

2.5 评价方法和指标

一级模型定位以IOU(intersection over union,IOU)大于0.5为分类阈值,即当IOU>0.5时,视为定位预测成功,然后再在此基础上进一步采用准确率(precision,P)、召回率(recall,R)、F1得分(F1_Score)评估定位准确性;采用Dice、体积相似度(volume similarity,VS)评估二级模型肾脏与肿瘤分割的准确度。具体公式如下:

(3)

(4)

(5)

(6)

(7)

(8)

其中,A表示模型分割结果中的肾脏(肾肿瘤),B表示影像医师标定图像中的肾脏(肾肿瘤),TP表示正确检测肿瘤肾,FP表示将正常肾预测为肿瘤肾,FN表示将肿瘤肾预测为正常肾。评价指标中,P表示正确检测为肿瘤肾的样本占所有预测为肿瘤肾样本的比例;R表示正确检测为肿瘤肾的样本占所有实际为肿瘤肾样本的比例;F1_Score同时考虑P和R,当F1_Score较高时,说明模型预测结果较好;Dice越大,代表模型预测结果越接近金标准,即分割越准确;VS则是将Dice中的“与”操作用减法替代,以此代表错误率,数值越小,分割误差越小。

3 结果与分析

3.1 一级模型定位结果

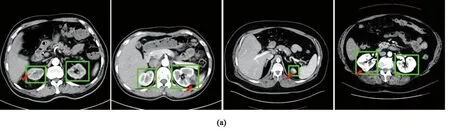

一级模型在KiTS19、OHI及二者整体测试集中的肾脏定位结果见表2。由测试结果可见,U-Net模型的整体Precision最高,为97.67(KiTS19:98.28;OHI:96.10);整体最高Recall=90.42(KiTS19:95.34;OHI:81.76),F1_Score=90.77(KiTS19:92.46;OHI:87.48),均在Res U-Net模型中获得。图3展示了同一片层在三种不同网络级联模型上测试的定位结果。由图3可见,一级模型可以实现正常及含肿瘤肾脏的基本定位,但因部分肿瘤直径较小或位置靠近片层两端,模型容易将其误识为正常肾脏(图4(a)红色箭头处),导致假阴性率较高;或因肾脏与肾肿瘤较为相似,从而产生少数假阳性结果(图4(b)红色框),影响了模型整体的准确性。从评价结果可见,OHI测试集Recall较低,导致F1_Score较低,原因可能为训练集包含肿瘤类型不够广泛,或同一类型肿瘤数量较少所致。除此之外,从理论上分析,引入注意力机制的Attention U-Net精度应当更高,但结果并非如此,分析原因可能如下:(1)注意力机制并不适合本研究数据集;(2)本研究数据量对于Attention U-Net要求的数据量来说偏少;(3)一级模型训练集标签包含少量周围组织器官,即背景区域也包含在目标区域内,而注意力机制在模型训练过程中会将目标区域的值放大,从而对分割精度产生了一定影响。

表2 不同级联模型在KiTS19和OHI测试集上定位结果

注:左右两列分别为KiTS19和OHI数据集(图中标示详见电子版彩图)。

3.2 二级模型分割结果

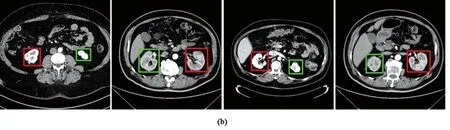

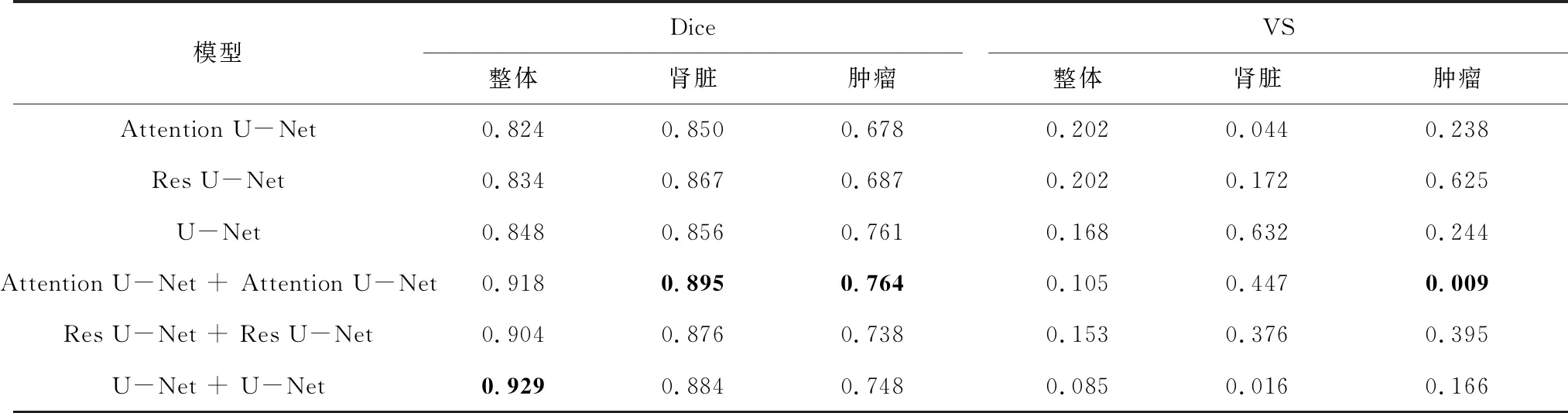

测试集在不同网络模型及所提出级联模型的分割Dice、VS值见表3。由表可知,U-Net + U-Net级联模型的肾脏及肿瘤整体Dice最高(0.929),与直接利用U-Net分割相比提升了9.55%;Attention U-Net + Attention U-Net级联模型的肾脏、肿瘤Dice均最高(分别为0.895、0.764),相较于Attention U-Net直接分割分别提高了5.29%、12.68%;U-Net + U-Net级联模型的整体、肾脏VS最小(分别为0.085、0.016),效果最优,对肿瘤的最优VS值在Attention U-Net + Attention U-Net级联模型中获得(0.009)。由此可见,经过一级模型的定位处理,提升了网络对输入特征图的感受野,捕获了更多的图像特征,使得二级模型的性能相较于直接利用Attention U-Net、Res U-Net、U-Net对图像进行分割有了明显的提升,准确度更高。图5分别展示了不同模型在KiTS19和OHI测试集的部分分割结果,将肿瘤部分与临床医师勾画标准对比,本研究提出模型分割结果与医生做出诊断的大小、形状相似度较高,能够基本实现肾脏肿瘤的边界勾画,且分割精度较高,测试集在提出的级联模型均有较好的表现,有利于辅助医生进行肾脏器官的疾病诊断与治疗。

注:图中标示详见电子版彩图。

表3 不同CNN模型在测试集上的Dice、VS值

注:左右两列分别为KiTS19和OHI数据集。红色为模型分割肿瘤边界,蓝色为医师勾画相应边界(图中标示详见电子版彩图)。图5 二级模型分割结果

4 结论

由于相邻器官灰度相似性、不同个体之间的肾脏差异等[26],在腹部增强CT图像中分割肾脏及肾脏肿瘤一直是肾脏分割研究的关键及难点。为解决该问题,本研究提出了基于级联卷积神经网络肾脏及肾脏肿瘤定位与分割模型,该级联模型相对于应用基础网络直接分割病灶而言,准确度更高。一级模型可基本识别定位正常肾及肿瘤肾,二级模型进一步实现了对肾脏及肿瘤精细分割。实验结果表明,与Efremova等[15]、Vu等[17]提出模型相比,本研究的级联模型不仅提高了肾脏与肿瘤整体的Dice,而且进一步提升了肿瘤分割准确度。综上所述,本研究所提出的级联模型充分利用了图像特征及U-Net性能,实现了正常肾与肿瘤肾的准确定位、肾脏及肾脏肿瘤的精确分割,有助于临床医师确定肿瘤位置及形态,为临床肾脏疾病诊断提供依据,具有实际研究意义及临床应用价值。本研究提出的级联模型仍有一些不足之处,例如病灶边缘片层的感兴趣区或直径较小病灶识别、分割难度较高,还需对模型进一步改进并优化算法。另外也发现,不同医师对小病灶判定不相同,导致模型训练集标签勾画不一致,对模型的训练有一定影响,故还需进一步规范标准。