基于深度迁移学习的红外舰船目标检测算法

2021-12-28王悦行吴永国徐传刚

王悦行,吴永国,徐传刚

(天津津航技术物理研究所,天津 300308)

0 引 言

卷积神经网络(convolutional neural networks,CNN)在图像分类、人脸识别等领域的巨大成功依赖于大规模数据集的训练[1-2]。研究和实践表明,CNN在图像识别任务中,当训练数据集达到千万量级时,可以接近甚至超过人眼识别能力[3-5]。但是在红外目标检测任务[6-8]中,受客观条件限制,真实红外目标图像数据量有限,无法按传统方法对算法进行训练[9]。因此,必须开展基于迁移学习的CNN 训练方法研究,将通过大数据集充分训练的CNN 模型迁移到用于识别红外舰船特征的CNN模型[10]。

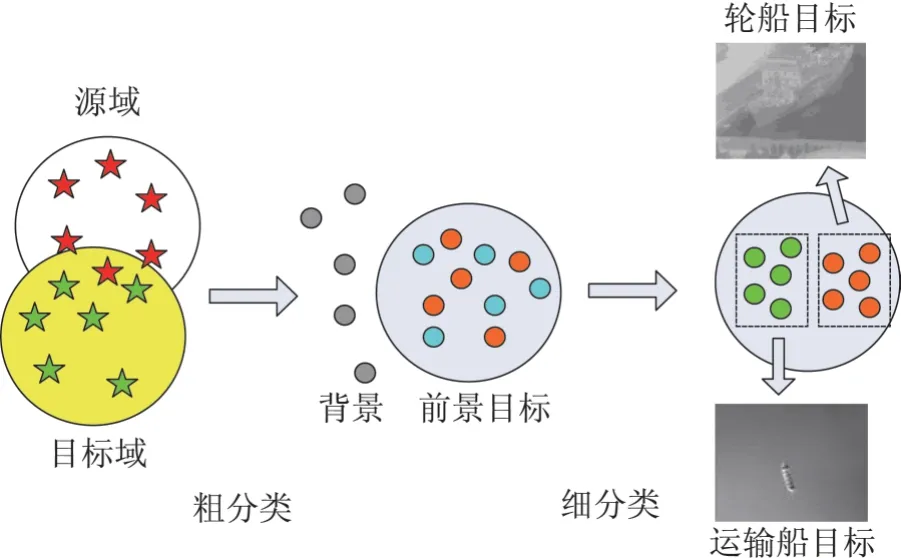

迁移学习[11]可以从现有数据迁移知识来帮助将来的学习,而且迁移学习不像传统机器学习那样做同分布假设。采用仿真红外图像数据集上预先训练的成熟CNN 特征,对提取出的特征在真实红外图像数据集上进行二次训练,具体流程如图1所示。

将迁移学习应用到神经网络中,就是将一层层网络中每个节点的权重从一个训练好的网络迁移到一个全新的网络里,而不是从头开始,为每一个特定任务训练神经网络。迁移学习相当于让神经网络有了语言。新一代神经网络可以在前人的基础上更进一步,使用一个由他人预先训练好并可作为我们训练模型的起点。因此,本文使用大量仿真红外舰船图像和少量真实红外舰船图像作为训练样本,利用由粗到细的深度卷积神经网络实现迁移学习,以解决仿真红外舰船图像和真实红外舰船图像的跨域适应性问题,从而实现对真实红外舰船目标的检测识别功能。

1 红外舰船目标跨域自适应检测算法

在复杂海面场景条件下,能够准确地检测目标对于实际作战应用有重要意义。但是由于客观条件限制,海面红外目标场景数据较少,因此,为了降低深度学习对真实红外舰船数据量的需求,本文使用大量仿真红外舰船图像数据集和少量真实红外舰船图像,通过特征自适应迁移学习(feature adaption transfer learning,FATL)方法实现从仿真红外目标到真实红外目标的跨域目标检测功能。

检测器通常由两部分组成:backbone 和head。前者在ImageNet上进行预训练,后者用来预测类别信息和目标物体的边界框。在最近几年,目标检测器会在backbone 和head 之间插入一些网络层,这些网络层通常用来收集不同的特征图,我们将其称之为目标检测器的neck。通常,一个neck 由多个bottom-up 路径和top-down路径组成。

图2 介绍了本文设计的用于跨域对象检测的网络结构框架,目标检测器的backbone 采用DenseNet预训练模型,模型参数在ImageNet 上进行预训练,能够高效地逐层提取输入图像不同的深度特征;目标检测器的neck 采用路径聚合网络(path aggregation network,PAN)结构,使低层信息更容易传播到顶层;目标检测器的head 采用粗细分类模块,粗分类模块会从不同层输出的特征图中提取当前特征图的前景信息,进行粗粒度特征自适应;经过全连接层后,细分类模块区分不同类型目标并对齐同一类型目标,进行细粒度特征自适应。在数据增广方法上,本文采用自对抗训练方法(self-adversarial training,SAT)提高模型泛化能力。

与目前常用的Yolov3 检测器[12]相比(Yolov3 网络结构如图3 所示),本文算法采用DenseNet 结构作为骨架网络,与Darknet53 结构相比,DenseNet 结构能够在小数据集情况下更好地解决过拟合的问题。另外,本文网络增加PAN 结构连通浅层特征和深层特征,使得网络在提取目标高层次语义信息时能够更好地保留目标细节特征,从而提高对小目标的检测性能。同时,通过SAT方法在原有模型的训练过程中注入对抗样本,提升了模型对于微小扰动的鲁棒性。并且,本文网络设置粗分类和精细分类模块,能够达到对目标类型进行精准分类的目的。

2 检测器结构

本文检测器由提取特征的backbone、用于输出目标检测结果的head 以及连接两者的neck 组成。通过对检测网络进行设计优化,使网络在提取图像高层次语义信息的同时,能够充分利用目标的低层次表观特征,并且通过多尺度设计,使网络能够在不同空间分辨率下检测目标。

2.1 检测器backbone

本文选用DenseNet 作为检测网络的backbone。DenseNet 网络结构由多个Dense Block 组成,一个Dense Block 包含多个卷积层,如图4 所示,每层结构由 卷 积、batch normalization(BN)和ReLU 组 成。Dense Block 的输入并不是只使用之前最后一层的输出,而是将之前所有Dense Block的输出以及原始层的输出作为输入,即x0,x1,…,xi-1。DenseNet 不同层特征能够复用,从而减少计算量,并且缓解梯度消失问题,加强特征传播。

图4 Dense Block网络结构Fig.4 Dense Block network structure

2.2 检测器neck

特征图经过上一节backbone 特征提取网络后,会输入到检测器head 中来得到检测结果。为了丰富检测器head 的信息,本文采用PAN 结构作为检测器的neck,使特征图在送入head 之前,首先经过自底向上和自顶向下的PAN结构,相邻特征图按元素顺序添加到一起。

图5是本文采用的PAN结构。PAN结构是在常用的特征金字塔网络(feature pyramid networks,FPN)基础上,增加了自底向上的结构,参见图5(b)中橙色框结构,能够使网络的底层信息更容易传播到顶层。在FPN中,局部空间信息在图5(a)中由红色箭头向上传递,红色路径经过约100层。PAN引入了short-cut路径,只需约10层就可到达顶部的N5层。short-circuit结构设计使最上层可以获得精确的局部信息。因此,PAN结构能够连通浅层特征和深层特征,PAN输出特征包含了自底向上的空间丰富信息和自上而下的语义丰富信息,能够提高对小目标的检测性能。

图5 PAN结构Fig.5 PAN structure

2.3 检测器head

检测器head是在neck之后,用于输出检测网络结果,即目标检测位置和目标类别。为了减小不同领域特征空间的域偏移以实现跨域目标检测,本文采用文献[13]的方法,分别在backbone 和neck 网络结构的输出特征层设置粗分类head 和细分类head。首先,本文利用DenseNet网络提取多层目标特征,然后采用粗分类head 对DenseNet 网络提取的前景目标和背景特征进行特征对齐,实现前景和背景的分类。细分类head将PAN 网络融合的目标表观特征和深度特征进行提取,细分类head 在充分利用目标类别信息的基础上,突出每个类别的分布并对不同类别目标进行特征对齐,从而达到对目标类型精分类的目的。

因此,FATL 算法设计了两个分类模块head:第一个模块(粗分类head)从不同领域图像中识别出前景信息,但是对目标类别不作区分;第二个模块(细分类head)通过建立每个类别的原型实现同一类别目标的语义对齐。具体分类过程如图6所示。

图6 适配模块原理示意图Fig.6 The schematic diagram of the adaptation module

在粗粒度阶段,通过基于注意力的区域转移模块来突出前景的重要性,它以一种不区分类的粗糙方式工作。利用高级特征中的注意机制提取感兴趣的前景目标,并在特征分布对齐时对其进行标记。通过多层对抗性学习,利用复杂的检测模型可以实现有效的领域交叉。粗分类网络采用经典的对抗生成网络模型,由分类器D 和主干网络G 构成,具体来说,分类器D 试图区分特征来自真实图像和仿真图像,而主干网络G旨在混淆分类器。G和D之间通过梯度反向层进行连接。当训练过程收敛时,G 倾向于提取域不变的特征表示。第l个卷积块中对抗学习的目标函数Ll可以表示为

式中:Gl和Dl分别是分类器D 和主干网络G 的第l个卷积块;θGl和θDl是Gl和Dl对应的权重因子;xs和xt分别是来自源域DS和目标域DT的输入图像;Dl(·)表示源域输入图像的目标特征概率。

在细粒度阶段,通过基于原型的语义对齐模块来构建跨域的每个类别的全局原型。原型在每次迭代中都进行自适应更新,从而抑制了假伪标签和类不匹配的负面影响。由于从粗到细的特征自适应,前景区域中的领域知识能够得到有效传递。本文提出的结构将跨领域具有相同类别的一对原型(WSi,WTi)之间的距离最小化,从而保持特征空间中的语义一致性。原型可以定义为

式中:WSi和WTi表示分别来自源域S和目标域T的第i类原型;F(f)表示在头部网络经过第2 个全连接层后前景区域f的特征;|·|表示区域个数。本文采用头部网络提供的Ri作为目标域的伪标签,采用真实数据Gi提取源域中前景区域。

因此,检测器head 能够利用粗分类器高级特征的注意机制提取感兴趣的前景目标,然后通过细分类器基于原型的语义对齐模块将跨领域具有相同类别的目标原型进行对齐,从而实现跨域自适应目标检测功能。

2.4 数据增广方法

本文采用自对抗训练方法(SAT)中的数据增广方法。首先,对一个训练样本执行前向传递。在传统的反向传播中,通常是通过调整模型权重来改进检测器对图像中目标检测的准确率。本文采取相反的方向,通过改变图像来降低检测器的性能,从而创建一个针对当前模型的对抗性攻击,而新图像在视觉上看起来是一样的。然后,用带有原始边界框和类标签的新图像对模型进行训练,从而提高模型泛化能力,并减少过拟合。

3 红外舰船目标仿真方法

经过几十年发展,仿真红外图像可以很好地模仿红外探测器接收到的来自物体和背景的红外辐射。在满足客观物理规律的同时,还能提供与真实红外船只图像类似的边缘、轮廓、纹理和辨别性特征等细节,以及丰富的高级语义信息。

当深度学习技术与仿真红外船只图像相结合,就可以从大量仿真红外船只图像中学习到本应从真实红外船只图像中学习的信息。这些信息可以帮助神经网络优化各层参数,强化其对各个特征的提取、分析和判断能力,从而提高网络对海上红外船只图像的特征适应能力,最终实现对真实红外船只目标的准确检测。通过该方法生成的红外舰船目标图像具有自然的图像纹理特征,符合红外辐射特性,可有效提高红外舰船数据集的完整性和可用性。

图7 是利用仿真生成的红外船只目标仿真序列,为模拟海上船只可能出现的尺度变化和角度变化,让船只在视场内产生从0 到360°的角度变化,间隔30°;产生从0 到8000 m 的高度变化,间隔100 m;产生从0到80°的视角变化,间隔5°。

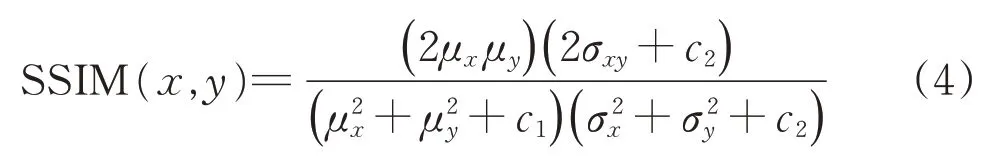

为了评估仿真红外图像与真实红外图像的相似性,本文用结构相似性(SSIM)指标来进行评价。SSIM 值越大,意味着仿真红外图像与真实红外图像的差异越小,图像的仿真效果越好。SSIM 的定义如下:

式中:x、y为两幅图像(在这里分别代表仿真红外图像与真实红外图像);μx和μy分别为x和y的灰度平均值;σx和σy分别为x和y的灰度方差;σxy为x和y的灰度协方差;c1和c2用于维持SSIM 数值的稳定,c1=k1L,c2=k2L(其中,L为图像灰度值的动态范围,k1和k2是试验总结的经验值,k1=0.01,k2=0.03)。

SSIM 的计算结果为-1 到1 之间的小数。若结果为1,说明对比的两幅图像在结构上完全一致,当两张图像之间满足SSIM ≥0.7时,就可以认为两个图像相似。计算仿真红外舰船图像与真实红外舰船图像的SSIM 值,得出本文仿真生成的红外图像SSIM 均值达到0.795 1,方差为0.003 2。由于SSIM>0.7,可知基于此方法生成的仿真红外图像与真实红外图像高度相似。

4 试验验证情况

本文针对上述海上红外舰船图像的小样本问题,利用海上红外舰船图像中特征的不变性,研究了一种基于深度迁移学习的红外舰船目标检测方法。采用大量仿真红外舰船数据集和少量真实红外舰船数据集训练深度学习网络,试验采用2×TITAN V显卡,单卡5 120个CUDA核,显存12G,测试结果如图8所示。

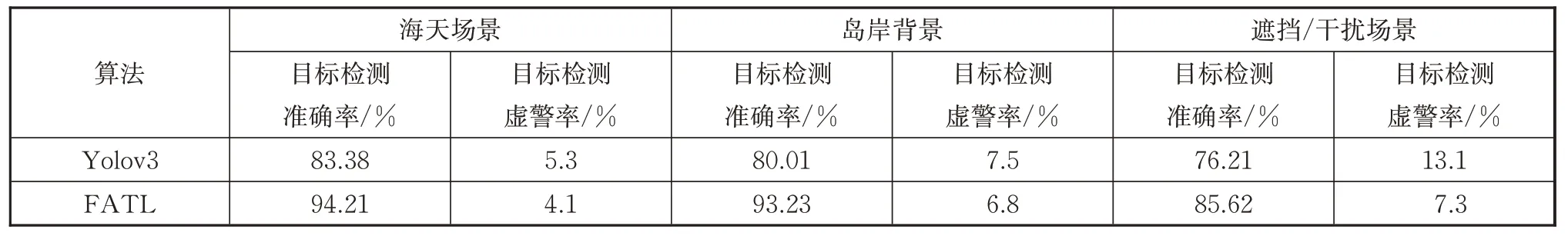

如图8 所示,采用大量仿真红外舰船数据集和少量真实红外舰船数据集进行训练,用真实图像进行检测时,可以做到准确检测。将FATL算法与Yolov3算法进行对比试验,如表1所示,在大量仿真图像的训练条件下,Yolov3 的适应能力较差,对正确目标的检出率较低,对错误目标有较高的误检率。而本文提出的算法显著提升了目标检测准确率,降低了目标检测虚警率,而且对于存在火光干扰和部分遮挡的红外舰船目标以及岛岸背景条件下的红外舰船目标都有准确的检测结果。由此可以证明,本文提出的结构具有跨域迁移性和环境适应性,在面对真实海上红外舰船目标时具有较好的检测效果。

表1 FATL算法与Yolov3算法的对比Tab.1 The comparison of the FATL algorithm with the Yolov3 algorithm

图8 真实红外舰船目标检测效果Fig.8 Real infrared ship target detection effect

5 结束语

对于复杂海面场景,能够准确地检测红外舰船目标对于实际作战应用有重要意义。由于客观条件限制,海面红外目标场景数据较少,因此,为了降低深度学习对红外图像数据量的需求,本文创新性地使用大量仿真红外舰船数据和少量真实红外舰船数据,利用FATL 方法实现跨域目标检测功能。通过试验证明,本文提出的算法对于真实红外舰船目标具有较好的检测效果。