基于拦截无人机反制“低慢小”目标的新型防御系统

2021-12-20翟羽佳

史 民,翟羽佳,马 俊,陈 靓

(北京新风航天装备有限公司,北京 100100)

1 反“低慢小”防御系统

1.1 研究背景

近年来,随着以多旋翼无人机为代表的“低慢小”目标技术的飞速发展以及国家政策对低空空域的逐步开放,“低小慢”目标带来的低空安全威胁越来越大[1-2]。这使得反“低小慢”目标技术及其装备应用逐步成为发展热点,反“低小慢”目标的项目、技术如雨后春笋般不断涌现[3]。

目前的反“低小慢”目标的防御系统普遍存在探测难、缺乏有效拦截手段等问题。不同于国内外现有的反“低小慢”防御系统,本文提出了一种集雷达与光电复合探测、以“无人机反无人机”为反制策略的综合防御系统,在拦截处置上具有直接、高效、低成本等优点。

1.2 系统组成与配置

反“低慢小”防御系统主要由探测识别分系统、指挥控制分系统以及反制分系统组成,如图1所示。

图1 系统组成及配置

反“低慢小”防控系统中的探测识别分系统主要由低空雷达、光电识别跟踪设备组成。其中,低空雷达主要功能是探测预警、显示目标航迹、显示目标速度和位置信息等,光电设备主要用于对目标进行识别确认和留存取证信息。

反“低慢小”防控系统中的指挥控制分系统主要由指控计算机和指控软件构成。其主要用于接收雷达设备的目标信息,实时解算目标的运动要素,并指挥调度光电对已捕捉的目标进行识别确认,最后控制反制分系统对“低慢小”目标进行拦截处置,如图2所示。

反“低慢小”防控系统中的反制分系统主要由反制无人机和无人机地面控制系统构成。

1.3 系统工作过程

探测系统发现目标后预警并将预警信息和目标信息发给指控分系统,指控分系统进行综合信息处理,发送反制指令和预测拦截点位置信息给无人机地面控制系统,无人机地面控制系统控制无人机起飞并飞至预测拦截点,到达预测拦截点后控制无人机切换自主搜寻模式,无人机依靠自身视觉系统识别并稳定跟踪目标,飞向并毁伤目标,完成拦截处置,如图2所示。

图2 各系统及设备间信息交互关系

2 目标分析

2.1 目标特性分析

“低慢小”目标飞行高度低、飞行速度慢、RCS小,采用电池动力,红外辐射特性不明显。

以0.4 m×0.4 m的四旋翼无人机为例,其典型雷达截面积(RCS)约为0.01 m2,一般飞行高度在20 m~200 m范围内,飞行速度小于15 m/s。

对于城市防护场景,除了雾霾、浮尘、雨雪等气候因素影响,高层建筑物、反射玻璃幕墙、灯光、车辆等背景干扰源影响也很突出,因此,及时发现、识别、跟踪“低慢小”目标更为困难。

2.2 典型任务剖面

四旋翼无人机典型任务剖面为:起飞→爬升→巡航→抵达任务区执行任务(盘旋/悬停)→返航→下降→降落,如图3所示。

图3 无人机典型任务剖面示意图

任务一般包括:侦察、拍摄或监视;投递/发射相关物品,如弹药、补给及其他物品[4]。

3 关键过程

3.1 探测跟踪

在“低慢小”目标的探测方面,需要重点关注其低空/超低空、慢速、红外辐射特性弱/雷达反射截面积小等几个特点。

对于雷达来讲,意味着雷达需要具有良好的低空复杂背景下微弱目标检测性能,具有较高的速度分辨率,同时,因为旋翼无人机悬停状态会使传统的基于运动多普勒的雷达检测方法失效,还应在基于旋翼叶片旋转给雷达回波带来相位调制的微多普勒效应上有针对性进行解决。

采用经典的探测模式:应用雷达监控远处,锁定目标后转由光电设备进行识别确认及跟踪[5],并在目标靠近时实施反制。

3.1.1 目标航迹

目标在自身飞行坐标系下,运动姿态相应的指标为v(飞行速度),Ψ(航向角),Θ(俯仰角)。将目标的飞行位置纳入站心直角坐标系,站心直角坐标系的原点设定为指控中心位置,地磁东方向为E轴正方向,地磁北方向为N轴正方向,指控中心正上方为D轴正方向,目标点的坐标投影到N/E/D坐标轴上的值,用(x,y,z)来表示。在该坐标系下对于目标的飞行航迹建模,参考公式[6-7](1)~(2):

Sn=v*Δt

(1)

(2)

式中,Sn为Δt时段内目标飞行的距离,单位为m;(xn,yn,zn)为tn时刻目标的位置,单位为m;(xn+1,yn+1,zn+1)为tn+Δt时刻目标的位置,单位为m。

雷达球坐标系坐标原点位置与指控中心原点重合,坐标原点与目标连线为极径,极径与其EON平面的水平投影所成角为目标相对于雷达的仰角Ω,水平投影与N轴正向所成角为目标相对于雷达的方位角φ。

3.1.2 拦截位置解算

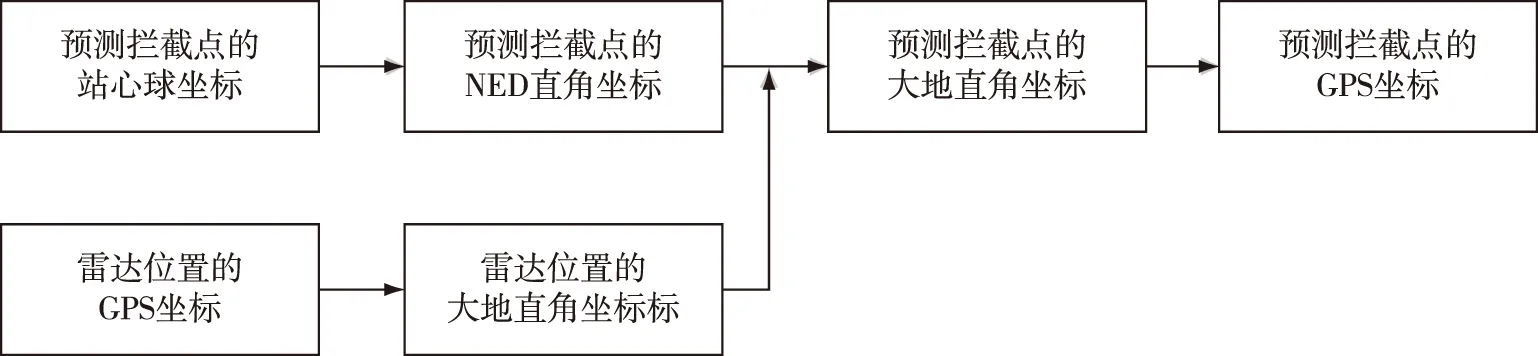

通过雷达获取目标的相对位置信息,并根据目标的运动速度和运动规律预测目标拦截位置,由于反制无人机依靠GPS定位,指控系统把预测目标拦截位置以GPS格式通过Mavlink协议无线发送给反制无人机。

具体格式转换过程:首先将预测拦截位置点的相对位置信息(R、Ω、φ)由站心球坐标转换为站心直角坐标;然后,结合雷达所处位置的GPS信息和预测拦截点的站心直角坐标,再将其转换到大地直角坐标系下;最后,再将预测拦截位置点的大地直角坐标转换到GPS坐标系下[8-9]。各个坐标系之间的转换流程图如图4所示。

图4 坐标转换流程图

雷达所在位置的GPS准确值(记为B1,L1,H1)可以通过高精度定位仪测得,根据公式(3)转换为大地直角坐标(记为X1,Y1,Z1)。

(3)

由站心球坐标系向站心直角坐标系的转换公式

(4)

由站心直角坐标系向大地直角坐标系的转换公式

(5)

再经过坐标平移,就能得到预测拦截位置点的大地直角坐标值(记为X2,Y2,Z2)。

(6)

根据得到的预测目标拦截位置的大地直角坐标(X2,Y2,Z2),采用近似直接法即可得到预测目标拦截位置的GPS坐标值(记为B2、L2、H2)。

(7)

3.2 反制策略

反制无人机收到拦截指令及预测目标拦截位置信息,飞向预测拦截点并切换自主搜寻模式,机载视觉导引系统识别并捕获目标,导引反制无人机拦截并毁伤目标。

3.2.1 反制无人机系统组成

反制无人机系统主要由高强度碳纤维多旋翼机身、动力系统、飞行控制系统、视觉导引系统、通信系统、地面站系统等组成,各系统功能及系统间功能关系如图5所示。

图5 反制无人机系统组成示意图

3.2.2 视觉识别与导引

视觉导引系统中包括目标检测和目标跟踪两个部分,采用基于深度学习的方法实现目标检测和跟踪的功能。其中,目标检测采用Yolo的深度学习框架,目标跟踪采用GoTurn的深度学习框架。深度学习框架采用改进版精度浮点型的方式,提高目标检测和跟踪的运算速度。

视觉导引系统的处理器安装Ubuntu操作系统,以及Open CV视觉处理库、ROS框架、Tensorflow等软件库。平台软件由上层图像处理部分与下层飞行控制部分两部分组成:上层部分用于处理视觉传感器采集到的图像信息,解算目标位置信息,进而通过串口反馈给下层飞行控制系统[10],控制反制无人机跟踪目标。

视觉识别与跟踪流程分为目标图像搜索、目标识别、目标跟踪以及控制反制无人机飞行等几部分,如图6所示。

图6 视觉识别与跟踪系统流程

1)目标图像搜索:反制无人机收到指令飞向预测拦截位置后,通过机载视觉传感器自动搜索目标。

2)目标识别:当目标进入机载视觉传感器视场后,对目标图像使用YOLOv4-Tiny进行检测确认,判断是否为需要跟踪的目标,如果目标识别通过,则保存其像素坐标用于目标跟踪初始化。

3)目标跟踪及控制反制无人机飞行:目标识别通过后,使用检测到的目标初始化跟踪器,根据目标在图像中的实际位置与设定的预期位置的偏差生成误差信号,来驱动控制器生成基于图像坐标系的控制速度,再通过图像坐标系与机体坐标系的关系将速度指令转换到机体坐标系下,从而控制反制无人机飞向并毁伤目标。

基于图像的视觉伺服控制方法设计PID控制器,对于视觉传感器采集的分辨率为W0×H0的图像,视觉识别与跟踪模块得到的跟踪结果形式为(xp,yp,wp,hp),其中xp,yp为目标跟踪矩形框的左顶点,wp为目标跟踪矩形框的宽度,hp为目标跟踪矩形框的高度,则目标跟踪结果矩形框的中心为

(8)

设定预期的目标中心位置为(xpe,ype),则图像坐标系下二维正交两个方向上的偏差exx与eyy为

(9)

通过计算目标跟踪结果框占图像面积的比例来估算反制无人机相对于被跟踪目标的距离,目标跟踪结果框的近似面积与预期目标面积的偏差err表示为

err=rpe-rpc

(10)

其中,rpe为设定的预期目标近似圆的半径,rpe=(W0+H0)/2N(N为比例系数);rpc为被跟踪的目标近似成圆形的设定半径,rpc=(wp+hp)/4。

将误差在图像中所占像素的比例分别定义为偏差率(fx,fy,fr)

(11)

通过像素偏差计算无人机与目标的水平位移,设计位置-姿态的外内环控制器,外环根据位置参考值[xd,yd,zd]T得到内环姿态的期望角度[Φd,Θd]T,内环根据期望角度得到无人机最终的控制量U,U=[U1,U2,U3,U4]T,其具体表达式为[11]

(12)

其中,ωi表示第i号旋翼的转速,CT表示升力系数,CQ表示扭矩系数。结合四旋翼无人机的飞行原理可以看出,U1表示四个电机提供的总升力,U2表示沿机体坐标系Y方向的电机升力差,U3表示沿机体坐标系X方向的电机升力差,U4表示四个电机提供的总扭矩。跟踪控制器结构框如图7所示。

图7 跟踪控制器结构框

通过多次实际飞行寻优控制器参数,利用Mavlink通信协议在地面站软件中对控制参数实现在线调整。

4 仿真计算与测试

4.1 目标航迹仿真

为了模拟“低慢小”目标的来袭,按照四旋翼无人机典型任务剖面,模拟其从“垂直起飞”→“爬升”→“巡航”的持续过程。假设目标的起始坐标为(2000,2000,0),各飞行阶段的飞行参数如表1所示。

表1 飞行参数表

目标航迹仿真如图8所示,目标每个时间步长飞过的三维位置显示在图中的一个点,当各飞行阶段飞行结束后,图中各点形成的线,就代表了目标的飞行航迹。

图8 目标航迹仿真

4.2 位置解算仿真

表2 计算结果

4.3 目标识别与跟踪测试

通过网络搜集及拍摄大量的目标图像用以制作数据集,标注数据集并对Tiny-YOLOv4网络进行训练,得到用于检测和识别目标的权重文件,目标识别通过后,获取当前帧目标在像素坐标系下的位置,进而初始化目标跟踪器,然后根据目标在第一帧图像中的位置,对后续图像序列进行解析,估算出后续每一帧中所要跟踪目标的位置。目标检测与识别的测试如图9所示。基于KCF算法的目标跟踪效果测试表明,当目标发生运动时,跟踪框也能够随目标运动继续跟踪目标,结果如图10所示。

图9 目标检测与识别图像

4.3.1 目标识别效果测试

系统主要的防御对象是以市场普遍的大疆精灵系列为典型目标,以大疆精灵系列的目标图像制作数据集进行训练,为了验证目标识别算法的有效性,设计实验进行测试。首先对大疆精灵4和大疆御Mavic2进行了对比测试,之后将大疆御Mavic2扩增到数据集重新测试对比。实验中视觉传感器距离目标距离10 m,目标背景均为纯色天空,测试时间1 min,帧率30 fps,共1 800帧,每组采集3次。

从表3中可以看出,基于对已知目标图像训练集训练的结果,在对未训练的旋翼无人机识别时效果一般,还需扩增数据集以提高有效识别率。

针对纯净天空、建筑物、树林三种不同场景同样对检测效果进行了测试。实验中以大疆精灵4为目标,视觉传感器距离目标距离10 m,测试时间1 min,帧率30fps,共1 800帧,每组采集3次。

从地面升空跟踪“低慢小”目标,目标一般以天空为背景,与从空中跟踪地面目标相比,背景环境相对简单。从表4中也可以看出,针对纯净天空、建筑物、树林背景的三种不同场景,总体的识别可以达到 95%以上的正确率。

表4 不同场景情况下目标检测结果表

4.3.2 目标跟踪效果测试

为了评估反制无人机的跟踪效果,使用误差在图像中所占像素的比例(fx,fy,fr)作为评估系统跟踪效果的参数。

机载视觉传感器的图像分辨率为640×360,像素中心坐标为(320,180),将跟踪过程中目标框中心坐标带入公式(11),得出各参数在跟踪过程中的曲线。

令反制无人机与目标无人机作追逐实验,两者保持等高、同向、同速、定距(10 m)做匀速直线运动。图11和图12为运动速度分别为0.5 m/s及1 m/s情况下fx和fy的对比曲线。

图11 fx曲线

图12 fy曲线

跟踪过程中目标框中心基本保持在图像中心 35%误差之内,反制无人机可以稳定跟踪目标飞行。

需要说明的是,通过增加实验发现,当运动速度大于2 m/s时,跟踪质量出现明显下降,后续可以通过增加伺服云台、提高伺服响应速度、进一步优化跟踪和控制算法有针对性进行解决。

还有一点说明,反制无人机起初的机载图像处理平台使用的是英伟达公司的 Jetson TX2 处理器。之后更换了性能更为强大的Jetson NX,并利用NVIDIA 所推出的深度学习加速引擎TensorRT进行了优化,将目标识别的每秒帧率(fps)由原来的30左右提高到了120以上,但是跟踪效率并没有明显的提升。

5 结束语

目前,国内外反无人机系统正处于快速发展阶段。与电磁干扰、激光等反制手段相比,以无人机反制无人机的反无人机具有“简单直接、效率高、成本对称”等优势,是低空近程反制“低慢小”目标的一条极具发展潜力的技术路线。本文提出的新型“低慢小”目标综合防御系统,引入了基于深度学习的目标识别与目标跟踪算法,为防御“低慢小”目标的威胁提供了高效、低成本的措施,是对反无人机系统领域的重要探索。